人工知能

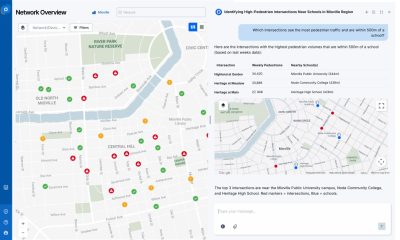

DeepSeek-V3公開: ハードウェアに優しいAI設計がコストを削減し、パフォーマンスを向上させる方法

DeepSeek-V3は、コスト効率の高いAI開発におけるブレークスルーを表しています。ハードウェアとソフトウェアの共同設計が、過剰なコストなくても最先端のパフォーマンスを提供できることを実証しています。2,048個のNVIDIA H800 GPUでのみで訓練されたこのモデルは、Multi-head Latent Attentionによるメモリ効率の向上、Mixture of Expertsアーキテクチャによる計算の最適化、FP8混合精度訓練によるハードウェアの潜在能力の解放など、革新的なアプローチを通じて著しい成果を達成しています。このモデルは、知的な設計選択によって、小規模チームが大手テック企業と競争できることを示しています。

AIスケーリングの課題

AI業界は、根本的な問題に直面しています。大規模な言語モデルは、より大規模で強力になっているですが、それらは同時に、ほとんどの組織が負担できない巨大な計算リソースを必要とします。Google、Meta、OpenAIなどの大手テック企業は、数万または数十万のGPUを持つトレーニングクラスターを展開しています。これは、小規模な研究チームやスタートアップが競争することを困難にしています。

このリソースギャップは、AI開発を数少ない大手テック企業の手に集中させる可能性があります。AIの進歩を促すスケーリング法則は、より大規模なモデル、より多くのトレーニングデータ、計算リソースがより優れたパフォーマンスにつながることを示唆しています。ただし、ハードウェア要件の指数関数的増加により、小規模プレーヤーがAIレースで競争することがますます困難になっています。

メモリ要件は、別の重大な課題として浮上しています。大規模な言語モデルは、重要なメモリリソースを必要とし、需要は年間で1,000%以上増加しています。一方、高速メモリ容量は、年間50%以下のペースでしか成長しません。この不一致により、研究者が「AIメモリウォール」と呼ぶ現象が生じ、メモリが計算能力よりも制限要因となるようになります。

状況は、モデルが実際のユーザーにサービスを提供する際に、さらに複雑になります。モダンなAIアプリケーションは、多回の会話や長いコンテキストを伴うことが多く、メモリを大量に消費する強力なキャッシングメカニズムを必要とします。従来のアプローチは、すぐに利用可能なリソースを圧倒し、効率的な推論を重大な技術的および経済的課題にする可能性があります。

DeepSeek-V3のハードウェアに優しいアプローチ

DeepSeek-V3は、ハードウェア最適化を念頭に設計されています。大規模なモデルをスケールアップするために、より多くのハードウェアを使用するのではなく、DeepSeekは、既存の制約内で効率を最適化するハードウェアに優しいモデル設計に焦点を当てました。このアプローチにより、DeepSeekは、2,048個のNVIDIA H800 GPUのみを使用して、最先端のパフォーマンスを達成することができます。これは、競合他社が通常必要とするものの、ごく一部です。

DeepSeek-V3の背後にある核心的な洞察は、AIモデルが、最適化プロセスにおける重要なパラメータとしてハードウェア能力を考慮する必要があるということです。モデルを分離して設計し、次にそれらを効率的に実行する方法を決定するのではなく、DeepSeekは、ハードウェアを理解した上でAIモデルを構築することに焦点を当てました。この共同設計戦略により、モデルとハードウェアが効率的に協調して動作し、ハードウェアを固定された制約として扱うのではなく、効率的に動作します。

このプロジェクトは、特にDeepSeek-V2の重要な洞察に基づいています。DeepSeek-V2は、DeepSeek-MoEやマルチヘッド潜在的注意などの革新的なアイデアを導入しました。ただし、DeepSeek-V3は、これらの洞察を拡張し、FP8混合精度訓練を統合し、インフラストラクチャコストを削減する新しいネットワークトポロジーを開発しています。

このハードウェアに優しいアプローチは、モデルだけでなく、トレーニングインフラストラクチャ全体に適用されます。チームは、従来の3層トポロジーに代わるマルチプレーン2層ファットツリー ネットワークを開発し、クラスタネットワークのコストを大幅に削減しました。これらのインフラストラクチャイノベーションは、思慮深い設計が、AI開発パイプライン全体で大幅なコスト削減を達成できることを示しています。

効率性を高めるための重要なイノベーション

DeepSeek-V3には、効率性を大幅に向上させるいくつかの改善が含まれています。1つの重要なイノベーションは、メモリ使用量の高い推論に対処するマルチヘッド潜在的注意(MLA)メカニズムです。従来の注意メカニズムでは、すべての注意ヘッドのKeyおよびValueベクトルをキャッシュする必要があります。これは、会話が長くなるにつれて大量のメモリを消費します。

MLAは、プロジェクトマトリックスを使用して、すべての注意ヘッドのKey-Value表現を小さい潜在ベクトルに圧縮することで、この問題を解決します。推論中には、この圧縮された潜在ベクトルのみをキャッシュする必要があり、メモリ要件を大幅に削減します。DeepSeek-V3では、トークンあたり70 KBのみが必要です。一方、LLaMA-3.1 405Bでは516 KB、Qwen-2.5 72B1では327 KBが必要です。

専門家の混合アーキテクチャも、別の重要な効率性の向上を提供します。モデル全体を各計算で活性化するのではなく、MoEは各入力に対して最も関連性の高い専門家ネットワークのみを選択的に活性化します。このアプローチにより、モデル容量を維持しながら、各フォワードパスの実際の計算量を大幅に削減します。

FP8混合精度訓練により、16ビットから8ビットの浮動小数点精度に切り替えることで、効率性がさらに向上します。これにより、メモリ消費量が半分になりながら、トレーニングの品質が維持されます。このイノベーションは、AIメモリウォールに対処し、利用可能なハードウェアリソースの使用をより効率的にします。

マルチトークン予測モジュールは、推論中にも別の効率性の層を追加します。1トークンずつ生成するのではなく、このシステムは、複数の未来のトークンを同時に予測でき、推論速度を大幅に向上させます。スペキュラティブデコーディングにより、全体的な応答生成時間が短縮され、ユーザーエクスペリエンスが向上し、計算コストが削減されます。

業界への重要な教訓

DeepSeek-V3の成功は、より広いAI業界にいくつかの重要な教訓を提供します。効率性のイノベーションは、モデルサイズのスケーリングと同等に重要であることを示しています。このプロジェクトは、慎重なハードウェアとソフトウェアの共同設計が、AI開発を制限する可能性のあるリソース制限を克服できることも強調しています。

このハードウェアに優しい設計アプローチは、AIの開発方法を変える可能性があります。ハードウェアを制限として扱うのではなく、モデルアーキテクチャを形作る上で中心的な設計要素として扱うことができます。この心構えの転換により、業界全体でより効率的でコスト効率の高いAIシステムが実現します。

MLAやFP8混合精度訓練などのテクニックの有効性は、効率性を向上させる余地がまだまだあることを示しています。ハードウェアが進化するにつれて、新しい最適化の機会が生まれます。これらのイノベーションを活用する組織は、増大するリソース制約の世界で競争するために、より良い準備が整っています。

DeepSeek-V3のネットワークイノベーションも、インフラストラクチャ設計の重要性を強調しています。モデルアーキテクチャやトレーニング方法に多くの焦点が当てられている一方で、インフラストラクチャは全体的な効率性とコストに重要な役割を果たします。AIシステムを構築する組織は、モデル改善と並行してインフラストラクチャの最適化に重点を置く必要があります。

このプロジェクトはまた、オープンな研究とコラボレーションの価値を示しています。DeepSeekチームは、洞察とテクニックを共有することで、AIの進歩に貢献し、効率的なAI開発のリーダーとしての地位を確立しています。このアプローチは、進歩を加速し、重複作業を減らすことで、業界全体に利益をもたらします。

まとめ

DeepSeek-V3は、人工知能の重要な進歩です。慎重な設計が、モデルを単純にスケールアップすることよりも優れたパフォーマンスを提供できることを実証しています。マルチヘッド潜在的注意、専門家の混合層、FP8混合精度訓練などのアイデアを使用することで、モデルはトップレベルの結果を達成しながら、ハードウェア要件を大幅に削減します。このハードウェア効率への焦点は、小規模な研究所や企業が、大きな予算なしに先端的なシステムを構築する新たな機会を提供します。AIが進化するにつれて、DeepSeek-V3のようなアプローチは、進歩が持続可能で、よりアクセスしやすいものとなるために、ますます重要になります。DeepSeek-V3は、さらに広い教訓も提供します。賢いアーキテクチャ選択と徹底的な最適化により、膨大なリソースやコストを必要とせずに、強力なAIを構築できます。このように、DeepSeek-V3は、業界全体に、コスト効率の良い、より手頃なAIへの実用的な道筋を提供します。これにより、世界中の多くの組織やユーザーが利益を得ることができます。