ソートリーダー

自律エージェントにはAIの観察可能性だけでなくさらに多くのものが必要

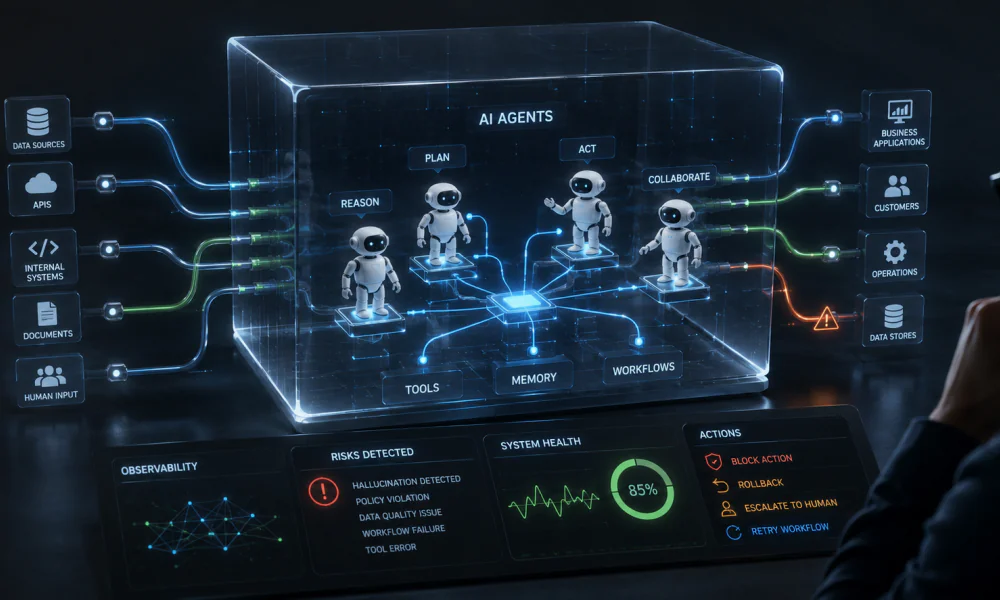

企業がAIエージェントを使用して思考、行動、ワークフローを開始するにつれて、それらを監視および管理する計画を開発することが不可欠です。

AIシステムのさまざまなコンポーネントが独自の決定を下し始めると、観察可能性だけでは運用が安定した、安全で、信頼できるものであることを保証することができません。

企業がエージェントを効率的に管理するには、問題の特定と対策の間のギャップを埋める必要があります。そのためには、問題を単に観察するのではなく、積極的にそれを防ぐ必要があります。

自律エージェントの出現

企業での初期のAIの波は、プロンプトベースのシステムでした。ユーザーが質問を投げかけたとき、モデルが応答し、そこでやり取りは終了しました。初期のテクノロジーは本質的に反応的でしたが、検索、コピロット、コンテンツ作成、要約に役立ちました。

次の波は異なります。自律AIエージェントは反応するだけでなく、目的を越えた推論を行い、ツールを選択し、情報を抽出して行動を起こし、ワークフローを開始します。時には他のエージェントやシステムと共同で動作し、企業内で人的指示のインターフェース層ではなく、運用プレイヤーとしての役割を果たします。

この変化は重要です。AIの運用特性に影響を及ぼします。チームはもはやモデル出力だけに注目していません。代わりに、瞬時にクライアント、スタッフ、インフラストラクチャ、ビジネスプロセス、他のアプリケーションに影響を与えることができるダイナミックなシステムを管理しています。

現在のエージェントの能力

エージェントの能力は進化しています。エージェントは次のことを選択できます。目標をステップに分解し、さまざまなレベルでアクティビティを完了します。APIに接触することで、データベースに照会することで、内部システムを検索することで、レコードを更新することで、ダウンストリームのアクションを開始することで、ワークフローを調整します。プロンプト、メモリ、ビジネスルール、取得した情報、リアルタイムの運用シグナルを統合することで、エージェントはコンテキストベースの判断を下すこともできます。

より洗練されたエージェントは、ワークフローが失敗していることを認識できます。再試行できます。問題をエスカレートできます。または、ジョブを人間のレビューアーに転送できます。CRM、チケット、クラウドインフラストラクチャ、内部ナレッジベース、観測可能性プラットフォーム、ビジネスアプリケーション内で、エージェントは独立して機能できます。エージェントのスキルは急速に拡大することが予想されます。

企業での自律AIエージェントの統合

エージェントは、速度、精度、安全性、ガバナンスが重要な、拡大する範囲の組織運用に統合されています。そうした運用には、以下のようなものがあります。カスタマーサービスとケースハンドリング、インシデントレスポンスとIT運用、DevOpsとサイトの信頼性のワークフロー、コード修正とソフトウェア開発、運用とサプライチェーンの計画などです。

新たな運用上の脅威

しかし、エージェントがより独立性を獲得するにつれて、企業は新たな種類の運用上のリスクに対処する必要があります。

- 悪い選択は単に提案されるのではなく、実行されることがあります

- 軽微なミスはすぐに他のリンクされたシステムに広がる可能性があります

- 現実世界のアクションは、幻覚によって引き起こされる可能性があります

- エージェントはビジネス意図、ポリシー、またはコンプライアンスから逸脱する可能性があります

- 複数のコンポーネント間の相互作用により、障害が発生する可能性があります

- 自動化された意思決定は、人間の評価よりも迅速に決定を下す可能性があります

チームは症状を観察するかもしれませんが、システムの動作の背後にある理由を理解することもできなければなりません。企業のAIには、可視性に加えて、信頼性の制御が必要です。

AIシステムの複雑さ

今日のAI駆動システムは、まれに単一のモデルで構成されています。多くの相互作用するコンポーネントで構成された分散型、階層化されたシステムです。以下のようなものが含まれます。

- 基礎モデル(LLM)

- ファインチューンされたモデルまたはタスク固有の小規模言語モデル(SLM)

- 埋め込みモデル

- ベクトルデータベース

- 取得パイプラインとRAGコンポーネント

- プロンプトテンプレートとプロンプトオーケストレーションレイヤー

- トレーニングデータと評価データ

- ガードレールとポリシーレイヤー

- エージェントとワークフロー

- ツール呼び出しシステム

- テレメトリ(ログ、メトリクス、トレース)

- ヒューマンインザループ承認チェックポイント

それらのリスク

各コンポーネントは異なる故障モードを追加し、それらの相互作用はさらに複雑性を追加します。システムがインフラストラクチャレベルで強固に見えても、悪い選択を下し、満足のいく結果を生成し、表面下で運用上のリスクを蓄積する可能性があります。

関連するリスクには、以下のようなものがあります。データパイプラインによって、低品質または汚染された入力が導入されること、インフラストラクチャのボトルネックによって信頼性が低下すること、有害または誤った結果が生じること、人間のレビューに対する運用上のボトルネックが生じることなどです。さらに、複数のエージェントまたはステップを持つシステムは、すぐに明らかでない方法で故障する可能性があります。

AIの観察可能性

伝統的な監視は、プロンプトの動作、取得の品質、モデルドリフト、エージェントの実行チャネル、またはAIの動作とダウンストリームのビジネスまたは運用上の影響を理解するには不十分です。

そこで、AIの観察可能性が重要になります。AIの観察可能性により、チームは、入力、出力、望ましい動作、システムによって生成される決定シグナルを収集、関連付け、評価することで、実稼働環境でのAIシステムの動作を理解できます。これは、AIシステムが分散型、非決定論的、非常にコンテキストに敏感であるため、不可欠です。

AIの観察可能性により、チームは、プロンプト、モデル、取得レイヤー、ツール、ダウンストリームシステムが実行中にどのように相互作用するかを、エンドツーエンドの洞察を得ることができます。

AIの観察可能性により、待ち時間、コスト、トークン使用、スループット、エラーレート、モデル動作、出力品質指標などのパフォーマンスと動作を監視できます。複雑なエージェントワークフローでの実行パスのトレースと分析により、複数のステップと依存関係を経て結果が得られる方法を示します。

AIの観察可能性はまた、運用およびAIシグナル全体で異常を検出することで、モデル、パイプライン、インフラストラクチャ、またはユーザー向け結果での異常な動作を、チームが手動で検出する前に公開します。何かが間違ったときに診断を迅速化し、システムテレメトリ(ログ、メトリクス、トレース、イベント)にAI固有の操作を含めることで、根本原因の調査を容易にします。

観察可能性だけは不十分

AIの観察可能性は不可欠なビジネス慣行ですが、固有の制限があります。

観察可能性は、診断的ではなく、予防的です。チームは何が間違ったのかを学ぶことができますが、必ずしもそれが再び起こらないようにする方法を知ることはできません。エージェントの過去の行動についての知識が、自動的にエージェントの将来の行動を制御するものにはなりません。

複雑な非決定論的システムでは、観察可能性はチームをデータで圧倒し、不確実性につながることがよくあります。運用上の答えを提供するのではなく、説明で終わることがよくあります。チームは問題を認識しているかもしれませんが、是正措置を講じるために、自動化、セーフガード、制御ループが不足している可能性があります。

これにより、運用上のギャップが生じます。企業は問題を発見できますが、それが再発するのを防ぐ、影響を軽減する、または自律システムを安全な運用パラメータ内で維持することができない可能性があります。

これは、チームが反応的に運用を継続することを意味します。何かが壊れたときに手動介入を使用し、事後にインシデントを調査し、システムがより速く自律的になるにつれて、人間の労力に頼る必要があります。

AIの信頼性の概要

AIの信頼性は、問題を単に観察するのではなく、AIシステムが実稼働環境で安全に、一貫性に、予測可能に、効果的に機能することを保証することを意味します。AIの信頼性は、AIを取り巻くシステム全体を理解し、管理します。検知と行動の間のループを閉じます。

AIの信頼性は、モデルが正確な応答を提供したかどうかだけに焦点を当てるのではなく、AI駆動システム全体が合理的な運用制約内で機能するかどうかを検討します。品質、安全性、回復性、説明可能性、ポリシーのコンプライアンス、コスト効率、運用上の安定性がすべてこの方程式の一部です。

検出から予防への移行

AIの信頼性は、問題を認識して対処するまでの時間を短縮します。問題が何だったのかから、AIをどのように迅速に改善できるのかへの対話に移行します。以下のテクニックを使用することで、観察可能性を被動的な観察から予防的な予防へと移行できます。

- モデル、データ、インフラストラクチャ全体のシグナルを相関させて問題を特定する

- 影響が出る前に事前に問題を検出する

- 確率的AIシステムのすべての入力と出力を検証して、微妙な動作の変化を検出する

- 生産環境での望ましくない出力を検出して、それを使用して基礎となるモデルの精度を向上させるためのファインチューニングデータを生成するためのフィードバックループを作成する

- 複雑なエージェントワークフローをトレースして、複雑なアクションを通知するためにデータがどのように進化したかを把握できるようにする

- 安全な対応と自動化された救済のための、人間がループ内にあるエージェントワークフローを定義する

制御と観察のギャップを埋める

企業は、可視性と制御を統合するフレームワークから利益を得ることができます。生成的なAIの上に観察可能性レイヤーだけでは不十分です。決定論的および非決定論的システムの両方で、信頼性プラットフォームは問題を特定、予測、説明、および制御することができます。

信頼できるAI運用のための実行可能なフレームワークには、以下のものが含まれます。

- ITシステムとAIシステムの両方の統合テレメトリ

- エージェントワークフローとシステム依存関係のエンドツーエンドトラッキング

- AI固有の動作と品質トラッキング(プロンプトと評価)

- あらゆるソースからの高度な異常検出

- 因果的推論と根本原因分析

- 環境に自動的に適応し、手動のしきい値を必要としないアラート

- ポリシーの施行とガードレール

- 繊細または重要なアクションのためのヒューマンインザループの評価

- ワークフローの自動化と救済の調整

- 問題を予防するための予測分析の使用

- 異常検出とAIモデル品質の向上を結びつけるフィードバックループ

AIの機能を促進する

AIシステムは、インフラストラクチャ、サービス、データパイプライン、運用ルーチンに依存しています。単独で故障しません。AIとITの信頼性を組み合わせることで、チームは全体像を把握できます。

薄いLLMラッパーは、信頼性の高いプラットフォームの基盤にはなりません。生成的なAIだけのツールが見落とす問題を特定して修正するには、生成的なAIに加えて、無教師AI、予測AI、因果AIなどのさまざまなAIテクニックを考慮する必要があります。このテクニックの組み合わせは、一般に「複合AI」と呼ばれます。

生成的なAIは、自然言語の要約に適しています。非構造化されたデータを推論したり、人間と対話したりする必要がある状況に最適です。しかし、実稼働環境でのほとんどの信頼性の問題には、適していません。

予測AIは、障害、悪い顧客体験、または高価な故障になる前に、早期の兆候を特定するために、異常検出アルゴリズムを使用します。

因果AIは、パフォーマンスの低下の原因が、取得の品質、モデル動作、インフラストラクチャの遅さ、上流のデータドリフト、または下流のシステムの故障であったかどうかを判断するのに役立ちます。

無教師AIは、人間の指示なしで、複雑で分類されていないデータ内に隠れたパターン、構造、または異常を自律的に発見します。信頼性のために、生成的なAIよりも優れています。なぜなら、複雑なデータ内に隠れた構造を発見して、類似のアイテムをグループ化したり、関係を特定したりすることに重点を置いているからです。

リスク、不確実性、またはビジネスへの影響が大きい場合、運用AIエージェントは、人間の関与を維持しながら、自動化された対応を実行できる必要があります。

ビジネスコンテキストの理解を強化するために、実稼働環境での実際のユーザーデータから強化学習を使用して、AIモデルのコンテキストの理解を向上させることができます。

最も高度なシステムは、アラートを超えて、クローズドループの救済を学習し、自動化された対応を実行し、安全な措置を開始します。

自律AIシステムの準備

企業は、自律AIシステムのためにいくつかの方法で準備できます。まず、エージェントは生産性ツールではなく、運用システムとして見なす必要があります。エージェントが行動する能力を持つようになると、企業の運用の不可欠な部分となり、適切に規制される必要があります。

チームは、モデル、プロンプト、ツール、ワークフロー、インフラストラクチャ、ユーザーの結果からシグナルをすぐに記録できます。エージェントをインストルメント化することで、この基本的な監視は、エージェントが企業にとって重要になるまで延期されるべきではありません。

エージェントの広範な展開前に、信頼性の基準を確立することも重要です。安全性、待ち時間、エラーレート、幻覚のリスク、ポリシーのコンプライアンス、ビジネスへの影響のための許容可能なしきい値は、事後に導入されるのではなく、設計時に組み込まれる必要があります。

AIの動作を、サポートする根本的なシステムとプロセスに結び付けることで、企業はAIとITの運用を統合できます。インフラストラクチャとモデル監視のために異なるツールを使用すると、盲点が生じます。

プラットフォームエンジニアリング、SRE、セキュリティ、データチーム、AIチーム、ビジネスオーナーが協力して、信頼性の高いAI運用を提供し、自律システムは従来のシロを超えています。

インシデント、異常、ニアミスをすべて運用にフィードバックループを組み込むことで、企業は生産環境の動作から継続的に学ぶことができます。

最後に、観察可能性だけではなく、制御に重点を置いたプラットフォームを選択することが重要です。エージェントがより自律的になるにつれて、企業は、観察可能性、予測、説明、行動を統合するシステムから利益を得るでしょう。

まとめ

企業でのAIは、ツールではなく、運用システムです。実稼働環境では、AIシステムに信頼性を追加することで、安全性、一貫性、予測可能性、効率性が保証されます。問題を特定して安全に結果を制御する企業が勝者となるでしょう。