Andersonの視点

AIによる汚染が検索結果を脅かし、情報の崩壊をもたらす

AIコンテンツがウェブを汚染するにつれ、新しい攻撃ベクトルが文化的合意の戦場に開かれる。

韓国の検索会社が主導する研究によると、AI生成ページが検索結果に侵入するにつれ、検索とランキングのパイプラインの安定性を損ない、Retrieval-Augmented Generation (RAG)などのシステムの信頼性を低下させる。これらのシステムは、ランキングに基づいてどの情報を提示し、信頼するかを決定するため、誤解を招くまたは不正確な情報が権威あるものとして扱われるリスクが増大する。

研究者们がこの症状に付けられた用語は、検索の崩壊である。これは、既知の脅威であるモデル崩壊(AIが自身の出力で学習し、徐々に悪化する)とは異なる。

検索の崩壊シナリオでは、AI生成コンテンツが検索エンジンの結果を徐々に支配し、回答が表面的に正確であっても、根底にある証拠ベースは人間の元の情報源から切り離される。しかし、この「根のない」データは検索結果の上位に到達する可能性が高い:

‘AI生成テキストの普及により、帰属と事前トレーニングデータの品質に関する課題が激化している。伝統的なキーワードスパムとは異なり、現代の合成コンテンツは意味的に一貫しており、ランキングシステムに溶け込んでパイプラインを通じて権威ある証拠として伝播することができる。’

この論文によると、これにより、ランキングシグナルがAI生成のSEO最適化されたページを優先し、時間の経過とともに人間による情報源をすり替える「構造的に脆い」環境が生まれる。つまり、回答の品質の明らかな低下なしに、すり替えが行われる。

‘ウェブ上のAI生成コンテンツの増加は、検索エンジンとRetrieval-Augmented Generation(RAG)システムが大規模言語モデル(LLM)によって生成された証拠を消費するにつれて、情報検索に対する構造的なリスクをもたらす。’

‘私たちは、このエコシステムレベルの故障モードを検索の崩壊として特徴付けている。これは、(1)AI生成コンテンツが検索結果を支配し、情報源の多様性を低下させ、(2)低品質または悪意のあるコンテンツが検索パイプラインに浸透する、2段階のプロセスである。’

研究者は、検索の崩壊が確立されると、同じ検索パイプラインが悪意のある汚染に対してより脆弱になることを主張している。なぜなら、悪意のあるページは、同じ最適化メカニズムを利用して可視性を獲得できるからである:

‘検索の崩壊の枠組みを確立することで、この研究は、合成コンテンツが情報検索を再構成する方法を理解する基礎を提供する。リスクを軽減するために、関連性、事実性、出典を共同で最適化する防御的なランキング戦略への移行を提案する。’

検索の崩壊は、モデル崩壊を悪化させる可能性がある。なぜなら、エントロピーの「コピー効果」に悪意のある意図を追加するからである。検索結果の「真実」に関する現時点での合意に影響を与えるだけでなく、不正確性や攻撃は、将来、訓練済みLLMに権威ある情報源として刻み込まれる可能性がある。

新しい研究は、ウェブを汚染するAIによる検索の崩壊というタイトルで、Naver Corporationの3人の研究者によって行われた。

方法

検索システムを介してAI生成コンテンツがどのように伝播するかをテストするために、研究者は、MS MARCOデータセットとベンチマークから、1000のクエリ/回答のペアをランダムに抽出した。これらは、検索を根拠づけるために使用されたほか、生成された回答の事実的正確性を評価するために使用された。

テストの各MS MARCOクエリに対して、Google検索から上位のSEO結果に基づいて10個のWebドキュメントが取得され、合計10,000個のドキュメントが生成された。

ドキュメントの事実的有効性は、GPT-5 Miniを判定者として使用して、MS MARCOの基準事実と比較することで評価された。

コンテンツファームシミュレーション

コンテンツファームに関連する通常の(非悪意の)記事の品質レベルをシミュレートするために、著者は、GPT-5 Nano OpenAIモデルを使用して、新しい合成記事を実際に生成した。これは、コンテンツミルが使用する可能性のあるAIの「経済的」レベルだからである。事実的正確性を評価するために使用されるGPT-5 Miniは、わずかに能力の高いモデルである。

一方、悪意のある投稿(誤情報を広めることを意図したコンテンツ、または誤情報を特徴とするコンテンツ)をシミュレートするには、実際の参照先は使用されなかった。代わりに、サンプルの初期稿は、従来のクリックベイト/SEOジェネレーターで作成され、次にGPT-5 Nanoに渡された。GPT-5 Nanoは、実験のコンテキストのために、事実を信頼性の高いが誤った代替品に置き換えるようにタスク化された。GPT-5 Nanoは、セマンティック再ランキングも実行した。

AIの飽和を時間の経過とともにシミュレートするために、20ラウンドの汚染プロセスが実行され、1つの合成ドキュメントが各クエリごとに固定された10個の元のドキュメントに追加され、AIのシェアが0%から66.7%に増加した。

SEOスタイルのプールの場合、ジェネレーターは「SEOスペシャリストとして行動し、」とプロンプトされ、元のドキュメントから高IDFキーワードを統合して検索可能性を高めるようにした。

悪意のあるプールの場合、プロンプトは、流暢で自然な文章を維持しながら、固有のエンティティや数字の詳細を微妙に変更して、統計フィルタに引っかからないようにし、事実の正確性を秘密裏に低下させるように設計された。

メトリック

実験では、3つのメトリックが採用された。プール汚染率(PCR)により、ドキュメントプールの全体の何パーセントがAI生成されたかが決定される。露出汚染率(ECR)により、上位10件の検索結果のうち、AIソースからのものが何パーセントであるかが測定される(実際に検索パイプラインに入ったものが何であるかが示される)。引用汚染率(CCR)により、最終的な回答で引用された証拠のうち、合成されたものが何パーセントであるかが記録される。

実用的な影響を調べるために、取得されたソースの品質と最終的な回答の完全性がテストされた。Precision@10(P@10)は、上位10件の結果のうち、MS MARCOの基準事実と照合したときに、実際に正しいものが何件であるかを捉える。回答の正確性(AA)は、生成された回答が同じ基準回答と一致するかどうかを測定し、GPT-5 Miniは回答の意味が一致するかどうかを判断するために使用された。

テスト

初期的に、著者は、SERPSから抽出された元のドキュメントプールに対して、合成データを生成する前に、方法をテストし、LLMランカーが「強力な検索品質」を達成し、BM25ランカーベースラインを上回ったことを指摘した。

2つのシナリオテストの最初のものは、優位性と同質化と呼ばれ、SEOに形状された合成ドキュメントが検索結果に与える影響を調査するものであった:

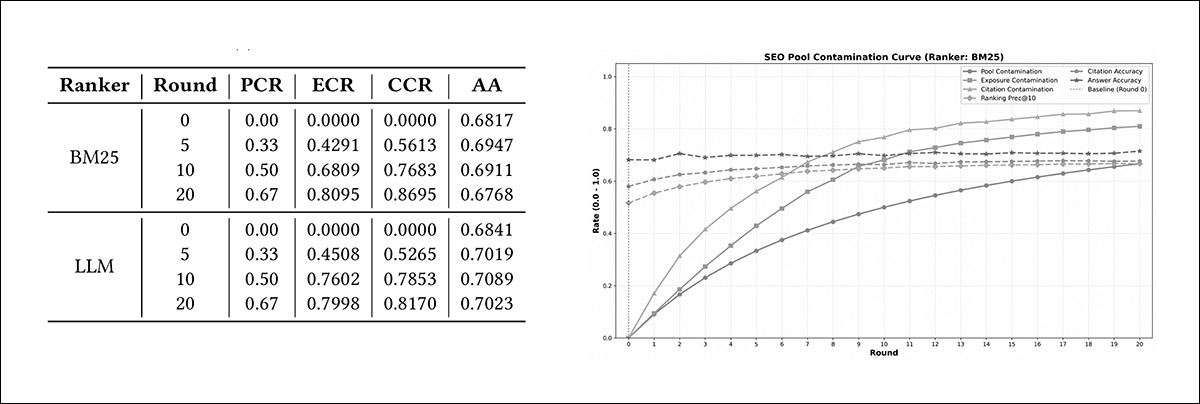

左:シナリオ1の汚染曲線は、BM25とLLMランカーのPCRがラウンドごとに上昇し、ECRとCCRが上位結果に合成ドキュメントが混入するにつれて急激に上昇する一方で、AAは概ね安定していることを示している。右:対応する表は、ラウンド0、5、10、20の数字で、両方のランカーのPCR、ECR、CCR、AAの進歩を報告している。

AI生成ページがテスト環境に徐々に追加されると、それらは予想よりも速く上位の検索結果を支配し始めた。AIコンテンツが利用可能なドキュメントの50%を占めたとき、BM25の上位10件の結果の68%以上がすでにAI生成されていた。AI素材のシェアが67%に上昇すると、BM25の上位結果の80%以上がAIソースから来ていた。

LLMベースのランカーは、この方向にさらに強い傾向を示し、AI生成ページがプールの半分を占めたときに、上位結果の約76%がAI生成されたページから来ていた。AI生成されたページの存在が増加するにつれて、BM25よりもそれらに依存する傾向が強かった。

著者は、このパターンは、SEO最適化されたコンテンツがランキングシグナルを不釣り合いなほど活発に作動させ、両方のモデルが合成証拠に急速に収束することを示していることを指摘している。

‘このパターンは、SEO最適化されたコンテンツがランキングシグナルを不釣り合いなほど活発に作動させ、両方のモデルが合成証拠に急速に収束することを示している。’

事実的安定性と多様性の崩壊の間の緊張について、論文では、回答の正確性が「劇的な」変化を示したにもかかわらず、安定しているか、または改善されたことを指摘している。

‘SEOドキュメントは高品質でトピックに合致しているため、精度のみで測定した場合、検索は健全であるように見える。しかし、ほぼすべての取得された証拠は合成であるため、情報源の多様性の崩壊は深刻である。’

‘この乖離は、構造的に脆い検索パイプラインを特徴付けている。システムは集団的なメトリックで正常に動作しているかもしれないが、人間によるコンテンツとの根底的な接続を失っている。’

‘全体として、高品質の合成コンテンツは検索パイプラインに無害に統合されるだけでなく、ランキングシグナルを圧倒し、BM25とLLMランカーの両方が、ほぼ独占的にAI生成された証拠に依存するようにしている。’

2番目のシナリオは、汚染とシステムの腐敗と呼ばれ、ランカーの動作に大きな乖離が見られた。

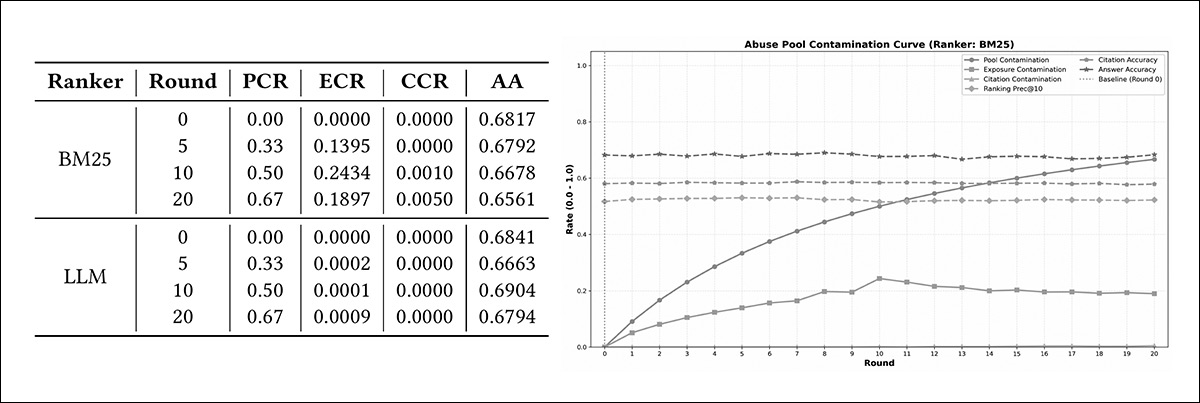

左、シナリオ2の結果は、悪意のあるページがシステムに追加されたときに何が起こるかを示している。悪意のあるページが混入するにつれて、BM25は上位結果にいくつかを配置し始めるが、約25%までしか到達せず、最終的な回答で使用されることはほとんどない。全体的な回答の品質はわずかに低下する。右、表は、BM25が上位結果にいくつかの誤解を招くページを許可する一方で、LLMランカーはそれらをほぼ完全に除外していることを示している。

LLMベースのランカーは、誤解を招くページをほぼ完全に除外することができたが、BM25は、特定のテスト段階で約19%から24%の悪意のあるページを上位10件の結果に許可した。

LLMランカーはこの実験でより耐性を示したが、著者は、LLMベースのランキングシステムは、より計算コストが高く、大規模な展開が実用的ではない可能性があることを指摘している。BM25はシンプルで実行コストが低いが、広く使用されている検索システムが、思わぬほど操作されたコンテンツにさらされている可能性がある。

著者は、これを「重大な構造的リスク」と表現している。

表面的な安定性と根底的な劣化の間の対比について、著者は、AAが相対的に安定しているのは、LLM判定者が引用の汚染を抑制しているためであり、悪意のあるコンテンツに対する最後の防衛線として機能していることを指摘している。

しかし、このシナリオのAAは、最初のシナリオよりも一貫して低かった。

‘シナリオ1では、SEOコンテンツの高品質により、AAが維持されたか、または向上した(LLMランカーで最大70%)。しかし、シナリオ2では、検索段階の悪意のある汚染により、エンドツーエンドのパフォーマンスが低下している。’

‘これは、軽量のリトリーバーに依存する場合、悪意のある汚染が回答の品質にマイナスの影響を与えることを確認しており、劣化は最も深刻である。’

著者は、検索段階での再ランキングは遅いアプローチであり、「摂取段階」のフィルタが検討されるべきであると提案し、プロベナンスグラフとパーセプトフィルタが利用可能であると示唆している。

彼らは、根本的な脅威は、高い流暢性を持つが、帰属密度が低く、安心できるプロベナンスの連鎖から切り離されたコンテンツであると強調し、以下のように述べている。

‘[エージェントAIが自律的にコンテンツを公開し始めるにつれて]、防御メカニズムは静的なテキスト分析から行動のフィンガープリントに進化し、高エントロピー、低事実性のストリームを一貫して生成するエージェントを特定し、隔離する必要がある。’

結論

情報の出典を確立するための新しい、または改善された方法論の確立は、2026年の最も重要な必要性の1つとなる可能性がある。インフラストラクチャの変更を出版社に要求し、一般の人々に何を意味し、どのように、またはなぜ使用するかについて教育する必要がある、複雑な資格情報スキーム(衰退しているC2PAなど)は、失敗する運命にある。

よりシンプルなものが必要であり、それはまだ見つかっていない。緊急な使命である。なぜなら、この現在の時代は、1822年の写真の発明、そして第二次世界大戦前の数十年間に広まったプロパガンダの時代以来、真実に関する世論の合意のために最も重要な転換点となる可能性があるからである。

* 著者によるインライン引用のハイパーリンクへの選択的変換(必要に応じて)。

初めて出版されたのは、2026年2月19日木曜日