Intelligenza Artificiale

Il problema della scatola nera negli LLM: sfide e soluzioni emergenti

L’apprendimento automatico, un sottoinsieme dell’intelligenza artificiale, coinvolge tre componenti: algoritmi, dati di addestramento e il modello risultante. Un algoritmo, essenzialmente un insieme di procedure, impara a identificare modelli da un ampio insieme di esempi (dati di addestramento). Il culmine di questa formazione è un modello di apprendimento automatico. Ad esempio, un algoritmo addestrato con immagini di cani darebbe come risultato un modello in grado di identificare i cani nelle immagini.

La scatola nera nell'apprendimento automatico

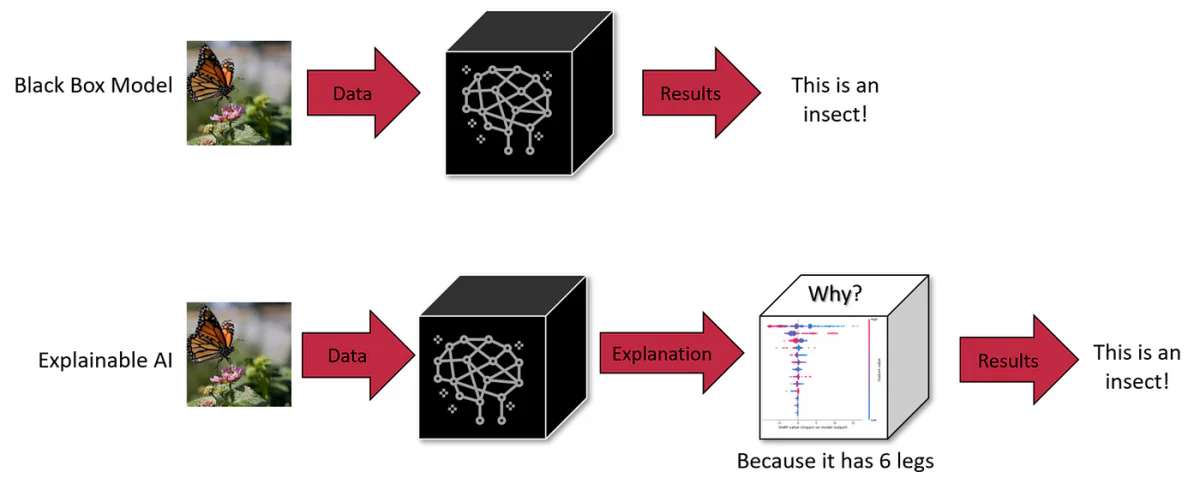

Nell'apprendimento automatico, uno qualsiasi dei tre componenti – algoritmo, dati di training o modello – può essere una scatola nera. Sebbene gli algoritmi siano spesso noti al pubblico, gli sviluppatori possono scegliere di mantenere segreti il modello o i dati di training per proteggere la proprietà intellettuale. Questa oscurità rende difficile comprendere il processo decisionale dell'IA.

Le scatole nere dell’intelligenza artificiale sono sistemi i cui meccanismi interni rimangono opachi o invisibili agli utenti. Gli utenti possono inserire dati e ricevere output, ma la logica o il codice che produce l'output rimane nascosto. Questa è una caratteristica comune in molti sistemi di intelligenza artificiale, inclusi modelli generativi avanzati come ChatGPT e DALL-E 3.

Gli LLM come GPT-4 rappresentano una sfida significativa: il loro funzionamento interno è in gran parte opaco, rendendoli “scatole nere”. Tale opacità non è solo un problema tecnico; pone problemi etici e di sicurezza nel mondo reale. Ad esempio, se non riusciamo a discernere il modo in cui questi sistemi raggiungono le conclusioni, possiamo fidarci di loro in aree critiche come le diagnosi mediche o le valutazioni finanziarie?

La scala e la complessità dei LLM

La scala di questi modelli aumenta la loro complessità. Prendiamo ad esempio GPT-3, con i suoi 175 miliardi di parametri e i modelli più recenti che ne contengono trilioni. Ogni parametro interagisce in modi complessi all'interno della rete neurale, contribuendo a capacità emergenti che non sono prevedibili esaminando i singoli componenti da soli. Questa scala e complessità rendono quasi impossibile comprenderne appieno la logica interna, ponendo un ostacolo nella diagnosi di pregiudizi o comportamenti indesiderati in questi modelli.

Il compromesso: scala vs interpretabilità

Ridurre la portata dei LLM potrebbe migliorare l’interpretabilità, ma a scapito delle loro capacità avanzate. La scala è ciò che consente comportamenti che i modelli più piccoli non possono ottenere. Ciò presenta un compromesso intrinseco tra scala, capacità e interpretabilità.

Impatto del problema della scatola nera LLM

1. Processo decisionale imperfetto

L'opacità nel processo decisionale di LLM come GPT-3 o BERT può portare a pregiudizi ed errori non rilevati. In settori come la sanità o la giustizia penale, dove le decisioni hanno conseguenze di vasta portata, l’incapacità di verificare la solidità etica e logica degli LLM è una delle principali preoccupazioni. Ad esempio, un LLM con diagnosi medica che si basa su dati obsoleti o distorti può fornire raccomandazioni dannose. Allo stesso modo, i LLM nei processi di assunzione possono inavvertitamente perpetuare pregiudizi di genere. La natura della scatola nera quindi non solo nasconde i difetti ma può potenzialmente amplificarli, rendendo necessario un approccio proattivo per migliorare la trasparenza.

2. Adattabilità limitata in contesti diversi

La mancanza di comprensione del funzionamento interno degli LLM limita la loro adattabilità. Ad esempio, un LLM che assume potrebbe essere inefficiente nel valutare i candidati per un ruolo che valorizza le competenze pratiche rispetto alle qualifiche accademiche, a causa della sua incapacità di adeguare i propri criteri di valutazione. Allo stesso modo, un LLM medico potrebbe avere difficoltà con la diagnosi di malattie rare a causa di squilibri nei dati. Questa inflessibilità evidenzia la necessità di trasparenza per ricalibrare gli LLM per compiti e contesti specifici.

3. Pregiudizi e lacune conoscitive

L'elaborazione di enormi quantità di dati di training da parte degli LLM è soggetta ai limiti imposti dai loro algoritmi e dalle architetture dei modelli. Ad esempio, un LLM in ambito medico potrebbe presentare distorsioni demografiche se addestrato su set di dati sbilanciati. Inoltre, la competenza di un LLM in argomenti di nicchia potrebbe essere fuorviante, portando a risultati eccessivamente sicuri e errati. Per affrontare queste distorsioni e lacune conoscitive non bastano i dati aggiuntivi: è necessario esaminare i meccanismi di elaborazione del modello.

4. Responsabilità legale ed etica

La natura poco chiara degli LLM crea un'area grigia dal punto di vista legale in merito alla responsabilità per eventuali danni causati dalle loro decisioni. Se un LLM in ambito medico fornisce consigli errati che causano danni al paziente, determinare la responsabilità diventa difficile a causa dell'opacità del modello. Questa incertezza giuridica comporta rischi per le entità che impiegano LLM in aree sensibili, sottolineando la necessità di una governance chiara e trasparente.

5. Problemi di fiducia nelle applicazioni sensibili

Per i LLM utilizzati in aree critiche come la sanità e la finanza, la mancanza di trasparenza ne mina l’affidabilità. Gli utenti e i regolatori devono garantire che questi modelli non contengano pregiudizi o prendano decisioni basate su criteri ingiusti. La verifica dell'assenza di pregiudizi negli LLM richiede una comprensione dei loro processi decisionali, sottolineando l'importanza della spiegabilità per l'implementazione etica.

6. Rischi legati ai dati personali

Gli LLM richiedono dati di formazione estesi, che possono includere informazioni personali sensibili. La natura di scatola nera di questi modelli solleva preoccupazioni su come questi dati vengono elaborati e utilizzati. Ad esempio, un LLM medico formato sulle cartelle cliniche dei pazienti solleva interrogativi sulla privacy e sull’utilizzo dei dati. Garantire che i dati personali non vengano utilizzati in modo improprio o sfruttato richiede processi trasparenti di gestione dei dati all’interno di questi modelli.

Soluzioni emergenti per l'interpretabilità

Per affrontare queste sfide, si stanno sviluppando nuove tecniche. Questi includono metodi di approssimazione controfattuale (CF). Il primo metodo prevede di chiedere a un LLM di modificare uno specifico concetto di testo mantenendo costanti gli altri concetti. Questo approccio, sebbene efficace, richiede molte risorse al momento dell'inferenza.

Il secondo approccio prevede la creazione di uno spazio di inclusione dedicato guidato da un LLM durante la formazione. Questo spazio si allinea con un grafico causale e aiuta a identificare le corrispondenze che si avvicinano ai CF. Questo metodo richiede meno risorse al momento del test e ha dimostrato di spiegare in modo efficace le previsioni del modello, anche in LLM con miliardi di parametri.

Questi approcci evidenziano l’importanza delle spiegazioni causali nei sistemi PNL per garantire sicurezza e stabilire fiducia. Le approssimazioni controfattuali forniscono un modo per immaginare come un dato testo cambierebbe se un certo concetto nel suo processo generativo fosse diverso, aiutando nella stima pratica dell'effetto causale di concetti di alto livello sui modelli PNL.

Approfondimento: metodi di spiegazione e causalità nei LLM

Strumenti di sondaggio e importanza delle funzionalità

Il sondaggio è una tecnica utilizzata per decifrare cosa codificano le rappresentazioni interne nei modelli. Può essere supervisionato o non supervisionato e ha lo scopo di determinare se concetti specifici sono codificati in determinati punti della rete. Sebbene efficaci in una certa misura, le indagini non riescono a fornire spiegazioni causali, come evidenziato da Geiger et al. (2021).

Gli strumenti per l'importanza delle funzionalità, un'altra forma di metodo di spiegazione, spesso si concentrano sulle funzionalità di input, sebbene alcuni metodi basati sul gradiente lo estendano agli stati nascosti. Un esempio è il metodo dei gradienti integrati, che offre un'interpretazione causale esplorando gli input di base (controfattuali, CF). Nonostante la loro utilità, questi metodi hanno ancora difficoltà a collegare le loro analisi con concetti del mondo reale al di là delle semplici proprietà di input.

Metodi basati sull'intervento

I metodi basati sull'intervento implicano la modifica degli input o delle rappresentazioni interne per studiare gli effetti sul comportamento del modello. Questi metodi possono creare stati CF per stimare gli effetti causali, ma spesso generano input o stati di rete non plausibili se non attentamente controllati. Il Causal Proxy Model (CPM), ispirato al concetto di S-learner, è un nuovo approccio in questo ambito, imitando il comportamento del modello spiegato sotto input CF. Tuttavia, la necessità di una spiegazione distinta per ciascun modello rappresenta una limitazione importante.

Approssimazione dei controfattuali

I controfattuali sono ampiamente utilizzati nell'apprendimento automatico per l'aumento dei dati, coinvolgendo perturbazioni a vari fattori o etichette. Questi possono essere generati tramite editing manuale, sostituzione euristica di parole chiave o riscrittura automatica del testo. Sebbene l'editing manuale sia accurato, richiede anche molte risorse. I metodi basati su parole chiave hanno i loro limiti e gli approcci generativi offrono un equilibrio tra fluidità e copertura.

Spiegazioni fedeli

La fedeltà nelle spiegazioni si riferisce alla rappresentazione accurata del ragionamento sottostante al modello. Non esiste una definizione universalmente accettata di fedeltà, il che porta alla sua caratterizzazione attraverso varie metriche come sensibilità, coerenza, accordo sull'importanza delle caratteristiche, robustezza e simulabilità. La maggior parte di questi metodi si concentra su spiegazioni a livello di caratteristica e spesso confonde correlazione con causalità. Il nostro lavoro mira a fornire spiegazioni concettuali di alto livello, sfruttando la letteratura sulla causalità per proporre un criterio intuitivo: ordine-fedeltà.

Abbiamo approfondito le complessità intrinseche degli LLM, comprendendone la natura di "scatola nera" e le significative sfide che pone. Dai rischi di processi decisionali errati in settori delicati come sanità e finanza, ai dilemmi etici legati a pregiudizi e equità, la necessità di trasparenza negli LLM non è mai stata così evidente.

Il futuro degli LLM e la loro integrazione nella nostra vita quotidiana e nei processi decisionali critici dipende dalla nostra capacità di rendere questi modelli non solo più avanzati ma anche più comprensibili e responsabili. La ricerca della spiegabilità e dell’interpretabilità non è solo uno sforzo tecnico ma un aspetto fondamentale per creare fiducia nei sistemi di intelligenza artificiale. Man mano che gli LLM diventano sempre più integrati nella società, la domanda di trasparenza crescerà, non solo da parte dei professionisti dell’intelligenza artificiale, ma da parte di ogni utente che interagisce con questi sistemi.