Angolo di Anderson

Cerca di ‘Gufo e Lucertola’ nel Pubblico di un Inserzionista

Poiché il settore della pubblicità online è stimato aver speso 740,3 miliardi di dollari USA nel 2023, è facile capire perché le aziende di pubblicità investono risorse considerevoli in questo particolare ramo della ricerca sulla visione artificiale.

Sebbene l’industria sia insulare e protettiva, occasionalmente pubblica studi che suggeriscono un lavoro più avanzato e proprietario nel riconoscimento facciale e dell’orientamento degli occhi – incluso riconoscimento dell’età, centrale per le statistiche dell’analisi demografica:

Stimare l’età in un contesto pubblicitario è di interesse per gli inserzionisti che potrebbero essere interessati a una particolare fascia demografica. In questo esempio sperimentale di stima automatica dell’età facciale, l’età del cantante Bob Dylan è tracciata nel corso degli anni. Fonte: https://arxiv.org/pdf/1906.03625

Questi studi, che di rado appaiono in repository pubblici come Arxiv, utilizzano partecipanti legittimamente reclutati come base per un’analisi guidata dall’AI che mira a determinare in quale misura e in che modo lo spettatore sta interagendo con un annuncio.

L’istogramma di gradienti orientati (HoG) di Dlib viene spesso utilizzato nei sistemi di stima facciale. Fonte: https://www.computer.org/csdl/journal/ta/2017/02/07475863/13rRUNvyarN

Istinto Animale

A questo riguardo, naturalmente, l’industria della pubblicità è interessata a determinare i falsi positivi (occasioni in cui un sistema di analisi interpreta male le azioni di un soggetto) e a stabilire criteri chiari per quando la persona che guarda i loro annunci non è completamente coinvolta con il contenuto.

Per quanto riguarda la pubblicità basata su schermo, gli studi tendono a concentrarsi su due problemi in due ambienti. Gli ambienti sono ‘desktop’ o ‘mobile’, ciascuno dei quali ha caratteristiche particolari che richiedono soluzioni di tracciamento personalizzate; e i problemi – dal punto di vista dell’inserzionista – sono rappresentati dal comportamento da gufo e lucertola – la tendenza degli spettatori a non prestare attenzione completa a un annuncio che è davanti a loro.

Esempi di comportamento da ‘Gufo’ e ‘Lucertola’ in un soggetto di un progetto di ricerca pubblicitaria. Fonte: https://arxiv.org/pdf/1508.04028

Se ti allontani dall’annuncio pubblicitario con tutta la testa, questo è un comportamento da ‘gufo’; se la tua posizione della testa è statica ma i tuoi occhi si allontanano dallo schermo, questo è un comportamento da ‘lucertola’. In termini di analisi e test di nuovi annunci in condizioni controllate, queste sono azioni essenziali per un sistema in grado di catturarle.

Un nuovo articolo di SmartEye’s Affectiva affronta questi problemi, offrendo un’architettura che sfrutta diversi framework esistenti per fornire un set di caratteristiche combinato e concatenato in tutte le condizioni e reazioni possibili – e per essere in grado di dire se uno spettatore è annoiato, coinvolto o in qualche modo remoto dal contenuto che l’inserzionista desidera che guardi.

Esempi di true e false positivi rilevati dal nuovo sistema di attenzione per vari segnali di distrazione, mostrati separatamente per dispositivi desktop e mobile. Fonte: https://arxiv.org/pdf/2504.06237

Gli autori affermano*:

‘Limitata ricerca ha indagato sul monitoraggio dell’attenzione durante gli annunci online. Mentre questi studi si sono concentrati sulla stima della posizione della testa o della direzione dello sguardo per identificare istanze di sguardo deviato, trascurano parametri critici come il tipo di dispositivo (desktop o mobile), la posizione della telecamera rispetto allo schermo e le dimensioni dello schermo. Questi fattori influenzano notevolmente la rilevazione dell’attenzione.

‘In questo articolo, proponiamo un’architettura per la rilevazione dell’attenzione che comprende la rilevazione di vari distrattori, tra cui il comportamento da gufo e lucertola di sguardo fuori schermo, parlare, sonnolenza (attraverso lo sbadiglio e la chiusura prolungata degli occhi) e lasciare lo schermo non sorvegliato.

‘A differenza degli approcci precedenti, il nostro metodo integra caratteristiche specifiche del dispositivo come il tipo di dispositivo, la posizione della telecamera, le dimensioni dello schermo (per i desktop) e l’orientamento della telecamera (per i dispositivi mobili) con la stima grezza dell’attenzione per migliorare l’accuratezza della rilevazione dell’attenzione.’

Il nuovo lavoro si intitola Monitoraggio dell’attenzione dello spettatore durante gli annunci online, e proviene da quattro ricercatori di Affectiva.

Metodo e Dati

Largamente a causa della segretezza e della natura chiusa di tali sistemi, il nuovo articolo non confronta direttamente l’approccio degli autori con quello dei rivali, ma presenta invece i propri risultati esclusivamente come studi di ablazione; inoltre, l’articolo non aderisce in generale al formato usuale della letteratura sulla visione artificiale. Pertanto, esamineremo la ricerca come è presentata.

Gli autori sottolineano che solo un numero limitato di studi ha affrontato la rilevazione dell’attenzione specificamente nel contesto degli annunci online. Nell’AFFDEX SDK, che offre il riconoscimento facciale in tempo reale, l’attenzione è inferita solo dalla posizione della testa, con i partecipanti etichettati come inattenti se l’angolo della testa supera una soglia definita.

Un esempio dall’AFFDEX SDK, un sistema Affectiva che si basa sulla posizione della testa come indicatore di attenzione. Fonte: https://www.youtube.com/watch?v=c2CWb5jHmbY

Nella collaborazione del 2019 Misurazione automatica dell’attenzione visiva al contenuto video utilizzando l’apprendimento profondo, un set di dati di circa 28.000 partecipanti è stato annotato per vari comportamenti inattenti, tra cui sguardo deviato, occhi chiusi, o impegnati in attività non correlate, e un modello CNN-LSTM è stato addestrato per rilevare l’attenzione dall’aspetto facciale nel tempo.

Dall’articolo del 2019, un esempio che illustra gli stati di attenzione previsti per uno spettatore che guarda contenuto video. Fonte: https://www.jeffcohn.net/wp-content/uploads/2019/07/Attention-13.pdf.pdf

Tuttavia, gli autori osservano che questi sforzi precedenti non hanno tenuto conto di fattori specifici del dispositivo, come il fatto che il partecipante stesse utilizzando un dispositivo desktop o mobile; né hanno considerato le dimensioni dello schermo o la posizione della telecamera. Inoltre, il sistema AFFDEX si concentra solo sull’identificazione della deviazione dello sguardo e omette altre fonti di distrazione, mentre il lavoro del 2019 tenta di rilevare un set più ampio di comportamenti – ma l’uso di una singola rete neurale convoluzionale (CNN) poco profonda potrebbe, afferma l’articolo, essere stato inadeguato per questo compito.

Gli autori osservano che alcune delle ricerche più popolari in questo campo non sono ottimizzate per il test degli annunci, che ha esigenze diverse rispetto a domini come la guida o l’istruzione – dove la posizione della telecamera e la calibrazione sono usualmente fisse in anticipo, e che invece operano all’interno della gamma di sguardo limitata dei dispositivi desktop e mobili.

Pertanto, hanno elaborato un’architettura per la rilevazione dell’attenzione dello spettatore durante gli annunci online, sfruttando due toolkit commerciali: AFFDEX 2.0 e SmartEye SDK.

Esempi di analisi facciale da AFFDEX 2.0. Fonte: https://arxiv.org/pdf/2202.12059

Questi lavori precedenti estraggono caratteristiche di basso livello come espressioni facciali, posizione della testa e direzione dello sguardo. Queste caratteristiche vengono quindi elaborate per produrre indicatori di alto livello, con ogni distrattore gestito da un classificatore binario separato addestrato sul proprio set di dati per un’ottimizzazione e valutazione indipendenti.

Set di dati: Sguardo

Gli autori hanno utilizzato quattro set di dati per alimentare e valutare il sistema di rilevazione dell’attenzione: tre si concentrano individualmente sul comportamento dello sguardo, sul parlare e sullo sbadiglio; e un quarto tratto da sessioni di test di annunci reali che contengono una miscela di tipi di distrazione.

A causa delle esigenze specifiche del lavoro, sono stati creati set di dati personalizzati per ciascuna di queste categorie. Tutti i set di dati curati sono stati tratti da un repository proprietario che presenta milioni di sessioni registrate di partecipanti che guardano annunci in ambienti domestici o lavorativi, utilizzando un setup web-based, con il consenso informato – e a causa delle limitazioni di questi accordi di consenso, gli autori affermano che i set di dati per il nuovo lavoro non possono essere resi pubblicamente disponibili.

Per costruire il set di dati dello sguardo, ai partecipanti è stato chiesto di seguire un punto in movimento su vari punti dello schermo, compresi i bordi, e poi di guardare lontano dallo schermo in quattro direzioni (su, giù, sinistra e destra) con la sequenza ripetuta tre volte. In questo modo, è stata stabilita la relazione tra cattura e copertura:

Schermate che mostrano lo stimolo video dello sguardo su (a) dispositivi desktop e (b) dispositivi mobili. I primi e terzi frame visualizzano le istruzioni per seguire un punto in movimento, mentre i secondi e quarti frame richiedono ai partecipanti di guardare lontano dallo schermo.

I segmenti del punto in movimento sono stati etichettati come attenti, e i segmenti fuori schermo come inattenti, producendo un set di dati etichettato di esempi positivi e negativi.

Ogni video è durato circa 160 secondi, con versioni separate create per piattaforme desktop e mobili, ciascuna con risoluzioni di 1920×1080 e 608×1080, rispettivamente.

Sono stati raccolti un totale di 609 video, comprendenti 322 registrazioni desktop e 287 registrazioni mobili. Le etichette sono state applicate automaticamente in base al contenuto del video, e il set di dati diviso in 158 campioni di addestramento e 451 per il test.

Set di dati: Parlare

In questo contesto, uno dei criteri che definiscono ‘inattenzione’ è quando una persona parla per più di un secondo (che potrebbe essere un commento momentaneo o anche una tosse).

Poiché l’ambiente controllato non registra o analizza l’audio, il parlare è inferito osservando il movimento interno dei punti di riferimento facciali stimati. Pertanto, per rilevare il parlare senza audio, gli autori hanno creato un set di dati basato interamente su input visivo, tratto dal loro repository interno, e diviso in due parti: la prima contiene circa 5.500 video, ciascuno etichettato manualmente da tre annotatori come parlante o non parlante (di questi, 4.400 sono stati utilizzati per l’addestramento e la convalida, e 1.100 per il test).

Il secondo comprende 16.000 sessioni etichettate automaticamente in base al tipo di sessione: 10.500 presentano partecipanti che guardano in silenzio gli annunci, e 5.500 mostrano partecipanti che esprimono opinioni sui marchi.

Set di dati: Sbadiglio

Mentre esistono alcuni set di dati di sbadiglio, tra cui YawDD e Driver Fatigue, gli autori affermano che nessuno di questi è adatto per scenari di test di annunci, poiché presentano sbadigli simulati o contengono contorsioni facciali che potrebbero essere confuse con paura, o altre azioni non correlate allo sbadiglio.

Pertanto, gli autori hanno utilizzato 735 video dal loro repository interno, scegliendo sessioni che contenevano probabilmente un abbassamento della mandibola della durata di più di un secondo. Ogni video è stato etichettato manualmente da tre annotatori come attivo o inattivo sbadiglio. Solo il 2,6% dei frame conteneva sbadigli attivi, sottolineando il disequilibrio delle classi, e il set di dati è stato diviso in 670 video di addestramento e 65 per il test.

Set di dati: Distrazione

Il set di dati della distrazione è stato anch’esso tratto dal repository di test di annunci degli autori, dove i partecipanti avevano guardato annunci reali senza compiti assegnati. Sono state selezionate casualmente 520 sessioni (193 su dispositivi mobili e 327 su ambienti desktop) e etichettate manualmente da tre annotatori come attenti o inattenti.

Il comportamento inattento includeva sguardo fuori schermo, parlare, sonnolenza, e schermi non sorvegliati. Le sessioni coprono regioni diverse in tutto il mondo, con registrazioni desktop più comuni a causa della posizione flessibile della webcam.

Modelli di Attenzione

Il modello di attenzione proposto elabora caratteristiche visive di basso livello, vale a dire espressioni facciali; posizione della testa; e direzione dello sguardo – estratte attraverso i toolkit AFFDEX 2.0 e SmartEye SDK menzionati in precedenza.

Queste caratteristiche vengono quindi convertite in indicatori di alto livello, con ogni distrattore gestito da un classificatore binario separato addestrato sul proprio set di dati per un’ottimizzazione e valutazione indipendenti.

Schema per il sistema di monitoraggio proposto.

Il modello dello sguardo determina se lo spettatore sta guardando o no lo schermo utilizzando coordinate dello sguardo normalizzate, con una calibrazione separata per dispositivi desktop e mobili. Un aiuto a questo processo è una macchina a vettori di supporto (SVM) lineare, addestrata su caratteristiche spaziali e temporali, che incorpora una finestra di memoria per smussare rapidi spostamenti dello sguardo.

Per rilevare il parlare senza audio, il sistema utilizza regioni della bocca ritagliate e una 3D-CNN addestrata su segmenti video conversazionali e non conversazionali. Le etichette sono state assegnate in base al tipo di sessione, con un liscio temporale che riduce i falsi positivi che possono derivare da brevi movimenti della bocca.

Lo sbadiglio è stato rilevato utilizzando ritagli di immagini facciali complete, per catturare una più ampia motilità facciale, con una 3D-CNN addestrata su frame etichettati manualmente (sebbene il compito sia stato complicato dalla bassa frequenza dello sbadiglio in visione naturale e dalla sua somiglianza con altre espressioni).

Lo schermo abbandonato è stato identificato attraverso l’assenza di un volto o una posizione estrema della testa, con previsioni fatte da un albero decisionale.

Lo stato di attenzione finale è stato determinato utilizzando una regola fissa: se qualsiasi modulo rileva inattenzione, lo spettatore è contrassegnato come inattento – un approccio che priorizza la sensibilità, e regolato separatamente per contesti desktop e mobili.

Test

Come menzionato in precedenza, i test seguono un metodo di ablazione, dove i componenti vengono rimossi e si osserva l’effetto sul risultato.

Diverse categorie di inattenzione percepita identificate nello studio.

Il modello dello sguardo ha identificato il comportamento fuori schermo attraverso tre passaggi chiave: normalizzazione delle stime grezze dello sguardo, regolazione fine dell’output e stima delle dimensioni dello schermo per i dispositivi desktop.

Per comprendere l’importanza di ciascun componente, gli autori li hanno rimossi individualmente e valutati le prestazioni su 226 video desktop e 225 video mobili tratti da due set di dati. I risultati, misurati utilizzando G-mean e F1 score, sono mostrati di seguito:

Risultati che indicano le prestazioni del modello completo dello sguardo, accanto a versioni con passaggi di elaborazione rimossi.

In ogni caso, le prestazioni sono diminuite quando un passaggio è stato omesso. La normalizzazione si è rivelata particolarmente preziosa sui desktop, dove la posizione della telecamera varia più che sui dispositivi mobili.

Lo studio ha anche valutato come le caratteristiche visive prevedessero l’orientamento della telecamera mobile: la posizione del volto, la posizione della testa e la direzione dello sguardo hanno ottenuto punteggi di 0,75, 0,74 e 0,60, mentre la loro combinazione ha raggiunto 0,91, sottolineando – affermano gli autori – il vantaggio di integrare più indizi.

Il modello del parlare, addestrato sulla distanza labiale verticale, ha raggiunto un ROC-AUC di 0,97 sul set di test etichettato manualmente, e 0,96 sul set più ampio etichettato automaticamente, indicando prestazioni coerenti in entrambi.

Il modello dello sbadiglio ha raggiunto un ROC-AUC del 96,6% utilizzando solo il rapporto di aspetto della bocca, che è migliorato al 97,5% quando combinato con le previsioni dell’unità di azione da AFFDEX 2.0.

Il modello dello schermo non sorvegliato ha classificato i momenti come inattenti quando sia AFFDEX 2.0 che SmartEye non riuscivano a rilevare un volto per più di un secondo. Per valutare la validità di ciò, gli autori hanno annotato manualmente tutti gli eventi di “nessun volto” nel set di dati di distrazione reale, identificando la causa sottostante di ogni attivazione. I casi ambigui (come ostruzione della telecamera o distorsione del video) sono stati esclusi dall’analisi.

Come mostrato nella tabella dei risultati di seguito, solo il 27% delle attivazioni “nessun volto” sono state causate da utenti che hanno fisicamente lasciato lo schermo.

Ragioni diverse ottenute per cui un volto non è stato trovato, in determinate istanze.

L’articolo afferma:

‘Nonostante gli schermi non sorvegliati costituissero solo il 27% delle istanze che attivavano il segnale di “nessun volto”, è stato attivato per altre ragioni indicative di inattenzione, come partecipanti che guardavano fuori schermo con un angolo estremo, facevano movimenti eccessivi o occludevano significativamente il loro volto con un oggetto o una mano.’

Nell’ultimo dei test quantitativi, gli autori hanno valutato come l’aggiunta progressiva di diversi segnali di distrazione – sguardo fuori schermo (tramite sguardo e posizione della testa), sonnolenza, parlare e schermi non sorvegliati – ha influenzato le prestazioni complessive del modello di attenzione.

I test sono stati condotti su due set di dati: il set di dati di distrazione reale e un subset di test del set di dati di sguardo. Sono stati utilizzati punteggi G-mean e F1 per misurare le prestazioni (sebbene sonnolenza e parlare siano stati esclusi dall’analisi del set di dati dello sguardo, a causa della loro limitata rilevanza in questo contesto).

Come mostrato di seguito, la rilevazione dell’attenzione è migliorata costantemente man mano che venivano aggiunti più tipi di distrazione, con sguardo fuori schermo, il distrattore più comune, che fornisce la base più forte.

L’effetto dell’aggiunta di diversi segnali di distrazione all’architettura.

Di questi risultati, l’articolo afferma:

‘Dai risultati, possiamo concludere in primo luogo che l’integrazione di tutti i segnali di distrazione contribuisce a una migliore rilevazione dell’attenzione.

‘In secondo luogo, il miglioramento nella rilevazione dell’attenzione è coerente su entrambi i dispositivi desktop e mobili. In terzo luogo, le sessioni mobili nel set di dati reale mostrano movimenti significativi della testa quando si guarda lontano, che vengono facilmente rilevati, portando a prestazioni più elevate per i dispositivi mobili rispetto ai desktop. In quarto luogo, l’aggiunta del segnale di sonnolenza ha un miglioramento relativamente leggero rispetto ad altri segnali, poiché è raro che si verifichi.

‘Infine, il segnale dello schermo non sorvegliato ha un miglioramento relativamente più grande sui dispositivi mobili rispetto ai desktop, poiché i dispositivi mobili possono essere facilmente lasciati non sorvegliati.’

Gli autori hanno anche confrontato il loro modello con AFFDEX 1.0, un sistema precedente utilizzato nel test degli annunci – e anche la rilevazione dell’attenzione basata sulla testa del modello attuale ha superato AFFDEX 1.0 su entrambi i tipi di dispositivo:

‘Questo miglioramento è il risultato dell’integrazione dei movimenti della testa in entrambe le direzioni yaw e pitch, nonché della normalizzazione della posizione della testa per tenere conto di piccoli cambiamenti. I movimenti significativi della testa nel set di dati mobile reale hanno causato il nostro modello della testa a eseguire in modo simile ad AFFDEX 1.0.’

Gli autori concludono l’articolo con un giro di test qualitativi (forse un po’ superficiale) mostrato di seguito.

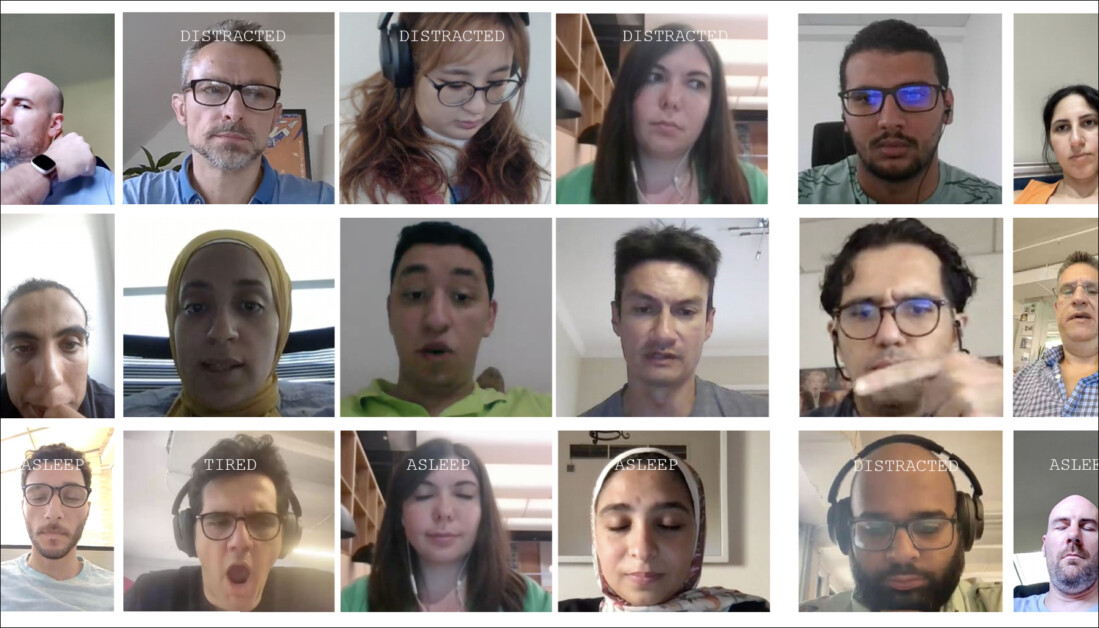

Esempi di output del modello di attenzione su dispositivi desktop e mobili, con ogni riga che presenta esempi di true e false positivi per diversi tipi di distrazione.

Gli autori affermano:

‘I risultati indicano che il nostro modello rileva efficacemente vari distrattori in ambienti non controllati. Tuttavia, potrebbe occasionalmente produrre falsi positivi in determinati casi limite, come un’inclinazione estrema della testa mentre si mantiene lo sguardo sullo schermo, alcune occlusioni della bocca o immagini facciali eccessivamente sfocate o scure.’

Conclusione

Sebbene i risultati rappresentino un progresso misurato ma significativo rispetto ai lavori precedenti, il valore più profondo dello studio risiede nel barlume che offre sulla spinta persistente per accedere allo stato interno dello spettatore. Anche se i dati sono stati raccolti con il consenso, la metodologia punta verso future strutture che potrebbero estendersi oltre ambienti di ricerca di mercato strutturati.

Questa conclusione piuttosto paranoica è solo rafforzata dalla natura chiusa, limitata e gelosamente protetta di questo particolare ramo della ricerca.

* La mia conversione delle citazioni in linea degli autori in collegamenti ipertestuali.

Pubblicato per la prima volta mercoledì 9 aprile 2025