L'angolo di Anderson

Fornire ai modelli linguistici un "quadrante della verità"

Vero o loquace: scegline uno. Un nuovo metodo di addestramento consente agli utenti di dire ai chatbot AI quanto "reali" debbano essere, trasformando la precisione in un quadrante che puoi alzare o abbassare.

Una nuova collaborazione di ricerca tra Stati Uniti e Cina offre qualcosa che quasi tutti gli utenti di chatbot AI apprezzerebbero: una "manopola" virtuale che indica al bot se deve essere "loquace" o "veritiero".

Il sistema è stato creato da ritocchi a Mistral-7B modello su dati sintetici, in modo che lo schema per una scala di "verità" potesse essere impresso sul modello. Dopo questa revisione, il modello Mistral è in grado di controllare il numero di fatti in una risposta; più alto è il valore di "verità" fornito dall'utente, minore sarà il numero di fatti, ma più sicuro sarà il numero di fatti. minore risposta.

Con impostazioni più basse, la risposta del chatbot diventa ciò che gli autori del documento chiamano "informativa", vale a dire, fornirà una risposta più lunga e conterrà più fatti; ma alcuni dei fatti potrebbero essere allucinato.

I dati sintetici su cui è stato addestrato il sistema hanno utilizzato Wikipedia come riferimento per un dominio di prova: fatti biografici reali su persone. Che si pensi o meno che Wikipedia debba essere una fonte autorevole, il valore del lavoro sta nella progettazione. in qualsiasi tipo di sistema che può limitare la formazione nativa degli LLM compulsione a dare risposte, anche quando non ha risposte da dare.

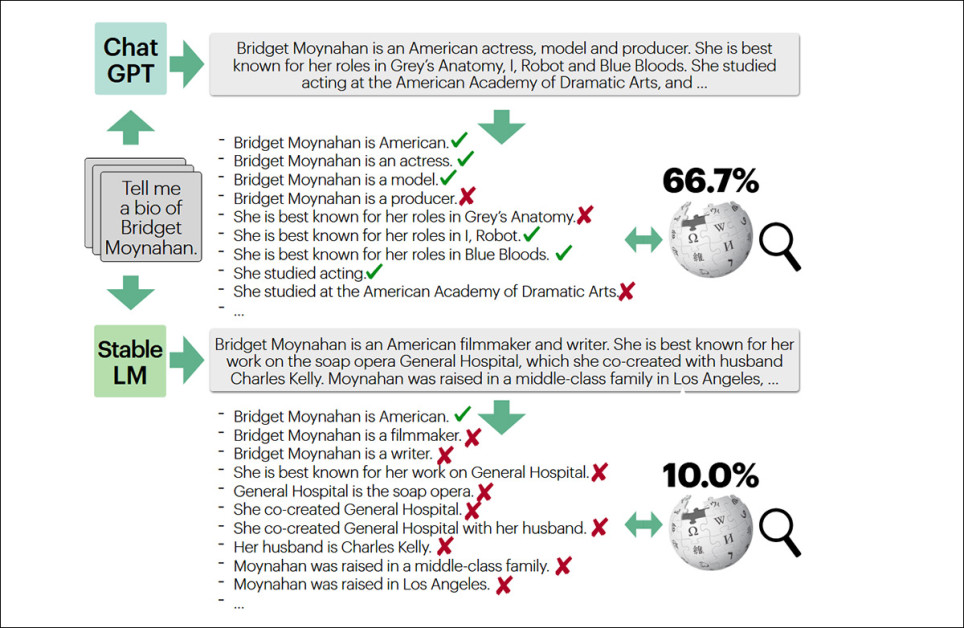

Un esempio tratto dal progetto FactScore che ha alimentato la selezione del set di dati per l'articolo che stiamo esaminando qui, utilizzando Wikipedia come autorità di riferimento per i dettagli biografici. Fonte

Gli autori sottolineano che i contesti ad alta garanzia, come quelli medico e legale, richiedono risultati conservativi e fattuali affidabili, mentre molti altri tipi di utenti richiedono un tipo di risultato più duttile e creativo, interpretativo (ad esempio, scrittura discorsiva e analisi accademica, tra gli altri).

Osservano*:

Gli LLM [attuali] non offrono alcun meccanismo integrato per controllare questo compromesso.

"Mentre gli utenti potrebbero provare a guidare il comportamento del modello con richieste come "sii più fattuale", abbiamo scoperto che i modelli di frontiera non adattano in modo affidabile i loro output in risposta a tali richieste in questo compito.

'SU FactScore, scopriamo che i modelli standard spesso non riescono a soddisfare nemmeno gli obiettivi da moderati a rigorosi. Questa lacuna motiva un'alternativa controllabile che consenta agli utenti di richiedere un livello di fattualità specifico e di far sì che il modello adatti le sue risposte di conseguenza.

Solo i fatti

Per comprendere il documento e le soluzioni che offre, è necessario rivedere la propria definizione di "informatività". Gli autori affermano che la quantificazione di un informativo la risposta è uguale 'la quantità di contenuto supportato nell'output, misurata come numero di istruzioni atomiche convalidate, normalizzata dalla lunghezza dell'output'.

In altri punti il documento afferma più semplicemente che l'informatività è 'il numero totale di fatti atomici nell'output, corretti o meno'.

Inoltre, i ricercatori sottolineano che la tendenza degli LLM a oscillare tra l'accuratezza fattuale e le ipotesi soggettive è una caratteristica prettamente umana, documentata da diversi studi scientifici*:

"La conoscenza [degli LLM] è disomogeneamente affidabile: alcune affermazioni sono fortemente supportate, mentre altre sono speculative, obsolete o incerte. La generazione richiede quindi di decidere quanto dire e con quanta cautela, creando una tensione tra precisione fattuale e informatività.

Gli esseri umani fanno scelte analoghe: partendo da fatti altamente affidabili e l'aggiunta di minore certezza dettagli solo quando richiesto.'

Sebbene gli esperimenti siano stati effettuati solo sul modello Mistral di medie dimensioni, i principi applicati dovrebbero funzionare su una varietà di scale e piattaforme, perché implicano un nuovo quantificazione di dati, come aggiunta allo schema interno di un LLM; e una modifica di questo tipo non è specifica dell'architettura.

Migliori nuovo documento è intitolato Fattualità su richiesta: controllo del compromesso tra fattualità e informatività nella generazione di testoe proviene da sette ricercatori della Columbia University, della New York University e della NYU Shanghai.

Metodo e dati

Il nuovo approccio presentato nel documento è denominato Generazione controllata dalla fattualità (FCG) e introduce un quadrante virtuale che consente agli utenti di specificare il livello di precisione che desiderano per la risposta di un chatbot. "In sostanza," il documento afferma, 'FCG migliora il modello con una "manopola" controllabile per la fattualità'.

Il modello prende sia una domanda dell'utente sia un livello di fattualità desiderato, quindi genera una risposta che include solo le informazioni che ritiene sufficientemente affidabili, cercando comunque di essere il più dettagliato possibile entro quel vincolo di confidenza.

Utilizzando il sistema FactScore (collegato sopra), l'output segmentato delle query campione viene valutato per l'accuratezza, una qualità definita come aderenza alla fattualità:

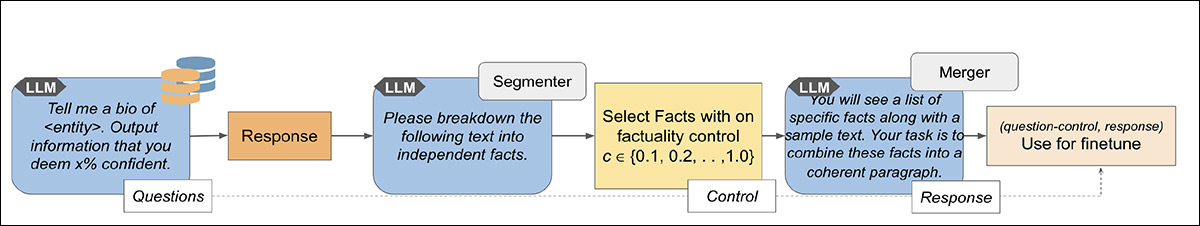

Pipeline di dati di addestramento per FCG: un modello linguistico genera una risposta iniziale, la scompone in fatti atomici, li classifica in base all'affidabilità e scarta quelli meno affidabili finché non viene raggiunto il livello di verità desiderato. Fonte

Poiché nessun set di dati esistente corrispondeva ai requisiti di FCG, gli autori ne hanno creato uno sintetico utilizzando il GPT-4† il modello linguistico genera prima una risposta non vincolata, quindi elimina i fatti con il "livello di confidenza più basso", finché la risposta non raggiunge un dato livello di accuratezza.

Lavori precedenti suggerivano che l'allenamento fosse effettuato solo su verità di base dati potrebbe effettivamente realizzare modelli meno effettivo, scoraggiandoli dal fornire qualsiasi dettaglio aggiuntivo. Pertanto, gli esempi di addestramento FCG sono stati modificati in modo minimo, preservando il fraseggio e il ritmo propri del modello, riducendoli solo quanto basta per raggiungere il livello di sicurezza richiesto.

Applicando questo processo di editing a una gamma di livelli di confidenza target, dal 10% a una soglia rigorosa del 100%, è stato creato un set di dati sintetico in cui ogni domanda è stata abbinata a più risposte filtrate.

In ogni versione, sono stati mantenuti solo i fatti ritenuti dal modello sufficientemente affidabili per soddisfare il livello di fattualità richiesto; questi esempi sono stati poi utilizzati come dati di addestramento per la messa a punto supervisionata.

Il set di dati finale era composto da 3,302 (domanda, di controllo, risposta) triple per l'allenamento e 396 per convalida, costruito a partire da 500 entità, di cui 450 per la formazione e 50 per lo sviluppo. Ulteriori 183 entità distinte sono state utilizzate per i test.

Formazione e test

Gli autori hanno perfezionato il Mistral-7B-Instruct-v0.2 LLM modello a vari tassi di apprendimento (3e-6, 1e-5, 3e-5) per arrivare al LR ottimale (non dichiarato), per 30 epoche, in a dimensione del lotto di 256 (nb l'hardware di formazione non è specificato).

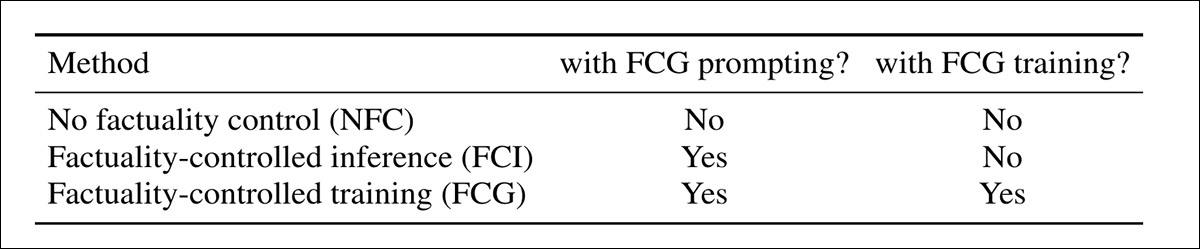

FCG è stato testato su due linee di base. La prima era Nessun controllo di fattualità (NFC), dove al modello è stata semplicemente inviata una richiesta come Raccontami una biografia di X, senza alcuna menzione di accuratezza o affidabilità. Questa versione riflette il comportamento predefinito di un LLM, senza alcun meccanismo di filtraggio o vincolo.

Il secondo metodo, chiamato Inferenza controllata dalla fattualità (FCI), ha utilizzato gli stessi prompt sul livello di confidenza senza alcuna messa a punto. Ad esempio, il modello potrebbe essere sollecitato con 'Fornisci informazioni che ritieni sicure al 90%'In questo caso, le istruzioni erano simili a quelle utilizzate nell'addestramento, ma il modello non era stato precedentemente esposto a tali vincoli:

Confronto dei tre approcci testati: la linea di base senza controllo; una versione che utilizza prompt di fattualità senza formazione; e il modello perfezionato che ha imparato a seguire le impostazioni di accuratezza attraverso l'esposizione a dati filtrati.

Inizialmente è stato fatto un test per aderenza alla fattualità:

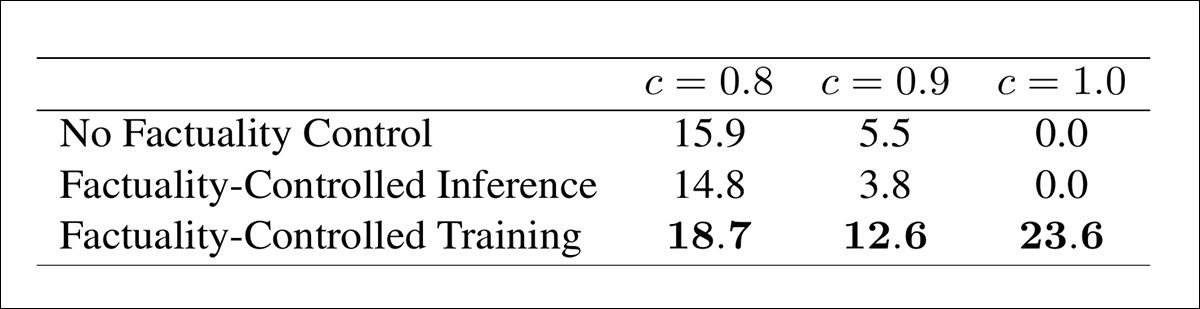

Prestazioni a tre livelli di confidenza target. Solo il modello completamente addestrato è stato in grado di produrre risultati pienamente fattuali, e ha superato entrambe le linee di base in tutti i settori, in particolare alle soglie più elevate.

Testato su soglie di fattualità dell'80%, 90% e 100%, solo il modello ottimizzato è stato in grado di raggiungere costantemente gli obiettivi. Sorprendentemente, la semplice aggiunta di istruzioni di confidenza, senza addestrare il modello a seguirle, non ha aiutato. In alcuni casi, ha addirittura peggiorato la situazione; ad esempio, solo il 3.8% degli output del modello con prompt ha raggiunto la soglia del 90%, rispetto al 5.5% della versione senza alcuna istruzione:

Ciò suggerisce, affermano gli autori, che il modello base Mistral-7B non è stato in grado di interpretare prompt come 'sii sicuro al 90%' in modo utile e che l'istruzione aggiuntiva potrebbe addirittura averne interrotto il normale output.

Al contrario, il modello addestrato ha risposto in modo affidabile ai segnali di controllo, producendo il 18.7% di output conformi all'80%, il 12.6% al 90% e il 23.6% al 100%; e si è dimostrato l'unico metodo in grado di generare qualsiasi completamente fattuale risposte:

"Questi miglioramenti indicano che la capacità di controllare la fattualità può effettivamente essere instillata tramite un addestramento supervisionato. Il modello FCG ha imparato ad adattare il suo contenuto e a includere solo i fatti di cui è sufficientemente sicuro, mentre il modello standard non riusciva a utilizzare efficacemente il segnale di controllo da solo."

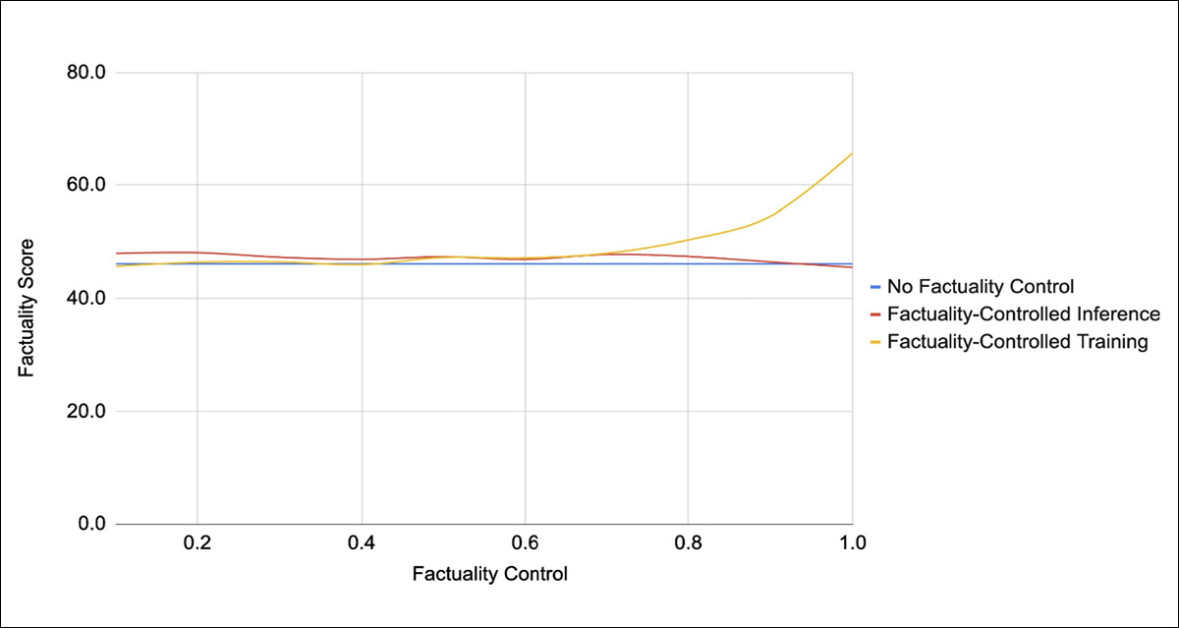

In un test separato, progettato per confermare che il modello avesse effettivamente imparato a interpretare il segnale di controllo, i ricercatori hanno verificato se la fattualità media delle risposte aumentava quando venivano richieste impostazioni di verità più elevate.

Prima dell'addestramento non è emerso alcun modello del genere, ma in seguito i risultati hanno rivelato una tendenza costante al rialzo, con una maggiore fiducia richiesta che produceva risposte corrispondentemente più accurate:

Con l'aumentare dell'impostazione della verità target, il modello perfezionato ha prodotto risultati sempre più fattuali, mentre i modelli di base non hanno mostrato alcun cambiamento coerente nello stesso intervallo.

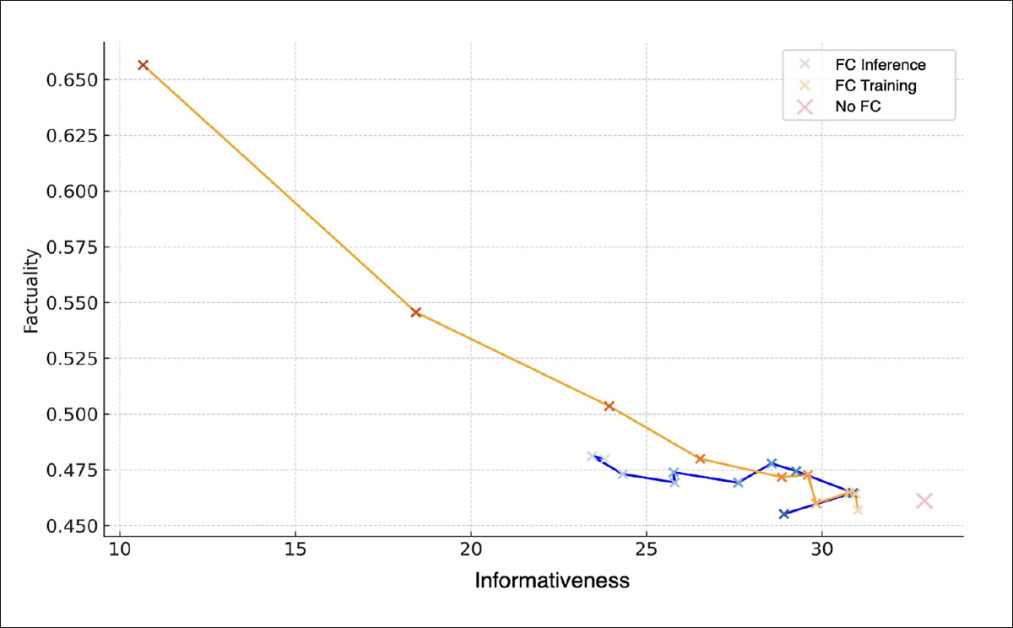

È stato esaminato anche il compromesso tra veridicità e "ricchezza". I risultati sono stati valutati non solo in base all'accuratezza, ma anche in base alla quantità di informazioni verificate rimaste in base a requisiti di fattualità sempre più rigorosi. Come mostrato nel grafico sottostante, il modello FCG ha dimostrato di avere prestazioni superiori sia al modello di base basato solo sull'inferenza sia al modello non vincolato nella maggior parte dei livelli:

Un grafico che rappresenta il compromesso tra fattualità e informatività nei tre metodi. Il modello perfezionato ha dimostrato di offrire un migliore equilibrio tra verità e dettaglio rispetto a entrambi i metodi di base. A livelli di accuratezza comparabili, è stato preservato un contenuto più fattuale e, al livello più alto, è rimasto l'unico metodo in grado di produrre risposte completamente verificate e non vuote.

Con una precisione target di circa il 90%, FCG ha trattenuto più fatti rispetto a qualsiasi altro metodo e, nell'intera gamma di impostazioni di confidenza, nessuna linea di base ha prodotto risultati costantemente migliori.

La differenza era più evidente nell'impostazione più restrittiva, dove l'FCG continuava a produrre un livello di informatività diverso da zero, mentre la linea di base con soli prompt era costretta a rimuovere tutto. In quei casi, anche una singola affermazione a bassa confidenza causava l'eliminazione dell'intera risposta.

Al contrario, il modello addestrato è stato in grado di rimodellare il suo output per preservare solo i fatti che riteneva pienamente affidabili, evitando il crollo nel silenzio che ha colpito gli altri.

La fattualità era direttamente vincolata dall'impostazione di controllo, mentre l'informatività è stata ottimizzata consentendo al modello di includere quanti più contenuti affidabili possibile. A impostazioni più elevate, venivano mantenute solo le affermazioni attendibili; a quelle più basse, erano consentiti dettagli più speculativi, aumentando la lunghezza ma riducendo l'accuratezza.

Gli autori concludono:

"[Quando] è presente un vincolo di elevata fattualità, il modello dà priorità alle affermazioni verificabili nei fatti, pur includendo quante più informazioni rilevanti possibile. Al contrario, il modello ha la libertà di incorporare una gamma più ampia di dettagli, inclusi alcuni meno verificabili o più speculativi, con conseguente maggiore informatività (più fatti menzionati) a scapito di una certa accuratezza.

Questo comportamento è in linea con la nostra progettazione dei dati di addestramento: poiché abbiamo sempre rimosso i fatti minimi necessari, il modello ha imparato che "se devi essere fattuale al x%, elimina i dettagli meno certi ma mantieni tutto il resto".

L'articolo si conclude con la speranza che la nuova metodologia venga sperimentata con modelli su larga scala e applicata a compiti più complessi, tra le altre possibili future estensioni del lavoro.

Conclusione

La soluzione qui proposta affronta uno dei problemi più gravi e spesso notati anche dell'ultima generazione di Large Language Model: la loro tendenza a privilegiare la loquacità rispetto all'accuratezza, apparentemente solo per "mantenere viva la conversazione" e a presentare con sicurezza informazioni obsolete o completamente allucinate come se fossero fatti.

Per gli utenti di ChatGPT, qualsiasi risposta sicura non preceduta dalla breve apparizione di un widget "ricerca web" proverrà dai confini del modello data limite delle conoscenze, altrimenti potrebbe essere tanto un'allucinazione quanto un fatto.

Tuttavia, le ricerche sul Web aumentano la latenza e i costi di gestione dell'host LLM e, come ogni utente sa, vengono eseguite in modo selettivo, su richiesta dell'utente o come "impostazione speciale" che potrebbe comportare costi aggiuntivi in termini di token.

Tuttavia, questo tipo di economia interna può avere un effetto critico sulle query LLM in determinati domini o per determinati tipi di query. Qualsiasi metodo in grado di imporre uno schema relativo all'accuratezza dell'output è sicuramente una ricerca benvenuta.

* La mia conversione delle citazioni in linea degli autori in collegamenti ipertestuali.

† Numero di versione completo non specificato.

Pubblicato per la prima volta venerdì 6 febbraio 2026. Modificato nei cinque minuti successivi per una ripetizione di parole