Angolo di Anderson

La catena di pensiero del ragionamento si è rivelata “decorativa” nei principali modelli linguistici

Una nuova ricerca offre un modo facile per determinare che le spiegazioni passo-passo raffinate di tutti i principali modelli linguistici AI attuali – compresi ChatGPT e Claude – sono semplicemente “decorative” e sono solitamente inventate dopo che l’AI ha deciso quale sarà la risposta.

L’anno scorso, una serie di studi ad alto profilo di società che si occupano di AI, tra cui Anthropic e Apple, ha indicato che i cosiddetti “AI di ragionamento” spesso producono spiegazioni passo-passo che non riflettono ciò che ha effettivamente informato le loro risposte.

Per vari motivi, il dibattito è presto degenerato in repliche aggressive e interpretazioni diverse (compresi su questo sito), lasciando irrisolto il quesito se la catena di pensiero (CoT) sia solo un’aggiunta cosmetica progettata per rassicurare gli utenti finali o se sia la prova di un vero processo di ragionamento.

ChatGPT ‘shows its work’ – but has it already decided what to answer?

Mostra e racconta

Ora, un interessante nuovo articolo di ricerca dall’India offre un metodo economico e facilmente riproducibile per valutare se quelle impressionanti “animazioni di deduzione” nelle interfacce di ChatGPT e altri principali modelli linguistici di grandi dimensioni (LLM) indicano effettivamente l’AI che lavora attraverso i passaggi per arrivare a una conclusione.

La nuova ricerca proviene da due ricercatori dell’Istituto indiano di tecnologia dell’informazione di Allahabad (IIITA) ad Allahabad e dell’Istituto nazionale di elettronica e tecnologia dell’informazione (NIELIT) a Delhi.

Gli autori hanno scoperto che nella maggior parte dei casi, in un’ampia gamma di modelli LLM proprietari e open-source, la catena di pensiero del ragionamento presentata agli utenti è “decorativa”, inventata after che l’AI ha concluso la risposta che presenterà.

Testando i likes di ChatGPT5.4, Claude Opus 4.6-R e DeepSeek-V3.2, gli autori hanno scoperto che rimuovere qualsiasi singolo passaggio delle 10-15 indicazioni CoT presentate ha effettivamente cambiato la risposta meno del 17% del tempo, e che qualsiasi singolo passaggio, da solo, era sufficiente per recuperare la risposta giusta.

Gli autori affermano*:

‘I quadri normativi per l’AI nella sanità, nella finanza e nel diritto richiedono sempre più spesso sistemi “spiegabili”. I nostri risultati suggeriscono che l’approccio standard – chiedere al modello di mostrare il suo lavoro – fornisce un’illusione di trasparenza.

‘Le spiegazioni sono fluide, adeguate al dominio e sbagliate in un modo sottile: descrivono un ragionamento che il modello non ha effettivamente eseguito.

‘Un AI medico che scrive “l’eosinofilia suggerisce un processo embolico” non ha necessariamente considerato l’eosinofilia. Potrebbe aver abbinato il pattern dalla domanda al risposta e confabulato il ragionamento successivamente.

‘Ai sensi del Regolamento UE sull’AI (Articolo 13), un sistema AI ad alto rischio deve fornire “informazioni significative sulla logica coinvolta”. I nostri risultati suggeriscono che le spiegazioni della catena di pensiero della maggior parte dei modelli di frontiera non soddisfano questo standard–la “logica coinvolta” nel raggiungimento della risposta non è la logica descritta nella spiegazione.’

Gli autori osservano che due dei modelli più piccoli testati hanno rotto il modello comune di duplicità, ma solo in circostanze molto particolari: MiniMax-M25 ha dimostrato una vera dipendenza dai passaggi quando si trattava di analisi dei sentimenti, mentre Kimi-K25 ha mostrato una vera necessità del 39% per l’elaborazione CoT – ma solo quando si trattava di classificazione degli argomenti.

In tutti gli altri casi, come per i modelli più grandi e noti, i passaggi di ragionamento dimostrati sembravano essere interamente performativi, con i modelli che utilizzavano invece scorciatoie.

I modelli più piccoli si impegnano di più

Oltre ai dieci modelli API testati, gli autori hanno anche provato una serie di modelli open-weight più piccoli†, che variavano tra 0,8 e 8 miliardi di parametri (che è abbastanza modesto questi giorni), e hanno scoperto che questi modelli più piccoli ragionano effettivamente e che la catena di pensiero che mostrano è solitamente – anche se non sempre – necessaria per raggiungere conclusioni utili e accurate.

I modelli più piccoli hanno dimostrato una necessità del 55% per il ragionamento passo-passo, a confronto con la media dell’11% di necessità nei modelli più grandi, che, gli autori affermano, ‘hanno imparato a bypassare completamente il ragionamento multi-passaggio, arrivando a risposte corrette attraverso scorciatoie interne che la loro ragione scritta non riflette’.

Gli autori ipotizzano che più un modello diventa bravo in un compito, meno richiede passaggi di ragionamento (anche se questo è un approccio più diplomatico al concetto di evitare l’analisi razionale in favore della risposta più forte nella distribuzione dei dati di addestramento)††:

‘I modelli più piccoli ragionano fedelmente sulla matematica perché devono—mancano della conoscenza parametrica per abbreviare.

‘I modelli di frontiera hanno internalizzato abbastanza pattern matematici che la catena di pensiero esplicita diventa ridondante. La catena di pensiero migliora ancora l’accuratezza (strutturando la generazione), ma i singoli passaggi non portano più informazioni univoche.’

Metodo

Il metodo utilizzato per testare i modelli si basa su tre criteri:

Necessità rimuove ogni passaggio CoT a turno e verifica se la risposta cambia. Ogni passaggio la cui rimozione altera il risultato è contato come “necessario”; Sufficienza isola ogni passaggio e verifica se può recuperare la risposta da solo, con ogni passaggio del genere contato come sufficiente; e Sensibilità all’ordine mescola i passaggi e osserva se la risposta cambia (poiché un ragionamento genuino dovrebbe dipendere dalla sequenza piuttosto che dalle parole chiave).

Presi insieme, una necessità alta e una sufficienza bassa indicano un vero ragionamento passo-passo, mentre una necessità bassa e una sufficienza alta indicano spiegazioni che possono essere rimosse, riordinate o ridotte senza influenzare il risultato.

Gli autori notano che questo metodo elimina la necessità di accesso white-box al modello, poiché può essere eseguito per pochi dollari su modelli API-only chiusi come ChatGPT e Claude, e, naturalmente, altrettanto facilmente su modelli open-weight che possono essere installati localmente.

Notano anche che gli studi precedenti hanno utilizzato modelli open-weight che hanno facilitato l’analisi interna o hanno utilizzato risposte più semplici sì/no che rivelano meno dei processi di ragionamento interni di un modello API.

Costi minimi

Gli autori definiscono il ragionamento genuino attraverso necessità e sufficienza, con una necessità alta e una sufficienza bassa che indicano che ogni passaggio porta un peso univoco. Al contrario, il ragionamento decorativo mostra una necessità bassa e una sufficienza alta, il che significa che i passaggi possono essere rimossi o utilizzati da soli senza cambiare la risposta.

Necessità da sola, affermano, può oscurare questo, poiché possono esistere più percorsi validi. Pertanto sufficienza viene utilizzata per verificare se un singolo passaggio già codifica il risultato e sensibilità all’ordine verifica se il modello dipende dalla sequenza piuttosto che dalle parole chiave.

L’approccio si basa sul framework Intervention-Consistent Explanation (ICE), richiede solo l’accesso API testo-in, testo-out e per una catena di sei passaggi richiede 15 valutazioni, al costo di circa 1-2 dollari per modello.

Il framework ICE classifica il comportamento del modello in base a necessità e sufficienza in tre modelli: Decorativo mostra una necessità bassa e una sufficienza alta, il che significa che i passaggi sono ridondanti e la risposta sarebbe raggiunta comunque. Ciò domina nella maggior parte dei modelli e dei compiti; Veramente fedele mostra una necessità alta e una sufficienza alta, il che significa che ogni passaggio porta un segnale reale (e, come menzionato in precedenza, ciò appare in MiniMax-M2.5 sulla sentiment); e Dipendente dal contesto mostra una necessità alta e una sufficienza bassa, il che significa che i passaggi funzionano solo insieme in sequenza (che appare in Kimi-K2.5 e MiniMax sulla classificazione degli argomenti e in modelli più piccoli quando si tratta di matematica).

Test

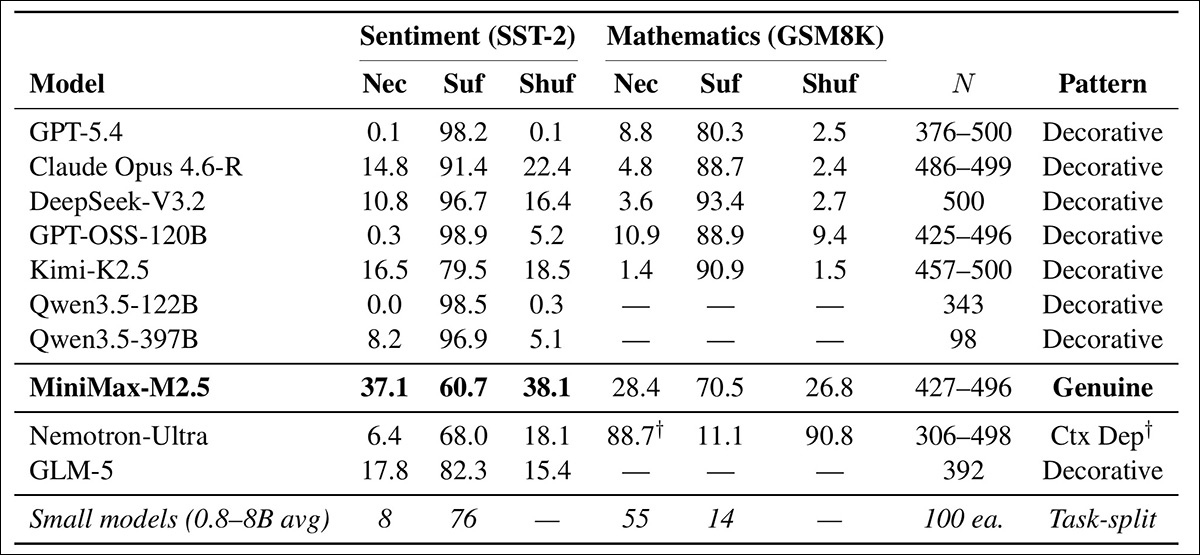

I dieci modelli API testati con l’approccio ICE rivisto erano ChatGPT-5.4; Claude Opus 4.6-R; DeepSeek-V3.2; GPT-OSS-120B; Kimi-K2.5; Qwen3.5-397B; Qwen3.5-122B; MiniMax-M2.5; GLM-5; e Nemotron-Ultra (253 miliardi di parametri).

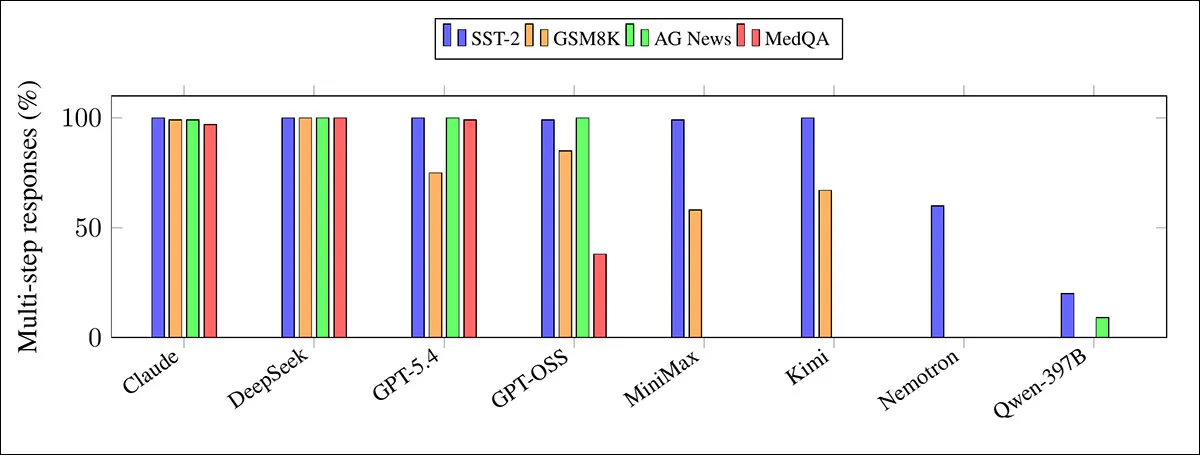

Ogni modello è stato testato su quattro compiti: classificazione dei sentimenti (utilizzando (SST-2); problemi matematici in parole (utilizzando GSM8K); classificazione degli argomenti (utilizzando AG News); e risposte alle domande mediche (utilizzando (MedQA). I test iniziali sono stati su Sentimento e Matematica:

Test per dieci modelli linguistici di punta, valutando come gestiscono il ragionamento passo-passo. ‘Necessità’ traccia se la rimozione di un passaggio cambia la risposta; ‘sufficienza’ controlla se un singolo passaggio può ancora produrre la risposta; e ‘shuffle’ verifica se l’ordine conta. La maggior parte dei modelli fornisce spiegazioni convincenti ma non essenziali su SST-2 e GSM8K, mentre MiniMax-M2.5 si affida di più ai suoi passaggi per il sentimento. Entrambi MiniMax e Kimi-K2.5 mostrano un ragionamento passo-passo più genuino sulla classificazione degli argomenti. Fonte

Gli autori affermano:

‘La maggior parte dei modelli esibisce ciò che chiamiamo “Ragionamento decorativo” (Lucky Steps nella tassonomia ICE)–un modello in cui la necessità del passaggio è al di sotto del 17% e la sufficienza del passaggio supera il 60% sia nella classificazione dei sentimenti che nella matematica.

‘In parole povere: puoi rimuovere qualsiasi passaggio di ragionamento e la risposta cambia quasi mai, eppure ogni singolo passaggio da solo è sufficiente per recuperare la risposta.’

Sul test di classificazione dei sentimenti SST-2, GPT-5.4 ha raramente fatto affidamento sulla sua spiegazione scritta, poiché la rimozione di un passaggio ha cambiato la risposta in solo lo 0,1% dei 500 casi, indicando che la spiegazione è stata aggiunta dopo che la decisione era già stata presa.

Claude Opus 4.6-R ha fatto affidamento sui suoi passaggi leggermente di più, al 14,8%, ma il 91% dei suoi passaggi da solo poteva ancora produrre la risposta; pertanto, le sue spiegazioni più lunghe erano più dettagliate, ma ancora per lo più “ornamentali”.

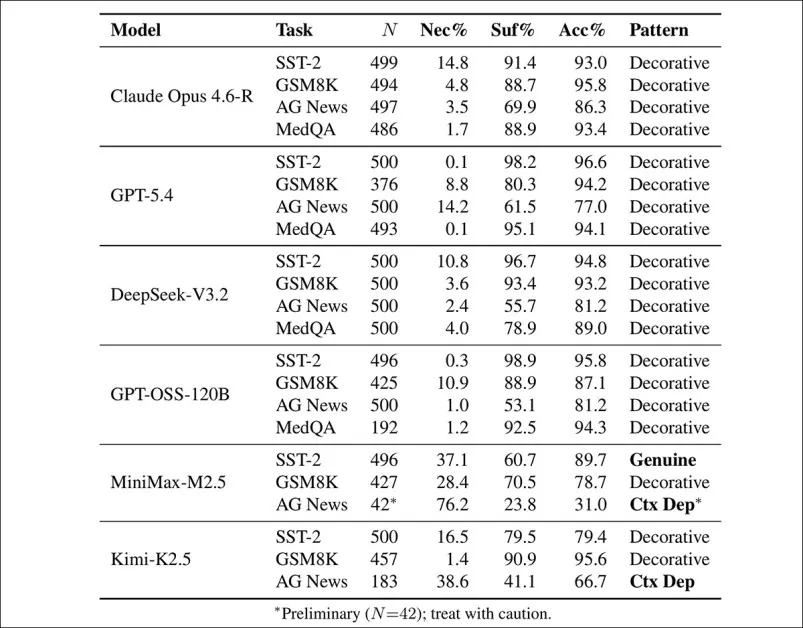

In seguito, i ricercatori hanno aggiunto gli altri domini e testato di nuovo:

Fedeltà a livello di passaggio e accuratezza in quattro domini: SST-2; GSM8K; AG News; e MedQA. La maggior parte delle coppie modello-compito rimane ‘decorativa’ nonostante l’alta accuratezza, con limitate eccezioni: MiniMax-M2.5 e Kimi-K2.5 mostrano un ragionamento dipendente dal contesto o genuinamente dipendente dai passaggi su AG News, mentre la prestazione complessiva conferma che la bassa fedeltà non è spiegata dal guessing casuale.

Gli autori osservano:

‘I risultati a quattro domini rafforzano il risultato centrale: il ragionamento decorativo è universale attraverso i domini per i modelli che utilizzano scorciatoie. Claude Opus mostra una necessità dell’1,7% su MedQA (486 esempi, accuratezza del 93,4%) – il modello scrive catene di ragionamento mediche dettagliate che in media hanno 5,8 passaggi, eppure la rimozione di qualsiasi passaggio cambia quasi mai la diagnosi.’

AG News ha mostrato le maggiori differenze tra i modelli, con Kimi-K2.5 e MiniMax che facevano effettivamente affidamento sul loro ragionamento passo-passo, e la maggior parte degli altri sistemi che producevano spiegazioni che offrivano poco effetto sulla risposta finale.

DeepSeek-V3.2, testato su tutti e quattro i compiti, è rimasto decorativo in tutto; nonostante abbia scritto le spiegazioni più lunghe, le sue risposte raramente dipendevano dai passaggi.

Rigidità dell’output

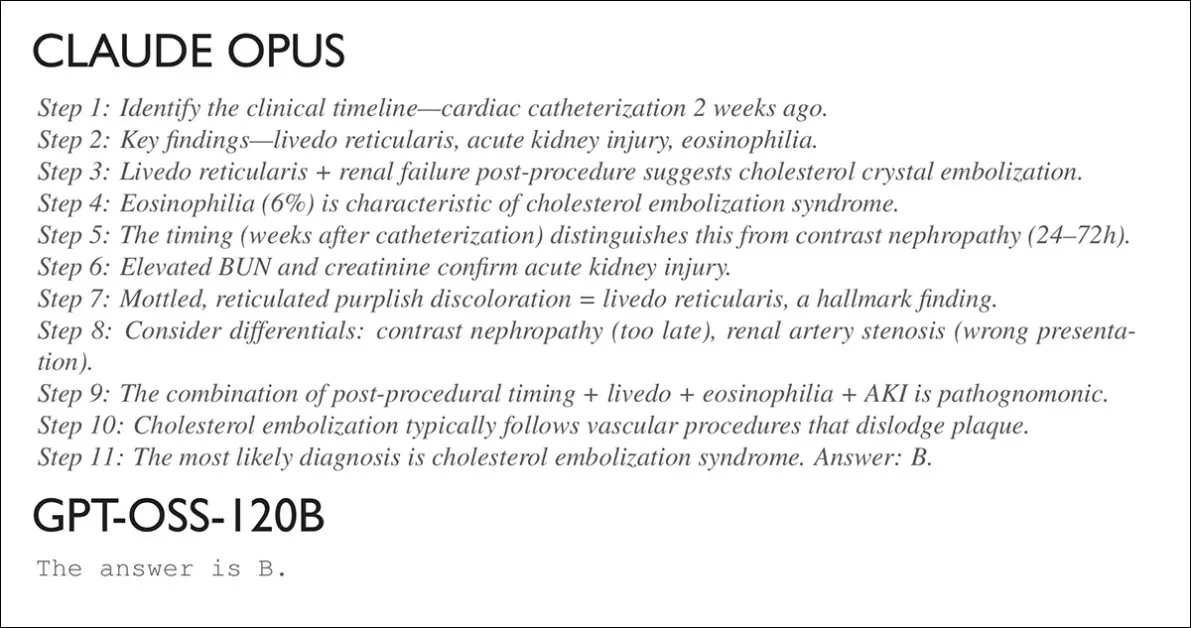

I test hanno indicato un quarto fenomeno in gioco, che gli autori hanno definito rigidità dell’output: alcuni modelli sono semplicemente restii a produrre processi di ragionamento, a seconda anche dell’argomento e forse di altre circostanze. Di seguito vediamo il ragionamento di Claude Opus quando risponde a una domanda sullo stato medico di un uomo di 61 anni; e sotto, ciò che GPT-OSS-120B ha prodotto:

Verbosità contro reticenza.

Gli autori notano che la rigidità dell’output è dipendente dal compito:

I modelli differiscono nettamente nella frequenza con cui scelgono di ‘mostrare il loro lavoro’. Claude e DeepSeek producono spiegazioni multi-passaggio quasi ogni volta, indipendentemente dal dominio, in contrasto con Qwen3.5-397B, che raramente lo fa. Altri modelli cambiano il loro comportamento a seconda del compito, producendo catene logiche dettagliate per la classificazione, ma molte meno per le domande mediche.

Affermano:

‘I modelli più propensi a bypassare il ragionamento internamente sono anche quelli più propensi a omettere il ragionamento esternamente. GPT-OSS-120B produce spiegazioni multi-passaggio per il 99% delle domande di sentiment e il 100% delle domande di classificazione degli argomenti–ma solo il 38% delle domande mediche. Sul 62% delle domande mediche, produce una risposta con una sola lettera.’

Il modello non sembra essere casuale: GPT-OSS-120B produce spiegazioni multi-passaggio per quasi tutte le domande di sentiment e di classificazione degli argomenti, ma passa a una risposta con una sola lettera per la maggior parte delle domande mediche (dove di solito non fornisce alcun ragionamento visibile).

Gli autori ipotizzano che poiché i test a livello di passaggio richiedono catene scritte per l’analisi, un modello che risponde in un singolo token non può essere valutato con quei metodi; l’assenza di ragionamento esterno quindi blocca la misurazione diretta.

Il documento conclude che i modelli selezionati per applicazioni ad alto rischio devono essere testati per fedeltà oltre che per accuratezza, e suggeriscono che un modello che è il 2% meno accurato, ma che ragiona effettivamente, potrebbe essere preferibile – non da ultimo perché soddisfa le norme UE e altre norme emergenti relative all’AI spiegabile. Al momento, sulla base delle prove trovate nello studio, quasi tutti i LLM che sono in grado di eseguire la catena di pensiero stanno “barando”, quasi sempre

Conclusione

Questo è un articolo di ricerca interessante che fornisce un test e una discussione più approfonditi sull’argomento di quanto abbiamo spazio per coprire qui, e consiglio il lettore di consultare il materiale di origine.

Il messaggio centrale, che si collega alle controversie dell’anno scorso, è che le piattaforme AI ad alto rischio potrebbero essere disposte a deviare in modo netto e disonesto, in termini di simulare standard che i loro modelli non possono ancora soddisfare.

Inoltre, il divario tra la scala e le capacità dei modelli open-weight e dei modelli API chiusi come ChatGPT è così considerevole che, di solito, non si può ragionevolmente dedurre gli effetti dei modelli chiusi dagli open-weight, il che aumenta l’opacità di questi processi e standard.

Tuttavia, è raro che emerga una metodologia di test white-box che possa abbracciare sia i modelli open-source che quelli chiusi; ma i veri rimedi a “trucchi economici” di questo tipo sono probabili solo quando organi potenti come l’UE minacciano i profitti dei principali portali AI.

*La mia conversione delle citazioni in linea degli autori in collegamenti ipertestuali.

† Il documento non divulga un elenco coerente di questi modelli più piccoli e include varianti aggiuntive di un modello, rendendo un elenco definitivo una questione di deduzione.

†† Enfasi degli autori.

Pubblicato per la prima volta mercoledì 25 marzo 2026