Intelligenza artificiale

EAGLE: Esplorazione dello Spazio di Progettazione per Modelli Linguistici Multimodali di Grande Scala con una Miscela di Encoder

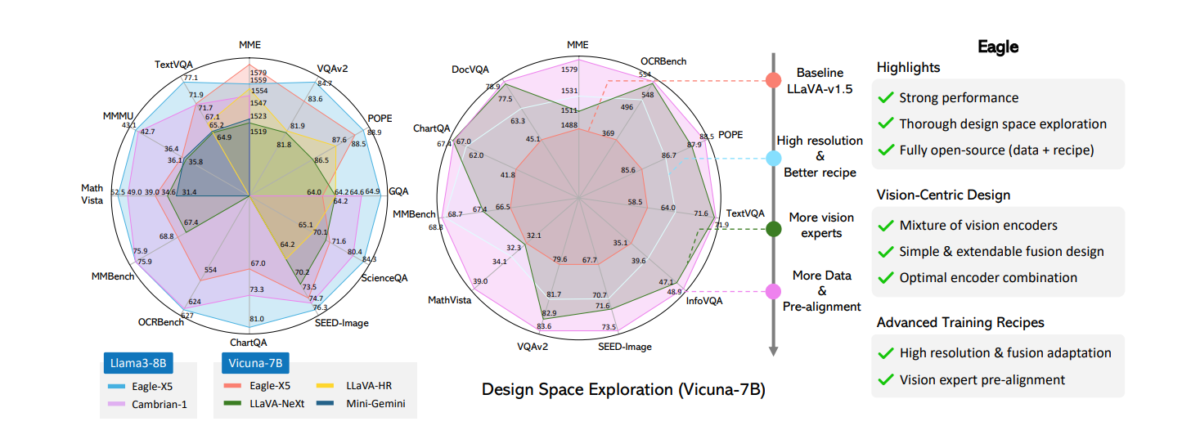

La capacità di interpretare con precisione le informazioni visive complesse è un focus cruciale per i modelli linguistici multimodali di grande scala (MLLM). Studi recenti mostrano che una percezione visiva migliorata riduce notevolmente le allucinazioni e migliora le prestazioni in compiti sensibili alla risoluzione, come il riconoscimento ottico dei caratteri e l’analisi dei documenti. Diversi MLLM recenti raggiungono questo obiettivo utilizzando una miscela di encoder visivi. Nonostante il loro successo, c’è una carenza di confronti sistematici e di studi di ablazione dettagliati che affrontano aspetti critici, come la selezione degli esperti e l’integrazione di più esperti visivi. Questo articolo fornisce un’ampia esplorazione dello spazio di progettazione per MLLM utilizzando una miscela di encoder visivi e risoluzioni, il framework Eagle che tenta di esplorare lo spazio di progettazione per modelli linguistici multimodali di grande scala con una miscela di encoder. I risultati rivelano diversi principi fondamentali comuni a varie strategie esistenti, portando a un approccio di progettazione efficiente eppure efficace. Eagle scopre che semplicemente concatenare token visivi da un set di encoder visivi complementari è altrettanto efficace quanto architetture di miscela più complesse o strategie. Inoltre, Eagle introduce Pre-Allineamento per colmare il divario tra encoder visivi focalizzati e token linguistici, migliorando la coerenza del modello. La risultante famiglia di MLLM, Eagle, supera altri modelli open-source leader nei principali benchmark MLLM.

Il lavoro di Eagle è legato alla progettazione generale dell’architettura dei modelli linguistici multimodali di grande scala (MLLM). Oltre alla linea di ricerca open-source rappresentativa menzionata in precedenza, altre famiglie note di MLLM includono, ma non sono limitate a, MiniGPT-4, Lynx, Otter, QwenVL, CogVLM, VILA, GPT-4V, Gemini e Llama 3.1. A seconda di come i segnali visivi vengono integrati nel modello linguistico, gli MLLM possono essere ampiamente categorizzati in modelli di “attenzione cross-modale” e modelli di “prefix-tuning”. I primi iniettano informazioni visive in diversi strati di LLM utilizzando l’attenzione cross-modale, mentre i secondi trattano i token visivi come parte della sequenza di token linguistici e li appongono direttamente con le embedding di testo. Il modello di Eagle appartiene alla famiglia del prefix-tuning seguendo un’architettura multimodale nello stile di LLaVA.

Il lavoro di Eagle è strettamente legato alla ricerca focalizzata sul miglioramento della progettazione degli encoder visivi per MLLM. I lavori precedenti adottavano spesso encoder visivi pre-addestrati su compiti di allineamento visivo-linguistico come CLIP e EVA-CLIP. Encoder visivi più forti, come SigLIP e InternVL, sono stati proposti per migliorare le attività visivo-linguistiche con migliori progettazioni, dimensioni di modello più grandi e ricette di addestramento più efficaci. Poiché i modelli sono spesso pre-addestrati su immagini a bassa risoluzione e possono mancare della capacità di codificare dettagli fini, l’adattamento a risoluzioni più elevate viene spesso eseguito per aumentare la risoluzione di input di MLLM. Oltre all’adattamento a risoluzioni più elevate, modelli come LLaVA-NeXT, LLaVA-UHD, Monkey, InternLM-XComposer e InternVL utilizzano la tecnica di tiling o tiling adattivo per gestire input ad alta risoluzione, dove le immagini vengono divise in patch a bassa risoluzione e elaborate separatamente. Sebbene la capacità di gestire risoluzioni più elevate sia resa possibile introducendo ulteriori esperti visivi, questo approccio differisce leggermente dalle tecniche di tiling, sebbene entrambi siano compatibili e possano essere combinati.

EAGLE: Utilizzo di una Miscela di Encoder per Esplorare lo Spazio di Progettazione per MLLM

Il successo dei modelli linguistici di grande scala (LLM) ha suscitato un grande interesse nel consentire loro di acquisire capacità di percezione visiva, permettendo loro di vedere, capire e ragionare nel mondo reale. Al centro di questi modelli linguistici multimodali di grande scala (MLLM) c’è una progettazione tipica in cui le immagini vengono convertite in una serie di token visivi dagli encoder visivi e apposte con le embedding di testo. CLIP viene spesso scelto come encoder visivo perché la sua rappresentazione visiva è allineata con lo spazio del testo mediante pre-addestramento su coppie di immagini e testo. A seconda delle architetture, delle ricette di addestramento e del modo in cui i token visivi vengono iniettati nel modello linguistico, famiglie note di MLLM includono Flamingo, BLIP, PaLI, PaLM-E e LLaVA. La maggior parte di questi modelli mantiene risoluzioni di input relativamente basse a causa delle limitazioni degli encoder visivi pre-addestrati e della lunghezza della sequenza di LLM. Il lavoro di Eagle è strettamente allineato con modelli che utilizzano più encoder visivi per una migliore percezione.

Per esempio, modelli come Mousi e Brave fondono token visivi da diversi encoder visivi concatenandoli lungo il canale o la direzione del token. RADIO introduce un metodo di distillazione multi-insegnante per unificare le capacità di diversi encoder visivi in un singolo modello. MoAI, IVE e Prismer utilizzano inoltre l’output di esperti visivi, come OCR, rilevamento o stima della profondità, per integrare informazioni aggiuntive per MLLM per generare risposte. MoVA elabora una rete di routing per assegnare un modello visivo ottimale in base all’immagine e alle istruzioni dati.

Studi recenti hanno mostrato che progettazioni di encoder visivi più forti sono importanti per ridurre le allucinazioni di MLLM e migliorare le prestazioni in compiti sensibili alla risoluzione come il riconoscimento ottico dei caratteri. Diversi lavori si concentrano sul miglioramento della capacità dell’encoder visivo, sia aumentando le dimensioni del modello e le ricette di addestramento, sia dividendo le immagini in patch a bassa risoluzione. Tuttavia, questi approcci spesso introducono grandi richieste di risorse di addestramento. Una strategia efficiente eppure potente è la miscela di encoder visivi pre-addestrati con compiti e risoluzioni di input diversi, sia fondendo encoder a risoluzione più elevata con l’encoder CLIP, sia appendendo sequenzialmente caratteristiche da diversi encoder, sia adottando strategie di fusione e routing più complesse per massimizzare i benefici di diversi encoder. Questo approccio “miscela di esperti visivi” si è rivelato efficace, sebbene uno studio dettagliato del suo spazio di progettazione con ablazione rigorosa sia ancora carente, motivando Eagle a rivedere questa area. Rimangono domande chiave: quali combinazioni di encoder visivi scegliere, come fondere diversi esperti e come regolare le strategie di addestramento con più encoder visivi.

Per affrontare queste domande, Eagle indaga sistematicamente lo spazio di progettazione della miscela di encoder visivi per una migliore percezione di MLLM. L’esplorazione di questo spazio di progettazione coinvolge i seguenti passaggi: 1) valutazione di vari encoder visivi e ricerca di un adattamento a risoluzioni più elevate; 2) confronto “apples to apples” tra strategie di fusione di encoder visivi; 3) identificazione progressiva della combinazione ottimale di più encoder visivi; 4) miglioramento dell’allineamento pre-visivo e della miscela dei dati. I passaggi di esplorazione sono illustrati nell’immagine seguente.

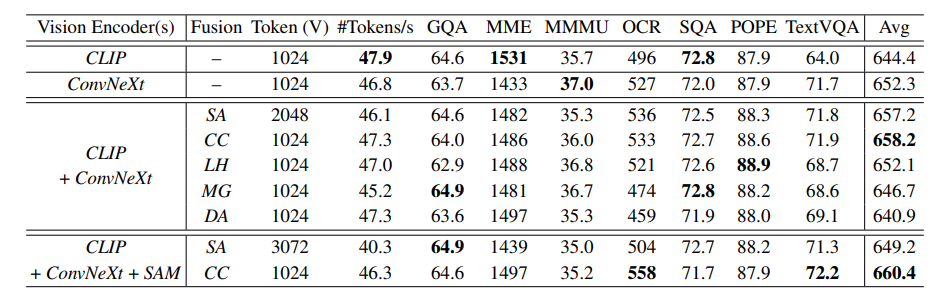

Lo studio di Eagle copre le prestazioni di encoder visivi pre-addestrati su compiti e risoluzioni diversi, come allineamento visivo-linguistico, apprendimento auto-supervisionato, rilevamento, segmentazione e OCR. Utilizzando un approccio round-robin, Eagle inizia con l’encoder di base CLIP e aggiunge un esperto aggiuntivo alla volta, selezionando l’esperto che fornisce il miglioramento più significativo in ogni round.

Sebbene il lavoro di Eagle non sia il primo a sfruttare più encoder visivi in MLLM, lo studio sistematico conduce a diverse scoperte chiave in questo contesto:

- Sbloccare gli encoder visivi durante l’addestramento di MLLM è importante. Ciò è in contrasto con modelli come LLaVA e altri che considerano più encoder visivi o insegnanti, dove congelare gli encoder visivi è stata una pratica comune.

- Alcune strategie di fusione recentemente proposte non mostrano vantaggi significativi. Invece, la concatenazione diretta dei canali emerge come una strategia di fusione semplice e competitiva, offrendo la migliore efficienza e prestazione.

- L’integrazione di ulteriori esperti visivi porta a guadagni consistenti. Ciò rende questo percorso promettente per migliorare sistematicamente la percezione di MLLM, oltre al semplice aumento degli encoder singoli. Il miglioramento è particolarmente pronunciato quando gli encoder visivi sono sbloccati.

- La fase di pre-allineamento è fondamentale. Eagle introduce una fase di pre-allineamento in cui gli esperti visivi non allineati con il testo vengono individualmente ritoccati con un LLM congelato prima di essere addestrati insieme. Questa fase migliora significativamente le prestazioni di MLLM sotto la progettazione della miscela di encoder visivi.

Eagle: Metodologia e Architettura

A differenza dei metodi precedenti che si concentrano su nuove strategie di fusione o architetture tra encoder visivi, l’obiettivo di Eagle è identificare una progettazione minimalista per fondere diversi encoder visivi, supportata da ablazioni dettagliate e rimozione di componenti non necessari. Come mostrato nella figura seguente, Eagle inizia estendendo l’encoder di base CLIP a un set di esperti visivi con architetture, compiti di pre-addestramento e risoluzioni diverse. Con questi esperti, Eagle confronta poi diverse architetture di fusione e metodi e esplora come ottimizzare le strategie di pre-addestramento con più encoder.

Infine, Eagle combina tutte le scoperte e estende l’approccio a più encoder visivi con risoluzioni e conoscenze di dominio diverse. Utilizzando gli stessi dati di pre-addestramento di LLaVA-1.5, che consistono di 595k coppie di immagini e testo, Eagle passa alla fase di addestramento supervisionato raccogliendo dati da una serie di compiti e convertendoli in conversazioni multimodali, includendo LLaVA-1.5, Laion-GPT4V, ShareGPT-4V, DocVQA, synDog-EN, ChartQA, DVQA e AI2D, risultando in 934k campioni.

Il modello viene pre-addestrato con coppie di immagini e testo per un’epoca con una dimensione del batch di 256, dove l’intero modello è congelato e solo lo strato del proiettore viene aggiornato. Nella seconda fase, il modello viene addestrato sui dati di addestramento supervisionato per un’epoca con una dimensione del batch di 128. Per questa esplorazione, Eagle impiega Vicuna-7B come modello linguistico di base. Le velocità di apprendimento sono impostate su 1e-3 per la prima fase e 2e-5 per la seconda fase.

Encoder CLIP più Forte

Eagle inizia l’esplorazione con il modello CLIP, poiché è diventato la scelta principale per molti MLLM. Sebbene i modelli CLIP siano noti per migliorare le attività multimodali, le loro limitazioni sono state anche ben documentate. Per esempio, molti MLLM esistenti tendono a utilizzare le risoluzioni pre-addestrate di CLIP (come 224 × 224 o 336 × 336) come risoluzioni di input. In questi casi, gli encoder spesso lottano per catturare dettagli fini importanti per compiti sensibili alla risoluzione come OCR e comprensione dei documenti.

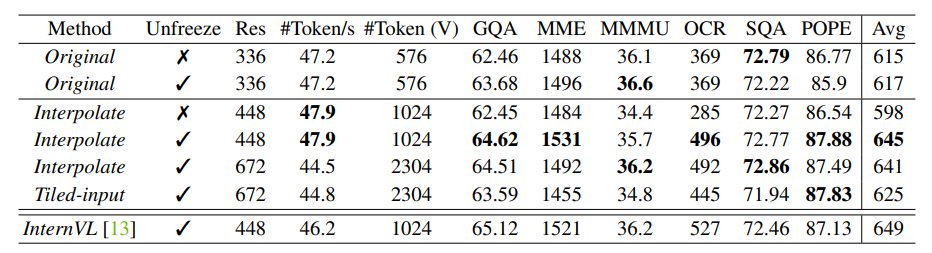

Per gestire un aumento della risoluzione di input, un approccio comune è il tiling, dove le immagini di input vengono divise in tile e codificate separatamente. Un altro metodo più semplice è scalare direttamente la risoluzione di input e interpolare le embedding di posizione del modello di trasformazione visiva se necessario. Eagle confronta questi due approcci con encoder visivi congelati e sbloccati attraverso diverse risoluzioni, con i risultati contenuti nella tabella sopra. Le scoperte possono essere riassunte come segue:

- Sbloccare l’encoder CLIP porta a un miglioramento significativo quando si interpolano a una risoluzione di input di MLLM più elevata che differisce dalla risoluzione di pre-addestramento di CLIP, senza degrado delle prestazioni quando le risoluzioni rimangono le stesse.

- Congelare l’encoder CLIP e adattarlo direttamente a una risoluzione di input di MLLM più elevata danneggia notevolmente le prestazioni.

- Tra le strategie confrontate, interpolare direttamente a 448 × 448 con un encoder CLIP sbloccato si rivela essere sia efficace che efficiente in termini di prestazioni e costo.

- L’encoder CLIP migliore raggiunge prestazioni vicine a InternVL, nonostante essere un modello molto più piccolo (300M vs. 6B) con meno dati di pre-addestramento.

È degno di nota che CLIP-448 consente a Eagle di allinearsi con l’impostazione di LLaVA-HR e InternVL, dove gli encoder CLIP vengono adattati per accettare input 448 × 448 e produrre 1024 token di patch. Per ulteriori indagini, Eagle segue questa strategia semplice di scalare la risoluzione di input e sbloccare l’encoder visivo durante l’addestramento.

Eagle osserva che le strategie di fusione esistenti, nonostante le loro variazioni di progettazione, possono essere ampiamente categorizzate come segue:

- Appendice di Sequenza: Appendere direttamente i token visivi da diversi backbone come una sequenza più lunga.

- Concatenazione dei Canali: Concatenare i token visivi lungo la dimensione del canale senza aumentare la lunghezza della sequenza.

- LLaVA-HR: Iniettare caratteristiche ad alta risoluzione in token visivi a bassa risoluzione utilizzando un adattatore di miscela di risoluzione.

- Mini-Gemini: Utilizzare i token CLIP come query a bassa risoluzione per cross-attendere un altro encoder visivo ad alta risoluzione in finestre locali co-locate.

- Attenzione Deformabile: Una nuova baseline introdotta sopra Mini-Gemini, dove l’attenzione della finestra vanilla viene sostituita con l’attenzione deformabile.

Invece di addestrare un proiettore per allineare simultaneamente più esperti visivi come nella strategia di pre-addestramento originale di LLaVA, Eagle allinea prima la rappresentazione di ogni singolo esperto con un modello linguistico più piccolo (Vicuna-7B nella pratica) utilizzando la supervisione della previsione del token successivo. Come mostrato nella figura seguente, con il pre-allineamento, l’intero processo di addestramento consiste di tre passaggi: 1) addestramento di ogni esperto visivo pre-addestrato con il proprio proiettore sui dati SFT, mantenendo il modello linguistico congelato; 2) combinazione di tutti gli esperti visivi dal primo passaggio e addestramento solo del proiettore con dati di immagini e testo; 3) addestramento dell’intero modello sui dati SFT.

Eagle: Esperimenti e Risultati

Dopo aver sviluppato meticolosamente le sue strategie, Eagle ha stabilito i seguenti principi per il modello: (1) integrazione di più esperti visivi con una ricetta di addestramento ottimizzata; (2) combinazione di più esperti visivi attraverso la concatenazione diretta dei canali; (3) pre-addestramento degli esperti visivi separatamente tramite pre-allineamento. In questa sezione, per dimostrare ulteriormente i vantaggi dei modelli Eagle, vengono incorporati dati di addestramento aggiuntivi e Eagle viene confrontato con gli attuali modelli MLLM di stato dell’arte in vari compiti. Eagle utilizza Vicuna-v1.5-7B, Llama3-8B e Vicuna-v1.5-13B come modelli linguistici. Per gli encoder visivi, sulla base dei risultati della sezione 2.6, i modelli Eagle sono denominati Eagle-X4, che include quattro encoder visivi: CLIP, ConvNeXt, Pix2Struct e EVA-02, e Eagle-X5, che include un encoder visivo SAM aggiuntivo.

Compiti di Risposta alle Domande Visive

Eagle confronta la serie di modelli attraverso tre benchmark di risposta alle domande visive, includendo GQA, VQAv2 e VizWiz. Come mostrato nella tabella seguente, Eagle-X5 raggiunge le prestazioni di stato dell’arte su GQA e VQAv2, evidenziando i vantaggi dell’integrazione di ulteriori esperti visivi.

Compiti di OCR e Comprensione dei Grafici

Per valutare le capacità di OCR, documenti e comprensione dei grafici di Eagle, il modello viene valutato su OCRBench, TextVQA e ChartQA. Come mostrato nella tabella sopra, Eagle supera notevolmente i concorrenti su TextVQA, beneficiando della sua architettura ad alta risoluzione e dell’integrazione di diversi encoder visivi. Notabilmente, Eagle mantiene una progettazione semplice, supportando fino a 1024 token senza richiedere una decomposizione di tile complessa delle immagini.

La figura seguente presenta esempi di casi di OCR e comprensione dei documenti. Con l’adattamento ad alta risoluzione e l’inclusione di più esperti visivi, Eagle può identificare testo piccolo all’interno delle immagini ed estrarre informazioni con precisione in base alle istruzioni dell’utente.

Per comprendere meglio i vantaggi dell’introduzione di esperti pre-addestrati su altri compiti visivi, la figura seguente visualizza i risultati di un modello con solo gli encoder visivi ConvNeXt e CLIP, confrontati con i risultati di Eagle-X5. Con l’intero set di encoder visivi, il modello corregge con successo gli errori, dimostrando che anche quando dotato di encoder visivi ad alta risoluzione pre-addestrati sull’allineamento visivo-linguistico, le capacità di Eagle sono ulteriormente migliorate integrando ulteriori esperti visivi pre-addestrati su compiti visivi diversi.

Valutazione del Benchmark Multimodale

Eagle viene valutato su sette benchmark per MLLM per dimostrare le sue capacità da diverse prospettive, includendo MME, MMBench, SEED, MathVista, MMMU, ScienceQA e POPE. Specificamente, MME, MMBench e SEED valutano le prestazioni generali su vari compiti del mondo reale che coinvolgono ragionamento, riconoscimento, conoscenza e OCR. MMMU si concentra su problemi impegnativi da diversi domini che richiedono conoscenze a livello universitario. POPE valuta le allucinazioni visive di MLLM. Le metriche utilizzate in questa valutazione seguono le impostazioni predefinite di questi benchmark. Eagle riporta il punteggio di percezione per MME, la divisione en_dev per MMBench, la divisione delle immagini per SEED, la divisione test-mini per MathVista, la divisione val per MMMU, il punteggio F1 per POPE e il punteggio per le immagini per ScienceQA, assicurando l’allineamento con i punteggi segnalati da altri modelli.

Pensieri Finali

In questo articolo, abbiamo parlato di Eagle, un’analisi approfondita dello spazio di progettazione per l’integrazione di encoder visivi in modelli linguistici multimodali di grande scala. A differenza dei lavori precedenti che si concentrano sulla progettazione di nuovi paradigmi di fusione, Eagle scopre che le scelte di progettazione sistematiche sono importanti e scopre una serie di tecniche utili. Passo dopo passo, Eagle ottimizza la ricetta di addestramento di singoli encoder visivi, identifica un metodo di fusione estensibile ed efficiente e combina gradualmente gli encoder visivi con conoscenze di dominio diverse. I risultati evidenziano l’importanza critica delle considerazioni fondamentali dello spazio di progettazione.