Angolo di Anderson

I Rompicapo Jigsaw Potenziano il Ragionamento Visivo dell’AI

Nuove ricerche indicano che i modelli di intelligenza artificiale possono diventare più intelligenti nel vedere risolvendo rompicapo jigsaw. Riordinare immagini, video e scene 3D confuse aiuta a migliorare le loro abilità visive senza la necessità di ulteriori dati, etichette o strumenti.

Nella corsa attuale per spingere i Multimodal Large Language Models (MLLM) avanti nel pacchetto (o almeno rimanere tre rilasci davanti al rivale più vicino), ci sono poche vittorie facili e nessun pasto gratuito.

Sebbene molti dei rilasci FOSS cinesi del 2025 siano riportati come aventi bassi costi di sviluppo e di esecuzione, i rilasci occidentali tendono a lanciare di più sul problema: più volume di dati, più potenza di inferenza, più elettricità (anche se non, come abbiamo recentemente notato, più annotatori umani reali, poiché questo è troppo costoso anche per la rivoluzione dell’AI da $trilioni+).

Nella letteratura di ricerca, la maggior parte degli approcci “gratuiti” all’evoluzione delle architetture dell’AI tende a offrire solo miglioramenti incrementali minori; o miglioramenti in aree che non sono le più criticamente perseguite. Tuttavia, la ricerca di “principi fondamentali” finora non scoperti che potrebbero accelerare il ritmo dello sviluppo è troppo allettante per abbandonarla.

Raccogliere i Pezzi

Mentre non è proprio in quella categoria, una nuova collaborazione accademica tra istituzioni cinesi afferma di aver determinato che far risolvere ai VLM rompicapo jigsaw migliora notevolmente le loro prestazioni, anche se questo approccio di apprendimento per rinforzo ha precedentemente funzionato male in questa area, e anche se non richiede sistemi aggiuntivi, modelli ausiliari o altri processi “bolt-on”:

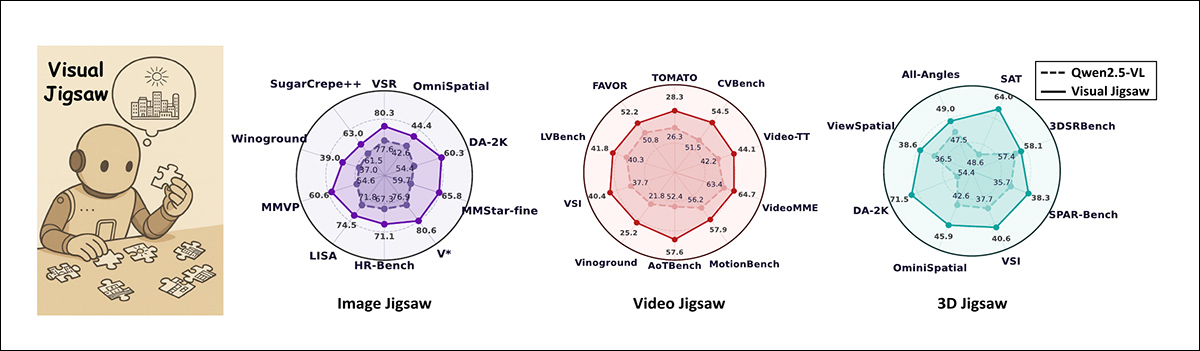

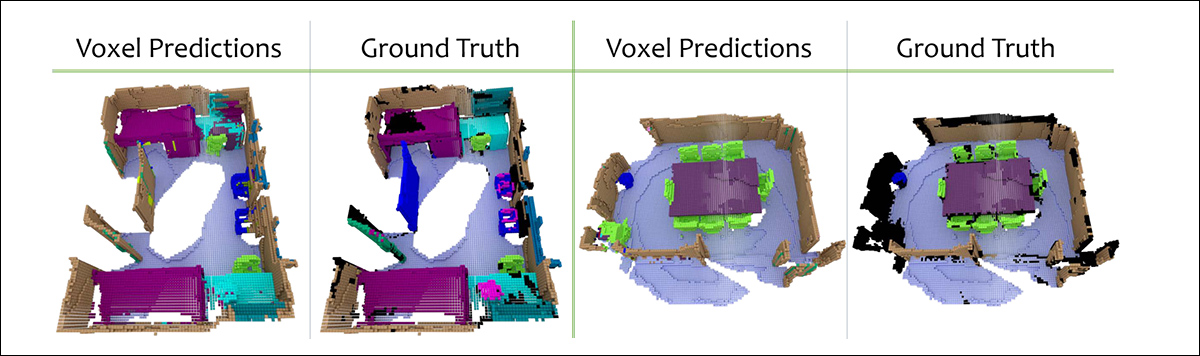

Visual Jigsaw è un framework di post-formazione auto-supervisionato che migliora le abilità visive nei multimodal large language models. Formando su compiti jigsaw attraverso immagini, video e dati 3D, i modelli guadagnano una percezione più fine, spaziale e compositiva più forte nelle immagini, una ragione temporale più forte nei video e una comprensione geometrica più consapevole nelle scene 3D. I grafici a raggiera nell’immagine in alto mostrano guadagni coerenti rispetto al Qwen2.5-VL di base, con scale di valore regolate per ogni benchmark per chiarezza. Fonte: https://arxiv.org/pdf/2509.25190

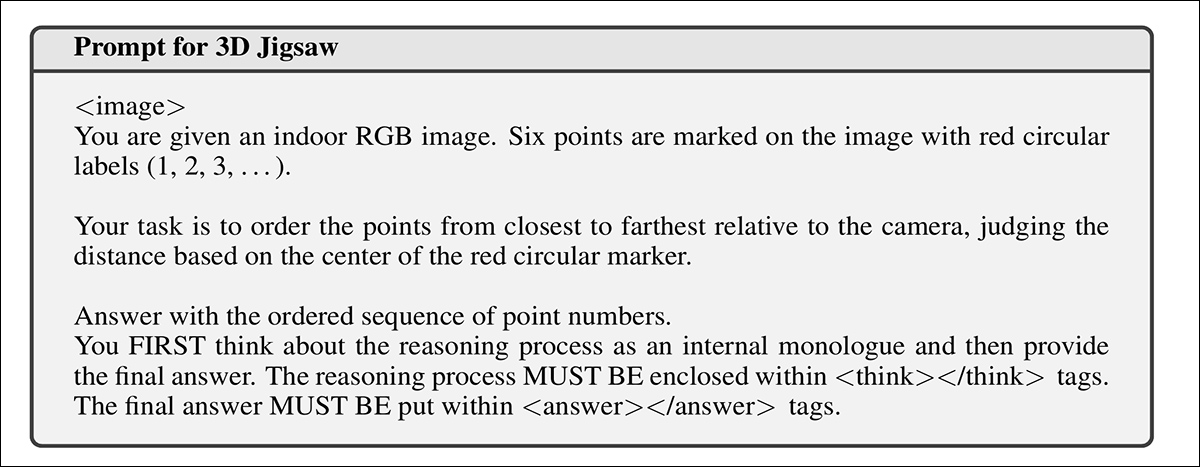

Il sistema ideato dai ricercatori è intitolato Visual Jigsaw e consiste nel formare MLLM esistenti su materiale che è stato frammentato e disperso casualmente, come un rompicapo. Gli autori hanno sviluppato tre modalità per questo approccio: immagine, video e 3D (cioè mesh di stile CGI), e hanno scoperto che un adattamento moderato dello stesso processo ha beneficiato tutti e tre i domini:

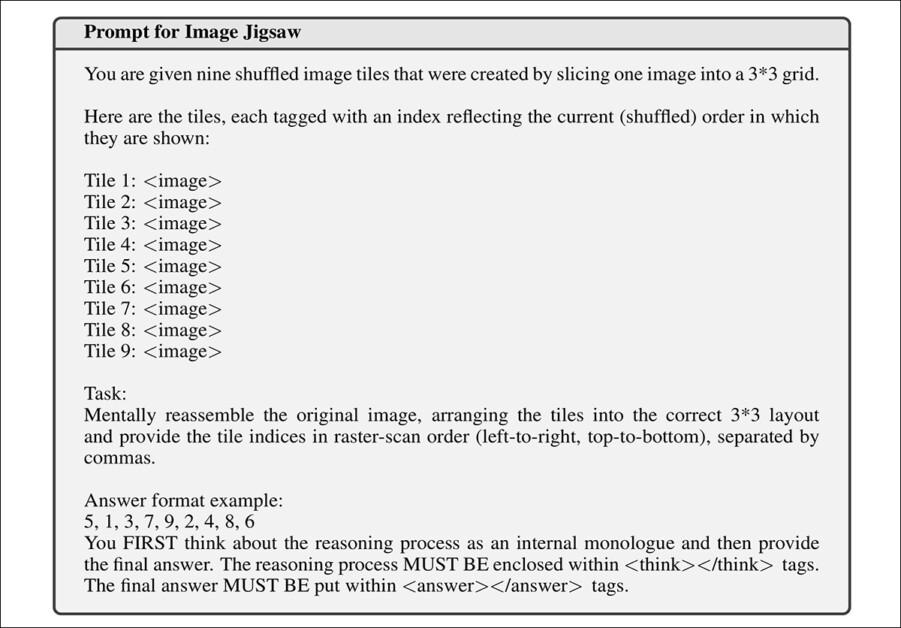

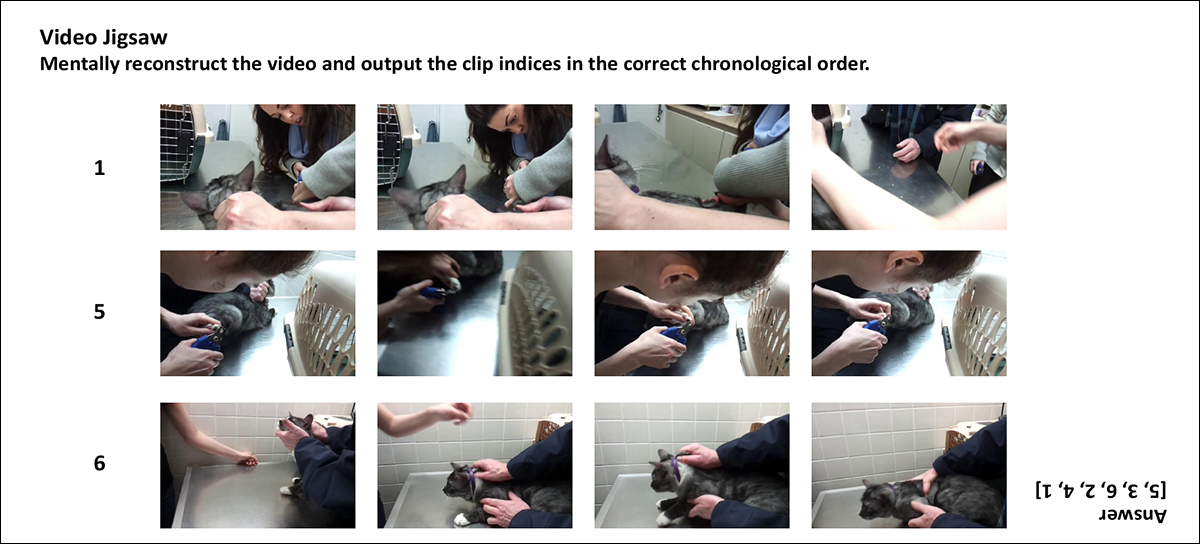

Una rappresentazione dei tre compiti Visual Jigsaw. Nel Jigsaw dell’immagine, un’immagine è divisa in patch, mescolate e il modello predice il layout corretto; nel Jigsaw del video, i clip sono mescolati e il modello ripristina il loro ordine cronologico; nel Jigsaw 3D, i punti con diverse profondità sono mescolati e il modello li classifica da più vicino a più lontano. Le uscite del modello sono valutate contro la verità di base, con credito parziale concesso per soluzioni parzialmente corrette.

Il metodo di formazione di Visual Jigsaw aiuta i modelli di intelligenza artificiale a migliorare la comprensione delle informazioni visive facendoli riordinare queste immagini, clip video o dati 3D confusi.

Il processo si basa sulle parole e non sulle immagini, quindi non c’è bisogno che il modello generi immagini o utilizzi componenti visive aggiuntive. Questo metodo rientra in un sistema chiamato Reinforcement Learning from Verifiable Rewards (RLVR), dove il modello riceve una ricompensa per risposte corrette in base a regole chiare e automatiche; e dove, quindi, non è richiesta etichettatura umana.

Questo fatto cruciale è in realtà difficile da capire dal nuovo articolo: che il sistema sta assemblando il rompicapo semanticamente, attraverso descrizioni, e non nel modo rappresentativo della forma in cui gli esseri umani imparano a risolvere tali rompicapo:

Dall’articolo supplementare del nuovo articolo, un esempio di compito RL che illustra la natura testuale di questo processo di apprendimento aggiuntivo. Le immagini che sarebbero state mostrate al MLLM non sono rappresentate qui.

Sebbene i MLLM trattino estensivamente compiti visivi, sono architetture basate sul linguaggio, non progettate per generare immagini, video o rappresentazioni di forme come mesh 3D.

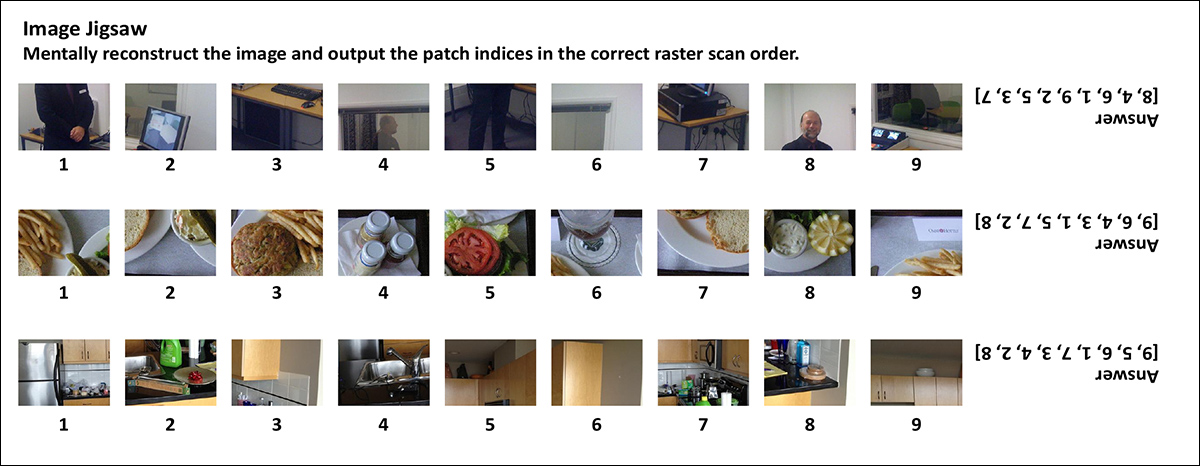

Esempi del compito jigsaw dell’immagine. Ogni riga mostra patch mescolate che il modello deve riordinare nel loro layout originale, con l’ordinamento corretto mostrato a destra.

In ogni caso, questo tipo di formazione viene eseguito dopo la fase di apprendimento principale, quando il modello ha già una certa capacità di comprendere le immagini.

Approcci precedenti come il documento svizzero del 2017 Apprendimento non supervisionato di rappresentazioni visive risolvendo rompicapo jigsaw hanno utilizzato questo tipo di approccio di rinforzo con un successo piuttosto scarso, su reti neurali convoluzionali (CNN), un tipo di architettura notevolmente diverso rispetto a un moderno MLLM.

Dal rilascio del 2017 ‘Apprendimento non supervisionato di rappresentazioni visive risolvendo rompicapo jigsaw’, un esempio precoce dell’uso della frammentazione come sfida basata su ricompense per un sistema neurale. Fonte: https://arxiv.org/pdf/1603.09246

Nei test, Visual Jigsaw ha portato a miglioramenti consistenti e misurabili in una vasta gamma di benchmark: il compito jigsaw dell’immagine ha migliorato la percezione fine, la comprensione della disposizione spaziale e la ragione compositiva; il compito jigsaw del video ha migliorato la capacità del modello di tracciare sequenze temporali e ragionare sull’ordine degli eventi; e il compito jigsaw 3D ha rafforzato la comprensione della profondità e la ragione spaziale utilizzando solo input RGB-D.

In tutti e tre i modi, l’articolo ribadisce, il nuovo metodo ha superato diverse linee di base competitive, nonostante non richieda modifiche architettoniche, moduli visivi aggiuntivi o dati supervisionati aggiuntivi:

‘Esperimenti estensivi dimostrano miglioramenti sostanziali nella percezione fine, nella ragione temporale e nella comprensione spaziale 3D. I nostri risultati evidenziano il potenziale di compiti visivi auto-supervisionati nella post-formazione dei MLLM e mirano a ispirare ulteriori ricerche su progetti di pre-testo visivo-centrici.’

Il nuovo articolo è intitolato Visual Jigsaw Post-Formazione Migliora i MLLM e proviene da sei ricercatori di Nanyang Technological University, Linköping University e SenseTime Research. L’articolo è accompagnato da un sito del progetto con demo live (e puoi anche caricare la tua immagine nel demo jigsaw basato su immagini). Il codice e i pesi per il progetto sono stati resi generalmente disponibili,

Metodo

Sebbene dovremmo dare un’occhiata a come le informazioni vengono suddivise per adattarsi ai tre modi testati, dovremmo prima considerare la progettazione della ricompensa per il nuovo sistema.

L’approccio Visual Jigsaw valuta le risposte del modello utilizzando una ricompensa graduale, non solo un semplice pass o fall. Se il modello predice l’esatto ordine corretto dei pezzi del rompicapo, riceve una ricompensa completa; se la risposta è per lo più corretta, ma non perfetta, il modello riceve un credito parziale, scalato da un fattore di sconto per evitare di sovrastimare gli errori parziali (ciò impedisce al modello di barare il sistema ripetendo ipotesi che sono solo parzialmente corrette).

Risposte non valide, come l’imbroglio di utilizzare lo stesso numero ripetutamente, ricevono un punteggio di zero. Per incoraggiare una formattazione coerente, il modello deve inserire la sua ragione all’interno di <think> e la sua risposta finale all’interno di <answer> . Riceve un piccolo bonus se questo formato viene utilizzato correttamente.

Immagini

Per creare un rompicapo per la modalità immagine, un’immagine viene prima divisa in una griglia di patch tagliandola in blocchi di dimensioni uguali:

Esempi di patch basate su immagini per il sistema da risolvere.

Le patch vengono disposte in un ordine fisso da sinistra a destra, come nell’ordine di lettura di una pagina, prima di essere confuse con una mescolanza casuale. Il modello viene quindi esposto a questo set di patch mescolate e deve capire l’ordine originale predendo la permutazione corretta che ripristina il layout originale.

Durante la formazione, sono stati utilizzati 118.000 immagini dal set di dati COCO, con ogni immagine che produceva nove patch (cioè “pezzi del rompicapo”). Il prompt presentato al sistema è mostrato all’inizio di questo articolo (l’immagine con la didascalia che inizia con ‘Dall’articolo supplementare del nuovo articolo’).

Video

Per il compito jigsaw del video, un video viene tagliato in una sequenza di clip tagliandolo uniformemente nel tempo, e poi mescolando i segmenti dei clip. Il modello viene quindi mostrato questa sequenza mescolata e deve capire il loro ordine cronologico originale.

Esempi troncati della sfida del rompicapo del video, dal materiale supplementare dell’articolo.

La formazione per questa modalità ha utilizzato 100.000 video dal set di dati LLaVA-Video, con ogni video diviso in sei clip. Per evitare che il modello sfrutti ovvi indizi di corrispondenza dei fotogrammi ai bordi dei clip, il 5% dei fotogrammi all’inizio e alla fine di ogni clip è stato tagliato.

I clip contenevano non più di 12 fotogrammi, ciascuno con una risoluzione massima di 128x28x28 pixel. I video più corti di 24 secondi sono stati esclusi.

Il prompt per questo compito è mostrato di seguito:

Il prompt di apprendimento per rinforzo presentato ai MLLM per il compito del video, senza i clip che sarebbero stati presentati al MLLM..

Dati 3D

Un compito jigsaw 3D completo richiederebbe normalmente la rottura di uno spazio 3D (come blocchi voxel o fragmenti di nuvola di punti) in blocchi più piccoli e la formazione di un modello per ricostruire la loro disposizione spaziale originale.

Tuttavia, il modello MLLM medio non è in grado di gestire dati 3D grezzi direttamente, ma si affida invece a input di immagini o video semanticamente interpretati. Pertanto, per creare un compito che colga ancora la ragione 3D pur restando compatibile con i MLLM attuali, gli autori hanno introdotto una variante più fattibile utilizzando le immagini RGB-D sopra menzionate (cioè immagini 2D che includono informazioni sulla profondità per ogni pixel).

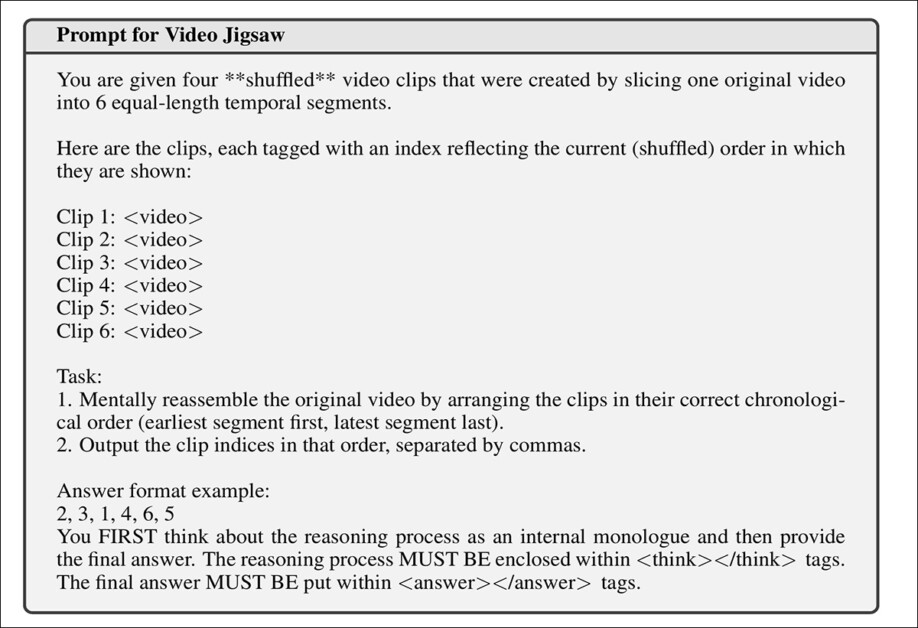

Esempi di domande dal 3D Spatial Understanding Benchmark utilizzato per valutare le prestazioni sulla ragione della vista relativa e del movimento della telecamera. Il modello 3D Jigsaw inferisce correttamente sia la relazione spaziale tra due viste di una scena che la direzione probabile della rotazione della telecamera, superando il baseline Qwen2.5-VL-7B.

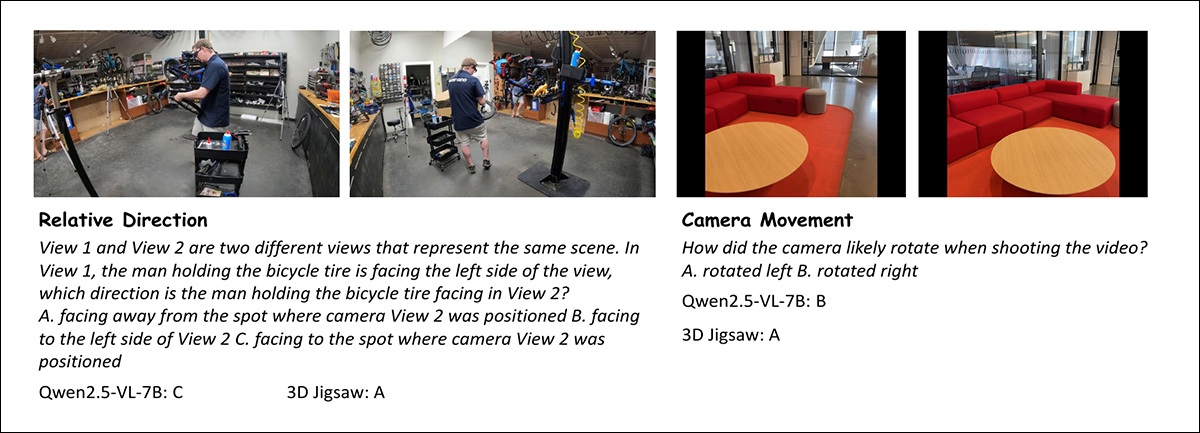

Da ogni immagine RGB-D, il modello riceve un elenco mescolato di punti che originariamente avevano profondità diverse, che vanno da vicino a lontano, con l’obiettivo di recuperare il loro ordine di profondità corretto utilizzando solo l’immagine 2D come riferimento:

Il prompt RL per il 3D jigsaw.

Ogni punto è contrassegnato sull’immagine (che viene mostrata al modello, ma non visualizzata nell’esempio di prompt nell’immagine direttamente sopra), e il modello deve prevedere quale era il più vicino, il secondo più vicino e così via, effettivamente ricostruendo la sequenza di profondità originale senza accesso ai valori di profondità grezzi.

Il compito jigsaw 3D è stato addestrato su immagini RGB-D dal set di dati ScanNet, utilizzando 300.000 campioni creati selezionando set casuali di sei punti di profondità per immagine.

Esempi di nuvole di punti dal set di dati ScanNet utilizzato nel 3D jigsaw. Fonte: https://arxiv.org/pdf/1702.04405

Ogni punto doveva trovarsi all’interno di un intervallo di profondità da 0,1 a 10 metri e, per promuovere la diversità, non due punti in un set potevano essere più vicini di 40 pixel nel piano dell’immagine o meno di 0,2 metri di distanza nella profondità.

Test

Per i test iniziali, il sistema ha utilizzato Qwen2.5-VL-7B-Instruct come modello multimodale di base. La formazione ha utilizzato l’algoritmo Group Relative Policy Optimization (GRPO), con entrambi KL regularization e perdita di entropia rimossi.

Per le previsioni parziali, è stato applicato un fattore di sconto del 20%. La formazione del jigsaw dell’immagine ha utilizzato una dimensione del batch globale di 256, mentre il jigsaw del video e il 3D hanno utilizzato 128. La velocità di apprendimento è stata impostata su 1×10⁻⁶.

Per ogni prompt, il modello ha generato 16 risposte a una temperatura di decodifica di 1,0. Sia il compito jigsaw dell’immagine che del video sono stati addestrati per 1.000 passi, mentre il compito jigsaw 3D è stato addestrato per 800 passi.

Rompicapo dell’immagine

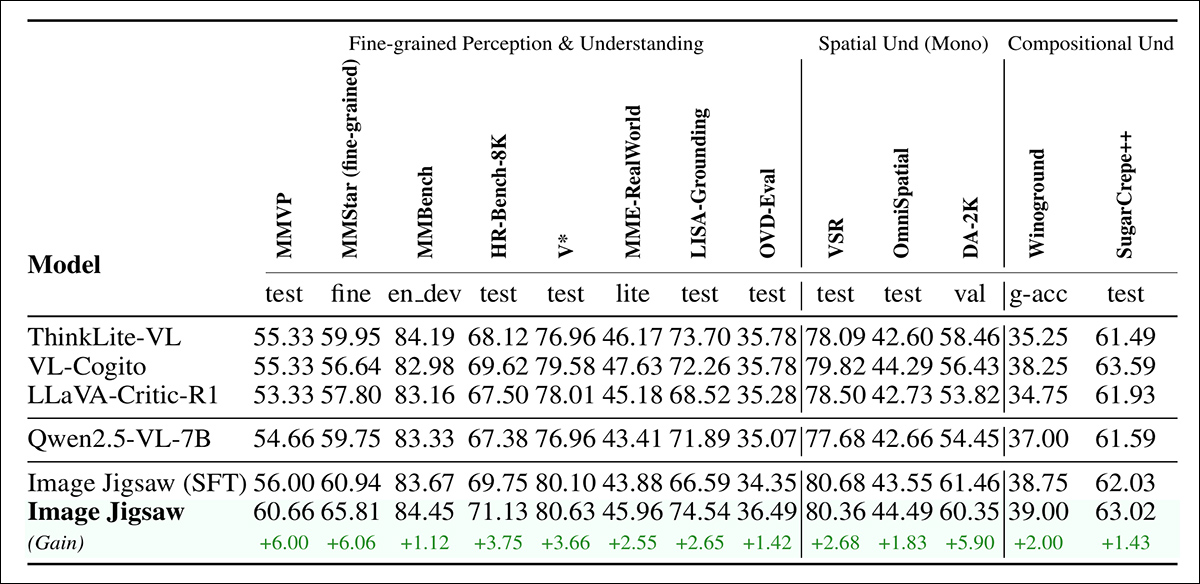

Il modello jigsaw dell’immagine è stato testato in tre categorie di benchmark visivi: per la percezione fine e la comprensione, MMVP, il subset di percezione fine di MMStar; MMBench; HR-Bench; V*; MME-RealWorld (lite); LISA-Grounding; e OVD-Eval.

Per la comprensione spaziale monocolare, i benchmark sono stati VSR; OmniSpatial; e Depth Anything V2 (DA-2K). Per la comprensione visiva compositiva, i test hanno impiegato Winoground e SugerCrepe++.

Tre baseline sono state testate, tutte derivate da Qwen2.5-VL-7B: ThinkLite-VL per il ragionamento multimodale; VL-Cogito per compiti visivi e scientifici generali; e LLaVA-Critic-R1 per la percezione delle immagini.

Tutti sono stati valutati utilizzando solo risposte brevi, poiché la ragione della catena di pensieri (CoT) a volte riduce le prestazioni.

Risultati di valutazione sui benchmark delle immagini. Il rompicapo dell’immagine ha migliorato il modello di base Qwen2.5-VL-7B in tutte le categorie di compiti (cioè percezione fine e comprensione; comprensione spaziale monocolare; e ragione visiva compositiva), superando le baseline post-formate precedenti.

Dei risultati per il rompicapo dell’immagine, mostrati sopra, gli autori affermano:

‘[L’immagine sopra] mostra che il nostro metodo migliora costantemente le capacità visive sui tre tipi di benchmark. Questi risultati confermano che l’inclusione della post-formazione del rompicapo dell’immagine migliora notevolmente le capacità visive dei MLLM e la comprensione visiva fine oltre le strategie di post-formazione centrate sul ragionamento. ‘

‘Attribuiamo questi miglioramenti al fatto che risolvere il rompicapo dell’immagine richiede al modello di prestare attenzione ai dettagli locali dei patch, inferire layout spaziali globali e ragionare sulle relazioni inter-patch, il che beneficia direttamente la comprensione fine, spaziale e compositiva.’

Rompicapo del video

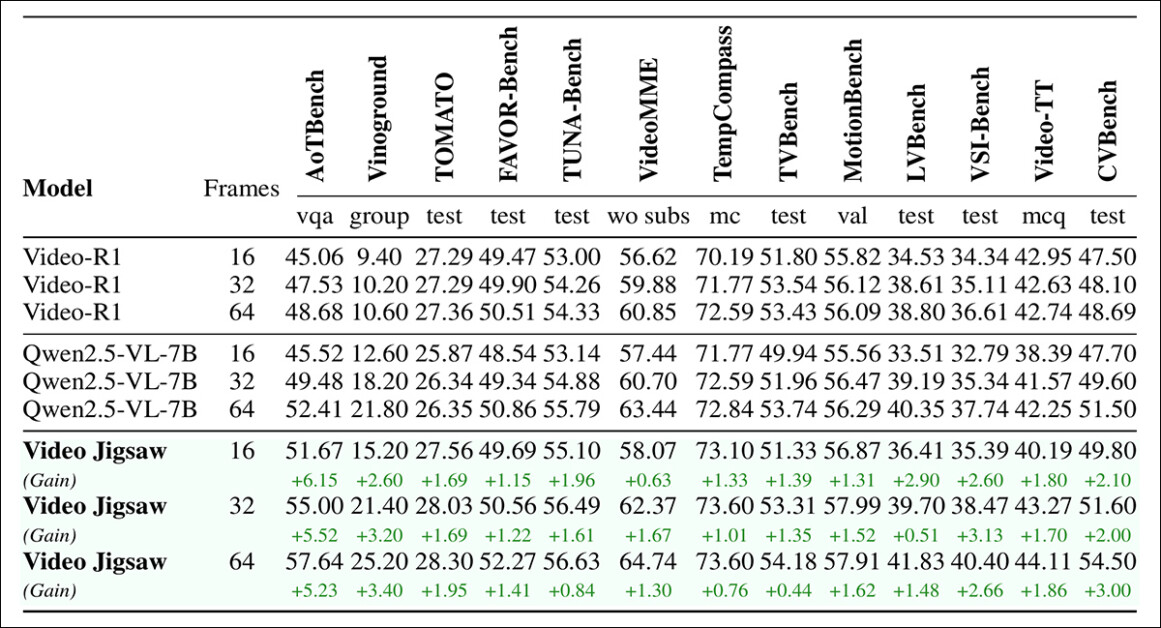

Per il rompicapo del video, la valutazione è stata condotta su AoTBench; Vinoground; TOMATO; FAVOR-Bench; TUNA-Bench; Video-MME; TempCompass; TVBench; MotionBench; LVBench; VSI-Bench; Video-TT; e CVBench.

Video-R1 è stato utilizzato come baseline, addestrato con un addestramento supervisionato a freddo seguito da apprendimento per rinforzo per la comprensione e il ragionamento del video. In questo caso, le valutazioni includevano l’intero processo di ragionamento, poiché questo ha prodotto costantemente risultati migliori rispetto alle risposte dirette.

Tutti i modelli sono stati limitati a 256x28x28 pixel e testati su tre impostazioni di fotogrammi – 16, 32 e 64:

Risultati di valutazione sui benchmark del video, con Video Jigsaw che supera costantemente la baseline in tutti i compiti e impostazioni dei fotogrammi.

Il rompicapo del video ha prodotto miglioramenti costanti in tutti i benchmark di comprensione del video e impostazioni dei fotogrammi, con guadagni particolarmente forti nei compiti che richiedono ragionamento temporale e direzionalità, come quelli in AoTBench, e anche nei benchmark di ragionamento tra video, come CVBench:

‘Questi risultati confermano che risolvere i compiti jigsaw del video incoraggia il modello a catturare meglio la continuità temporale, comprendere le relazioni tra i video, ragionare sulla coerenza direzionale e generalizzare a scenari di comprensione del video olistici e generalizzabili.’

Dati 3D

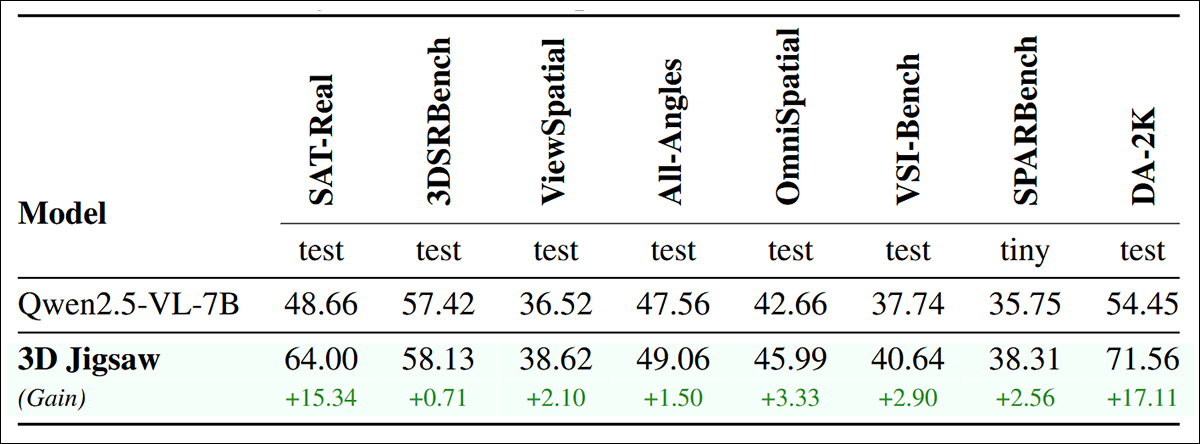

Per la modalità 3D, il modello è stato valutato su SAT-Real; 3DSRBench; ViewSpatial; All-Angles; il già menzionato OmniSpatial; VSI-Bench; SPARBench (tiny); e il già menzionato DA-2K.

Risultati di valutazione sui benchmark 3D: 3D Jigsaw ha migliorato le prestazioni in compiti di confronto di profondità come DA-2K, nonché benchmark di percezione 3D più ampi che coprono input di video singolo, multi-vista ed egocentrico.