Intelligenza artificiale

Migliore Prestazione di Machine Learning Attraverso il Ridimensionamento di Immagini Basato su CNN

Google Research ha proposto un nuovo metodo per migliorare l’efficienza e l’accuratezza dei flussi di lavoro di addestramento di computer vision basati su immagini, migliorando il modo in cui le immagini in un set di dati vengono ridotte nella fase di pre-elaborazione.

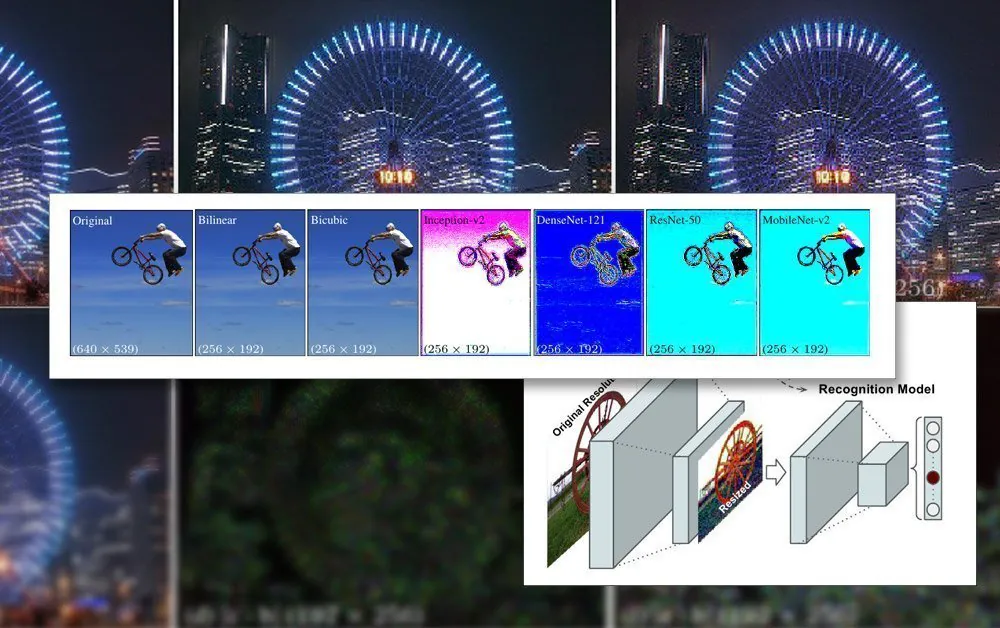

Nel paper Learning to Resize Images for Computer Vision Tasks, i ricercatori Hossein Talebi e Peyman Milanfar utilizzano una CNN per creare una nuova architettura di ridimensionamento di immagini ibrida che produce un notevole miglioramento dei risultati di riconoscimento ottenuti su quattro popolari set di dati di computer vision.

The proposed joint framework for recognition and resizing. Source: https://arxiv.org/pdf/2103.09950.pdf

Il paper osserva che i metodi di ridimensionamento attualmente utilizzati nelle pipeline di machine learning automatizzate sono datati di decenni e utilizzano spesso solo metodi di base di interpolazione bilineare, bicubica e del vicino più prossimo resizing – metodi che trattano tutti i pixel in modo indifferenziato.

Al contrario, il metodo proposto aumenta i dati di immagine attraverso una CNN e incorpora quell’input nelle immagini ridimensionate che passeranno attraverso l’architettura del modello.

Limiti delle Immagini nell’Addestramento AI

Per addestrare un modello che gestisce immagini, una struttura di machine learning includerà una fase di pre-elaborazione, in cui una varietà di immagini di diverse dimensioni, spazi di colore e risoluzioni (che contribuiranno al set di dati di addestramento) vengono sistematicamente ritagliate e ridimensionate in dimensioni coerenti e in un formato stabile e unico.

In generale, ciò comporterà un compromesso basato sul formato PNG, in cui si stabilirà un equilibrio tra tempo di elaborazione/risorse, dimensione del file e qualità dell’immagine.

Nella maggior parte dei casi, le dimensioni finali dell’immagine elaborata sono molto piccole. Di seguito si vede un esempio della risoluzione di 80×80 pixel a cui sono stati generati alcuni dei primi set di dati di deepfakes sono stati generati:

Poiché i volti (e altri soggetti possibili) raramente si adattano al rapporto di forma quadrata richiesto, potrebbero essere necessarie barre nere (o spazio sprecato) per omogeneizzare le immagini, riducendo ulteriormente i dati di immagine effettivamente utilizzabili:

Here the face has been extracted from a larger image area until it is cropped as economically as it can be in order to include the entire face area. However, as seen on the right, a great deal of the remaining area will not be used during training, adding greater weight to the importance of the image quality of the resized data.

Mentre le capacità delle GPU sono migliorate negli ultimi anni, con la nuova generazione di schede NVIDIA dotate di quantità crescenti di video-RAM (VRAM), le dimensioni medie delle immagini che contribuiscono stanno iniziando ad aumentare, sebbene 224×224 pixel sia ancora abbastanza standard (ad esempio, è la dimensione del set di dati ResNet-50).

An unresized 224×244 pixels image.

Adattare i Lotti nella VRAM

Il motivo per cui le immagini devono essere tutte della stessa dimensione è che la discesa del gradiente, il metodo con cui il modello migliora nel tempo, richiede dati di addestramento uniformi.

Il motivo per cui le immagini devono essere così piccole è che devono essere caricate (completamente decompressate) nella VRAM durante l’addestramento in lotti piccoli, di solito tra 6-24 immagini per lotto. Troppo poche immagini per lotto, e non c’è abbastanza materiale di gruppo per generalizzare bene, oltre a prolungare il tempo di addestramento; troppo grandi, e il modello potrebbe non riuscire a ottenere le caratteristiche e i dettagli necessari (vedi sotto).

Questa sezione di “caricamento live” dell’architettura di addestramento è chiamata spazio latente. Questo è dove le caratteristiche vengono estratte ripetutamente dagli stessi dati (cioè le stesse immagini) fino a quando il modello non ha converito verso uno stato in cui ha tutta la conoscenza generalizzata necessaria per eseguire trasformazioni su dati successivi, non visti, di tipo simile.

Questo processo in genere richiede giorni, sebbene possa richiedere anche un mese o più di costante e inarrestabile elaborazione ad alta intensità 24/7 per raggiungere una generalizzazione utile. Gli aumenti della dimensione della VRAM sono utili solo fino a un certo punto, poiché anche incrementi minori nella risoluzione dell’immagine possono avere un effetto dell’ordine di grandezza sulla capacità di elaborazione, e effetti sull’accuratezza che potrebbero non essere sempre favorevoli.

Utilizzare una maggiore capacità di VRAM per ospitare lotti di dimensioni maggiori è anche una benedizione mista, poiché le velocità di addestramento più elevate ottenute con questo metodo sono probabilmente compensate da risultati meno precisi.

Pertanto, poiché l’architettura di addestramento è così vincolata, qualsiasi cosa che possa effettuare un miglioramento all’interno dei limiti esistenti della pipeline è un risultato notevole.

Come il Ridimensionamento Migliore Aiuta

La qualità finale di un’immagine che sarà inclusa in un set di dati di addestramento si è rivelata avere un effetto migliorativo sull’esito dell’addestramento, in particolare nei compiti di riconoscimento di oggetti. Nel 2018, i ricercatori dell’Istituto Max Planck per i Sistemi Intelligenti hanno sostenuto che la scelta del metodo di campionamento ha un impatto notevole sulle prestazioni di addestramento e sui risultati.

Inoltre, lavori precedenti di Google (co-scritti dagli autori del nuovo paper) hanno trovato che l’accuratezza della classificazione può essere migliorata mantenendo il controllo sugli artefatti di compressione nelle immagini del set di dati.

Il modello CNN costruito nel nuovo campionatore combina il ridimensionamento bilineare con una funzione di “connessione di salto” che può incorporare l’output dalla rete addestrata nell’immagine ridimensionata.

A differenza di una tipica architettura encoder/decoder, la nuova proposta può agire non solo come un collo di bottiglia feed-forward, ma anche come un collo di bottiglia inverso per il ri-scaling a qualsiasi dimensione e/o rapporto di aspetto bersaglio. Inoltre, il metodo di campionamento “standard” può essere sostituito con qualsiasi altro metodo tradizionale adatto, come Lanczos.

Dettagli ad Alta Frequenza

Il nuovo metodo produce immagini che, in effetti, sembrano “cuocere” direttamente le caratteristiche chiave (che saranno ultimate riconosciute dal processo di addestramento) nell’immagine sorgente. In termini estetici, i risultati sono non convenzionali:

The new method applied across four networks – Inception V2; DenseNet-121; ResNet-50; and MobileNet-V2. The results of the Google Research image downsampling/resizing method produces images with obvious pixel aggregation, anticipating the key features that will be discerned during the training process.

I ricercatori notano che questi esperimenti iniziali sono esclusivamente ottimizzati per compiti di riconoscimento di immagini e che, nei test, il loro “campionatore appreso” CNN-powered è stato in grado di ottenere tassi di errore migliorati in tali compiti. I ricercatori intendono applicare il metodo in futuro ad altre tipologie di applicazioni di computer vision basate su immagini.