Intelligenza artificiale

Un Cartello di Dataset Influente Sta Dominando la Ricerca su Machine Learning, Suggerisce uno Studio Recente

Un nuovo articolo della University of California e di Google Research ha scoperto che un piccolo numero di dataset di “benchmark” di machine learning, in larga misura provenienti da istituzioni influenti occidentali e frequentemente da organizzazioni governative, sta sempre più dominando il settore della ricerca sull’intelligenza artificiale.

I ricercatori concludono che questa tendenza a “default” verso dataset open source molto popolari, come ImageNet, solleva una serie di motivi di preoccupazione pratici, etici e anche politici.

Tra i loro risultati – basati sui dati principali del progetto comunitario guidato da Facebook Papers With Code (PWC) – gli autori sostengono che ‘i dataset ampiamente utilizzati sono introdotti da solo un pugno di istituzioni d’élite’, e che questa ‘consolidazione’ è aumentata a circa l’80% negli ultimi anni.

‘[Noi] troviamo che c’è una crescente disuguaglianza nell’utilizzo dei dataset a livello globale, e che più del 50% di tutti gli utilizzi dei dataset nel nostro campione di 43.140 corrispondono a dataset introdotti da dodici istituzioni d’élite, principalmente occidentali.’

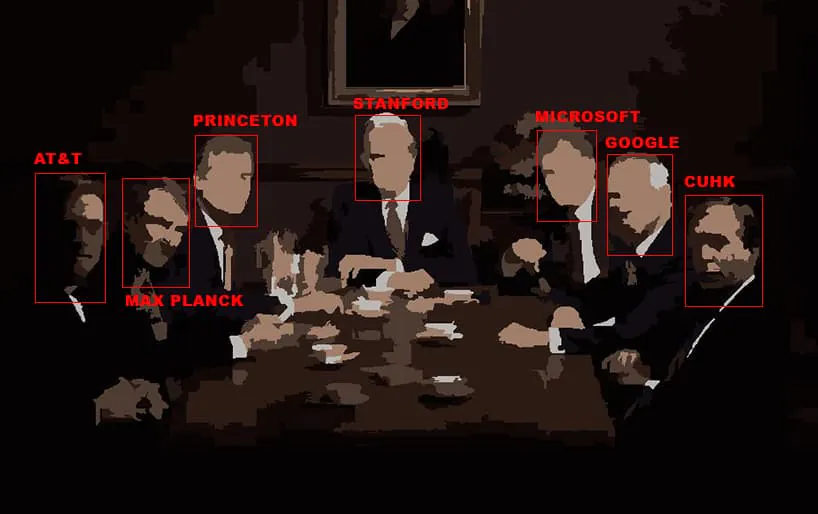

Una mappa degli utilizzi dei dataset non specifici per task negli ultimi dieci anni. I criteri per l’inclusione sono dove l’istituzione o l’azienda rappresenta più del 50% degli utilizzi noti. A destra è mostrato il coefficiente di Gini per la concentrazione dei dataset nel tempo per entrambe le istituzioni e i dataset. Source: https://arxiv.org/pdf/2112.01716.pdf

Le istituzioni dominanti includono Stanford University, Microsoft, Princeton, Facebook, Google, l’Istituto Max Planck e AT&T. Quattro delle prime dieci fonti di dataset sono istituzioni corporate.

L’articolo caratterizza anche l’aumento dell’utilizzo di questi dataset d’élite come ‘un veicolo per la disuguaglianza nella scienza’. Ciò avviene perché i team di ricerca che cercano l’approvazione della comunità sono più motivati a raggiungere risultati di stato dell’arte (SOTA) contro un dataset coerente piuttosto che generare dataset originali che non hanno tale standing, e che richiederebbero ai pari di adattarsi a metriche nuove invece di indici standard.

In ogni caso, come riconosce l’articolo, creare il proprio dataset è un’impresa proibitivamente costosa per istituzioni e team meno risorsosi.

‘Il prima facie valore scientifico concesso dal benchmarking SOTA è genericamente confuso con la credibilità sociale che i ricercatori ottengono mostrando di poter competere su un dataset ampiamente riconosciuto, anche se un benchmark più specifico per il contesto potrebbe essere più tecnicamente appropriato.

‘Sosteniamo che queste dinamiche creano un “Effetto Matthew” (cioè “i ricchi diventano più ricchi e i poveri diventano più poveri”) dove i benchmark di successo, e le istituzioni d’élite che li introducono, guadagnano uno stato sproporzionato all’interno del campo.

L’articolo si intitola Ridotti, Riutilizzati e Riciclati: La Vita di un Dataset nella Ricerca su Machine Learning, e proviene da Bernard Koch e Jacob G. Foster alla UCLA, e Emily Denton e Alex Hanna alla Google Research.

Il lavoro solleva una serie di problemi con la crescente tendenza alla consolidazione che documenta, e ha ricevuto un’approvazione generale su Open Review. Un revisore di NeurIPS 2021 ha commentato che il lavoro è ‘estremamente rilevante per chiunque sia coinvolto nella ricerca su machine learning.’ e ha previsto la sua inclusione come lettura assegnata in corsi universitari.

Da Necessità a Corruzione

Gli autori notano che l’attuale cultura del ‘superare il benchmark’ è emersa come rimedio alla mancanza di strumenti di valutazione oggettiva che ha causato il crollo dell’interesse e degli investimenti in AI per la seconda volta oltre trent’anni fa, dopo il declino dell’entusiasmo aziendale verso nuove ricerche in ‘Sistemi Esperti’:

‘I benchmark tipicamente formalizzano un particolare task attraverso un dataset e una metrica quantitativa di valutazione associata. La pratica è stata originariamente introdotta nella ricerca su machine learning dopo l'”inverno dell’AI” degli anni ’80 da finanziatori governativi, che cercavano di valutare più accuratamente il valore ricevuto dai finanziamenti.’

L’articolo sostiene che i vantaggi iniziali di questa cultura informale di standardizzazione (riducendo le barriere alla partecipazione, metriche coerenti e opportunità di sviluppo più agili) stanno iniziando a essere superati dagli svantaggi che naturalmente si verificano quando un corpo di dati diventa abbastanza potente da definire efficacemente i ‘termini di utilizzo’ e l’ambito di influenza.

Gli autori suggeriscono, in linea con molto pensiero recente dell’industria e dell’accademia su questo argomento, che la comunità di ricerca non pone più problemi nuovi se questi non possono essere affrontati attraverso i dataset di benchmark esistenti.

Inoltre, notano che l’adesione cieca a questo piccolo numero di ‘dataset d’oro’ incoraggia i ricercatori a ottenere risultati che sono sovrapposti (cioè che sono specifici del dataset e non sono probabilmente in grado di eseguire altrettanto bene sui dati del mondo reale, su nuovi dataset accademici o originali, o anche necessariamente su altri dataset nel ‘gold standard’).

‘Data la concentrazione osservata di ricerca su un piccolo numero di dataset di benchmark, crediamo che diversificare le forme di valutazione sia particolarmente importante per evitare di sovrapporsi ai dataset esistenti e di rappresentare in modo errato i progressi nel campo.’

Influenza del Governo nella Ricerca su Computer Vision

Secondo l’articolo, la ricerca su Computer Vision è notevolmente più influenzata dalla sindrome che descrive rispetto ad altri settori, con gli autori che notano che la ricerca su Natural Language Processing (NLP) è molto meno influenzata. Gli autori suggeriscono che ciò potrebbe essere dovuto al fatto che le comunità NLP sono ‘più coerenti’ e più grandi in termini di dimensioni, e perché i dataset NLP sono più accessibili e più facili da curare, oltre a essere più piccoli e meno intensivi in termini di raccolta dei dati.

Nella Computer Vision, e in particolare per quanto riguarda i dataset di Riconoscimento Faciale (FR), gli autori sostengono che gli interessi aziendali, statali e privati spesso collidono:

‘Le istituzioni aziendali e governative hanno obiettivi che possono entrare in conflitto con la privacy (ad esempio, la sorveglianza), e il loro peso di queste priorità è probabilmente diverso da quello degli accademici o degli stakeholder più ampi dell’AI.’

Per i compiti di riconoscimento facciale, i ricercatori hanno trovato che l’incidenza di dataset puramente accademici diminuisce drasticamente rispetto alla media:

‘[Quattro] dei otto dataset (33,69% degli utilizzi totali) sono stati finanziati esclusivamente da aziende, dall’esercito degli Stati Uniti o dal governo cinese (MS-Celeb-1M, CASIA-Webface, IJB-A, VggFace2). MS-Celeb-1M è stato ritirato a causa della controversia sul valore della privacy per diversi stakeholder.’

I principali dataset utilizzati nelle comunità di ricerca su Generazione di Immagini e Riconoscimento Faciale.

Nel grafico sopra, come notano gli autori, vediamo anche che il campo relativamente recente della Generazione di Immagini (o Sintesi di Immagini) si basa fortemente su dataset esistenti e più vecchi che non erano destinati a questo uso.

In realtà, l’articolo osserva una tendenza crescente alla ‘migrazione’ dei dataset lontano dal loro scopo originale, mettendo in discussione la loro idoneità per le esigenze di nuovi o marginali settori di ricerca, e l’estensione in cui le limitazioni di budget potrebbero ‘genericizzare’ l’ambito delle ambizioni dei ricercatori all’interno del quadro più stretto fornito sia dai materiali disponibili che da una cultura così ossessionata dalle valutazioni dei benchmark anno per anno che i nuovi dataset hanno difficoltà a guadagnare trazione.

‘I nostri risultati indicano anche che i dataset si trasferiscono regolarmente tra diverse comunità di task. All’estremo più estremo, la maggior parte dei dataset di benchmark in circolazione per alcune comunità di task sono stati creati per altri task.’

Riguardo ai luminari del machine learning (incluso Andrew Ng) che hanno sempre più chiesto una maggiore diversità e cura dei dataset negli ultimi anni, gli autori sostengono il sentimento, ma credono che questo tipo di sforzo, anche se riuscito, potrebbe potenzialmente essere compromesso dalla dipendenza attuale della cultura dai risultati SOTA e dai dataset stabiliti:

‘La nostra ricerca suggerisce che semplicemente chiedere ai ricercatori di machine learning di sviluppare più dataset, e spostare le strutture di incentivi in modo che lo sviluppo del dataset sia valorizzato e premiato, potrebbe non essere sufficiente per diversificare l’utilizzo dei dataset e le prospettive che sono alla fine plasmate e che definiscono gli obiettivi di ricerca sulla machine learning.’

‘In aggiunta all’incentivazione dello sviluppo del dataset, noi sosteniamo interventi di politica orientati all’equità che diano priorità a finanziamenti significativi per le persone in istituzioni meno risorse per creare dataset di alta qualità. Ciò diversificherebbe – da una prospettiva sociale e culturale – i dataset di benchmark utilizzati per valutare i metodi di machine learning moderni.’

6 dicembre 2021, 16:49 GMT+2 – Corretto possessivo nel titolo. – MA