Sudut Anderson

Out of Sight, Out of Mind: Menangani Masalah Terbesar dalam Video AI

Masalah terbesar bahkan dengan generator video AI terbaik adalah mereka memiliki amnesia kronis – sebuah tantangan yang kini ditangani oleh penelitian baru dari China.

Masalah terbesar bahkan dengan sistem pembuatan video AI terbaik dan paling mutakhir adalah mereka semua memiliki amnesia kronis: jika kamera bergeser menjauh dari fokusnya lalu kembali, ia tidak akan pernah menemukan apa yang ada di awal – karakter akan menghilang, berubah penampilan dan/atau jenis gerakan, dan latar belakang kemungkinan besar juga akan berubah.

Ini karena sistem generasi berbasis difusi memiliki jendela perhatian bergulir yang terbatas, dan karena ia selalu berurusan dengan apa yang dapat dilihatnya pada saat itu; dalam sebuah perwujudan nyata dari solipsisme, apa yang ada di luar bingkai adalah tidak ada bagi AI generatif – ia secara harfiah dibuang dari memori.

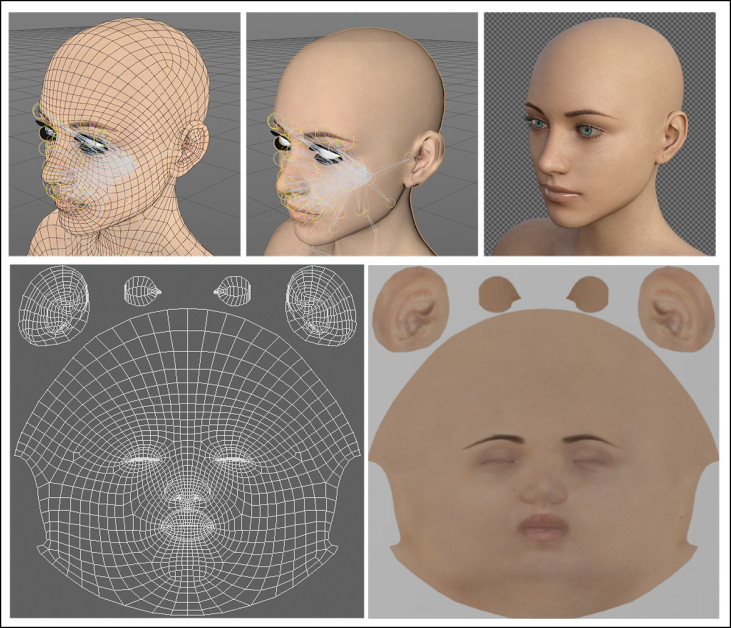

Ini tidak pernah menjadi masalah dalam CGI tradisional, yang selalu dapat merujuk dan menciptakan ulang subjek secara akurat, termasuk penampilan dan gerakan, di titik mana pun dalam video yang dirender di mana mereka mungkin diperlukan lagi:

Mesh CGI tradisional dan tekstur bitmap selalu dapat dimasukkan kembali ke dalam render, memberikan penampilan yang konsisten – sebuah trik yang jauh lebih sulit dicapai dalam pendekatan AI, karena tidak ada file ‘referensi datar’ yang setara, atau kumpulan file terkait.

Ini karena elemen komponen CGI, seperti mesh dan tekstur (lihat gambar di atas), serta file gerakan dan perilaku dinamis lainnya, dapat hidup secara terpisah di disk, dan dimasukkan ke dalam komposisi kapan saja.

Tidak ada ‘repositori datar’ seperti itu dalam video AI generatif; yang paling mendekati fungsionalitas ini adalah LoRA – file tambahan yang dilatih khusus yang dapat dilatih pada perangkat konsumen, memungkinkan karakter baru dan pakaian tertentu ‘dipaksakan’ masuk ke dalam video:

Klik untuk memutar. Masalah solipsisme video AI dapat dikurangi sampai batas tertentu dengan menggunakan LoRA – tetapi hasilnya bisa berlebihan.

Namun, ini bukan solusi yang ideal. Pertama, LoRA terikat pada versi spesifik yang tepat dari model dasar (seperti Wan2+, atau Hunyuan Video), dan perlu dibuat ulang setiap kali model dasar berubah. Kedua, LoRA cenderung mendistorsi bobot model dasar, sehingga identitas terlatih LoRA dipaksakan pada semua karakter dalam sebuah adegan. Selain itu, metode fine-tuning semacam ini sangat sensitif terhadap kumpulan data yang dikurasi dengan buruk.

Encore yang Akurat

Sekarang, sebuah kolaborasi akademik/industri baru dari China menawarkan obat pertama yang signifikan yang menarik perhatian saya dalam lebih dari tiga tahun melaporkan masalah ini. Metode ini menggunakan apa yang disebut peneliti sebagai memori hibrida untuk menjaga karakter di luar layar dan lingkungan langsung mereka tetap aktif dan akurat di ruang laten model, sehingga ketika sudut pandang kita kembali kepada mereka, efeknya konsisten:

Klik untuk memutar. Dari situs proyek untuk makalah baru, dua contoh karakter hasil AI (WAN) keluar dari bingkai dan masuk kembali secara akurat. Sumber

Perlu ditekankan bahwa ini bukan hal yang sama dengan mencapai konsistensi karakter di berbagai bidikan – sesuatu yang diklaim telah dicapai setahun yang lalu dalam rilis Gen 4 Runway, dan yang tetap menjadi pencarian yang berlangsung dalam literatur penelitian.

Sebaliknya, yang diselesaikan di sini adalah sesuatu yang tidak dapat dicapai oleh kerangka kerja komersial atau eksperimental yang pernah saya lihat – kemunculan kembali yang konsisten secara visual dari penampilan, gerakan, dan lingkungan sebelumnya seorang karakter di luar layar:

Klik untuk memutar. Dua contoh utama lainnya yang diberikan di situs proyek inisiatif baru.

Jelas prinsip-prinsip yang bekerja di sini dapat diterapkan secara setara pada domain lain, seperti eksplorasi perkotaan, mengemudi POV, atau jenis rendering non-karakter lainnya.

Perlu ditekankan juga bahwa pendekatan baru ini tidak menyelesaikan atau menangani masalah yang diklaim telah ditangani oleh Runway Gen4 dan platform sumber tertutup lainnya, dengan menciptakan ulang karakter di berbagai bidikan; alih-alih ia melakukan apa yang belum berhasil dilakukan oleh mereka – mempertahankan karakter dan lingkungan dalam memori, tanpa perlu mereka tetap terlihat oleh pemirsa sepanjang waktu.

Karya baru ini terdiri dari kumpulan data khusus yang dihasilkan melalui Unreal Engine, serta metrik khusus untuk masalah solipsisme*, dan kerangka kerja generatif khusus yang dibangun di atas WAN. Dalam pengujian terhadap beberapa sistem analog yang tersedia, penulis mengklaim hasil yang mutakhir, dan mereka berkomentar:

‘[Memori] mekanisme telah muncul sebagai batas penting dalam memajukan model dunia, karena kapasitas memori menentukan konsistensi spasial dan temporal dari konten yang dihasilkan.

‘Secara khusus, itu adalah jangkar kognitif yang memungkinkan model untuk mempertahankan konteks historis selama pergeseran sudut pandang atau ekstrapolasi jangka panjang.

‘Tanpa memori yang kuat, dunia simulasi dengan cepat terurai menjadi bingkai-bingkai yang terputus dan kacau.’

Makalah baru ini berjudul Out of Sight but Not Out of Mind: Hybrid Memory for Dynamic Video World Models, dan berasal dari tujuh peneliti di Huazhong University of Science and Technology, dan Tim Kling di Kuaishou Technology.

Metode

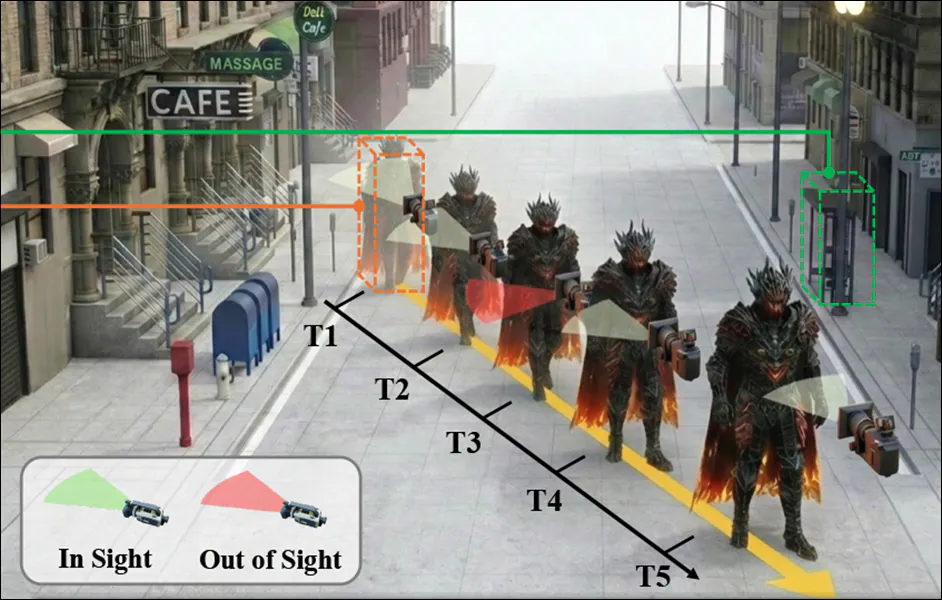

Pilar utama dari karya baru ini adalah memori hibrida, yang memfasilitasi ‘ekstrapolasi di luar pandangan’ – retensi karakter dan konteks mereka sementara pemirsa ‘memalingkan muka’ (atau sementara karakter itu sendiri keluar dari pandangan). Dalam skenario ini, kerangka kerja diharuskan untuk melakukan pemisahan ruang-waktu, di mana ia secara bersamaan fokus pada generasi yang terlihat oleh pemirsa, dan keberadaan di luar layar dari karakter yang kini berada di luar pandangan.

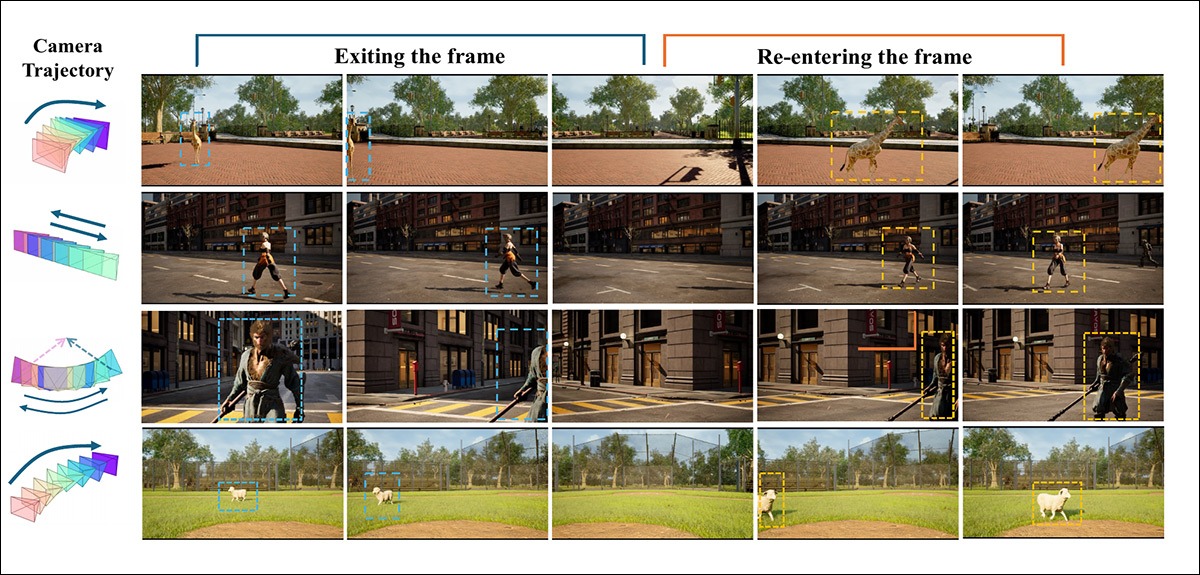

Contoh gerakan kamera masuk/keluar. Dalam contoh-contoh ini, gerakan kameralah yang menyebabkan karakter keluar dari bingkai, tetapi dalam sampel yang beragam kita juga dapat mengamati karakter itu sendiri sementara mendorong diri mereka keluar layar. Sumber

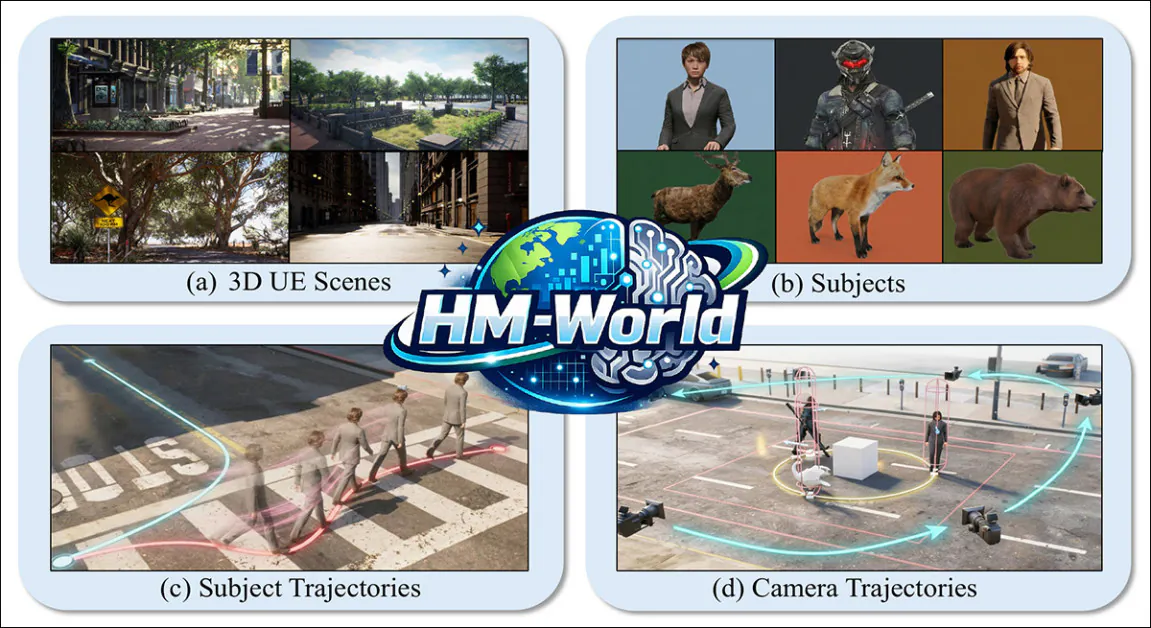

Para penulis mencatat bahwa dalam embedding laten difusi, fitur-fitur yang perlu diekstraksi dan digunakan sangat terjalin dengan fitur dan properti lainnya; dan bahwa upaya mengekstraksinya sering menyebabkan subjek ‘membeku’ ke latar belakang. Oleh karena itu mereka merancang dan mengkurasi kumpulan data HM-World**, yang secara khusus ditujukan untuk melatih memori hibrida:

Dari makalah, sampel dari empat kategori yang terkandung dalam kumpulan data HM-World.