Kecerdasan buatan

Mobile-Agents: Autonomous Multi-modal Mobile Device Agent With Visual Perception

Kemunculan Multimodal Large Language Models (MLLM) telah membuka era baru agen perangkat seluler, yang mampu memahami dan berinteraksi dengan dunia melalui teks, gambar, dan suara. Agen-agen ini menandai kemajuan signifikan dibandingkan AI tradisional, menyediakan cara yang lebih kaya dan intuitif bagi pengguna untuk berinteraksi dengan perangkat mereka. Dengan memanfaatkan MLLM, agen-agen ini dapat memproses dan mensintesis sejumlah besar informasi dari berbagai modalitas, memungkinkan mereka menawarkan bantuan yang dipersonalisasi dan meningkatkan pengalaman pengguna dengan cara yang sebelumnya tak terbayangkan. Agen-agen ini didukung oleh teknik machine learning mutakhir dan kemampuan pemrosesan bahasa alami yang canggih, memungkinkan mereka memahami dan menghasilkan teks seperti manusia, serta menafsirkan data visual dan auditori dengan akurasi yang luar biasa. Mulai dari mengenali objek dan adegan dalam gambar hingga memahami perintah lisan dan menganalisis sentimen teks, agen multimodal ini dilengkapi untuk menangani berbagai macam input dengan mulus. Potensi teknologi ini sangat luas, menawarkan layanan yang lebih canggih dan sadar konteks, seperti asisten virtual yang peka terhadap emosi manusia dan alat pendidikan yang beradaptasi dengan gaya belajar individu. Mereka juga berpotensi merevolusi aksesibilitas, membuat teknologi lebih mudah didekati melintasi hambatan bahasa dan sensorik. Dalam artikel ini, kita akan membahas tentang Mobile-Agents, sebuah agen perangkat multimodal otonom yang pertama-tama memanfaatkan kemampuan alat persepsi visual untuk mengidentifikasi dan melokalisasi elemen visual dan tekstual pada antarmuka depan aplikasi seluler secara akurat. Dengan menggunakan konteks visual yang dipersepsikan ini, kerangka kerja Mobile-Agent merencanakan dan menguraikan tugas operasi yang kompleks secara otonom, dan menavigasi melalui aplikasi seluler langkah demi langkah. Kerangka kerja Mobile-Agent berbeda dari solusi yang ada karena tidak bergantung pada metadata sistem seluler atau file XML dari aplikasi seluler, memberikan ruang untuk peningkatan adaptabilitas di berbagai lingkungan operasi seluler dengan cara yang berpusat pada penglihatan. Pendekatan yang diikuti oleh kerangka kerja Mobile-Agent menghilangkan kebutuhan kustomisasi khusus sistem yang menghasilkan peningkatan kinerja, dan kebutuhan komputasi yang lebih rendah.

Mobile-Agents: Autonomous Multi-modal Mobile Device Agent

Dalam dunia teknologi seluler yang bergerak cepat, sebuah konsep perintis muncul sebagai yang menonjol: Large Language Models, khususnya Multimodal Large Language Models atau MLLM yang mampu menghasilkan beragam teks, gambar, video, dan ucapan dalam berbagai bahasa. Perkembangan pesat kerangka kerja MLLM dalam beberapa tahun terakhir telah melahirkan aplikasi baru dan kuat dari MLLM: agen seluler otonom. Agen seluler otonom adalah entitas perangkat lunak yang bertindak, bergerak, dan berfungsi secara independen, tanpa memerlukan perintah manusia langsung, dirancang untuk melintasi jaringan atau perangkat untuk menyelesaikan tugas, mengumpulkan informasi, atau memecahkan masalah. Mobile Agents dirancang untuk mengoperasikan perangkat seluler pengguna berdasarkan instruksi pengguna dan visual layar, sebuah tugas yang mengharuskan agen memiliki kemampuan pemahaman semantik dan persepsi visual. Namun, agen seluler yang ada jauh dari sempurna karena mereka didasarkan pada model bahasa besar multimodal, dan bahkan kerangka kerja MLLM state-of-the-art saat ini termasuk GPT-4V kekurangan kemampuan persepsi visual yang diperlukan untuk berfungsi sebagai agen seluler yang efisien. Lebih lanjut, meskipun kerangka kerja yang ada dapat menghasilkan operasi yang efektif, mereka kesulitan untuk melokalisasi posisi operasi ini secara akurat di layar, membatasi aplikasi dan kemampuan agen seluler untuk beroperasi pada perangkat seluler. Untuk mengatasi masalah ini, beberapa kerangka kerja memilih untuk memanfaatkan file tata letak antarmuka pengguna untuk membantu GPT-4V atau MLLM lainnya dengan kemampuan pelokalan, dengan beberapa kerangka kerja berhasil mengekstrak posisi yang dapat ditindaklanjuti di layar dengan mengakses file XML aplikasi sementara kerangka kerja lain memilih untuk menggunakan kode HTML dari aplikasi web. Seperti yang dapat dilihat, mayoritas kerangka kerja ini bergantung pada akses ke file aplikasi lokal dan mendasar, membuat metode ini hampir tidak efektif jika kerangka kerja tidak dapat mengakses file-file ini. Untuk mengatasi masalah ini dan menghilangkan ketergantungan agen lokal pada file mendasar dalam metode pelokalan, pengembang telah mengerjakan Mobile-Agent, sebuah agen seluler otonom dengan kemampuan persepsi visual yang mengesankan. Menggunakan modul persepsi visualnya, kerangka kerja Mobile-Agent menggunakan tangkapan layar dari perangkat seluler untuk melokalisasi operasi secara akurat. Modul persepsi visual menampung model OCR dan deteksi yang bertanggung jawab untuk mengidentifikasi teks dalam layar dan mendeskripsikan konten dalam wilayah spesifik layar seluler. Kerangka kerja Mobile-Agent menggunakan prompt yang dirancang dengan cermat dan memfasilitasi interaksi yang efisien antara alat dan agen, sehingga mengotomatiskan operasi perangkat seluler. Selanjutnya, kerangka kerja Mobile-Agents bertujuan untuk memanfaatkan kemampuan kontekstual dari kerangka kerja MLLM state-of-the-art seperti GPT-4V untuk mencapai kemampuan perencanaan mandiri yang memungkinkan model merencanakan tugas berdasarkan riwayat operasi, instruksi pengguna, dan tangkapan layar secara holistik. Untuk lebih meningkatkan kemampuan agen dalam mengidentifikasi instruksi yang tidak lengkap dan operasi yang salah, kerangka kerja Mobile-Agent memperkenalkan metode refleksi mandiri. Di bawah bimbingan prompt yang dirancang dengan cermat, agen secara konsisten merefleksikan operasi yang salah dan tidak valid, dan menghentikan operasi begitu tugas atau instruksi telah selesai. Secara keseluruhan, kontribusi dari kerangka kerja Mobile-Agent dapat diringkas sebagai berikut:

- Mobile-Agent bertindak sebagai agen perangkat seluler otonom, memanfaatkan alat persepsi visual untuk melakukan pelokalan operasi. Ia merencanakan setiap langkah secara metodis dan terlibat dalam introspeksi. Patut dicatat, Mobile-Agent hanya bergantung pada tangkapan layar perangkat, tanpa menggunakan kode sistem apa pun, menunjukkan solusi yang murni berbasis teknik penglihatan.

- Mobile-Agent memperkenalkan Mobile-Eval, sebuah tolok ukur yang dirancang untuk mengevaluasi agen perangkat seluler. Tolok ukur ini mencakup berbagai dari sepuluh aplikasi seluler yang paling umum digunakan, bersama dengan instruksi cerdas untuk aplikasi-aplikasi ini, dikategorikan ke dalam tiga tingkat kesulitan.

Mobile-Agent : Arsitektur dan Metodologi

Pada intinya, kerangka kerja Mobile-Agent terdiri dari Multimodal Large Language Model state-of-the-art, GPT-4V, sebuah modul deteksi teks yang digunakan untuk tugas pelokalan teks. Bersama dengan GPT-4V, Mobile-Agent juga menggunakan modul deteksi ikon untuk pelokalan ikon.

Persepsi Visual

Seperti disebutkan sebelumnya, MLLM GPT-4V memberikan hasil yang memuaskan untuk instruksi dan tangkapan layar, tetapi gagal mengeluarkan lokasi secara efektif di mana operasi berlangsung. Karena keterbatasan ini, kerangka kerja Mobile-Agent yang mengimplementasikan model GPT-4V perlu mengandalkan alat eksternal untuk membantu pelokalan operasi, sehingga memfasilitasi keluaran operasi di layar seluler.

Pelokalan Teks

Kerangka kerja Mobile-Agent mengimplementasikan alat OCR untuk mendeteksi posisi teks yang sesuai di layar setiap kali agen perlu mengetuk teks spesifik yang ditampilkan di layar seluler. Ada tiga skenario pelokalan teks yang unik.

Skenario 1: Tidak Ada Teks yang Ditentukan Terdeteksi

Masalah: OCR gagal mendeteksi teks yang ditentukan, yang mungkin terjadi pada gambar kompleks atau karena keterbatasan OCR. Respons: Instruksikan agen untuk:

- Memilih ulang teks untuk diketuk, memungkinkan koreksi manual atas kelalaian OCR, atau

- Memilih operasi alternatif, seperti menggunakan metode input yang berbeda atau melakukan tindakan lain yang relevan dengan tugas yang ada.

Alasan: Fleksibilitas ini diperlukan untuk mengelola ketidakakuratan atau halusinasi GPT-4V yang sesekali terjadi, memastikan agen masih dapat melanjutkan secara efektif.

Skenario 2: Satu Instansi Teks yang Ditentukan Terdeteksi

Operasi: Secara otomatis menghasilkan tindakan untuk mengklik pada koordinat tengah kotak teks yang terdeteksi. Pembenaran: Dengan hanya satu instansi yang terdeteksi, kemungkinan identifikasi yang benar tinggi, sehingga efisien untuk melanjutkan dengan tindakan langsung.

Skenario 3: Banyak Instansi Teks yang Ditentukan Terdeteksi

Penilaian: Pertama, evaluasi jumlah instansi yang terdeteksi: Banyak Instansi: Menunjukkan layar yang penuh dengan konten serupa, memperumit proses pemilihan. Tindakan: Minta agen untuk memilih ulang teks, bertujuan untuk menyempurnakan pilihan atau menyesuaikan parameter pencarian. Sedikit Instansi: Jumlah deteksi yang dapat dikelola memungkinkan pendekatan yang lebih bernuansa. Tindakan: Potong wilayah di sekitar instansi-instansi ini, memperluas kotak deteksi teks ke luar untuk menangkap konteks tambahan. Ekspansi ini memastikan lebih banyak informasi dipertahankan, membantu dalam pengambilan keputusan. Langkah Selanjutnya: Gambar kotak deteksi pada gambar yang dipotong dan sajikan kepada agen. Bantuan visual ini membantu agen dalam memutuskan instansi mana yang akan diinteraksi, berdasarkan petunjuk kontekstual atau persyaratan tugas. Pendekatan terstruktur ini mengoptimalkan interaksi antara hasil OCR dan operasi agen, meningkatkan keandalan dan adaptabilitas sistem dalam menangani tugas berbasis teks di berbagai skenario. Seluruh proses ditunjukkan dalam gambar berikut.

Pelokalan Ikon

Kerangka kerja Mobile-Agent mengimplementasikan alat deteksi ikon untuk melokalisasi posisi ikon ketika agen perlu mengkliknya di layar seluler. Lebih spesifik, kerangka kerja pertama-tama meminta agen untuk memberikan atribut spesifik gambar termasuk bentuk dan warna, kemudian kerangka kerja mengimplementasikan metode Grounding DINO dengan prompt ikon untuk mengidentifikasi semua ikon yang terkandung dalam tangkapan layar. Akhirnya, Mobile-Agent menggunakan kerangka kerja CLIP untuk menghitung kesamaan antara deskripsi wilayah klik, dan menghitung kesamaan antara ikon yang dihapus, dan memilih wilayah dengan kesamaan tertinggi untuk diklik.

Eksekusi Instruksi

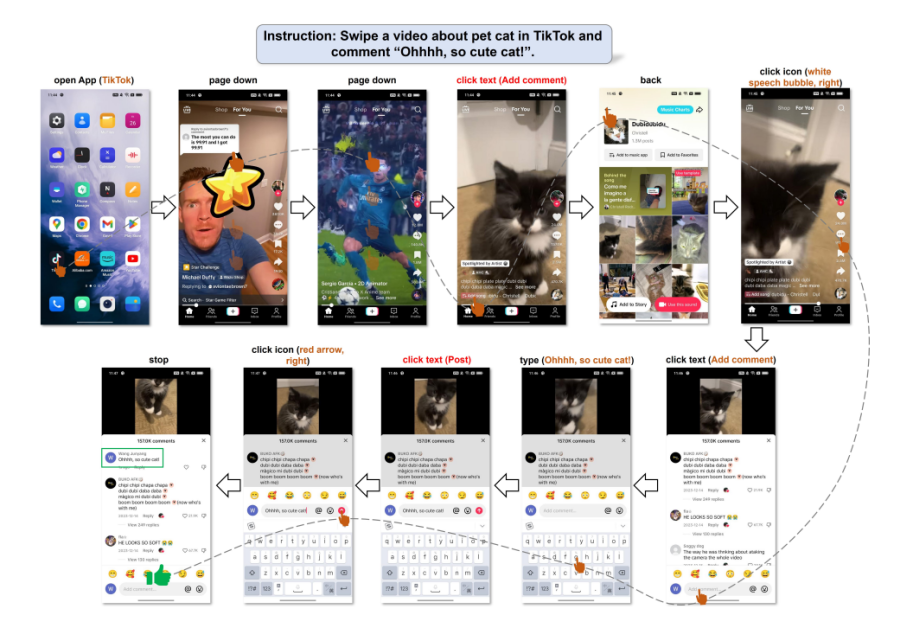

Untuk menerjemahkan tindakan menjadi operasi di layar oleh agen, kerangka kerja Mobile-Agent mendefinisikan 8 operasi berbeda.

- Luncurkan Aplikasi (Nama Aplikasi): Mulai aplikasi yang ditentukan dari antarmuka desktop.

- Ketuk pada Teks (Label Teks): Berinteraksi dengan bagian layar yang menampilkan label “Label Teks”.

- Berinteraksi dengan Ikon (Deskripsi Ikon, Lokasi): Targetkan dan ketuk area ikon yang ditentukan, di mana “Deskripsi Ikon” merinci atribut seperti warna dan bentuk ikon. Pilih “Lokasi” dari opsi seperti atas, bawah, kiri, kanan, atau tengah, mungkin menggabungkan dua untuk navigasi yang tepat dan mengurangi kesalahan.

- Masukkan Teks (Teks Input): Masukkan “Teks Input” yang diberikan ke dalam bidang teks aktif.

- Gulir Ke Atas & Ke Bawah: Navigasi ke atas atau ke bawah melalui konten halaman saat ini.

- Kembali: Kembali ke halaman yang dilihat sebelumnya.

- Tutup: Navigasi kembali ke desktop langsung dari layar saat ini.

- Hentikan: Akhiri operasi begitu tugas selesai.

Perencanaan Mandiri

Setiap langkah operasi dieksekusi secara iteratif oleh kerangka kerja, dan sebelum dimulainya setiap iterasi, pengguna diminta untuk memberikan instruksi input, dan model Mobile-Agent menggunakan instruksi tersebut untuk menghasilkan prompt sistem untuk seluruh proses. Selanjutnya, sebelum awal setiap iterasi, kerangka kerja mengambil tangkapan layar dan memberikannya ke agen. Agen kemudian mengamati tangkapan layar, riwayat operasi, dan prompt sistem untuk mengeluarkan langkah operasi berikutnya.

Refleksi Mandiri

Selama operasinya, agen mungkin menghadapi kesalahan yang mencegahnya berhasil mengeksekusi perintah. Untuk meningkatkan tingkat pemenuhan instruksi, pendekatan evaluasi mandiri telah diimplementasikan, diaktifkan dalam dua keadaan spesifik. Awalnya, jika agen mengeksekusi tindakan yang cacat atau tidak valid yang menghentikan kemajuan, seperti ketika ia mengenali tangkapan layar tetap tidak berubah pasca-operasi atau menampilkan halaman yang salah, ia akan diarah