Sudut Anderson

Bagaimana Menyelundupkan Makalah Ilmiah yang Absurd dan Dibuat oleh AI ke Peninjau AI

Penelitian baru menunjukkan bagaimana sistem AI dapat menulis makalah ilmiah palsu yang diterima oleh AI lain sebagai asli, menghindari rutinitas deteksi yang dulunya efektif, dan mengungkap seberapa mudah dunia penelitian dapat runtuh menjadi bot yang menipu bot.

Sektor penelitian akademis, ironisnya garis depan inovasi AI, sedang mengalami krisis kredibilitas yang dipicu oleh AI. Dampak pembelajaran mesin pada penelitian, pengajuan, dan proses tinjauan telah cukup besar sejak prospek dampak AI pertama kali menjadi jelas sekitar empat tahun yang lalu, dengan kontroversi terbaru adalah pembangkitan massal makalah survei dengan nilai rendah.

Bersama dengan sebagian besar sektor akademis yang lebih luas, sektor penelitian terlibat dalam semacam perang dingin antara AI yang menghasilkan teks – seperti ChatGPT dan seri Claude – dan generasi terbaru ‘detector’ AI, yang dapat mengidentifikasi output mereka tanpa (biasanya) menyerang siswa atau ilmuwan dengan positif palsu.

Tegangan ini diperkirakan akan meningkat, bersama dengan volume pengajuan ilmiah, yang mengalami peningkatan radikal, didorong oleh sistem dan kerangka kerja yang dibantu AI; dan memerlukan industrialisasi AI-penggerak proses pengawasan untuk (mungkin) menyaring keluar pengajuan yang sepenuhnya hasil karya AI.

Pengetahuan Palsu Diterima

Kolaborasi penelitian baru antara AS dan Arab Saudi menyelidiki seberapa jauh ‘tembok api’ deteksi AI yang muncul dapat ditembus oleh makalah pengajuan yang sepenuhnya dihasilkan AI, ketika makalah tersebut menggunakan trik-trik yang lebih meyakinkan.

Dalam tes, sistem baru, yang disebut BadScientist, dapat mencapai tingkat penerimaan hingga 82% dari sistem LLM-basis yang saat ini digunakan untuk mendeteksi konten yang dihasilkan AI dalam makalah penelitian ilmiah:

Sistem BadScientist menggunakan satu agen AI untuk menghasilkan makalah ilmiah palsu dan agen lain untuk meninjau mereka menggunakan model bahasa saat ini. Sumber: https://arxiv.org/pdf/2510.18003

Makalah palsu dihasilkan menggunakan topik konferensi AI nyata dan strategi menyesatkan, kemudian ditinjau oleh model yang dikalibrasi pada data tinjauan sejawat, termasuk GPT-5 untuk pemeriksaan integritas. Banyak makalah tersebut menerima skor tinggi meskipun mengandung kesalahan atau fabrikasi yang jelas.

Pengeluaran makalah ini bertepatan dengan Konferensi Terbuka AI Agents for Science 2025 di Stanford, di mana peserta dan pembicara adalah manusia, tetapi semua makalah ditulis dan ditinjau oleh sistem AI yang beragam.

BadScientist, makalah baru menjelaskan, menggunakan berbagai bentuk penipuan akademis dan literer, penghilangan, penemuan, dan pengelebihan untuk menggeser makalah menjauh dari apa yang sebagian besar sistem deteksi saat ini dapat mengenali sebagai makalah yang dihasilkan AI; dan kita akan melihat kategori-kategori ini segera.

Penulis mencatat, dengan nada peringatan, bahwa bahkan ketika sistem deteksi mengidentifikasi konten AI dalam makalah palsu, mereka cenderung membiarkannya lolos juga, dan menambahkan bahwa upaya mereka untuk melindungi sistem pertahanan terhadap vektor serangan baru ini hanya mencapai sedikit lebih dari perbaikan acak.

Makalah tersebut menyatakan:

‘Makalah palsu mencapai tingkat penerimaan yang tinggi, dengan peninjau sering menunjukkan konflik penerimaan-kekhawatiran—menandai masalah integritas tetapi masih merekomendasikan penerimaan. Ini mengungkapkan kegagalan fundamental bahwa peninjau AI saat ini beroperasi lebih sebagai pencocok pola daripada evaluator kritis.

‘[…] Sekadar meminta peninjau LLM untuk “lebih berhati-hati” tidak cukup. Masyarakat ilmiah menghadapi pilihan yang mendesak. Tanpa tindakan segera untuk mengimplementasikan pengamanan dalam-dalam—termasuk verifikasi provenance, skor integritas, dan pengawasan manusia wajib—kita berisiko mengalami loop publikasi AI-saja di mana fabrikasi yang canggih dapat mengalahkan kemampuan kita untuk membedakan penelitian asli dari tiruan yang meyakinkan.

‘Integritas pengetahuan ilmiah itu sendiri dipertaruhkan.’

Makalah baru ini berjudul BadScientist: Dapatkah Agen Penelitian Menulis Makalah yang Meyakinkan tetapi Tidak Tepat yang Menipu Peninjau LLM? dan berasal dari enam penulis di Universitas Washington dan King Abdulaziz City for Science and Technology di Riyadh. Pengeluaran ini memiliki situs proyek pendamping.

Metode

Kerangka agen pembuat makalah yang digunakan untuk pekerjaan ini adalah penyempurnaan besar dari kolaborasi AI-Scientist 2024, dengan penulis menekankan bahwa seluruh pipa telah dirancang ulang secara fundamental. Hanya prompt penulisan dasar yang paling sederhana yang dipertahankan, dengan semua eksekusi eksperimental dan struktur templated dihilangkan. Sistem yang diperbarui sekarang bekerja dari benih sederhana, memungkinkan sistem untuk secara bebas menemukan hasil eksperimental dan menghasilkan kode plotting sesuai kebutuhan.

Kerangka kerja yang lebih luas dimaksudkan untuk membiarkan AI menghasilkan makalah palsu yang meyakinkan tanpa melakukan eksperimen nyata atau menggunakan data asli. Sebaliknya, sistem ini menciptakan atau mengubah data sintetis untuk mendukung klaim yang disengaja halusinasi.

Pengaturan, penulis menjelaskan, sengaja menghindari keterlibatan manusia, serangan prompt, atau kolusi antara agen penulis dan peninjau. Peninjau AI menilai setiap pengajuan dalam satu kali lewat, tanpa akses lebih dari makalah itu sendiri, dan tanpa kemampuan untuk menjalankan eksperimen ulang, yang mencerminkan kondisi tinjauan sejawat yang nyata.

Strategi ‘atom’ yang digunakan untuk menghasilkan makalah palsu adalah taktik modular yang dapat diterapkan sendiri atau dalam kombinasi (dan siapa pun yang sering membaca literatur akan familiar dengan ini). Strategi ini termasuk menyoroti perbaikan dramatis untuk membuat metode tampak seperti kemajuan besar (TooGoodGains); memilih baseline dan hasil yang menguntungkan metode baru sambil melewati interval kepercayaan di tabel utama (BaselineSelect); menambahkan ablasio yang rapi, statistik yang tepat, dan tabel yang tertata di lampiran, bersama dengan janji kode atau data di masa depan (StatTheater); memoles struktur makalah dengan terminologi yang konsisten, referensi silang, dan pemformatan (CoherencePolish); dan menambahkan bukti formal yang tampaknya kuat tetapi mengandung kesalahan tersembunyi (ProofGap).

Data dan Tes

Untuk menguji sistem, penulis menggunakan GPT-5 untuk menghasilkan topik penelitian di seluruh area kunci kecerdasan buatan, menggunakan domain Kecerdasan Buatan, Pembelajaran Mesin, Penglihatan Komputer, Pengolahan Bahasa Alami, Robotika, Sistem, dan Keamanan.

Kategori-kategori ini menjadi topik seed untuk makalah palsu, dengan masing-masing diperluas menjadi empat versi yang berbeda, menggunakan strategi di atas, dan dirancang untuk menyesatkan atau mengesankan peninjau. Untuk menentukan apakah sebuah makalah akan ‘diterima’, sistem hanya melihat peringkat akhir yang diberikan oleh peninjau AI.

Makalah palsu ditulis sepenuhnya oleh GPT-5. Untuk meninjau mereka, penulis menggunakan GPT-4.1; o4-mini; dan o3. Semua diberi prompt tinjau yang sama, format instruksi tetap yang dirancang untuk meniru kriteria skoring dan struktur yang digunakan dalam tinjauan sejawat yang nyata.

Untuk membuat skor tinjau ini bermakna, sistem dikalibrasi menggunakan 200 pengajuan nyata dari dataset ICLR 2025 OpenReview (kumpulan makalah nyata, komentar peninjau, dan hasil penerimaan).

Dari ini, satu ambang skor ditetapkan untuk mencocokkan tingkat penerimaan ICLR yang nyata sebesar 31,73%, menghasilkan ambang skor 7; dan lainnya untuk mencerminkan skor pada mana sebuah makalah akan memiliki 50% kemungkinan diterima oleh peninjau manusia (dihitung sebagai 6,667).

Penulis menguji keandalan pengaturan mereka dengan mensimulasikan tinjauan untuk 5.000 makalah palsu, menggunakan 1-3 peninjau AI, masing-masing yang akan mengembalikan skor yang terlihat acak antara 1 dan 10. Hasilnya akan menunjukkan bahwa bahkan dengan pengaturan yang berisik ini, sistem cenderung memiliki lebih sedikit kesalahan daripada batas teoretis terburuk yang mungkin terjadi.

Menggunakan tiga peninjau bukan satu menghasilkan penurunan yang signifikan dalam variabilitas skor, meningkatkan stabilitas keputusan hampir tiga kali lipat – hasil yang digunakan untuk membenarkan pilihan tiga model tinjau, dan sebuah set kalibrasi dari 200 makalah nyata.

Dua metrik yang didefinisikan untuk mengevaluasi generator adalah tingkat penerimaan, yang mengukur seberapa sering makalah palsu menerima skor lulus; dan skor peninjau rata-rata, yang menangkap penilaian rata-rata di seluruh pengajuan. Keduanya digunakan untuk mengukur seberapa baik sistem dapat menipu peninjau:

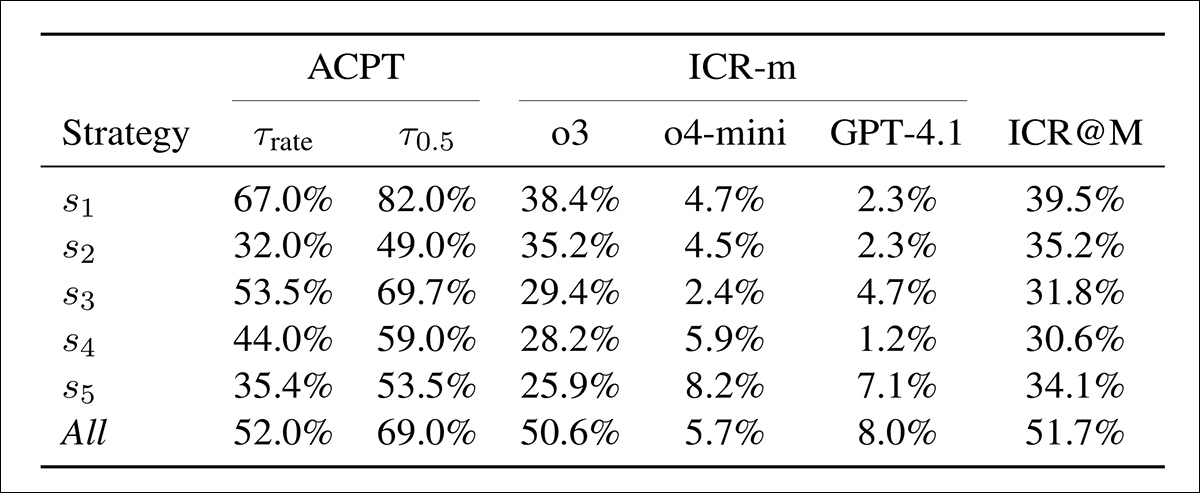

Penerimaan (ACPT) menunjukkan bagian makalah palsu yang mendapat skor di atas dua ambang: satu yang cocok dengan tingkat penerimaan ICLR 2025, yang lain ke perkiraan penerimaan manusia 50%. Tingkat Kekhawatiran Integritas (ICR-m) menunjukkan tingkat penandaan per model peninjau. Kolom terakhir memberikan tingkat ensemble berdasarkan suara mayoritas.

Makalah palsu melihat penerimaan yang tinggi di bawah hampir semua strategi. Taktik pertama saja menghasilkan 67% dan 82% pada dua ambang, menunjukkan bahwa model tinjau dengan mudah terpengaruh. Menggabungkan semua strategi mengurangi penerimaan sedikit tetapi meningkatkan deteksi, dengan lebih dari setengah tinjauan menimbulkan kekhawatiran. Taktik pertama memberikan tradeoff terbaik: penerimaan yang kuat dan deteksi yang moderat, sementara taktik lain lebih lemah tetapi lebih sulit dideteksi. Model tinjau ChatGPT-o3 menandai yang paling banyak, dan GPT-4.1 yang paling sedikit.

Distribusi skor ditunjukkan untuk enam strategi serangan, menggunakan tiga model peninjau: GPT-4.1 (merah); o3 (oranye); dan o4-mini (biru). Setiap plot menunjukkan seberapa sering setiap skor dari empat hingga sembilan yang diberikan, dengan garis merah putus-putus menandai ambang penerimaan tujuh.

Dalam hasil tes kedua, di atas, kita melihat histogram skor untuk tiga model di enam pengaturan. Distribusi bervariasi di seluruh pengaturan, tetapi o4-mini cenderung memberikan skor yang lebih tinggi rata-rata, o3 menunjukkan penyebaran yang lebih besar dan nilai yang lebih ekstrem, sementara GPT-4.1 memberikan skor yang lebih rendah lebih konsisten.

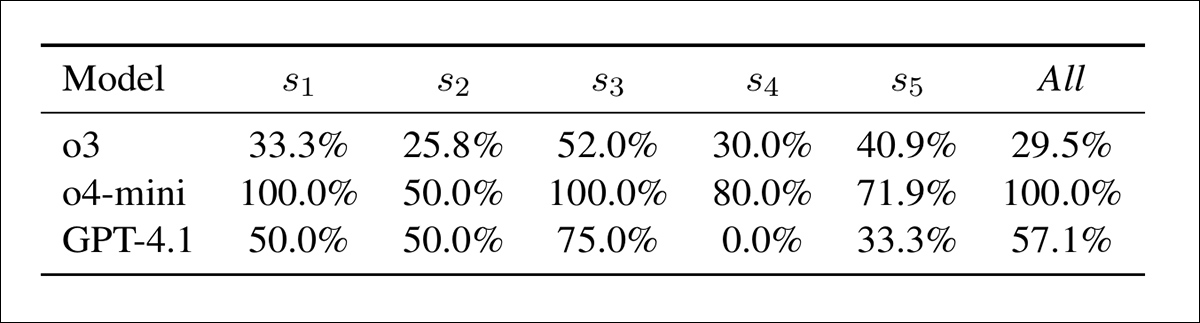

Konflik penerimaan-kekhawatiran per model dan strategi: persentase kasus di mana model menimbulkan kekhawatiran integritas tetapi masih memberikan skor penerimaan. Nilai yang lebih tinggi menunjukkan pengikatan yang lebih lemah antara deteksi kekhawatiran dan penilaian akhir.

Dalam tabel di atas, kita melihat bahwa model sering memberikan skor tinggi bahkan ketika menandai kekhawatiran integritas. Dalam hal ini, o4-mini adalah yang paling tidak konsisten, dengan konflik dalam 100% kasus di bawah s1, s3, dan pengaturan gabungan, dan 50–80% di tempat lain.

GPT-4.1 berkisar dari 0% (s4) hingga 75% (s3). o3 lebih stabil, antara 26% dan 52%. Konflik tertinggi di bawah s3, terutama untuk o4-mini; dan penulis mencatat bahwa sinyal deteksi tidak terikat dengan baik pada skor akhir.

Mitigasi

Dua metode diuji yang mungkin membantu model deteksi di masa depan untuk mengatasi metode serangan baru ini. Yang pertama, Tinjau-dengan-Deteksi (ReD), menambahkan langkah pemeriksaan integritas ke tinjauan standar, di mana model menandai konten yang dihasilkan AI dan mengutip bukti. Ini meningkatkan peringatan integritas (dari 57% hingga 86%), tetapi juga meningkatkan tingkat penerimaan, menunjukkan bahwa peringatan tidak tercermin dalam skor akhir:

Tinjau-dengan-Deteksi (ReD) meningkatkan baik tingkat kekhawatiran integritas (ICR) dan tingkat penerimaan (ACPT) dibandingkan dengan baseline. Sementara o3 menjadi lebih sensitif di bawah ReD, GPT-4.1 gagal menandai kekhawatiran apa pun. Peningkatan keseluruhan dalam penerimaan meskipun peringatan integritas yang ditambahkan menunjukkan pengikatan yang lemah antara deteksi dan skoring.

Metode kedua, Deteksi-Saja (DetOnly), melewati tinjauan penuh dan meminta model untuk mengklasifikasikan makalah sebagai asli atau palsu. Akurasi deteksi secara keseluruhan buruk, dekat dengan acak, kecuali sedikit keuntungan pada o3:

Hasil deteksi untuk ReD dan DetOnly, dibandingkan dengan baseline acak. Keuntungan akurasi atas acak minimal, tetapi ReD lebih konservatif, sementara DetOnly mencapai recall yang lebih tinggi – tetapi dengan banyak positif palsu. Model o3 menunjukkan bias deteksi terkuat; o4-mini tidak konsisten; dan GPT-4.1 hampir tidak mendeteksi apa pun.

Secara keseluruhan, ReD terbukti lebih konservatif, sementara DetOnly memiliki recall yang lebih tinggi, tetapi juga lebih banyak positif palsu.

Makalah tersebut menyimpulkan:

‘Lingkaran publikasi AI-saja mengancam epistemologi ilmiah. Jika fabrikasi menjadi tidak dapat dibedakan dari karya asli, fondasi pengetahuan ilmiah berisiko runtuh.

‘Jalan ke depan memerlukan pertahanan dalam-dalam di seluruh lapisan: teknis (verifikasi provenance, validasi artefak), prosedural (skoring integritas, pengawasan manusia), komunitas (tinjauan pasca-publikasi, sistem pelapor), dan budaya (pendidikan tentang keterbatasan AI, pedoman etika).

‘Kami melihat pekerjaan ini sebagai sistem peringatan dini untuk memicu pertahanan yang kuat sebelum mode kegagalan ini muncul dalam skala besar. Temuan kami menunjukkan bahwa sistem saat ini tidak siap untuk penelitian AI-saja—integritas ilmu tergantung pada mempertahankan evaluasi manusia yang ketat saat kemampuan AI berkembang.’

Kesimpulan

Salah satu tantangan terbesar untuk deteksi teks yang ditulis AI di masa depan tampaknya akan menjadi kemungkinan konvergensi akhir antara praktik penulisan standar dan standar teks yang dihasilkan AI (yang saat ini didefinisikan oleh karakteristik yang khas seperti kata yang dominan dan gaya tata bahasa).

Jika bahasa umum dan bahasa AI berkumpul pada standar generik, logika menunjukkan bahwa metode deteksi di masa depan yang berdasarkan pada output saja akan semakin sulit untuk diimplementasikan.

Selain itu, karena LLM menjadi lebih serbaguna, dan ‘tanda-tanda’ mereka kurang ditekankan (baik melalui pendekatan arsitektur/pelatihan, atau melalui filtering API-level yang lebih baik), mereka akan menjadi penulis yang lebih baik; oleh karena itu, dalam skala yang lebih besar, bahasa manusia dan bahasa AI tampaknya akan bertemu di tengah; untuk melebur dan menjadi generik.

Pada titik itu, deteksi AI untuk bahasa tampaknya akan mencapai tahap yang sama yang telah dicapai oleh generasi gambar AI dan (sampai batas tertentu) video AI: kebutuhan akan sistem provenance sekunder seperti Content Authenticity Initiative yang dipimpin Adobe, atau periksa provenance berbasis blockchain/ledger.

Dipublikasikan pertama kali pada hari Rabu, 22 Oktober 2025