Sudut Anderson

Teka-Teki Jigsaw Meningkatkan Penalaran Visual AI

Penelitian baru menunjukkan bahwa model AI dapat menjadi lebih pintar dalam melihat dengan menyelesaikan teka-teki jigsaw. Menyusun ulang gambar, video, dan adegan 3D yang acak membantu mereka mempertajam keterampilan visual tanpa memerlukan data, label, atau alat tambahan.

Dalam perebutan saat ini untuk mendorong Multimodal Large Language Models (MLLMs*) ke depan (atau setidaknya tetap tiga rilis di depan pesaing terdekat), hanya ada sedikit kemenangan mudah dan tidak ada makan siang gratis.

Meskipun banyak rilis FOSS China yang mengesankan pada 2025 dilaporkan memiliki biaya pengembangan dan operasi yang lebih rendah, rilis Barat cenderung melempar lebih banyak pada masalah: lebih banyak volume data, lebih banyak tenaga inferensi, lebih banyak listrik (meskipun tidak, seperti yang baru-baru ini kami catat, lebih banyak anotator manusia sebenarnya, karena itu terlalu mahal bahkan untuk revolusi gen-AI skala $triliun+).

Dalam literatur penelitian, sebagian besar pendekatan yang diklaim ‘gratis’ untuk evolusi arsitektur AI cenderung hanya menawarkan peningkatan inkremental kecil; atau peningkatan di area yang tidak paling kritis dikejar. Namun demikian, pencarian ‘prinsip dasar’ yang belum ditemukan yang dapat mempercepat laju perkembangan terlalu menggoda untuk ditinggalkan.

Mengumpulkan Potongan

Meskipun tidak sepenuhnya dalam kategori itu, sebuah kolaborasi akademik baru antara institusi China mengklaim telah menentukan bahwa membuat VLMs menyelesaikan teka-teki jigsaw meningkatkan kinerja mereka secara signifikan, meskipun pendekatan pembelajaran penguatan ini sebelumnya berkinerja buruk di area ini, dan meskipun tidak memerlukan sistem tambahan, model tambahan atau proses ‘tambahan’ lainnya:

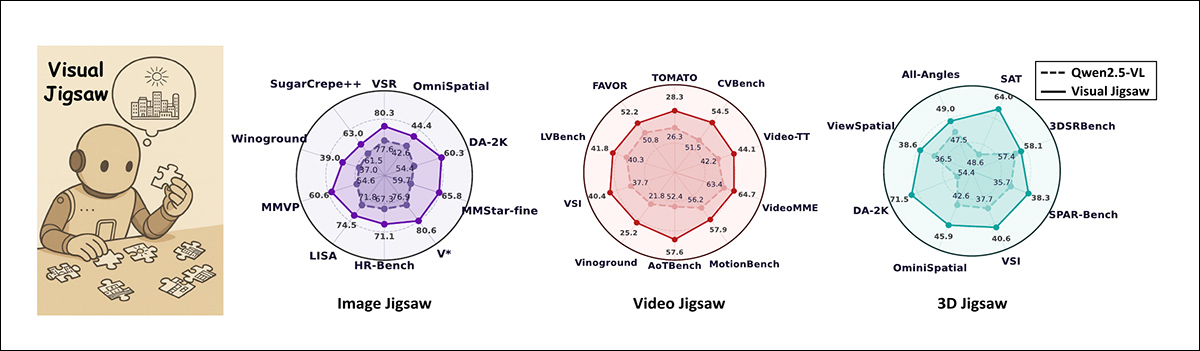

Visual Jigsaw adalah kerangka kerja pasca-pelatihan yang diawasi sendiri yang meningkatkan keterampilan berpusat pada penglihatan dalam model bahasa besar multimodal. Dengan melatih pada tugas jigsaw di seluruh gambar, video, dan data 3D, model mendapatkan persepsi halus, spasial, dan komposisional yang lebih tajam dalam gambar, penalaran temporal yang lebih kuat dalam video, dan pemahaman sadar geometri yang ditingkatkan dalam adegan 3D. Bagan radar pada gambar di atas menunjukkan peningkatan yang konsisten dibandingkan Qwen2.5-VL dasar, dengan skala nilai disesuaikan untuk setiap tolok ukur demi kejelasan. Source: https://arxiv.org/pdf/2509.25190

Sistem yang dirancang oleh para peneliti berjudul Visual Jigsaw, dan melibatkan pelatihan MLLM yang ada pada materi yang telah dipecah dan disebar secara acak, seperti jigsaw. Para penulis mengembangkan tiga modalitas untuk pendekatan ini: gambar, video, dan 3D (yaitu, mesh bergaya CGI), dan menemukan bahwa adaptasi moderat dari proses yang sama menguntungkan ketiga domain:

Representasi dari tiga tugas Visual Jigsaw. Dalam Image Jigsaw, sebuah gambar dibagi menjadi patch, diacak, dan model memprediksi tata letak yang benar; dalam Video Jigsaw, klip diacak dan model mengembalikan urutannya dalam waktu; dalam 3D Jigsaw, titik dengan kedalaman berbeda diacak dan model memberi peringkat dari yang terdekat hingga terjauh. Output model dinilai terhadap kebenaran dasar, dengan kredit parsial diberikan untuk solusi yang sebagian benar.

Metode pelatihan Visual Jigsaw membantu model AI meningkatkan pemahaman informasi visual dengan membuat mereka menyusun ulang gambar, klip video, atau titik data 3D yang berantakan ini.

Proses ini didasarkan pada kata-kata daripada gambar, dan oleh karena itu tidak perlu model menghasilkan gambar atau menggunakan komponen visual tambahan apa pun. Metode ini masuk ke dalam sistem yang disebut Reinforcement Learning from Verifiable Rewards (RLVR), di mana model diberi imbalan untuk jawaban yang benar berdasarkan aturan otomatis yang jelas; dan di mana, oleh karena itu, tidak diperlukan pelabelan manusia.