Kecerdasan buatan

Mistral AI: Menetapkan Tolak Ukur Baru di Luar Llama2 di Ruang Sumber Terbuka

Model Bahasa Besar (LLM) baru-baru ini menduduki pusat perhatian, berkat penampilan yang menonjol seperti ChatGPT. Ketika Meta memperkenalkan model Llama mereka, itu memicu minat baru dalam LLM sumber terbuka. Tujuannya? Membuat LLM sumber terbuka yang terjangkau dan sebaik model tingkat atas seperti GPT-4, tetapi tanpa harga yang mahal atau kompleksitas.

Campuran keterjangkauan dan efisiensi ini tidak hanya membuka jalur baru bagi peneliti dan pengembang, tetapi juga menetapkan panggung untuk era baru kemajuan teknologi dalam pemrosesan bahasa alami.

Baru-baru ini, perusahaan rintisan AI generatif telah mendapatkan pendanaan. Bersama-sama mengumpulkan $20 juta, dengan tujuan membentuk AI sumber terbuka. Anthropic juga mengumpulkan $450 juta, dan Cohere, bermitra dengan Google Cloud, mengamankan $270 juta pada bulan ini.

Pengenalan Mistral 7B: Ukuran & Ketersediaan

Mistral AI, yang berbasis di Paris dan didirikan oleh alumni dari Google DeepMind dan Meta, mengumumkan model bahasa besar pertamanya: Mistral 7B. Model ini dapat diunduh dengan mudah oleh siapa saja dari GitHub dan bahkan melalui 13,4-gigabyte torrent.

Perusahaan rintisan ini berhasil mengamankan pendanaan benih yang memecahkan rekor bahkan sebelum mereka memiliki produk. Mistral AI pertama dengan model 7 miliar parameter melebihi kinerja Llama 2 13B dalam semua tes dan mengalahkan Llama 1 34B dalam banyak metrik.

Dibandingkan dengan model lain seperti Llama 2, Mistral 7B menawarkan kemampuan yang serupa atau lebih baik tetapi dengan beban komputasi yang lebih rendah. Sementara model dasar seperti GPT-4 dapat mencapai lebih, mereka datang dengan biaya yang lebih tinggi dan tidak serama karena mereka sebagian besar dapat diakses melalui API.

Ketika datang ke tugas pengkodean, Mistral 7B memberikan CodeLlama 7B kesempatan untuk bersaing. Plus, itu cukup kompak pada 13,4 GB untuk dijalankan pada mesin standar.

Selain itu, Mistral 7B Instruct, yang disesuaikan khusus untuk dataset instruksional pada Hugging Face, telah menunjukkan kinerja yang luar biasa. Ini mengungguli model 7B lainnya pada MT-Bench dan berdiri bahu membahu dengan model obrolan 13B.

Hugging Face Mistral 7B Contoh

Benchmark Kinerja

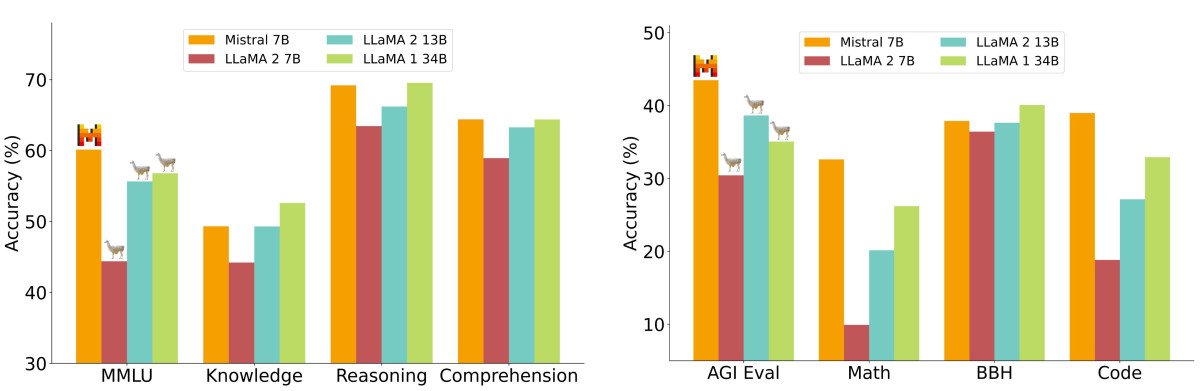

Dalam analisis kinerja terperinci, Mistral 7B diukur melawan model keluarga Llama 2. Hasilnya jelas: Mistral 7B secara substansial melebihi Llama 2 13B di semua benchmark. Bahkan, itu mencapai kinerja Llama 34B, terutama menonjol dalam benchmark kode dan penalaran.

Benchmark dibagi menjadi beberapa kategori, seperti Penalaran Umum, Pengetahuan Dunia, Pemahaman Membaca, Matematika, dan Kode, di antara lainnya. Pengamatan yang patut dicatat adalah metrik kinerja biaya Mistral 7B, yang disebut “ukuran model setara”. Dalam area seperti penalaran dan pemahaman, Mistral 7B menunjukkan kinerja yang serupa dengan model Llama 2 tiga kali lipat ukurannya, menunjukkan potensi penghematan memori dan peningkatan throughput. Namun, dalam benchmark pengetahuan, Mistral 7B sejajar dengan Llama 2 13B, yang kemungkinan disebabkan oleh keterbatasan parameter yang memengaruhi kompresi pengetahuan.

Apa yang Membuat Model Mistral 7B Lebih Baik dari Model Bahasa Lainnya?

Mengsederhanakan Mekanisme Perhatian

Sementara kehalusan mekanisme perhatian adalah teknis, ide dasarnya relatif sederhana. Bayangkan membaca buku dan menyoroti kalimat penting; ini analog dengan bagaimana mekanisme perhatian “menyoroti” atau memberi penting pada titik data tertentu dalam urutan.

Dalam konteks model bahasa, mekanisme ini memungkinkan model untuk fokus pada bagian paling relevan dari data input, memastikan outputnya kohesif dan akurat secara kontekstual.

Dalam transformer standar, skor perhatian dihitung dengan rumus:

Rumus untuk skor ini melibatkan langkah kritis – perkalian matriks Q dan K. Tantangan di sini adalah bahwa ketika panjang urutan tumbuh, kedua matriks berkembang secara proporsional, menyebabkan proses yang intensif secara komputasi. Keprihatinan skala ini adalah salah satu alasan utama mengapa transformer standar dapat lambat, terutama ketika menangani urutan panjang.

Perhatian multi-query (MQA) mempercepat proses dengan menggunakan satu set ‘kepala kunci-nilai’ tetapi terkadang mengorbankan kualitas. Sekarang, Anda mungkin bertanya-tanya, mengapa tidak menggabungkan kecepatan MQA dengan kualitas perhatian multi-kepala? Itulah di mana Perhatian Berkelompok (GQA) masuk.

Perhatian Berkelompok (GQA)

GQA adalah solusi tengah. Alih-alih menggunakan hanya satu atau beberapa ‘kepala kunci-nilai’, itu mengelompokkannya. Dengan cara ini, GQA mencapai kinerja yang dekat dengan perhatian multi-kepala yang terperinci tetapi dengan kecepatan MQA. Untuk model seperti Mistral, ini berarti kinerja yang efisien tanpa mengorbankan kualitas terlalu banyak.

Perhatian Jendela Geser (SWA)

Jendela geser adalah metode lain yang digunakan dalam memproses urutan perhatian. Metode ini menggunakan jendela perhatian berukuran tetap di sekitar setiap token dalam urutan. Dengan beberapa lapisan yang menumpuk perhatian jendela ini, lapisan atas akhirnya mendapatkan perspektif yang lebih luas, mencakup informasi dari seluruh input. Mekanisme ini analog dengan bidang reseptif yang dilihat dalam Jaringan Saraf Konvolusional (CNN).

Di sisi lain, “perhatian jendela geser yang diperluas” dari model Longformer, yang konseptualnya mirip dengan metode jendela geser, hanya menghitung beberapa diagonal dari matriks . Perubahan ini menyebabkan penggunaan memori meningkat secara linier daripada kuadrat, membuatnya menjadi metode yang lebih efisien untuk urutan yang lebih panjang.

Transparansi Mistral AI vs. Keprihatinan Keamanan dalam Desentralisasi

Dalam pengumuman mereka, Mistral AI juga menekankan transparansi dengan pernyataan: “Tidak ada trik, tidak ada data milik.” Namun, model mereka yang hanya tersedia saat ini ‘Mistral-7B-v0.1’ adalah model dasar pra-terlatih, sehingga dapat menghasilkan respons untuk setiap kueri tanpa moderasi, yang menimbulkan kekhawatiran keamanan potensial. Sementara model seperti GPT dan Llama memiliki mekanisme untuk mengetahui kapan harus merespons, sifat desentralisasi Mistral yang sepenuhnya dapat dieksploitasi oleh aktor jahat.

Namun, desentralisasi Model Bahasa Besar memiliki kelebihannya. Sementara beberapa orang mungkin menyalahgunakan itu, orang dapat memanfaatkan kekuatannya untuk kebaikan sosial dan membuat kecerdasan buatan dapat diakses oleh semua orang.

Fleksibilitas Penerapan

Salah satu sorotan adalah bahwa Mistral 7B tersedia di bawah lisensi Apache 2.0. Ini berarti tidak ada hambatan nyata untuk menggunakannya – apakah Anda menggunakannya untuk tujuan pribadi, perusahaan besar, atau bahkan entitas pemerintah. Anda hanya perlu sistem yang tepat untuk menjalankannya, atau Anda mungkin perlu berinvestasi dalam sumber daya cloud.

Sementara ada lisensi lain seperti Lisensi MIT yang lebih sederhana dan Lisensi CC BY-SA-4.0 yang kooperatif, yang mengharuskan kredit dan lisensi yang sama untuk turunan, Apache 2.0 menyediakan fondasi yang kuat untuk upaya skala besar.

Pemikiran Akhir

Munculnya Model Bahasa Besar sumber terbuka seperti Mistral 7B menandai pergeseran penting dalam industri AI, membuat model bahasa berkualitas tinggi dapat diakses oleh audiens yang lebih luas. Pendekatan inovatif Mistral AI, seperti Perhatian Berkelompok dan Perhatian Jendela Geser, menjanjikan kinerja yang efisien tanpa mengorbankan kualitas.

Sementara sifat desentralisasi Mistral menimbulkan beberapa tantangan, fleksibilitas dan lisensi sumber terbukanya menekankan potensi untuk mendemokratisasikan AI. Seiring dengan evolusi lanskap, fokusnya akan secara tidak terhindarkan berada pada keseimbangan kekuatan model ini dengan pertimbangan etika dan mekanisme keamanan.

Apa yang akan datang untuk Mistral? Model 7B hanya awal. Tim ini berencana untuk meluncurkan model yang lebih besar segera. Jika model baru ini sesuai dengan kinerja 7B, Mistral mungkin akan segera naik sebagai pemain utama di industri, semua dalam tahun pertama mereka.