Sudut Anderson

Kecerdasan Buatan Memecah Pencarian Web Menjadi Tiga Kenyataan yang Berbeda

Penelitian baru menemukan bahwa Google sekarang menggunakan tiga sistem informasi yang berbeda di dalam kerajaan pencarian sendiri, dengan Pencarian Reguler, Ringkasan Kecerdasan Buatan, dan Gemini semuanya memfavoritkan sumber, peringkat, dan konten yang berbeda.

Reduksionisme memerintah. Selama dua belas bulan terakhir, ‘Biarkan saya mencari itu untuk Anda’ meme telah diambil alih oleh tren baru ‘Biarkan saya meringkas pencarian Google itu untuk Anda’, di mana ringkasan kecerdasan buatan dalam hasil pencarian semakin sering menyelamatkan pembaca dari kesulitan mengklik tautan pencarian (secara mengurangi pendanaan situs sumber dalam prosesnya), dengan mengompresi hasil pencarian seluruhnya menjadi beberapa paragraf yang dihasilkan.

Seseorang mungkin berpikir bahwa pengetahuan inti yang disampaikan, dan pilihan situs dari mana menarik pengetahuan itu, akan relatif sama di semua tiga metode pencarian internet yang paling populer: dalam pencarian web tradisional; dalam ringkasan kecerdasan buatan (AIOs) yang sekarang memimpin sebagian besar hasil pencarian web; dan melalui penggunaan yang meningkat LLMs seperti ChatGPT sebagai web-oracles (dengan atau tanpa panggilan RAG eksternal).

Namun, penelitian baru dari AS menunjukkan bahwa ini, mengejutkan, jauh dari kasus; dan bahwa bahkan di dalam trinitas orakel Google sendiri – SERPS*, ringkasan AI, dan interaksi langsung dengan seri LLM Gemini – tampaknya ada perbedaan yang signifikan dan menarik, untuk setiap rute.

Pemisahan Tiga Cara

Dalam makalah baru yang jelas dan ekstensif, berjudul Bagaimana Kecerdasan Buatan Mengganggu Pencarian: Studi Empiris tentang Pencarian Google, Gemini, dan Ringkasan Kecerdasan Buatan, enam peneliti dari New Jersey Institute of Technology menguraikan cara-cara metode pencarian yang berbeda ini, dan menawarkan beberapa teori yang mungkin untuk perbedaan ini.

Makalah tersebut menyatakan:

‘[Pertama, kami] menemukan bahwa untuk 51,5% dari kueri pengguna nyata, AIOs dihasilkan, dan ditampilkan di atas hasil pencarian organik. Pertanyaan kontroversial sering menghasilkan AIO.

‘Kedua, kami menunjukkan bahwa sumber yang diperoleh secara substansial berbeda untuk setiap mesin pencari (<0,2 rata-rata kesamaan Jaccard). Pencarian Google tradisional lebih cenderung mengambil informasi dari situs web populer atau lembaga pemerintah atau pendidikan, sedangkan mesin pencari generatif lebih cenderung mengambil konten milik Google.

‘Ketiga, kami mengamati bahwa situs web yang memblokir pengambil AI Google adalah jauh lebih kecil kemungkinannya untuk diperoleh oleh AIOs, meskipun memiliki akses ke konten.’

Karena makalah ini adalah smorgasbord dari wawasan yang menarik, bukan mengikuti alur kerja yang biasa dan metodis, kita akan melihat lebih dekat pada beberapa temuan ini, dan beberapa temuan lain yang paling menarik dan menerangi.

Lama ‘Dua-Satu’

Salah satu temuan menarik dalam studi ini menunjukkan bahwa ringkasan kecerdasan buatan Google cenderung ditekan untuk peristiwa berita yang tiba-tiba, karena sumber awal dan tersedia mungkin tidak paling akurat.

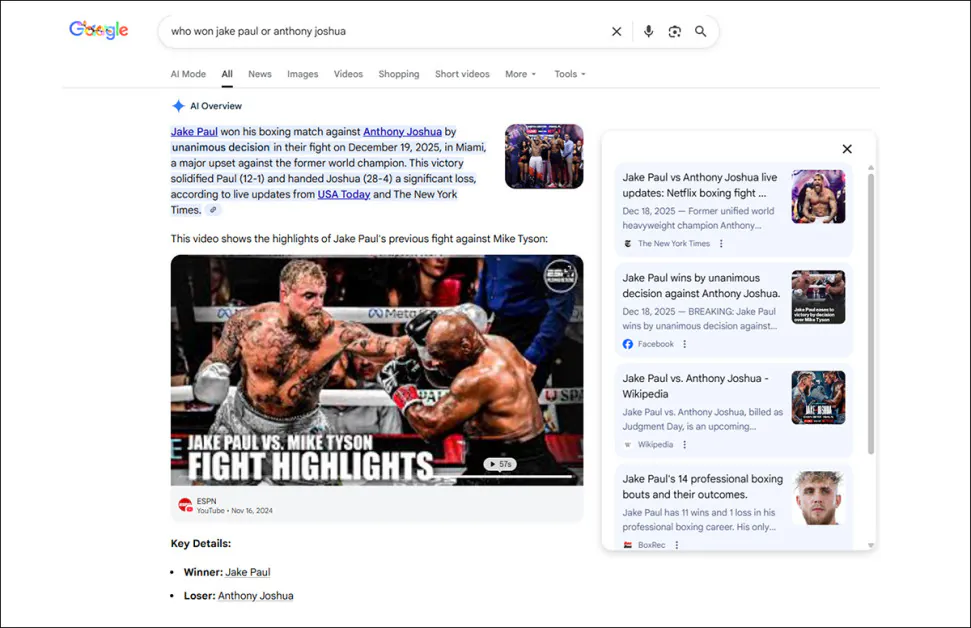

Sistem ini tidak selalu berhasil: dalam contoh di bawah, yang dicatat oleh peneliti, ringkasan kecerdasan buatan Google tentang hasil pertarungan tinju mengaitkan kemenangan dengan petinju yang salah, meskipun satu-satunya sumber yang menyatakan (salah) hasil ini adalah umpan olahraga satir di Facebook:

Salah satu alasan mengapa ringkasan kecerdasan buatan Google menghindari ringkasan waktu-kritis adalah bahwa informasi awal mungkin tidak lengkap, atau sepenuhnya tidak akurat. Dalam kasus ini, petinju Jake Paul sebenarnya kalah dalam pertarungan. Sumber

Penulis mencatat bahwa AIOs cenderung muncul ketika suatu peristiwa telah berusia setidaknya lima hari, yang memenuhi syarat ini sebagai anomali – tetapi bagaimanapun, satu yang peneliti dengan mudah dapat memanggil.

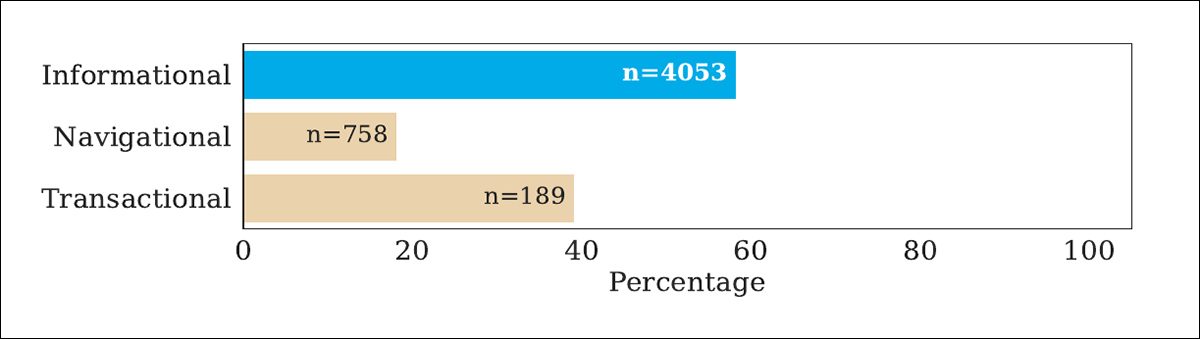

AIOs ditemukan lebih cenderung dihasilkan ketika kueri ditutup dengan tanda tanya, dan bahwa intent kueri adalah faktor dalam apakah AIO akan disajikan:

Persentase insiden di mana ringkasan pencarian AI dihasilkan dalam satu putaran tes peneliti. Di sini ‘informasional’ menunjukkan pertanyaan langsung, yang cenderung menghasilkan AIOs lebih dari jenis interaksi lainnya.

Selain itu, makalah tersebut menyatakan, kueri yang lebih panjang cenderung lebih mungkin menghasilkan ringkasan AI daripada hanya hasil pencarian langsung, meskipun penulis belum menawarkan teori untuk menjelaskan hal ini.

Kerajaan yang Terbagi

Mungkin hasil yang paling mengejutkan dari pekerjaan baru ini adalah perbedaan yang relatif kecil dalam kualitas hasil antara tiga platform pencarian Google.

Makalah tersebut berulang kali menunjukkan bahwa Pencarian Google Reguler, Ringkasan Kecerdasan Buatan, dan Gemini (LLM) mengambil sumber yang sangat berbeda untuk kueri yang sama, dengan skor tumpang tindih yang cukup rendah untuk mengimplikasikan tiga logika pengambilan yang bersaing di dalam satu perusahaan, di mana pengguna mungkin menganggap bahwa Google memiliki satu indeks otoritatif, dan satu filosofi peringkat:

Bahkan di dalam ekosistem Google sendiri, tumpang tindih antara Pencarian Tradisional, Ringkasan Kecerdasan Buatan, dan Gemini terbukti cukup kecil, dengan kueri yang sama sering menghasilkan daftar sumber yang sangat berbeda tergantung pada sistem Google mana yang menangani permintaan.

Mengenai bagian analisis ini, penulis menyatakan†:

‘[Tabel di atas] menyajikan kesamaan rata-rata antara daftar sumber yang dikembalikan oleh AIO, Gemini, dan SERP tradisional untuk setiap kueri dalam dataset benchmark.

‘Inti utama adalah bahwa terlepas dari subset kueri dan pasangan mesin pencari yang dibandingkan, daftar yang diperoleh tidak sama, meskipun ketiganya dikembangkan oleh Google.’

Peneliti lebih lanjut menyatakan bahwa tidak ada metode pencarian yang diuji yang memiliki tumpang tindih peringkat (RBO) di atas 0,27, yang merupakan skor yang sangat rendah. Mereka mencatat lebih lanjut bahwa Amazon Retail dan kueri lokal (yaitu, ‘toko di dekat saya’) memiliki kesamaan terendah di antara metode pencarian.

Mereka mengatribusikan kesepakatan yang rendah pada ‘inkonsistensi antara mesin pencari’, mencatat bahwa tidak ada keacakan atau faktor lain yang jelas dapat dijadikan alasan untuk perbedaan ini.

Satu penjelasan intuitif, secara argumentatif, adalah bahwa titik data pelatihan diberi peringkat dengan cara yang sangat berbeda dari metode yang telah dikembangkan Google untuk PageRank dan penerusnya selama dua dekade terakhir. Selain itu, pada kemungkinan bahwa algoritma Pencarian Google memiliki agenda rahasia, jenis intervensi atau ‘permainan’ tersebut jauh lebih sulit untuk diimplementasikan secara konsisten di model AI berbasis difusi seperti Gemini (bahkan melalui filtering, sistem prompt, dan berbagai metode lain yang diterapkan pada model komersial).

Layanan Mandiri..?

Tentu situs web, atau kategori situs web, tampaknya telah terpengaruh oleh munculnya ringkasan kecerdasan buatan dan penggunaan LLM dalam pencarian tradisional – baik secara negatif maupun positif, tergantung pada kasus:

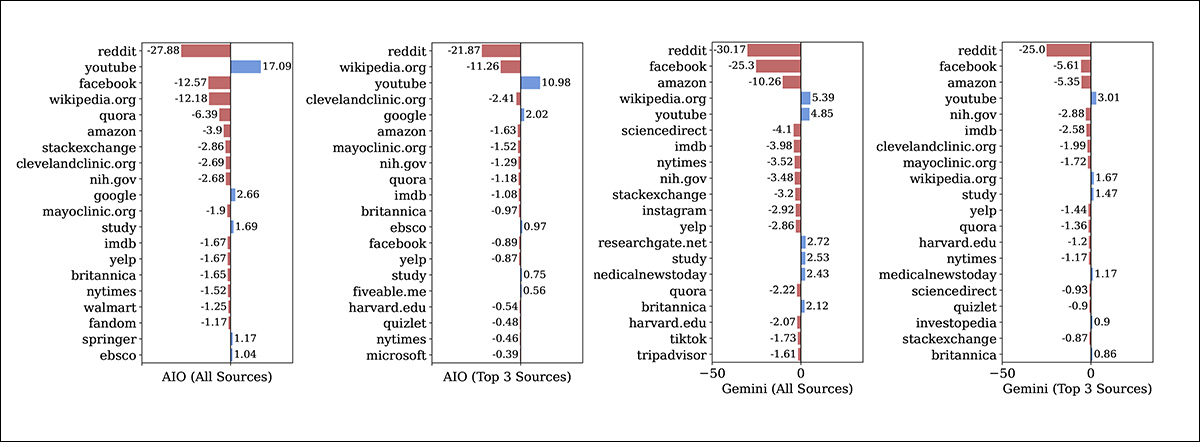

Dibandingkan dengan Pencarian Google Tradisional, Ringkasan Kecerdasan Buatan dan Gemini keduanya mengurangi kutipan dari banyak situs web besar, sementara meningkatkan visibilitas untuk sejumlah domain yang disukai. YouTube terbukti menjadi salah satu penerima manfaat terbesar di kedua sistem, sementara Reddit, Wikipedia, Facebook, dan banyak sumber lembaga muncul kurang sering dalam pengambilan yang dihasilkan AI.

Penulis mencatat bahwa beberapa preferensi yang tidak terduga muncul di antara tiga metode ini, selama pengujian:

‘Kami memiliki tiga kesimpulan utama dari [grafik di atas]. Pertama, situs web besar dan terkenal adalah yang paling terpengaruh (baik positif maupun negatif). Ini intuitif karena situs web besar memiliki reputasi dan keragaman konten untuk relevan dengan banyak kueri yang berbeda.

‘Kedua, sebagian besar situs web ini menerima kutipan yang lebih sedikit secara keseluruhan, dan kutipan tiga teratas, dengan mesin pencari generatif (ditunjukkan oleh bilah merah dan angka negatif di [grafik di atas]). Ini menunjukkan bahwa pencarian generatif cenderung mengambil informasi dari sumber yang lebih khusus daripada mesin pencari tradisional.

‘Ketiga, Ringkasan Kecerdasan Buatan Google memfavoritkan situs web Google (yaitu, domain google.com dan youtube.com).

‘Gemini juga memfavoritkan YouTube dibandingkan dengan Pencarian Google Tradisional, tetapi perbedaan absolutnya lebih kecil.’

Apakah Ada ‘Penghalang’..?

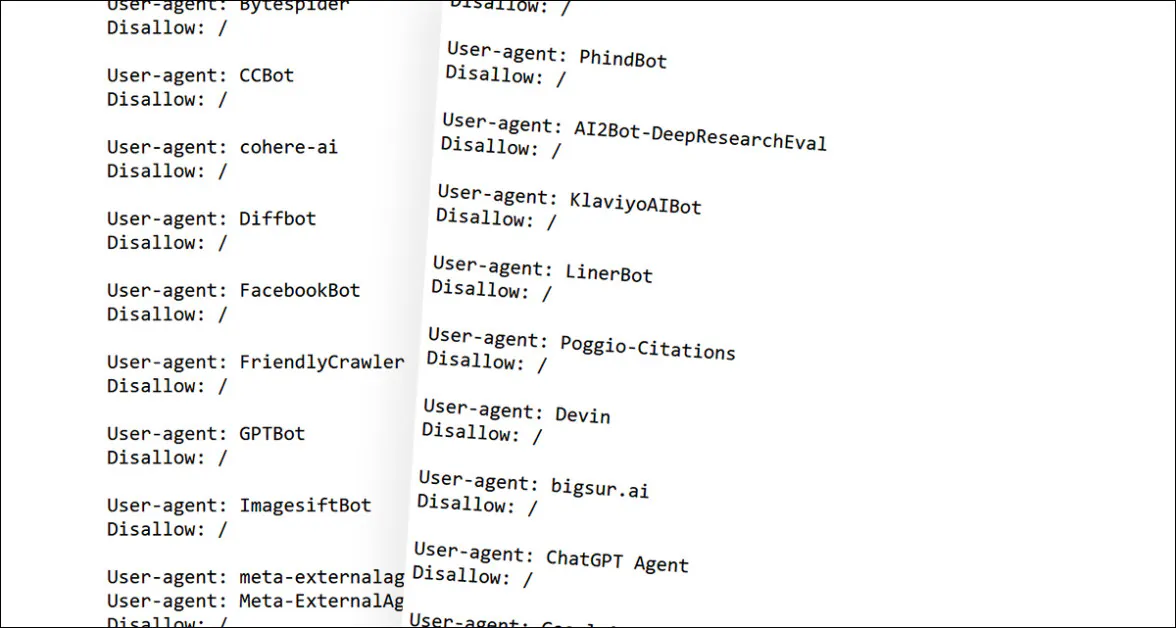

Studi ini juga menemukan bahwa penerbit yang memblokir pengambil AI web Google – bot web otomatis yang mengambil data dari situs Anda kecuali Anda mengatakan tidak dengan file robots.txt – cenderung tidak muncul dalam ringkasan AI.

Hal ini mungkin tampak seperti luka yang dilakukan sendiri, tetapi sebenarnya Google telah menyatakan secara terbuka bahwa konten dari platform yang memblokir pengambil AI tidak akan dicegah dari muncul dalam ringkasan AI; tetapi, penerbit tersebut tidak akan memiliki datanya diambil, dikurasi menjadi koleksi, dan dijalankan melalui putaran pelatihan AI berikutnya untuk Gemini dan proyek AI Google lainnya.

Namun, itu bukanlah kesimpulan yang dicapai oleh peneliti makalah baru, yang menemukan bahwa penerbit yang populer dan memblokir AI jarang dikutip oleh Gemini, baik dalam LLM maupun inkarnasi hasil pencarian yang lebih ramping. Penerbit yang ‘terlarang secara efektif’ dilaporkan oleh makalah tersebut termasuk NYTimes, CNN, BBC, ScienceDirect, Reuters, Wiley, Nature, ESPN, Business Insider, CNBC, NPR, WIRED, USA Today, NBC News, Genius, National Geographic, The Conversation, U.S. News & World Report, Scientific American, Consumer Reports, dan STAT.

Beberapa larangan pengambilan AI yang diterapkan oleh penerbit yang disebutkan di atas. Tapi apakah itu menyebabkan sensor yang lebih luas oleh Google?

Penulis menyatakan:

‘Dalam analisis kami tentang domain yang paling terpengaruh, kami menemukan bahwa 21 penerbit populer (yang diperoleh untuk setidaknya 20 kueri unik oleh Pencarian Google dan AIOs) tidak pernah dikutip oleh Gemini.

‘Beberapa situs web media sosial (Facebook, Instagram, Tiktok) dan review (IMDb, Yelp, Tripadvisor) juga menerima kutipan nol dari Gemini. Setelah penyelidikan lebih lanjut, kami menemukan bahwa semua situs web ini memblokir bot Google-Extended di file robots.txt mereka.’

Jika temuan ini terbukti diverifikasi di tempat lain dan konsisten, seseorang dapat berspekulasi bahwa perusahaan-perusahaan ini mungkin dipaksa oleh Google untuk menyerah dan bekerja sama dengan operasi AI mereka melalui daftar hitam sebagian. Pada pandangan pertama, hasilnya tampak seperti hukuman – tetapi kemudian, temuan pekerjaan baru ini lebih mengindikasikan kekacauan daripada premeditasi; oleh karena itu, satu-satunya komentar yang masuk akal adalah bahwa hasil ini tampak ‘dendam’, apa pun yang sebenarnya menyebabkannya.

Kesimpulan

Opini Ini adalah makalah yang jelas dan ekstensif, yang sepuluh halaman utamanya membuka wawasan yang menarik. Karena kita telah memiliki waktu untuk menutupi hanya sebagian kecil dari ini, saya sarankan PDF sumber bahkan untuk pembaca kasual (suatu kejadian yang langka).

Meskipun disposisi ‘kuning’ dapat melemparkan banyak interpretasi negatif pada penemuan penulis, pekerjaan ini mungkin lebih baik dianggap sebagai indikasi dari pemimpin teknologi global yang mencoba mendapatkan dan mempertahankan keunggulan dalam pencarian berbasis AI, dengan menggunakan platform yang sangat kontras yang dikembangkan dalam keadaan dan era yang sangat berbeda.

Sementara tiga metode pencarian diperiksa dalam makalah, kontroversi sebenarnya terletak antara hasil pencarian mesin tradisional, yang diberi peringkat oleh metode proprietari, dan metode seleksi berbasis distribusi yang kontras yang mendominasi kurasi data dan pelatihan AI.

Kecerdasan Buatan Seperti di Tahun 1999

Sebelum munculnya Google, memungkinkan untuk ‘mengalahkan’ hasil pencarian melalui volume saja, dan dengan cara ini, seseorang dapat sering mencapai peringkat SERPS halaman depan dengan upaya minimal (sering otomatis). ‘Permainan angka’ ini secara efektif diakhiri sekitar tahun 2002 oleh algoritma peringkat pencarian Google yang lebih canggih dan rahasia. Tetapi karena taruhannya signifikan, konten volume tinggi dan kualitas rendah tidak pernah benar-benar hilang dalam arti apa pun.

Oleh karena itu, pada saat koleksi hiperskala seperti Common Crawl meletakkan dasar revolusi AI modern, dominasi data-prominensi ditentukan oleh seberapa baik proses otomatis dapat memfilter dan mengatur kualitas data masuk, dan (jauh lebih kecil), seberapa banyak uang yang tersedia untuk membayar orang untuk mengatur data tersebut.

Ada banyak data yang buruk atau berkualitas rendah dalam koleksi besar dan tidak diskriminatif tersebut; data yang mungkin tidak termasuk konten yang tidak pantas atau rasisme, atau hal-hal lain yang relatif mudah untuk disaring dari dataset pelatihan – tetapi yang masih bersifat melayani diri sendiri dan banyak, seperti hasil pencarian internet sekitar 1999-2001.

Karena proses induksi data masih tidak hebat, sangat sulit bahkan bagi Google untuk membuat AI bertindak dengan cara bisnis, karena keputusan Gemini yang bergaya PageRank ditentukan tidak oleh insinyur kebijakan Google, tetapi oleh pemahaman yang tidak sempurna tentang bagaimana data hiperskala berubah menjadi distribusi data dan pembenaman laten selama pelatihan model AI.

* Halaman Hasil Pencarian Mesin.

† Penekanan penulis, bukan saya. Namun, saya telah menggantikan tebal dengan miring, karena penekanan miring tidak bekerja dengan baik dalam kutipan yang sudah sebagian besar miring.

Pertama dipublikasikan pada hari Rabu, 13 Mei 2026