Anderson का एंगल

एआई के साथ वीडियो से वस्तुओं और लोगों को मिटाना

नहीं, बच्चा तस्वीर में नहीं रहता, अगर एआई का इसमें कुछ लेना-देना है।

छवियों और वीडियो से लोगों और वस्तुओं को हटाना, वीएफएक्स-केंद्रित एआई साहित्य में शोध का एक लोकप्रिय उप-क्षेत्र है, जिसके लिए चुनौती का सामना करने वाले समर्पित डेटासेट और फ्रेमवर्क की बढ़ती संख्या है। इनमें से नवीनतम, चीन के फ़ुडान विश्वविद्यालय के इंस्टीट्यूट ऑफ बिग डेटा से, EffectErase है, जो एक ‘प्रभाव-सचेत’ वीडियो ऑब्जेक्ट रिमूवल सिस्टम है, जिसके बारे में लेखकों का दावा है कि यह परीक्षणों में अत्याधुनिक तकनीक पर काफी सुधार करता है:

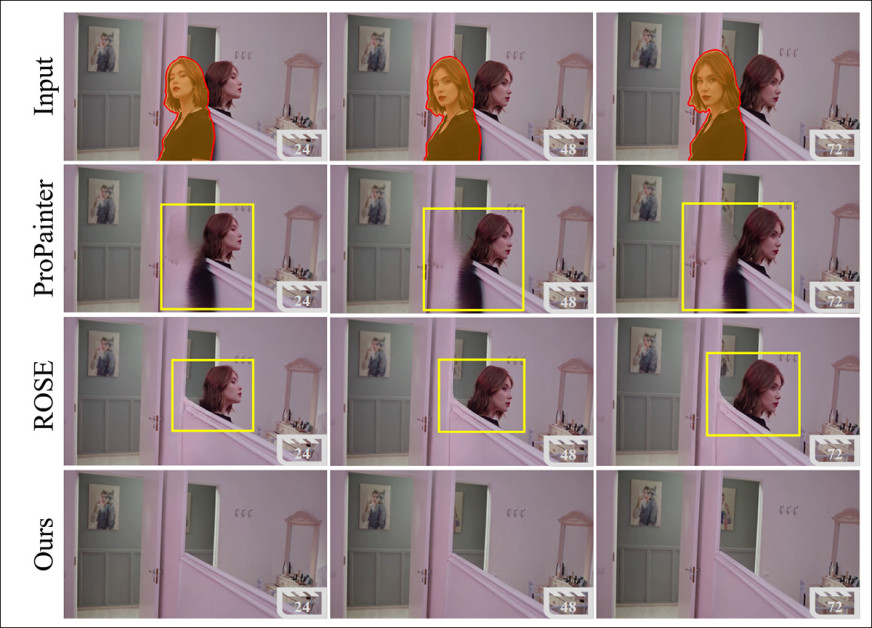

परियोजना वेबसाइट की सामग्री से संकलित, EffectErase विधि के उदाहरण (कृपया ध्यान दें कि हम एक लिंक प्रदान करते हैं, लेकिन स्रोत साइट में इतने अधिक हाई-रेस और अन-ऑप्टिमाइज़्ड ऑटोप्ले वीडियो हैं कि इससे आपके वेब ब्राउज़र की स्थिरता प्रभावित हो सकती है। संलग्न YouTube वीडियो एक आसान और पूर्ण संदर्भ है, और इस लेख के अंत में एम्बेडेड है)। स्रोत

नए कार्य में लगभग 350 मूल वास्तविक-विश्व और संश्लेषित दृश्यों (सार्वजनिक रिपॉजिटरी* का उपयोग करते हुए) से युक्त एक अर्ध-नवीन डेटासेट के निर्माण/संकलन शामिल थे, जिन्हें या तो समर्पित उपकरणों से कैप्चर किया गया था या ओपन सोर्स Blender 3D फ्रेमवर्क के आसपास बने वर्कफ़्लो में सोर्स और पुनः उपयोग किया गया था।

हाइब्रिड वीडियो ऑब्जेक्ट रिमूवल (VOR) डेटासेट EffectErase एप्लिकेशन का आधार बनता है, जो Wan2.1 वीडियो-जनरेशन सिस्टम पर बनाया गया है। सिस्टम दो नए संबंधित बेंचमार्क भी परिभाषित करता है: VOR Eval और VOR Wild – क्रमशः, ग्राउंड ट्रुथ वाले और बिना ग्राउंड ट्रुथ वाले नमूनों के लिए।

(हालांकि पेपर के साथ एक संगत प्रोजेक्ट साइट है, यह कई हाई-रेस वीडियो से काफी अधिक भरी हुई है, और लोड करना कठिन है; इसलिए कृपया ऊपर एम्बेडेड वीडियो में मेरे द्वारा संकलित अंशों का संदर्भ लें, यदि आपको प्रोजेक्ट साइट का उपयोग करना कठिन लगता है)

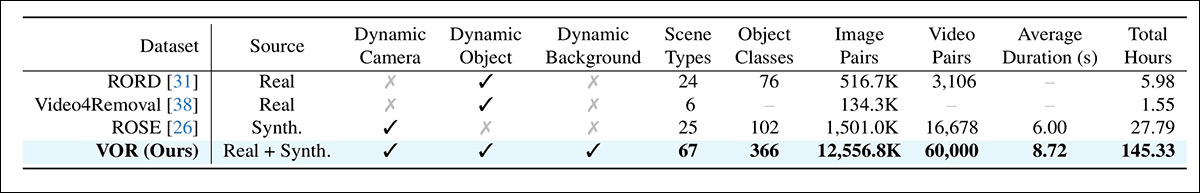

नए प्रस्ताव के संबंध में, तुलनीय पूर्व डेटासेट में मात्राओं की तुलना। स्रोत

शोधकर्ताओं का दावा है कि उनका दृष्टिकोण मात्रात्मक मेट्रिक्स और मानव अध्ययन के माध्यम से निर्णय किए गए गुणात्मक परिणामों दोनों में अत्याधुनिक प्रदर्शन प्रदान करता है।

वे ध्यान देते हैं कि पूर्व के कार्यों ने किसी वस्तु के सहायक प्रभावों, जैसे छाया और प्रतिबिंबों को हटाने में हमेशा सफलता नहीं पाई है, और उनके डेटासेट को इस कमी को दूर करने के लिए सावधानीपूर्वक बनाया गया है:

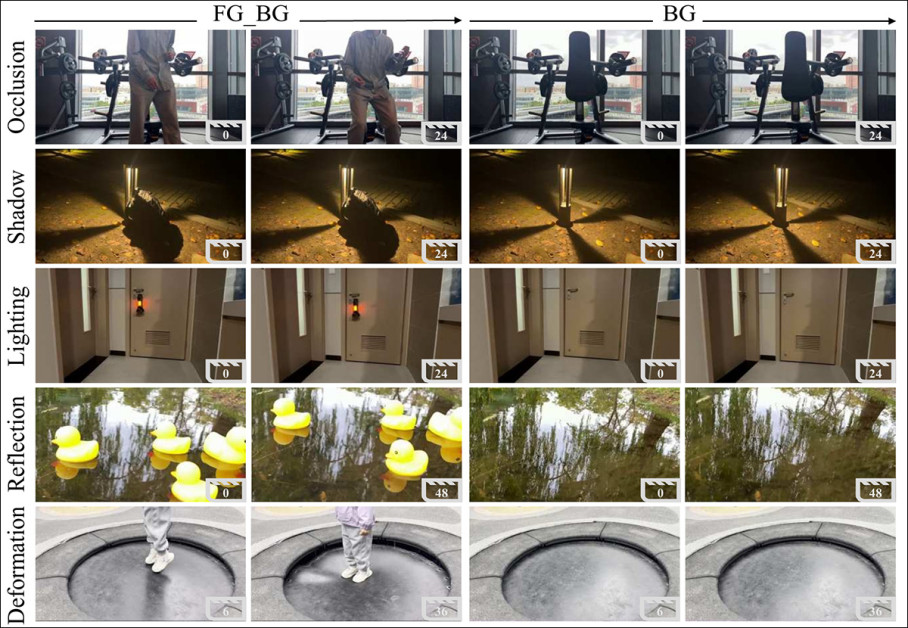

पूर्व के दृष्टिकोणों की विफलता के उदाहरण, जो हटाने के लिए मांगी गई वस्तु से आगे, द्वितीयक संकेतों, जैसे प्रतिबिंबों और छायाओं को देखने में विफल रहे।

नया पेपर का शीर्षक EffectErase: Joint Video Object Removal and Insertion for High-Quality Effect Erasing है, और यह फ़ुडान विश्वविद्यालय के कॉलेज ऑफ कंप्यूटर साइंस एंड आर्टिफिशियल इंटेलिजेंस के चार शोधकर्ताओं से आया है।

विधि

हाइब्रिड VOR डेटासेट को पर्याप्त रूप से विस्तृत परिदृश्यों को शामिल करने के लिए डिज़ाइन किया गया था ताकि वीडियो से किसी व्यक्ति या वस्तु को हटाने के प्रयास के सभी निहितार्थों को कवर किया जा सके:

VOR डेटासेट से युग्मित फ्रेम दर्शाते हैं कि कैसे वस्तु हटाना दृश्यमान विषय से आगे उसके प्रेरित प्रभावों तक विस्तारित होना चाहिए, जिसमें ओक्लूज़न, छाया, प्रकाश परिवर्तन, प्रतिबिंब और भौतिक विरूपण दिखाने वाले उदाहरण हैं, प्रत्येक को इनपुट (वस्तु मौजूद) के रूप में प्रस्तुत किया गया है, साथ ही हटाने के बाद संबंधित स्वच्छ पृष्ठभूमि के साथ। अधिक उदाहरणों के लिए, इस लेख के अंत में एम्बेडेड संगत YouTube वीडियो देखें।

संबोधित किए जाने वाले ‘हस्तक्षेप’ के पांच प्रतिनिधि प्रकारों को लेखकों द्वारा ओक्लूज़न (विभिन्न प्रकार के ग्लास और धुएं के ओक्लूज़न सहित); छाया; प्रकाश व्यवस्था (उदाहरण के लिए, जब हटाई जाने वाली वस्तु प्रकाश का मार्ग बनाती है या बदलती है); प्रतिबिंब; और विरूपण (उदाहरण के लिए, कुशन पर उपयोगकर्ता की छाप, जो व्यक्ति के हटने के बाद नहीं रहनी चाहिए) के रूप में परिभाषित किया गया है।

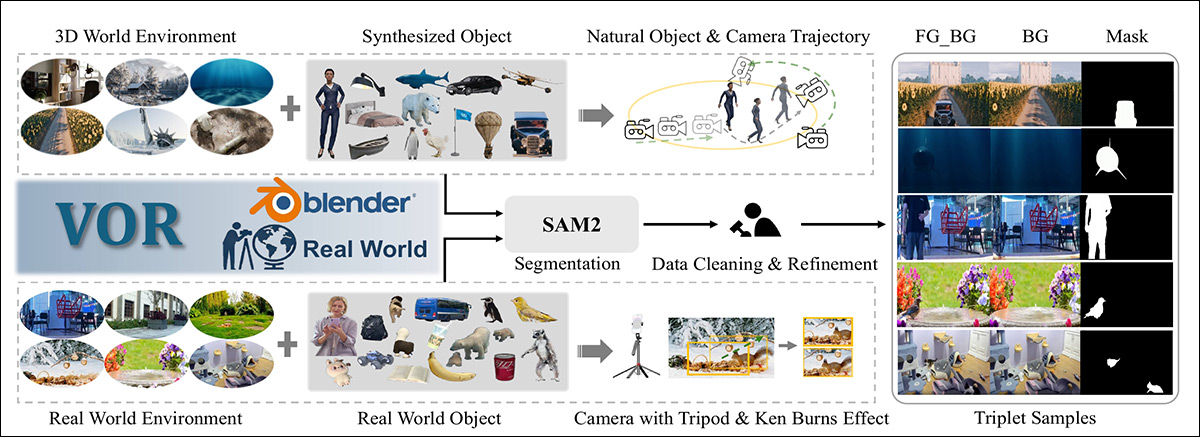

VOR के लिए डेटासेट निर्माण पाइपलाइन, Blender-जनरेटेड सिंथेटिक दृश्यों को वास्तविक-विश्व कैप्चर के साथ जोड़ती है, जहां सिंथेटिक डेटा क्यूरेटेड 3D वातावरण, वस्तुओं और कैमरा प्रक्षेपवक्र से बनाया जाता है, और वास्तविक फुटेज विविध दृश्यों में रिकॉर्ड की जाती है, जिसे Ken Burns मोशन से संवर्धित किया जाता है। SAM2 सेगमेंटेशन और मैन्युअल रिफाइनमेंट तब संबंधित मास्क के साथ संरेखित फोरग्राउंड और बैकग्राउंड वीडियो ट्रिपलेट उत्पन्न करते हैं।

वास्तविक-विश्व के मूल डेटा के लिए, शोधकर्ताओं ने विभिन्न वातावरणों, दिन के समय और मौसम की स्थितियों को कवर करने वाले ‘साथ’ और ‘बिना’ दृश्यों को रिकॉर्ड करने के लिए फिक्स्ड कैमरों का उपयोग किया।

संश्लेषित डेटा के लिए, कई दृष्टिकोण रेंडर किए गए, और बहु-वस्तु परिदृश्य बनाए गए, जिनमें जानबूझकर जटिल और चुनौतीपूर्ण प्रकार के कैमरा मूवमेंट शामिल थे, जैसे कि वास्तविक-विश्व फुटेज में हो सकते हैं; और शोधकर्ता ध्यान देते हैं कि यह दृष्टिकोण अन्यथा समान Remove Objects with Side Effects in Videos (ROSE) डेटासेट के लिए उपयोग की जाने वाली विधि से अधिक परिष्कृत और प्रयासपूर्ण है।

गति विविधता बढ़ाने के लिए, कैमरा-कैप्चर की गई जोड़ियों पर Ken Burns प्रभाव लागू किया गया, चौदह पूर्वनिर्धारित नियमों के तहत नियंत्रित पैन, ज़ूम और हल्के हैंडहेल्ड मूवमेंट जोड़ते हुए, प्रति जोड़ी पांच गति पैटर्न नमूने लिए गए जबकि क्रॉप को मूल फ्रेम के अंदर रखा गया।

पैमाने और विविधता को सिंथेटिक वस्तुओं को कई कैमरा सेटअप के साथ जोड़कर और अधिक विस्तारित किया गया। मास्क मैन्युअल पॉइंट प्रॉम्प्ट को मुख्य फ्रेम पर रखकर, Segment Anything 2 (SAM2) के साथ सेगमेंटेशन को प्रचारित करके, परिणामों को साफ़ और परिष्कृत करके, और प्रशिक्षण के लिए मान्य फोरग्राउंड, बैकग्राउंड और मास्क ट्रिपलेट को असेंबल करके उत्पन्न किए गए।

अंतिम संग्रह 443 दृश्यों में 366 वस्तु वर्गों को कवर करते हुए, वास्तविक और सिंथेटिक, 60,000 युग्मित वीडियो में 145 घंटे के वीडियो तक पहुंचता है।

EffectErase नेटवर्क स्वयं सामग्री को एक वेरिएशनल ऑटो-एनकोडर (VAE†) के माध्यम से ग्रहण करता है, जिसमें अव्यक्त डिनॉइज़िंग Wan2.1 द्वारा संभाली जाती है। इस बैकबोन पर, EffectErase Removal-Insertion Joint Learning संचालित करता है, जो दोनों कार्यों को एक साथ समान क्षेत्रों पर प्रशिक्षित करता है; Task-Aware Region Guidance (TARG), जो वस्तुओं और उनके प्रभावों के बीच स्थानिक-समयिक लिंक को मॉडल करने और कार्य स्विचिं