कृत्रिम बुद्धिमत्ता

ईगल: एक मिश्रण ऑफ एनकोडर्स के साथ मल्टीमॉडल लार्ज लैंग्वेज मॉडल्स के डिज़ाइन स्पेस का अन्वेषण

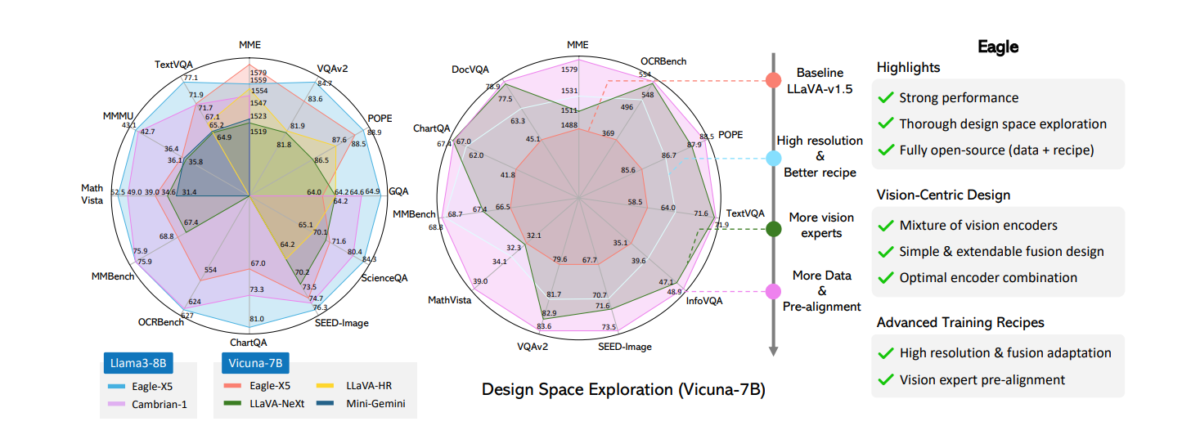

जटिल दृश्य जानकारी की सटीक व्याख्या करने की क्षमता मल्टीमॉडल लार्ज लैंग्वेज मॉडल्स (एमएलएलएम) का एक महत्वपूर्ण फोकस है। हाल के शोध से पता चलता है कि बेहतर दृश्य धारणा हॉलुसिनेशन को कम करती है और रिज़ॉल्यूशन-संवेदनशील कार्यों जैसे ऑप्टिकल चार्टर रिकग्निशन और डॉक्यूमेंट विश्लेषण पर प्रदर्शन में सुधार करती है। कई हाल के एमएलएलएम यह हासिल करने के लिए विज़न एनकोडर्स के मिश्रण का उपयोग करते हैं। इसके बावजूद, विशेषज्ञ चयन और कई विज़न विशेषज्ञों के एकीकरण जैसे महत्वपूर्ण पहलुओं को संबोधित करने वाली व्यवस्थित तुलना और विस्तृत अभिलेशन अध्ययनों की कमी है। यह लेख विज़न एनकोडर्स और रिज़ॉल्यूशन के मिश्रण का उपयोग करके एमएलएलएम के लिए डिज़ाइन स्पेस का व्यापक अन्वेषण प्रदान करता है, ईगल फ्रेमवर्क जो मल्टीमॉडल लार्ज लैंग्वेज मॉडल्स के लिए एनकोडर्स के मिश्रण के साथ डिज़ाइन स्पेस का अन्वेषण करने का प्रयास करता है। निष्कर्ष कई मौजूदा रणनीतियों में सामान्य सिद्धांतों को उजागर करते हैं, जिससे एक सरलीकृत लेकिन प्रभावी डिज़ाइन दृष्टिकोण की ओर जाता है। ईगल यह पता चलता है कि विभिन्न विज़न एनकोडर्स से दृश्य टोकन को सरल रूप से संकेत करना जटिल मिश्रण वास्तुकला या रणनीतियों के रूप में प्रभावी है। इसके अतिरिक्त, ईगल प्री-अलाइनमेंट को विज़न-फोकस्ड एनकोडर्स और भाषा टोकन के बीच की खाई को पुल करने के लिए पेश करता है, मॉडल संगतता में सुधार करता है। परिणामी एमएलएलएम परिवार, ईगल, प्रमुख ओपन-सोर्स मॉडल्स को प्रमुख एमएलएलएम बेंचमार्क पर पार करता है।

ईगल का काम मल्टीमॉडल लार्ज लैंग्वेज मॉडल्स (एमएलएलएम) के सामान्य वास्तुकला डिज़ाइन से संबंधित है। पूर्व में उल्लिखित प्रतिनिधि ओपन-सोर्स शोध की पंक्ति के अलावा, एमएलएलएम के अन्य उल्लेखनीय परिवारों में शामिल हैं, लेकिन सीमित नहीं हैं, मिनी-जीपीटी-4, लिंक्स, ओटर, क्वेनवीएल, कोगवीएलएम, विला, जीपीटी-4वी, जेमिनी और लामा 3.1। विज़न सिग्नल को भाषा मॉडल में कैसे एकीकृत किया जाता है, इसके आधार पर एमएलएलएम को व्यापक रूप से “क्रॉस-मॉडल अटेंशन” मॉडल और “प्रीफिक्स-ट्यूनिंग” मॉडल में वर्गीकृत किया जा सकता है। पूर्व में विभिन्न एलएलएम परतों में क्रॉस-मॉडल अटेंशन का उपयोग करके दृश्य जानकारी को इंजेक्ट किया जाता है, जबकि बाद वाले दृश्य टोकन को पाठ एम्बेडिंग के साथ सीधे अपेंड करके पाठ टोकन अनुक्रम के हिस्से के रूप में मानते हैं। ईगल मॉडल एलएलएवीए-शैली की बहुमोड़ल वास्तुकला का पालन करके प्रीफिक्स-ट्यूनिंग परिवार से संबंधित है। यह देखते हुए कि एमएलएलएम एक तेजी से बढ़ता क्षेत्र है, ईगल आगे के अंतर्दृष्टि के लिए अधिक विस्तृत अध्ययन और सर्वेक्षणों का संदर्भ लेने की सिफारिश करता है।

ईगल का काम एमएलएलएम के लिए विज़न एनकोडर डिज़ाइन में सुधार पर केंद्रित शोध से निकटता से संबंधित है। प्रारंभिक कार्यों ने आमतौर पर विज़न-लैंग्वेज अलाइनमेंट कार्यों जैसे क्लिप और ईवीए-क्लिप पर पूर्व-प्रशिक्षित विज़न एनकोडर्स को अपनाया था। एमएलएलएम के साथ विज़न-भाषा कार्यों को बेहतर बनाने के लिए बेहतर विज़न एनकोडर्स, जैसे सिग्लिप और इंटरनवीएल, का प्रस्ताव किया गया है, जो बेहतर डिज़ाइन, बड़े मॉडल आकार और अधिक प्रभावी प्रशिक्षण नुस्खे के साथ हैं। चूंकि मॉडल अक्सर कम-रिज़ॉल्यूशन छवियों पर पूर्व-प्रशिक्षित होते हैं और महीन विवरण को एन्कोड करने की क्षमता की कमी हो सकती है, उच्च रिज़ॉल्यूशन अनुकूलन को अक्सर एमएलएलएम इनपुट रिज़ॉल्यूशन को बढ़ाने के लिए किया जाता है। उच्च रिज़ॉल्यूशन अनुकूलन के अलावा, मॉडल जैसे एलएलएवीए-नेक्स्ट, एलएलएवीए-यूएचडी, मंकी, इंटरनएलएम-एक्सकंपोज़र और इंटरनवीएल टाइलिंग या अनुकूली टाइलिंग का उपयोग करके उच्च-रिज़ॉल्यूशन इनपुट को संभालने के लिए उपयोग करते हैं, जहां छवियों को निम्न-रिज़ॉल्यूशन पैच में विभाजित किया जाता है और अलग से संसाधित किया जाता है। जबकि उच्च रिज़ॉल्यूशन को संभालने की क्षमता अतिरिक्त विज़न विशेषज्ञों को पेश करके संभव है, यह दृष्टिकोण टाइलिंग तकनीकों से थोड़ा भिन्न है, हालांकि दोनों संगत हैं और संयुक्त किए जा सकते हैं।

ईगल: मल्टीमॉडल एलएलएम के लिए मिश्रण ऑफ एनकोडर्स का उपयोग करके डिज़ाइन स्पेस का अन्वेषण

बड़े भाषा मॉडल (एलएलएम) की सफलता ने उनकी दृश्य धारण क्षमताओं को सक्षम करने में महत्वपूर्ण रुचि पैदा की है, जिससे वे वास्तविक दुनिया में देख सकते हैं, समझ सकते हैं और तर्क कर सकते हैं। इन मल्टीमॉडल लार्ज लैंग्वेज मॉडल्स (एमएलएलएम) के मूल में एक विशिष्ट डिज़ाइन है जहां छवियों को विज़न एनकोडर्स द्वारा दृश्य टोकन की एक श्रृंखला में परिवर्तित किया जाता है और पाठ एम्बेडिंग के साथ जोड़ा जाता है। क्लिप अक्सर विज़न एनकोडर के रूप में चुना जाता है क्योंकि इसका दृश्य प्रतिनिधित्व पाठ स्थान के साथ पूर्व-प्रशिक्षित छवि-पाठ जोड़े पर पूर्व-प्रशिक्षित किया जाता है। वास्तुकला, प्रशिक्षण नुस्खे और विज़न टोकन को भाषा मॉडल में इंजेक्ट करने के तरीके के आधार पर, एमएलएलएम के उल्लेखनीय परिवारों में फ्लेमिंगो, ब्लिप, पाली, पाल्म-ई और एलएलएवीए शामिल हैं। इनमें से अधिकांश मॉडल अपेक्षाकृत कम इनपुट रिज़ॉल्यूशन बनाए रखते हैं जो पूर्व-प्रशिक्षित विज़न एनकोडर्स और एलएलएम अनुक्रम लंबाई में सीमाओं के कारण होता है। ईगल का काम उन मॉडल्स से जुड़ा हुआ है जो बेहतर धारणा के लिए कई विज़न एनकोडर्स का उपयोग करते हैं। मिनी-जेमिनी और एलएलएवीए-एचआर उच्च-रिज़ॉल्यूशन विज़ुअल विशेषताओं को कम-रिज़ॉल्यूशन दृश्य टोकन में मिलाने का प्रस्ताव करते हैं। रिज़ॉल्यूशन मुद्दों से परे, ये पूर्व-प्रशिक्षित विज़न एनकोडर्स विशिष्ट क्षमताओं की कमी हो सकती है, जैसे कि पाठ पढ़ना या वस्तुओं का स्थानीयकरण। इसे संबोधित करने के लिए, विभिन्न मॉडल विभिन्न विज़न कार्यों पर पूर्व-प्रशिक्षित विज़न एनकोडर्स को एकीकृत करते हैं ताकि विज़न एनकोडर की क्षमताओं को बढ़ाया जा सके।

उदाहरण के लिए, मॉडल जैसे माउसी और ब्रेव विभिन्न विज़न एनकोडर्स से दृश्य टोकन को चैनल या टोकन दिशा में संकेत करके मिलाते हैं। रेडियो एक एकल मॉडल में विभिन्न विज़न एनकोडर्स की क्षमताओं को एकजुट करने के लिए एक बहु-शिक्षक ज्ञान अंतर्ग्रहण विधि पेश करता है। मोएआई, आईवीई और प्रिज़्मेर विज़न विशेषज्ञों के आउटपुट का उपयोग करके अतिरिक्त जानकारी को पूरक करने के लिए एमएलएलएम को उत्तर प्रदान करते हैं, जैसे कि ओसीआर, पता लगाने या गहराई अनुमान। मोवा एक दिए गए छवि और निर्देशों के आधार पर एक अनुकूल विज़न मॉडल को असाइन करने के लिए एक मार्ग नेटवर्क का आविष्कार करता है।

हाल के अध्ययनों से पता चलता है कि एमएलएलएम हॉलुसिनेशन को कम करने और रिज़ॉल्यूशन-संवेदनशील कार्यों जैसे ऑप्टिकल चार्टर रिकग्निशन (ओसीआर) पर प्रदर्शन में सुधार करने के लिए मजबूत विज़न एनकोडर डिज़ाइन महत्वपूर्ण हैं। कई कार्य विज़न एनकोडर की क्षमता में सुधार पर केंद्रित हैं, या तो पूर्व-प्रशिक्षित डेटा और पैरामीटर को स्केल करना या छवियों को निम्न-रिज़ॉल्यूशन पैच में विभाजित करना। हालांकि, ये दृष्टिकोण अक्सर बड़े प्रशिक्षण संसाधनों की मांग करते हैं। एक कुशल लेकिन शक्तिशाली रणनीति विभिन्न कार्यों और इनपुट रिज़ॉल्यूशन के साथ पूर्व-प्रशिक्षित विज़ुअल एनकोडर्स को मिलाना है, जैसे कि सीएलआईपी एनकोडर के साथ उच्च-रिज़ॉल्यूशन एनकोडर्स को मिलाना, विभिन्न एनकोडर्स से सुविधाओं को क्रमिक रूप से जोड़ना, या अधिक जटिल मिश्रण और मार्गदर्शन रणनीतियों को अपनाना। यह “मिश्रण-ऑफ-विज़न-एक्सपर्ट्स” दृष्टिकोण प्रभावी साबित हुआ है, हालांकि इसके डिज़ाइन स्पेस का विस्तृत अध्ययन अभी भी कमी है, जो ईगल को इस क्षेत्र में पुनः अन्वेषण करने के लिए प्रेरित करता है। मुख्य प्रश्न बने रहते हैं: कौन से विज़न एनकोडर संयोजन चुनने हैं, विभिन्न विशेषज्ञों को कैसे मिलाना है, और विज़न एनकोडर्स के साथ प्रशिक्षण रणनीतियों को कैसे समायोजित करना है।

इन प्रश्नों का समाधान करने के लिए, ईगल विज़न एनकोडर्स और रिज़ॉल्यूशन के मिश्रण का उपयोग करके एमएलएलएम के लिए डिज़ाइन स्पेस की व्यवस्थित जांच करता है। इस डिज़ाइन स्पेस का अन्वेषण निम्नलिखित चरणों में शामिल है: 1) विभिन्न विज़न एनकोडर्स का बेंचमार्किंग और उच्च-रिज़ॉल्यूशन अनुकूलन के लिए खोज; 2) विज़न एनकोडर फ्यूजन रणनीतियों के बीच “सेब के साथ सेब” तुलना; 3) कई विज़न एनकोडर्स के ऑप्टिमल संयोजन की प्रगतिशील पहचान; 4) विज़न विशेषज्ञ पूर्व-संरेखण और डेटा मिश्रण में सुधार। अन्वेषण चरण निम्नलिखित छवि में चित्रित किए गए हैं।

ईगल का अध्ययन विभिन्न कार्यों और रिज़ॉल्यूशन पर पूर्व-प्रशिक्षित विज़न एनकोडर्स के प्रदर्शन को कवर करता है, जैसे कि विज़न-लैंग्वेज अलाइनमेंट, स्व-पर्यवेक्षित शिक्षा, पता लगाना, सेगमेंटेशन, और ओसीआर। एक राउंड-रोबिन दृष्टिकोण का उपयोग करते हुए, ईगल बुनियादी सीएलआईपी एनकोडर से शुरू होता है और प्रत्येक राउंड में एक अतिरिक्त विशेषज्ञ जोड़ता है, जो प्रत्येक राउंड में सबसे अच्छा सुधार प्रदान करता है।

जबकि ईगल का काम एमएलएलएम में कई विज़न एनकोडर्स का लाभ उठाने वाला पहला नहीं है, व्यवस्थित अध्ययन कई महत्वपूर्ण निष्कर्षों की ओर जाता है:

- एमएलएलएम प्रशिक्षण के दौरान विज़न एनकोडर्स को अनलॉक करना महत्वपूर्ण है। यह एलएलएवीए और अन्य मॉडलों के विपरीत है, जो कई विज़न एनकोडर्स या शिक्षकों का उपयोग करते हैं, जहां विज़न एनकोडर्स को जमाना एक सामान्य अभ्यास रहा है।

- कुछ हाल ही में प्रस्तावित फ्यूजन रणनीतियों में महत्वपूर्ण लाभ नहीं दिखते हैं। इसके बजाय, सीधा चैनल संकेत एक सरल लेकिन प्रतिस्पर्धी फ्यूजन रणनीति के रूप में उभरता है, जो सर्वोत्तम कुशलता और प्रदर्शन प्रदान करता है।

- अतिरिक्त विज़न विशेषज्ञों को शामिल करने से निरंतर लाभ होता है। यह एमएलएलएम धारणा को व्यवस्थित रूप से बढ़ाने के लिए एक आशाजनक मार्ग है, एकल एनकोडर्स को स्केल करने के अलावा। सुधार विशेष रूप से तब महत्वपूर्ण होता है जब विज़न एनकोडर्स अनलॉक होते हैं।

- प्री-अलाइनमेंट चरण महत्वपूर्ण है। ईगल एक प्री-अलाइनमेंट चरण पेश करता है, जहां गैर-पाठ-संरेखित विज़न विशेषज्ञों को एक जमे हुए एलएलएम के साथ व्यक्तिगत रूप से फ़ाइन-ट्यून किया जाता है और फिर एक साथ प्रशिक्षित किया जाता है। यह चरण मिश्रण-ऑफ-विज़न-एनकोडर डिज़ाइन के तहत एमएलएलएम प्रदर्शन में काफी सुधार करता है।

ईगल: विधि और वास्तुकला

पिछले तरीकों के विपरीत जो विज़न एनकोडर्स के बीच नए फ्यूजन परिदृश्य या वास्तुकला पर केंद्रित हैं, ईगल का लक्ष्य विभिन्न विज़न एनकोडर्स को मिलाने के लिए एक न्यूनतम डिज़ाइन की पहचान करना है, जो विस्तृत अभिलेशन और अनावश्यक घटकों को हटाने के साथ समर्थित है। जैसा कि निम्नलिखित आंकड़े में दिखाया गया है, ईगल बुनियादी सीएलआईपी एनकोडर को विभिन्न वास्तुकला, पूर्व-प्रशिक्षित कार्यों और रिज़ॉल्यूशन के साथ विज़न विशेषज्ञों के एक सेट में विस्तारित करता है। इन विशेषज्ञों के साथ, ईगल विभिन्न फ्यूजन वास्तुकला और विधियों की तुलना करता है और विभिन्न एनकोडर्स के साथ प्रशिक्षण रणनीतियों को अनुकूलित करने का अन्वेषण करता है।

अंत में, ईगल अपने निष्कर्षों को एकत्र करता है और दृष्टिकोण को विभिन्न रिज़ॉल्यूशन और डोमेन ज्ञान के साथ कई विज़न एनकोडर्स में विस्तारित करता है। एलएलएवीए-1.5 के समान पूर्व-प्रशिक्षित डेटा का उपयोग करते हुए, जो 595k छवि-पाठ जोड़े से बना है, ईगल पर्यवेक्षित फ़ाइन-ट्यूनिंग चरण में आगे बढ़ता है और डेटा को एक श्रृंखला कार्यों से इकट्ठा करता है और इसे मल्टीमॉडल बातचीत में परिवर्तित करता है, जिसमें एलएलएवीए-1.5, लायोन-जीपीटी4वी, शेयरजीपीटी-4वी, डॉकवीक्यूए, सिंडॉग-ईएन, चार्टक्यूए, डीवीक्यूए और एआई2डी शामिल हैं, जिसके परिणामस्वरूप 934k नमूने होते हैं।

मॉडल को पहले छवि-पाठ जोड़ों के साथ एक पूर्व-प्रशिक्षित किया जाता है एक पूर्व-प्रशिक्षित के लिए बैच आकार के साथ 256, जहां पूरे मॉडल जमे हुए हैं, और केवल परियोजना परत को अद्यतन किया जाता है। दूसरे चरण में, मॉडल को पर्यवेक्षित फ़ाइन-ट्यूनिंग डेटा पर एक पूर्व-प्रशिक्षित किया जाता है एक पूर्व-प्रशिक्षित के लिए बैच आकार के साथ 128। इस अन्वेषण के लिए, ईगल विकुना-7बी को अंतर्निहित भाषा मॉडल के रूप में नियुक्त करता है। सीखने की दरें पहले चरण के लिए 1e-3 और दूसरे चरण के लिए 2e-5 निर्धारित की जाती हैं।

मजबूत सीएलआईपी एनकोडर

ईगल सीएलआईपी मॉडल के साथ अन्वेषण शुरू करता है, क्योंकि यह कई एमएलएलएम के लिए प्राथमिक विकल्प बन गया है। जबकि सीएलआईपी मॉडल मल्टीमॉडल कार्यों को बढ़ाने में जाने जाते हैं, उनकी सीमाएं भी अच्छी तरह से प्रलेखित हैं। उदाहरण के लिए, कई मौजूदा एमएलएलएम सीएलआईपी पूर्व-प्रशिक्षित रिज़ॉल्यूशन (जैसे 224 × 224 या 336 × 336) का उपयोग अपने इनपुट रिज़ॉल्यूशन के रूप में करते हैं। इन मामलों में, एनकोडर्स अक्सर रिज़ॉल्यूशन-संवेदनशील कार्यों जैसे ओसीआर और डॉक्यूमेंट समझने के लिए महत्वपूर्ण महीन विवरण को पकड़ने में संघर्ष करते हैं।

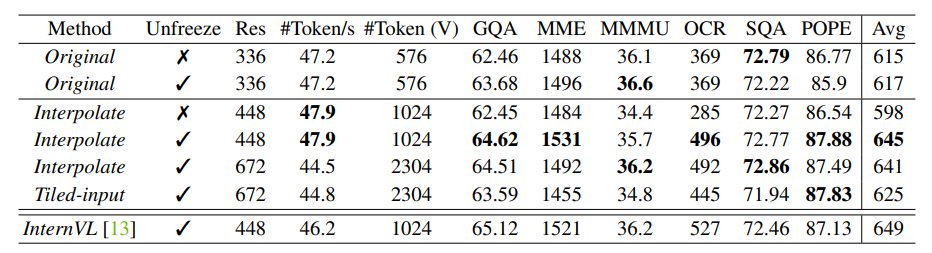

इनपुट रिज़ॉल्यूशन को बढ़ाने के लिए, एक सामान्य दृष्टिकोण टाइलिंग है, जहां इनपुट छवियों को टाइल्स में विभाजित किया जाता है और अलग से संसाधित किया जाता है। एक और सरल विधि सीधे इनपुट रिज़ॉल्यूशन को स्केल अप करना और यदि आवश्यक हो तो विज़न ट्रांसफॉर्मर मॉडल के स्थिति एम्बेडिंग को इंटरपोलेट करना है। ईगल इन दोनों दृष्टिकोणों की तुलना करता है, जमे हुए और अनलॉक विज़न एनकोडर्स के साथ विभिन्न रिज़ॉल्यूशन पर, और परिणाम निम्नलिखित तालिका में शामिल हैं। निष्कर्षों को इस प्रकार सारांशित किया जा सकता है:

- सीएलआईपी एनकोडर को अनलॉक करने से सीएलआईपी पूर्व-प्रशिक्षित रिज़ॉल्यूशन से भिन्न उच्च एमएलएलएम इनपुट रिज़ॉल्यूशन पर महत्वपूर्ण सुधार होता है, बिना प्रदर्शन में गिरावट के, जब रिज़ॉल्यूशन समान रहते हैं।

- सीएलआईपी एनकोडर को जमाना और सीधे इसे उच्च एमएलएलएम इनपुट रिज़ॉल्यूशन में अनुकूलित करने से प्रदर्शन पर महत्वपूर्ण नकारात्मक प्रभाव पड़ता है।

- तुलना की जा रही रणनीतियों के बीच, 448 × 448 तक सीधे इंटरपोलेट करना एक अनलॉक किए गए सीएलआईपी एनकोडर के साथ प्रदर्शन और लागत दोनों के मामले में प्रभावी और कुशल साबित होता है।

- सर्वोत्तम सीएलआईपी एनकोडर इंटरनवीएल के प्रदर्शन के करीब है, जो एक बहुत छोटा मॉडल है (300मी बनाम 6बी) और कम पूर्व-प्रशिक्षित डेटा के साथ।

यह ध्यान देने योग्य है कि सीएलआईपी-448 ईगल को एलएलएवीए-एचआर और इंटरनवीएल के साथ सेटिंग का मिलान करने की अनुमति देता है, जहां सीएलआईपी एनकोडर्स को इसी तरह 448 × 448 इनपुट लेने और 1024 पैच टोकन का आउटपुट देने के लिए अनुकूलित किया जाता है। आगे की जांच के लिए, ईगल इस सरल रणनीति का पालन करता है जो इनपुट रिज़ॉल्यूशन को स्केल अप करता है और प्रशिक्षण के दौरान विज़न एनकोडर को अनलॉक करता है।

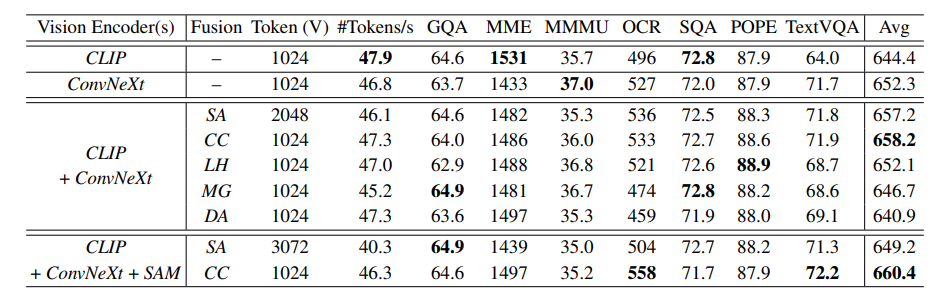

ईगल यह देखता है कि मौजूदा लोकप्रिय फ्यूजन रणनीतियों, उनके डिज़ाइन भिन्नताओं के बावजूद, निम्नलिखित श्रेणियों में वर्गीकृत की जा सकती हैं:

- सीक्वेंस अपेंड: विभिन्न बैकबोन से दृश्य टोकन को सीधे एक लंबी श्रृंखला के रूप में जोड़ना।

- चैनल कॉन्केटेनेशन: चैनल आयाम में दृश्य टोकन को जोड़ना, श्रृंखला की लंबाई को बढ़ाए बिना।

- एलएलएवीए-एचआर: एक मिश्रण-ऑफ-रिज़ॉल्यूशन एडाप्टर का उपयोग करके निम्न-रिज़ॉल्यूशन विज़न एनकोडर्स में उच्च-रिज़ॉल्यूशन विशेषताओं को इंजेक्ट करना।

- मिनी-जेमिनी: एक उच्च-रिज़ॉल्यूशन विज़न एनकोडर में निम्न-रिज़ॉल्यूशन विज़न एनकोडर्स के सीएलआईपी टोकन को क्रॉस-एटेंड करना।

- डिफॉर्मेबल अटेंशन: मिनी-जेमिनी पर एक नया बेसलाइन, जहां वैनिला विंडो अटेंशन को डिफॉर्मेबल अटेंशन से बदल दिया जाता है।

इसके बजाय एलएलएवीए की मूल पूर्व-प्रशिक्षित रणनीति में एक ही समय में कई विज़न विशेषज्ञों को संरेखित करने के लिए एक परियोजना को प्रशिक्षित करने के, हम पहले प्रत्येक व्यक्तिगत विशेषज्ञ को एक छोटे भाषा मॉडल (विकुना-7बी का अभ्यास में) के साथ अपने स्वयं के परियोजना पर अगले टोकन की भविष्यवाणी पर्यवेक्षण का उपयोग करके प्रशिक्षित करते हैं। जैसा कि निम्नलिखित आंकड़े में दिखाया गया है, पूर्व-संरेखण के साथ, पूरे प्रशिक्षण प्रक्रिया में तीन चरण शामिल हैं: 1) प्रत्येक पूर्व-प्रशिक्षित विज़न विशेषज्ञ को अपने परियोजना पर एसएफटी डेटा पर प्रशिक्षित करना, जबकि भाषा मॉडल जमे हुए रहता है; 2) पहले चरण से सभी विज़न विशेषज्ञों को जोड़ना और केवल परियोजना को छवि-पाठ जोड़े डेटा पर प्रशिक्षित करना; 3) पूरे मॉडल को एसएफटी डेटा पर प्रशिक्षित करना।

ईगल: प्रयोग और परिणाम

अपनी रणनीतियों को विकसित करने के बाद, ईगल ने मॉडल के लिए निम्नलिखित सिद्धांतों की स्थापना की है: (1) अनुकूलित प्रशिक्षण नुस्खे के साथ कई विज़न विशेषज्ञों को एकीकृत करना; (2) विभिन्न विज़न विशेषज्ञों को सीधे चैनल संकेत के माध्यम से जोड़ना; (3) विज़न विशेषज्ञों को अलग से पूर्व-संरेखण के माध्यम से प्रशिक्षित करना। इस खंड में, ईगल मॉडल्स के फायदों को आगे साबित करने के लिए, अतिरिक्त प्रशिक्षण डेटा शामिल किया जाता है और विभिन्न कार्यों पर वर्तमान राज्य-ऑफ-द-आर्ट एमएलएलएम के खिलाफ तुलना की जाती है। ईगल विकुना-वी1.5-7बी, लामा3-8बी और विकुना-वी1.5-13बी को भाषा मॉडल के रूप में उपयोग करता है। विज़न एनकोडर्स के लिए, खंड 2.6 में परिणामों के आधार पर, ईगल मॉडल्स को ईगल-एक्स4 के रूप में चिह्नित किया जाता है, जिसमें चार विज़न एनकोडर्स शामिल हैं: सीएलआईपी, कॉनवनेक्सट, पिक्स2स्ट्रक्ट और ईवीए-02, और ईगल-एक्स5, जिसमें एक अतिरिक्त एसएएम विज़न एनकोडर शामिल है।

विज़ुअल प्रश्न उत्तर देने वाले कार्य

ईगल तीन विज़ुअल प्रश्न उत्तर देने वाले बेंचमार्क पर मॉडल श्रृंखला की तुलना करता है, जिनमें जीक्यूए, वीक्यूएवी2 और विज़विज़ शामिल हैं। जैसा कि निम्नलिखित तालिका में दिखाया गया है, ईगल-एक्स5 जीक्यूए और वीक्यूएवी2 पर राज्य-ऑफ-द-आर्ट प्रदर्शन हासिल करता है, कई विज़न विशेषज्ञों को शामिल करने के फायदों को उजागर करता है।

ओसीआर और चार्ट समझने वाले कार्य

ईगल की ओसीआर, डॉक्यूमेंट और चार्ट समझने की क्षमताओं का मूल्यांकन करने के लिए, मॉडल को ओसीआरबेंच, टेक्स्टवीक्यूए और चार्टक्यूए पर बेंचमार्क किया जाता है। जैसा कि ऊपर दी गई तालिका में दिखाया गया है, ईगल टेक्स्टवीक्यूए पर प्रतियोगियों को महत्वपूर्ण रूप से पार करता है, इसकी उच्च-रिज़ॉल्यूशन वास्तुकला और विभिन्न विज़न एनकोडर्स के एकीकरण से लाभान्वित होता है। उल्लेखनीय रूप से, ईगल एक सरल डिज़ाइन बनाए रखता है, जो 1024 टोकन तक का समर्थन करता है बिना जटिल टाइल विभाजन की आवश्यकता के।

निम्नलिखित आंकड़े ओसीआर और डॉक्यूमेंट समझने वाले मामलों के उदाहरण प्रस्तुत करते हैं। उच्च-रिज़ॉल्यूशन अनुकूलन और विभिन्न विज़न एनकोडर्स के एकीकरण के साथ, ईगल छवियों के भीतर छोटे पाठ की पहचान कर सकता है और उपयोगकर्ता निर्देशों के आधार पर सटीक रूप से जानकारी निकाल सकता है।

विभिन्न दृष्टिकोण कार्यों पर पूर्व-प्रशिक्षित विज़न विशेषज्ञों को पेश करने के लाभों को बेहतर ढंग से समझने के लिए, निम्नलिखित आंकड़े केवल कॉनवनेक्सट और सीएलआईपी विज़न एनकोडर्स वाले मॉडल के परिणामों को दिखाते हैं, ईगल-एक्स5 के परिणामों की तुलना में। पूरे विज़न एनकोडर्स के सेट के साथ, मॉडल सफलतापूर्वक त्रुटियों को सुधारता है, यह प्रदर्शित करता है कि उच्च-रिज़ॉल्यूशन विज़न एनकोडर्स के साथ-साथ विभिन्न दृष्टिकोण कार्यों पर पूर्व-प्रशिक्षित विज़न विशेषज्ञों को एकीकृत करने से ईगल की क्षमताओं में और सुधार होता है।

मल्टीमॉडल बेंचमार्क मूल्यांकन

ईगल का मूल्यांकन एमएलएलएम के लिए सात बेंचमार्क पर किया जाता है ताकि विभिन्न दृष्टिकोणों से इसकी क्षमताओं का प्रदर्शन किया जा सके, जिनमें एमएमई, एमएमबेंच, सीड, मैथविस्टा, एमएमएमयू, साइंसक्यूए और पीओपीई शामिल हैं। विशेष रूप से, एमएमई, एमएमबेंच और सीड वास्तविक दुनिया के कार्यों पर समग्र प्रदर्शन का मूल्यांकन करते हैं जो तर्क, पहचान, ज्ञान और ओसीआर को शामिल करते हैं। एमएमएमयू जटिल समस्याओं पर कॉलेज स्तर के ज्ञान की आवश्यकता वाले विविध डोमेन से समस्याओं पर केंद्रित है। पीओपीई एमएलएलएम के दृश्य हॉलुसिनेशन का मूल्यांकन करता है। इस मूल्यांकन में उपयोग किए जाने वाले मेट्रिक्स इन बेंचमार्क की डिफ़ॉल्ट सेटिंग्स का पालन करते हैं। ईगल एमएमई के लिए धारणा स्कोर, एमएमबेंच के लिए एन_डेव स्प्लिट, सीड के लिए छवि स्प्लिट, मैथविस्टा के लिए टेस्ट-मिनी स्प्लिट, एमएमएमयू के लिए वैल स्प्लिट, पीओपीई के लिए एफ1-स्कोर और साइंसक्यूए के लिए छवि स्कोर की रिपोर्ट करता है, अन्य मॉडल्स से रिपोर्ट किए गए स्कोर के साथ संरेखण सुनिश्चित करता है।

अंतिम विचार

इस लेख में, हमने ईगल के बारे में बात की है, जो मल्टीमॉडल लार्ज लैंग्वेज मॉडल्स में विज़न एनकोडर्स के एकीकरण के लिए डिज़ाइन स्पेस का एक गहन विश्लेषण है। पिछले कार्यों के विपरीत जो नए फ्यूजन परिदृश्य या वास्तुकला पर केंद्रित हैं, ईगल यह पता चलता है कि व्यवस्थित डिज़ाइन विकल्प महत्वपूर्ण हैं और कई उपयोगी तकनीकों की खोज करता है। चरणबद्ध तरीके से, ईगल व्यक्तिगत विज़न एनकोडर्स के प्रशिक्षण नुस्खे को अनुकूलित करता है, एक विस्तार योग्य और कुशल फ्यूजन विधि की पहचान करता है, और विभिन्न डोमेन ज्ञान के साथ विज़न एनकोडर्स को逐渐 जोड़ता है। परिणाम डिज़ाइन स्पेस में मूलभूत विचारों के महत्व को रेखांकित करते हैं।