Anderson का एंगल

जिगसॉ पज़ल्स बूस्ट एआई विज़ुअल रीज़निंग

नया शोध संकेत देता है कि एआई मॉडल जिगसॉ पज़ल्स को हल करके देखने में अधिक चतुर हो सकते हैं। छवियों, वीडियो और 3डी दृश्यों को पुनर्व्यवस्थित करके उन्हें अतिरिक्त डेटा, लेबल या टूल्स की आवश्यकता के बिना अपने दृश्य कौशल को तेज करने में मदद मिलती है।

वर्तमान में मल्टीमॉडल लार्ज लैंग्वेज मॉडल्स (एमएलएलएमएस*) को आगे बढ़ाने के लिए होड़ में, कुछ आसान जीत और कोई मुफ्त भोजन नहीं हैं।

हालांकि 2025 के कई प्रभावशाली चीनी फॉस रिलीज़ को कम विकास और चलने की लागत होने की सूचना मिली है, पश्चिमी रिलीज़ अक्सर समस्या पर अधिक डेटा वॉल्यूम, अधिक अनुमान गणना, अधिक बिजली (हालांकि नहीं, जैसा कि हम हाल ही में उल्लेख किया है, वास्तविक मानव अनnotators, क्योंकि यह भी महंगा है) फेंकते हैं।

शोध साहित्य में, अधिकांश कथित ‘मुफ्त’ दृष्टिकोण एआई वास्तुकला के विकास में केवल छोटे सुधार प्रदान करते हैं; या फिर उन क्षेत्रों में सुधार होता है जो सबसे गंभीर रूप से पीछा किए जा रहे हैं। फिर भी, हitherto अनखोजे ‘मौलिक सिद्धांतों’ की खोज जो विकास की गति को तेज कर सकती है, छोड़ने के लिए बहुत आकर्षक है।

पीस उठाना

जबकि यह ठीक उस श्रेणी में नहीं है, एक新的 अकादमिक सहयोग चीनी संस्थानों के बीच दावा करता है कि वीएलएमएस जिगसॉ पज़ल्स को हल करने से उनके प्रदर्शन में उल्लेखनीय सुधार होता है, भले ही यह सुदृढ़ सीखने दृष्टिकोण ने पहले इस क्षेत्र में कम प्रदर्शन किया हो, और भले ही इसके लिए कोई अतिरिक्त प्रणाली, सहायक मॉडल या अन्य ‘बोल्ट-ऑन’ प्रक्रियाओं की आवश्यकता नहीं है:

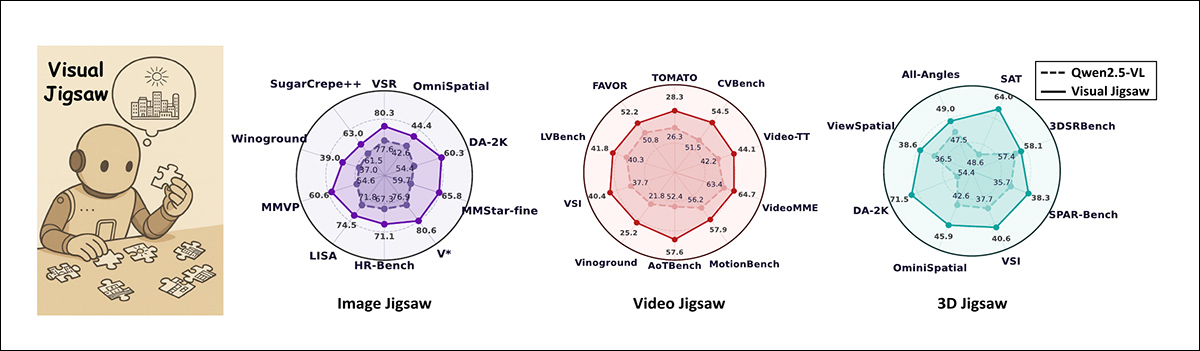

विज़ुअल जिगसॉ एक स्व-पर्यवेक्षित पोस्ट-ट्रेनिंग फ्रेमवर्क है जो मल्टीमॉडल लार्ज लैंग्वेज मॉडल्स में दृष्टि-केंद्रित कौशल में सुधार करता है। छवियों, वीडियो और 3डी डेटा पर जिगसॉ कार्यों के प्रशिक्षण से, मॉडल में छवियों में तीक्ष्ण विस्तृत, स्थानिक और संरचनात्मक धारणा प्राप्त होती है, वीडियो में समयिक अनुक्रम और घटना क्रम के बारे में तर्कशक्ति में सुधार होता है, और 3डी दृश्यों में ज्यामिति-जागरूक समझ में वृद्धि होती है। ऊपर दिए गए रडार चार्ट में सुसंगत लाभ दिखाए गए हैं, जो बेस क्यूवेन2.5-वीएल के साथ तुलना में हैं, जिसमें प्रत्येक बेंचमार्क के लिए मान स्केल को स्पष्टता के लिए समायोजित किया गया है। स्रोत: https://arxiv.org/pdf/2509.25190

शोधकर्ताओं द्वारा विकसित प्रणाली को विज़ुअल जिगसॉ कहा जाता है, और इसमें मौजूदा एमएलएलएमएस को टुकड़ों में तोड़े गए और यादृच्छिक रूप से वितरित किए गए सामग्री पर प्रशिक्षित किया जाता है, जैसे कि एक जिगसॉ पज़ल। लेखकों ने इस दृष्टिकोण के लिए तीन मोडलिटी विकसित की: छवि, वीडियो और 3डी (अर्थात, सीजीआई-शैली मेश), और पाया कि एक मध्यम अनुकूलन इसी प्रक्रिया के तीनों डोमेन में लाभकारी था:

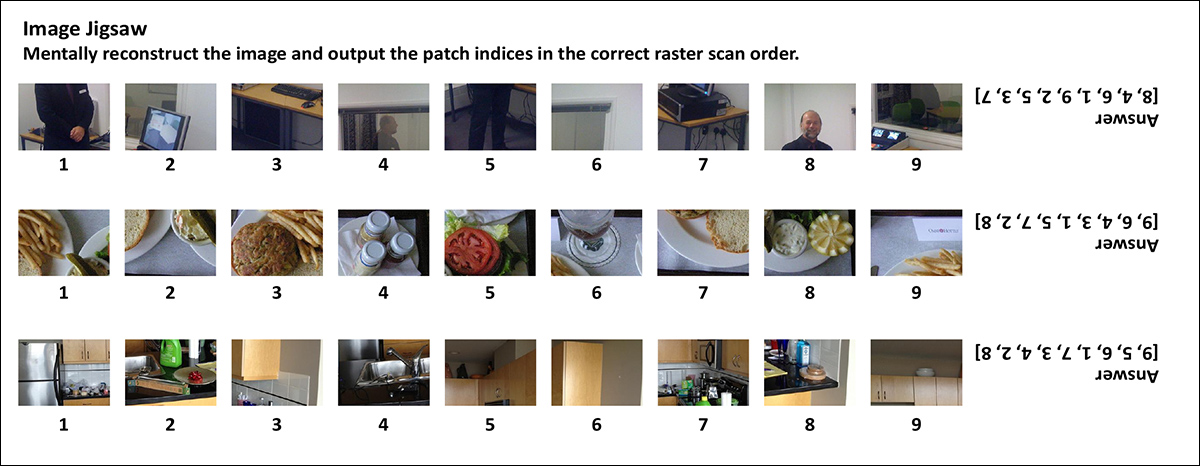

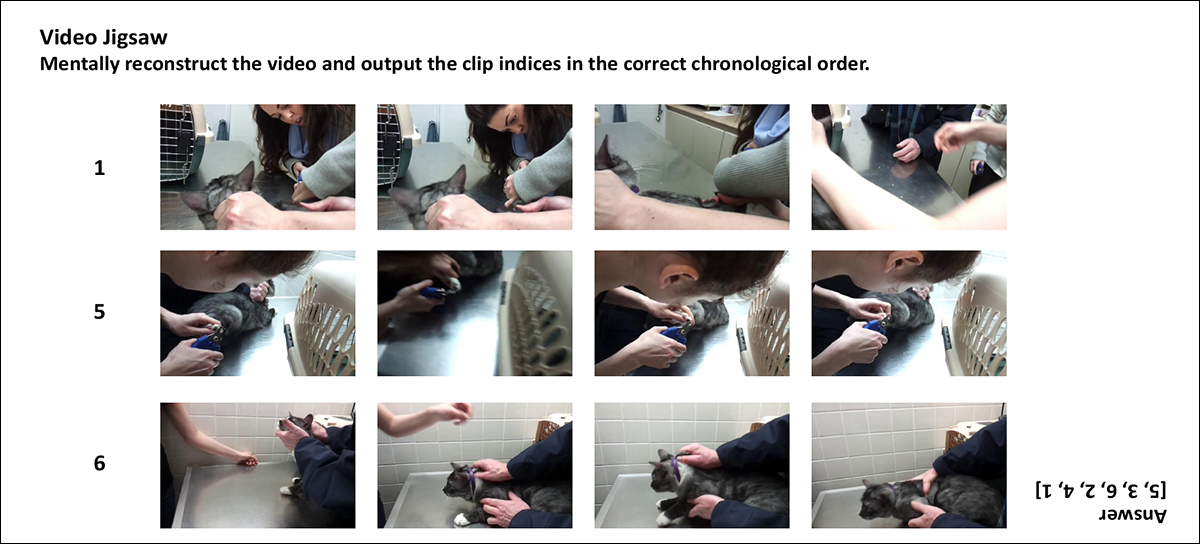

विज़ुअल जिगसॉ कार्यों का एक प्रतिनिधित्व। इमेज जिगसॉ में, एक छवि को पैच में विभाजित किया जाता है, मिलाया जाता है, और मॉडल सही लेआउट की भविष्यवाणी करता है; वीडियो जिगसॉ में, क्लिप मिलाए जाते हैं और मॉडल समय में उनका क्रम बहाल करता है; 3डी जिगसॉ में, विभिन्न गहराई के बिंदुओं को मिलाया जाता है और मॉडल उन्हें निकटतम से दूर तक रैंक करता है। मॉडल आउटपुट को ग्राउंड ट्रुथ के खिलाफ स्कोर किया जाता है, जिसमें आंशिक रूप से सही समाधानों के लिए आंशिक क्रेडिट दिया जाता है।

विज़ुअल जिगसॉ के प्रशिक्षण तरीके एआई मॉडल को दृश्य जानकारी को समझने में सुधार करने में मदद करते हैं जो इन जumbled-अप छवियों, वीडियो क्लिप या 3डी डेटा बिंदुओं को पुनर्संयोजित करके उन्हें करते हैं।

प्रक्रिया छवियों पर नहीं, बल्कि शब्दों पर आधारित है, और इसलिए मॉडल को छवियों को उत्पन्न करने या किसी अतिरिक्त दृश्य घटक का उपयोग करने की आवश्यकता नहीं है। यह तरीका वेरिफाइड रिवार्ड्स से सुदृढ़ सीखने (आरएलवीआर) नामक एक प्रणाली में फिट होता है, जहां मॉडल को स्पष्ट, स्वचालित नियमों के आधार पर सही उत्तरों के लिए पुरस्कृत किया जाता है; और जहां, इसलिए, मानव लेबलिंग की आवश्यकता नहीं है।

यह महत्वपूर्ण तथ्य वास्तव में नए पत्र से कठिन है: कि प्रणाली सेमैंटिक रूप से पहेली को इकट्ठा कर रही है, विवरण के माध्यम से, और न कि उस आकार-प्रतिनिधित्व तरीके से जिसे मनुष्य ऐसी पहेलियों को सीखने के लिए उपयोग करते हैं:

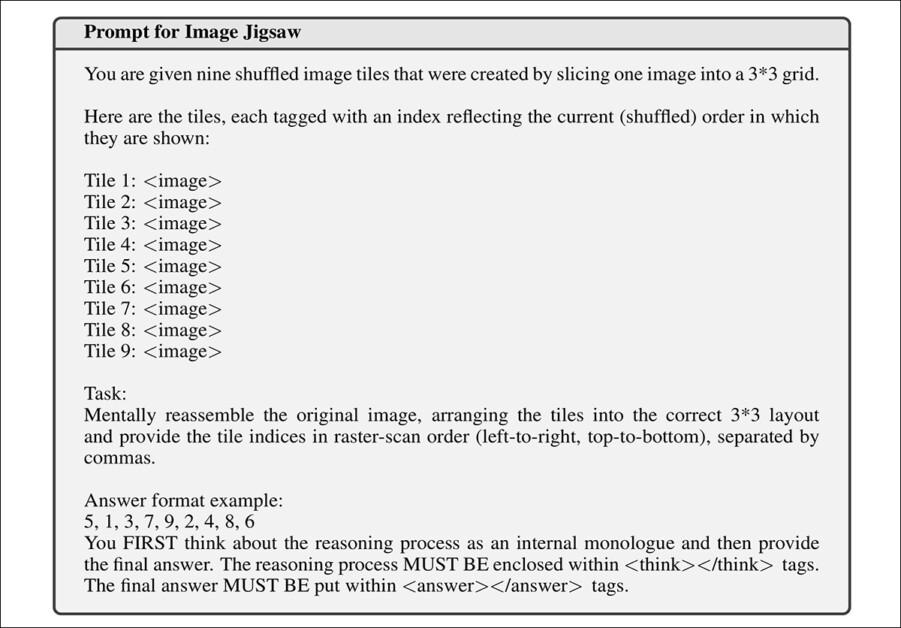

नया पत्र के पूरक सामग्री से, एक आरएल कार्य का एक उदाहरण जो इस सहायक सीखने की प्रक्रिया के पाठ-आधारित स्वरूप को दर्शाता है। इस पत्र में दिखाए गए छवियां एमएलएलएम को नहीं दिखाई गई हैं।

हालांकि एमएलएलएमएस व्यापक रूप से दृश्य-केंद्रित कार्यों से निपटते हैं, वे भाषा-आधारित वास्तुकला हैं, न कि छवियों, वीडियो या आकार प्रतिनिधित्व जैसे 3डी मेश उत्पन्न करने के लिए डिज़ाइन किए गए हैं।

इमेज जिगसॉ कार्य के उदाहरण। प्रत्येक पंक्ति में मॉडल को अपने मूल लेआउट में व्यवस्थित करने के लिए मिले हुए पैच दिखाए जाते हैं, जो दाईं ओर दिखाया गया है।

इस प्रकार का प्रशिक्षण मुख्य सीखने के चरण के बाद किया जाता है, जब मॉडल के पास पहले से ही कुछ छवियों को समझने की क्षमता होती है।

पूर्व दृष्टिकोण जैसे 2017 के स्विस पत्र जिगसॉ पज़ल्स को हल करके दृश्य प्रतिनिधित्व का अनुप्रवेशी सीखना ने इस प्रकार के सुदृढ़ दृष्टिकोण का उपयोग किया, लेकिन काफी कम सफलता के साथ, कॉनवोल्यूशनल न्यूरल नेटवर्क (सीएनएन) पर, जो एक आधुनिक एमएलएलएम की तुलना में एक अलग प्रकार की वास्तुकला है।

2017 रिलीज ‘जिगसॉ पज़ल्स को हल करके दृश्य प्रतिनिधित्व का अनुप्रवेशी सीखना’ से, एक न्यूरल सिस्टम के लिए एक पुरस्कार-आधारित चुनौती के रूप में टुकड़ों का उपयोग करने का एक प्रारंभिक उदाहरण। स्रोत: https://arxiv.org/pdf/1603.09246

परीक्षणों में, विज़ुअल जिगसॉ ने दावा किया कि व्यापक श्रृंखला के बेंचमार्क पर सुसंगत और मापनीय सुधार किए गए हैं: इमेज जिगसॉ कार्य ने सूक्ष्म दृष्टि धारणा, स्थानिक लेआउट समझ और संरचनात्मक तर्क में सुधार किया; वीडियो जिगसॉ कार्य ने मॉडल की समयिक अनुक्रमों को ट्रैक करने और घटना क्रम के बारे में तर्क करने की क्षमता में सुधार किया; और 3डी जिगसॉ कार्य ने गहराई-आधारित समझ और केवल आरजीबी-डी इनपुट का उपयोग करके स्थानिक तर्क में सुधार किया।

तीनों मोडलिटी में, पत्र दोहराता है, नई विधि ने कई प्रतिस्पर्धी बेसलाइन को पार किया, बिना किसी वास्तुकला परिवर्तन, अतिरिक्त दृश्य मॉड्यूल, या अतिरिक्त पर्यवेक्षित डेटा के:

‘व्यापक प्रयोगों से सूक्ष्म धारणा, समयिक तर्क और 3डी स्थानिक समझ में महत्वपूर्ण सुधार का प्रदर्शन किया जाता है। हमारे निष्कर्ष एमएलएलएमएस में स्व-पर्यवेक्षित दृश्य-केंद्रित कार्यों के पोस्ट-ट्रेनिंग की संभावना को उजागर करते हैं और दृश्य-केंद्रित प्रीटेक्स डिज़ाइन पर आगे के शोध को प्रेरित करने का लक्ष्य रखते हैं। ‘

नया पत्र विज़ुअल जिगसॉ पोस्ट-ट्रेनिंग एमएलएलएमएस में सुधार करता है है, और नаньयांग प्रौद्योगिकी विश्वविद्यालय, लिंकोपिंग विश्वविद्यालय और सेंसटाइम रिसर्च के छह शोधकर्ताओं से आता है। पत्र के साथ एक प्रोजेक्ट साइट है जिसमें लाइव डेमो (और आप अपनी खुद की छवि को इमेज-आधारित जिगसॉ डेमो में लोड कर सकते हैं) है। प्रोजेक्ट के लिए कोड और वज़न सामान्य रूप से उपलब्ध हैं,

विधि

हालांकि हम तीन परीक्षण की हुई मोडलिटी के लिए जानकारी को कैसे विभाजित किया जाता है, इसकी जांच करेंगे, हमें पहले नई प्रणाली के लिए पुरस्कार डिज़ाइन पर विचार करना चाहिए।

विज़ुअल जिगसॉ दृष्टिकोण मॉडल प्रतिक्रियाओं को ग्रेडेड पुरस्कार का उपयोग करके स्कोर करता है, न कि केवल एक सरल पास या विफल। यदि मॉडल जिगसॉ टुकड़ों का सटीक सही क्रम की भविष्यवाणी करता है, तो यह पूर्ण पुरस्कार प्राप्त करता है; यदि उत्तर अधिकांशतः सही है, लेकिन पूरी तरह से सही नहीं है, तो मॉडल आंशिक क्रेडिट प्राप्त करता है, जो एक छूट कारक द्वारा गुणा किया जाता है ताकि आंशिक रूप से सही समाधानों को अधिक मूल्य न दिया जा सके (यह मॉडल को आंशिक रूप से सही अनुमानों को दोहराने से रोकता है जो केवल आंशिक रूप से सही हैं)।

अमान्य उत्तर, जैसे कि ‘चीट’ एक ही संख्या का उपयोग करना, शून्य स्कोर प्राप्त करते हैं। सुसंगत प्रारूप को प्रोत्साहित करने के लिए, मॉडल को अपने तर्क को <think> टैग के अंदर और अपने अंतिम उत्तर को <answer> टैग के अंदर रखना होगा। यह सही प्रारूप का उपयोग करने पर एक छोटा सा बोनस प्राप्त करता है।

छवियां

इमेज मोडलिटी के लिए एक पहेली बनाने के लिए, एक छवि को पहले एक ग्रिड में पैच में विभाजित किया जाता है जो इसे समान आकार के ब्लॉक में काटता है:

सिस्टम के लिए हल करने के लिए छवि-आधारित पैच के उदाहरण।

पैच को एक निश्चित क्रम में बाएं से दाएं और ऊपर से नीचे तक रखा जाता है, जैसे कि एक पृष्ठ पर पढ़ने का क्रम, इससे पहले कि उन्हें एक यादृच्छिक शफल के साथ मिलाया जाए। मॉडल को तब इस मिले हुए सेट के पैच के साथ पेश किया जाता है, और यह मूल क्रम का अनुमान लगाना होगा जो मूल लेआउट को पुनर्स्थापित करता है।

प्रशिक्षण में 118,000 छवियों का उपयोग किया गया था सीओसीओ डेटासेट से, प्रत्येक छवि ने नौ पैच (अर्थात, ‘पज़ल पीस’) का उत्पादन किया। सिस्टम को दिए गए प्रॉम्प्ट को इस लेख के पहले में दिखाया गया है (छवि जो ‘नया पत्र के पूरक सामग्री से’ शुरू होती है)।

वीडियो

वीडियो जिगसॉ कार्य के लिए, एक वीडियो को समय के माध्यम से समान रूप से क्लिप में काटा जाता है, और फिर क्लिप खंडों को मिलाया जाता है। मॉडल को तब इस मिले हुए क्रम को दिखाया जाता है, और यह उनके मूल, मूल कालानुक्रमिक क्रम का अनुमान लगाना होगा:

वीडियो पहेली चुनौती के संक्षिप्त उदाहरण, पत्र के पूरक सामग्री से।

प्रशिक्षण में एलएलएवी-वीडियो डेटासेट से 100,000 वीडियो का उपयोग किया गया था, प्रत्येक वीडियो को छह क्लिप में विभाजित किया गया था। क्लिप सीमाओं पर स्पष्ट फ्रेम-मिलान संकेतों का शोषण करने से मॉडल को रोकने के लिए, प्रत्येक क्लिप की शुरुआत और अंत में 5% फ्रेम को ट्रिम किया गया था।

क्लिप में 12 फ्रेम से अधिक नहीं थे, प्रत्येक का अधिकतम रिज़ॉल्यूशन 128x28x28 पिक्सल था। 24 सेकंड से कम वीडियो को बाहर कर दिया गया था।

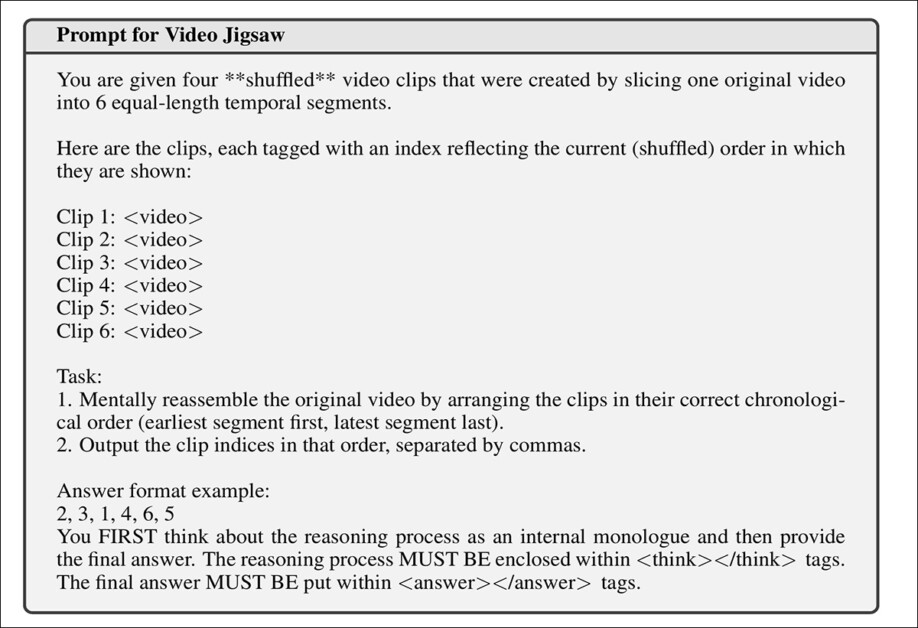

इस कार्य के लिए प्रॉम्प्ट नीचे दिखाया गया है:

वीडियो कार्य के लिए एमएलएलएमएस को प्रस्तुत किए गए सुदृढ़ सीखने का प्रॉम्प्ट, जिसमें एमएलएलएम को प्रस्तुत किए जाने वाले क्लिप नहीं हैं।

3डी डेटा

एक पूर्ण 3डी जिगसॉ कार्य आमतौर पर 3डी स्पेस (जैसे वोक्सेल ब्लॉक या पॉइंट क्लाउड खंड) को छोटे टुकड़ों में तोड़ने और मॉडल को उनके मूल स्थानिक लेआउट को पुनर्निर्माण करने के लिए प्रशिक्षित करने में शामिल होता है।

हालांकि, औसत एमएलएलएम सीधे तौर पर कच्चे 3डी डेटा को संभालने में सक्षम नहीं है, बल्कि सेमैंटिक-व्याख्या छवि या वीडियो इनपुट पर निर्भर करता है। इसलिए, वर्तमान एमएलएलएम के साथ संगत रहते हुए 3डी तर्क में टैप करने वाली एक कार्य बनाने के लिए, लेखकों ने एक अधिक ट्रैक्टेबल वेरिएंट का परिचय दिया जो उपरोक्त आरजीबी-डी छवियों (अर्थात, 2डी छवियों में प्रत्येक पिक्सेल के लिए गहराई जानकारी) का उपयोग करता है:

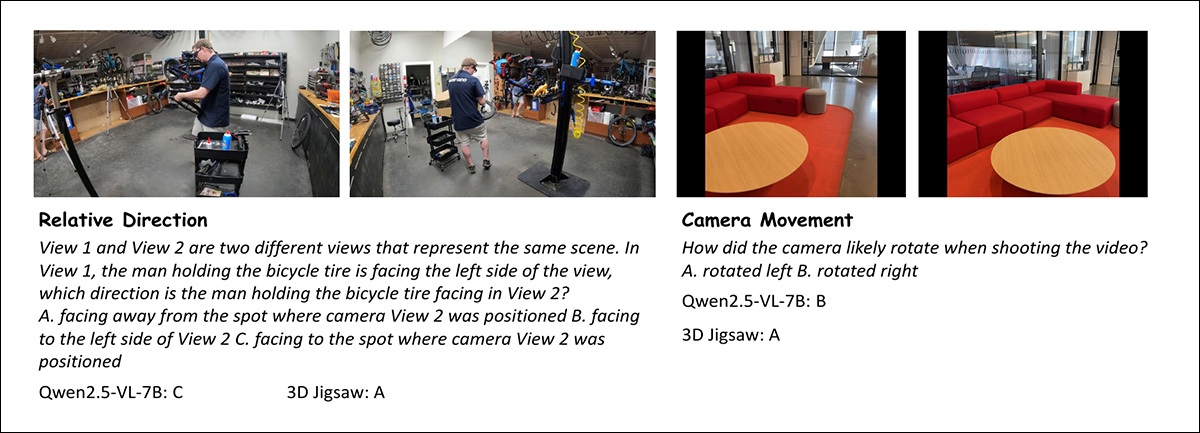

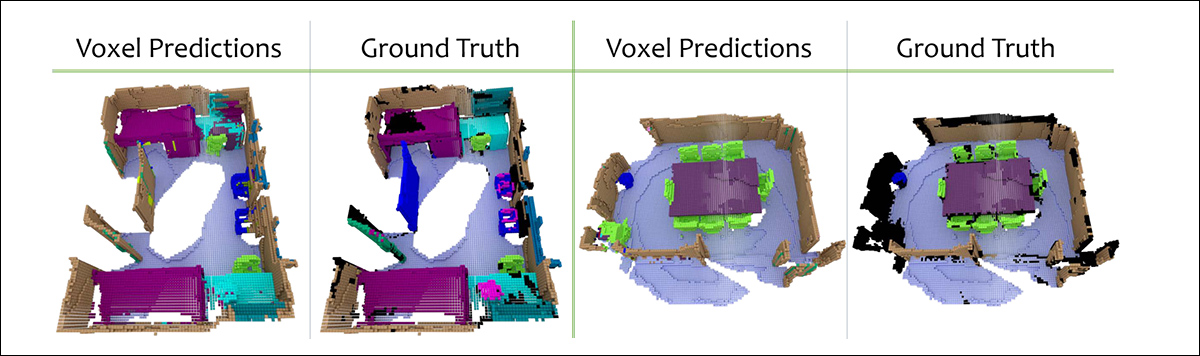

3डी स्पेशियल अंडरस्टैंडिंग बेंचमार्क का उपयोग सापेक्ष दृष्टिकोण और कैमरा मोशन तर्क के मूल्यांकन के लिए किया जाता है। 3डी जिगसॉ मॉडल दोनों दृश्यों के बीच स्थानिक संबंध और कैमरा घूर्णन की संभावित दिशा का सही अनुमान लगाता है, क्यूवेन2.5-वीएल-7बी बेसलाइन को पार करता है।

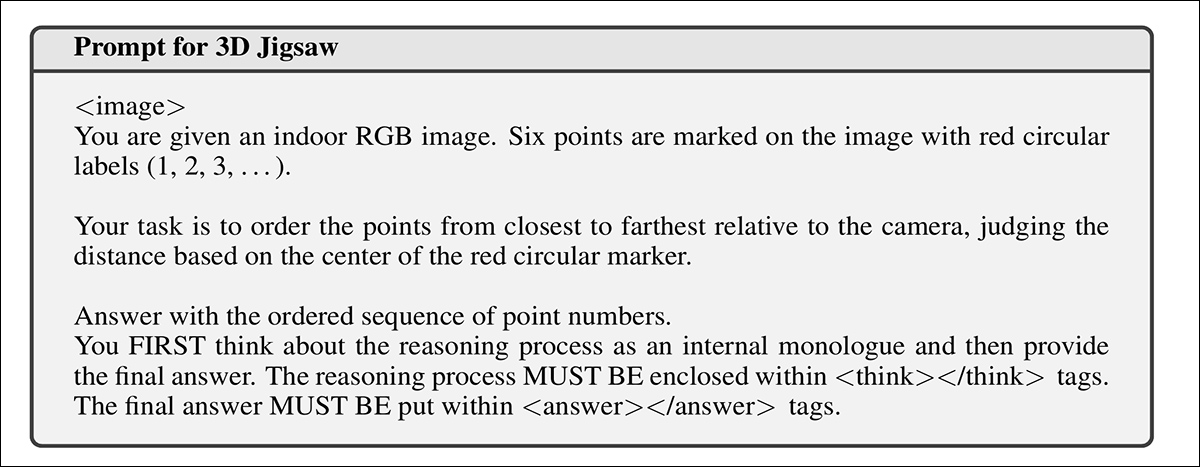

प्रत्येक आरजीबी-डी छवि से, मॉडल को एक मिले हुए सूची के बिंदुओं के साथ प्रस्तुत किया जाता है जो मूल रूप से विभिन्न गहराई पर थे, जो निकटतम से दूर तक उनके गहराई-आधारित क्रम को पुनर्स्थापित करने का लक्ष्य रखता है, केवल 2डी छवि को संदर्भ के रूप में उपयोग करता है:

3डी जिगसॉ के लिए आरएल प्रॉम्प्ट।

प्रत्येक बिंदु को छवि पर चिह्नित किया जाता है (जो मॉडल को दिखाया जाता है, लेकिन ऊपर दिखाए गए छवि में सीधे दृश्यमान नहीं है), और मॉडल को यह अनुमान लगाना होगा कि कौन सा निकटतम, दूसरा निकटतम, और इसी तरह, मूल गहराई क्रम को पुनर्निर्माण करते हुए, कच्चे गहराई मूल्यों तक पहुंच के बिना।

3डी जिगसॉ कार्य स्कैननेट डेटासेट से आरजीबी-डी छवियों पर प्रशिक्षित किया गया था, जिसमें प्रति छवि छह गहराई बिंदुओं के यादृच्छिक सेट का चयन करके 300,000 नमूने तैयार किए गए थे।

3डी जिगसॉ में उपयोग किए जाने वाले स्कैननेट डेटासेट से पॉइंट क्लाउड के उदाहरण। स्रोत: https://arxiv.org/pdf/1702.04405

प्रत्येक बिंदु को 0.1 से 10 मीटर की गहराई सीमा के भीतर होना आवश्यक था, और विविधता को बढ़ावा देने के लिए, किसी भी दो बिंदुओं को एक सेट में एक दूसरे के 40 पिक्सल से कम या गहराई में 0.2 मीटर से कम नहीं होना चाहिए।

परीक्षण

प्रारंभिक परीक्षणों के लिए, सिस्टम ने क्यूवेन2.5-वीएल-7बी-इन्सट्रक्ट को आधार बहुमोडल मॉडल के रूप में उपयोग किया। प्रशिक्षण जीआरपीओ अल्गोरिथ्म का उपयोग किया गया, जिसमें केएल नियमितकरण और एंट्रोपी हानि को हटा दिया गया था।

आंशिक भविष्यवाणियों के लिए, 0.2 का छूट कारक लागू किया गया था। इमेज जिगसॉ प्रशिक्षण में वैश्विक बैच आकार 256 का उपयोग किया गया था, जबकि वीडियो और 3डी जिगसॉ में 128 का उपयोग किया गया था। सीखने की दर 1×10⁻⁶ पर सेट की गई थी।

प्रत्येक प्रॉम्प्ट के लिए, मॉडल ने 16 प्रतिक्रियाएं उत्पन्न कीं जो 1.0 के डिकोडिंग तापमान पर थीं। इमेज और वीडियो जिगसॉ कार्यों को प्रत्येक 1,000 चरणों के लिए प्रशिक्षित किया गया था, जबकि 3डी जिगसॉ कार्य 800 चरणों के लिए प्रशिक्षित किया गया था।

इमेज जिगसॉ

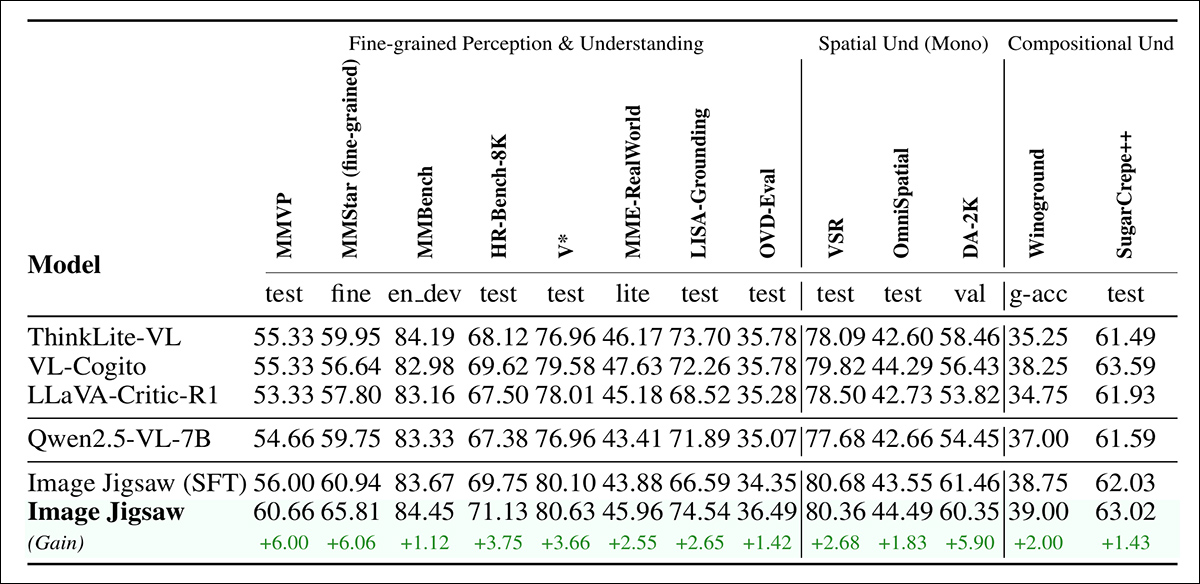

इमेज जिगसॉ मॉडल का परीक्षण तीन श्रेणियों के दृश्य-केंद्रित बेंचमार्क पर किया गया था: सूक्ष्म धारणा और समझ के लिए, एमएमवीपी, एमएमस्टार का सूक्ष्म धारणा उपसेट; एमएमबेंच; एचआर-बेंच; वी*; एमएमई-रियलवर्ल्ड (लाइट); लिसा-ग्राउंडिंग; और ओवीडी-इवल.

एकल-दृष्टिकोण स्थानिक समझ के लिए, बेंचमार्क वीएसआर थे; ओम्नीस्पेशियल; और डेप्थ एनीव्हेयर वी2 (डीए-2के). संरचनात्मक दृश्य समझ के लिए, परीक्षणों ने विनोग्राउंड और सुगरक्रेप++ का उपयोग किया।

तीन बेसलाइन का परीक्षण किया गया था, सभी क्यूवेन2.5-वीएल-7बी से व्युत्पन्न: थिंकलाइट-वीएल बहुमोडल तर्क के लिए; वीएल-कोगिटो सामान्य दृश्य और वैज्ञानिक कार्यों के लिए; और एलएलएवी-क्रिटिक-आर1 छवि धारणा के लिए।

सभी का मूल्यांकन केवल छोटे उत्तरों का उपयोग करके किया गया था, क्योंकि चेन-ऑफ-थॉट (सीओटी) तर्क कभी-कभी प्रदर्शन को कम कर देता है।

इमेज बेंचमार्क पर मूल्यांकन परिणाम। इमेज जिगसॉ ने क्यूवेन2.5-वीएल-7बी बेस मॉडल पर सारे कार्य श्रेणियों में सुधार किया (अर्थात, सूक्ष्म धारणा और समझ; एकल-दृष्टिकोण स्थानिक समझ; और संरचनात्मक दृश्य तर्क), पूर्व पोस्ट-ट्रेन्ड बेसलाइन को पार करते हुए।

इमेज जिगसॉ के परिणामों के बारे में लेखक कहते हैं:

‘[उपरोक्त छवि] दिखाती है कि हमारी विधि तीनों प्रकार के बेंचमार्क पर दृश्य-केंद्रित क्षमताओं में सुसंगत सुधार करती है। ये परिणाम पुष्टि करते हैं कि इमेज जिगसॉ पोस्ट-ट्रेनिंग को शामिल करने से एमएलएलएमएस की धारणा और सूक्ष्म दृश्य समझ में महत्वपूर्ण सुधार होता है, जो तर्क-केंद्रित पोस्ट-ट्रेनिंग रणनीतियों से परे। ‘

‘हम इन सुधारों को इस तथ्य से जोड़ते हैं कि इमेज जिगसॉ को हल करने से मॉडल को स्थानीय पैच विवरण पर ध्यान केंद्रित करने, वैश्विक स्थानिक लेआउट का अनुमान लगाने और पैच संबंधों के बारे में तर्क करने की आवश्यकता होती है, जो सूक्ष्म, स्थानिक और संरचनात्मक समझ को सीधे लाभान्वित करता है। ‘

वीडियो

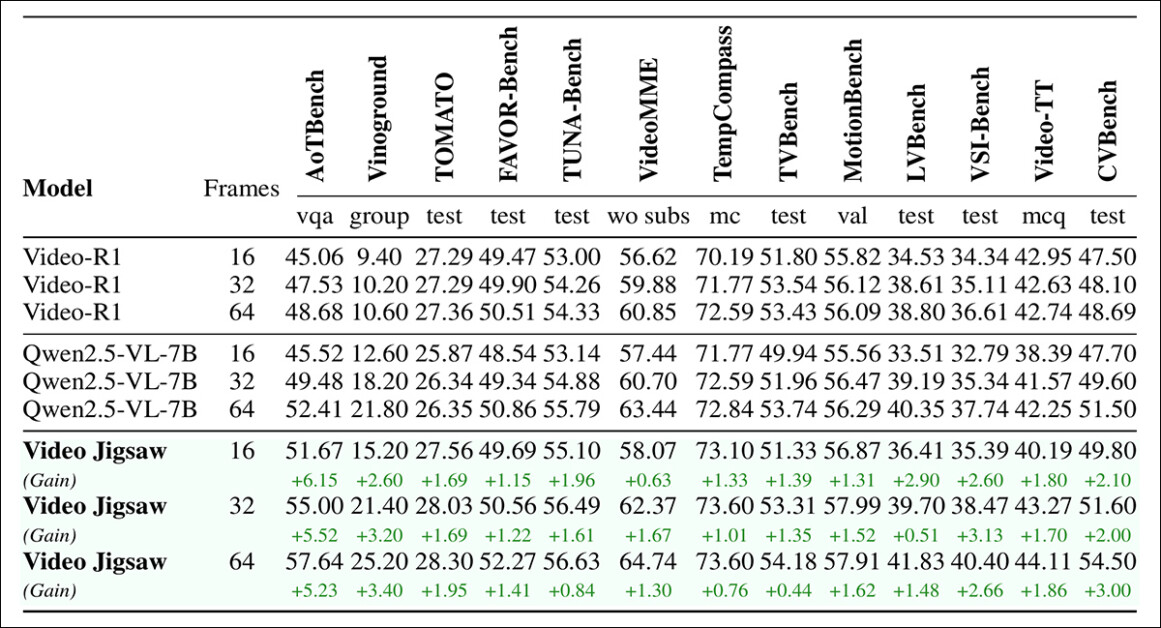

वीडियो जिगसॉ के लिए, मूल्यांकन एओटीबेंच पर किया गया था; विनोग्राउंड; टोमाटो; फेवर-बेंच; ट्यूना-बेंच; वीडियो-एमएमई; टेम्पकॉम्पास; टीवीबेंच; मोशनबेंच; एलवीबेंच; वीएसआई-बेंच; वीडियो-टीटी; और सीवीबेंच.

वीडियो-आर1 का उपयोग एक बेसलाइन के रूप में किया गया था, जिसे वीडियो समझ और तर्क के लिए सुदृढ़ सीखने के साथ ठंडा शुरू पर्यवेक्षित फाइन-ट्यूनिंग के बाद प्रशिक्षित किया गया था। इस मामले में, मूल्यांकन में पूरी तर्क प्रक्रिया शामिल थी, क्योंकि यह सीधे उत्तरों की तुलना में बेहतर परिणाम देती थी।

सभी मॉडल को 256x28x28 पिक्सल तक सीमित किया गया था, और तीन फ्रेम सेटिंग्स – 16, 32, और 64 में परीक्षण किया गया था:

वीडियो बेंचमार्क पर मूल्यांकन परिणाम, वीडियो जिगसॉ सभी कार्यों और फ्रेम सेटिंग्स पर बेसलाइन को पार करते हुए।

वीडियो जिगसॉ ने सभी वीडियो समझ बेंचमार्क और फ्रेम सेटिंग्स पर सुसंगत सुधार का उत्पादन किया, विशेष रूप से समयिक तर्क और दिशात्मकता की मांग वाले कार्यों जैसे कि एओटीबेंच में, और साथ ही क्रॉस-वीडियो तर्क बेंचमार्क जैसे सीवीबेंच में भी:

‘ये परिणाम पुष्टि करते हैं कि वीडियो जिगसॉ कार्यों को हल करने से मॉडल को बेहतर ढंग से समयिक निरंतरता को पकड़ने, वीडियो के बीच संबंधों को समझने, दिशात्मक संगति के बारे में तर्क करने और समग्र और सामान्य वीडियो समझ परिदृश्यों में सामान्यीकरण करने के लिए प्रोत्साहित किया जाता है। ‘

3डी डेटा

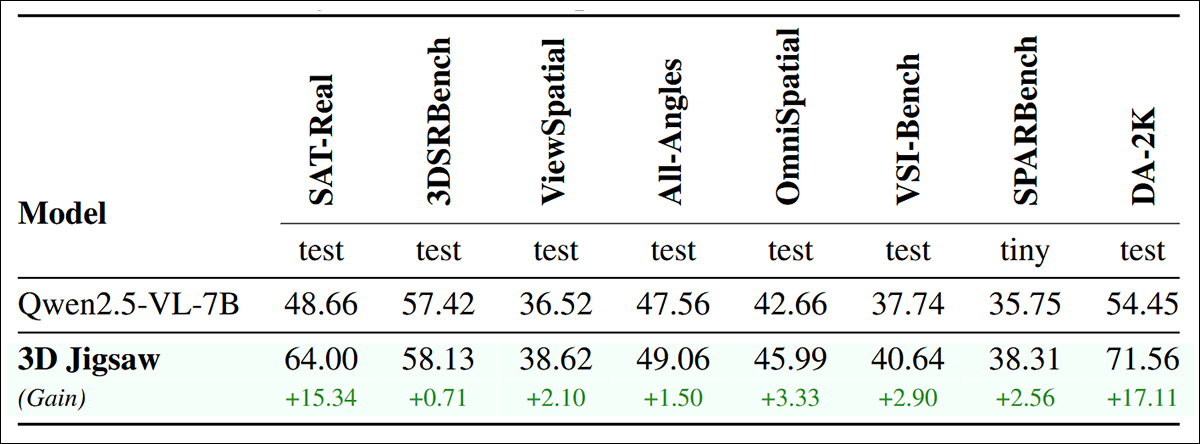

3डी मोडलिटी के लिए, मॉडल का मूल्यांकन एसएटी-रियल पर किया गया था; 3डीएसआरबेंच; व्यूस्पेशियल; ऑल-एंगल्स; उपरोक्त ओम्नीस्पेशियल; वीएसआई-बेंच; एसपीएआरबेंच (टिनी); और उपरोक्त डीए-2के।

3डी बेंचमार्क पर मूल्यांकन परिणाम: 3डी जिगसॉ ने डीए-2के जैसे गहराई तुलना कार्यों पर साथ ही व्यापक 3डी धारणा बेंचमार्क पर प्रदर्शन में सुधार किया, जो एकल-दृष्टिकोण, बहु-दृष्टिकोण और स्व-केंद्रित वीडियो इनपुट को कवर करता है।

यहाँ लेखक कहते हैं:

‘[3डी] जिगसॉ सभी बेंचमार्क पर महत्वपूर्ण सुधार प्राप्त करता है। अप्रत्याशित रूप से, सबसे बड़ा लाभ डीए-2के पर है, जो एक गहराई अनुमान बेंचमार्क है जो सीधे तौर पर हमारे गहराई-आधारित प्री-प्रशिक्षण कार्य से संबंधित है। अधिक महत्वपूर्ण बात यह है कि हम एकल-दृष्टिकोण (जैसे, 3डीएसआरबेंच, [ओम्नीस्पेशियल]), बहु-दृष्टिकोण (जैसे, व्यूस्पेशियल, ऑल-एंगल्स), और स्व-केंद्रित वीडियो इनपुट (जैसे, वीएसआई-बेंच) सहित विभिन्न कार्यों पर सुसंगत सुधार देखते हैं। ‘

‘ये परिणाम दर्शाते हैं कि हमारा दृष्टिकोण न केवल विशिष्ट कौशल को सिखाता है बल्कि मॉडल की सामान्य क्षमता को भी 3डी स्थानिक संरचना को समझने और तर्क करने में सुधार करता है। ‘

निष्कर्ष

यह पत्र से पूरी तरह से स्पष्ट नहीं है कि एमएलएलएम प्रदर्शन में सुधार को शक्ति देने वाला छवि और विवरण के बीच संबंध क्या है।

पहली नज़र में, पहेली को हल करने की प्रक्रिया हमारे अपने प्रारंभिक प्रयासों और विकास के समान लगती है। हालांकि, हमारी अपनी दुनिया की स्थानिक व्याख्या स्वाभाविक रूप से कम सेमैंटिक और भाषा से संबंधित लगती है, और पत्र की गहराई से जांच यह दर्शाती है कि एमएलएलएम के लिए भाषा दृश्य और सेमैंटिक वास्तविकताओं के बीच एक आकर्षक पुल के रूप में कैसे कार्य करती है।

* कृपया ध्यान दें कि पत्र के लेखक ‘मल्टीमॉडल लार्ज लैंग्वेज मॉडल्स’ शब्द का उपयोग करना पसंद करते हैं, जिसे एमएलएलएमएस के रूप में संक्षिप्त किया जाता है। यह एक उभरता हुआ या कम बार-बार उपयोग किया जाने वाला शब्द है, और उन मॉडल्स पर लागू होता है जो व्यापक रूप से दृश्यों को स्थानिक रूप से तर्क और विश्लेषण कर सकते हैं, लेकिन छवियों का उत्पादन नहीं करते हैं। जैसे ही नए परिदृश्य और मॉडल उभरते हैं, यह शब्दावली निरंतर संशोधन के अधीन है।

पहली बार गुरुवार, 2 अक्टूबर, 2025 को प्रकाशित