कृत्रिम बुद्धिमत्ता

MINT-1T: ओपन-सोर्स मल्टीमॉडल डेटा को 10x तक बढ़ाना

बड़े फ्रंटियर मल्टीमॉडल मॉडल (एलएमएम) को प्रशिक्षित करने के लिए बड़े पैमाने पर डेटासेट की आवश्यकता होती है जिसमें छवियों और पाठ के बीच इंटरलीव्ड अनुक्रम होते हैं। हालांकि ओपन-सोर्स एलएमएम तेजी से विकसित हुए हैं, फिर भी खुले स्रोत वाले मल्टीमॉडल इंटरलीव्ड डेटासेट की कमी है जो बड़े पैमाने पर हैं। इन डेटासेट का महत्व अतिरंजित नहीं किया जा सकता है, क्योंकि वे उन उन्नत एआई प्रणालियों के निर्माण के लिए आधार बनाते हैं जो विभिन्न मोडलिटी में सामग्री को समझने और उत्पन्न करने में सक्षम हैं। पर्याप्त व्यापक और इंटरलीव्ड डेटासेट की आपूर्ति के बिना, अधिक परिष्कृत और सक्षम एलएमएम विकसित करने की संभावना काफी बाधित है। ये डेटासेट मॉडल को विभिन्न प्रकार के इनपुट से सीखने में सक्षम बनाते हैं, जिससे वे विभिन्न अनुप्रयोगों में अधिक बहुमुखी और प्रभावी होते हैं। इसके अलावा, इस तरह के डेटासेट की कमी ओपन-सोर्स समुदाय के लिए एक चुनौती प्रस्तुत करती है, जो नवाचार और सहयोग को बढ़ावा देने के लिए साझा संसाधनों पर निर्भर करता है।

ओपन-सोर्स एलएमएम ने हाल के वर्षों में महत्वपूर्ण प्रगति की है, लेकिन उनकी वृद्धि बड़े पैमाने पर इंटरलीव्ड डेटासेट की सीमित उपलब्धता से बाधित है। इस बाधा को पार करने के लिए, अधिक व्यापक डेटासेट को संकलित, संकेतित और जारी करने के लिए सामूहिक प्रयासों की आवश्यकता है जो मल्टीमॉडल मॉडलों के निरंतर विकास और परिष्करण का समर्थन कर सकें। इसके अलावा, इन डेटासेट के निर्माण और प्रसार में कई तकनीकी और लॉजिस्टिक बाधाओं को पार करना शामिल है। डेटा संग्रह व्यापक और विविध संदर्भों का प्रतिनिधित्व करना चाहिए जिसमें एलएमएम तैनात किए जाएंगे। संकेतन को सावधानी से करने की आवश्यकता है ताकि यह सुनिश्चित किया जा सके कि छवियों और पाठ के बीच इंटरलीव्ड अनुक्रम मॉडल की सीखने की क्षमता को बढ़ाता है। इसके अलावा, डेटासेट को ओपन-सोर्स बनाने में डेटा गोपनीयता और उपयोग अधिकारों से संबंधित कानूनी और नैतिक विचारों को संबोधित करना शामिल है। उच्च गुणवत्ता वाले बड़े पैमाने पर मल्टीमॉडल इंटरलीव्ड डेटासेट की उपलब्धता का विस्तार एआई अनुसंधान और विकास के भविष्य के लिए आवश्यक है। वर्तमान कमी को संबोधित करके, एआई समुदाय अधिक नवाचार और सहयोग को बढ़ावा दे सकता है, जिससे अधिक शक्तिशाली और बहुमुखी एलएमएम का निर्माण हो सकता है जो जटिल, वास्तविक दुनिया की समस्याओं का सामना करने में सक्षम हैं।

इस बात पर जोर देते हुए, MINT-1T, अब तक का सबसे बड़ा और सबसे विविध मल्टीमॉडल इंटरलीव्ड ओपन-सोर्स डेटासेट है। MINT-1T: एक 10x बड़े पैमाने पर, जिसमें एक ट्रिलियन पाठ टोकन और 3.4 अरब छवियां शामिल हैं, मौजूदा ओपन-सोर्स डेटासेट की तुलना में। MINT-1T डेटासेट में पीडीएफ फाइलों और अर्काइव पेपर्स जैसे पहले से अनजान स्रोत भी शामिल हैं। चूंकि मल्टीमॉडल इंटरलीव्ड डेटासेट आसानी से स्केल नहीं होते हैं, इसलिए यह महत्वपूर्ण है कि MINT-1T डेटासेट डेटा क्यूरेशन प्रक्रिया को साझा करता है ताकि अन्य लोग भी इस तरह के जानकारी-संपन्न वेरिएंट पर प्रयोग कर सकें। MINT-1T डेटासेट यह प्रदर्शित करता है कि इसकी विधि; MINT-1T पर प्रशिक्षित एलएम मॉडल पिछले राज्य-ऑफ-द-आर्ट ओबेलिक्स की तुलना में प्रतिस्पर्धी (हालांकि थोड़ा) हैं।

MINT-1T: एक ट्रिलियन टोकन वाला मल्टीमॉडल डेटासेट

बड़े ओपन-सोर्स प्री-ट्रेनिंग डेटासेट अनुसंधान समुदाय के लिए डेटा इंजीनियरिंग और पारदर्शी, ओपन-सोर्स मॉडल को प्रशिक्षित करने में महत्वपूर्ण रहे हैं। पाठ डोमेन में, शुरुआती कार्यों जैसे सी4 और द पाइल ने पहले ओपन-सोर्स बड़े भाषा मॉडल जैसे जीपीटी-जे, जीपीटी-नियो और अन्य को प्रशिक्षित करने में समुदाय को सक्षम बनाने में महत्वपूर्ण भूमिका निभाई। इन मूलभूत प्रयासों ने डेटा फिल्टरिंग विधियों और स्केलिंग में बाद के सुधारों के लिए भी मार्ग प्रशस्त किया। इसी तरह, छवि-पाठ स्थान में, बड़े पैमाने पर ओपन-सोर्स डेटासेट ने बेहतर डेटा क्यूरेशन विधियों में नवाचारों को बढ़ावा दिया है, जैसे कि डेटा फिल्टरिंग नेटवर्क और टी-मार्स। फ्रंटियर लैब्स से बड़े मल्टीमॉडल मॉडल (एलएमएम) को प्रशिक्षित करने की ओर एक ध्यान देने योग्य बदलाव है, जो व्यापक मल्टीमॉडल इंटरलीव्ड डेटासेट की आवश्यकता होती है जिसमें छवियों और पाठ के बीच मुक्त-रूप अनुक्रम होते हैं। जैसे-जैसे फ्रंटियर मॉडल की क्षमताएं तेजी से आगे बढ़ रही हैं, मल्टीमॉडल प्रशिक्षण डेटा के बीच बंद और ओपन-सोर्स मॉडल के बीच एक महत्वपूर्ण अंतर उभर रहा है।

वर्तमान में ओपन-सोर्स मल्टीमॉडल इंटरलीव्ड डेटासेट छोटे और कम विविध हैं और मुख्य रूप से एचटीएमएल दस्तावेजों से सourced हैं, जो डेटा की व्यापकता और विविधता को सीमित करता है। यह सीमा मजबूत ओपन-सोर्स एलएमएम के विकास को बाधित करती है और ओपन-सोर्स और बंद-सोर्स मॉडल की क्षमताओं के बीच एक असमानता पैदा करती है।

MINT-1T: निर्माण डेटासेट

MINT-1T एक बड़े पैमाने पर ओपन-सोर्स डेटासेट को संकलित करता है जो इंटरलीव्ड दस्तावेजों के अधिक विविध स्रोतों का उपयोग करता है, जैसे कि पीडीएफ और अर्काइव पेपर्स। यह खंड MINT-1T के तरीकों का विवरण देता है मल्टीमॉडल दस्तावेजों को सोर्सिंग, निम्न-गुणवत्ता वाली सामग्री को फिल्टरिंग, डुप्लिकेट डेटा को हटाने और नॉट सेफ फॉर वर्क या एनएसएफडब्ल्यू और अवांछित सामग्री को हटाने के लिए। अंतिम डेटासेट में 922 अरब (बी) एचटीएमएल टोकन, 106बी पीडीएफ टोकन और 9बी अर्काइव टोकन शामिल हैं।

बड़ी मात्रा में मल्टीमॉडल दस्तावेजों को सोर्सिंग

एचटीएमएल पाइपलाइन

MINT-1T ओबेलिक्स के तरीके का अनुसरण करता है जो कॉमनक्रॉल वारसी फाइलों से इंटरलीव्ड मल्टीमॉडल दस्तावेजों को निकालने के लिए प्रत्येक वारसी प्रविष्टि के डीओएम ट्री को पार्स करके है। जबकि ओबेलिक्स केवल फरवरी 2020 से फरवरी 2023 कॉमनक्रॉल डंप से दस्तावेजों को संसाधित करता है, MINT-1T ने दस्तावेजों के पूल को विस्तारित किया है जिसमें मई 2017 से अप्रैल 2024 (पूर्ण डंप अक्टूबर 2018 से अप्रैल 2024 और पहले वर्षों से आंशिक डंप) तक के एचटीएमएल दस्तावेजों को शामिल किया गया है। ओबेलिक्स के समान, MINT-1T उन दस्तावेजों को फिल्टर आउट करता है जिनमें कोई छवि नहीं है, तीस से अधिक छवियां हैं, या कोई भी छवि जिसमें अश्लील उपसर्ग जैसे लोगो, अवतार, पोर्न और एक्सएक्सएक्स शामिल हैं।

पीडीएफ पाइपलाइन

MINT-1T पीडीएफ दस्तावेजों को फरवरी 2023 से अप्रैल 2024 डंप से कॉमनक्रॉल वैट फाइलों से सोर्स करता है। शुरू में, सभी पीडीएफ लिंक इन डंप से निकाले जाते हैं। MINT-1T तब पीडीएफ को डाउनलोड करने और पाइमूपीडीएफ का उपयोग करके पढ़ने का प्रयास करता है, 50 एमबी (संभवतः बड़ी छवियों वाली) और 50 पृष्ठों से अधिक लंबी पीडीएफ को हटा देता है। पाठ के बिना पृष्ठों को बाहर रखा जाता है और शेष पृष्ठों के लिए एक पढ़ने का क्रम स्थापित किया जाता है। पढ़ने का क्रम प्रत्येक पृष्ठ पर सभी पाठ ब्लॉकों के बाउंडिंग बॉक्स को खोजने, कॉलम के आधार पर ब्लॉकों को क्लस्टर करने और उन्हें ऊपर से नीचे तक क्रमबद्ध करने से निर्धारित किया जाता है। छवियों को पाठ ब्लॉकों के साथ एक ही पृष्ठ पर उनकी निकटता के आधार पर अनुक्रम में एकीकृत किया जाता है।

उपरोक्त आंकड़ा यह दर्शाता है कि MINT-1T कैसे पीडीएफ और अर्काइव दस्तावेजों से डेटा शामिल करता है, जो कि एचटीएमएल स्रोतों से परे है।

सुरक्षा फिल्टरिंग

- एनएसएफडब्ल्यू छवि फिल्टरिंग: MINT-1T सभी छवियों पर एक एनएसएफडब्ल्यू छवि डिटेक्टर लागू करता है। यदि एक दस्तावेज़ में एक单 एनएसएफडब्ल्यू छवि है, तो पूरा दस्तावेज़ हटा दिया जाता है।

- व्यक्तिगत रूप से पहचान योग्य जानकारी हटाना: व्यक्तिगत डेटा लीक के जोखिम को कम करने के लिए, पाठ डेटा में ईमेल पते और आईपी पते को अनामित किया जाता है। ईमेल को टेम्पलेट जैसे “ईमेल@example.com” और आईपी को यादृच्छिक रूप से उत्पन्न गैर-कार्यात्मक आईपी के साथ बदल दिया जाता है।

डुप्लिकेशन

MINT-1T प्रत्येक कॉमनक्रॉल स्नैपशॉट के भीतर और प्रत्येक डेटा स्रोत के लिए अलग से पैराग्राफ और डॉक्यूमेंट टेक्स्ट डुप्लिकेशन और छवि डुप्लिकेशन करता है ताकि पुनरावृत्ति और अव्याकुल छवियों जैसे आइकन और लोगो को हटाया जा सके।

पैराग्राफ और डॉक्यूमेंट डुप्लिकेशन

डोल्मा की विधि का पालन करते हुए, MINT-1T पैराग्राफ डुप्लिकेशन के लिए एक ब्लूम फिल्टर का उपयोग करता है, झूठी सकारात्मक दर को 0.01 पर सेट करता है और प्रत्येक दस्तावेज़ से दोहरे नया लाइन विभाजक द्वारा संकेतित 13-ग्राम पैराग्राफ को डुप्लिकेट करता है। यदि किसी दस्तावेज़ के 80% से अधिक पैराग्राफ डुप्लिकेट हैं, तो पूरा दस्तावेज़ हटा दिया जाता है।

सामान्य बॉयलरप्लेट पाठ हटाना

पैराग्राफ डुप्लिकेशन के बाद, MINT-1T एचटीएमएल दस्तावेजों में छोटे सामान्य बॉयलरप्लेट वाक्यांशों को हटा देता है, जैसे कि “सामग्री पर जाएं” या “ब्लॉग आर्काइव”। यह 2% प्रत्येक कॉमनक्रॉल स्नैपशॉट पर, सीसीनेट प्रथाओं के अनुसार, मुख्य रूप से सामान्य बॉयलरप्लेट पाठ को हटाने के लिए एक्सएक्ट पैराग्राफ डुप्लिकेशन चलाकर किया जाता है।

उपरोक्त आंकड़ा MINT-1T की फिल्टरिंग प्रक्रिया को दर्शाता है और दिखाता है कि एचटीएमएल, पीडीएफ और अर्काइव पेपर्स के लिए टोकन को डेटा पाइपलाइन के माध्यम से हटाया जाता है।

छवि डुप्लिकेशन

प्रत्येक कॉमनक्रॉल स्नैपशॉट के भीतर, MINT-1T एसएचए256 हैशों के आधार पर बार-बार होने वाली छवियों को हटा देता है। सख्त डुप्लिकेशन के बजाय, केवल दस से अधिक बार एक स्नैपशॉट के भीतर होने वाली छवियां हटा दी जाती हैं, मल्टीमॉडल-सी4 प्रथाओं का पालन करते हुए। ओबेलिक्स के साथ संगत, एक ही दस्तावेज़ के भीतर दोहराई जाने वाली छवियां हटा दी जाती हैं, केवल पहले अवलोकन को बनाए रखती हैं।

बुनियादी ढांचा

डेटा प्रसंस्करण के दौरान, MINT-1T के पास 190-प्रोसेसर और 90-प्रोसेसर नोड्स के मिश्रण से औसतन 2,350 सीपीयू कोर तक पहुंच थी। कुल मिलाकर, लगभग 4.2 मिलियन सीपीयू घंटे इस डेटासेट को बनाने में उपयोग किए गए थे।

MINT-1T और ओबेलिक्स में डॉक्यूमेंट संरचना की तुलना

इंटरलीव्ड डेटासेट की संरचना का मूल्यांकन करते समय, दो मुख्य विशेषताओं की जांच की जाती है: प्रति दस्तावेज़ पाठ टोकन का वितरण और प्रति दस्तावेज़ छवियों की संख्या। इस विश्लेषण के लिए, ओबेलिक्स और MINT-1T के प्रत्येक डेटा स्रोत से 50,000 दस्तावेजों का यादृच्छिक नमूना लिया गया था। जीपीटी-2 के टोकनाइज़र का उपयोग पाठ टोकन की संख्या की गणना के लिए किया गया था। आउटलियर्स को पाठ टोकन और छवियों की संख्या के लिए 1.5 इंटरक्वार्टाइल रेंज से बाहर गिरने वाले दस्तावेजों को हटाकर हटा दिया गया था। जैसा कि निम्नलिखित आंकड़े में दिखाया गया है, MINT-1T के एचटीएमएल उपसेट ओबेलिक्स में देखे गए टोकन वितरण के साथ紧密 संरेखित है। हालांकि, पीडीएफ और अर्काइव से सourced दस्तावेज़ औसतन एचटीएमएल दस्तावेजों की तुलना में लंबे होते हैं, विविध स्रोतों से डेटा सोर्सिंग के लाभों को रेखांकित करते हैं।

विभिन्न डेटा स्रोतों से डॉक्यूमेंट विविधता में सुधार कैसे होता है

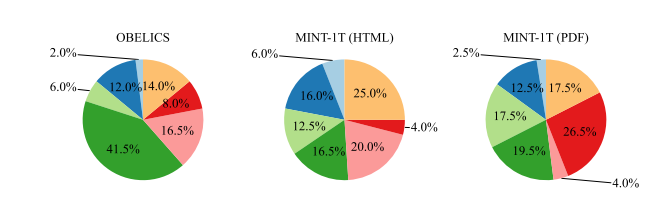

मल्टीमॉडल दस्तावेजों के पूल को एचटीएमएल से परे विस्तारित करने का एक महत्वपूर्ण प्रेरक डोमेन कवरेज में सुधार है। इस कवरेज की विविधता और गहराई को मापने के लिए, 200 विषयों को प्राप्त करने के लिए ओबेलिक्स डेटासेट, MINT-1T के एचटीएमएल उपसेट और MINT-1T के पीडीएफ उपसेट (अर्काइव को छोड़कर) से 100,000 दस्तावेजों पर एक लेटेंट डिरिचलेट अलोकेशन (एलडीए) मॉडल प्रशिक्षित किया गया था। जीपीटी-4 का उपयोग विषय-वार शब्दों को वर्गीकृत करने के लिए किया गया था ताकि प्रमुख डोमेन – जैसे स्वास्थ्य और चिकित्सा, विज्ञान, व्यवसाय, मानविकी, इतिहास, आदि – की पहचान की जा सके। एमएमएमयू डोमेन के आधार पर। विश्लेषण विभिन्न रुझानों को प्रकट करता है:

- ओबेलिक्स: यह डेटासेट “मानविकी और सामाजिक विज्ञान” में एक प्रमुख केंद्रीकरण प्रदर्शित करता है। यह इसके डेटा निर्माण प्रक्रिया के कारण हो सकता है, जिसमें विकिपीडिया लेखों के समान दस्तावेजों को फिल्टर आउट करना शामिल है, जिससे सामान्य ज्ञान और मानविकी-केंद्रित सामग्री की ओर झुकाव हो सकता है।

- MINT-1T का एचटीएमएल उपसेट: ओबेलिक्स के विपरीत, MINT-1T का एचटीएमएल उपसेट किसी विशिष्ट डोमेन की ओर झुकाव नहीं दिखाता है, जो एक व्यापक और संतुलित डोमेन प्रतिनिधित्व का सुझाव देता है।

- MINT-1T का पीडीएफ उपसेट: MINT-1T के पीडीएफ दस्तावेजों में “विज्ञान और प्रौद्योगिकी” दस्तावेजों का एक उच्च अनुपात है। यह प्रवृत्ति वैज्ञानिक संचार की प्रकृति के कारण हो सकती है, जहां पीडीएफ विस्तृत अनुसंधान पत्रों और तकनीकी रिपोर्टों को साझा करने के लिए पसंदीदा प्रारूप है।

MINT-1T: परिणाम और प्रयोग

सभी प्रयोगों के लिए, MINT-1T 50% इमेज-टेक्स्ट कैप्शनिंग बैच और 50% मल्टीमॉडल इंटरलीव्ड बैच पर मॉडल को प्रशिक्षित करता है। प्रत्येक इंटरलीव्ड दस्तावेज़ से 2048 मल्टीमॉडल टोकन का अधिकतम नमूना लिया जाता है और प्रत्येक इमेज-टेक्स्ट नमूने से 340 टोकन। फ्लेमिंगो के समान, एक “समाप्त” टोकन को एक साथ छवि-पाठ अनुक्रम के अंत को इंगित करने के लिए जोड़ा जाता है। प्रशिक्षण के दौरान, 50% एकल-छवि इंटरलीव्ड दस्तावेजों को यादृच्छिक रूप से हटा दिया जाता है ताकि बहु-छवि दस्तावेजों को अपसैंपल किया जा सके। छवि-पाठ डेटासेट आंतरिक रूप से क्यूरेट कैप्शन डेटासेट के मिश्रण से बना है। मॉडल की मल्टीमॉडल इंटरलीव्ड अनुक्रमों के बारे में तर्क करने की क्षमता का मूल्यांकन इसकी संदर्भ-शिक्षण क्षमताओं और मल्टी-इमेज तर्क के प्रदर्शन के माध्यम से किया जाता है।

उपरोक्त आंकड़ा ओबेलिक्स और MINT-1T के उपसेटों में प्रत्येक डोमेन से दस्तावेजों के प्रतिशत को दर्शाता है।

संदर्भ-शिक्षण: मॉडल को चार-शॉट और आठ-शॉट संदर्भ-शिक्षण प्रदर्शन पर मूल्यांकन किया जाता है विभिन्न कैप्शनिंग बेंचमार्क (सीओसीओ (कर्पथी परीक्षण) और टेक्स्टकैप्स (मान्यकरण)) और दृश्य प्रश्न उत्तर देने वाले डेटासेट (वीक्यूए2 (मान्यकरण), ओके-वीक्यूए (मान्यकरण), टेक्स्टवीक्यूए (मान्यकरण), और विज़विज़ (मान्यकरण)) पर। प्रदर्शन प्रशिक्षण सेट से यादृच्छिक रूप से नमूने लिए जाते हैं। स्कोर कई मूल्यांकन रनों पर औसतन होते हैं, जिसमें चुने गए प्रोम्प्ट्स के प्रति संवेदनशीलता को ध्यान में रखते हुए यादृच्छिक प्रदर्शन शामिल होते हैं। प्रत्येक कार्य के लिए विभिन्न प्रोम्प्ट्स को अलग किया जाता है ताकि सर्वोत्तम प्रदर्शन करने वाले लोगों का चयन किया जा सके।

मल्टी-इमेज तर्क: मॉडल का मूल्यांकन एमएमएमयू (जिसमें एकल और मल्टी-इमेज प्रश्न शामिल हैं) और मंटिस-इवल (सभी मल्टी-इमेज प्रश्न) पर किया जाता है ताकि संदर्भ-शिक्षण मूल्यांकन से परे मल्टी-इमेज तर्क क्षमताओं का परीक्षण किया जा सके।

एचटीएमएल दस्तावेजों पर प्रशिक्षण

प्रारंभ में, MINT-1T के एचटीएमएल भाग की ओबेलिक्स के साथ तुलना की जाती है, क्योंकि ओबेलिक्स भी एचटीएमएल दस्तावेजों से संकलित पिछले अग्रणी इंटरलीव्ड डेटासेट है। दो मॉडल को MINT-1T और ओबेलिक्स के एचटीएमएल भागों पर कुल 10B मल्टीमॉडल टोकन के लिए प्रशिक्षित किया जाता है। उनके संदर्भ-शिक्षण प्रदर्शन का मूल्यांकन किया जाता है। निम्नलिखित तालिका सामान्य बेंचमार्क पर 4-शॉट और 8-शॉट प्रदर्शन प्रस्तुत करती है; MINT-1T एचटीएमएल दस्तावेजों पर प्रशिक्षित मॉडल वीक्यूए कार्यों पर ओबेलिक्स की तुलना में बेहतर प्रदर्शन करता है लेकिन कैप्शनिंग बेंचमार्क पर खराब प्रदर्शन करता है। औसतन, ओबेलिक्स MINT-1T (एचटीएमएल) की तुलना में थोड़ा बेहतर प्रदर्शन करता है।

पीडीएफ और अर्काइव दस्तावेजों को जोड़ना

इसके बाद, प्रशिक्षण MINT-1T के पूर्ण डेटा स्रोतों पर किया जाता है, जिसमें एचटीएमएल, पीडीएफ और अर्काइव दस्तावेजों का मिश्रण शामिल है। इंटरलीव्ड दस्तावेजों का 50% एचटीएमएल से, 45% पीडीएफ से और 5% अर्काइव से नमूना लिया जाता है। मॉडल को कुल 10B मल्टीमॉडल टोकन के लिए प्रशिक्षित किया जाता है। जैसा कि ऊपर दी गई तालिका में देखा जा सकता है, MINT-1T के पूरे डेटा मिश्रण पर प्रशिक्षित मॉडल ओबेलिक्स और MINT-1T (एचटीएमएल) की तुलना में अधिकांश संदर्भ-शिक्षण बेंचमार्क पर बेहतर प्रदर्शन करता है। अधिक जटिल मल्टीमॉडल तर्क बेंचमार्क पर, MINT-1T मॉडल एमएमएमयू पर ओबेलिक्स को पीछे छोड़ देता है लेकिन मंटिस-इवल पर खराब प्रदर्शन करता है।

विस्तृत रुझान

संदर्भ-शिक्षण प्रदर्शन कैसे प्रदर्शन के साथ बदलता है

संदर्भ-शिक्षण प्रदर्शन का मूल्यांकन एक से आठ प्रदर्शनों के साथ किया जाता है। प्रत्येक शॉट गिनती के लिए प्रत्येक मूल्यांकन बेंचमार्क पर एक परीक्षण चलाया जाता है। जैसा कि निम्नलिखित आंकड़े में देखा जा सकता है, MINT-1T पर प्रशिक्षित मॉडल सभी शॉट पर MINT-1T के एचटीएमएल उपसेट और ओबेलिक्स पर प्रशिक्षित मॉडल को पीछे छोड़ देता है। MINT-1T (एचटीएमएल) मॉडल ओबेलिक्स की तुलना में थोड़ा खराब प्रदर्शन करता है।

कैप्शनिंग और विजुअल क्वेश्चन अन्सरिंग कार्यों पर प्रदर्शन

निम्नलिखित आंकड़ा कैप्शनिंग और विजुअल क्वेश्चन अन्सरिंग (वीक्यूए) बेंचमार्क पर औसत संदर्भ-शिक्षण प्रदर्शन प्रस्तुत करता है। ओबेलिक्स चार-शॉट कैप्शनिंग बेंचमार्क पर सभी MINT-1T वेरिएंट को पीछे छोड़ देता है और आठ-शॉट कैप्शनिंग पर MINT-1T की तुलना में थोड़ा खराब प्रदर्शन करता है। हालांकि, MINT-1T वीक्यूए बेंचमार्क पर ओबेलिक्स और अन्य बेसलाइन को काफी पीछे छोड़ देता है। MINT-1T (एचटीएमएल) वीक्यूए कार्यों पर ओबेलिक्स को भी पीछे छोड़ देता है।

विभिन्न डोमेन पर प्रदर्शन

MINT-1T में विभिन्न डोमेन को शामिल करने का उद्देश्य मॉडल के सामान्यीकरण में सुधार करना है। पूर्व का आंकड़ा एमएमएमयू पर प्रत्येक डोमेन के लिए प्रदर्शन को तोड़ता है। व्यवसाय डोमेन के अलावा, MINT-1T ओबेलिक्स और MINT-1T (एचटीएमएल) की तुलना में बेहतर प्रदर्शन करता है। विज्ञान और प्रौद्योगिकी डोमेन में प्रदर्शन में वृद्धि अर्काइव और पीडीएफ दस्तावेजों में इन डोमेन की प्रचुरता के कारण है।

अंतिम विचार

इस लेख में हमने MINT-1T के बारे में बात की है, जो अब तक का सबसे बड़ा और सबसे विविध मल्टीमॉडल इंटरलीव्ड ओपन-सोर्स डेटासेट है। MINT-1T: एक 10x बड़े पैमाने पर, जिसमें एक ट्रिलियन पाठ टोकन और 3.4 अरब छवियां शामिल हैं, मौजूदा ओपन-सोर्स डेटासेट की तुलना में। MINT-1T डेटासेट में पीडीएफ फाइलों और अर्काइव पेपर्स जैसे पहले से अनजान स्रोत भी शामिल हैं। चूंकि मल्टीमॉडल इंटरलीव्ड डेटासेट आसानी से स्केल नहीं होते हैं, इसलिए यह महत्वपूर्ण है कि MINT-1T डेटासेट डेटा क्यूरेशन प्रक्रिया को साझा करता है ताकि अन्य लोग भी इस तरह के जानकारी-संपन्न वेरिएंट पर प्रयोग कर सकें। MINT-1T डेटासेट यह प्रदर्शित करता है कि इसकी विधि; MINT-1T पर प्रशिक्षित एलएम मॉडल पिछले राज्य-ऑफ-द-आर्ट ओबेलिक्स की तुलना में प्रतिस्पर्धी (हालांकि थोड़ा) हैं।