कृत्रिम बुद्धिमत्ता

DeepMind ने ऐसी AI बनाई जो हिप्पोकैम्पस की तरह यादें दोहराती है

मानव मस्तिष्क अक्सर अतीत की यादों (आभासी रूप से) बिना किसी प्रेरणा के याद करता है। जैसे हम अपने दिन भर में जाते हैं, हमारे जीवन से यादों के आकस्मिक फ्लैश होते हैं। जबकि यादों के इस आकस्मिक संयोजन ने लंबे समय से तंत्रिका विज्ञानियों को आकर्षित किया है, एआई अनुसंधान कंपनी DeepMind ने हाल ही में एक पत्र प्रकाशित किया जिसमें बताया गया है कि उनकी एक एआई ने इस अजीब पैटर्न को दोहराया है।

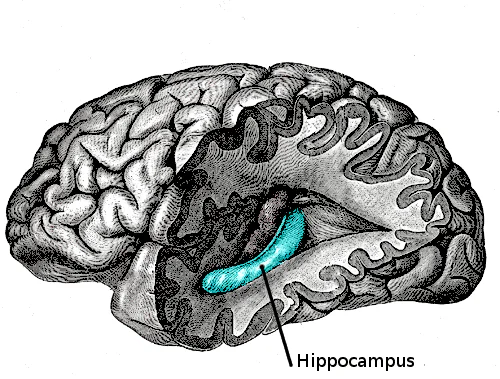

मस्तिष्क में यादों का संयोजन, न्यूरल रिप्ले, हिप्पोकैम्पस से जुड़ा हुआ है। हिप्पोकैम्पस एक समुद्री घोड़े के आकार का निर्माण है जो लिम्बिक प्रणाली से संबंधित है, और यह नई यादों के गठन से संबंधित है, साथ ही यादों से उत्पन्न होने वाली भावनाओं से। हिप्पोकैम्पस (मस्तिष्क के प्रत्येक गोलार्ध में एक) की भूमिका के वर्तमान सिद्धांत बताते हैं कि हिप्पोकैम्पस के विभिन्न क्षेत्र विभिन्न प्रकार की यादों को संभालने के लिए जिम्मेदार होते हैं। उदाहरण के लिए, स्थानिक स्मृति को हिप्पोकैम्पस के पीछे के क्षेत्र में संभाला जाता है।

जैसा कि जीसस रॉड्रिग्ज द्वारा बताया गया है, डॉ जॉन ओ’कीफ हिप्पोकैम्पस की हमारी समझ में कई योगदानों के लिए जिम्मेदार है, जिनमें हिप्पोकैम्पल “स्थान” कोशिकाएं शामिल हैं। हिप्पोकैम्पस में स्थान कोशिकाएं विशिष्ट पर्यावरण में उत्तेजना से ट्रिगर होती हैं। एक उदाहरण के रूप में, चूहों पर प्रयोगों से पता चला कि विशिष्ट न्यूरॉन्स तब आग लग जाते हैं जब चूहे कertain हिस्सों से गुजरते हैं। शोधकर्ताओं ने चूहों की निगरानी जारी रखी जब वे आराम कर रहे थे, और उन्होंने पाया कि मेज़ के एक हिस्से को दर्शाने वाले समान पैटर्न के न्यूरॉन्स आग लग जाते हैं, हालांकि वे तेजी से आग लग जाते हैं। चूहों को लगता है कि वे अपनी यादों को अपने दिमाग में दोहरा रहे हैं।

मानव में, यादों को याद करना सीखने की प्रक्रिया का एक महत्वपूर्ण हिस्सा है, लेकिन जब एआई को सीखने में सक्षम करने की कोशिश की जाती है, तो यह घटना को पुन: बनाना मुश्किल होता है।

DeepMind टीम ने पुनरावृत्ति सीखने का उपयोग करके यादों को दोहराने की घटना को पुन: बनाने का प्रयास किया। पुनरावृत्ति सीखने के अल्गोरिदम काम करते हैं जब वे अपने आसपास के वातावरण के साथ बातचीत से प्रतिक्रिया प्राप्त करते हैं, जब वे कार्रवाई करते हैं जो उन्हें वांछित लक्ष्य के करीब लाती है। इस संदर्भ में, पुनरावृत्ति सीखने वाले एजेंट घटनाओं को रिकॉर्ड करता है और बाद में उन्हें प्ले बैक करता है, जिससे प्रणाली को पिछले अनुभवों को याद रखने में अधिक कुशलता से सुधार करने के लिए प्रोत्साहित किया जाता है।

DeepMind ने एक पुनरावृत्ति बफर का उपयोग करके पुनरावृत्ति सीखने के अल्गोरिदम में अनुभवों को दोहराने की क्षमता जोड़ी, जो प्रणाली को विशिष्ट समय पर यादों/रिकॉर्ड किए गए अनुभवों को प्ले बैक करेगा। प्रणाली के कुछ संस्करणों में अनुभवों को यादृच्छिक क्रम में प्ले बैक किया गया था, जबकि अन्य मॉडलों में पूर्व-चयनित प्ले बैक क्रम थे। जबकि शोधकर्ताओं ने पुनरावृत्ति एजेंटों के लिए प्ले बैक क्रम के साथ प्रयोग किया, उन्होंने अनुभवों को दोहराने के विभिन्न तरीकों के साथ भी प्रयोग किया।

पुनरावृत्ति अल्गोरिदम को याद किए गए अनुभव प्रदान करने के लिए दो प्राथमिक तरीके हैं। ये तरीके कल्पना पुनरावृत्ति विधि और मूवी पुनरावृत्ति विधि हैं। DeepMind पत्र दोनों रणनीतियों का वर्णन करने के लिए एक रूपक का उपयोग करता है:

“मान लें कि आप घर आते हैं और, अपने आश्चर्य और निराशा के लिए, अपने सुंदर लकड़ी के फर्श पर पानी जमा होते हुए पाते हैं। डाइनिंग रूम में कदम रखते ही, आप एक टूटा हुआ फूलदान पाते हैं। फिर आप एक चीत्कार सुनते हैं, और आप पेटियो दरवाजे से बाहर देखते हैं और अपने कुत्ते को बहुत दोषी देखते हैं।”

जैसा कि रॉड्रिग्ज द्वारा बताया गया है, कल्पना पुनरावृत्ति विधि घटनाओं को उस क्रम में रिकॉर्ड नहीं करती है जिसमें वे अनुभव किए गए थे। इसके बजाय, घटनाओं के बीच एक संभावित कारण का अनुमान लगाया जाता है। घटनाएं एजेंट की दुनिया की समझ के आधार पर अनुमानित होती हैं। दूसरी ओर, मूवी पुनरावृत्ति विधि घटनाओं को उस क्रम में संग्रहीत करती है जिसमें वे हुईं, और उत्तेजना के क्रम – “पानी बहना, टूटा हुआ फूलदान, कुत्ता” को प्ले बैक करती है। घटनाओं का क्रमिक क्रम संरक्षित है।

तंत्रिका विज्ञान के क्षेत्र से शोध से पता चलता है कि मूवी पुनरावृत्ति विधि संकल्पनाओं के बीच संघों के निर्माण और घटनाओं के बीच न्यूरॉन्स के संबंध के लिए महत्वपूर्ण है। हालांकि, कल्पना पुनरावृत्ति विधि एजेंट को तर्कसंगत रूप से नए क्रम बनाने में मदद कर सकती है। उदाहरण के लिए, एजेंट यह तर्क दे सकता है कि यदि एक बैरल तेल के लिए है जैसे एक फूलदान पानी के लिए है, तो एक बैरल एक कुत्ते के बजाय एक फैक्ट्री रोबोट द्वारा छोड़ा जा सकता है। वास्तव में, जब DeepMind ने कल्पना पुनरावृत्ति विधि की संभावनाओं की जांच की, तो उन्होंने पाया कि उनका सीखने वाला एजेंट पिछले अनुभवों को ध्यान में रखते हुए प्रभावशाली और नवाचारी क्रम बनाने में सक्षम था।

वर्तमान में पुनरावृत्ति सीखने में यादों के क्षेत्र में ज्यादातर प्रगति मूवी रणनीति के साथ की जा रही है, हालांकि शोधकर्ताओं ने हाल ही में कल्पना रणनीति के साथ प्रगति करना शुरू किया है। दोनों एआई स्मृति विधियों के शोध न केवल पुनरावृत्ति सीखने वाले एजेंटों के प्रदर्शन में सुधार कर सकते हैं, बल्कि वे हमें मानव मस्तिष्क के कार्य के बारे में नए दृष्टिकोण प्राप्त करने में भी मदद कर सकते हैं।