Inteligencia artificial

¿Por qué los sistemas de video generativos no pueden crear películas completas?

El advenimiento y progreso del video generativo de inteligencia artificial ha llevado a muchos observadores casuales a predecir que el aprendizaje automático demostrará la muerte de la industria cinematográfica como la conocemos – en lugar de eso, creadores individuales podrán crear blockbusters al estilo de Hollywood en casa, ya sea en sistemas GPU locales o basados en la nube.

¿Es esto posible? Incluso si es posible, ¿es inminente, como creen muchos?

Que los individuos eventualmente puedan crear películas, en la forma que las conocemos, con personajes consistentes, continuidad narrativa y fotorealismo total, es bastante posible – y quizás incluso inevitable.

Sin embargo, hay varias razones fundamentalmente verdaderas por las que esto no es probable que ocurra con sistemas de video basados en Modelos de Difusión Latente.

Este último hecho es importante porque, en este momento, esa categoría incluye todos los sistemas de texto a video (T2) y de imagen a video (I2V) populares disponibles, incluyendo Minimax, Kling, Sora, Imagen, Luma, Amazon Video Generator, Runway ML, Kaiber (y, hasta donde podemos discernir, la funcionalidad de video pendiente de Adobe Firefly’s pending); entre muchos otros.

Aquí, estamos considerando la perspectiva de verdaderas auteur producciones de video generativo de inteligencia artificial de larga duración, creadas por individuos, con personajes consistentes, cinematografía y efectos visuales al menos al nivel del estado actual del arte en Hollywood.

Veamos algunos de los mayores obstáculos prácticos para los desafíos involucrados.

1: No puedes obtener un disparo de seguimiento preciso

La inconsistencia narrativa es el obstáculo más grande. El hecho es que ningún sistema de generación de video actualmente disponible puede hacer un disparo de seguimiento verdaderamente preciso*.

Esto se debe a que el modelo de difusión de desenoise en el corazón de estos sistemas depende de ruido aleatorio, y este principio fundamental no es susceptible de reinterpretar exactamente el mismo contenido dos veces (es decir, desde diferentes ángulos, o desarrollando el disparo anterior en un disparo de seguimiento que mantiene la consistencia con el disparo anterior).

Donde se utilizan textos de prompts, solos o junto con imágenes de ‘semilla’ subidas (entrada multimodal), los tokens derivados del prompt producirán contenido semánticamente apropiado del espacio latente entrenado del modelo.

Sin embargo, obstaculizado aún más por el factor de ‘ruido aleatorio’, nunca lo hará de la misma manera dos veces.

Esto significa que las identidades de las personas en el video tenderán a cambiar, y los objetos y entornos no coincidirán con el disparo inicial.

Esto es por qué los clips virales que muestran visuales extraordinarias y una salida de nivel de Hollywood tienden a ser disparos únicos, o una ‘montaje de presentación’ de las capacidades del sistema, donde cada disparo presenta personajes y entornos diferentes.

Excerpts from a generative AI montage from Marco van Hylckama Vlieg – source: https://www.linkedin.com/posts/marcovhv_thanks-to-generative-ai-we-are-all-filmmakers-activity-7240024800906076160-nEXZ/

La implicación en estas colecciones de generaciones de video ad hoc (que pueden ser engañosas en el caso de sistemas comerciales) es que el sistema subyacente puede crear narrativas contiguas y consistentes.

La analogía que se explota aquí es un tráiler de una película, que solo presenta un minuto o dos de metraje de la película, pero da al público razones para creer que toda la película existe.

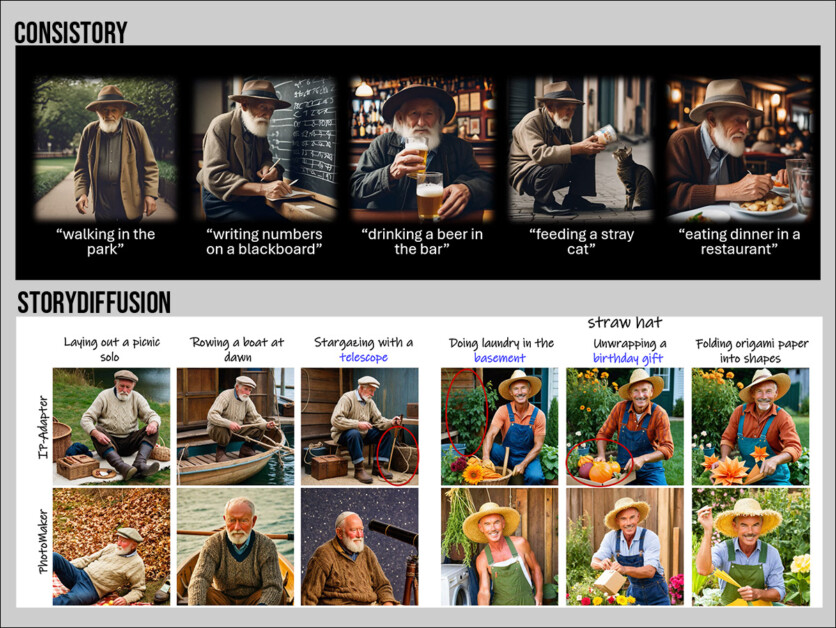

Los únicos sistemas que actualmente ofrecen consistencia narrativa en un modelo de difusión son aquellos que producen imágenes fijas. Estos incluyen NVIDIA’s ConsiStory, y diversos proyectos en la literatura científica, como TheaterGen, DreamStory, y StoryDiffusion.

Dos ejemplos de ‘estática’ continuidad narrativa, de modelos recientes:: Fuentes: https://research.nvidia.com/labs/par/consistory/ y https://arxiv.org/pdf/2405.01434

En teoría, se podría utilizar una versión mejorada de dichos sistemas (ninguno de los anteriores es verdaderamente consistente) para crear una serie de disparos de imagen a video, que podrían unirse en una secuencia.

En el estado actual del arte, este enfoque no produce disparos de seguimiento plausibles; y, en cualquier caso, ya hemos abandonado el sueño de auteur al agregar una capa de complejidad.

También podemos utilizar Low Rank Adaptation (LoRA) modelos, entrenados específicamente en personajes, cosas o entornos, para mantener una mejor consistencia a través de los disparos.

Sin embargo, si un personaje desea aparecer en un nuevo traje, generalmente se necesitará entrenar un nuevo LoRA que incorpore al personaje vestido de esa manera (aunque subconceptos como ‘vestido rojo’ se pueden entrenar en LoRAs individuales, junto con imágenes apropiadas, no siempre son fáciles de trabajar).

Esto agrega una complejidad considerable, incluso a una escena de apertura en una película, donde una persona se levanta de la cama, se pone un albornoz, bosteza, mira por la ventana del dormitorio y va al baño a cepillarse los dientes.

Dicha escena, que contiene aproximadamente 4-8 disparos, se puede filmar en una mañana mediante procedimientos de filmación convencionales; en el estado actual del arte en inteligencia artificial generativa, potencialmente representa semanas de trabajo, múltiples LoRAs entrenados (o otros sistemas auxiliares), y una cantidad considerable de postprocesamiento

Alternativamente, se puede utilizar video a video, donde se transforma metraje mundano o de CGI a través de textos de prompts en interpretaciones alternativas. Runway ofrece dicho sistema, por ejemplo.

CGI (izquierda) de Blender, interpretado en un experimento de video a video asistido por texto de Runway por Mathieu Visnjevec – Fuente: https://www.linkedin.com/feed/update/urn:li:activity:7240525965309726721/

Hay dos problemas aquí: ya estás creando el metraje básico, así que ya estás haciendo la película dos veces, incluso si estás utilizando un sistema sintético como UnReal’s MetaHuman.

Si creas modelos de CGI (como en el clip anterior) y los usas en una transformación de video a imagen, su consistencia a través de los disparos no se puede confiar.

Esto se debe a que los modelos de difusión de video no ven la ‘gran imagen’ – en lugar de eso, crean un nuevo cuadro basado en cuadros anteriores, y, en algunos casos, consideran un cuadro futuro cercano; pero, para comparar el proceso con un juego de ajedrez, no pueden pensar ‘diez movimientos adelante’, y no pueden recordar diez movimientos atrás.

En segundo lugar, un modelo de difusión seguirá luchando por mantener una apariencia consistente a través de los disparos, incluso si se incluyen múltiples LoRAs para personaje, entorno y estilo de iluminación, por razones mencionadas al comienzo de esta sección.

2: No puedes editar un disparo fácilmente

Si representas a un personaje caminando por una calle utilizando métodos de CGI de la vieja escuela, y decides que deseas cambiar algún aspecto del disparo, puedes ajustar el modelo y renderizarlo nuevamente.

Si es un rodaje en la vida real, simplemente reinicias y lo filma de nuevo, con los cambios apropiados.

Sin embargo, si produces un disparo de video de inteligencia artificial generativa que te encanta, pero deseas cambiar un aspecto de él, solo puedes lograrlo mediante métodos de postproducción laboriosos desarrollados en los últimos 30-40 años: CGI, rotoscopía, modelado y matting – todos procedimientos intensivos en mano de obra y costosos, que consumen tiempo.

La forma en que funcionan los modelos de difusión, simplemente cambiar un aspecto de un texto de prompt (incluso en un prompt multimodal, donde se proporciona una imagen de semilla completa) cambiará múltiples aspectos de la salida generada, lo que lleva a un juego de ‘golpea la mole’.

3: No puedes confiar en las leyes de la física

Los métodos de CGI tradicionales ofrecen una variedad de modelos de física basados en algoritmos que pueden simular cosas como la dinámica de fluidos, el movimiento gaseoso, la cinemática inversa (el modelado preciso del movimiento humano), la dinámica de telas, las explosiones y diversos otros fenómenos del mundo real.

Sin embargo, los métodos basados en difusión, como hemos visto, tienen una memoria corta, y también un rango limitado de priores de movimiento (ejemplos de tales acciones, incluidos en el conjunto de datos de entrenamiento) para aprovechar.

En una versión anterior de la página de aterrizaje de OpenAI para el aclamado sistema generativo Sora, la empresa reconoció que Sora tiene limitaciones en este regard (aunque este texto ha sido eliminado desde entonces):

‘[Sora] puede luchar para simular la física de una escena compleja, y puede no comprender instancias específicas de causa y efecto (por ejemplo: una galleta puede no mostrar una marca después de que un personaje la muerda).

‘El modelo también puede confundir detalles espaciales incluidos en un prompt, como discernir izquierda de derecha, o luchar con descripciones precisas de eventos que se desarrollan con el tiempo, como trayectorias de cámara específicas.’

La utilización práctica de varios sistemas generativos de video basados en API revela limitaciones similares en la representación de física precisa.

Algunos embeddings de prior de movimiento, ya sea entrenados en el modelo generativo o alimentados desde un video de origen, tardan un tiempo en completarse (como una persona que realiza una secuencia de baile compleja y no repetitiva en un traje elaborado) y, una vez más, la ventana de atención miope del modelo de difusión probablemente transformará el contenido (identidad facial, detalles del traje, etc.) para cuando el movimiento se haya completado. Sin embargo, los LoRAs pueden mitigar esto, hasta cierto punto.

Arreglarlo en postproducción

Hay otras limitaciones para la generación de video de inteligencia artificial pura ‘de un solo usuario’, como la dificultad que tienen para representar movimientos rápidos, y el problema general y mucho más apremiante de obtener consistencia temporal en la salida de video.

Además, crear actuaciones faciales específicas es más o menos un asunto de suerte en video generativo, al igual que la sincronización de labios para diálogos.

En ambos casos, el uso de sistemas auxiliares como LivePortrait y AnimateDiff se está volviendo muy popular en la comunidad de VFX, ya que esto permite la transposición de al menos expresiones faciales generales y sincronización de labios a la salida generada existente.

Un ejemplo de transferencia de expresión (video de conducción en la esquina inferior izquierda) impuesta en un video objetivo con LivePortrait. El video es de Generative Z TunisiaGenerative. Ver la versión de larga duración en mejor calidad en https://www.linkedin.com/posts/genz-tunisia_digitalcreation-liveportrait-aianimation-activity-7240776811737972736-uxiB/?

Además, una multitud de soluciones complejas, que incorporan herramientas como la interfaz de usuario de Stable Diffusion ComfyUI y la aplicación de composición y manipulación profesional Nuke, así como la manipulación del espacio latente, permiten a los practicantes de VFX de IA obtener un mayor control sobre la expresión y disposición facial.

Aunque describe el proceso de animación facial en ComfyUI como ‘tortura’, el profesional de VFX Francisco Contreras ha desarrollado dicho procedimiento, que permite la imposición de fonemas de labios y otros aspectos de la representación de la cabeza y la cara

Stable Diffusion, ayudado por un flujo de trabajo de ComfyUI impulsado por Nuke, permitió al profesional de VFX Francisco Contreras obtener un control inusual sobre los aspectos faciales. Para el video completo, a mejor resolución, vaya a https://www.linkedin.com/feed/update/urn:li:activity:7243056650012495872/

Conclusión

Nada de esto es prometedor para la perspectiva de un usuario individual que genera películas coherentes y fotorealistas de estilo de blockbuster de larga duración, con diálogos realistas, sincronización de labios, actuaciones, entornos y continuidad.

Además, los obstáculos descritos aquí, al menos en relación con los modelos de video generativos basados en difusión, no son necesariamente solubles ‘en cualquier momento’ ahora, a pesar de los comentarios del foro y la atención de los medios que hacen este caso. Las limitaciones descritas parecen ser intrínsecas a la arquitectura.

En la investigación de síntesis de IA, al igual que en toda investigación científica, las ideas brillantes periódicamente nos deslumbran con su potencial, solo para que una investigación posterior descubra sus limitaciones fundamentales.

En el espacio de síntesis/generación, esto ya ha sucedido con las Redes Generativas Adversarias (GAN) y los Campos de Radiancia Neuronal (NeRF), ambos de los cuales en última instancia resultaron muy difíciles de instrumentalizar en sistemas comerciales performantes, a pesar de años de investigación académica hacia ese objetivo. Estas tecnologías ahora aparecen con más frecuencia como componentes auxiliares en arquitecturas alternativas.

Tanto como los estudios de cine pueden esperar que el entrenamiento en catálogos de películas con licencia legítima pueda eliminar a los artistas de VFX, la IA en realidad está agregando roles a la fuerza laboral en este momento.

Si los sistemas de video basados en difusión realmente pueden transformarse en generadores de películas narrativamente consistentes y fotorealistas, o si todo el negocio es solo otra búsqueda alquímica, debería ser evidente en los próximos 12 meses.

Es posible que necesitemos un enfoque completamente nuevo; o es posible que Gaussian Splatting (GSplat), que se desarrolló en la década de 1990 y ha tomado impulso en el espacio de síntesis de imágenes, represente una alternativa potencial a la generación de video basada en difusión.

Dado que GSplat tardó 34 años en surgir, también es posible que los contendientes más antiguos como NeRF y GAN – e incluso los modelos de difusión latente – todavía tengan su día.

* Aunque la función AI Storyboard de Kaiber ofrece esta funcionalidad, los resultados que he visto no son de calidad de producción.

Martin Anderson es el ex jefe de contenido de investigación científica en metaphysic.ai

Publicado por primera vez el lunes 23 de septiembre de 2024