Ángulo de Anderson

Agregar diálogo a video real con IA

Un nuevo marco de IA puede reescribir, eliminar o agregar las palabras de una persona en un video sin volver a grabar, en un solo sistema de extremo a extremo.

Hace tres años, Internet se habría sorprendido con cualquiera de los 20-30 marcos de video alterados por IA que se publican en portales académicos semanalmente; como es, esta popular rama de investigación se ha vuelto tan prolífica que casi constituye otra rama de ‘basura de IA’, y cubro mucho menos de estos lanzamientos de lo que lo habría hecho hace dos o tres años.

Sin embargo, un lanzamiento actual en esta línea llamó mi atención: un sistema integrado que puede intervenir en clips de video reales e interponer nuevo diálogo en el video existente (en lugar de crear un clip generativo completo a partir de una cara o un marco, lo que es mucho más común).

En los ejemplos a continuación, que edité juntos a partir de una multitud de videos de muestra disponibles en el sitio web del proyecto project website, primero vemos el clip de origen real, y luego, debajo, el diálogo de IA impuesto en el medio del clip, incluyendo síntesis de voz y sincronización de labios:

Click to play. Edición local con costura – una de las varias modalidades ofrecidas por FacEDiT. Por favor, refiérase al sitio web de origen para una mejor resolución. Source – https://facedit.github.io/

Este enfoque es uno de los tres desarrollados para el nuevo método, este titulado ‘edición local con costura’, y el que más interesa a los autores (así como a mí). Esencialmente, el clip se extiende utilizando uno de los marcos del medio como punto de partida para la interpretación de IA novel, y su marco sucesivo (real) como un objetivo que el clip insertado generativo debe tratar de emparejar.

En los clips vistos arriba, estos marcos ‘semilla’ y ‘objetivo’ están representados por el video superior que se detiene mientras el video modificado debajo proporciona relleno generativo.

Los autores enmarcan este enfoque de síntesis facial y vocal como el primer método completamente integrado de extremo a extremo para ediciones de video de IA de este tipo, observando el potencial de un marco completamente desarrollado como este para la producción de TV y cine:

‘Los cineastas y productores de medios a menudo necesitan revisar partes específicas de videos grabados – quizás una palabra se dijo mal o el guión cambió después de la filmación. Por ejemplo, en la escena icónica de Titanic (1997) donde Rose dice, “I’ll never let go, Jack,” el director podría decidir más tarde que debería ser “I’ll never forget you, Jack”.

‘Tradicionalmente, dichos cambios requieren volver a grabar toda la escena, lo que es costoso y lleva mucho tiempo. La síntesis de cara hablante ofrece una alternativa práctica al modificar automáticamente el movimiento facial para que coincida con el habla revisada, eliminando la necesidad de nuevas tomas.’

Aunque las interposiciones de IA de este tipo pueden enfrentar cultural o resistencia de la industria, también pueden constituir un nuevo tipo de funcionalidad en sistemas y suites de herramientas de efectos visuales liderados por humanos. En cualquier caso, por el momento, los desafíos son estrictamente técnicos.

Además de extender un clip a través de diálogo de IA adicional, el nuevo sistema también puede alterar el habla existente:

Click to play. Un ejemplo de cambiar el diálogo existente en lugar de interponer diálogo adicional. Por favor, refiérase al sitio web de origen para una mejor resolución.

Estado del arte

Actualmente no hay sistemas de extremo a extremo que ofrezcan esta capacidad de síntesis; aunque una creciente cantidad de plataformas de IA generativas como la serie Veo de Google, pueden generar audio, y diversos otros marcos pueden crear audio deepfaked, actualmente hay que crear una especie de tubería involucrada de diversas arquitecturas y trucos para interferir con metraje real de la manera que el nuevo sistema – titulado FacEDiT – puede lograr.

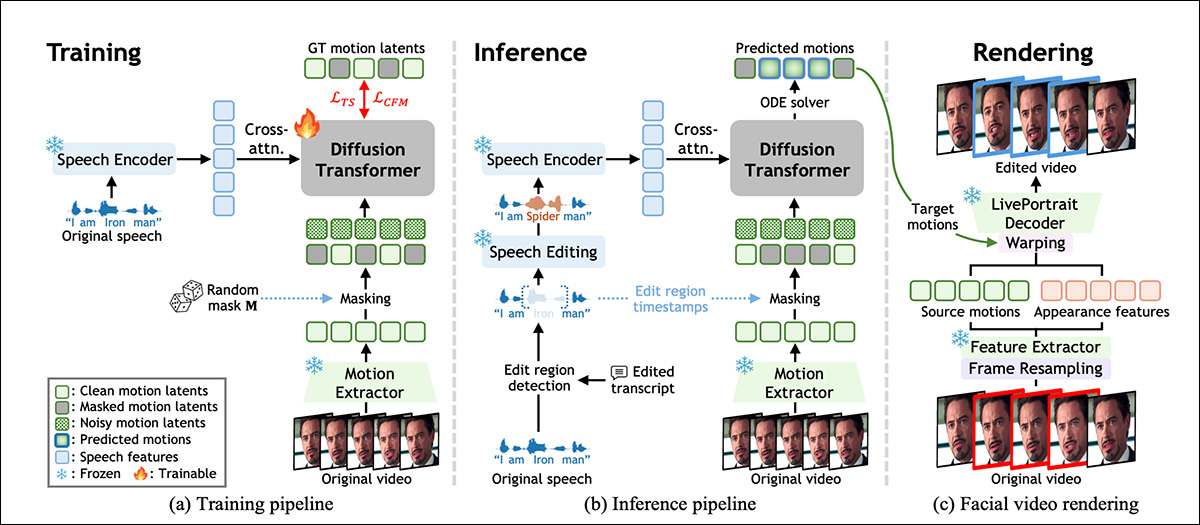

El sistema utiliza Transformadores de difusión (DiT) en combinación con Flow Matching para crear movimientos faciales condicionados por movimientos y contenido de audio de habla circundantes. El sistema aprovecha paquetes populares existentes que tratan con la reconstrucción facial, incluyendo LivePortrait (recientemente asumido por Kling).

Además de este método, dado que su enfoque es el primero en integrar estos desafíos en una sola solución, los autores han creado un benchmark novel llamado FacEDiTBench, junto con varias métricas de evaluación completamente nuevas apropiadas para esta tarea específica.

El nuevo trabajo se titula FacEDiT: Edición y generación de cara hablante unificada a través del relleno de movimiento facial, y proviene de cuatro investigadores de la Universidad de Ciencia y Tecnología de Pohang (POSTECH), el Instituto Avanzado de Ciencia y Tecnología de Corea (KAIST) y la Universidad de Texas en Austin.

Método

FacEDiT se entrena para reconstruir el movimiento facial aprendiendo a rellenar partes faltantes del rendimiento original de un actor, basado en el movimiento circundante y el audio de habla. Como se muestra en el esquema a continuación, este proceso permite que el modelo actúe como un relleno de brechas durante el entrenamiento, prediciendo movimientos faciales que coincidan con la voz mientras se mantienen consistentes con el video original:

Visión general del sistema FacEDiT, que muestra cómo se aprende el movimiento facial a través del relleno auto-supervisado durante el entrenamiento, guiado por el habla editada en la inferencia, y finalmente se representa nuevamente en el video reutilizando la apariencia del metraje original mientras se reemplaza solo el movimiento objetivo. Fuente

En el momento de la inferencia, la misma arquitectura admite dos salidas diferentes dependiendo de cuánto del video esté enmascarado: ediciones parciales, donde solo se altera una frase y el resto se deja intacto; o generación de oraciones completas, donde se sintetiza nuevo movimiento enteramente desde cero.

El modelo se entrena a través de Flow Matching, que trata las ediciones de video como una especie de camino entre dos versiones de movimiento facial.

En lugar de aprender a adivinar cómo debería verse una cara editada desde cero, el Flow Matching aprende a moverse gradual y suavemente entre un placeholder ruidoso y el movimiento correcto. Para facilitar esto, el sistema representa el movimiento facial como un conjunto compacto de números extraídos de cada marco utilizando una versión del sistema LivePortrait mencionado anteriormente (ver esquema anterior).

Estos vectores de movimiento están diseñados para describir expresiones y pose de cabeza sin entrelazar identidad, para que los cambios en el habla puedan localizarse sin afectar la apariencia general de la persona.

Entrenamiento de FacEDiT

Para entrenar a FacEDiT, cada clip de video se dividió en una serie de instantáneas de movimiento facial, y cada marco se emparejó con el trozo correspondiente de audio. Se ocultaron partes aleatorias de los datos de movimiento, y se le pidió al modelo que adivinara qué aspecto deberían tener esos movimientos faltantes, utilizando tanto el habla como el movimiento no enmascarado circundante para el contexto.

Dado que los spans enmascarados y sus posiciones varían de un ejemplo de entrenamiento a otro, el modelo aprende gradualmente a manejar tanto ediciones internas pequeñas como brechas más largas, para la generación de secuencias completas, según la cantidad de información que se le proporcione.

El Transformador de difusión del sistema aprende a recuperar el movimiento enmascarado refinando las entradas ruidosas con el tiempo. En lugar de alimentar el habla y el movimiento en el modelo todo de una vez, el audio se introduce en cada bloque de procesamiento a través de cross-attention, lo que ayuda al sistema a emparejar los movimientos de labios con la voz de habla de manera más precisa.

Para preservar la realismo a través de las ediciones, la atención se sesga hacia los marcos vecinos en lugar de toda la línea de tiempo, lo que fuerza al modelo a centrarse en la continuidad local y evita parpadeos o saltos de movimiento en los bordes de las regiones alteradas. Las incrustaciones de posición (que le dicen al modelo dónde aparece cada marco en la secuencia) también ayudan al modelo a mantener el flujo temporal natural y el contexto.

Durante el entrenamiento, el sistema aprende a predecir el movimiento facial faltante reconstruyendo spans enmascarados basados en el habla y el movimiento no enmascarado circundante. En el momento de la inferencia, este mismo conjunto se vuelve a utilizar, pero con las máscaras ahora guiadas por ediciones en el habla.

Cuando se inserta, elimina o cambia una palabra o frase, el sistema localiza la región afectada, la enmascara y regenera el movimiento que coincide con el nuevo audio. La generación de secuencia completa se trata como un caso especial, donde toda la región se enmascara y se sintetiza desde cero.

Datos y pruebas

La columna vertebral del sistema comprende 22 capas para el Transformador de difusión, cada una con 16 cabezas de atención y dimensiones de alimentación hacia adelante de 1024 y 2024px. Las características de movimiento y apariencia se extraen utilizando componentes congelados de LivePortrait, y el habla se codifica a través de WavLM y se modifica utilizando VoiceCraft.

Una capa de proyección dedicada mapea las características de habla de 786 dimensiones en el espacio latente de DiT, con solo el DiT y los módulos de proyección entrenados desde cero.

El entrenamiento se realizó bajo el optimizador AdamW con una tasa de aprendizaje objetivo de 1e‑4, durante un millón de pasos, en dos GPU A6000 (cada una con 48GB de VRAM), a un tamaño de lote total de ocho.

FacEDiTBench

El conjunto de datos FacEDiTBench contiene 250 ejemplos, cada uno con un clip de video del habla original y editada, y las transcripciones para ambos. Los videos provienen de tres fuentes, con 100 clips de HDTF, 100 de Hallo3, y 50 de CelebV-Dub. Cada uno se verificó manualmente para confirmar que tanto el audio como el video fueran lo suficientemente claros para la evaluación.

Se utilizó GPT‑4o para revisar cada transcripción y crear ediciones gramaticalmente válidas. Estas transcripciones revisadas, junto con el habla original, se pasaron a VoiceCraft para producir nuevo audio; y en cada etapa, tanto la transcripción como el habla generada se revisaron manualmente para la calidad.

Cada muestra se etiquetó con el tipo de edición, el momento del cambio y la longitud del span modificado, y las ediciones se clasificaron como inserciones, eliminaciones o sustituciones. El número de palabras cambiadas varió desde ediciones cortas de 1 a 3 palabras, ediciones medias de 4 a 6 palabras y ediciones más largas de 7 a 10 palabras.

Se definieron tres métricas personalizadas para evaluar la calidad de edición. Continuidad fotométrica, para medir cómo se mezcla la iluminación y el color de un segmento editado con el video circundante, comparando diferencias a nivel de píxel en los bordes; continuidad de movimiento, para evaluar la consistencia del movimiento facial, midiendo los cambios de flujo óptico en los marcos editados y no editados; y preservación de identidad, para estimar si la apariencia del sujeto permanece consistente después de la edición, comparando incrustaciones faciales de las secuencias original y generada utilizando el modelo de reconocimiento facial ArcFace.

Pruebas

El modelo de prueba se entrenó en material de los tres conjuntos de datos mencionados anteriormente, totalizando alrededor de 200 horas de contenido de video, incluyendo vlogs y películas, así como videos de YouTube de alta resolución.

Para evaluar la edición de cara hablante, se utilizó FacEDiTBench, además de la partición de prueba HDTF, que se ha convertido en un estándar de referencia para este conjunto de tareas.

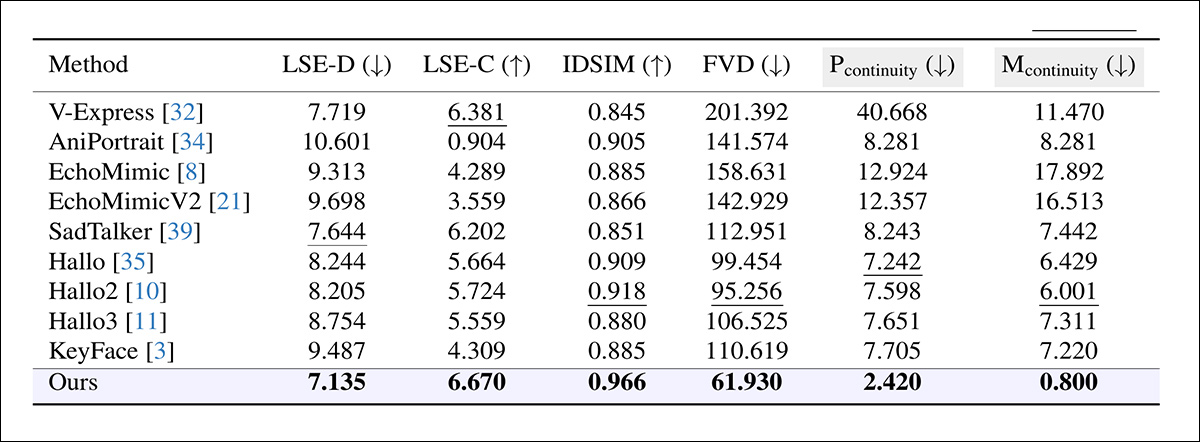

Dado que no había sistemas directamente comparables capaces de encapsular esta funcionalidad de extremo a extremo, los autores eligieron una variedad de marcos que reprodujeran al menos parte de la funcionalidad objetivo, y que podrían operar como líneas base; a saber, KeyFace; EchoMimic; EchoMimicV2; Hallo; Hallo2; Hallo3; V-Express; AniPortrait; y SadTalker.

También se utilizaron varias métricas establecidas para evaluar la calidad de generación y edición, con la precisión de sincronización de labios evaluada a través de SyncNet, informando tanto el error absoluto entre los movimientos de labios y el audio (LSE-D) como una puntuación de confianza (LSE-C); Fréchet Video Distance (FVD) cuantificando lo realista que parece el video en general; y Métricas de similitud perceptual aprendidas (LPIPS), midiendo la similitud perceptual entre los marcos generados y originales.

Para la edición, todas las métricas excepto LPIPS se aplicaron solo al segmento modificado; para la generación, se evaluó todo el video, con la continuidad de los bordes excluida.

Cada modelo se hizo sintetizar un segmento de video coincidente, que luego se insertó en el clip original (los investigadores observan que este método a menudo introdujo discontinuidades visibles, donde el segmento editado se encuentra con el metraje circundante). También se probó un segundo enfoque, en el que se regeneró todo el video desde el audio modificado – pero esto inevitablemente sobrescribió las regiones no editadas y no preservó el rendimiento original:

Comparación del rendimiento de edición en sistemas originalmente diseñados para la generación de cara hablante, con FacEDiT superando a todas las líneas base en todas las métricas, logrando un error de sincronización de labios más bajo (LSE-D), una mayor confianza de sincronización (LSE-C), una preservación de identidad más fuerte (IDSIM), una mayor realismo perceptual (FVD) y transiciones más suaves en los bordes de edición (Pcontinuity, Mcontinuity). Las columnas sombreadas en gris resaltan los criterios clave para evaluar la calidad de los bordes; los valores en negrita y subrayados indican los mejores y segundos mejores resultados, respectivamente

En cuanto a estos resultados, los autores comentan:

‘[Nuestro] modelo supera significativamente a los métodos existentes en la tarea de edición. Logra una fuerte continuidad de bordes y una alta preservación de identidad, demostrando su capacidad para mantener la consistencia temporal y visual durante la edición. Además, su precisión de sincronización de labios superior y su bajo FVD reflejan el realismo del video sintetizado.’

Click to play. Resultados, ensamblados por este autor a partir de los videos publicados en el sitio del proyecto. Por favor, refiérase al sitio web de origen para una mejor resolución.

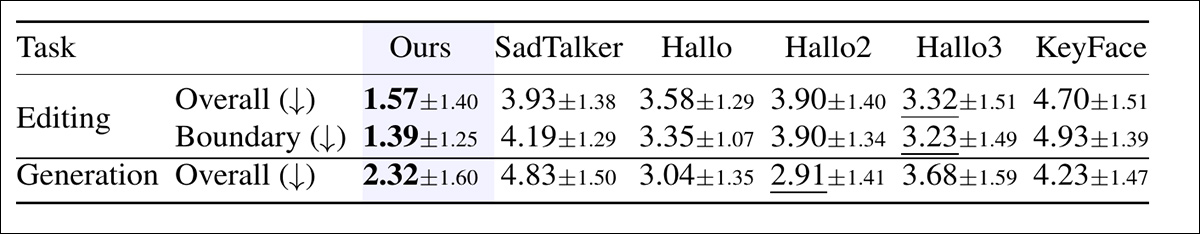

Además, se realizó un estudio humano para evaluar la calidad percibida en ambas edición y generación.

Para cada comparación, los participantes vieron seis videos y los clasificaron por calidad general, considerando la precisión de sincronización de labios, la naturalidad y el realismo del movimiento de cabeza. En las pruebas de edición, los participantes también calificaron la suavidad de las transiciones entre segmentos editados y no editados:

Rangos promedio asignados por los evaluadores humanos, donde menor es mejor. En ambas edición y generación, los participantes juzgaron qué tan natural y bien sincronizado parecía cada video. Para la edición, también calificaron qué tan suave era la transición entre el habla editada y no editada. Los números en negrita y subrayados indican las dos mejores puntuaciones.

En el estudio, FacEDiT se clasificó consistentemente como el más alto por una ventaja clara, tanto en la calidad de edición como en la suavidad de la transición, y también obtuvo puntuaciones sólidas en el escenario de generación, lo que sugiere que sus ventajas medibles se traducen en salidas perceptualmente preferidas.

Debido a la falta de espacio, nos referimos al lector al papel de origen para más detalles de los estudios de abstinencia y las pruebas adicionales que se ejecutaron y se informaron en el nuevo trabajo. En realidad, las ofertas de investigación prototípicas de este tipo luchan por generar secciones de resultados de prueba significativas, ya que la oferta central en sí misma es inevitablemente una posible línea base para trabajos posteriores.

Conclusión

Incluso para la inferencia, sistemas como este pueden requerir recursos computacionales significativos en el momento de la inferencia, lo que hace que sea difícil para los usuarios posteriores – aquí, presumiblemente, tiendas de efectos visuales – mantener el trabajo en las instalaciones. Por lo tanto, los enfoques que se pueden adaptar a recursos locales realistas siempre serán preferidos por los proveedores, que están bajo la obligación legal de proteger el metraje del cliente y la propiedad intelectual en general.

Eso no es para criticar la nueva oferta, que puede funcionar perfectamente bajo pesos cuantizados u otras optimizaciones, y que es la primera oferta de su tipo que me ha atraído de regreso a esta avenida de investigación en bastante tiempo.

Publicado por primera vez el miércoles 17 de diciembre de 202. Editado el 20.10 EET, mismo día, para agregar espacio en el primer párrafo del cuerpo.