Inteligencia artificial

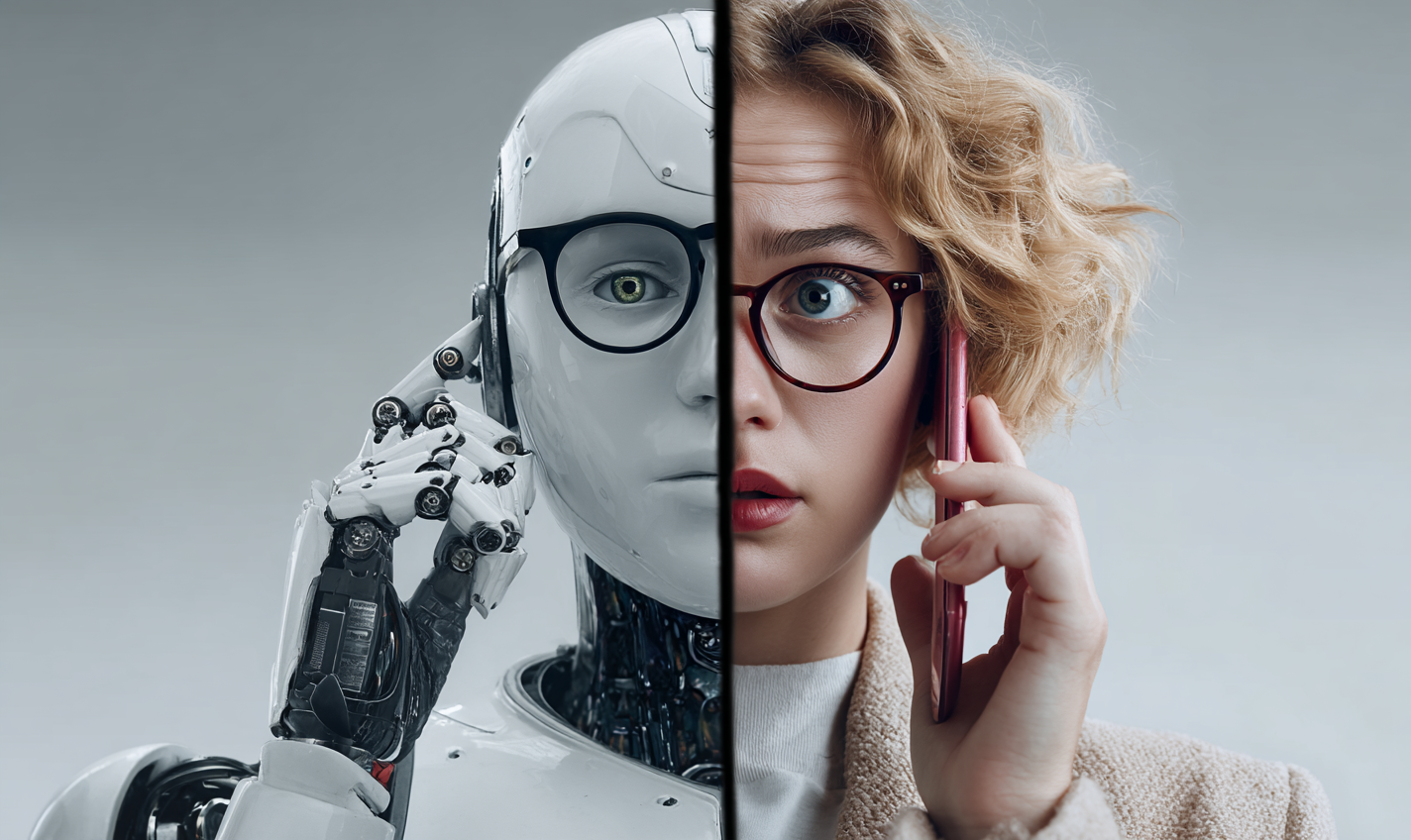

Cómo detectar deepfakes de audio

Los deepfakes de audio suenan casi exactamente como personas reales, a veces incluso como personas que conoces. Solo se necesitan unos pocos segundos de habla grabada para recrear con precisión el tono y el ritmo de alguien con herramientas de clonación de voz modernas impulsadas por modelos de aprendizaje automático. Lo que solía sonar robótico o plano ahora se presenta como emocional y natural, completo con patrones de respiración y acentos.

Si bien ese progreso impulsa usos creativos como asistentes virtuales y narración accesible, también abre la puerta a riesgos graves. Detectar deepfakes de audio es importante porque tu voz es parte de tu identidad. Una vez que se puede clonar, la confianza en la comunicación digital disminuye. Aprender a reconocer audio falso va más allá de protegerte de estafas y desinformación. Implica salvaguardar la autenticidad de cada conversación que tienes en línea.

El impacto de los deepfakes de audio en la sociedad y la seguridad

Los deepfakes de audio han hecho que sea más difícil confiar en lo que escuchas en línea o por teléfono. Cuando la voz de alguien se puede clonar con solo unos pocos segundos de audio, incluso las voces familiares se pueden utilizar para engañar. Los estafadores cada vez más utilizan el habla sintética para impersonar a CEOs, compañeros de trabajo y miembros de la familia — convenciendo a las víctimas de transferir dinero o compartir datos confidenciales.

Estas estafas causan daños financieros y erosionan la confianza en las conversaciones digitales. Para las empresas, los riesgos van más allá del dinero hacia la reputación y la confianza del cliente. Los equipos de aplicación de la ley y ciberseguridad combinan herramientas forenses, sistemas de autenticación de voz y modelos de detección de inteligencia artificial (IA) para combatir estas amenazas. Sin embargo, a medida que la tecnología de deepfakes evoluciona, mantenerse alerta y informado es tu mejor defensa contra el engaño en un mundo donde las voces pueden mentir.

7 consejos para identificar deepfakes de audio

Incluso los mejores deepfakes de audio dejan pistas sutiles. Puedes detectar la manipulación antes de que te perjudique prestando atención a detalles en la calidad del sonido, el ritmo del habla y el comportamiento contextual. A continuación, se presentan 10 consejos prácticos para ayudar a detectar audio sintético o manipulado.

1. Escucha pausas o transiciones poco naturales

El habla generada por IA puede sonar real, pero a menudo se capturan pistas sutiles si se escucha atentamente. Estas incluyen una pausa que se siente poco natural, un ritmo ligeramente desigual o un tono que cambia a mitad de frase. Estas pequeñas inconsistencias en el tiempo son las pistas que indican que algo no es completamente humano. Sin embargo, incluso con esas pistas, detectar un deepfake de audio no es fácil.

La investigación muestra que solo se puede detectarlos con una precisión de aproximadamente el 62%, lo que significa que casi la mitad de las veces, un falso convincente puede pasar desapercibido. A medida que los deepfakes se vuelven más pulidos, es inteligente verificar mensajes sospechosos, especialmente cuando involucran información sensible o solicitudes urgentes. Una verificación rápida podría salvarte de caer en una voz que suena real pero no lo es.

2. Nota la planitud emocional o la exageración

Cuando escuchas un deepfake de audio, es posible que notes algo ligeramente fuera de lugar sobre el tono del hablante. Los deepfakes a menudo suenan demasiado monótonos — faltos de los altibajos emocionales naturales — o excesivamente expresivos, con énfasis exagerado que no se ajusta al contexto.

Los modelos de IA pueden imitar el tono y el ritmo pero luchan por capturar el equilibrio emocional sutil en conversaciones reales. Si una voz suena inusualmente plana o dramática, especialmente en momentos que deberían sentirse normales, tómalo como una señal de alerta. Prestar atención a estas inconsistencias tonales puede ayudarte a detectar audio falso antes de que te convenza de actuar sobre algo que no es real.

3. Busca artefactos de audio

Pistas sutiles — estática débil, distorsiones extrañas o cambios de tono repentinos que simplemente no suenan bien — pueden delatar un deepfake de audio. Estos pequeños glitches ocurren porque los sistemas de IA cosen trozos de sonido para imitar el habla natural. Lo que es más sorprendente es cuánto audio necesitan estas herramientas para crear un clon convincente de tu voz.

En algunos casos, solo tres segundos de habla grabada son suficientes para producir una coincidencia de voz del 85% entre tú y el falso. Eso significa que un clip corto de un correo de voz, una publicación en las redes sociales o un video rápido podría ser todo lo que se necesite para que alguien copie tu tono y ritmo. Siempre que algo suene ligeramente fuera de lugar, confía en tus instintos. Esas pequeñas imperfecciones podrían ser las únicas señales de que la voz que estás escuchando no es real.

4. Compara con grabaciones conocidas

Las voces reales tienen un flujo natural que la IA todavía lucha por capturar por completo. Cuando alguien habla, su tono, ritmo y respiración reflejan consistentemente su personalidad y emoción. Por lo general, puedes escuchar pistas sutiles — una inhalación rápida antes de un pensamiento, un ritmo constante cuando están calmados o un ligero cambio en el ritmo — cuando enfatizan un punto.

Los deepfakes de audio, por otro lado, a menudo pierden estos detalles orgánicos. La respiración puede sonar mecánica, el ritmo desigual, o el tono extrañamente plano o exagerado. Si una voz se siente demasiado suave o carece de esas pequeñas imperfecciones humanas, esa es una señal de que podría ser sintética. Prestar atención a cómo alguien habla naturalmente te ayuda a detectar cuándo una voz no suena como la de ellos.

5. Utiliza verificación multicanal

Cuando un mensaje de voz o una llamada se siente sospechoso, siempre toma un momento para verificarlo antes de responder. La forma más fácil de mantenerse a salvo es confirmar el mensaje a través de otro canal — envía un texto rápido, salta a una llamada de video o responde utilizando una dirección de correo electrónico oficial que confíes. Este paso adicional puede protegerte de estafas que utilizan voces clonadas y falsa urgencia para engañarte para que actúes rápidamente.

Los ciberdelincuentes de hoy en día están volviéndose más inteligentes, combinando deepfakes de audio con phishing de voz para robar datos. Es una amenaza en crecimiento, con 71% de las organizaciones informando que han enfrentado estos intentos. Es por eso que verificar la comunicación es un hábito inteligente. Cuando algo se siente fuera de lugar, confía en la validación sobre la urgencia y tómate el tiempo para confirmar la verdad antes de actuar.

6. Revisa el contexto del habla

Cuando recibes una llamada o mensaje de voz inesperado, presta tanta atención a lo que se dice como a cómo suena. Las estafas de deepfakes a menudo dependen de frases inusuales, urgencia repentina o solicitudes de datos sensibles para presionarte para que actúes rápidamente. Puedes escuchar una voz que afirma ser tu jefe pidiendo una transferencia de dinero inmediata, o un ser querido que suena angustiado y pide ayuda — tácticas comunes que los estafadores utilizan.

Estos desencadenantes emocionales te hacen entrar en pánico antes de pensarlo bien. Si un mensaje se siente apresurado, sospechoso o ligeramente fuera de caracter, tómate un paso atrás y vérificalo a través de otro canal. Una pausa rápida para confirmar puede detener una voz falsa antes de que conduzca a un problema real.

7. Confía en herramientas de verificación confiables

Los detectores de audio de IA y el software forense están volviéndose herramientas esenciales para detectar deepfakes. Estas tecnologías analizan ondas sonoras, ruido de fondo y patrones de habla para identificar signos sutiles de manipulación que el oído humano puede pasar por alto fácilmente. Aunque confíes en tus instintos, los estudios muestran que el juicio humano no siempre es confiable — incluso los oyentes entrenados pueden ser engañados por clones de voz muy realistas.

Confiar solo en la intuición ya no es suficiente. Se necesitan sistemas de detección robustos para ayudar a individuos, empresas y equipos de seguridad a verificar qué es real y qué es falso. A medida que la tecnología de deepfakes evoluciona, combinar la detección automatizada con el pensamiento crítico puede proteger la comunicación, la reputación y la confianza en el mundo digital.

Mantente alerta, mantente informado

Incluso cuando la tecnología de deepfakes mejora, tu capacidad para escuchar críticamente y cuestionar lo que escuchas sigue siendo una poderosa defensa. Prestar atención a pistas sutiles y verificar la información a través de canales confiables puede detener la manipulación antes de que se propague. Mantenerse alerta y escéptico te ayuda a proteger tus datos y la confianza que mantiene la autenticidad de la comunicación digital.