Ángulo de Anderson

El Futuro de la Generación de Imágenes con RAG

Los modelos de difusión generativa como Stable Diffusion, Flux y los modelos de video como Hunyuan dependen del conocimiento adquirido durante una sola sesión de entrenamiento intensiva en recursos utilizando un conjunto de datos fijo. Cualquier concepto introducido después de este entrenamiento, al que se hace referencia como el corte de conocimiento, está ausente en el modelo a menos que se suplemente a través de ajuste fino o técnicas de adaptación externas como Adaptación de Bajo Rango (LoRA).

Por lo tanto, sería ideal si un sistema generativo que produce imágenes o videos pudiera acceder a fuentes en línea y llevarlas al proceso de generación según sea necesario. De esta manera, por ejemplo, un modelo de difusión que no sabe nada sobre el último lanzamiento de Apple o Tesla aún podría producir imágenes que contengan estos nuevos productos.

En cuanto a los modelos de lenguaje, la mayoría de nosotros estamos familiarizados con sistemas como Perplexity, Notebook LM y ChatGPT-4o, que pueden incorporar información externa novedosa en un modelo de Generación con Recuperación (RAG).

Los procesos RAG hacen que las respuestas de ChatGPT 4o sean más relevantes. Fuente: https://chatgpt.com/

Sin embargo, esta es una comodidad poco común cuando se trata de generar imágenes, y ChatGPT confesará sus propias limitaciones en este respecto:

ChatGPT 4o ha hecho una buena suposición sobre la visualización de un lanzamiento de reloj completamente nuevo, basado en la línea general y en las descripciones que ha interpretado; pero no puede ‘absorber’ e integrar nuevas imágenes en una generación basada en DALL-E.

Incorporar datos recuperados externamente en una imagen generada es desafiante porque la imagen entrante debe primero descomponerse en tokens y incrustaciones, que luego se asignan al conocimiento de dominio entrenado más cercano del modelo.

Aunque este proceso funciona de manera efectiva para herramientas de post-entrenamiento como ControlNet, tales manipulaciones siguen siendo en gran medida superficiales, canalizando esencialmente la imagen recuperada a través de una tubería de renderizado, pero sin integrarla profundamente en la representación interna del modelo.

Como resultado, el modelo carece de la capacidad de generar perspectivas novedosas de la manera en que los sistemas de renderizado neural como NeRF pueden, que construyen escenas con una comprensión espacial y estructural real.

Lógica Madura

Una limitación similar se aplica a las consultas basadas en RAG en Modelos de Lenguaje Grande (LLM), como Perplexity. Cuando un modelo de este tipo procesa datos recuperados externamente, funciona mucho como un adulto que dibuja sobre una vida de conocimiento para inferir probabilidades sobre un tema.

Sin embargo, al igual que una persona no puede integrar retroactivamente nueva información en el marco cognitivo que dio forma a su visión del mundo fundamental – cuando sus prejuicios y preconcepciones aún se estaban formando – un LLM no puede fusionar sin esfuerzo nuevo conocimiento en su estructura preentrenada.

En su lugar, solo puede ‘impactar’ o yuxtaponer los nuevos datos contra su conocimiento internalizado, utilizando principios aprendidos para analizar y conjeturar en lugar de sintetizar a nivel fundamental.

Esta falta de equivalencia entre yuxtapuesta y generación internalizada probablemente sea más evidente en una imagen generada que en una generación basada en lenguaje: las conexiones de red más profundas y la creatividad aumentada de la ‘generación nativa’ (en lugar de la basada en RAG) se han establecido en varios estudios.

Riesgos Ocultos de la Generación de Imágenes con RAG

Incluso si fuera técnicamente factible integrar imágenes de Internet recuperadas en imágenes sintetizadas de manera fluida en un estilo RAG, las limitaciones relacionadas con la seguridad presentarían un desafío adicional.

Muchos conjuntos de datos utilizados para el entrenamiento de modelos generativos se han curado para minimizar la presencia de contenido explícito, racista o violento, entre otras categorías sensibles. Sin embargo, este proceso es imperfecto, y las asociaciones residuales pueden persistir. Para mitigar esto, sistemas como DALL·E y Adobe Firefly confían en mecanismos de filtrado secundarios que examinan tanto las solicitudes de entrada como las salidas generadas para contenido prohibido.

Como resultado, un simple filtro NSFW – que principalmente bloquea contenido explícito – sería insuficiente para evaluar la aceptabilidad de los datos basados en RAG recuperados. Tal contenido podría seguir siendo ofensivo o dañino de maneras que caen fuera de los parámetros de moderación predefinidos del modelo, potencialmente introduciendo material que el AI carece de la conciencia contextual para evaluar adecuadamente.

El descubrimiento de una vulnerabilidad reciente en el DeepSeek producido por el CCP, diseñado para suprimir discusiones de contenido político prohibido, ha resaltado cómo las vías de entrada alternativas pueden ser explotadas para eludir las salvaguardias éticas de un modelo; arguablemente, esto también se aplica a los datos nuevos y arbitrarios recuperados de Internet, cuando se pretende incorporarlos en una nueva generación de imágenes.

RAG para la Generación de Imágenes

A pesar de estos desafíos y aspectos políticos espinosos, han surgido varios proyectos que intentan utilizar métodos RAG para incorporar datos nuevos en generaciones visuales.

ReDi

El proyecto Retrieval-based Diffusion (ReDi) de 2023 es un marco de aprendizaje libre que acelera la inferencia del modelo de difusión al recuperar trayectorias similares de una base de conocimiento precalculada.

Los valores de un conjunto de datos se pueden ‘prestar’ para una nueva generación en ReDi. Fuente: https://arxiv.org/pdf/2302.02285

En el contexto de los modelos de difusión, una trayectoria es el camino paso a paso que el modelo toma para generar una imagen a partir de ruido puro. Normalmente, este proceso sucede gradualmente a lo largo de muchos pasos, con cada paso refinando la imagen un poco más.

ReDi acelera este proceso saltando un montón de esos pasos. En lugar de calcular cada paso individual, recupera una trayectoria similar del pasado de una base de datos y salta hacia un punto posterior en el proceso. Esto reduce el número de cálculos necesarios, lo que hace que la generación de imágenes basada en difusión sea mucho más rápida, manteniendo al mismo tiempo la calidad alta.

ReDi no modifica los pesos del modelo de difusión, sino que utiliza la base de conocimiento para saltar los pasos intermedios, reduciendo así el número de estimaciones de función necesarias para la muestra.

Por supuesto, esto no es lo mismo que incorporar imágenes específicas a voluntad en una solicitud de generación; pero se relaciona con tipos similares de generación.

Lanzado en 2022, el año en que los modelos de difusión latente capturaron la imaginación del público, ReDi parece ser uno de los primeros enfoques basados en la difusión para apoyarse en una metodología RAG.

Aunque debería mencionarse que en 2021, Facebook Research lanzó Instance-Conditioned GAN, que buscaba condicionar imágenes GAN en entradas de imagen novedosas, este tipo de proyección en el espacio latente es extremadamente común en la literatura, tanto para GAN como para modelos de difusión; el desafío es hacer que dicho proceso sea libre de entrenamiento y funcional en tiempo real, como los métodos RAG centrados en LLM.

RDM

Otra incursión temprana en la generación de imágenes con RAG es Retrieval-Augmented Diffusion Models (RDM), que introduce un enfoque semiparamétrico para la síntesis de imágenes generativas. Mientras que los modelos de difusión tradicionales almacenan todo el conocimiento visual aprendido dentro de sus parámetros de red neuronal, RDM confía en una base de datos de imágenes externa:

Los vecinos más cercanos recuperados en una consulta ilustrativa pseudo en RDM*.

Durante el entrenamiento, el modelo recupera vecinos más cercanos (imágenes visual o semánticamente similares) de la base de datos externa, para guiar el proceso de generación. Esto permite que el modelo condicione sus salidas en instancias visuales del mundo real.

El proceso de recuperación está impulsado por incrustaciones CLIP, diseñadas para forzar las imágenes recuperadas a compartir similitudes significativas con la consulta, y también para proporcionar información novedosa para mejorar la generación.

Esto reduce la dependencia de parámetros, facilitando modelos más pequeños que logran resultados competitivos sin la necesidad de conjuntos de datos de entrenamiento extensos.

El enfoque RDM admite modificaciones post-hoc: los investigadores pueden cambiar la base de datos en el momento de la inferencia, lo que permite una adaptación de disparo cero a nuevos estilos, dominios o incluso tareas completamente diferentes, como la síntesis condicional de clase o la estilización.

En las filas inferiores, vemos a los vecinos más cercanos dibujados en el proceso de difusión en RDM*.

Una ventaja clave de RDM es su capacidad para mejorar la generación de imágenes sin volver a entrenar el modelo. Al simplemente alterar la base de datos de recuperación, el modelo puede generalizar a nuevos conceptos en los que nunca se entrenó explícitamente. Esto es particularmente útil para aplicaciones donde ocurren cambios de dominio, como la generación de imágenes médicas basadas en conjuntos de datos en evolución, o la adaptación de modelos de texto a imagen para aplicaciones creativas.

Negativamente, los métodos de recuperación de este tipo dependen de la calidad y la relevancia de la base de datos externa, lo que hace que la curación de datos sea un factor importante para lograr generaciones de alta calidad; y este enfoque sigue estando lejos de una síntesis de imágenes equivalente al tipo de interacciones RAG típicas en LLM comerciales.

ReMoDiffuse

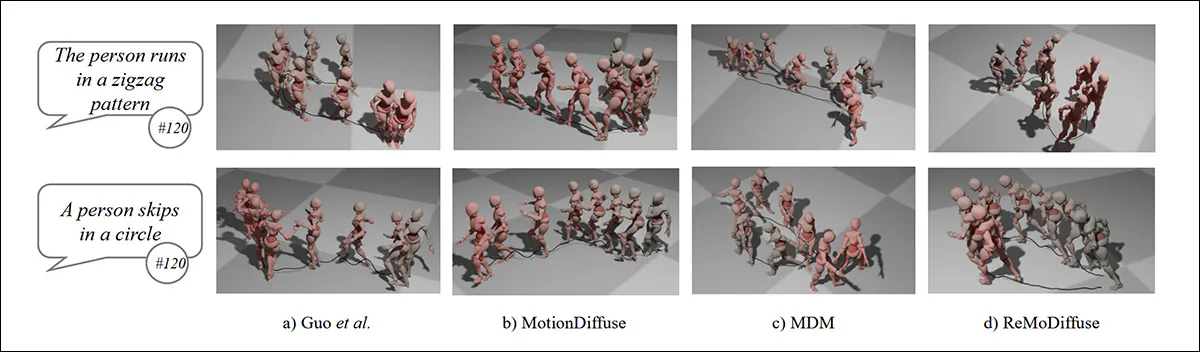

ReMoDiffuse es un modelo de difusión de movimiento con recuperación aumentada diseñado para la generación de movimiento humano en 3D. A diferencia de modelos de generación de movimiento tradicionales que confían puramente en representaciones aprendidas, ReMoDiffuse recupera muestras de movimiento relevantes de un gran conjunto de datos de movimiento y las integra en el proceso de desenoise, en un esquema similar al de RDM (ver arriba).

Comparación de ReMoDiffuse con RAG (derecha) con métodos anteriores. Fuente: https://arxiv.org/pdf/2304.01116

Esto permite que el modelo genere secuencias de movimiento diseñadas para ser más naturales y diversas, así como semánticamente fieles a las solicitudes de texto del usuario.

ReMoDiffuse utiliza un mecanismo de recuperación híbrido innovador, que selecciona secuencias de movimiento basadas en similitudes semánticas y cinemáticas, con la intención de asegurar que los movimientos recuperados no solo sean temáticamente relevantes, sino también físicamente plausibles cuando se integran en la nueva generación.

El modelo luego refina estas muestras recuperadas utilizando un Transformador Modulado por Semántica, que incorpora selectivamente el conocimiento de los movimientos recuperados mientras mantiene las cualidades características de la secuencia generada:

Esquema de la tubería de ReMoDiffuse.

La técnica Mezcla de Condiciones del proyecto mejora la capacidad del modelo para generalizar a través de diferentes solicitudes y condiciones de recuperación, equilibrando las muestras de movimiento recuperadas con las solicitudes de texto durante la generación, y ajustando cuánto peso cada fuente recibe en cada paso.

Esto puede ayudar a prevenir salidas poco realistas o repetitivas, incluso para solicitudes poco comunes. También aborda el problema de sensibilidad a la escala que a menudo surge en las técnicas de guiado libre de clasificador comúnmente utilizadas en los modelos de difusión.

RA-CM3

El modelo de 2023 de Stanford Retrieval-Augmented Multimodal Language Modeling (RA-CM3) permite que el sistema acceda a información del mundo real en el momento de la inferencia:

El modelo RA-CM3 de Stanford utiliza imágenes recuperadas de Internet para aumentar el proceso de generación, pero sigue siendo un prototipo sin acceso público. Fuente: https://cs.stanford.edu/~myasu/files/RACM3_slides.pdf

RA-CM3 integra texto y imágenes recuperadas en la tubería de generación, mejorando tanto la síntesis de texto a imagen como la de imagen a texto. Utilizando CLIP para la recuperación y un Transformador como el generador, el modelo se refiere a documentos multimodales pertinentes antes de componer una salida.

Los benchmarks en MS-COCO muestran mejoras notables sobre DALL-E y sistemas similares, logrando una reducción de 12 puntos en la Fréchet Inception Distance (FID), con un costo computacional mucho menor.

Sin embargo, al igual que con otros enfoques de recuperación aumentada, RA-CM3 no internaliza sin esfuerzo su conocimiento recuperado. En su lugar, superpone nuevos datos contra su red neuronal preentrenada, mucho como un LLM que aumenta respuestas con resultados de búsqueda. Si bien este método puede mejorar la precisión factual, no reemplaza la necesidad de actualizaciones de entrenamiento en dominios donde se requiere una síntesis profunda.

Además, una implementación práctica de este sistema no parece haber sido lanzada, incluso en una plataforma basada en API.

RealRAG

Un nuevo lanzamiento de China, y el que ha provocado esta mirada a los sistemas generativos de imágenes con RAG, se llama Retrieval-Augmented Realistic Image Generation (RealRAG).

Imágenes externas dibujadas en RealRAG (centro inferior). Fuente: https://arxiv.o7rg/pdf/2502.00848

RealRAG recupera imágenes reales de objetos relevantes de una base de datos curada a partir de conjuntos de datos públicamente disponibles como ImageNet, Stanford Cars, Stanford Dogs y Oxford Flowers. Luego integra las imágenes recuperadas en el proceso de generación, abordando las brechas de conocimiento en el modelo.

Un componente clave de RealRAG es el aprendizaje contrastivo autorreflexivo, que entrena un modelo de recuperación para encontrar imágenes de referencia informativas, en lugar de solo seleccionar visualmente similares.