Inteligencia artificial

RigNeRF: Un nuevo método de Deepfakes que utiliza campos de radiancia neural

Nueva investigación desarrollada en Adobe ofrece el primer método viable y eficaz de deepfakes basado en Campos de Radiancia Neural (NeRF) – quizás la primera innovación real en arquitectura o enfoque en los cinco años desde la aparición de los deepfakes en 2017.

El método, titulado RigNeRF, utiliza modelos de cara morfables 3D (3DMM) como una capa intermedia de instrumentación entre la entrada deseada (es decir, la identidad que se va a imponer en el render de NeRF) y el espacio neural, un método que ha sido ampliamente adoptado en los últimos años por enfoques de síntesis de caras de Generative Adversarial Network (GAN), ninguno de los cuales ha producido aún marcos de reemplazo de caras funcionales y útiles para video.

A diferencia de los videos de deepfakes tradicionales, absolutamente nada del contenido en movimiento que se muestra aquí es ‘real’, sino que es un espacio neural explorable que se entrenó en metraje breve. A la derecha vemos el modelo de cara morfable 3D (3DMM) actuando como una interfaz entre las manipulaciones deseadas (‘sonreír’, ‘mirar a la izquierda’, ‘mirar hacia arriba’, etc.) y los parámetros usualmente inaccesibles de una visualización de campo de radiancia neural. Para una versión de alta resolución de este clip, junto con otros ejemplos, consulte la página del proyecto, o los videos incrustados al final de este artículo. Fuente: https://shahrukhathar.github.io/2022/06/06/RigNeRF.html

Los 3DMM son efectivamente modelos de CGI de caras, cuyos parámetros pueden adaptarse a sistemas de síntesis de imagen más abstractos, como NeRF y GAN, que de otra manera son difíciles de controlar.

Lo que se ve en la imagen de arriba (imagen del medio, hombre con camisa azul), así como la imagen directamente debajo (imagen de la izquierda, hombre con camisa azul), no es un video ‘real’ en el que se ha superpuesto un parche de ‘cara falsa’, sino una escena completamente sintetizada que existe únicamente como una representación neural volumétrica – incluyendo el cuerpo y el fondo:

En el ejemplo directamente arriba, el video de la vida real a la derecha (mujer con vestido rojo) se utiliza para ‘manipular’ la identidad capturada (hombre con camisa azul) a la izquierda a través de RigNeRF, que (según afirman los autores) es el primer sistema basado en NeRF que logra separar la pose y la expresión mientras puede realizar síntesis de vistas novedosas.

La figura masculina a la izquierda en la imagen de arriba se ‘capturó’ a partir de un video de 70 segundos de un smartphone, y los datos de entrada (incluida la información de la escena completa) se entrenaron posteriormente en 4 V100 GPUs para obtener la escena.

Dado que los modelos de cara morfables 3D también están disponibles como proxies de CGI paramétricos de cuerpo completo (en lugar de solo modelos de cara), RigNeRF potencialmente abre la posibilidad de deepfakes de cuerpo completo donde el movimiento, la textura y la expresión humanos reales se pasan a la capa paramétrica basada en CGI, que luego traduciría la acción y la expresión en entornos y videos renderizados de NeRF.

En cuanto a RigNeRF – ¿califica como un método de deepfakes en el sentido actual en que los titulares entienden el término? ¿O es solo otro también-ran semi-cojo a DeepFaceLab y otros sistemas de deepfakes autoencoder de 2017, laboriosos y intensivos?

Los investigadores del nuevo artículo son inequívocos sobre este punto:

‘Al ser un método capaz de reanimar caras, RigNeRF es propenso a ser utilizado por actores maliciosos para generar deepfakes.’

El nuevo artículo se titula RigNeRF: Retratos neuronales 3D completamente controlables, y proviene de ShahRukh Atha de la Universidad de Stonybrook, un internado en Adobe durante el desarrollo de RigNeRF, y cuatro otros autores de Adobe Research.

Más allá de los deepfakes basados en autoencoder

La mayoría de los deepfakes virales que han capturado los titulares en los últimos años son producidos por sistemas basados en autoencoder, derivados del código que se publicó en el subreddit r/deepfakes prohibido en 2017 – aunque no antes de ser copiado a GitHub, donde ha sido bifurcado más de mil veces, no menos en la popular (aunque controvertida) DeepFaceLab distribución, y también el proyecto FaceSwap.

Además de GAN y NeRF, los marcos de autoencoder también han experimentado con 3DMM como ‘directrices’ para marcos de síntesis de caras mejorados. Un ejemplo de esto es el proyecto HifiFace de julio de 2021. Sin embargo, no parecen haber desarrollado iniciativas útiles o populares a partir de este enfoque hasta la fecha.

Los datos para las escenas de RigNeRF se obtienen capturando videos de smartphone cortos. Para el proyecto, los investigadores de RigNeRF utilizaron un iPhone XR o un iPhone 12 para todos los experimentos. Para la primera mitad de la captura, se le pide al sujeto que realice una amplia gama de expresiones faciales y habla mientras mantiene la cabeza quieta mientras la cámara se mueve alrededor de ellos.

Para la segunda mitad de la captura, la cámara mantiene una posición fija mientras el sujeto debe mover la cabeza alrededor mientras muestra una amplia gama de expresiones. El metraje resultante de 40-70 segundos (alrededor de 1200-2100 cuadros) representa el conjunto de datos completo que se utilizará para entrenar el modelo.

Reducir la recopilación de datos

En contraste, los sistemas de autoencoder como DeepFaceLab requieren la recopilación y curación relativamente laboriosa de miles de fotos diversas, a menudo tomadas de videos de YouTube y otros canales de redes sociales, así como de películas (en el caso de deepfakes de celebridades).

Los modelos de autoencoder entrenados resultantes a menudo están destinados a ser utilizados en una variedad de situaciones. Sin embargo, los ‘deepfakers’ de celebridades más escrupulosos pueden entrenar modelos completos desde cero para un solo video, a pesar de que el entrenamiento puede tardar una semana o más.

A pesar de la nota de advertencia de los investigadores del nuevo artículo, los conjuntos de datos ‘de patchwork’ y ampliamente ensamblados que alimentan el porno AI, así como los ‘recastings’ de deepfakes populares en YouTube/TikTok, parecen poco probable que produzcan resultados aceptables y coherentes en un sistema de deepfakes como RigNeRF, que tiene una metodología específica de escena. Dado que las restricciones sobre la captura de datos descritas en el nuevo trabajo, esto podría probar, hasta cierto punto, una salvaguarda adicional contra la apropiación casual de identidad por parte de deepfakers maliciosos.

Ajustar NeRF a video de deepfake

NeRF es un método basado en fotogrametría en el que se ensamblan un pequeño número de imágenes de origen tomadas desde diferentes puntos de vista en un espacio neural explorable. Este enfoque llegó a prominencia a principios de este año cuando NVIDIA presentó su sistema Instant NeRF, capaz de reducir los tiempos de entrenamiento exorbitantes para NeRF a minutos, o incluso segundos:

Instant NeRF. Fuente: https://www.youtube.com/watch?v=DJ2hcC1orc4

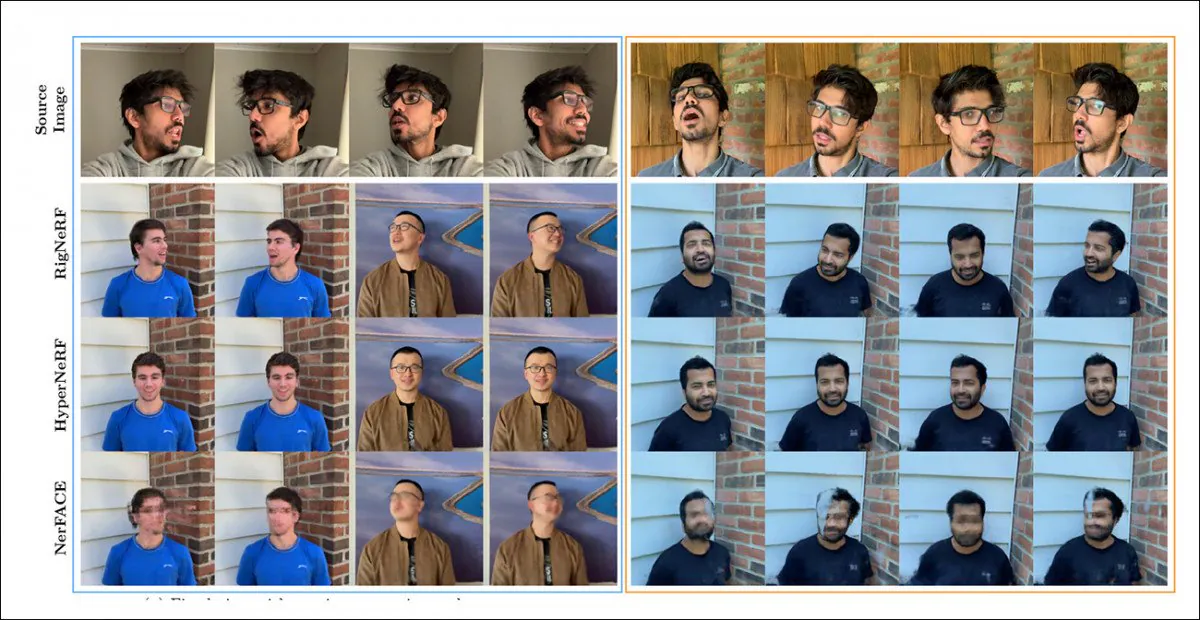

El campo de radiancia neural resultante es esencialmente un entorno estático que se puede explorar, pero que es difícil de editar. Los investigadores observan que dos iniciativas anteriores basadas en NeRF – HyperNeRF + E/P y NerFACE – han intentado la síntesis de video facial, y (aparentemente por sake de la compleción y la diligencia) han establecido RigNeRF contra estos dos marcos en una ronda de pruebas:

Una comparación cualitativa entre RigNeRF, HyperNeRF y NerFACE. Consulte los videos y el PDF vinculados para versiones de mayor calidad. Fuente de imagen estática: https://arxiv.org/pdf/2012.03065.pdf

Sin embargo, en este caso los resultados, que favorecen a RigNeRF, son bastante anómalos, por dos razones: primero, los autores observan que ‘no hay un trabajo existente para una comparación manzana a manzana’; segundo, esto ha necesitado limitar las capacidades de RigNeRF para que coincida al menos parcialmente con la funcionalidad más restringida de los sistemas anteriores.

Dado que los resultados no son una mejora incremental en el trabajo anterior, sino que representan un ‘avance’ en la edición y utilidad de NeRF, dejaremos la ronda de pruebas a un lado, y en su lugar veremos qué está haciendo RigNeRF de manera diferente a sus predecesores.

Fuerzas combinadas

La limitación principal de NerFACE, que puede crear control de pose/expresión en un entorno de NeRF, es que supone que el metraje de origen se capturará con una cámara estática. Esto efectivamente significa que no puede producir vistas novedosas que se extiendan más allá de sus limitaciones de captura. Esto produce un sistema que puede crear ‘retratos en movimiento’, pero que es inadecuado para video de estilo deepfake.

HyperNeRF, por otro lado, mientras puede generar vistas hiperrealistas y novedosas, no tiene instrumentación que le permita cambiar poses de cabeza o expresiones faciales, lo que nuevamente no resulta en ningún tipo de competidor para los deepfakes basados en autoencoder.

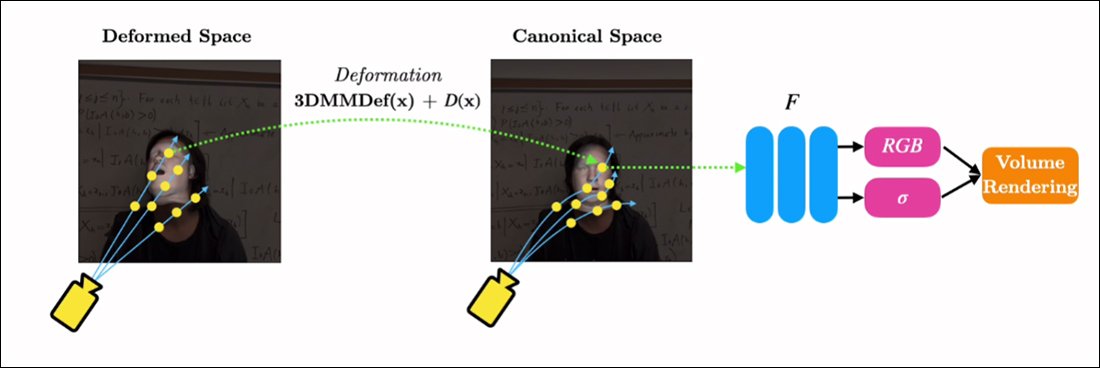

RigNeRF es capaz de combinar estas dos funcionalidades aisladas creando un ‘espacio canónico’, una línea de base predeterminada desde la cual se pueden realizar desviaciones y deformaciones a través de la entrada del módulo 3DMM.

Creando un ‘espacio canónico’ (sin pose, sin expresión), en el que las deformaciones (es decir, poses y expresiones) producidas a través del 3DMM pueden actuar.

Dado que el sistema 3DMM no coincidirá exactamente con el sujeto capturado, es importante compensar esto en el proceso. RigNeRF logra esto con un campo de deformación previo que se calcula a partir de un Perceptrón Multicapa (MLP) derivado del metraje de origen.

Los parámetros de cámara necesarios para calcular las deformaciones se obtienen a través de COLMAP, mientras que los parámetros de expresión y forma para cada cuadro se obtienen de DECA.

La posición se optimiza aún más a través de ajuste de puntos de referencia y los parámetros de cámara de COLMAP, y, debido a las restricciones de recursos de cómputo, la salida de video se reduce a una resolución de 256×256 para el entrenamiento (un proceso de reducción de hardware que también afecta a la escena de deepfakes autoencoder).

Después de esto, la red de deformación se entrena en los cuatro V100 – un hardware formidable que no es probable que esté al alcance de los entusiastas casuales (sin embargo, donde se trata del entrenamiento de aprendizaje automático, a menudo es posible comerciar con la fuerza por el tiempo, y simplemente aceptar que el entrenamiento del modelo será cuestión de días o incluso semanas).

En conclusión, los investigadores afirman:

‘A diferencia de otros métodos, RigNeRF, gracias al uso de un módulo de deformación guiado por 3DMM, es capaz de modelar la pose de la cabeza, las expresiones faciales y el retrato 3D completo con alta fidelidad, lo que da como resultado mejores reconstrucciones con detalles nítidos.’

Consulte los videos incrustados a continuación para más detalles y metraje de resultados.

Publicado por primera vez el 15 de junio de 2022.