Inteligencia artificial

Una perspectiva personal sobre las tendencias de la literatura de visión por computadora en 2024

He estado siguiendo continuamente la escena de investigación de visión por computadora (CV) y síntesis de imágenes en Arxiv y en otros lugares durante unos cinco años, por lo que las tendencias se vuelven evidentes con el tiempo, y cambian en nuevas direcciones cada año.

Por lo tanto, a medida que 2024 llega a su fin, pensé que sería apropiado echar un vistazo a algunas de las nuevas o evolucionadas características en las presentaciones de Arxiv en la sección de Visión por Computadora y Reconocimiento de Patrones section. Estas observaciones, aunque informadas por cientos de horas de estudio de la escena, son estrictamente anecdóticas.

El ascenso continuo de Asia Oriental

Al final de 2023, había notado que la mayoría de la literatura en la categoría de síntesis de voz provenía de China y otras regiones de Asia Oriental. Al final de 2024, tengo que observar (de manera anecdótica) que esto ahora también se aplica a la escena de investigación de síntesis de imágenes y videos.

Esto no significa que China y los países adyacentes necesariamente siempre produzcan el mejor trabajo (de hecho, hay algunas pruebas en contrario); ni tiene en cuenta la alta probabilidad de que algunos de los sistemas más interesantes y poderosos en desarrollo sean propiedad de empresas y estén excluidos de la literatura de investigación.

Pero sugiere que Asia Oriental está superando a Occidente en volumen, en este respecto. Lo que esto vale depende de la medida en que cree en la viabilidad de la persistencia al estilo de Edison, que generalmente resulta ineficaz frente a obstáculos intractables.

Hay muchos obstáculos en la inteligencia artificial generativa, y no es fácil saber cuáles se pueden resolver abordando arquitecturas existentes, y cuáles necesitarán ser reconsideradas desde cero.

Aunque los investigadores de Asia Oriental parecen producir un mayor número de artículos de visión por computadora, he notado un aumento en la frecuencia de proyectos de estilo “Frankenstein” – iniciativas que constituyen una fusión de trabajos anteriores, mientras agregan poca novedad arquitectónica (o posiblemente solo un tipo diferente de datos).

Este año, un número mucho mayor de colaboraciones de Asia Oriental (primariamente chinas o chino-estadounidenses) parecían estar impulsadas por cuotas en lugar de mérito, aumentando significativamente la relación señaligeno en un campo ya sobresuscrito.

Al mismo tiempo, un mayor número de artículos de Asia Oriental también han captado mi atención y admiración en 2024. Así que si esto es un juego de números, no está fallando – pero tampoco es barato.

Aumento del volumen de presentaciones

El volumen de artículos, en todos los países de origen, ha aumentado evidentemente en 2024.

El día de publicación más popular cambia a lo largo del año; en este momento es el martes, cuando el número de presentaciones a la sección de Visión por Computadora y Reconocimiento de Patrones es a menudo de alrededor de 300-350 en un solo día, en los períodos “pico” (mayo-agosto y octubre-diciembre, es decir, temporada de conferencias y “temporada de plazos de cuotas” respectivamente).

Más allá de mi propia experiencia, Arxiv mismo informa un número récord de presentaciones en octubre de 2024, con 6000 nuevas presentaciones en total, y la sección de Visión por Computadora es la segunda sección más presentada después de Aprendizaje Automático.

Sin embargo, dado que la sección de Aprendizaje Automático en Arxiv a menudo se utiliza como una categoría “adicional” o agregada, esto argumenta a favor de que la Visión por Computadora y el Reconocimiento de Patrones son en realidad la categoría más presentada en Arxiv.

Las propias estadísticas de Arxiv ciertamente muestran que la ciencia de la computación es el líder claro en presentaciones:

La ciencia de la computación (CS) domina las estadísticas de presentaciones en Arxiv durante los últimos cinco años. Fuente: https://info.arxiv.org/about/reports/submission_category_by_year.html

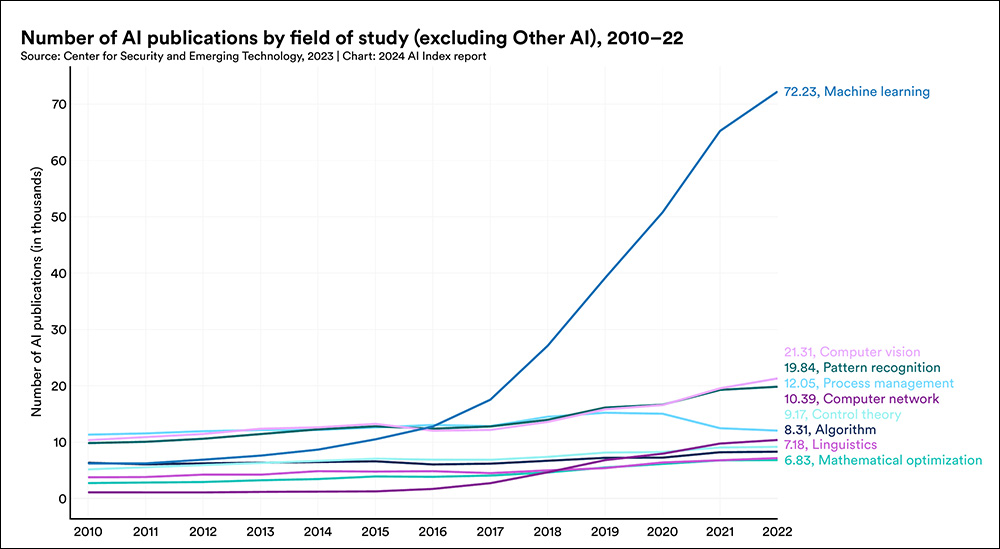

El Índice de IA de Stanford de 2024, aunque no puede informar sobre estadísticas más recientes, también enfatiza el notable aumento en las presentaciones de artículos académicos sobre aprendizaje automático en los últimos años:

Con cifras no disponibles para 2024, el informe de Stanford muestra dramáticamente el aumento del volumen de presentaciones de artículos de aprendizaje automático. Fuente: https://aiindex.stanford.edu/wp-content/uploads/2024/04/HAI_AI-Index-Report-2024_Chapter1.pdf

La proliferación de marcos de difusión>malla

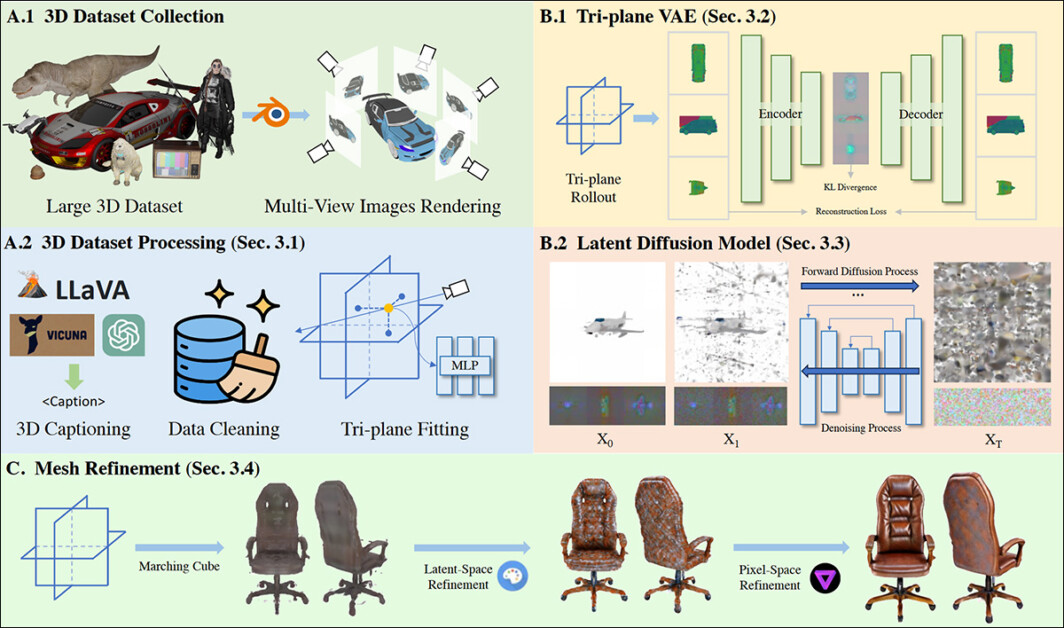

Otra tendencia clara que surgió para mí fue un gran aumento en los artículos que tratan de aprovechar los Modelos de Difusión Latente (LDM) como generadores de modelos de CGI basados en mallas.

Los proyectos de este tipo incluyen InstantMesh3D, 3Dtopia, Difusión2, V3D, MVEdit, y GIMDifusión, entre muchos otros.

Generación y refinamiento de malla a través de un proceso de difusión en 3Dtopia. Fuente: https://arxiv.org/pdf/2403.02234

Esta rama de investigación emergente podría considerarse como una concesión tácita a la continua intractabilidad de los sistemas generativos como los modelos de difusión, que hace solo dos años estaban siendo promocionados como un posible sustituto de todos los sistemas que los modelos de difusión>malla ahora están buscando poblar; relegando la difusión al papel de una herramienta en tecnologías y flujos de trabajo que datan de treinta o más años.

Stability.ai, los originadores del modelo de difusión estable de código abierto Stable Diffusion, acaban de lanzar Stable Zero123, que puede, entre otras cosas, utilizar una interpretación de Neural Radiance Fields (NeRF) de una imagen generada por IA como un puente para crear un modelo de CGI explícito y basado en malla que se puede utilizar en arenas de CGI como Unity, en videojuegos, realidad aumentada y en otras plataformas que requieren coordenadas 3D explícitas, en lugar de las coordenadas implícitas (ocultas) de funciones continuas.

Haga clic para reproducir. Las imágenes generadas en Stable Diffusion se pueden convertir en mallas de CGI racionales. Aquí vemos el resultado de un flujo de trabajo de imagen a CGI que utiliza Stable Zero 123. Fuente: https://www.youtube.com/watch?v=RxsssDD48Xc

Semántica 3D

El espacio de inteligencia artificial generativa hace una distinción entre implementaciones de sistemas de visión y generación en 2D y 3D. Por ejemplo, marcos de marcadores faciales, aunque representan objetos 3D (caras) en todos los casos, no todos necesariamente calculan coordenadas 3D direccionables.

El popular sistema FANAlign, ampliamente utilizado en arquitecturas de deepfakes de 2017 (entre otras), puede acomodar ambos enfoques:

Arriba, los puntos de referencia 2D se generan en función de los lineamientos y características faciales reconocidos. Abajo, se racionalizan en espacio 3D X/Y/Z. Fuente: https://github.com/1adrianb/face-alignment

Así que, al igual que ‘deepfake’ se ha convertido en un término ambiguo y secuestrado, ‘3D’ también se ha convertido en un término confuso en la investigación de visión por computadora.

Para los consumidores, ha significado típicamente medios con capacidad de estereoscopía (como películas donde el espectador debe usar gafas especiales); para los profesionales de efectos visuales y modeladores, proporciona la distinción entre el arte 2D (como bocetos conceptuales) y los modelos basados en malla que se pueden manipular en un programa “3D” como Maya o Cinema4D.

Pero en visión por computadora, simplemente significa que existe un sistema de coordenadas cartesianas en algún lugar del espacio latente del modelo – no que necesariamente pueda ser direccionado o manipulado directamente por un usuario; al menos, no sin sistemas interpretativos de CGI de terceros como 3DMM o FLAME.

Por lo tanto, la noción de difusión>3D es inexacta; no solo se puede utilizar cualquier tipo de imagen (incluyendo una foto real) como entrada para producir un modelo de CGI generativo, sino que el término menos ambiguo es ‘malla’.

Sin embargo, para comprender la ambigüedad, la difusión es necesaria para interpretar la foto de origen en una malla, en la mayoría de los proyectos emergentes. Así que una mejor descripción podría ser imagen-a-malla, mientras que imagen>difusión>malla es una descripción aún más precisa.

Pero eso es difícil de vender en una reunión de la junta directiva o en un comunicado de prensa diseñado para atraer a los inversores.

Evidencia de estancamientos arquitectónicos

Incluso en comparación con 2023, la cosecha de artículos de los últimos 12 meses exhibe un creciente desespero por eliminar los límites prácticos difíciles de la generación basada en difusión.

El principal obstáculo sigue siendo la generación de video narrativa y temporalmente coherente, y mantener una apariencia coherente de personajes y objetos – no solo a través de diferentes clips de video, sino incluso a lo largo de la corta duración de un clip de video generado.

La última innovación época en síntesis basada en difusión fue el advenimiento de LoRA en 2022. Mientras que sistemas más nuevos como Flux han mejorado algunos de los problemas de valores atípicos, como la incapacidad anterior de Stable Diffusion para reproducir contenido de texto dentro de una imagen generada, y la calidad general de la imagen ha mejorado, la mayoría de los artículos que estudié en 2024 fueron esencialmente solo mover la comida en el plato.

Estos estancamientos han ocurrido antes, con Redes Generativas Adversarias (GAN) y con Campos de Radiancia Neural (NeRF), ambos de los cuales no cumplieron con su aparente potencial inicial – y ambos de los cuales están siendo cada vez más utilizados en sistemas más convencionales (como el uso de NeRF en Stable Zero 123, ver arriba). Esto también parece estar sucediendo con los modelos de difusión.

Investigación de salpicadura gaussiana pivotando

Parecía que al final de 2023, el método de rasterización 3D Gaussian Splatting (3DGS), que debutó como una técnica de imagen médica a principios de la década de 1990, estaba a punto de superar repentinamente a los sistemas basados en autoencoder de desafíos de síntesis de imágenes humanas (como simulación y recreación facial, así como transferencia de identidad).

El artículo ASH de 2023 prometió humanos de 3DGS completos, mientras que Gaussian Avatars ofreció detalles mejorados (en comparación con métodos competidores) junto con una reescenificación impresionante.

Sin embargo, este año ha sido relativamente corto en momentos de avance para la síntesis humana de 3DGS; la mayoría de los artículos que abordaron el problema fueron o derivados de los trabajos anteriores, o no lograron superar sus capacidades.

En su lugar, el énfasis en 3DGS ha sido en mejorar su viabilidad arquitectónica fundamental, lo que ha llevado a una serie de artículos que ofrecen entornos exteriores de 3DGS mejorados. Se ha prestado atención particular a los enfoques de Localización y Mapeo Simultáneo (SLAM) de 3DGS, en proyectos como Gaussian Splatting SLAM, Splat-SLAM, Gaussian-SLAM, DROID-Splat, entre muchos otros.

Los proyectos que intentaron continuar o extender la síntesis humana basada en salpicadura incluyeron MIGS, GEM, EVA, OccFusion, FAGhead, HumanSplat, GGHead, HGM, y Topo4D. Aunque hay otros además, ninguno de estos logró igualar el impacto inicial de los artículos que surgieron a fines de 2023.

La era de Weinstein de muestras de prueba está en declive (lento)

La investigación de Asia Sudoriental en general (y China en particular) a menudo presenta ejemplos de prueba problemáticos para republicar en un artículo de revisión, porque presentan material que es un poco “picante”.

Si esto se debe a que los científicos de investigación en esa parte del mundo están buscando atraer atención para su producción es algo debatible; pero durante los últimos 18 meses, un número creciente de artículos sobre inteligencia artificial generativa (imagen y/o video) han recurrido a utilizar mujeres y niñas jóvenes y ligeramente vestidas en ejemplos de proyectos. Ejemplos límite de NSFW incluyen UniAnimate, ControlNext, e incluso artículos muy “secos” como Evaluación de la coherencia del movimiento mediante la distancia de movimiento de video de Fréchet (FVMD).

Esto sigue las tendencias generales de subreddits y otras comunidades que se han reunido alrededor de los Modelos de Difusión Latente (LDM), donde la Regla 34 sigue siendo muy evidente.

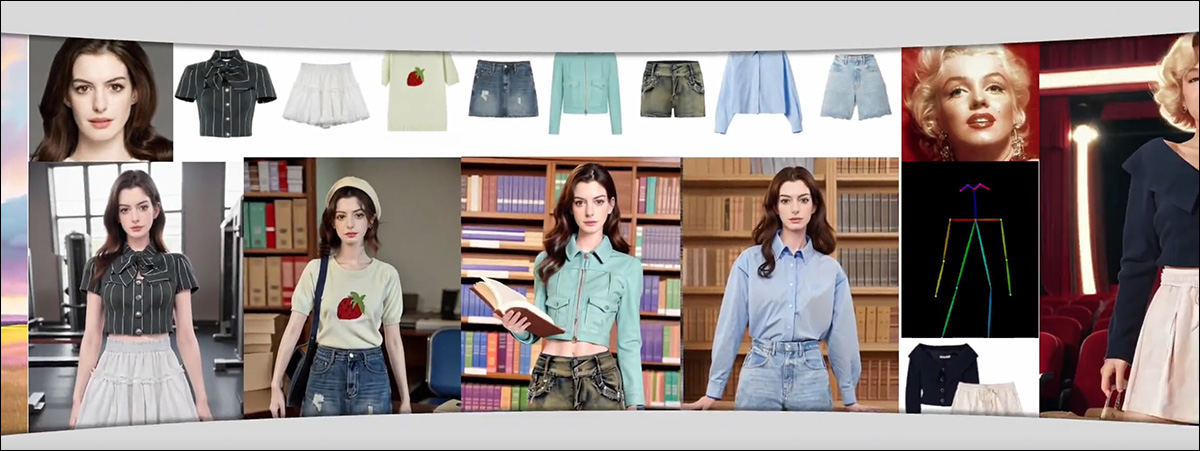

Enfrentamiento de celebridades

Este tipo de ejemplo inapropiado se superpone con el creciente reconocimiento de que los procesos de IA no deben explotar arbitrariamente las semejanzas de las celebridades – particularmente en estudios que utilizan ejemplos que presentan celebridades atractivas, a menudo femeninas, y las colocan en contextos cuestionables.

Un ejemplo es AnyDressing, que, además de presentar personajes femeninos jóvenes de estilo anime, también utiliza liberalmente las identidades de celebridades clásicas como Marilyn Monroe, y actuales como Ann Hathaway (quien ha denunciado este tipo de uso muy vocalmente).

El uso arbitrario de celebridades actuales y ‘clásicas’ sigue siendo bastante común en artículos de Asia Sudoriental, aunque la práctica está ligeramente en declive. Fuente: https://crayon-shinchan.github.io/AnyDressing/

En artículos occidentales, esta práctica en particular ha estado en declive durante todo 2024, liderada por los lanzamientos más grandes de FAANG y otros cuerpos de investigación de alto nivel como OpenAI. Críticamente conscientes del potencial de litigios futuros, estos grandes actores corporativos parecen cada vez más renuentes a representar incluso personas ficticias fotorealistas.

Aunque los sistemas que están creando (como Imagen y Veo2) son claramente capaces de tal salida, los ejemplos de proyectos de inteligencia artificial generativa occidentales ahora tienden hacia imágenes y videos ‘bonitos’, ‘disneyificados’ y extremadamente ‘seguros’.

A pesar de alardear la capacidad de Imagen para crear salida ‘fotorealista’, las muestras promocionadas por Google Research son típicamente fantásticas, ‘para toda la familia’ – se evitan cuidadosamente los humanos fotorealistas, o se proporcionan ejemplos mínimos. Fuente: https://imagen.research.google/

Lavado de caras

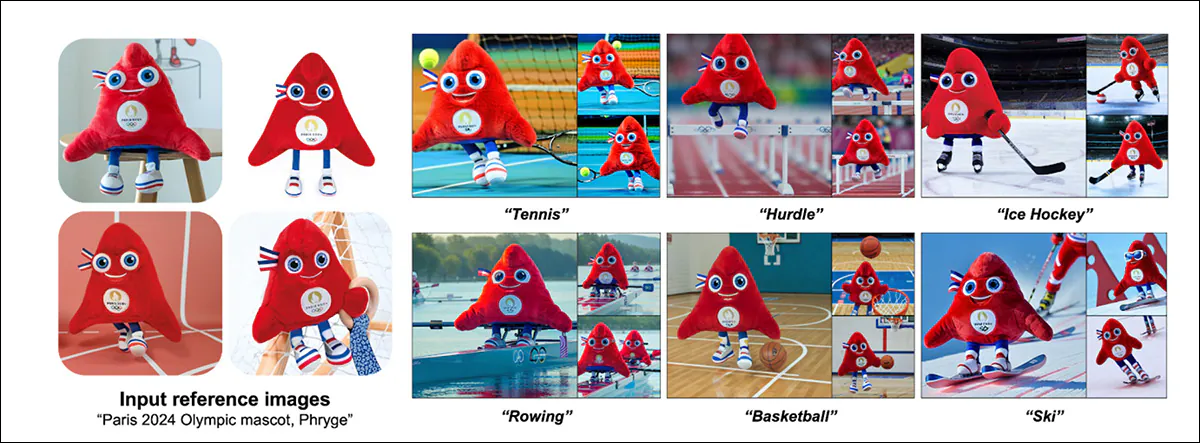

En la literatura de visión por computadora occidental, este enfoque engañoso es particularmente evidente para sistemas de personalización – métodos que son capaces de crear semejanzas coherentes de una persona en particular a través de múltiples ejemplos (es decir, como LoRA y el antiguo DreamBooth).

Ejemplos incluyen incrustación visual ortogonal, LoRA-Composer, InstructBooth de Google, y muchos más.

InstructBooth de Google sube el factor de ternura a 11, aunque la historia sugiere que los usuarios están más interesados en crear humanos fotorealistas que personajes peludos o divertidos. Fuente: https://sites.google.com/view/instructbooth

Sin embargo, el aumento del ‘ejemplo bonito’ se ve en otras áreas de investigación de visión por computadora y síntesis, en proyectos como Comp4D, V3D, DesignEdit, UniEdit, FaceChain (que admite expectativas de usuario más realistas en su página de GitHub), y DPG-T2I, entre muchos otros.

La facilidad con la que dichos sistemas (como LoRAs) pueden ser creados por usuarios domésticos con hardware relativamente modesto ha llevado a una explosión de modelos de celebridades descargables gratuitamente en el dominio civit.ai y la comunidad. Tal uso ilícito sigue siendo posible a través de la apertura de arquitecturas como Stable Diffusion y Flux.

Aunque a menudo es posible sortear las características de seguridad de los sistemas de imagen a texto (T2I) y texto a video (T2V) para producir material prohibido por las condiciones de uso de una plataforma, la brecha entre las capacidades restringidas de los mejores sistemas (como RunwayML y Sora), y las capacidades ilimitadas de los sistemas simplemente performantes (como Stable Video Diffusion, CogVideo y despliegues locales de Hunyuan), no está cerrándose realmente, como muchos creen.

Más bien, estos sistemas propietarios y de código abierto, respectivamente, amenazan con volverse igualmente inútiles: los sistemas T2V de gran escala y costosos pueden quedar excesivamente limitados debido a temores de litigios, mientras que la falta de infraestructura de licencia y supervisión de datos en los sistemas de código abierto podría bloquearlos por completo del mercado a medida que se implementan regulaciones más estrictas.

Publicado por primera vez el martes 24 de diciembre de 2024