Inteligencia artificial

La definición esquiva de ‘Deepfake’

Un estudio nuevo y convincente de Alemania critica la definición del término ‘deepfake’ en el Acta de IA de la UE como excesivamente vaga, particularmente en el contexto de la manipulación de imágenes digitales. Los autores argumentan que el énfasis del Acta en el contenido que se asemeja a personas o eventos reales – pero que potencialmente aparece falso – carece de claridad.

También resaltan que las excepciones del Acta para la ‘edición estándar’ (es decir, supuestas modificaciones menores con ayuda de IA a las imágenes) no consideran tanto la influencia generalizada de la IA en las aplicaciones de consumo como la naturaleza subjetiva de las convenciones artísticas que preceden al advenimiento de la IA.

La legislación imprecisa sobre estos asuntos da lugar a dos riesgos clave: un ‘efecto de enfriamiento’, donde el alcance interpretativo amplio de la ley sofoca la innovación y la adopción de nuevos sistemas; y un ‘efecto de desprecio a la ley’, donde la ley es desestimada por ser excesiva o irrelevante.

En cualquier caso, las leyes vagas transfieren efectivamente la responsabilidad de establecer definiciones legales prácticas a los fallos judiciales futuros – un enfoque cauteloso y averso al riesgo para la legislación.

Las tecnologías de manipulación de imágenes basadas en IA siguen siendo notoriamente más avanzadas que la capacidad de la legislación para abordarlas, al parecer. Por ejemplo, un ejemplo notable de la creciente elasticidad del concepto de post-procesamiento ‘automático’ impulsado por IA, el documento observa, es la función ‘Optimizador de escena’ en las cámaras Samsung recientes, que puede reemplazar imágenes tomadas por el usuario de la luna (un sujeto desafiante) con una imagen ‘refinada’ impulsada por IA:

Top left, an example from the new paper of a real user-taken image of the moon, to the left of a Samsung-enhanced version automatically created with Scene Optimizer; Right, Samsung’s official illustration of the process behind this; lower left, examples from the Reddit user u/ibreakphotos, showing (left) a deliberately blurred image of the moon and (right), Samsung’s re-imagining of this image – even though the source photo was a picture of a monitor, and not the real moon. Sources (clockwise from top-left): https://arxiv.org/pdf/2412.09961; https://www.samsung.com/uk/support/mobile-devices/how-galaxy-cameras-combine-super-resolution-technologies-with-ai-to-produce-high-quality-images-of-the-moon/; https:/reddit.com/r/Android/comments/11nzrb0/samsung_space_zoom_moon_shots_are_fake_and_here/

En la parte inferior izquierda de la imagen anterior, vemos dos imágenes de la luna. La de la izquierda es una foto tomada por un usuario de Reddit. Aquí, la imagen ha sido intencionalmente desenfocada y reducida por el usuario.

A su derecha vemos una foto de la misma imagen degradada tomada con una cámara Samsung con post-procesamiento impulsado por IA habilitado. La cámara ha ‘mejorado’ automáticamente el objeto ‘luna’ reconocido, aunque no era la luna real.

El documento critica más profundamente la función Best Take incorporada en los teléfonos inteligentes recientes de Google – una controvertida función de IA que edita las ‘mejores’ partes de una foto de grupo, escaneando múltiples segundos de una secuencia de fotografía para que las sonrisas se muevan hacia adelante o hacia atrás en el tiempo según sea necesario – y nadie se muestra en medio de parpadear.

El documento sostiene que este tipo de proceso compuesto tiene el potencial de tergiversar eventos:

‘[En] un entorno de foto de grupo típico, un espectador promedio probablemente consideraría la foto resultante como auténtica. La sonrisa que se inserta existía dentro de unos segundos de que se tomara la foto restante.

‘Por otro lado, el marco de tiempo de diez segundos de la función de mejor toma es suficiente para un cambio de estado de ánimo. Una persona podría haber dejado de sonreír mientras el resto del grupo se ríe de una broma a su costa.

‘Como consecuencia, asumimos que dicha foto de grupo puede constituir un deep fake.’

El nuevo documento se titula ¿Qué constituye un deep fake? La línea borrosa entre el procesamiento legítimo y la manipulación bajo el Acta de IA de la UE, y proviene de dos investigadores del Laboratorio de Derecho Computacional de la Universidad de Tübingen y la Universidad de Saarland.

Trucos antiguos

Manipular el tiempo en la fotografía es mucho más antiguo que la IA de consumo. Los autores del nuevo documento observan la existencia de técnicas mucho más antiguas que se pueden argumentar como ‘no auténticas’, como la concatenación de múltiples imágenes secuenciales en una foto de rango dinámico alto (HDR) o una ‘foto estichada’ panorámica.

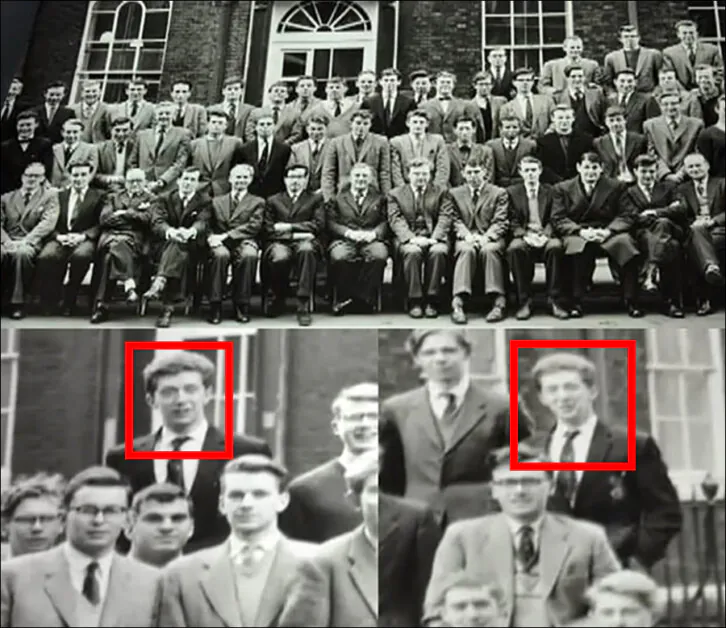

De hecho, algunas de las falsificaciones fotográficas más antiguas y divertidas se crearon tradicionalmente mediante niños que corrían de un extremo a otro de un grupo escolar, adelantándose a la trayectoria de las cámaras panorámicas que se utilizaban anteriormente para la fotografía de grupos escolares y deportes – lo que permitía al alumno aparecer dos veces en la misma imagen:

La tentación de engañar a las cámaras panorámicas durante las fotos de grupo era demasiado grande para muchos estudiantes, que estaban dispuestos a arriesgarse a una mala sesión en la oficina del director para ‘clonarse’ en las fotos escolares. Source: https://petapixel.com/2012/12/13/double-exposure-a-clever-photo-prank-from-half-a-century-ago/

A menos que tomes una foto en modo RAW, que básicamente descarga el sensor de la lente de la cámara a un archivo muy grande sin ninguna interpretación, es probable que tus fotos digitales no sean completamente auténticas. Los sistemas de cámara aplican rutinariamente algoritmos de ‘mejora’ como el afilado de imagen y el equilibrio de blancos, por defecto – y lo han hecho desde los orígenes de la fotografía digital de consumo.

Los autores del nuevo documento argumentan que incluso estos tipos más antiguos de aumento de foto digital no representan la ‘realidad’, ya que estos métodos están diseñados para hacer que las fotos sean más agradables, no más ‘reales’.

El estudio sugiere que el Acta de IA de la UE, incluso con enmiendas posteriores como recitales 123–27, coloca toda la producción fotográfica dentro de un marco probatorio inadecuado para el contexto en el que se producen las fotos hoy en día, en lugar de la naturaleza (nominalmente objetiva) de las imágenes de las cámaras de seguridad o la fotografía forense. La mayoría de las imágenes abordadas por el Acta de IA probablemente provengan de contextos donde los fabricantes y las plataformas en línea promueven activamente la interpretación creativa de las fotos, incluido el uso de la IA.

Los investigadores sugieren que las fotos ‘nunca han sido una representación objetiva de la realidad’. Consideraciones como la ubicación de la cámara, la profundidad de campo elegida y las opciones de iluminación contribuyen a hacer que una fotografía sea profundamente subjetiva.

El documento observa que las tareas de ‘limpieza’ rutinarias – como eliminar el polvo del sensor o las líneas de energía no deseadas de una escena bien compuesta – solo estaban semiautomatizadas antes del auge de la IA: los usuarios tenían que seleccionar manualmente una región o iniciar un proceso para lograr el resultado deseado.

Hoy en día, estas operaciones a menudo se activan mediante texto de los usuarios, más notablemente en herramientas como Photoshop. A nivel de consumo, estas características están cada vez más automatizadas sin entrada del usuario – un resultado que aparentemente es considerado por los fabricantes y las plataformas como ‘obviamente deseable’.

El significado diluido de ‘Deepfake’

Un desafío central para la legislación sobre imágenes alteradas y generadas por IA es la ambigüedad del término ‘deepfake’, que ha tenido su significado notablemente extendido en los últimos dos años.

Originalmente, los términos se aplicaban solo a la salida de video de sistemas basados en autoencoder como DeepFaceLab y FaceSwap, ambos derivados de código anónimo publicado en Reddit a fines de 2017.

A partir de 2022, la llegada de Modelos de Difusión Latente (LDM) como Stable Diffusion y Flux, así como sistemas de texto a video como Sora, también permitirían el intercambio de identidades y la personalización, a una resolución mejorada, versatilidad y fidelidad. Ahora era posible crear modelos de difusión que podrían representar celebridades y políticos. Dado que el término ‘deepfake’ ya era un tesoro que atraía titulares para los productores de medios, se extendió para cubrir estos sistemas.

Más tarde, en los medios y la literatura de investigación, el término también incluyó impersonación basada en texto. En este punto, el significado original de ‘deepfake’ estaba prácticamente perdido, mientras que su significado extendido estaba evolucionando constantemente y se volvía cada vez más diluido.

Pero como la palabra era tan incendiaria y galvanizadora, y era por entonces un poderoso punto de referencia político y mediático, resultó imposible renunciar a ella. Atraía a los lectores a los sitios web, la financiación a los investigadores y la atención a los políticos. Esta ambigüedad léxica es el enfoque principal de la nueva investigación.

Como observan los autores, el artículo 3(60) del Acta de IA de la UE describe cuatro condiciones que definen un ‘deepfake’.

1: Verdadera luna

En primer lugar, el contenido debe ser generado o manipulado, es decir, creado desde cero usando IA (generación) o alterado a partir de datos existentes (manipulación). El documento destaca la dificultad para distinguir entre resultados de edición de imagen ‘aceptables’ y deepfakes manipuladores, dado que las fotos digitales nunca son representaciones verdaderas de la realidad.

El documento sostiene que una luna generada por Samsung es arguablemente auténtica, ya que la luna es poco probable que cambie de apariencia, y ya que el contenido generado por IA, entrenado en imágenes lunares reales, es probable que sea preciso.

Sin embargo, los autores también afirman que dado que el sistema de Samsung se ha demostrado que genera una imagen ‘mejorada’ de la luna en un caso en el que la imagen de origen no era la luna en sí, esto se consideraría un ‘deepfake’.

Sería impráctico elaborar una lista exhaustiva de casos de uso diferentes sobre esta función ad hoc. Por lo tanto, la carga de definición parece pasar nuevamente a los tribunales.

2: TextFakes

En segundo lugar, el contenido debe ser en forma de imagen, audio o video. El contenido de texto, aunque sujeto a otras obligaciones de transparencia, no se considera un deepfake bajo el Acta de IA. Esto no se cubre en detalle en el nuevo estudio, aunque puede tener un impacto notable en la eficacia de los visuales deepfakes (ver a continuación).

3: Problemas del mundo real

En tercer lugar, el contenido debe se asemejar a personas, objetos, lugares, entidades o eventos existentes. Esta condición establece una conexión con el mundo real, lo que significa que la imaginería completamente fabricada, aunque sea fotorealista, no calificaría como un deepfake. Recital 134 del Acta de IA de la UE enfatiza el aspecto de ‘semejanza’ agregando la palabra ‘apreciablemente’ (un aparente aplazamiento a juicios legales posteriores).

Los autores, citando trabajos anteriores, consideran si una cara generada por IA debe pertenecer a una persona real o si solo debe ser lo suficientemente similar a una persona real para satisfacer esta definición.

Por ejemplo, ¿cómo se puede determinar si una secuencia de imágenes fotorealistas que representan al político Donald Trump tiene la intención de impersonación, si las imágenes (o los textos adjuntos) no mencionan específicamente a él? ¿Reconocimiento facial? ¿Encuestas a los usuarios? ¿Una definición de ‘sentido común’ de un juez?

Volviendo al problema de ‘TextFakes’ (ver arriba), las palabras a menudo constituyen una parte importante del acto de un visual deepfake. Por ejemplo, es posible tomar una (inalterada) imagen o video de ‘persona a’ y decir, en un pie de foto o una publicación en las redes sociales, que la imagen es de ‘persona b’ (suponiendo que las dos personas se parezcan).

En tal caso, no se necesita IA, y el resultado puede ser sorprendentemente efectivo – pero ¿constituye este enfoque de baja tecnología también un ‘deepfake’?

4: Retocar, remodelar

Finalmente, el contenido debe parecer auténtico o veraz a una persona. Esta condición enfatiza la percepción de los espectadores humanos. El contenido que solo es reconocido como representante de una persona o objeto real por un algoritmo no se consideraría un deepfake.

De todas las condiciones en 3(60), esta es la que más obviamente se remite al posterior juicio de un tribunal, ya que no permite ninguna interpretación a través de medios técnicos o mecanizados.

Hay dificultades inherentes para llegar a un consenso sobre una estipulación tan subjetiva. Los autores observan, por ejemplo, que diferentes personas, y diferentes tipos de personas (como niños y adultos), pueden estar dispuestas de manera variable a creer en un deepfake particular.

Los autores también señalan que las capacidades avanzadas de IA de herramientas como Photoshop desafían las definiciones tradicionales de ‘deepfake’. Si bien estos sistemas pueden incluir salvaguardas básicas contra contenido controvertido o prohibido, amplían dramáticamente el concepto de ‘retoque’. Los usuarios pueden agregar o eliminar objetos de manera convincente y fotorealista, logrando un nivel de autenticidad profesional que redefine los límites de la manipulación de imágenes.

Los autores afirman:

‘Argumentamos que la definición actual de deep fakes en el Acta de IA y las obligaciones correspondientes no están suficientemente especificadas para abordar los desafíos que plantean los deep fakes. Al analizar el ciclo de vida de una foto digital desde el sensor de la cámara hasta las características de edición digital, encontramos que:

‘(1.) Los deep fakes están mal definidos en el Acta de IA de la UE. La definición deja demasiado margen para lo que es un deep fake.

‘(2.) No está claro cómo se pueden considerar funciones de edición como la función “mejor toma” de Google como una excepción a las obligaciones de transparencia.

‘(3.) La excepción para imágenes editadas sustancialmente plantea preguntas sobre qué constituye una edición sustancial del contenido y si dicha edición debe ser perceptible por una persona natural.’

Tomar excepción

El Acta de IA de la UE contiene excepciones que, según los autores, pueden ser muy permisivas. Artículo 50(2), afirman, ofrece una excepción en casos en los que la mayoría de una imagen de origen original no se altera. Los autores señalan:

‘¿Qué se puede considerar contenido en el sentido del Artículo 50(2) en casos de audio, imágenes y videos digitales? Por ejemplo, en el caso de las imágenes, ¿debemos considerar el espacio de píxeles o el espacio visible perceptible por los humanos? Las manipulaciones sustanciales en el espacio de píxeles pueden no cambiar la percepción humana, y por otro lado, pequeñas perturbaciones en el espacio de píxeles pueden cambiar la percepción de manera dramática.’

Los investigadores proporcionan el ejemplo de agregar un arma de fuego a la foto de una persona que está apuntando a alguien. Al agregar el arma, se cambia como máximo el 5% de la imagen; sin embargo, el significado semántico de la parte cambiada es notable. Por lo tanto, parece que esta excepción no tiene en cuenta ninguna comprensión de ‘sentido común’ del efecto que un pequeño detalle puede tener en el significado general de una imagen.

La sección 50(2) también permite excepciones para una ‘función de edición asistida estándar’. Dado que el Acta no define qué significa ‘edición estándar’, incluso características de post-procesamiento extremas como la función Best Take de Google parecerían estar protegidas por esta excepción, observan los autores.

Conclusión

La intención declarada del nuevo trabajo es fomentar el estudio interdisciplinario sobre la regulación de los deepfakes y servir como punto de partida para nuevos diálogos entre científicos informáticos y académicos jurídicos.

Sin embargo, el documento en sí sucumbe a la tautología en varios puntos: frecuentemente utiliza el término ‘deepfake’ como si su significado fuera evidente, mientras critica el Acta de IA de la UE por no definir qué constituye un deepfake.

Publicado por primera vez el lunes 16 de diciembre de 2024