Líderes de opinión

Una guía práctica para salidas de LLM defensables

Hay una suposición silenciosa que atraviesa la mayoría de las implementaciones de GenAI en empresas: si la salida parece correcta, es correcta. En entornos de baja apuesta, eso es un atajo razonable. En industrias reguladas, como la atención médica, las finanzas, los productos farmacéuticos y el aseguramiento de la calidad, es una responsabilidad que espera surgir.

El momento en que una salida de LLM influye en una decisión clínica, un registro financiero o un documento de cumplimiento, la fluidez deja de ser un proxy para la confiabilidad. Y cuando un auditor, regulador o equipo legal pregunta qué datos se utilizaron, qué reglas se aplicaron y quién lo aprobó, “el modelo lo dijo” no es una respuesta que nadie pueda firmar.

Esta es la brecha de responsabilidad que la mayoría de los equipos de GenAI no están diseñando. Aquí está cómo cerrarla.

Por qué “parece correcto” es el estándar incorrecto

La evaluación tradicional de la IA se centra en la precisión, la latencia y el costo. Estos son importantes. Pero los entornos regulados introducen un cuarto eje que los demás no pueden sustituir: la auditoría.

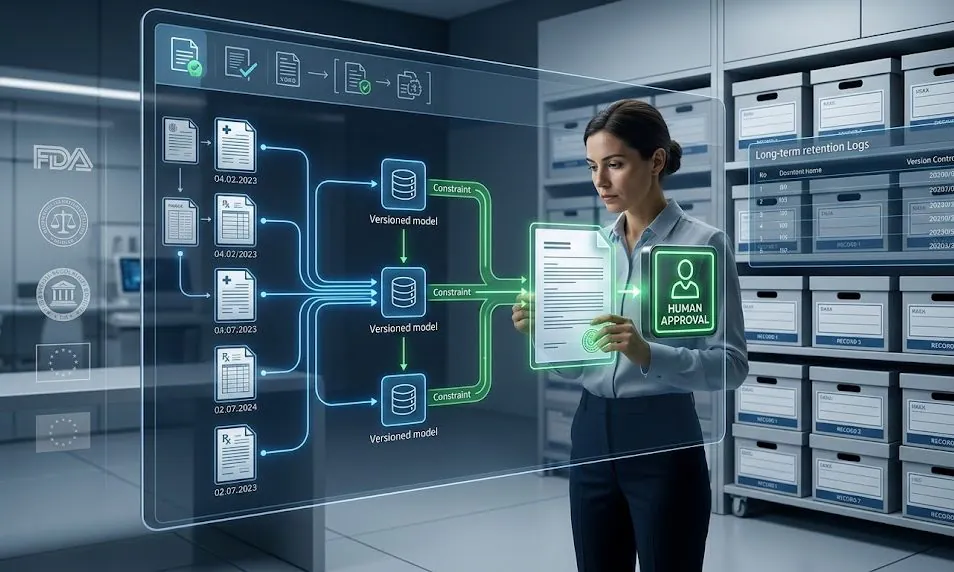

El Acta de IA de la UE, que ya está en vigor, requiere que los sistemas de IA de alto riesgo mantengan documentación técnica, registros de trazabilidad y evidencia de supervisión humana durante todo su ciclo de vida. El borrador de orientación de la FDA sobre la IA en el desarrollo de medicamentos y biológicos señala la misma dirección para las ciencias de la vida. Estos marcos no califican la fluidez. Requieren sistemas que puedan ser reconstruidos, inspeccionados y defendidos.

Una salida de LLM defensible es aquella que se puede rastrear a través de una cadena de evidencia verificable: qué datos utilizó, qué restricciones la configuraron, quién la revisó y qué se conservó para inspección futura. Sin esa cadena, incluso una salida correcta es indefensible.

Esto redefine lo que significa “listo para producción” para la IA en entornos gobernados.

Los cuatro pilares de la GenAI lista para auditoría

Construir sistemas de LLM defensibles se reduce a cuatro requisitos de ingeniería. No son principios abstractos, son decisiones de infraestructura que determinan si su sistema puede sobrevivir a la escrutinía.

1. Procedencia: controlar de dónde obtiene el modelo su información

El modo de falla más común en la IA empresarial también es el menos visible: los modelos que se basan en conocimientos generales o fuentes de datos mal definidas. Cuando no hay un límite de conocimiento controlado, las salidas no se pueden rastrear a ninguna fuente auditable, y la reconstrucción se vuelve imposible.

Un arreglo práctico es establecer un límite de conocimiento aprobado: documentos y conjuntos de datos con versiones y propietarios que el sistema está explícitamente autorizado a utilizar. Cada respuesta debe llevar un paquete de evidencia mínimo: un identificador de fuente con versión y fecha efectiva, un registro de recuperación que muestra qué se consultó y seleccionó, y citas en línea. Una regla de funcionamiento útil: sin cita, no hay afirmación.

Esto convierte el sistema de generación basada en memoria a razonamiento basado en evidencia. La distinción se vuelve crítica cuando alguien necesita reconstruir una salida específica semanas o meses después de que se generó.

2. Restricciones: reemplazar la improvisación con comportamiento controlado

Los LLM están diseñados para ser convincentes. Sin restricciones, optimizan la plausibilidad, y la plausibilidad en un contexto regulado es donde vive el riesgo.

Las restricciones son el mecanismo que convierte un generador de texto probabilístico en un componente de ejecución acotado. En la práctica, esto significa:

- Generación ligada a la fuente: cada afirmación requiere una fuente aprobada y con versión. Sin fuente, no hay respuesta, solo negación o escalada.

- Esquemas de salida estructurados: las respuestas siguen formatos definidos que las máquinas y los auditores pueden validar, no solo leer.

- Aplicación de límites de confianza: el contenido recuperado se trata como entrada, abordando directamente los riesgos de inyección de promtps que pueden socavar tanto la seguridad como la auditoría.

- Acceso con privilegios mínimos: el modelo interactúa solo con los datos y las herramientas que realmente necesita, manteniendo los registros de auditoría limpios.

Las restricciones no son una casilla de cumplimiento. Son la decisión arquitectónica que determina si su sistema puede ser auditado en absoluto.

3. Revisión: hacer que la supervisión humana sea una capa de control formal

En la IA regulada, la revisión humana no puede ser ad hoc. Necesita ser estratificada por riesgo (las salidas de mayor riesgo desencadenan una validación más estricta) y activada por eventos, cuando la confianza del modelo es baja, las fuentes están ausentes o se detectan anomalías.

El Acta de IA de la UE requiere explícitamente que los humanos puedan interpretar, anular y detener las decisiones impulsadas por la IA en casos de uso de alto riesgo. Cumplir con ese requisito significa que los registros de revisión deben capturar quién aprobó una salida, bajo qué condiciones y con qué nivel de escrutinio. “Alguien lo revisó” no es un control. Un registro de revisión documentado y con marca de tiempo es.

Esto eleva la revisión de la QA manual a una capa de gobernanza formal, que es exactamente cómo los reguladores están empezando a tratarla.

4. Retención: hacer que la responsabilidad sea duradera

Sin registros, no hay rastro de auditoría. Sin rastro de auditoría, la responsabilidad es teórica.

Al mismo tiempo, retener todo crea sus propios riesgos, particularmente donde los datos de salud o financieros sensibles están sujetos a requisitos de minimización bajo marcos como GDPR o HIPAA.

El enfoque práctico es un modelo por niveles. Siempre almacene los metadatos del modelo y la versión, los identificadores de fuente, las decisiones de política y las marcas de tiempo. Almacene el contenido de la interacción (prompts, salidas y trazas completas) selectivamente, basado en la clasificación de riesgo, con la supresión y los controles de acceso adecuados. El objetivo es permitir la reconstrucción de cualquier salida sin recopilar demasiados datos que creen exposición downstream.

Qué se ve en la práctica

Considere cómo se aplica esto en las ciencias de la vida, donde CFR 21 Parte 11 requiere que los registros electrónicos sean atribuibles, legibles, contemporáneos, originales y exactos. Un LLM que genera documentación regulatoria debe satisfacer los cinco criterios, no solo producir texto legible.

En este contexto, los cuatro pilares no son mejoras opcionales. Son la barra mínima para un sistema cumplidor. La procedencia garantiza que la salida es atribuible y original. Las restricciones garantizan que se mantiene dentro de los límites definidos. La revisión garantiza que es contemporánea con la supervisión humana. La retención garantiza que es legible y inspeccionable.

La misma lógica se aplica en los servicios financieros, donde MiFID II requiere registros de decisiones y la justificación detrás de ellas, y en la atención médica, donde los sistemas de apoyo a la decisión clínica enfrentan un escrutinio creciente sobre la explicabilidad y el sesgo.

El cambio más grande

La GenAI está pasando de la experimentación a la infraestructura operativa. Esa transición eleva el estándar para lo que se consideran sistemas aceptables.

Una salida útil ya no es suficiente. Las organizaciones necesitan salidas que puedan ser explicadas, rastreadas y defendidas bajo escrutinio, porque la IA se le pide que haga cosas que tienen consecuencias reales.

Los equipos que diseñan la defensibilidad desde el principio estarán posicionados para escalar la IA de manera segura y mantener la confianza regulatoria. Aquellos que no lo hagan eventualmente enfrentarán el mismo momento: una auditoría, una pregunta directa sobre una salida específica y nada que mostrar.

Construir una IA lista para auditoría no es sobre ralentizar. Es sobre construir algo que pueda durar.