Ángulo de Anderson

La codificación de vibraciones sufre cuando el papel de la IA se expande

Un nuevo estudio encuentra que la codificación de vibraciones mejora cuando los humanos dan las instrucciones, pero declina cuando la IA lo hace, con el mejor conjunto híbrido que mantiene a los humanos en primer lugar, con la IA como árbitro o juez.

Nueva investigación de los Estados Unidos, que examina qué sucede cuando los sistemas de IA se permiten dirigir la codificación de vibraciones, en lugar de simplemente ejecutar instrucciones humanas, ha encontrado que cuando los Modelos de Lenguaje Grande (LLMs) asumen un papel direccional más grande, los resultados son casi siempre peores.

Aunque los investigadores utilizaron el GPT-5 de OpenAI como el marco para sus experimentos de colaboración humano/IA, más tarde confirmaron que tanto Claude Opus 4.5 de Anthropic como Google Gemini 3 Pro estaban sujetos a la misma curva de deterioro a medida que crecían las responsabilidades, afirmando que ‘incluso la participación humana limitada mejora constantemente el rendimiento’:

‘[Los humanos] proporcionan una orientación de alto nivel únicamente efectiva en iteraciones, [mientras que] la orientación de la IA a menudo conduce a un colapso del rendimiento. También encontramos que una asignación de roles cuidadosa que mantiene a los humanos a cargo de la dirección mientras descarga la evaluación a la IA puede mejorar el rendimiento híbrido.’

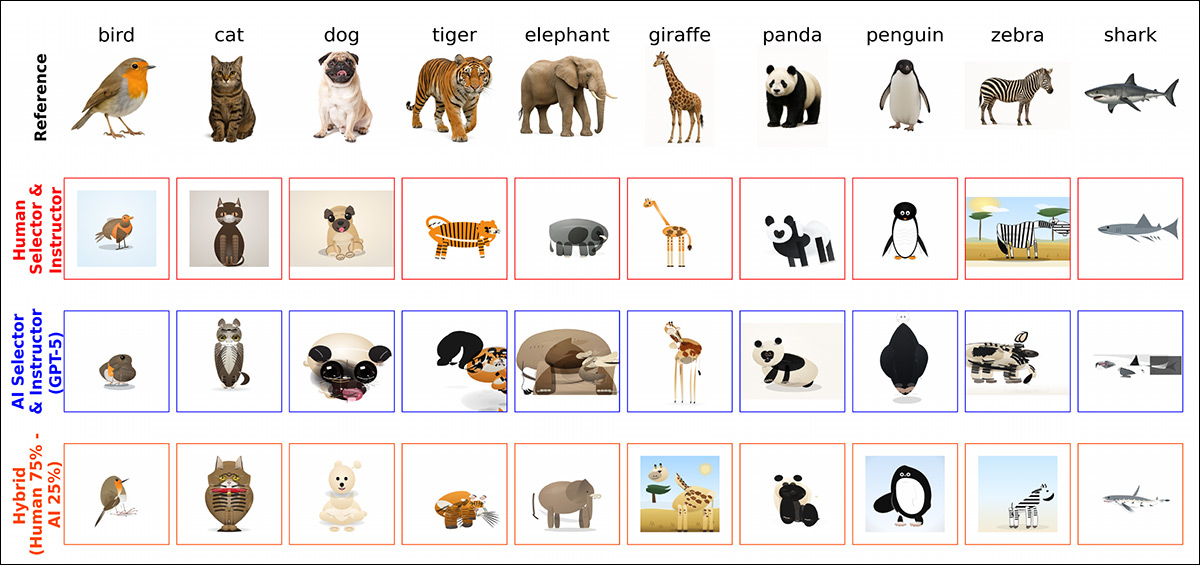

Para proporcionar una prueba consistente que pudiera ser evaluada igualmente por humanos y por IA, se construyó un marco experimental controlado alrededor de una tarea de codificación iterativa en la que una imagen de referencia – que presentaba una foto de un gato, perro, tigre, ave, elefante, pingüino, tiburón, cebra, jirafa o panda – debía ser recreada utilizando gráficos vectoriales escalables (SVG), y que la recreación se juzgara contra la fuente de la foto de la que se derivó:

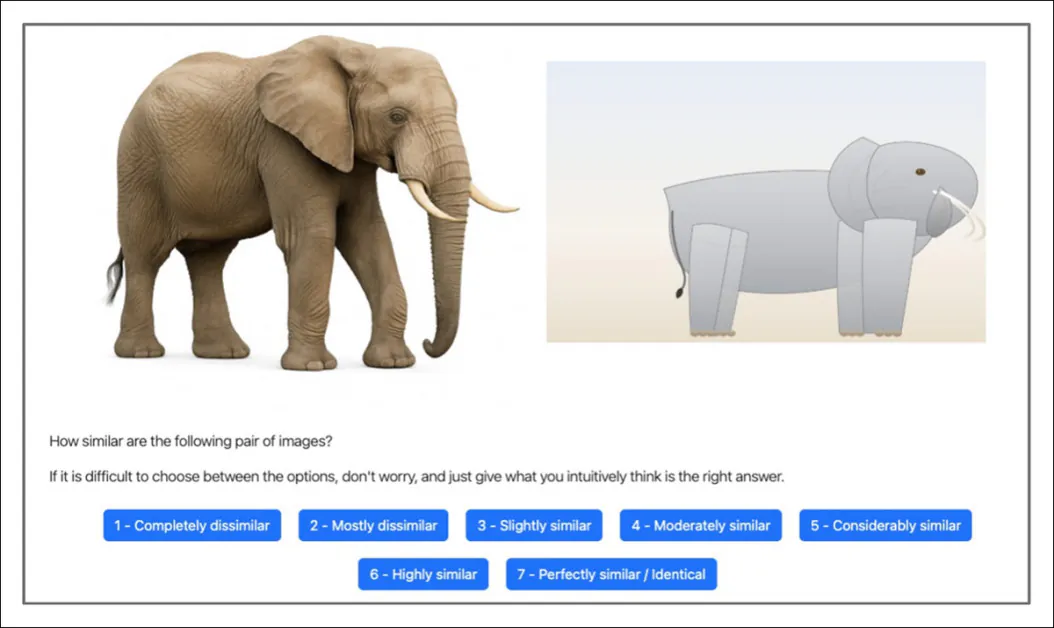

Tanto los participantes humanos como los de IA se les mostró una imagen de referencia fotográfica junto con una reconstrucción SVG generada por IA, y se les pidió que calificaran lo similar que eran las dos en una escala de siete puntos. Fuente

En cada ronda, un agente proporcionó instrucciones de lenguaje natural de alto nivel para guiar a un generador de código, y otro decidió si mantener la nueva versión o revertir a la anterior – un bucle estructurado que refleja los flujos de trabajo de colaboración real.

A lo largo de 16 experimentos que involucraron a 604 participantes y miles de llamadas a la API, se compararon rondas de pruebas dirigidas completamente por humanos con rondas dirigidas completamente por IA, en condiciones de lo contrario idénticas.

Algunas de las soluciones variadas llegadas por diferentes combinaciones de porcentajes y tipos de colaboración humano/IA (tomadas de una ilustración más grande en el papel de la fuente, al que se remite al lector).

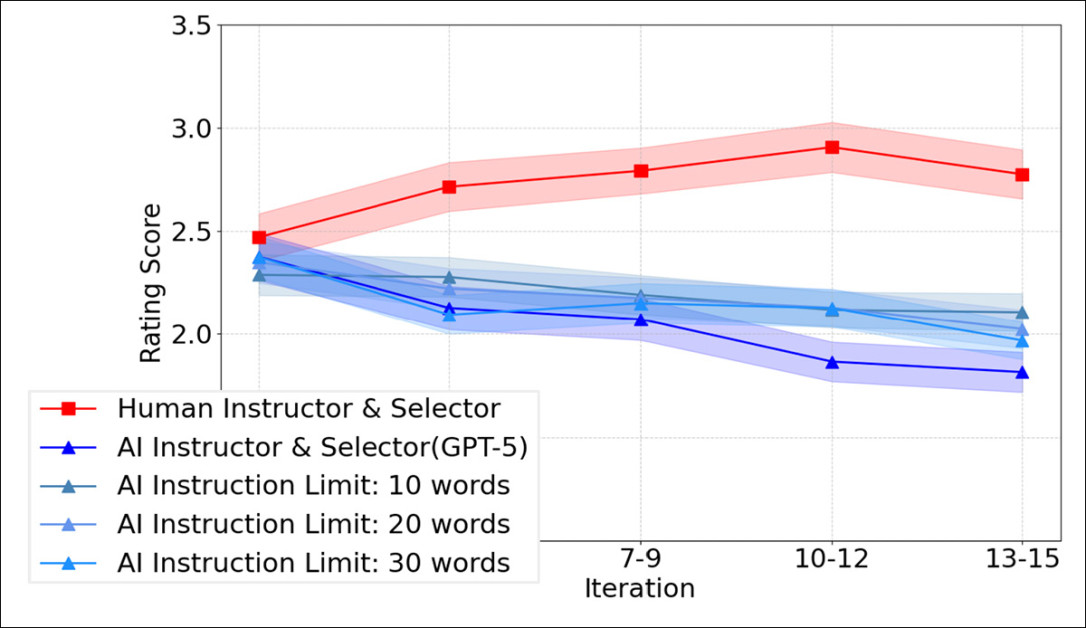

Aunque los humanos y la IA realizaron al mismo nivel al comienzo de las pruebas, con el tiempo, sus trayectorias divergieron: cuando los humanos proporcionaron las instrucciones y tomaron las decisiones de selección, las puntuaciones de similitud aumentaron en iteraciones, con una mejora acumulativa constante; pero cuando los sistemas de IA llenaron ambos roles, el rendimiento no mostró ganancias consistentes, y a menudo disminuyó en rondas – incluso cuando se utilizó el mismo modelo subyacente para la generación de código, y la IA tuvo acceso a la misma información que los participantes humanos.

El efecto de la prolixidad

Los resultados también mostraron que las instrucciones humanas fueron típicamente cortas y orientadas a la acción, centradas en qué cambiar a continuación en la imagen actual; por el contrario, las instrucciones de la IA fueron mucho más largas y densamente descriptivas (un factor que se parametrizó para GPT-5), detallando atributos visuales en lugar de priorizar la corrección incremental.

Pero, como se ve en el gráfico a continuación, imponer límites estrictos de palabras a las instrucciones de la IA no invirtió el patrón; incluso cuando se limitó a 10, 20 o 30 palabras, las cadenas dirigidas por la IA aún no mejoraron con el tiempo:

Puntuaciones de similitud en iteraciones para rondas dirigidas por humanos en comparación con rondas completamente dirigidas por IA y cadenas dirigidas por IA limitadas a 10, 20 o 30 palabras de instrucción. Evidentemente, acortar las instrucciones de la IA no evita la disminución del rendimiento observada cuando la IA dirige tanto la instrucción como la selección.

Los experimentos híbridos hicieron que el patrón fuera más claro, mostrando que agregar incluso un poco de participación humana mejoró los resultados, en comparación con los conjuntos completamente dirigidos por IA; sin embargo, el rendimiento generalmente disminuyó a medida que aumentó la participación de la orientación de la IA.

Cuando se separaron los roles, la evaluación y la selección podían ser entregadas a la IA con una pérdida de calidad relativamente pequeña; pero reemplazar la instrucción de alto nivel humana con la orientación de la IA llevó a disminuciones notables en el rendimiento, lo que sugiere que lo que más importaba no era quién generó el código, sino quién estableció y mantuvo la dirección en iteraciones.