Umělá inteligence

Úniková definice ‘Deepfake’

Poutavá nová studie z Německa kritizuje definici termínu ‘deepfake’ v rámci EU AI Act jako příliš vágní, zejména v kontextu digitální manipulace obrazu. Autoři argumentují, že důraz zákona na obsah, který připomíná skutečné osoby nebo události – ale potenciálně vypadá falešně – postrádá jasnost.

Autoři také poukazují na to, že výjimky zákona pro “standardní editaci” (tj. údajně malé AI-pomocené úpravy obrazu) nezohledňují široký vliv AI v spotřebitelských aplikacích a subjektivní povahu uměleckých konvencí, které předcházely nástupu AI.

Nepřesná legislativa v těchto otázkách vede k dvěma hlavním rizikům: “chilling effect”, kdy široký interpretační rozsah zákona brání inovacím a přijímání nových systémů; a “scofflaw effect”, kdy je zákon ignorován jako přehnaný nebo irelevantní.

V každém případě vágní zákony efektivní přenosem odpovědnosti za stanovení praktických právních definic na budoucí soudní rozhodnutí – opatrný a rizikový přístup k legislativě.

Technologie AI-založené manipulace obrazu zůstávají pozoruhodně před legislativou, která by je mohla řešit, zdá se. Například jeden pozoruhodný příklad rostoucí pružnosti konceptu AI-řízeného “automatického” post-processingu, studie pozoruje, je funkce “Scene Optimizer” v nedávných fotoaparátech Samsung, která může nahradit uživatelské snímky měsíce (komplikovaný předmět) AI-řízeným, “vylepšeným” obrazem:

Top left, an example from the new paper of a real user-taken image of the moon, to the left of a Samsung-enhanced version automatically created with Scene Optimizer; Right, Samsung’s official illustration of the process behind this; lower left, examples from the Reddit user u/ibreakphotos, showing (left) a deliberately blurred image of the moon and (right), Samsung’s re-imagining of this image – even though the source photo was a picture of a monitor, and not the real moon. Sources (clockwise from top-left): https://arxiv.org/pdf/2412.09961; https://www.samsung.com/uk/support/mobile-devices/how-galaxy-cameras-combine-super-resolution-technologies-with-ai-to-produce-high-quality-images-of-the-moon/; https:/reddit.com/r/Android/comments/11nzrb0/samsung_space_zoom_moon_shots_are_fake_and_here/

V dolní části obrázku výše vidíme dvě snímky měsíce. Ten vlevo je foto pořízené uživatelem Redditu. Zde byl snímek úmyslně rozostřen a zmenšen uživatelem.

Vpravo vidíme snímek stejného degradovaného obrazu pořízeného fotoaparátem Samsung s AI-řízeným post-processingem. Fotoapárát automaticky “vylepšil” rozpoznaný “měsíc” objekt, i když to nebyl skutečný měsíc.

Studie kritizuje ještě více funkci Best Take integrovanou do nedávných smartphonů Google – kontroverzní AI funkci, která edituje nejlepší části skupinové fotografie, skenuje několik sekund sekvence fotografie, aby úsměvy byly posunuty dopředu nebo dozadu v čase, jak je necessário – a nikdo není zobrazen uprostřed mrknutí.

Studie tvrdí, že tento typ kompozitního procesu má potenciál zkreslit události:

‘[V] typickém skupinovém fotografování by průměrný divák pravděpodobně stále považoval výsledný snímek za autentický. Úsměv, který je vložen, existoval v rámci několika sekund od zbytku snímku.

‘Na druhé straně je desetisekundový časový rámec funkce Best Take dostatečný pro změnu nálady. Osoba mohla přestat úsměvat, zatímco zbytek skupiny se směje o vtipu na její účet.

‘Jako důsledek předpokládáme, že taková skupinová fotografie může velmi dobře tvořit deep fake.’

Nová studie se jmenuje Co tvoří Deep Fake? Rozmazaná hranice mezi legitimní úpravou a manipulací podle EU AI Act a pochází od dvou výzkumníků z Computational Law Lab na Univerzitě Tübingen a Univerzitě Saarland.

Staré triky

Manipulace s časem ve fotografii je mnohem starší než spotřebitelská AI. Autoři nové studie poukazují na existenci mnohem starší techniky, které lze považovat za “neautentické”, jako je spojování více po sobě jdoucích snímků do High Dynamic Range (HDR) fotografie nebo ‘šitého’ panoramatického snímku.

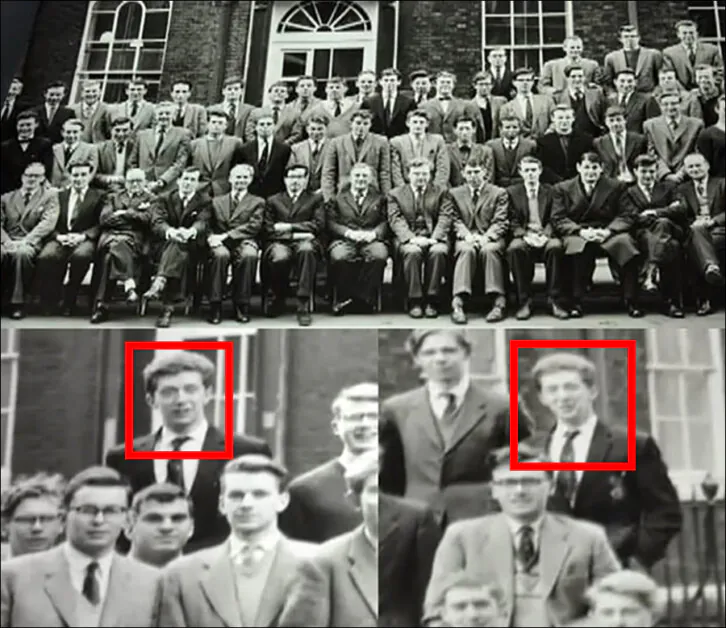

Skutečně, některé z nejstarších a nejzábavnějších fotografických padělků byly tradičně vytvářeny školními dětmi, které běžely z jednoho konce školní skupiny na druhý, před trajektorií speciálních panoramatických kamer, které se dříve používaly pro sportovní a školní skupinovou fotografii – umožňující žákovi objevit se dvakrát ve stejné fotografii:

Pokušení oklamat panoramatické kamery během skupinové fotografie bylo příliš velké, aby se mu mnoho studentů mohlo vyhnout, kteří byli ochotni riskovat špatnou relaci u ředitele školy, aby se ‘klonovali’ ve školních fotografiích. Source: https://petapixel.com/2012/12/13/double-exposure-a-clever-photo-prank-from-half-a-century-ago/

Pokud nevyfotíte fotografii v režimu RAW, který基本ně dumpuje snímač fotoaparátu do velmi velkého souboru bez jakéhokoli druhu interpretace, je pravděpodobné, že vaše digitální fotografie nejsou zcela autentické. Systémy fotoaparátů rutinně aplikují “vylepšovací” algoritmy, jako je ostření obrazu a vyvážení bílé, ve výchozím nastavení – a tak činily od počátků spotřebitelské digitální fotografie.

Autoři studie argumentují, že ani tyto starší typy digitální fotoúpravy nepředstavují “realitu”, protože tyto metody jsou navrženy tak, aby fotografie byly více příjemné, ne více “reálné”.

Studie naznačuje, že EU AI Act, i s pozdějšími dodatky, jako je recitály 123–27, umístí všechny fotografické výstupy do důkazního rámce, který není vhodný pro kontext, ve kterém jsou fotografie vyráběny dnes, na rozdíl od (nominálně objektivní) povahy bezpečnostních kamer nebo forenzní fotografie. Většina obrazů adresovaných AI Actem pravděpodobně pochází z kontextů, ve kterých výrobci a online platformy aktivně podporují kreativní fotografickou interpretaci, včetně použití AI.

Výzkumníci naznačují, že fotografie “nikdy nebyly objektivním znázorněním reality”. Faktory, jako je poloha fotoaparátu, zvolená hloubka ostření a výběr osvětlení, všechny přispívají k tomu, aby fotografie byly hluboce subjektivní.

Studie pozoruje, že rutinní “čištění” úkoly – jako je odstranění senzorového prachu nebo nežádoucích elektrických vedení z jinak dobře složené scény – byly před vzestupem AI pouze semi-automatizované: uživatelé museli ručně vybrat oblast nebo spustit proces, aby dosáhli svého požadovaného výsledku.

Dnes jsou tyto operace často spouštěny uživatelskými textovými příkazy, nejvýrazněji v nástrojích, jako je Photoshop. Na spotřebitelské úrovni jsou tyto funkce stále více automatizovány bez uživatelského vstupu – výsledek, který je zřejmě považován výrobci a platformami za “zjevně žádoucí”.

Rozředěný význam ‘Deepfake’

Centrální výzvou pro legislativu kolem AI-upravených a AI-generovaných obrazů je ambivalence termínu ‘deepfake’, který měl svůj význam pozoruhodně prodloužen za posledních dva roky.

Původně se termín vztahoval pouze na videovýstup z autoencoder-based systémů, jako je DeepFaceLab a FaceSwap, oba odvozené z anonymního kódu zveřejněného na Redditu na konci roku 2017.

Od roku 2022 příchod Latent Diffusion Models (LDMs), jako je Stable Diffusion a Flux, jakož i text-to-video systémy, jako je Sora, by také umožnily výměnu identit a přizpůsobení, s vylepšenou rozlišením, flexibilitou a věrností. Nyní bylo možné vytvořit difuzní modely, které by mohly zobrazovat celebrity a politiky. Od té doby, co termín ‘deepfake’ byl již pokladnicí pro média, byl prodloužen, aby zahrnoval tyto systémy.

Později, v médiích i ve výzkumné literatuře, termín zahrnoval také textovou impersonaci. Do tohoto okamžiku byl původní význam ‘deepfake’ téměř ztracen, zatímco jeho prodloužený význam se neustále vyvíjel a stále více ředil.

Ale protože slovo bylo tak výbušné a galvanizující, a stalo se nyní mocným politickým a mediálním bodem, bylo nemožné se ho vzdát. Přitáhlo čtenáře na webové stránky, financování pro výzkumníky a pozornost pro politiky. Tato lexikální ambivalence je hlavním zaměřením nové studie.

Jak autoři pozorují, článek 3(60) EU AI Actu stanoví čtyři podmínky, které definují ‘deepfake’.

1: Skutečný měsíc

Za prvé, obsah musí být vytvořen nebo upraven, tj. buď vytvořen od začátku pomocí AI (generace) nebo změněn z existujících dat (manipulace). Studie zdůrazňuje obtížnost rozlišení mezi “přijatelnými” výsledky úprav obrazu a manipulativními deepfakes, vzhledem k tomu, že digitální fotografie nejsou v žádném případě skutečným znázorněním reality.

Studie tvrdí, že Samsung-generovaný měsíc je pravděpodobně autentický, protože měsíc je nepravděpodobné, že se změní, a protože AI-generovaný obsah, který byl vyškolován na skutečných lunárních obrazech, je pravděpodobně přesný.

Nicméně, autoři také uvádějí, že protože Samsungův systém byl prokázán jako generující “vylepšený” obraz měsíce v případě, kdy zdroj obrazu nebyl měsícem sám, toto by bylo považováno za “deepfake”.

Bylo by nerealistické sestavit komplexní seznam různých použití tohoto druhu ad hoc funkcionality. Proto se zdá, že břemeno definice opět přechází na soudy.

2: TextFakes

Za druhé, obsah musí být ve formě obrazu, audio nebo videa. Textový obsah, i když podléhá jiným transparentním povinnostem, není považován za deepfake podle AI Actu. To není podrobně popsáno v nové studii, i když to může mít významný dopad na účinnost vizuálních deepfakes (viz níže).

3: Skutečné problémy

Za třetí, obsah musí připomínat existující osoby, objekty, místa, entity nebo události. Tato podmínka stanoví spojení se skutečným světem, což znamená, že čistě vymyšlené obrazové materiály, i když fotorealistické, by nezapadaly do definice deepfake. Recitál 134 EU AI Actu zdůrazňuje “připomínající” aspekt přidáním slova “značně” (zjevný odkaz na pozdější právní rozhodnutí).

Autoři, citující dřívější práci, zvažují, zda AI-generovaná tvář musí patřit skutečné osobě, nebo zda musí být pouze dostatečně podobná skutečné osobě, aby splnila tuto definici.

Například, jak lze určit, zda sekvence fotorealistických obrazů zobrazujících politika Donalda Trumpa má v úmyslu impersonaci, pokud obrázky (nebo připojené texty) zvlášť nezmíní jeho jméno? Rozpoznávání obličeje? Uživatelské průzkumy? Definice “zdravého rozumu” soudce?

Vracíme-li se k problému “TextFakes” (viz výše), slova často tvoří významnou část vizuálního deepfake. Například je možné vzít (nezměněný) obraz nebo video ‘osoby a’‘ a říci, v popisu nebo na sociálních médiích, že obraz je ‘osoby b’‘ (předpokládající, že obě osoby mají podobný vzhled).

V takovém případě není potřeba žádná AI, a výsledek může být překvapivě efektivní – ale tvoří taková nízkonákladová metoda také “deepfake”?

4: Retuš, Přestavba

Nakonec, obsah musí vydávat se jako autentický nebo pravdivý pro osobu. Tato podmínka zdůrazňuje vnímání lidských diváků. Obsah, který je rozpoznán jako reprezentace skutečné osoby nebo objektu pouze algoritmem, by nebyl považován za deepfake.

Ze všech podmínek v 3(60) je tato podmínka nejvíce zjevně odkazuje na pozdější soudní rozhodnutí, protože neumožňuje žádné interpretace prostřednictvím technických nebo mechanizovaných prostředků.

Existují zjevné obtíže při dosažení konsensu o tak subjektivním ustanovení. Autoři pozorují, že různé lidé, a různé typy lidí (jako jsou děti a dospělí), mohou být různě nakloněni věřit v konkrétní deepfake.

Autoři dále uvádějí, že pokročilé AI schopnosti nástrojů, jako je Photoshop, zpochybňují tradiční definice “deepfake”. Zatímco tyto systémy mohou zahrnovat základní bezpečnostní opatření proti kontroverznímu nebo zakázanému obsahu, dramaticky rozšiřují koncept “retušování”. Uživatelé mohou nyní přidávat nebo odebírat objekty ve vysoce přesvědčivém, fotorealistickém způsobem, dosahujícím profesionální úrovně autenticity, která předefinuje hranice manipulace obrazu.

Autoři uvádějí:

‘Argumentujeme, že současná definice deep fakes v AI Actu a odpovídající povinnosti nejsou dostatečně specifikovány, aby řešily výzvy, které představují deep fakes. Analýzou životního cyklu digitální fotografie od snímače fotoaparátu po digitální úpravné funkce, zjistíme, že:

‘(1.) Deep fakes jsou špatně definovány v EU AI Act. Definice ponechává příliš mnoho prostoru pro to, co je deep fake.

‘(2.) Není jasné, jak lze funkce úprav, jako je funkce “Best Take” od Google, považovat za výjimku z transparentních povinností.

‘(3.) Výjimka pro podstatně upravené obrázky vyvolává otázky o tom, co představuje podstatnou úpravu obsahu a zda musí být tato úprava patrná pro přirozenou osobu.’

Vyjímání

EU AI Act obsahuje výjimky, které, podle autorů, mohou být velmi permissive. Článek 50(2), uvádějí, nabízí výjimku v případech, kdy většina původního zdrojového obrazu není změněna. Autoři poznamenávají:

‘Co lze považovat za obsah ve smyslu článku 50(2) v případech digitálního audio, obrazů a videí? Například v případě obrazů, musíme-li zvažovat pixelový prostor nebo viditelný prostor vnímatelný lidmi? Substantivní manipulace v pixelovém prostoru nemusí měnit lidské vnímání, a na druhé straně, malé perturbace v pixelovém prostoru mohou dramaticky změnit vnímání.’

Výzkumníci poskytují příklad přidání pistole do fotografie osoby, která ukazuje na někoho. Přidáním pistole se mění méně než 5 % obrazu; nicméně, sémantický význam změněné části je pozoruhodný. Proto se zdá, že tato výjimka nezohledňuje žádný “zdravý rozum” ohledně efektu, který malá detail může mít na celkovém významu obrazu.

Oddíl 50(2) také umožňuje výjimky pro “asistivní funkci pro standardní úpravy”. Jelikož Act nedefinuje, co znamená “standardní úprava”, dokonce i post-processingové funkce, jako je Google’s Best Take, by se zdály být chráněny touto výjimkou, autoři pozorují.

Závěr

Uvedeným záměrem nové práce je povzbudit mezioborovou studii kolem regulace deepfakes a sloužit jako výchozí bod pro nové dialogy mezi počítačovými vědci a právními učenci.

Nicméně, studie sama o sobě podléhá tautologii na několika místech: často používá termín ‘deepfake’, jako by jeho význam byl samozřejmý, zatímco kritizuje EU AI Act za to, že nedokáže definovat, co vlastně tvoří deepfake.

Poprvé zveřejněno v pondělí, 16. prosince 2024