Etika

Databáze incidentů AI má za cíl učinit algoritmy AI bezpečnější

Každý dostatečně velký systém bude mít chyby a část oprav těchto chyb spočívá v tom, že je mít databázi, která může být analyzována z hlediska dopadů a potenciálních příčin. Stejně jako FDA udržuje databázi nežádoucích reakcí na léky nebo Národní rada pro bezpečnost dopravy udržuje databázi leteckých nehod, databáze incidentů AI je databáze určená katalogizovat selhání systémů AI a pomoci výzkumníkům AI navrhnout nové metody, jak těmto selháním zabránit. Tvůrci Databáze incidentů AI (AIID) doufají, že pomůže společnostem AI vyvinout bezpečnější, etičtější AI.

Co je AIID?

AIID je produktem organizace Partnership on AI (PAI). PAI byla založena v roce 2016 členy výzkumných týmů AI ve velkých technologických společnostech, jako jsou Facebook, Apple, Amazon, Google, IBM a Microsoft. Od té doby organizace získala členy z mnoha dalších organizací, včetně různých neziskových organizací. V roce 2018 se PAI rozhodla vytvořit jednotný klasifikační standard pro selhání AI. Avšak neexistovala žádná sbírka incidentů AI, na které by mohl být založen tento klasifikační standard. Z tohoto důvodu PAI vytvořila AIID.

Podle TechTalks, formát AIID byl ovlivněn strukturou databáze leteckých nehod udržované Národní radou pro bezpečnost dopravy. Od té doby, co byly zahájeny záznamy v roce 1996, se komerční letecká doprava podařilo zvýšit bezpečnost leteckého průmyslu archivací a analýzou incidentů. Doufá se, že podobná sbírka incidentů AI může učinit systémy AI bezpečnější, etičtější a spolehlivější. AIID také čerpala inspiraci z databáze Common Vulnerabilities and Exposures, která je repozitářem významných selhání softwaru, které pokrývají různé průmysly a disciplíny.

Sean McGregor je hlavní technický konzultant v IBM pro Watson AI XPRIZE. McGregor je také zodpovědný za dohled nad vývojem skutečné databáze AIID. McGregor vysvětlil, že konečným cílem AIID je zabránit tomu, aby systémy AI způsobily újmu, nebo alespoň snížit závažnost nežádoucích incidentů. Jak McGregor poznamenal, systémy strojového učení jsou podstatně složitější a nepředvídatelnější než tradiční softwarové systémy, a v důsledku toho je nelze testovat stejným způsobem jako ostatní software. Systémy strojového učení mohou měnit své chování neočekávanými způsoby. McGregor poznamenává, že kapacita hlubokých učení systémů se učit může znamenat, že „poruchy jsou více pravděpodobné, složitější a nebezpečnější“, když vstupují do nestrukturovaného světa.

Více než 1 000 incidentů souvisejících s AI bylo zaznamenáno

Od té doby, co byla AIID vytvořena, bylo zaznamenáno více než 1 000 incidentů souvisejících s AI. Z všech incidentů v databázi byly problémy související s AI férovostí nejčastějším typem nežádoucího incidentu. Mnoho z těchto incidentů férovosti zahrnuje použití algoritmů rozpoznávání obličeje vládními agenturami. McGregor také poznamenává, že je zaznamenán rostoucí počet incidentů souvisejících s robotikou, které jsou přidávány do databáze.

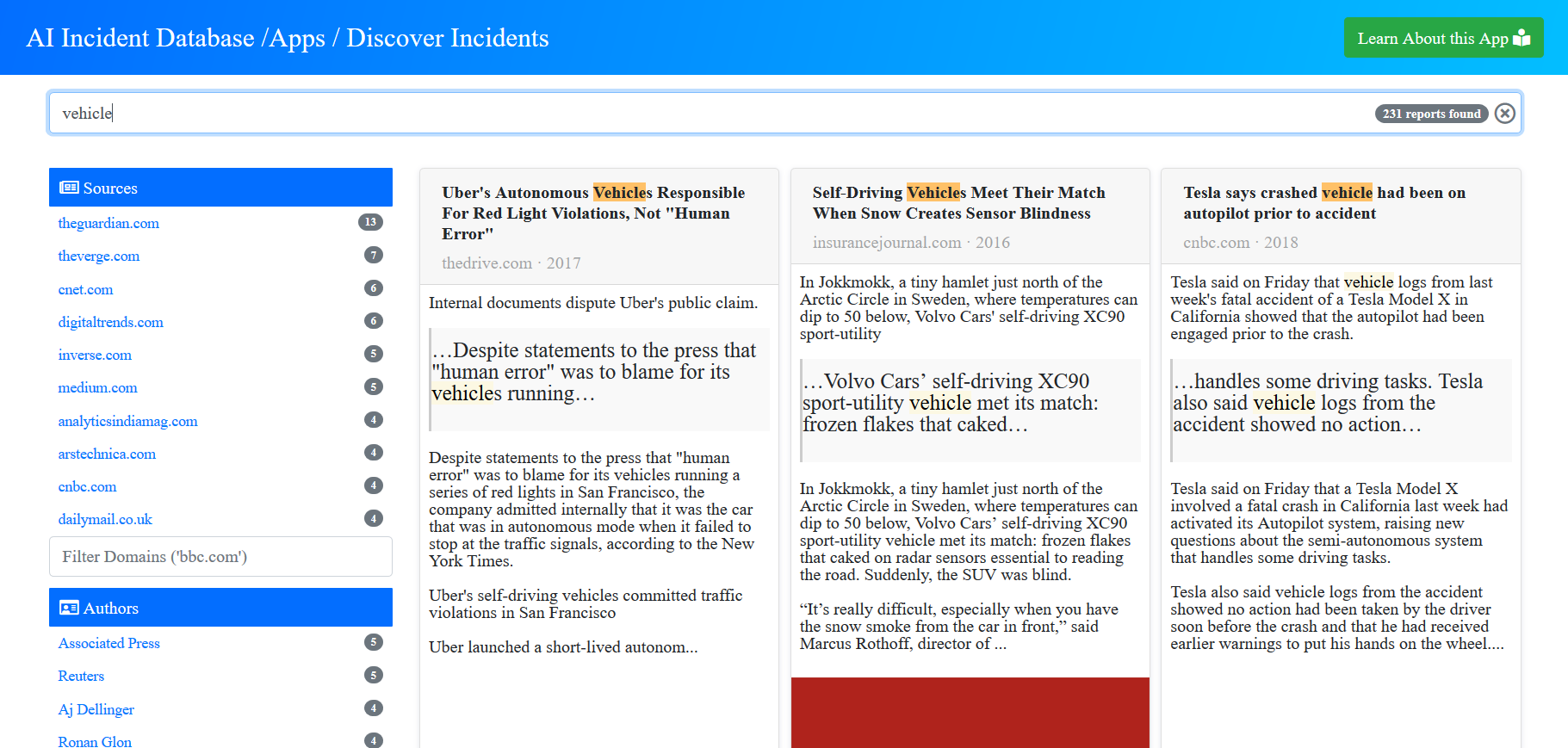

Návštěvníci databáze mohou spouštět dotazy, procházet databázi podle kritérií, jako jsou klíčová slova, ID incidentu, zdroj nebo autor. Například spuštění vyhledávání pro „Deepfake“ vrátí 7 zpráv, zatímco vyhledávání pro „roboty“ vrátí 158 zpráv.

Centralizovaná databáze incidentů, při kterých AI funguje nesprávně nebo neočekávaně, může pomoci výzkumníkům, inženýrům a etikům dohlížet na vývoj a nasazení systémů AI. Produktoví manažeři ve technologických společnostech mohli by použít AIID, aby zjistili, zda existují potenciální problémy před nasazením doporučení systémů AI, nebo inženýr AI mohl získat představu o potenciálních předpojatostech, které je třeba opravit při vytváření aplikace AI. Stejně tak mohli by risk manažeři použít databázi, aby určili potenciální negativní vedlejší účinky spojené s modelem AI, aby mohli naplánovat a vyvinout opatření k zmírnění potenciálních škod.

Architektura podkladová AIID je navržena tak, aby byla flexibilní, což umožňuje vytvářet nové nástroje pro dotazování databáze a extrahování významných informací. Partnership on AI a McGregor budou spolupracovat na vytvoření flexibilní taxonomie, která může být použita pro klasifikaci všech různých forem incidentů AI. Tým doufá, že jakmile bude flexibilní taxonomie vytvořena, může být kombinována s automatizovaným systémem, který bude automaticky zaznamenávat incidenty AI.

„Komunita AI začala sdílet záznamy o incidentech, aby motivovala změny svých produktů, kontrolních postupů a výzkumných programů,” McGregor vysvětlil prostřednictvím TechTalks. “Stránka byla veřejně vydána v listopadu, takže jsme teprve začali využívat výhody systému.”