Umělá inteligence

Supercharging Grafů Neuronových Sítí s Velkými Jazykovými Modely: Últimátní Průvodce

Grafy jsou datové struktury, které reprezentují komplexní vztahy v širokém spektru domén, včetně sociálních sítí, znalostních bází, biologických systémů a mnoha dalších. V těchto grafech jsou entity reprezentovány jako uzly a jejich vztahy jsou znázorněny jako hrany.

Schopnost účinně reprezentovat a uvažovat o těchto složitých relačních strukturách je zásadní pro umožnění pokroků v oblastech, jako je síťová věda, chemoinformatika a doporučovací systémy.

Grafy Neuronových Sítí (GNN) se objevily jako silný rámec hlubokého učení pro úkoly strojového učení na grafech. Integrací topologie grafu do architektury neuronové sítě prostřednictvím agregace sousedství nebo grafových konvolucí mohou GNN učit low-rozměrové vektorové reprezentace, které kódují jak vlastnosti uzlů, tak jejich strukturální role. To umožňuje GNN dosáhnout špičkového výkonu na úkolech, jako je klasifikace uzlů, predikce odkazů a klasifikace grafů v různých aplikacích.

Zatímco GNN přinesly podstatný pokrok, některé klíčové výzvy zůstávají. Získání vysoce kvalitních označených dat pro školení dohlížených modelů GNN může být nákladné a časově náročné. Kromě toho GNN mohou mít potíže s heterogenními grafickými strukturami a situacemi, kdy se distribuce grafu v době testování výrazně liší od trénovacích dat (generalizace mimo distribuci).

Souběžně s tím Velké Jazykové Modely (LLM) jako GPT-4 a LLaMA získaly světovou pozornost svými úžasnými schopnostmi přirozeného jazykového porozumění a generování. Školené na masivních textových korpusech s miliardami parametrů, LLM vykazují pozoruhodné schopnosti few-shot učení, generalizace přes úkoly a schopnosti běžného smyslu, které byly dříve považovány za extrémně náročné pro systémy umělé inteligence.

Úžasný úspěch LLM katalyzoval zkoumání využití jejich síly pro úkoly strojového učení na grafech. Na jedné straně znalostní a uvažovací schopnosti LLM představují příležitosti ke zlepšení tradičních modelů GNN. Naopak, strukturované reprezentace a faktické znalosti obsažené v grafech by mohly být nástrojové při řešení některých klíčových omezení LLM, jako jsou halucinace a nedostatek interpretability.

Grafy Neuronových Sítí a Samo-sebeučící Sebe

Abyste poskytli nezbytný kontext, stručně přezkoumeme základní koncepty a metody v grafech neuronových sítí a samo-sebeučícím grafových reprezentacích.

Architektury Grafů Neuronových Sítí

Architektura Grafu Neuronové Sítě – zdroj

Klíčový rozdíl mezi tradičními hlubokými neuronovými sítěmi a GNN spočívá v jejich schopnosti operovat přímo na graficky strukturovaných datech. GNN následují schéma agregace sousedství, kde každý uzel agreguje vektorové reprezentace ze svých sousedů pro výpočet své vlastní reprezentace.

Bylo navrženo několik architektur GNN s různými instantiacemi zpráv a aktualizačních funkcí, jako jsou Grafické Konvoluční Sítě (GCN), GraphSAGE, Grafické Pozornostní Sítě (GAT) a Grafické Izomorfní Sítě (GIN) mezi ostatními.

V poslední době získaly popularity grafické transformátory adaptací samo-pozornostního mechanismu z přirozeného jazykového transformátoru pro operaci na graficky strukturovaných datech. Některé příklady zahrnují GraphormerTransformer a GraphFormers. Tyto modely jsou schopny zachytit dlouhodobé závislosti napříč grafem lépe než čistě sousedství-založené GNN.

Samo-sebeučící Učení na Grafech

Zatímco GNN jsou silnými reprezentačními modely, jejich výkon je často omezen nedostatkem velkých označených datových sad vyžadovaných pro dohlížené školení. Samo-sebeučící učení se objevilo jako slibný paradigm pro předškolení GNN na neoznačených grafových datech využitím pretextových úkolů, které vyžadují pouze vnitřní grafickou strukturu a uzlové funkce.

Samo-sebeučící Graf – zdroj

Některé běžné pretextové úkoly používané pro samo-sebeučící předškolení GNN zahrnují:

- Predikce Vlastností Uzlu: Náhodné maskování nebo poškozování části uzlových atributů/vlastností a úkol GNN je rekonstruovat.

- Predikce Hran/Odkazů: Učení predikovat, zda existuje hrana mezi párem uzlů, často založené na náhodném maskování hran.

- Kontrastivní Učení: Maximální podobnosti mezi grafickými pohledy stejného grafického vzorku, zatímco tlačení pohledů z různých grafů.

- Maximalizace Společné Informace: Maximální společná informace mezi místními uzlovými reprezentacemi a cílovou reprezentací, jako je globální grafické vložené.

Pretextové úkoly, jako tyto, umožňují GNN extrahovat významné strukturální a sémantické vzory z neoznačených grafových dat během předškolení. Předškolený GNN lze pak dotvořit na relativně malých označených podmnožinách, aby vynikl v různých downstream úkolech, jako je klasifikace uzlů, predikce odkazů a klasifikace grafů.

Využitím samo-sebeučícího učení GNN předškoleno na velkých neoznačených datech vykazuje lepší generalizaci, odolnost vůči posunům distribuce a efektivitu ve srovnání se školením od začátku. Nicméně, některé klíčové omezení tradičních GNN-založených samo-sebeučících metod zůstávají, které budeme procházet pomocí LLM pro řešení dále.

Vylepšení Grafického Strojového Učení s Velkými Jazykovými Modely

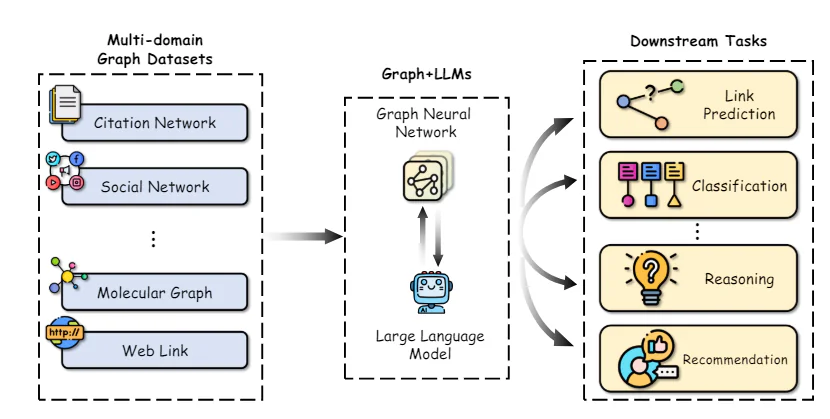

Integrace Grafů a LLM – zdroj

Úžasné schopnosti LLM v porozumění přirozenému jazyku, uvažování a few-shot učení představují příležitosti ke zlepšení několika aspektů grafických strojových učeních řetězců. Prozkoumáme některé klíčové směry výzkumu v tomto prostoru:

Klíčovou výzvou při aplikaci GNN je získání vysoce kvalitních reprezentačních reprezentací pro uzly a hrany, zejména když obsahují bohaté textové atributy, jako jsou popisy, názvy nebo abstrakty. Tradičně byly použity jednoduché bag-of-words nebo předškoleno word embedding modely, které často nedokáží zachytit jemné sémantiky.

Nedávné práce prokázaly sílu využití velkých jazykových modelů jako textových kódérů pro konstrukci lepší uzlové/okrajové funkční reprezentace před předáním do GNN. Například Chen et al. využívají LLM jako GPT-3 pro kódování textových uzlových atributů, ukazující významné zlepšení výkonu oproti tradičním word embeddingům na úkolech klasifikace uzlů.

Mimo lepší textové kódéry LLM mohou být použity pro generování augmentovaných informací z původních textových atributů v polo-supervizovaném způsobem. TAPE generuje potenciální štítky/vysvětlivky pro uzly pomocí LLM a používá je jako další augmentované funkce. KEA extrahuje termíny z textových atributů pomocí LLM a získává podrobné popisy pro tyto termíny, aby rozšířil funkce.

Zlepšením kvality a expresivnosti vstupních funkcí LLM mohou přenést své nadřazené přirozené jazykové porozumění schopnosti do GNN, zvyšující výkon na downstream úkolech.