Myslitelé

Což by měl vědět každý data scientist o Graph Transformerech a jejich dopadu na strukturovaná data

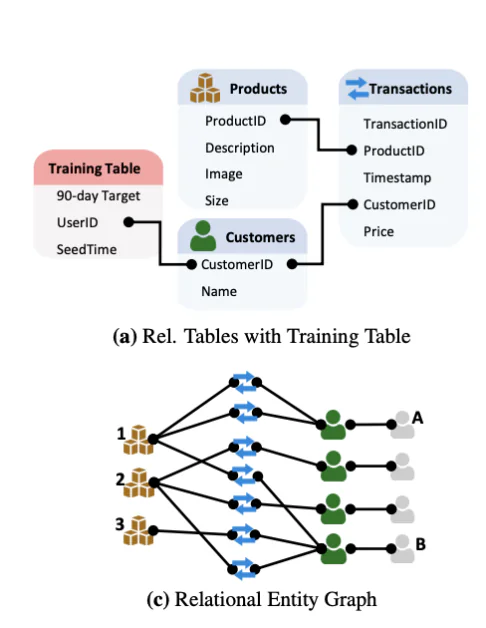

Spolu jsem vytvořil Graph Neural Networks, když jsem byl na Stanfordu. Brzy jsem si uvědomil, že tato technologie je neuvěřitelně silná. Každý datový bod, každá observace, každý kus znalostí neexistuje v izolaci; je součástí grafu spojeného s jinými kusy znalostí. Důležité je, že většina cenných obchodních dat, často uložených jako tabulky v databázích a skladbách dat, může být přirozeně reprezentována jako graf. Využití této relační struktury je klíčem k vytváření přesných a nehalucinujících modelů AI.

Grafické neuronové sítě (GNN) zavedly architektury pro přenos zpráv, které mohly rozumět grafům zachycujícím spojení mezi kusy znalostí. Ale stejně jako Transformery transformovali porozumění jazyku, nová třída modelů, Graph Transformery, přináší podobné zisky do grafických dat. Tyto modely kombinují flexibilitu mechanismů pozornosti se strukturálními grafickými apriory, aby modelovaly komplexní vztahy účinněji než jejich předchůdci GNN.

Proč grafy potřebují více než přenos zpráv

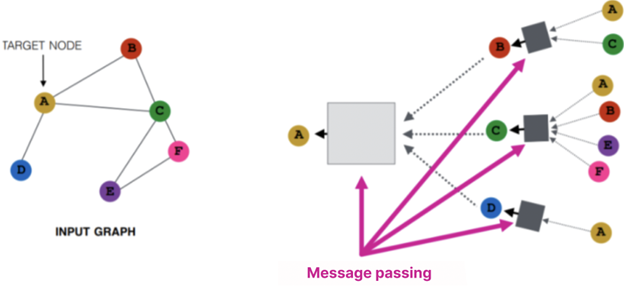

Tradiční grafické neuronové sítě (GNN) se spoléhají na přenos zpráv, proces, při kterém každý uzel aktualizuje svůj vnitřní stav agregací informací ze svých sousedů. Představte si to jako každý uzel vyměňuje souhrny se sousedními uzly, a pak používá tyto souhrny ke zlepšení svého vlastního porozumění. Během mnoha vrstev to umožňuje informacím propagovat se grafem.

Zatímco je to silné pro učení lokálních vzorců, přenos zpráv má důležité omezení:

- Přepínač: Jak jsou informace agregovány přes mnoho skoků, mohou se stát komprimovanými, ztrácíce smysluplné detaily. To je especialmente problematické v hlubokých GNN.

- Omezený kontext: Standardní přenos zpráv nemůže snadno zachytit dlouhodobé závislosti bez mnoha vrstev, což zvyšuje složitost a šum.

- Výrazivost: Mnoho grafických struktur nemůže být diferencováno pomocí pouze lokální sousední informace, omezující výkon modelu na úkolech vyžadujících jemné strukturální rozdíly.

To je místo, kde Graph Transformery vstupují. Nahrazují nebo doplňují přenos zpráv mechanismy pozornosti, umožňují každému uzlu přímo se soustředit na ostatní (i vzdálené) na základě naučené důležitosti. Výsledkem jsou bohatší reprezentace, lepší škálovatelnost a schopnost rozumět komplexním strukturám více flexibilně.

Od GNN po Graph Transformery

Původní model Transformer, uveden v ikonickém článku, Pozornost je vše, co potřebujete, byl navržen pro modelování vztahů mezi tokeny v sekvenci. Jeho úspěch spočívá v samo-pozornosti, mechanismu, který umožňuje každému vstupu zvažovat každý jiný vstup, vážený naučenou relevancí.

Graph Transformery adaptují tento paradigmatický přístup tím, že umožňují uzlům se soustředit nejen na své sousedy, ale na jakýkoli uzel v grafu, buď prostřednictvím plně propojené pozornosti nebo hybridního přístupu, který vyvažuje globální a lokální signály. Výzvou je zavedení pojmu struktury do modelu navrženého pro neuspořádané sekvence.

Graf-specifické Pozicionální Kódování

Na rozdíl od textu grafy nemají vnitřní pořadí, což činí pozicionální kódování, které se týká technik pro vkládání strukturální nebo lokální informace do modelu, ne-triviální. Graph Transformery řeší tuto výzvu různými metodami:

- Laplacian Eigenvectors: Odvozené z grafické Laplacian matice, tyto poskytují spektrální embedding, který zachycuje globální strukturu.

- Random Walks: Zachycují pravděpodobnost přechodu z jednoho uzlu do druhého přes více skoků.

- Strukturální Kódování: Zahrnují vzdálenostní metriky, stupeň uzlu nebo typy hran.

Tato pozicionální kódování, zda spektrální, pravděpodobnostní nebo strukturální, poskytují Graph Transformerům způsob, jak porozumět, kde každý uzel sedí v rámci širšího grafu. Tato strukturální povědomí je nezbytná pro umožnění mechanismům pozornosti fungovat smysluplně napříč nepravidelnými, neuspořádanými daty, nakonec umožňující modelu zachytit vztahy, které by byly neviditelné pro jednodušší, čistě lokální metody.

Reálné Implementace a Případy Použití

Zavedení Graph Transformerů do produkce vyžaduje infrastrukturu, která může škálovat na reálné velikosti dat. Knihovny jako PyTorch Geometric (PyG) to umožňují. Postavený na PyTorch, PyG poskytuje modulární rámec pro implementaci GNN a Graph Transformerů napříč širokým spektrem aplikací, od modelování molekul po systémy doporučení. Podporuje mini-batch trénink na mnoha malých grafech a jednom velkém grafu, s multi-GPU a torch.compile podporou, což z něj činí vhodný pro výzkum a podnikové pracovní postupy.

Tyto nástroje již pohánějí širokou škálu reálných aplikací. V objevování léků Graph Transformery pomáhají předpovídat molekulární vlastnosti modelováním atomových interakcí jako grafů. V logistice a optimalizaci dodavatelského řetězce mohou reprezentovat a rozumět dynamickým sítím zásilek, skladů a tras. E-commerce společnosti je používají ke zlepšení doporučení porozuměním chování při společném nákupu a prohlížení produktů jako relačních grafů. A v kybernetické bezpečnosti se grafické modely používají k detekci anomálií analýzou přístupových vzorců, topologie sítě a sekvencí událostí.

V každém z těchto nastavení je schopnost učit se z komplexních, propojených struktur, bez závislosti pouze na ručně vytvořených funkcích, se ukazuje jako významná výhoda.

Technické Úvahy

Navzdory jejich potenciálu Graph Transformery přinášejí skutečné inženýrské kompromisy. Plná samo-pozornost škáluje kvadraticky s počtem uzlů, což činí efektivitu paměti a výpočetní efektivitu top prioritou, zejména pro velké nebo husté grafy. Mnoho reálných grafů také má směrové hrany, což zavedení asymetrií komplikuje, jak strukturální informace jsou zakódovány. A v praktických nasazeních jsou vstupy zřídka uniformní: kombinace graf-strukturovaných dat s textem, časovými řadami nebo obrázky vyžaduje pečlivé architektonické volby a robustní předzpracování dat.

Tyto výzvy nejsou nepřekonatelné, ale vyžadují uvážlivé systémové návrhy, zejména při přechodu z výzkumných prototypů na modely připravené k produkci.

Co dál: LLMs setkávají se Grafi

Hlavním směrem výzkumu je integrace velkých jazykových modelů (LLM) s grafickými strukturami. Tyto hybridní systémy používají LLM k zakódování kontextu nebo extrakci entit, a poté zakotví tuto informaci v grafu pro rozhodování a uvažování.

V biologii to pohánělo nástroje jako AlphaFold. V podnikovém AI to umožňuje systémy zákaznické podpory, které kombinují dokumentaci a behaviorální grafy. Graph Transformery hrají také rostoucí roli při umožnění AI agentům učinit chytřejší, více akční rozhodnutí, umožňující jim rozumět strukturovaným reprezentacím stavu a priorizovat interakce dynamicky. Tato fúze pomáhá agentům lépe rozumět hierarchickým vztahům, sledovat závislosti v čase a přizpůsobovat své chování v komplexních prostředích.

Toto pole se stále vyvíjí, ale potenciál je významný.

Závěr

Graph Transformery nejsou pouze další iterací GNN; reprezentují konvergenci pozornosti, struktury a škálovatelnosti. Bez ohledu na to, zda pracujete ve financích, life sciences nebo systémech doporučení, zpráva je jasná: vaše data tvoří graf, takže vaše modely by také měly.