Umělá inteligence

Mistral AI: Nová laťka pro open-source modely beyond Llama2

Velké jazykové modely (LLM) se nedávno staly středem pozornosti, díky vynikajícím výkonům jako je ChatGPT. Když Meta představila své modely Llama, vyvolala to nový zájem o open-source LLM. Cílem je vytvořit dostupné, open-source LLM, které jsou stejně dobré jako top-modely jako GPT-4, ale bez vysoké ceny nebo složitosti.

Tato kombinace dostupnosti a efektivity neonly otevřela nové cesty pro výzkumníky a vývojáře, ale také nastolila novou éru technologických pokroků v zpracování přirozeného jazyka.

Nedávno získaly startupy zaměřené na generativní AI značné financování. Společnost Together získala 20 milionů dolarů za účelem budování open-source generativních AI modelů. Anthropic získala působivých 450 milionů dolarů a Cohere, ve spolupráci s Google Cloud, získala 270 milionů dolarů v červnu tohoto roku.

Úvod do Mistral 7B: Velikost a dostupnost

Mistral AI, se sídlem v Paříži a založená absolventy Google DeepMind a Meta, oznámila svůj první velký jazykový model: Mistral 7B. Tento model lze snadno stáhnout kdokoli z GitHubu a dokonce i prostřednictvím 13,4-gigabytového torrentu.

Tento startup získal rekordní seed financování, ještě předtím, než měl produkt na trhu. Mistral AI první model s 7 miliardami parametrů překonává výkon Llama 2 13B ve všech testech a poráží Llama 1 34B ve mnoha metrikách.

V porovnání s jinými modely, jako je Llama 2, Mistral 7B poskytuje podobné nebo lepší schopnosti, ale s menším výpočetním zatížením. Zatímco základní modely, jako je GPT-4, mohou dosáhnout více, jsou dražší a méně uživatelsky přívětivé, protože jsou主要 přístupné prostřednictvím API.

Při kódování úloh Mistral 7B dává CodeLlama 7B šanci na úspěch. Kromě toho je dostatečně kompaktní, aby běžel na standardních strojích.

Kromě toho má Mistral 7B Instruct, který je speciálně naladěn pro instruktážní datové sady na Hugging Face, prokázal skvělý výkon. Překonává ostatní 7B modely na MT-Bench a stojí ramen při rameni s 13B chat modely.

Hugging Face Mistral 7B Example

Performance Benchmarking

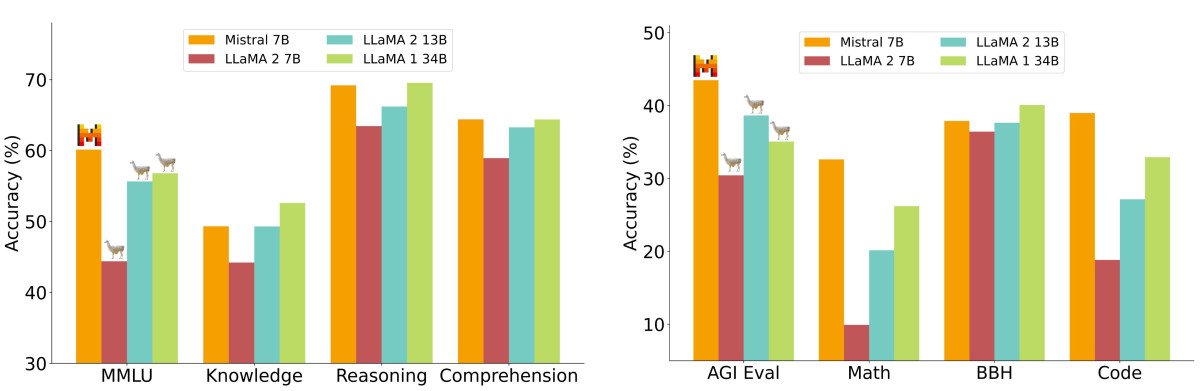

V podrobné analýze výkonu byl Mistral 7B měřen proti modelům Llama 2. Výsledky byly jasné: Mistral 7B podstatně překonává Llama 2 13B ve všech benchmarcích. Skutečně se vyrovná výkonu Llama 34B, zejména vynikající v kódování a rozumových benchmarcích.

Benchmárky byly organizovány do několika kategorií, jako je Commonsense Reasoning, Světové znalosti, Čtenářská komprese, Matematika a Kód, mezi jinými. Zvláště pozoruhodným pozorováním bylo, že Mistral 7B prokázal výkon blízký Llama 2 modelu třikrát větší, což naznačuje potenciální úspory v paměti a zvýšení propustnosti. Nicméně, v znalostních benchmarcích, Mistral 7B se vyrovnal Llama 2 13B, což je pravděpodobně způsobeno omezeními parametrů, které ovlivňují kompresi znalostí.

Co dělá model Mistral 7B lepší než většina ostatních jazykových modelů?

Zjednodušení Pozornostních Mechanismů

Zatímco nuance pozornostních mechanismů jsou technické, jejich základní myšlenka je relativně jednoduchá. Představte si, že čtete knihu a zvýrazňujete důležité věty; tohle je analogické k tomu, jak pozornostní mechanismy “zvýrazňují” nebo dávají důležitost konkrétním datovým bodům v sekvenci.

V kontextu jazykových modelů tyto mechanismy umožňují modelu soustředit se na nejrelevantnější části vstupních dat, zajišťující, že výstup je koherentní a kontextuálně přesný.

Ve standardních transformátorech jsou pozornostní skóre vypočteny pomocí vzorce:

Vzorec pro tyto skóre zahrnuje kritický krok – maticové násobení Q a K. Výzvou zde je, že jak se délka sekvence zvětšuje, obě matice se rozšiřují odpovídajícím způsobem, vedoucí k výpočetně náročnému procesu. Tato škálovatelnost je jedním z hlavních důvodů, proč standardní transformátory mohou být pomalé, zejména při zpracování dlouhých sekvencí.

Multi-dotazová pozornost (MQA) urychluje proces pomocí jedné sady “klíč-hodnota” hlav, ale někdy obětuje kvalitu. Nyní se můžete ptát, proč ne kombinovat rychlost MQA s kvalitou multi-head pozornosti? To je místo, kde přichází Skupinová dotazová pozornost (GQA).

Skupinová dotazová pozornost (GQA)

GQA je prostřední řešení. Místo použití pouze jedné nebo více “klíč-hodnota” hlav, GQA skupiny. Tímto způsobem GQA dosahuje výkonu blízkého podrobné multi-head pozornosti, ale s rychlostí MQA. Pro modely, jako je Mistral, to znamená efektivní výkon bez přílišného kompromisu kvality.

Klouzavé okno pozornosti (SWA)

Klouzavé okno je další metodou používanou při zpracování pozornostních sekvencí. Tato metoda používá pevně veliké okno pozornosti kolem každého tokenu v sekvenci. S více vrstvami, které tuto okenní pozornost skládají, horní vrstvy nakonec získávají širší perspektivu, zahrnující informace z celého vstupu. Tento mechanismus je analogický k receptivním polím viditelným v Konvolučních neuronových sítích (CNN).

Na druhé straně “dilated sliding window attention” modelu Longformer, který je konceptuálně podobný metodě klouzavého okna, počítá pouze několik diagonál matice. Tento změna vede k tomu, že využití paměti se zvyšuje lineárně, spíše než kvadraticky, což je efektivnější metoda pro delší sekvence.

Průhlednost Mistral AI vs. bezpečnostní obavy v decentralizaci

Ve svém oznámení Mistral AI také zdůraznila průhlednost prohlášením: “Žádné triky, žádné proprietární údaje.” Ale zároveň jejich jediný dostupný model v současné době ‘Mistral-7B-v0.1’ je předtrénovaný základní model, a proto může generovat odpověď na jakoukoli otázku bez moderace, což vyvolává potenciální bezpečnostní obavy. Zatímco modely, jako je GPT a Llama, mají mechanismy pro rozlišení, kdy odpovědět, Mistralova plně decentralizovaná povaha by mohla být zneužita špatnými aktéry.

Nicméně, decentralizace velkých jazykových modelů má své zásluhy. Zatímco někteří ji mohou zneužít, lidé mohou využít její sílu pro společenské dobro a zpřístupnění inteligence všem.

Flexibilita nasazení

Jedním z hlavních výhod je, že Mistral 7B je dostupný pod licencí Apache 2.0. To znamená, že nejsou žádné skutečné bariéry pro jeho použití – ať už jej používáte pro osobní účely, velkou korporaci nebo dokonce vládní entitu. Stačí mít správný systém pro jeho spuštění, nebo můžete investovat do cloudových zdrojů.

Zatímco existují další licence, jako je jednodušší licence MIT a kooperativní licence CC BY-SA-4.0, která vyžaduje uvedení zdroje a podobnou licenci pro deriváty, licence Apache 2.0 poskytuje robustní základ pro velké podniky.

Závěrečné myšlenky

Vzestup open-source velkých jazykových modelů, jako je Mistral 7B, signalizuje zásadní změnu v odvětví AI, zpřístupňující vysoce kvalitní jazykové modely širšímu publiku. Inovativní přístupy Mistral AI, jako je Skupinová dotazová pozornost a Klouzavé okno pozornosti, slibují efektivní výkon bez kompromisu kvality.

Zatímco decentralizovaná povaha Mistralu vyvolává určité výzvy, jeho flexibilita a open-source licence podtrhují potenciál pro demokratizaci AI. Jak se krajina vyvíjí, bude se zaměřovat na vyvážení síly těchto modelů s etickými úvahami a bezpečnostními mechanismy.

Co dál pro Mistral? Model 7B byl pouze začátkem. Tým plánuje spustit ještě větší modely brzy. Pokud tyto nové modely budou odpovídat výkonu 7B, Mistral by mohl rychle vystoupit jako jeden z nejlepších hráčů v odvětví, vše během svého prvního roku.