Umělá inteligence

Generování lepšího AI videa z pouhých dvou obrázků

Interpolace rámců videa (VFI) je otevřeným problémem v oblasti generativního výzkumu videa. Výzvou je generovat mezilehlé rámce mezi dvěma existujícími rámci v sekvenci videa.

Kliknutím se přehraje. Rámec FILM, spolupráce mezi Google a University of Washington, navrhl efektivní metodu interpolace rámců, která zůstává populární v hobbyistických a profesionálních sférách. Vlevo můžeme vidět dva samostatné a odlišné rámce superponované; uprostřed je ‘koncový rámec’; a vpravo je konečná syntéza mezi rámci. Zdroje: https://film-net.github.io/ a https://arxiv.org/pdf/2202.04901

Široce řečeno, tato technika sahá více než století nazpět a byla použita v tradiční animaci od té doby. V tomto kontextu by hlavní ‘klíčové rámce’ byly generovány hlavním animátorem, zatímco práce na ‘tweeningu’ mezilehlých rámců by byla prováděna jinými zaměstnanci jako více podřadná úloha.

Před vzestupem generativního AI, byla interpolace rámců použita v projektech, jako je Real-Time Intermediate Flow Estimation (RIFE), Depth-Aware Video Frame Interpolation (DAIN) a Google’s Frame Interpolation for Large Motion (FILM – viz výše) za účelem zvýšení frekvence rámců existujícího videa nebo umožnění umělých pomalých efektů. To je dosaženo rozdělením existujících rámců klipu a generováním odhadnutých mezilehlých rámců.

VFI je také použita ve vývoji lepších video kodeků a obecněji v optickém toku-založených systémech (včetně generativních systémů), které využívají pokročilé znalosti nadcházejících klíčových rámců k optimalizaci a tvarování mezilehlého obsahu, který jim předchází.

Koncové rámce v generativních video systémech

Moderní generativní systémy, jako je Luma a Kling, umožňují uživatelům specifikovat startovní a koncový rámec a mohou tuto úlohu provádět analýzou klíčových bodů ve dvou obrazech a odhadem trajektorie mezi dvěma obrázky.

Jak můžeme vidět v níže uvedených příkladech, poskytnutí ‘uzavíracího’ klíčového rámce umožňuje generativnímu video systému (v tomto případě Kling) zachovat aspekty, jako je identita, i když výsledky nejsou dokonalé (zvláště při velkých pohybech).

Kliknutím se přehraje. Kling je jedním z rostoucího počtu generátorů videa, včetně Runway a Luma, které umožňují uživateli specifikovat koncový rámec. Ve většině případů vede minimální pohyb k nejrealističtějším a nejméně poškozeným výsledkům. Zdroj: https://www.youtube.com/watch?v=8oylqODAaH8

V výše uvedeném příkladu je identita osoby konzistentní mezi dvěma uživatelsky poskytnutými klíčovými rámci, což vede k relativně konzistentní generaci videa.

Kde je poskytnut pouze startovní rámec, okno pozornosti generativního systému není obvykle dostatečně velké, aby ‘pamatovalo’, jak vypadala osoba na začátku videa. Spíše je identita pravděpodobně posunuta trochu s každým rámcem, dokud není ztracena вся podobnost. V níže uvedeném příkladu byl nahrán startovací obraz a pohyb osoby byl řízen textovým promptem:

Kliknutím se přehraje. Bez koncového rámce má Kling pouze malou skupinu bezprostředně předchozích rámců, které řídí generování následujících rámců. V případech, kdy je vyžadován jakýkoli významný pohyb, se tato atrofie identity stává závažnou.

Můžeme vidět, že podobnost herce není odolná vůči pokynům, protože generativní systém neví, jak by on vypadal, kdyby se usmíval, a on se neusmívá v semenném obraze (jediném dostupném odkazu).

Většina virálních generativních klipů je pečlivě kurátorována, aby tyto nedostatky minimalizovala. Nicméně, pokrok v časově konzistentních generativních video systémech může záviset na nových vývoji z výzkumného sektoru v souvislosti s interpolací rámců, protože jedinou možnou alternativou je závislost na tradičním CGI jako na ‘vedoucím’ videu (a dokonce i v tomto případě je konzistence textu a osvětlení目前 difícelná k dosažení).

Navíc, pomalu iterativní povaha odvozování nového rámce z malé skupiny nedávných rámců činí velmi obtížným dosáhnout velkých a odvážných pohybů. To je způsobeno tím, že objekt, který se rychle pohybuje přes rámec, může přejít z jedné strany na druhou v rámci jediného rámce, na rozdíl od více postupných pohybů, na které je systém pravděpodobně trénován.

Podobně, významná a odvážná změna postoje může vést nejen ke změně identity, ale také k živým nekongruencím:

Kliknutím se přehraje. V tomto příkladu z Luma, požadovaný pohyb nezdá se být dobře reprezentován v trénovacích datech.

Framer

To nás přivádí k zajímavé nedávné práci z Číny, která tvrdí, že dosáhla nového stavu umění v autenticky vypadající interpolaci rámců – a která je první svého druhu, která nabízí drag-based uživatelské rozhraní.

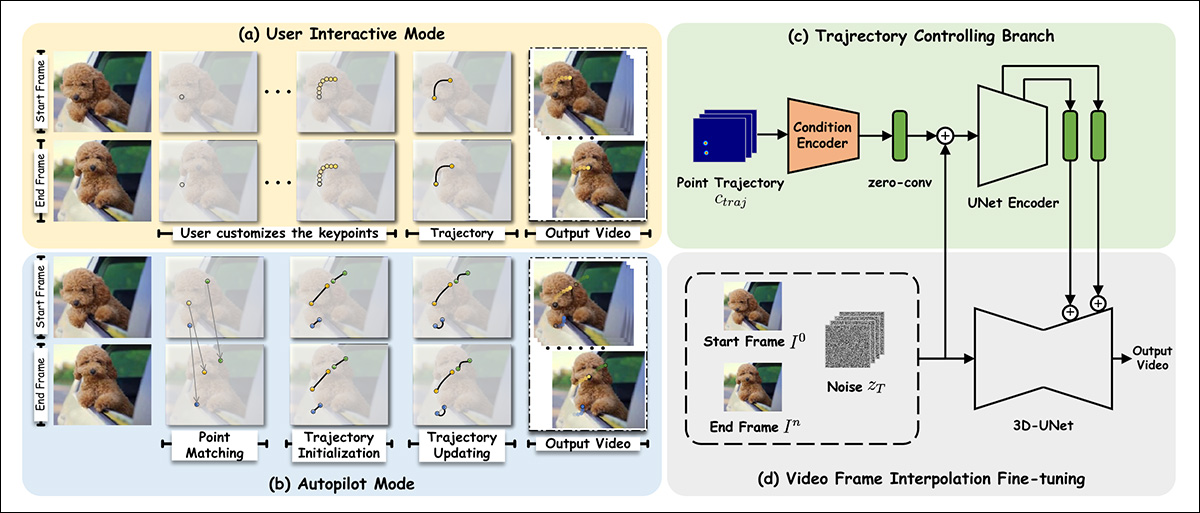

Framer umožňuje uživateli řídit pohyb pomocí intuitivního drag-based rozhraní, i když má také ‘automatický’ režim. Zdroj: https://www.youtube.com/watch?v=4MPGKgn7jRc

Drag-centric aplikace se staly častými v literatuře nedávno, protože výzkumný sektor bojuje o poskytování instrumentálií pro generativní systémy, které nejsou založeny na fairly hrubých výsledcích získaných pomocí textových promptů.

Nový systém, nazvaný Framer, může nejen sledovat uživatelsky vedený drag, ale také má více konvenční ‘autopilot’ režim. Kromě konvenčního tweeningu je systém schopen produkovat time-lapse simulace, stejně jako morphing a nové pohledy na vstupní obraz.

Mezilehlé rámce generované pro time-lapse simulaci ve Frameru. Zdroj: https://arxiv.org/pdf/2410.18978

V souvislosti s produkcí nových pohledů, Framer přechází trochu do území Neural Radiance Fields (NeRF) – i když vyžaduje pouze dva obrázky, zatímco NeRF obecně vyžaduje šest nebo více vstupních pohledů.

Ve testech, Framer, který je založen na Stability.ai’s Stable Video Diffusion latentní difuzní generativní video model, byl schopen překonat aproximované rivality, v uživatelské studii.

V době psaní, kód je nastaven být vydán na GitHub. Video ukázky (z nichž jsou výše uvedené obrázky odvozeny) jsou k dispozici na projektu, a výzkumníci také vydali YouTube video.

Nová práce nová práce je nazvaná Framer: Interactive Frame Interpolation, a pochází z devíti výzkumníků z Univerzity Če-ťiang a Alibaba-backed Ant Group.

Metoda

Framer používá interpolaci založenou na klíčových bodech ve svých dvou modalitách, kde je vstupní obraz hodnocen pro základní topologii, a ‘pohyblivé’ body jsou přiřazeny, kde je to nutné. Ve skutečnosti jsou tyto body ekvivalentní k obličejovým orientačním bodům v ID-založených systémech, ale generalizují se na jakoukoli plochu.

Výzkumníci fine-tuned Stable Video Diffusion (SVD) na OpenVid-1M dataset, přidáním další poslední syntézy schopnosti. To usnadňuje mechanismus kontroly trajektorie (nahoře vpravo ve schématu níže), který může vyhodnotit cestu k koncovému rámcu (nebo zpět z něj).

Schéma pro Framer.

V souvislosti s přidáním poslední syntézy, autoři uvádějí:

‘Abychom zachovali vizuální předchozí znalosti předtrénovaného SVD co nejvíce, následujeme kondiční paradigm SVD a vkládáme podmínky koncového rámce do latentního prostoru a sémantického prostoru, resp.

‘Konkrétně, spojujeme VAE-kódovaný latentní rys prvního [rámce] s hlukovým latentním prvním rámcem, stejně jako v SVD. Kromě toho spojujeme latentní rys posledního rámce, zn, s hlukovým latentním koncovým rámcem, s tím, že podmínky a odpovídající hlukové latenty jsou prostorově zarovnány.

‘Kromě toho extrahujeme CLIP obrazové vložky prvního a posledního rámců samostatně a spojujeme je pro injekci funkcí pro křížovou pozornost.’

Pro drag-based funkčnost, modul trajektorie využívá Meta Ai-led CoTracker framework, který vyhodnocuje profuse možné cesty dopředu. Tyto jsou zredukovány na mezi 1-10 možnými trajektoriemi.

Získané souřadnice bodů jsou poté transformovány metodou inspirovanou DragNUWA a DragAnything architekturami. To získá Gaussian heatmap, který individuuje cílové oblasti pro pohyb.

Následně jsou data krmena do kondičních mechanismů ControlNet, pomocného konformního systému původně navrženého pro Stable Diffusion, a od té doby adaptovaného pro další architektury.

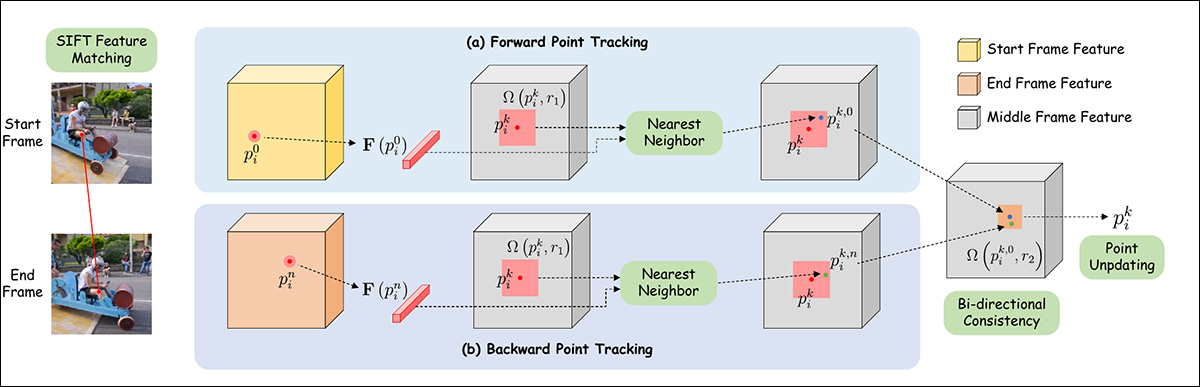

Pro autopilot režim, feature matching je inicializován prostřednictvím SIFT, který interpretuje trajektorii, která může být poté předána do auto-aktualizačního mechanismu inspirovaného DragGAN a DragDiffusion.

Schéma pro odhad trajektorie bodu ve Frameru.

Data a testy

Pro fine-tuning Frameru, prostorová pozornost a zbytkové bloky byly zmrazeny, a pouze temporální pozornost vrstvy a zbytkové bloky byly ovlivněny.

Model byl trénován po 10 000 iterací pod AdamW, při learning rate 1e-4, a batch size 16. Trénování probíhalo napříč 16 NVIDIA A100 GPU.

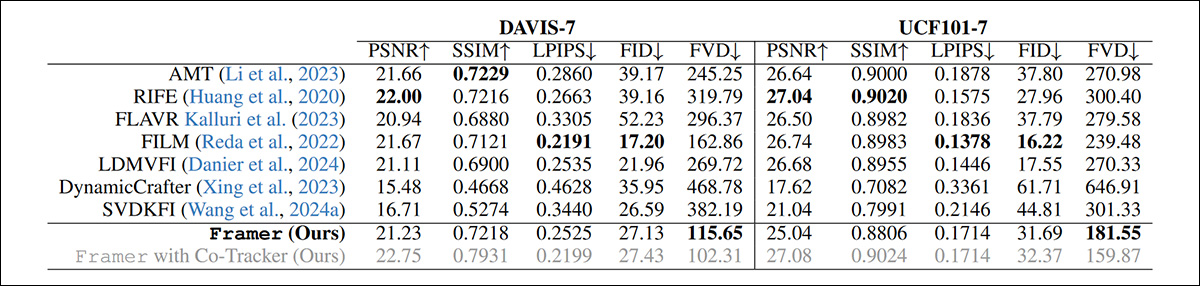

Jelikož předchozí přístupy k problému nenabízejí drag-based editaci, výzkumníci se rozhodli porovnat autopilot režim Frameru se standardní funkcionalitou starších nabídek.

Frameworky testované pro kategorii současných difuzních generativních video systémů byly LDMVFI; Dynamic Crafter; a SVDKFI. Pro ‘tradiční’ video systémy, rivalitní frameworky byly AMT; RIFE; FLAVR; a výše zmíněný FILM.

Kromě uživatelské studie, testy byly provedeny přes DAVIS a UCF101 dataset.

Kvalitativní testy mohou být hodnoceny pouze objektivními fakultami výzkumného týmu a uživatelskými studiemi. Nicméně, práce poznamenává, tradiční quantitativní metriky jsou převážně nevhodné pro návrh:

[Rekonstrukční] metriky, jako je PSNR, SSIM a LPIPS, nedokáží přesně zachytit kvalitu interpolovaných rámců, protože penalizují jiné možné interpolované výsledky, které nejsou pixelově zarovnány s původním videem.

‘Zatímco generativní metriky, jako je FID, nabízejí určitou zlepšení, stále nejsou dostatečné, protože nezohledňují časovou konzistenci a hodnotí rámce izolovaně.’

Navzdory tomu, výzkumníci provedli kvalitativní testy s několika populárními metrikami:

Quantitativní výsledky pro Framer vs. rivalitní systémy.

Autoři poznamenávají, že navzdory tomu, že mají šance proti nim, Framer stále dosahuje nejlepšího FVD skóre mezi testovanými metodami.

Níže jsou uvedeny výsledky práce pro kvalitativní srovnání:

Kvalitativní srovnání proti předchozím přístupům. Prosím, odkážete se na práci pro lepší rozlišení, stejně jako video výsledky na https://www.youtube.com/watch?v=4MPGKgn7jRc.

Autoři komentují:

‘[Naše] metoda produkuje významně jasnější textury a přirozený pohyb ve srovnání s existujícími interpolacemi. Vykonává se zvláště dobře ve scénářích s podstatnými rozdíly mezi vstupními rámci, kde tradiční metody často selhávají při interpolaci obsahu přesně.

‘Ve srovnání s jinými difuzními metodami, jako je LDMVFI a SVDKFI, Framer demonstruje lepší adaptabilitu na náročné případy a nabízí lepší kontrolu.’

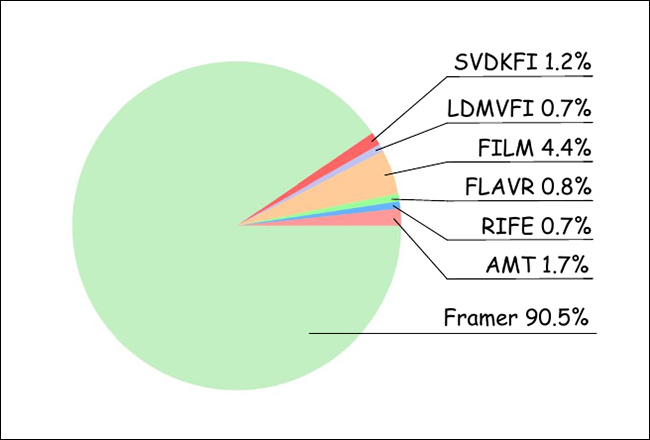

Pro uživatelskou studii, výzkumníci shromáždili 20 účastníků, kteří hodnotili 100 náhodně uspořádaných video výsledků z různých metod testovaných. Takže, 1000 hodnocení bylo získáno, hodnotící nej’realističtější’ nabídky:

Výsledky z uživatelské studie.

Jak je vidět z grafu výše, uživatelé jednoznačně preferovali výsledky z Frameru.

Projektový doprovodný YouTube video popisuje některé další možné použití pro Framer, včetně morphingu a cartoon in-betweeningu – kde celý koncept začal.

Závěr

Je obtížné přehánět, jak důležitá je tato výzva目前 pro úkol AI-založené generace videa. Do současnosti, starší řešení, jako je FILM a (non-AI) EbSynth, byla použita, jak amatérskými, tak profesionálními komunitami, pro tweening mezi rámci; ale tato řešení přicházejí s pozoruhodnými omezeními.

Protože oficiální ukázková videa pro nové T2V frameworky jsou často kurátorována, aby minimalizovala tyto nedostatky, existuje široká veřejná mylná představa, že systémy strojového učení mohou přesně odvodit geometrii v pohybu bez použití pomocných mechanismů, jako jsou 3D modely (3DMMs), nebo jiných pomocných přístupů, jako je LoRAs.

Čestně řečeno, tweening samo o sobě, i kdyby bylo možné jej dokonale provést, představuje pouze ‘hack’ nebo trik na tento problém. Nicméně, protože je často snazší produkovat dva dobře zarovnané rámce než provést vedení prostřednictvím textových promptů nebo současné řady alternativ, je dobré vidět iterativní pokrok na AI-založené verzi této starší metody.

Poprvé publikováno úterý, 29. října 2024