Umělá inteligence

Rozpojení je další hluboká revoluce Deepfake

CGI data augmentation je používána v novém projektu, aby získala větší kontrolu nad deepfake obrázky. Ačkoli stále nelze efektivně použít CGI hlavy k vyplnění chybějících mezer v deepfake dataselech, nová vlna výzkumu do rozpojení identity od kontextu znamená, že brzy možná nebude třeba.

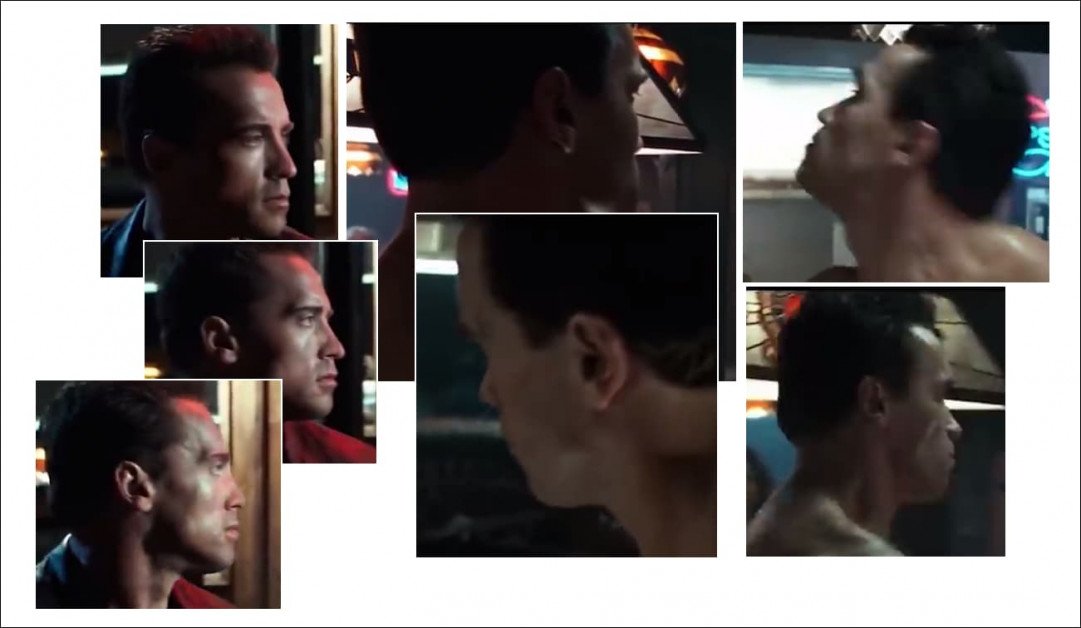

Tvůrci některých z nejúspěšnějších virálních deepfake videí posledních let vybírají své zdrojové videa velmi pečlivě, vyhýbají se udržení profilových snímků (tj. druhu bočních mugshotů, které se staly populárními díky policejním zatýkacím procedurám), akutním úhlům a neobvyklým nebo přehnaným výrazům. Čím dál více, demonstrační videa produkovaná virálními deepfaky jsou editované kompilace, které vybírají “nejlehčí” úhly a výrazy pro deepfake.

Skutečností je, že nejvhodnější cílové video pro vložení deepfaked celebrity je takové, kde původní osoba (jejíž identita bude vymazána deepfaky) se dívá přímo do kamery, s minimálním rozsahem výrazů.

Většina populárních deepfakes posledních let ukázala subjekty přímo tváří v tvář kameře, a buď pouze s populárními výrazy (jako úsměv), které lze snadno extrahovat z výstupu paparazzi, nebo (jako u falešného Sylvester Stallone jako Terminátor, zobrazeného vlevo), ideálně bez výrazu vůbec, protože neutrální výrazy jsou extrémně běžné, což usnadňuje jejich začlenění do deepfake modelů.

Protože deepfake technologie, jako je DeepFaceLab a FaceSwap, tyto jednoduché záměny provádějí velmi dobře, jsme dostatečně oklamaní tím, co dokážou, a ani si nevšimneme, co nejsou schopni udělat, a – často – se ani nepokoušejí:

Snímky z uznávaného deepfake videa, kde je Arnold Schwarzenegger transformován na Sylvester Stallone – pokud úhly nejsou příliš trikové. Profily zůstávají trvalým problémem současných deepfake přístupů, částečně protože otevřený software používaný pro definici faciálních póz v deepfake rámcích není optimalizován pro boční pohledy, ale hlavně kvůli nedostatku vhodného zdrojového materiálu v jednom nebo obou nezbytných dataselech. Zdroj: https://www.youtube.com/watch?v=AQvCmQFScMA

Nový výzkum z Izraele navrhuje novou metodu použití syntetických dat, jako jsou CGI hlavy, aby přinesl deepfaking do roku 2020, tím, že skutečně oddělí identitu od kontextu.

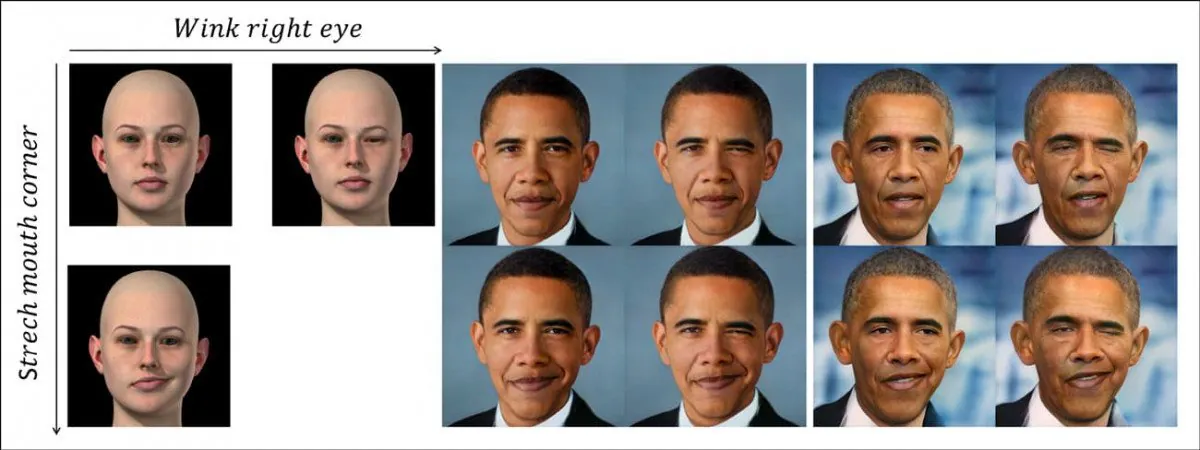

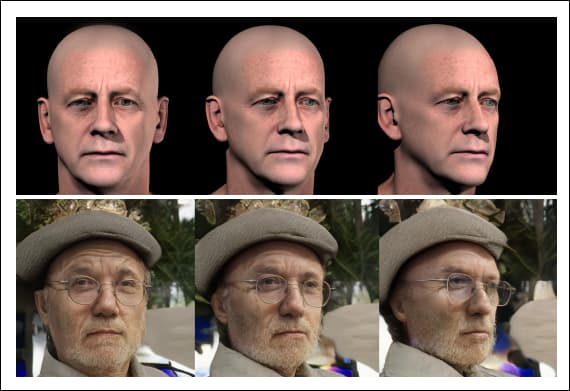

Nový systém odděluje diskrétně pózu a kontext (tj. mrknutí okem) od kódování identity jednotlivce, pomocí nesouvisejících syntetických dat obličeje (zobrazených vlevo). V horní řadě vidíme “mrknutí” přenesené na identitu Baracka Obamy, vyvolané naučenou nelineární cestou latentního prostoru GAN, reprezentovaného CGI obrazem vlevo. V řadě níže vidíme přenesenou rohovou část úst na bývalého prezidenta. V pravém dolním rohu vidíme obě charakteristiky aplikované současně.

Tento přístup není pouhým deepfake head-puppetry, technikou vhodnější pro avatary a částečné lip-synching, a která má omezený potenciál pro plnohodnotné deepfake video transformace.

Místo toho představuje cestu vpřed pro fundamentální oddělení instrumentality (jako “změna úhlu hlavy”) od identity, nabízející cestu k high-level, spíše než “derivative” image synthesis-based deepfake framework.

Nová práce je nazvána Delta-GAN-Encoder: Encoding Semantic Changes for Explicit Image Editing, using Few Synthetic Samples, a pochází od výzkumníků z Technion – Izraelského technologického institutu.

Abychom pochopili, co tato práce znamená, podívejme se, jak jsou deepfakes目前 vytvářeny všude od deepfake porn stránek po Industrial Light and Magic (protože otevřený zdroj repozitáře DeepFaceLab je目前 dominantní v obou “amatérském” a profesionálním deepfaking).

Co brání současné deepfake technologii?

Deepfakes jsou目前 vytvářeny pomocí školení encoder/decoder strojového učení modelu na dvou složkách obličejových obrazů – osobu, kterou chcete “překreslit” (v předchozím příkladu, to je Arnie) a osobu, kterou chcete vložit do videa (Sly).

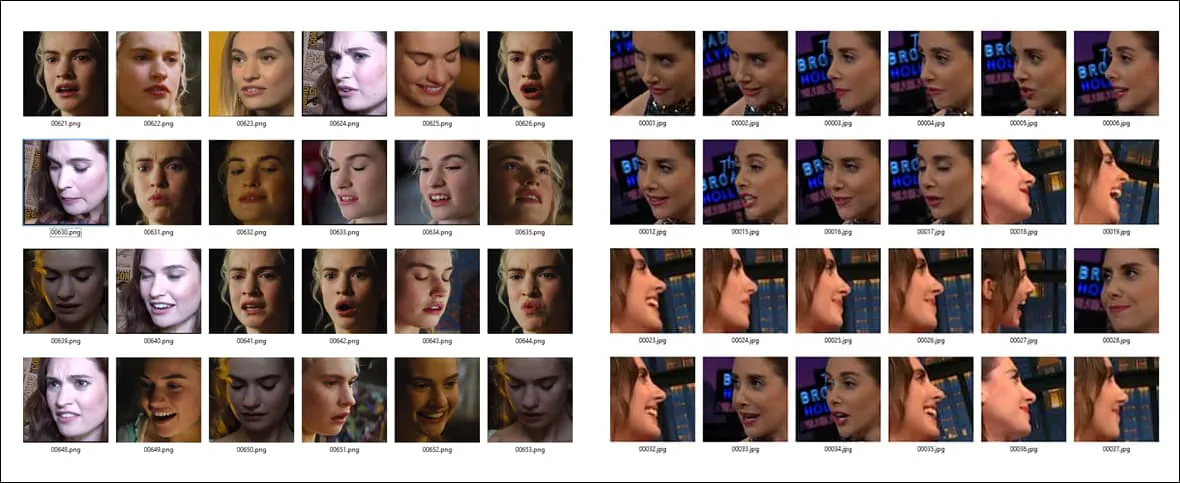

Příklad různých póz a osvětlovacích podmínek napříč dvěma různými face-sets. Poznámka: charakteristický výraz na konci třetí řady ve sloupci A je nepravděpodobné, že by měl blízký ekvivalent v jiném datasetu.

Encoder/decoder systém poté porovnává každý jednotlivý obraz v každé složce s každým jiným, udržení, zlepšení a opakování této operace pro stovky tisíc iterací (často po dobu až týdne), dokud nepochopí základní charakteristiky obou identit dostatečně dobře, aby je mohl vyměnit podle potřeby.

Pro každou z dvou osob, které jsou vyměňovány v procesu, co deepfake architektura naučí o identitě, je spjato s kontextem. Nemůže se naučit a aplikovat principy o generické póze “pro dobré a všechny”, ale potřebuje hojné příklady v trénovacím datasetu, pro každou identitu, která se bude účastnit face-swapping.

Proč je data vzácná

Pokud jste nebyli často zatčeni, pravděpodobně nemáte mnoho bočních profilových snímků sami. Jakékoli, které jste měli, jste pravděpodobně vyhodili. Protože agentury pro fotografie dělají totéž, profilové obličejové snímky jsou těžké najít.

Deepfakers často zahrnují více kopií omezených bočních profilových dat, která mají pro identitu v face-setu, jen aby tato póza dostala alespoň trochu pozornosti a času během trénování, místo aby byla diskontována jako outlier.

Syntetická substituce

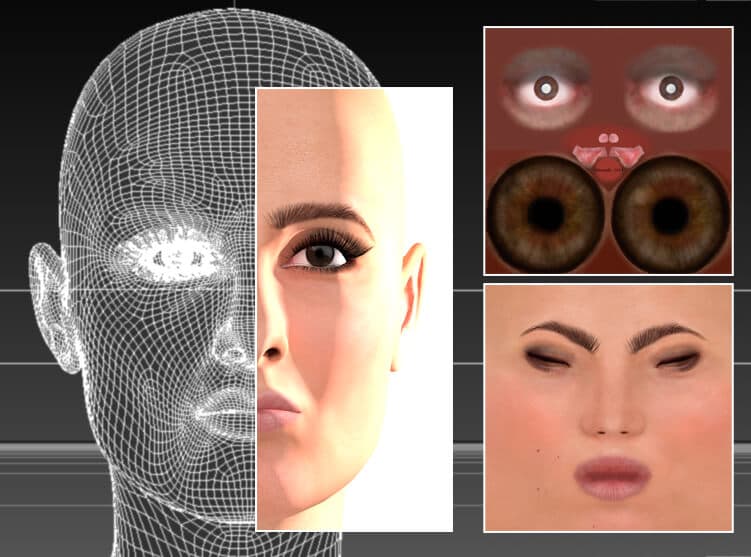

Od počátku deepfakes experimentovali deepfakers s použitím CGI-stylu obrazů, hlav vytvořených v 3D aplikacích, jako je Cinema4D a Maya, aby vygenerovali “chybějící pózy”.

Žádný AI není nutný; herečka je rekreována v tradičním CGI programu, Cinema 4D, pomocí mřížek a bitmapových textur – technologie, která sahá až do 60. let, i když se stala široce používanou až od 90. let. V teorii by tento face model mohl být použit k vygenerování deepfake zdrojových dat pro neobvyklé pózy, osvětlovací styly a faciální výrazy. Ve skutečnosti byl omezený nebo žádný pro deepfaking, protože “falešnost” syntetických renderů se často prosakuje do vyměněných videí.

CGI obličeje jako odpojené, konceptuální směrnice

Místo toho je nová metoda Delta-GAN Encoder (DGE) účinnější, protože póza a kontextuální informace z CGI obrazů byly kompletně odděleny od “identity” informací cíle.

Tento princip lze vidět v akci na obrázku níže, kde byly získány různé hlavy orientace pomocí CGI obrazů jako směrnice. Od identity funkcí nejsou související s kontextuálními funkcemi, není žádný únik ani falešného vzhledu syntetických CGI obličejů, ani identity zobrazené v nich:

S novou metodou nemusíte najít tři samostatné reálné zdrojové obrázky, aby jste provedli deepfake z více úhlů – můžete prostě otočit CGI hlavu, jejíž abstraktní funkce jsou uloženy na identitu bez úniku jakýchkoli informací o identitě.

Delta-GAN-Encoder. Horní levá skupina: úhel zdrojového obrazu lze změnit za sekundu, aby se vykreslil nový zdrojový obraz, který se odráží ve výstupu; horní pravá skupina: osvětlení je také odděleno od identity, což umožňuje superpozici osvětlovacích stylů; spodní levá skupina: několik faciálních detailů je změněno, aby se vytvořil ‘smutný’ výraz; spodní pravá skupina: jeden jediný faciální výraz detail je změněn, aby se oči zúžily.

Toto oddělení identity a kontextu je dosaženo ve fázi trénování. Roura pro novou deepfake architekturu hledá latentní vektor v předem trénovaném Generative Adversarial Network (GAN), který odpovídá obrazu, který má být transformován – Sim2Real metodologie, která navazuje na projekt z roku 2018 z IBM’s AI research sekce.

Výzkumníci pozorují:

‘S pouhými několika vzorky, které se liší konkrétním atributem, lze naučit disentangled chování předem trénovaného entangled generativního modelu. Není potřeba přesných reálných vzorků, aby se dosáhlo tohoto cíle, který není nutně proveditelný. ‘

‘Používáním nereálných datových vzorků lze dosáhnout stejného cíle díky využití sémantiky zakódovaných latentních vektorů. Aplikace požadovaných změn na stávající datové vzorky lze provést bez explicitního prozkoumání chování latentního prostoru.’

Výzkumníci předpokládají, že základní principy disentanglementu prozkoumané v projektu by mohly být přeneseny do jiných domén, jako jsou simulace interiérového designu, a že Sim2Real metoda přijatá pro Delta-GAN-Encoder by mohla nakonec umožnit deepfake instrumentality založené na pouhých náčrtcích, spíše než CGI-stylu vstupu.

Může se argumentovat, že rozsah, v jakém by nový izraelský systém mohl nebo nemohl syntetizovat deepfake videa, je daleko méně významný než pokrok, kterého výzkum dosáhl v disentanglementu kontextu od identity, a tím získání větší kontroly nad latentním prostorem GAN.

Disentanglement je aktivní oblast výzkumu v image syntéze; v lednu 2021 demonstrovala Amazon-vedená výzkumná práce podobnou kontrolu pózy a disentanglement, a v roce 2018 práce ze Shenzhen Institutes of Advanced Technology na Chinese Academy of Sciences učinila pokrok v generování libovolných pohledů v GAN.