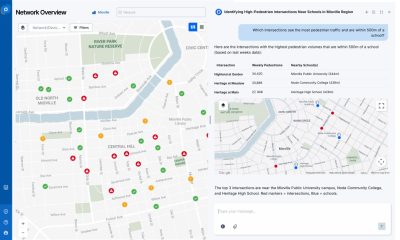

Umělá inteligence

DeepSeek-V3 Odhalen: Jak Hardware-Aware AI Design Sníží Náklady a Zvýší Výkon

DeepSeek-V3 představuje průlom v oblasti nákladově efektivní vývoj AI. Ukazuje, jak inteligentní hardwarově-softwarový ko-design může dodat špičkový výkon bez nadměrných nákladů. Díky tréninku na pouhých 2 048 NVIDIA H800 GPU đạtne tento model pozoruhodné výsledky díky inovativním přístupům, jako je Multi-head Latent Attention pro efektivitu paměti, Mixture of Experts architektura pro optimalizovanou výpočetní výkon a FP8 mixed-precision trénink, který odemyká hardwarový potenciál. Model ukazuje, že menší týmy mohou soutěžit s velkými technologickými společnostmi díky inteligentnímu designu, spíše než brutálnímu škálování.

Výzva Škálování AI

Průmysl AI čelí základnímu problému. Velké jazykové modely se stávají většími a výkonnějšími, ale také vyžadují enormní výpočetní zdroje, které většina organizací nemůže dovolit. Velké technologické společnosti, jako Google, Meta a OpenAI, nasazují tréninkové klastry se stovkami tisíc GPU, což dělá obtížné pro menší výzkumné týmy a startupy soutěžit.

Tento rozdílný přístup ohrožuje koncentraci vývoje AI do rukou několika velkých technologických společností. Škálovací zákony, které pohánějí pokrok AI, naznačují, že větší modely s více tréninkovými daty a výpočetním výkonem vedou k lepšímu výkonu. Nicméně, exponenciální růst hardwarových požadavků činí stále obtížnějším pro menší hráče soutěžit v AI závodě.

Požadavky na paměť se staly další významnou výzvou. Velké jazykové modely vyžadují významné paměťové zdroje, přičemž poptávka roste o více než 1000 % ročně. Zatímco kapacita vysokorychlostní paměti roste pomalejším tempem, obvykle méně než 50 % ročně. Tento nesoulad vytváří to, co výzkumníci nazývají “AI memory wall“, kde paměť se stává omezujícím faktorem spíše než výpočetní výkon.

Situace se stává ještě složitější během inferencing, kdy modely slouží skutečným uživatelům. Moderní AI aplikace často zahrnují multi-obratové konverzace a dlouhé kontexty, vyžadující výkonné cache mechanismy, které spotřebují podstatné množství paměti. Tradiční přístupy mohou rychle přetížit dostupné zdroje a učinit efektivní inferencing významnou technickou a ekonomickou výzvou.

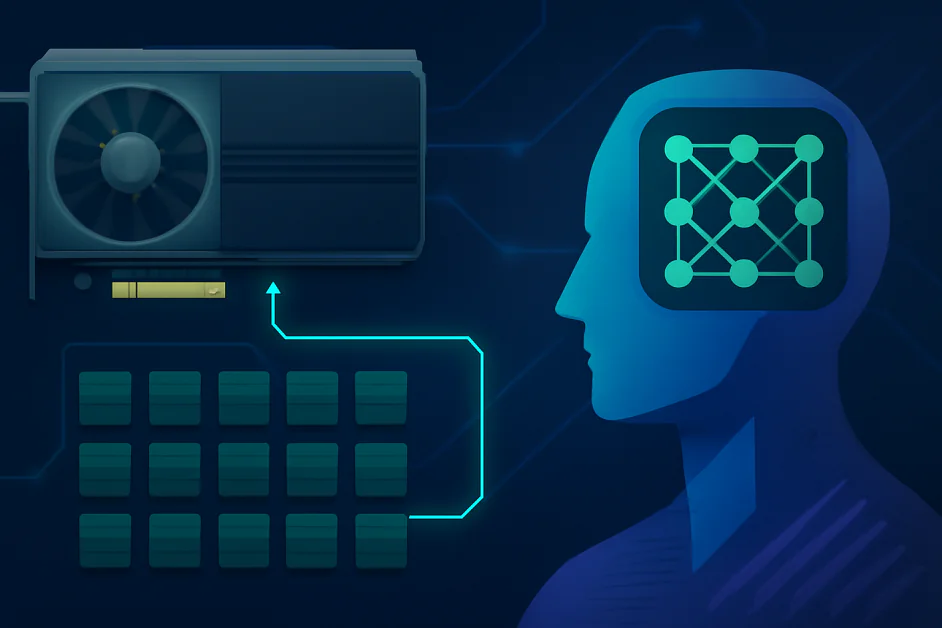

Hardware-Aware Přístup DeepSeek-V3

DeepSeek-V3 je navržen s hardwarovou optimalizací na mysli. Místo použití více hardwaru pro škálování velkých modelů, DeepSeek se zaměřil na vytváření hardwarově-aware modelových designů, které optimalizují efektivitu v rámci stávajících omezení. Tento přístup umožňuje DeepSeek dosáhnout špičkového výkonu pomocí pouhých 2 048 NVIDIA H800 GPU, což je zlomek toho, co konkurenti obvykle vyžadují.

Klíčovým poznatkem za DeepSeek-V3 je, že AI modely by měly považovat hardwarové schopnosti za klíčový parametr v optimalizačním procesu. Místo navrhování modelů v izolaci a následného zjišťování, jak je efektivně spustit, DeepSeek se zaměřil na budování AI modelu, který zahrnuje hluboké pochopení hardwaru, na kterém funguje. Tento ko-design strategie znamená, že model a hardwarová spolupráce fungují efektivně, spíše než považovat hardwaru za pevné omezení.

Projekt vychází z klíčových poznatků předchozích modelů DeepSeek, zejména DeepSeek-V2, který představil úspěšné inovace, jako DeepSeek-MoE a Multi-head Latent Attention. Nicméně, DeepSeek-V3 rozšiřuje tyto poznatky integrací FP8 mixed-precision tréninku a vývojem nových síťových topologií, které snižují infrastrukturní náklady bez ohrožení výkonu.

Tento hardwarově-aware přístup se aplikuje nejen na model, ale také na celou tréninkovou infrastrukturu. Tým vyvinul Multi-Plane two-layer Fat-Tree síť pro nahrazení tradičních třívrstvých topologií, což významně snižuje náklady na clusterovou síť. Tyto infrastrukturní inovace demonstrují, jak pečlivý design může dosáhnout významných úspor nákladů napříč celou AI vývojovou pipeline.

Klíčové Inovace Pohánějící Efektivitu

DeepSeek-V3 přináší několik vylepšení, která výrazně zvyšují efektivitu. Jednou z klíčových inovací je mechanismus Multi-head Latent Attention (MLA), který řeší vysokou spotřebu paměti během inferencing. Tradiční pozornostní mechanismy vyžadují caching Klíčových a Hodnotových vektorů pro všechny pozornostní hlavy. To spotřebuje enormní množství paměti, jakmile konverzace rostou déle.

MLA řeší tento problém komprimací Klíčových-Hodnotových reprezentací všech pozornostních hlav do menšího latentního vektoru pomocí projekční matice, která se trénuje s modelem. Během inferencing je třeba pouze tuto komprimovanou latentní vektor ukládat do cache, což významně snižuje požadavky na paměť. DeepSeek-V3 vyžaduje pouze 70 KB na token ve srovnání s 516 KB pro LLaMA-3.1 405B a 327 KB pro Qwen-2.5 72B1.

Mixture of Experts architektura poskytuje další zásadní efektivitní zisk. Místo aktivace celého modelu pro každou výpočetní operaci, MoE selektivně aktivuje pouze nejrelevantnější expertní sítě pro každý vstup. Tento přístup udržuje modelovou kapacitu, zatímco významně snižuje skutečnou výpočetní operaci pro každý forward pass.

FP8 mixed-precision trénink dále zlepšuje efektivitu přepínáním z 16-bitové na 8-bitovou přesnost plovoucího bodu. To snižuje spotřebu paměti o polovinu, zatímco udržuje kvalitu tréninku. Tato inovace přímo řeší AI memory wall, dělaje efektivnější využití dostupných hardwarových zdrojů.

Multi-Token Prediction Modul přidává další vrstvu efektivnosti během inferencing. Místo generování jednoho tokenу za čas, tento systém může předpovídat několik budoucích tokenů současně, což významně zvyšuje rychlost generování prostřednictvím spekulativního dekódování. Tento přístup snižuje celkovou dobu potřebnou pro generování odpovědí, zlepšuje uživatelský zážitek, zatímco snižuje výpočetní náklady.

Klíčové Lekce Pro Průmysl

Úspěch DeepSeek-V3 poskytuje několik klíčových lekcí pro širší AI průmysl. Ukazuje, že inovace v efektivitě je stejně důležitá jako škálování modelové velikosti. Projekt také zdůrazňuje, jak pečlivý hardwarově-softwarový ko-design může překonat zdrojová omezení, která by jinak omezila AI vývoj.

Tento hardwarově-aware designový přístup by mohl změnit, jak je AI vyvíjen. Místo toho, aby se hardwaru považovalo za omezení, organizace by mohly považovat hardwaru za klíčový designový faktor, který formuje modelovou architekturu od začátku. Tento posun v myšlení může vést k více efektivním a nákladově efektivním AI systémům napříč průmyslem.

Efektivita technik, jako MLA a FP8 mixed-precision trénink, naznačuje, že existuje stále významný prostor pro zlepšení efektivnosti. Jakmile hardwar pokračuje v pokroku, nové příležitosti pro optimalizaci se objeví. Organizace, které využijí těchto inovací, budou lépe připraveny soutěžit ve světě s rostoucími zdrojovými omezeními.

Inovace v síťovém designu DeepSeek-V3 také zdůrazňují důležitost infrastrukturního designu. Zatímco se většina pozornosti soustředí na modelové architektury a tréninkové metody, infrastruktura hraje kritickou roli v celkové efektivitě a nákladů. Organizace, které budují AI systémy, by měly priorizovat infrastrukturní optimalizaci vedle modelových vylepšení.

Projekt také demonstruje hodnotu otevřeného výzkumu a spolupráce. Sdílením svých poznatků a technik, tým DeepSeek přispívá k širšímu pokroku AI, zatímco také zajišťuje svou pozici jako lídři v oblasti efektivní AI vývoj.

Bottom Line

DeepSeek-V3 je důležitým krokem vpřed v oblasti umělé inteligence. Ukazuje, že pečlivý design může dodat výkon srovnatelný, nebo lepší, než škálování modelů. Používáním nápadů, jako je Multi-Head Latent Attention, Mixture-of-Experts vrstvy a FP8 mixed-precision trénink, model dosahuje špičkového výkonu, zatímco významně snižuje hardwarové požadavky. Tento zaměřený přístup na hardwarovou efektivitu dává menším laboratořím a společnostem nové šance na budování pokročilých systémů bez enormních rozpočtů. Jakmile AI pokračuje v pokroku, přístupy, jako ty v DeepSeek-V3, se stanou stále důležitějšími pro zajištění udržitelného a dostupného pokroku. DeepSeek-3 také učí širší lekci. S inteligentními architektonickými volbami a těsnou optimalizací, můžeme budovat výkonnou AI bez potřeby enormních zdrojů a nákladů. Tímto způsobem, DeepSeek-V3 nabízí celé průmyslu praktickou cestu k nákladově efektivní, více dostupné AI, která pomáhá mnoha organizacím a uživatelům po celém světě.