Andersonův úhel

Přinášející smysl pro vůni do vývoje AI

Nová sada AI dat učí stroje čichat asociací dat vůně s obrázky, umožňující modelům párovat pachy s objekty, scénami a materiály.

Možná proto, že stroje s výstupem vůně mají takovou pohnutou historii, je čich poměrně zanedbávaným smyslem ve výzkumu AI. Pokud jste neplánovali vytvořit další vstup do dlouho běžící (více než století, do dneška) smell-o-vision ságy, použití případů se vždy zdálo bastante “nišovým” ve srovnání s potenciálním využitím obrazových, audio a video dat a AI modelů, které z nich jsou trénovány.

Skutečně, možnost automatizace, industrializace a popularizace detekčních zařízení nabízených bombovými psy, cadaver psy, illness sniffer psy a různých dalších typů psích čichacích jednotek, by byla pozoruhodným přínosem v městských a bezpečnostních službách. Navzdory vysoké poptávce, daleko nad nabídkou, trénování a údržba detekčních psů je drahý podnik, který nedělá vždy dobrou hodnotu za peníze.

Do dneška, většina výzkumu, který zasahuje do této oblasti studia, byla omezena na laboratoř, s kuriózními sbírkami typicky složených z příkladů s ručně vyrobenými funkcemi – profil nakloněný více k bespoké kabinovým řešením než industrializovaným aplikacím.

Vpředu nosem

Do této rather fusty klimatu přichází zajímavá nová akademická/průmyslová spolupráce z USA, kde tým výzkumníků strávil několik měsíců katalogizací různých pachů v vnitřních a vnějších prostředích v New York City – a poprvé, shromažďováním obrazů spojených s zachycenými pachy:

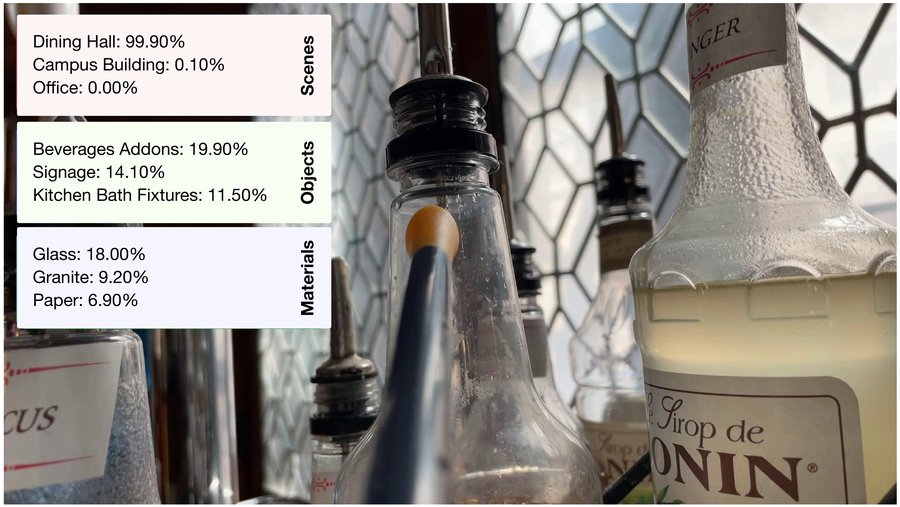

Note the central sensor, the ‘nose’ of the olfactory device. Trained only on smell, the model guesses whether it’s sniffing granite, plastic, or leather – and even identifies the room it’s in, without seeing a single pixel. Source

Tento výzkum vedl autory nové práce k vytvoření spinu na obrovsky populární Contrastive Language-Image Pretraining (CLIP) framework, který spojuje text a obrázky, ve formě Contrastive Olfaction-Image Pretraining (COIP) – který spojuje pachy a obrázky.

Top: synchronized video and olfactory sensor data are captured in natural settings using a camera-e-nose rig. Bottom left (b): a joint embedding is learned through cross-modal self-supervision. (c): the system retrieves visual matches based solely on a query smell. (d): individual smell samples are used to classify environment, object, and material categories. (e): highly similar odors, such as two types of grass, are distinguished without visual input. Source

Nová sada dat, nazvaná New York Smells, obsahuje 7 000 párů pach-obraz, představujících 3 500 různých objektů. Když byli trénováni v testech, nová data byla nalezena, aby překonala populární ručně vyrobené funkce v relativně malém počtu podobných předchozích sad dat.

Autoři doufají, že jejich počáteční výlet otevře cestu pro pozdější a následné práce směrem k olfaktorickým detekčním systémům navrženým pro provoz v divočině, podobně jako to dělají čichací psi*:

‘Vidíme tuto sadu dat jako krok směrem k v-divočině, multimodálnímu olfaktorickému vnímání, jakož i krok směrem k propojení zraku se smyslem.

‘Například, jako lidé, neustále používáme náš smysl pro vůni, abychom zhodnotili kvalitu potravin, identifikovali nebezpečí a detekovali neviditelné objekty.

‘Navíc, mnoho zvířat, jako psi, medvědi a myši, ukazuje nadlidské olfaktorické schopnosti, naznačující, že lidské vnímání vůně je daleko od limitu strojních schopností.’

Ačkoli nový papír, nazvaný New York Smells: A Large Multimodal Dataset for Olfaction, slibuje, že data a kód budou uvolněny, 27GB soubor dat je již k dispozici prostřednictvím projektového webu. Papír byl produkován devíti výzkumníky napříč Columbijskou univerzitou, Cornellovou univerzitou a Osmo Labs.

Metoda

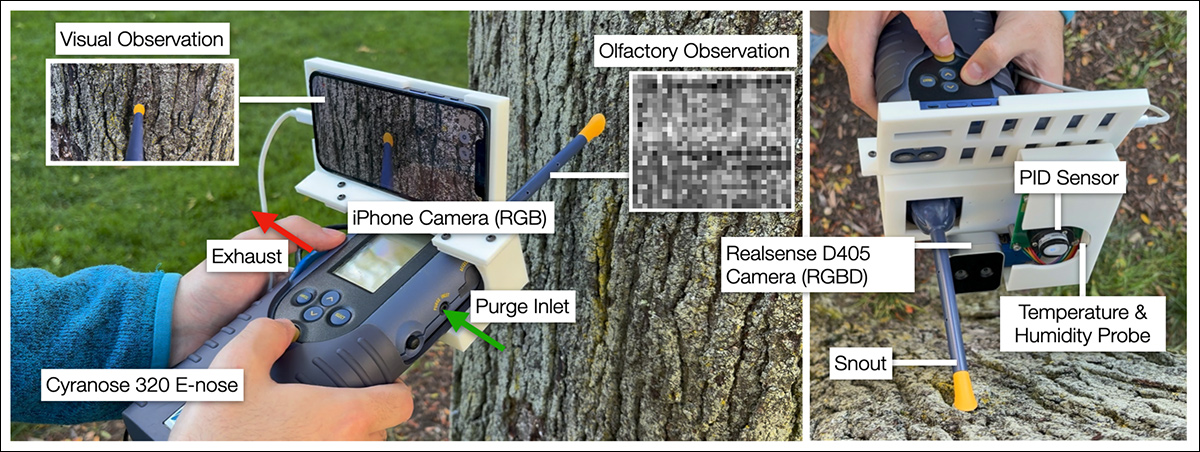

Pro sběr materiálu pro novou sbírku, výzkumníci používali Cyranose 320 elektronický nos, s iPhone namontovaným nad předním vstupem pro zachycení vizuálně, co pachy byly registrovány:

A handheld sensor rig collects paired video and smell data by mounting an iPhone camera onto a Cyranose 320 e-nose. The snout is aimed at objects while the exhaust and purge inlet manage airflow during sampling. An RGB‑D camera captures depth, while Volatile organic compound (VOC) concentration, temperature, and humidity are recorded through integrated sensors including a Proportional-integral-derivative (PID) module and environmental probe.

Zařízení Cyranose běží na 2Hz, zaznamenává 32-rozměrové olfaktorické časové kroky. Koncentrace VOC byly zaznamenány pomocí MiniPID2 PPM WR senzoru.

Portable jednotka fungovala jako hbitý senzor, přenášející data do více výpočetně schopného mobilního stanice pro zpracování.

Pro umístění cílového pachu do kontextu, byl registrován “základní pach”, předtím, než byl více specifický objekt zaměřen přímo s “chobotem” Cyranose. Vzorek okolního prostředí byl poté odebrán ze strany vstupu v zařízení, aby se zajistilo, že je dostatečně vzdálen od hlavního zdroje pachu, aby nebyl kontaminován.

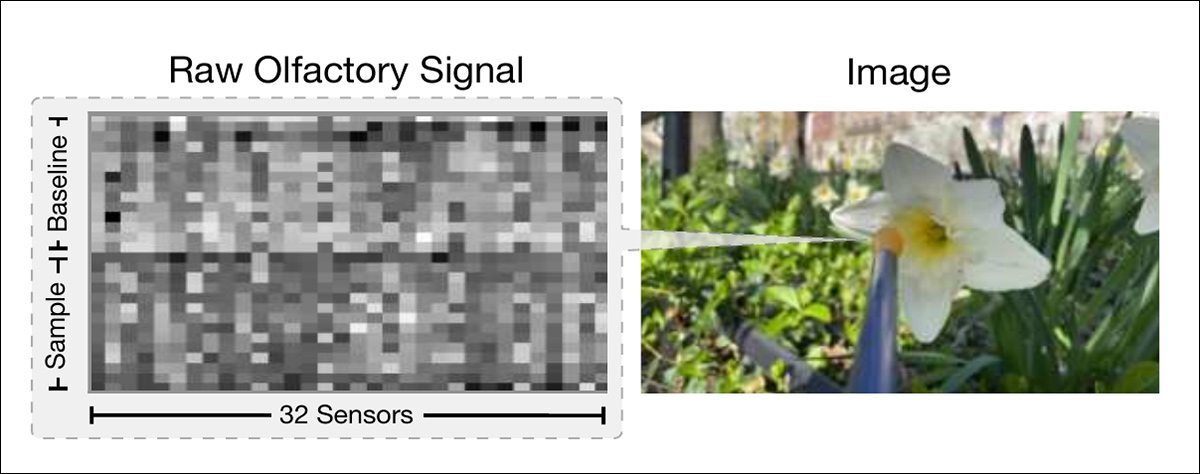

Dva vzorky byly odebrány přes hlavní vstup senzoru, s každým deseti-vteřinovým záznamem zachyceným z různých pozic kolem objektu, aby se zlepšila efektivita dat. Vzorky byly poté kombinovány s okolním základem, aby vytvořily 28×32 matici, reprezentující plné olfaktorické měření:

This example shows the signal and corresponding image for a flower. The full olfactory signal consists of a 28×32 matrix, combining a 14-frame ambient baseline with two 10-second samples taken from different angles around the target object.

Data a testy

Modely jazyka a vize (VLMs) byly použity pro automatické označení objektů a materiálů zachycených iPhonem v Cyranose rigu, s GPT-4o použitým pro úkol; nicméně, kategorie scén byly ručně označeny:

A small sample from an extensive illustration in the source paper detailing the varied smell sources and environments captured in the project.

Sada dat byla rozdělena do trénovacích a validačních splitů, s oběma vzorky z každého objektu přiřazeny ke stejnému splitu, aby se zabránilo zkřížené kontaminaci. Konečná sbírka se skládá z 7 000 olfaktoricko-vizních párů odvozených z 3 500 nelabelovaných objektů, spolu s 70 hodinami videa a 196 000 časovými kroky surových olfaktorických dat z obou fází základny a vzorku.

Data byla shromážděna napříč 60 relacemi po dobu dvou měsíců, pokrývající parky, univerzitní budovy, kanceláře, ulice, knihovny, byty a jídelny, s několika relacemi provedenými v každém umístění. Výsledná sada dat obsahuje 41% venkovních a 59% vnitřních prostředí.

Pro vývoj obecných olfaktorických reprezentací, autoři trénovali kontrastní model pro asociaci synchronizovaných obraz-smell párů ze sady dat. Tento přístup, výše zmíněný COIP, používá funkci ztráty adaptovanou z CLIP pro zarovnání zarovnání ko-occurring vizuálních a olfaktorických signálů.

Trénování používalo jak vizuální encoder, tak i smell encoder, s cílem naučit model přinést odpovídající pachy a obrázky blíže dohromady v sdíleném reprezentačním prostoru. Výsledné reprezentace podporují řadu downstream úkolů, včetně smell-to-image retrieval, scény a objektu rozpoznání, materiál klasifikace a jemné rozlišení pachů.

Model byl trénován pomocí dvou typů olfaktorických vstupů: plného surového senzorového signálu a zredukovaného ručně vyrobeného souhrnu známého jako smellprints – široce používané funkce v olfaktorickém výzkumu, které komprimují každou odpověď senzoru do jediného čísla porovnáním špičkové rezistence během vzorkování s průměrnou rezistencí během základního vzorku.

Na rozdíl od toho, surový vstup zaznamenaný po celém NYC se skládá z časové řady z 32 chemických senzorů uvnitř zařízení Cyranose, zachycující, jak každá změna senzoru elektrické rezistence změnila se časem, jak reagovala na pach.

Pro kultivaci sady dat, tento nezpracovaný signál byl krmen přímo do neuronové sítě, umožňující koncový koncový öğrenící proces s buď konvoluční nebo transformer-based backbone. Modely byly trénovány pomocí obou smellprints a surového vstupu shromážděného z různých prostředí v New York City, s oběma typy vstupů vyhodnocenými pomocí kontrastního učení.

Příčný modální výběr

Příčný modální výběr byl vyhodnocen vložením každého pachu vzorku a jeho spárovaného obrazu do sdíleného reprezentačního prostoru a testováním, zda lze správný obraz získat pouze na základě olfaktorického vstupu.

Řazení bylo určeno blízkostí každého obrazového zarovnání k dotazu pachu v tomto prostoru a výkon byl měřen pomocí průměrného ranku, mediánu ranku a recall na více prahových hodnotách:

Cross‑modal retrieval accuracy for different smell encoders, showing how well each model identifies the correct image from a smell query. The results compare architectures trained on raw olfactory signals with those using smellprints.

Ohledně těchto výsledků, autoři uvádějí:

‘Kontrastní předtrénování pomocí smellprint funguje lépe než náhoda ve všech metrikách. Nicméně, trénování olfaktorického encoderu na surovém olfaktorickém signálu vede k významnému zlepšení ve srovnání se smellprint encoderem, nezávisle na architektuře.

‘To ukazuje bohatější informace přítomné v surových olfaktorických datech, odemykající silnější příčný modální asociace mezi zrakem a čichem.’

Scény, objekty a materiály rozpoznání

Schopnost modelu rozpoznat pachy bez vizuálního vstupu byla vyhodnocena trénováním modelu pro identifikaci scén, objektů a materiálů pouze na základě olfaktorických dat; k tomuto účelu byl použit lineární sondu (jednoduchý klasifikátor trénovaný na zmrazených reprezentacích).

Štítky byly odvozeny z párovaných obrazů v trénovací sadě pomocí GPT-4o – ale pouze olfaktorický signál byl použit během klasifikace.

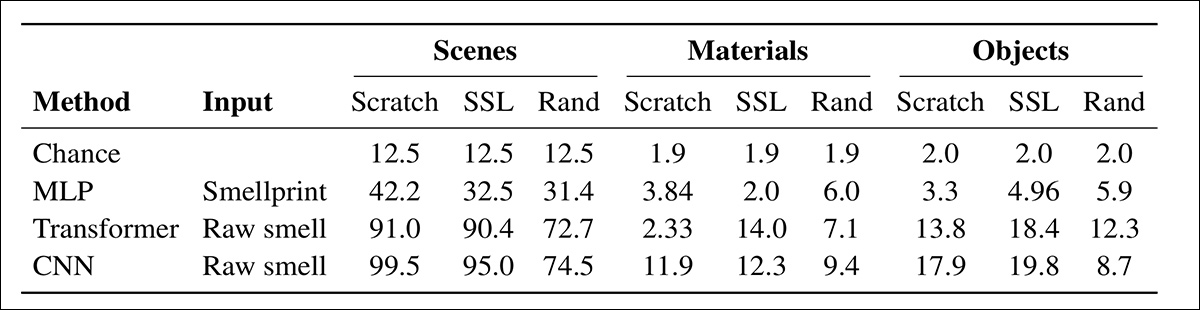

Několik typů encoderů bylo testováno: některé inicializovány náhodně, některé trénovány od začátku a jiné trénovány pomocí kontrastního učení pro zarovnání pachu a vize v sdíleném reprezentačním prostoru, s surovými daty a smellprints vyhodnocenými:

Classification accuracy for scenes, materials, and objects was assessed using olfactory signals alone. Raw sensor input outperformed smellprints, with CNNs trained from scratch yielding the highest results, including 99.5% for scenes. SSL pretraining helped in some cases, but was generally surpassed by supervised training. Random-weight baselines indicate that model capacity alone proves insufficient.

Značně vyšší přesnost byla získána, když byly použity surové olfaktorické data, zejména v modelech trénovaných s cross-modální supervizí. Autoři komentují**:

‘Modely trénované na surových senzorických vstupech také dosahují vyšší přesnosti než modely trénované s ručně vyrobenými smellprint funkcemi. Tyto výsledky ukazují, že hluboké učení ze surových olfaktorických signálů je významně lepší než ručně vyrobené funkce.’

Jemné rozlišení

Pro vyhodnocení, zda lze naučit jemné rozlišení pachů, byla postavena benchmark z dvou druhů trávy, které koexistují na stejné univerzitní louce. Střídavě byly odebrány vzorky po dobu šesti 30-minutových relací, což vedlo k 256 příkladům. Lineární klasifikátor byl trénován na funkcích z olfaktoricko-vizního kontrastního učení, a vyhodnocen na držené sadě 42 vzorků:

Accuracy of grass species classification from smell alone. Models were evaluated on their ability to distinguish between two visually similar grass types using only olfactory input. Performance was compared across smellprints and raw sensor data, with models either randomly initialized, trained from scratch, or trained using self-supervised learning (SSL) followed by a linear probe. The highest accuracy, 92.9%, was achieved using raw olfactory signals with SSL, indicating that fine-grained odor differences are best captured through raw input and vision-guided training.

Zde výzkumníci uvádějí:

‘Trénování na surovém olfaktorickém senzorovém signálu (místo ručně vyrobených funkcí) vede k nejvyšší přesnosti – překonávající všechny varianty založené na smellprintech.

‘Tyto výsledky naznačují, že olfaktoricko-vizní učení zachovává více jemných informací než učení se smellprinty, a že vizuální supervize poskytuje signál pro využití této informace.’

Závěr

Ačkoli syntéza pachu se zdá být pravděpodobně nevyřešeným problémem nějakou dobu do budoucna, efektivní a dostupný systém pro analýzu pachu v divočině má enormní potenciál, nejen pro policejní, bezpečnostní a lékařské účely, ale také pro kvalitu života a městské monitorování.

V současné době je zařízení zapojené do tohoto procesu niklové a obvykle poměrně drahé; proto skutečný pokrok v “olfaktorické AI” pro detekci se zdá být pravděpodobný pouze s vizií a dostupným senzorem v duchu Raspberry PI.

* Mé převody autorů inline citací na hypertextové odkazy.

** Pokud chcete další ilustrace (obrázek 8), jsou k dispozici v původním článku, ale jsou nejlepší prohlédnout v tomto kontextu.

Poprvé publikováno v pátek, 28. listopadu 2025