Myslitelé

Osobnost vašeho AI je stejně důležitá jako jeho IQ — a bude rozhodovat o úspěchu nasazení v podniku

Většina společností stále vybírá modely AI na základě benchmarků. V praxi to však zřídka určuje, zda tyto systémy skutečně fungují.

Dosud se většina diskusí o velkých jazycových modelech v podnikovém prostředí točila kolem benchmarků. Týmy se soustředí na měřitelné výkony, jako je to, který model je nejchytřejší, nejsilnější v kódování, nejpreciznější ve zhušťování nebo v matematickém uvažování.

Ale když týmy začínají přecházet z experimentální fáze do skutečného nasazení ve velkém měřítku, další důležité faktory, které jsou nyní většině CEO přehlíženy, se rychle ukážou jako stejně kritické pro úspěch podniku.

Zaměstnatelnost AI

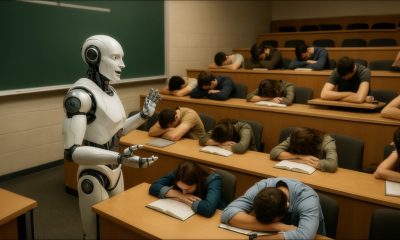

Syrová inteligence a analytická schopnost jsou samozřejmě důležité, ale nejpodceňovanější proměnnou při nasazení AI v podniku je osobnost. Osobnost, v kontextu velkých jazycových modelů, se týká konzistentního tónu, hlasu a chování, které model vyjadřuje napříč interakcemi. Je to to, co dělá AI cítit se koherentně a spolehlivě.

Při implementaci AI by podniky měly postupovat stejně jako při najímání lidského zaměstnance: posuzovat nejen to, jak dobře model zvládne úkol, ale také jeho postoj k práci, jak komunikuje a jak se hodí do většího pracovního procesu.

Schopnost modelu udržet konzistenci, reagovat vhodně a zvládat nuance v různých kontextech může mít významný dopad na obchodní výsledky. Technicky brilantní AI, který reaguje pomalu, mění tón nebo zanedbává nuancí v interakcích, může být podniky špatně aplikován, frustruje uživatele, snižuje zapojení a nakonec snižuje účinnost AI a úspěch podniku.

To je especialmente důležité v odvětvích, jako je zákaznická podpora, politický výstup nebo interní komunikace, protože jemné posuny v tónu nebo formulaci mezi odpověďmi mohou způsobit zmatek, podkopat důvěru a snížit celkové zapojení. Stejně jako u lidí, neexistuje žádný jediný ideální model, který by převyšoval konkurenci ve všech kategoriích. Některé modely jsou lepší v analytických úkolech, jako je kódování nebo matematika, zatímco jiné fungují mnohem lépe v konverzačních psaních a zhušťování schůzek.

Ale výzvou pro týmy, které staví na těchto systémech, je, že tyto charakteristiky nejsou pevné.

Pohyblivý cíl

Krajina AI se vyvíjí rychleji, než si většina organizací může dovolit držet krok. Nové verze jsou vydávány často a charakteristiky výkonu se mohou měnit z jedné aktualizace na druhou. Googleova série modelů Gemini je nedávným příkladem.

Gemini 2.0 Pro byl vydán v únoru 2025 a byl okamžitě označen jako vlajkový model pro vývojáře a podniky, které jej používají pro kódování a komplexní výzvy po celém světě.

Přišel s tím, co bylo v té době největší kontextovou oknem, které Google kdy nabídl, a to dvěma miliony tokenů, což mu dalo schopnost komplexně analyzovat a pochopit obrovské množství informací najednou, zatímco současně mohl využívat nástroje, jako je Google Search, a dokonce psát kód.

Pro týmy, které stavěly systémy, které potřebovaly zpracovat velké objemy dat rychle a přesně, se zdál být jasnou volbou. Ale během několika týdnů Google vydal Gemini 2.5 Pro, který okamžitě překonal leaderboards a předčil svého předchůdce s vylepšeními v kódování, matematice a vědě.

Přespříští den se model, který byl teprve před chvílí nejlepší volbou na trhu, stal zastaralým méně než dva měsíce po spuštění. Ale raní adoptéři okamžitě zaznamenali, že změny nebyly pouze incrementální nebo analytické — celou osobnost Gemini se změnila přes noc. Mnozí vývojáři šli tak daleko, že řekli, že AI se choval, jako by byl “lobotomizován” po své aktualizaci.

Stěžovali si, že AI se zdál být, doslova, “hloupější” — konzistentně produkoval pomalejší odpovědi, méně koherentní výstupy a projevoval nekonzistence v tom, jak zvládal výzvy, se kterými dříve neměl žádné problémy, a úkoly, které dříve plynuly hladce, najednou se staly rigidními.

A tady začíná strategie podniku kolem nasazení AI fundamentálně měnit.

Mimo benchmarky

Na papíru by Gemini 2.5 Pro měl být jasným vítězem se svými rozsáhlými vylepšeními v možnostech a bezpečnosti.

Ale v praxi tyto změny úplně změnily, jak spolehlivý model byl, jak se choval, reagoval na výzvy a, v důsledku toho, poslaly týmy, které právě utratily spoustu peněz a strávily nekonečné hodiny stavbou kolem těchto systémů, zpět na začátek, pokud nové schopnosti modelu nebyly v souladu s jejich stávajícím potrubím.

I malé posuny v chování mohou narušit systémy postavené na konzistenci a předvídatelnosti. To vytváří skutečné provozní riziko, pokud je podnik těsně spojen s jedním modelem, protože jakékoli aktualizace mohou zavést okamžitou nestabilitu do týmů, které se spoléhají na tyto systémy.

Aby se tomu zabránilo, mnoho progresivních společností začalo implementovat multi-modelovou strategii, kde směrují různé úkoly na modely, které jsou pro ně nejlépe vhodné, místo aby se spoléhaly na jeden model, aby zvládl vše.

Tento přístup nejen zlepšuje výkon přizpůsobený každé úkolu, ale také snižuje riziko spojené s implementací AI, protože kdyby se jeden model zhoršil po aktualizaci, nemusel by to způsobit, že by celý systém, který na něm závisí, selhal, protože jsou k dispozici zálohy.

Jednoduše řečeno, osobnost AI a spolehlivost jsou stejně důležité jako jeho syrová inteligence, pokud jde o aplikaci modelu v pracovním prostředí pro dokončení různých úkolů. Tato změna v myšlení představuje fundamentální změnu v tom, jak podniky již nejsou jen kupují “chytřejší nástroj”, ale spíše staví a spravují celou digitální infrastrukturu.

Aby podniky nejen přežily, ale i prosperovaly v dnešním obchodním prostředí, týmy potřebují zřídit potrubí, které může vyměňovat různé modely v závislosti na úkolu, a neustále monitorovat, jak aktualizace ovlivňují jak výkon, tak kvalitu interakce.

Nakonec se modely samy budou nadále vyvíjet tempem, které je obtížné sledovat. Ale podniky, které plánují změnu, budují redundanci a zacházejí s AI jako s nástrojem i partnerem, budou ty, které tyto rychlé změny promění v konkurenční výhodu.