Umělá inteligence

Osobní pohled na trendy literatury počítačového vidění v roce 2024

Po pět let jsem nepřetržitě sledoval výzkum počítačového vidění (CV) a syntézy obrazů na Arxiv a jinde, takže se trendy stávají zřejmými s časem a mění se každý rok novým směrem.

Protože se rok 2024 chýlí ke konci,thought jsem, že je vhodné se podívat na některé nové nebo se vyvíjející charakteristiky v příspěvcích Arxiv v sekci Computer Vision and Pattern Recognition section. Tyto pozorování, ačkoli jsou informovány stovkami hodin studia scény, jsou přísně anekdotické.

Stále rostoucí vliv Východní Asie

Ke konci roku 2023 jsem si všiml, že většina literatury v kategorii “syntéza hlasu” pocházela z Číny a dalších regionů Východní Asie. Ke konci roku 2024 musím pozorovat (anekdoticky), že se to nyní vztahuje také na výzkum syntézy obrazů a videí.

To neznamená, že Čína a sousední země nutně vždy produkují nejlepší práci (skutečně existuje一些 důkaz proti tomu); ani to nezohledňuje vysokou pravděpodobnost v Číně (jako na Západě), že některé z nejzajímavějších a nejvýkonnějších nových systémů jsou proprietární a vyloučeny z výzkumné literatury.

Ale to naznačuje, že Východní Asie poráží Západ co do objemu, v tomto ohledu. To, co to znamená, závisí na tom, do jaké míry věříte v životaschopnost Edisonova stylu vytrvalosti, který obvykle dokazuje neúčinný v tváří nepřekonatelných překážek.

Existují mnoho takových překážek v generativní AI, a není snadné vědět, které z nich lze vyřešit řešením stávajících architektur a které budou muset být přehodnoceny od nuly.

Ačkoli výzkumníci z Východní Asie zdá se, že produkují větší počet prací o počítačovém vidění, jsem si všiml zvýšení frekvence “Frankenstein”-style projektů – iniciativ, které představují spojení předchozích prací, zatímco přidávají omezenou architektonickou novinku (nebo možná jen jiný typ dat).

Tento rok mnohem větší počet východoasijských (především čínských nebo čínských spoluprací) příspěvků zdá se, že jsou kvótami řízeny spíše než meritou, což významně zvyšuje poměr signálu k šumu v již přeplněném poli.

V stejné době, větší počet východoasijských prací také upoutal mou pozornost a obdiv v roce 2024. Takže pokud je to vše hra s čísly, není to selhání – ale ani to není levné.

Zvyšující se objem příspěvků

Objem prací, napříč všemi původními zeměmi, zřejmě vzrostl v roce 2024.

Nejoblíbenější den publikace se mění během roku;目前 je to úterý, kdy je počet příspěvků do sekce Computer Vision and Pattern Recognition často kolem 300-350 v jednom dni, v “vrcholných” obdobích (květen-srpen a říjen-prosinec, tj. konferenční sezóna a “sezóna roční kvóty”, resp.).

Mimo mou vlastní zkušenost, Arxiv sám hlásí rekordní počet příspěvků v říjnu 2024, s 6000 novými příspěvky, a sekce Computer Vision je druhou nejčastěji zasílanou sekcí po Machine Learning.

Nicméně, jelikož sekce Machine Learning na Arxiv je často používána jako “další” nebo agregovaná nadkategorie, to naznačuje, že Computer Vision a Pattern Recognition jsou ve skutečnosti nejčastěji zasílanou kategorií Arxiv.

Vlastní statistiky Arxiv jistě zobrazují počítačovou vědu jako jasnou leader v příspěvcích:

Počítačová věda (CS) dominuje statistice příspěvků na Arxiv za posledních pět let. Source: https://info.arxiv.org/about/reports/submission_category_by_year.html

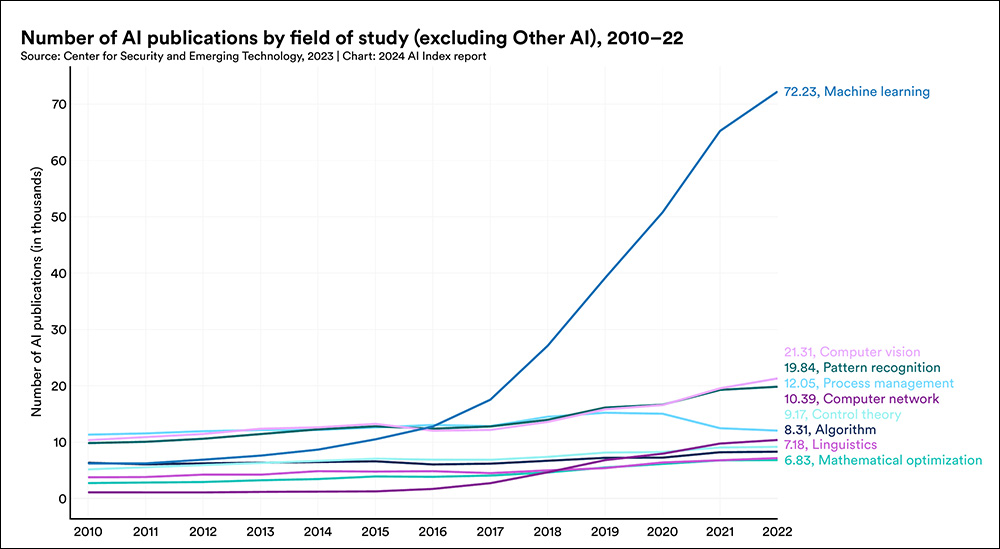

Stanford University’s 2024 AI Index, ačkoli nemůže hlásit nejnovější statistiky, také zdůrazňuje pozoruhodný růst příspěvků akademických prací kolem strojového učení v posledních letech:

S čísly, které nejsou k dispozici pro rok 2024, zpráva Stanfordu nicméně dramaticky ukazuje růst objemu příspěvků pro strojové učení. Source: https://aiindex.stanford.edu/wp-content/uploads/2024/04/HAI_AI-Index-Report-2024_Chapter1.pdf

Diffusion>Mesh Frameworks Proliferate

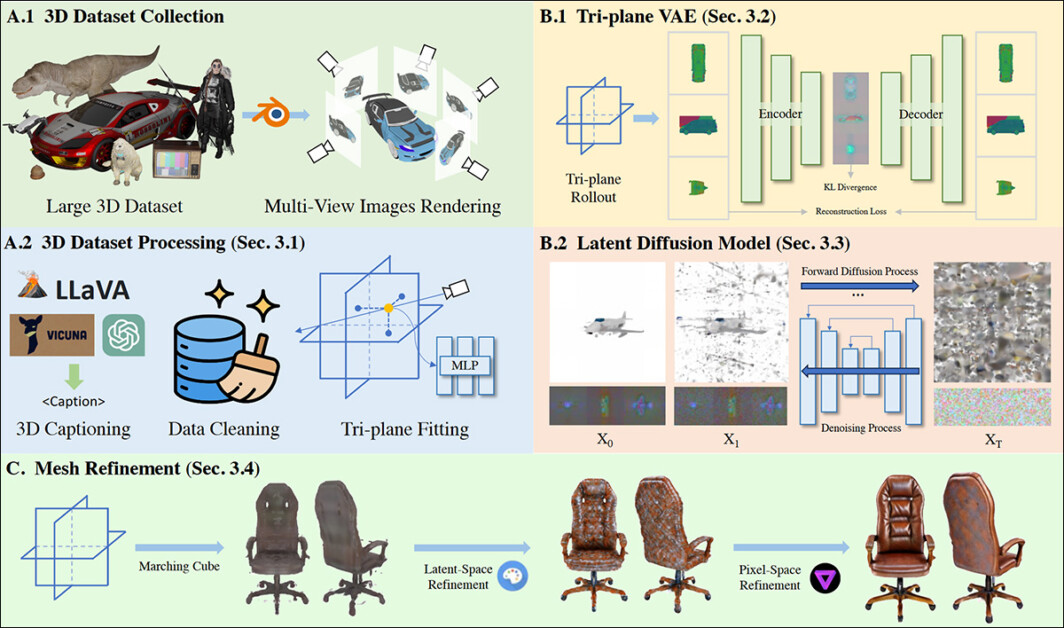

Jiným jasným trendem, který se mi objevil, byl velký nárůst prací, které se zabývají využíváním Latent Diffusion Models (LDMs) jako generátorů mesh-based, ‘tradičních’ CGI modelů.

Projekty tohoto typu zahrnují Tencent’s InstantMesh3D, 3Dtopia, Diffusion2, V3D, MVEdit, a GIMDiffusion, mezi mnoha dalšími.

Generování a rafinace mesh prostřednictvím difuzního procesu v 3Dtopia. Source: https://arxiv.org/pdf/2403.02234

Tento nově se objevující výzkumný směr by mohl být chápán jako implicitní ústup od trvající neřešitelnosti generativních systémů, jako jsou difuzní modely, které před dvěma lety byly považovány za potenciální náhradu za všechny systémy, které nyní difuzní>mesh modely snaží osídlit; relegace difuze do role nástroje v technologiích a pracovních postupech, které sahají třicet nebo více let zpět.

Stability.ai, původci otevřeného zdrojového Stable Diffusion modelu, právě vydali Stable Zero123, který může, mezi jinými věcmi, použít Neural Radiance Fields (NeRF) interpretaci AI-generované obrazovky jako most k vytvoření explicitního, mesh-based CGI modelu, který lze použít v CGI arénách, jako je Unity, ve videohrách, rozšířené realitě a v jiných platformách, které vyžadují explicitní 3D souřadnice, namísto implicitních (skrytých) souřadnic kontinuálních funkcí.

Kliknutím se přehraje. Obrazovky generované v Stable Diffusion lze převést na racionální CGI mesh. Zde vidíme výsledek image>CGI workflow pomocí Stable Zero 123. Source: https://www.youtube.com/watch?v=RxsssDD48Xc

3D Semantics

Generativní AI prostor činí rozdíl mezi 2D a 3D systémy implementací vidění a generativních systémů. Například facial landmarking frameworks, ačkoli reprezentují 3D objekty (tváře) ve všech případech, ne všechny nutně počítají adresovatelné 3D souřadnice.

Popular FANAlign systém, široce používaný v 2017-era deepfake architekturách (mezi jinými), může akomodovat obě tyto přístupy:

Nahoře, 2D landmarky jsou generovány na základě rozpoznaných obličejových lineamentů a rysů. Dole, jsou racionalizovány do 3D X/Y/Z prostoru. Source: https://github.com/1adrianb/face-alignment

Takže, stejně jako “deepfake” se stal záhadným a ukradeným termínem, “3D” se stal také matoucím termínem ve výzkumu počítačového vidění.

Pro spotřebitele, to obvykle znamenalo stereo-povolená média (jako filmy, kde divák musí nosit speciální brýle); pro odborníky na vizuální efekty a modeléry, to poskytuje rozdíl mezi 2D uměním (jako konceptuálními skicami) a mesh-based modely, které lze manipulovat v “3D programu” jako Maya nebo Cinema4D.

Ale ve výzkumu počítačového vidění, to prostě znamená, že Cartesian coordinate systém existuje někde v latentním prostoru modelu – ne to, že jej lze nutně adresovat nebo přímo manipulovat uživatelem; alespoň ne bez třetí strany interpretativních CGI-založených systémů, jako je 3DMM nebo FLAME.

Protože pojem diffusion>3D je nepřesný; ne pouze může jakýkoli typ obrazu (včetně skutečné fotografie) být použit jako vstup pro generování CGI modelu, ale méně ambivalentní termín “mesh” je vhodnější.

Ale aby se zkomplikovala nepřesnost, difuze je potřebná k interpretaci zdrojové fotografie do mesh, ve většině nově se objevujících projektů. Takže lepší popis by mohl být image-to-mesh, zatímco image>diffusion>mesh je ještě přesnější popis.

Ale to je těžké prodat na zasedání rady, nebo ve veřejné zprávě určené k zapojení investorů.

Důkazy o architektonických patových situacích

I ve srovnání s rokem 2023, loňská sklizeň prací vykazuje rostoucí zoufalství kolem odstranění tvrdých praktických limitů na difuzní generaci.

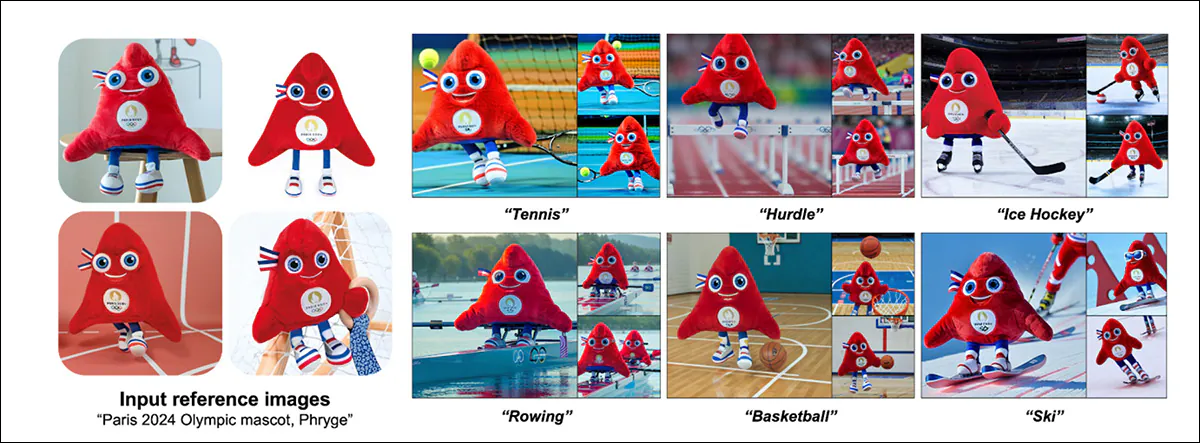

Klíčová překážka zůstává generování narativně a temporálně konzistentních videí a udržování konzistentního vzhledu postav a objektů – nejen napříč různými videoklipy, ale i napříč krátkou dobou běhu jednoho generovaného videa.

Poslední epochální inovace v difuzní syntéze byla příchod LoRA v roce 2022. Zatímco novější systémy, jako je Flux, zlepšily některé z outlier problémů, jako je předchozí neschopnost Stable Diffusion reprodukovat textový obsah uvnitř generovaného obrazu, a celková kvalita obrazu se zlepšila, většina prací, které jsem studoval v roce 2024, byly esenciálně pouze přesunutím jídla na talíři.

Tyto patové situace se již dříve vyskytly, s Generative Adversarial Networks (GANs) a s Neural Radiance Fields (NeRF), obě z nich selhaly ve svém údajném počátečním potenciálu – a obě z nich jsou stále více využívány v konvenčnějších systémech (jako je použití NeRF v Stable Zero 123, viz výše). To se zdá být také případem difuzních modelů.

Gaussian Splatting Research Pivots

Zdálo se, že na konci roku 2023, že rasterizační metoda 3D Gaussian Splatting (3DGS), která debutovala jako lékařská zobrazovací technika na počátku 90. let, byla připravena náhle předehnat autoencoder-based systémy lidské image syntézy výzev (jako obličejové simulace a rekreace, stejně jako identita přenos).

2023 ASH paper sliboval full-body 3DGS lidské, zatímco Gaussian Avatars nabídl výrazně zlepšené detaily (ve srovnání s autoencoder a jinými soutěžními metodami), spolu s působivým cross-reenactmentem.

Tento rok, však, byl relativně krátký na jakékoliv takové průlomové momenty pro 3DGS lidskou syntézu; většina prací, které se zabývaly touto problematikou, byly buď odvozeny od výše uvedených prací, nebo se nezdařily překonat jejich schopnosti.

Místo toho, důraz na 3DGS byl kladen na zlepšení jeho fundamentální architektonické proveditelnosti, což vedlo k velké vlně prací, které nabízejí zlepšené 3DGS vnější prostředí. Zvláštní pozornost byla věnována Simultaneous Localization and Mapping (SLAM) 3DGS přístupy, v projektech, jako je Gaussian Splatting SLAM, Splat-SLAM, Gaussian-SLAM, DROID-Splat, mezi mnoha dalšími.

Tyto projekty, které se pokusily pokračovat nebo rozšířit splat-based lidskou syntézu, zahrnovaly MIGS, GEM, EVA, OccFusion, FAGhead, HumanSplat, GGHead, HGM, a Topo4D. Ačkoli existují další, žádné z těchto projektů nezopakovaly počáteční dopad prací, které se objevily na konci roku 2023.

‘Weinstein Era’ testovacích vzorků je v (pomalém) úpadku

Výzkum z jihovýchodní Asie obecně (a Číny zvláště) často zahrnuje testovací příklady, které jsou problematické k opětovnému zveřejnění v recenzi článku, protože obsahují materiál, který je trochu “pikantní”.

Zda je to proto, že výzkumní pracovníci v této části světa se snaží získat pozornost pro svou produkci, je předmětem debaty; ale za posledních 18 měsíců, rostoucí počet prací kolem generativní AI (obraz a/nebo video) defaultoval na použití mladých a málo oděných žen a dívek v projektových příkladech. Na hranici NSFW příklady zahrnují UniAnimate, ControlNext, a dokonce velmi “suché” články, jako je Evaluating Motion Consistency by Fréchet Video Motion Distance (FVMD).

To následuje obecné trendy subredditů a jiných komunit, které se shromáždily kolem Latent Diffusion Models (LDM), kde Rule 34 zůstává velmi platná.

Celebrity Face-Off

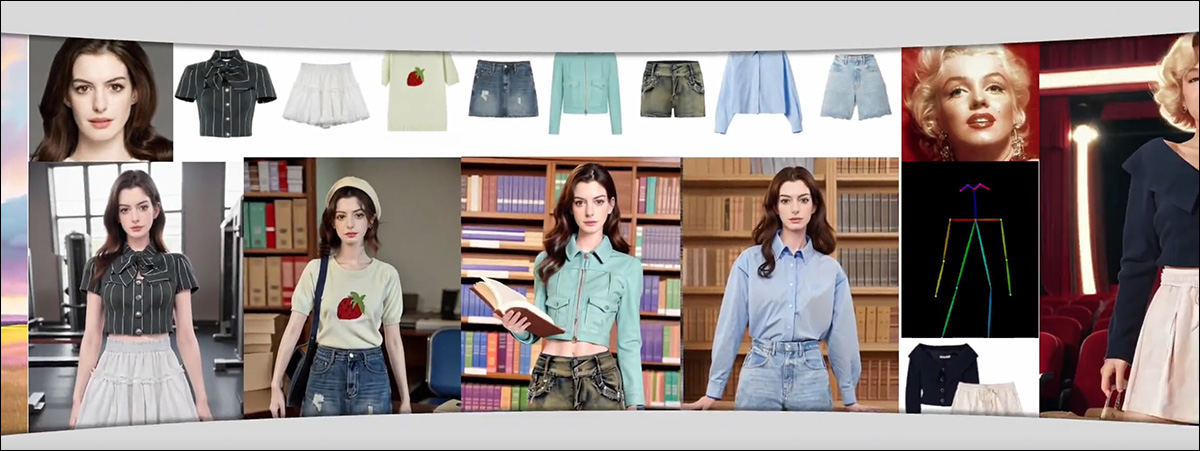

Tento typ nevhodného příkladu se překrývá s rostoucím uznáním, že AI procesy by neměly svévolně využívat celebrity podobizny – zejména ve studiích, které nekriticky používají příklady zahrnující atraktivní celebrity, často ženy, a umístění je do sporných kontextů.

Jeden příklad je AnyDressing, který, kromě toho, že zahrnuje velmi mladé anime-styl ženy, také volně používá identity klasických celebrity, jako je Marilyn Monroe, a současných, jako je Ann Hathaway (která odsoudila tento typ použití velmi hlasitě).

Svůjvolné použití současných a ‘klasických’ celebrity je stále poměrně časté v článcích z jihovýchodní Asie, i když tato praxe je mírně na ústupu. Source: https://crayon-shinchan.github.io/AnyDressing/

V západních článcích, tato konkrétní praxe je pozoruhodně na ústupu po celý rok 2024, vedená většími vydáními z FAANG a dalších vysokých úrovní výzkumných subjektů, jako je OpenAI. Kriticky si vědomi potenciálu budoucích žalob, tyto hlavní korporátní hráči zdají se být stále méně ochotni reprezentovat i fikční fotorealistické lidi.

Ačkoli systémy, které vytvářejí (jako Imagen a Veo2), jsou jasně schopné takové výstupu, příklady z western generativních AI projektů nyní směřují k “milým”, Disneyovsky a extrémně “bezpečným” obrazům a videím.

Přes prohlašování Imagen schopnosti vytvářet ‘fotorealistické’ výstupy, ukázky propagované Google Research jsou typicky fantastické, ‘rodinné’ záležitosti – fotorealističtí lidé jsou pečlivě vynecháni, nebo minimální ukázky jsou poskytovány. Source: https://imagen.research.google/

Face-Washing

V západní CV literatuře, tento neupřímný přístup je zvláště patrný pro customization systémy – metody, které jsou schopné vytvářet konzistentní podobizny konkrétní osoby napříč několika ukázkami (tj. jako LoRA a starší DreamBooth).

Příklady zahrnují ortogonální vizuální vložení, LoRA-Composer, Google’s InstructBooth, a mnoho dalších.

Google’s InstructBooth zvyšuje faktor ‘milosti’ na 11, i když historie naznačuje, že uživatelé jsou více zajímáni o vytváření fotorealistických lidí než o chlupaté nebo roztomilé postavy. Source: https://sites.google.com/view/instructbooth

Nicméně, růst “milých” příkladů je vidět v dalších CV a syntézách výzkumných směrech, v projektech, jako je Comp4D, V3D, DesignEdit, UniEdit, FaceChain (který uznává více realistických uživatelských očekávání na své GitHub stránce), a DPG-T2I, mezi mnoha dalšími.

Snadnost, s níž lze takové systémy (jako LoRAs) vytvořit domácími uživateli s relativně skromným hardwarem, vedla k explozi volně stahovatelných celebrity modelů na doméně civit.ai a komunitě. Takový nelegitimní použití zůstává možné prostřednictvím otevřeného zdrojového kódu architektur, jako je Stable Diffusion a Flux.

Ačkoli je často možné prolomit bezpečnostní funkce generativních text-to-image (T2I) a text-to-video (T2V) systémů, aby se vyrobily materiály zakázané platformou, mezera mezi omezenými schopnostmi nejlepších systémů (jako RunwayML a Sora) a neomezenými schopnostmi pouze výkonných systémů (jako Stable Video Diffusion, CogVideo a místní nasazení Hunyuan) není vlastně se zmenšující, jak si mnozí myslí.

Místo toho, tyto proprietární a otevřené systémy, respektive, hrozí stát se stejně neužitečnými: drahé a hyperscale T2V systémy mohou být nadměrně omezovány kvůli strachu z žalob, zatímco nedostatek licenčního infrastruktury a dohledu nad datovými sadami v otevřených systémech by je mohl úplně vyloučit z trhu, jakmile budou zavedena přísnější regulace.

Poprvé zveřejněno úterý, 24. prosince 2024