Góc nhìn Anderson

Con đường đến chỉnh sửa video dựa trên Trí tuệ nhân tạo tốt hơn

Ngành nghiên cứu tổng hợp video/hình ảnh thường xuyên đưa ra các kiến trúc chỉnh sửa video, và trong chín tháng qua, những lần ra mắt như vậy đã trở nên thường xuyên hơn. Tuy nhiên, hầu hết chúng chỉ đại diện cho những tiến bộ nhỏ trên trạng thái hiện tại, vì những thách thức cốt lõi là đáng kể.

Tuy nhiên, một sự hợp tác mới giữa Trung Quốc và Nhật Bản trong tuần này đã tạo ra một số ví dụ xứng đáng được xem xét kỹ lưỡng về phương pháp, ngay cả khi nó không nhất thiết phải là một công trình đột phá.

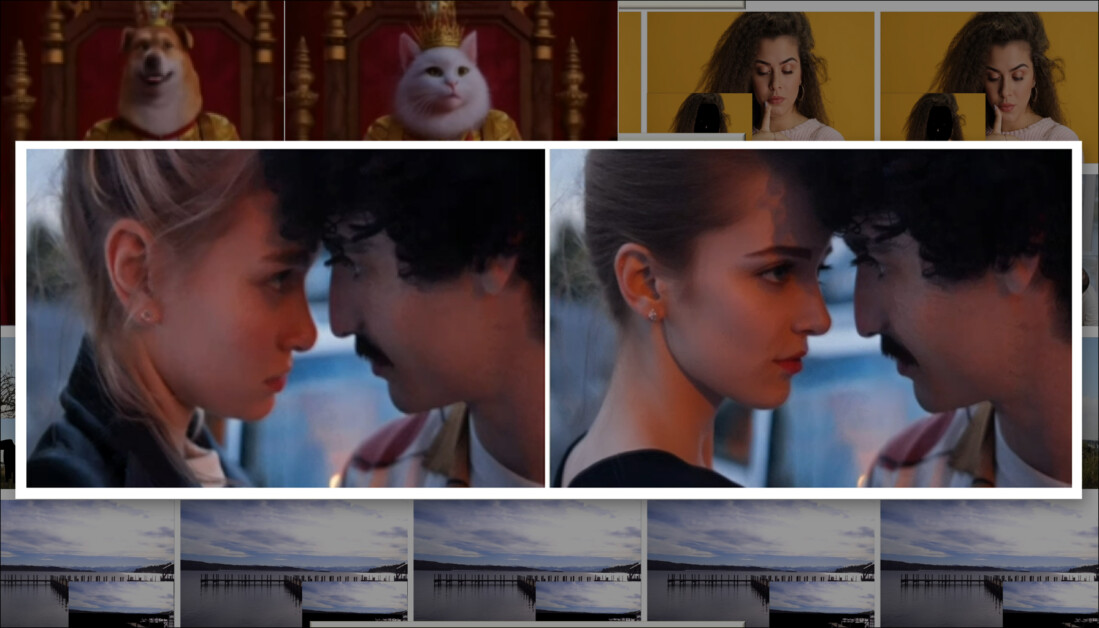

Trong đoạn video dưới đây (từ trang web dự án liên quan đến bài báo, điều đó – hãy cẩn thận – có thể làm chậm trình duyệt của bạn) chúng ta thấy rằng mặc dù khả năng tạo video giả của hệ thống không tồn tại trong cấu hình hiện tại, hệ thống làm rất tốt việc thay đổi đáng kể và hợp lý danh tính của người phụ nữ trẻ trong bức ảnh, dựa trên mặt nạ video (phía dưới bên trái):

Click để phát.Dựa trên mặt nạ phân đoạn ngữ nghĩa được trực quan hóa ở phía dưới bên trái, người phụ nữ ban đầu (phía trên bên trái) được biến thành một danh tính khác biệt đáng kể, mặc dù quá trình này không đạt được việc hoán đổi danh tính như được chỉ định trong lời nhắc.Nguồn: https://yxbian23.github.io/project/video-painter/ (hãy lưu ý rằng tại thời điểm viết, trang web này có xu hướng bị treo trình duyệt của tôi). Vui lòng tham khảo các video nguồn, nếu bạn có thể truy cập chúng, để có độ phân giải và chi tiết tốt hơn, hoặc kiểm tra các ví dụ tại video tổng quan của dự án tại https://www.youtube.com/watch?v=HYzNfsD3A0s

Chỉnh sửa dựa trên mặt nạ như vậy đã được thiết lập tốt trong các mô hình khuếch tán tiềm ẩn tĩnh, sử dụng các công cụ như ControlNet. Tuy nhiên, việc duy trì tính nhất quán của nền trong video là một thách thức lớn hơn nhiều, ngay cả khi các khu vực được mặt nạ cung cấp cho mô hình sự linh hoạt sáng tạo, như được hiển thị dưới đây:

Click để phát.Thay đổi loài, với phương pháp VideoPainter mới.Vui lòng tham khảo các video nguồn, nếu bạn có thể truy cập chúng, để có độ phân giải và chi tiết tốt hơn, hoặc kiểm tra các ví dụ tại video tổng quan của dự án tại https://www.youtube.com/watch?v=HYzNfsD3A0s

Các tác giả của công trình mới xem xét phương pháp của họ liên quan đến kiến trúc BrushNet của Tencent (điều mà chúng tôi đã đề cập vào năm ngoái), và đến ControlNet, cả hai đều xử lý kiến trúc phân nhánh kép có khả năng cách ly việc tạo nền và tiền cảnh.

Tuy nhiên, việc áp dụng phương pháp này trực tiếp vào phương pháp Biến đổi khuếch tán (DiT) được đề xuất bởi Sora của OpenAI mang lại những thách thức cụ thể, như các tác giả lưu ý:

‘[Áp dụng trực tiếp] kiến trúc của BrushNet và ControlNet cho video DiT mang lại một số thách thức: [Trước hết, xét] nền tảng tạo ra mạnh mẽ và kích thước mô hình nặng của Video DiT, việc sao chép lại toàn bộ hoặc một nửa lưng của Video DiT làm bộ mã hóa ngữ cảnh sẽ là không cần thiết và tính toán cấm.

‘[Thứ hai, không giống] như nhánh kiểm soát thuần túy của BrushNet, các token trong vùng bị mặt nạ của DiT vốn chứa thông tin nền do sự chú ý toàn cầu, làm phức tạp sự phân biệt giữa các vùng bị mặt nạ và không bị mặt nạ trong lưng DiT.

‘[Cuối cùng,] ControlNet thiếu việc tiêm tính năng trên tất cả các lớp, cản trở việc kiểm soát nền dày đặc cho các nhiệm vụ tạo lại.’

Do đó, các nhà nghiên cứu đã phát triển một phương pháp plug-and-play dưới dạng khung phân nhánh kép có tên là VideoPainter.

VideoPainter cung cấp một khung phân nhánh kép cho việc tạo lại video, giúp tăng cường các DiT đã được đào tạo trước với một bộ mã hóa ngữ cảnh nhẹ. Bộ mã hóa này chỉ chiếm 6% số tham số của lưng, điều mà các tác giả cho rằng làm cho phương pháp này hiệu quả hơn so với các phương pháp thông thường.

Mô hình đề xuất ba đổi mới chính: một bộ mã hóa ngữ cảnh hai lớp được tối ưu hóa cho hướng dẫn nền hiệu quả; một hệ thống tích hợp tính năng chọn mặt nạ giúp tách các token bị mặt nạ và không bị mặt nạ; và một kỹ thuật lấy mẫu lại ID vùng tạo lại giúp duy trì tính nhất quán danh tính trên các chuỗi video dài.

Bằng cách đông lạnh cả DiT đã được đào tạo trước và bộ mã hóa ngữ cảnh trong khi giới thiệu một ID-Adapter, VideoPainter đảm bảo rằng các token vùng tạo lại từ các đoạn trước sẽ tồn tại trong suốt video, giảm hiện tượng nhấp nháy và không nhất quán.

Khung này cũng được thiết kế cho khả năng tương thích plug-and-play, cho phép người dùng tích hợp nó một cách无缝 vào các công việc tạo và chỉnh sửa video hiện có.

Để hỗ trợ công việc, sử dụng CogVideo-5B-I2V làm động cơ tạo ra, các tác giả đã biên soạn những gì họ tuyên bố là bộ dữ liệu tạo lại video lớn nhất cho đến nay. Được đặt tên là VPData, bộ sưu tập bao gồm hơn 390.000 đoạn, với tổng thời lượng video hơn 886 giờ. Họ cũng phát triển một khung đánh giá liên quan có tên VPBench.

Click để phát.Từ các ví dụ trên trang web dự án, chúng ta thấy khả năng phân đoạn được cung cấp bởi bộ sưu tập VPData và bộ thử nghiệm VPBench.Vui lòng tham khảo các video nguồn, nếu bạn có thể truy cập chúng, để có độ phân giải và chi tiết tốt hơn, hoặc kiểm tra các ví dụ tại video tổng quan của dự án tại https://www.youtube.com/watch?v=HYzNfsD3A0s

Công việc mới này có tiêu đề VideoPainter: Tạo lại và chỉnh sửa video bất kỳ độ dài với kiểm soát ngữ cảnh plug-and-play, và đến từ bảy tác giả tại Tencent ARC Lab, Đại học Trung Quốc Hồng Kông, Đại học Tokyo và Đại học Macau.

Ngoài trang web dự án, các tác giả cũng đã phát hành một tổng quan trên YouTube và một trang Hugging Face.

Phương pháp

Quy trình thu thập dữ liệu cho VPData bao gồm thu thập, chú thích, chia tách, chọn lọc và chú thích:

Sơ đồ cho quy trình xây dựng bộ dữ liệu. Nguồn: https://arxiv.org/pdf/2503.05639

Các bộ sưu tập nguồn được sử dụng cho biên soạn này đến từ Videvo và Pexels, với khoảng 450.000 video thu được ban đầu.

Một số thư viện và phương pháp đóng góp đã được sử dụng trong giai đoạn tiền xử lý: khung Recognize Anything được sử dụng để cung cấp thẻ video mở, được giao nhiệm vụ xác định các đối tượng chính; Grounding Dino được sử dụng để phát hiện các hộp giới hạn xung quanh các đối tượng được xác định; và khung Segment Anything Model 2 (SAM 2) được sử dụng để tinh chỉnh các lựa chọn thô thành phân đoạn mặt nạ chất lượng cao.

Để quản lý các chuyển tiếp cảnh và đảm bảo tính nhất quán trong việc tạo lại video, VideoPainter sử dụng PySceneDetect để xác định và phân đoạn các đoạn tại các điểm ngắt tự nhiên, tránh các chuyển đổi giật cục thường gây ra bởi việc theo dõi cùng một đối tượng từ nhiều góc độ. Các đoạn được chia thành khoảng thời gian 10 giây, với bất kỳ thứ gì ngắn hơn 6 giây bị loại bỏ.

Đối với việc chọn lọc dữ liệu, ba tiêu chí lọc đã được áp dụng: chất lượng thẩm mỹ, được đánh giá bằng Laion-Aesthetic Score Predictor; độ mạnh của chuyển động, được đo bằng lưu lượng quang sử dụng RAFT; và an toàn nội dung, được xác minh thông qua Trình kiểm tra an toàn của Stable Diffusion.

Một hạn chế lớn trong các bộ dữ liệu phân đoạn video hiện có là thiếu chú thích văn bản chi tiết, điều quan trọng để hướng dẫn các mô hình tạo ra:

Các nhà nghiên cứu nhấn mạnh sự thiếu hụt của việc chú thích video trong các bộ sưu tập so sánh.

Do đó, quy trình thu thập dữ liệu VideoPainter bao gồm các mô hình tầm nhìn-ngôn ngữ hàng đầu, bao gồm CogVLM2 và Chat GPT-4o để tạo ra các chú thích dựa trên khung hình và mô tả chi tiết về các vùng bị mặt nạ.

VideoPainter tăng cường các DiT đã được đào tạo trước bằng cách giới thiệu một bộ mã hóa ngữ cảnh tùy chỉnh nhẹ, tách việc trích xuất ngữ cảnh nền khỏi việc tạo tiền cảnh, được nhìn thấy ở phía trên bên phải của sơ đồ minh họa dưới đây:

Sơ đồ khái niệm cho VideoPainter. Bộ mã hóa ngữ cảnh của VideoPainter xử lý các véc tơ nhiễu, mặt nạ xuống mẫu và véc tơ video mặt nạ qua VAE, tích hợp chỉ các token nền vào DiT đã được đào tạo trước để tránh sự mơ hồ.

Thay vì gánh nặng cho lưng với xử lý dư thừa, bộ mã hóa này hoạt động trên một đầu vào được tối ưu hóa: sự kết hợp của véc tơ nhiễu, véc tơ video mặt nạ (trích xuất qua một mô hình tự động mã hóa, hoặc VAE) và mặt nạ xuống mẫu.

Véc tơ nhiễu cung cấp ngữ cảnh tạo ra, và véc tơ video mặt nạ phù hợp với phân phối hiện có của DiT, nhằm tăng cường khả năng tương thích.

Thay vì sao chép các phần lớn của mô hình, điều mà các tác giả cho rằng đã xảy ra trong các công việc trước đây, VideoPainter chỉ tích hợp hai lớp đầu tiên của DiT. Các tính năng được trích xuất này được giới thiệu lại vào DiT đã được đông lạnh theo một cách có cấu trúc, nhóm theo nhóm – các tính năng lớp đầu tiên thông báo cho nửa đầu tiên của mô hình, trong khi các tính năng sau tinh chỉnh nửa thứ hai.

Ngoài ra, một cơ chế chọn token đảm bảo rằng chỉ các tính năng liên quan đến nền được tái tích hợp, ngăn chặn sự nhầm lẫn giữa các vùng bị mặt nạ và không bị mặt nạ. Phương pháp này, theo các tác giả, cho phép VideoPainter duy trì độ trung thực cao trong việc bảo tồn nền trong khi cải thiện hiệu quả tạo lại tiền cảnh.

Các tác giả lưu ý rằng phương pháp họ đề xuất hỗ trợ nhiều phương pháp tạo kiểu khác nhau, bao gồm cả phương pháp thích nghi thấp (LoRA) phổ biến nhất.

Dữ liệu và Kiểm tra

VideoPainter được đào tạo bằng mô hình CogVideo-5B-I2V, cùng với mô hình tương đương văn bản-sang-video. Bộ dữ liệu VPData được sử dụng ở độ phân giải 480x720px, với tốc độ học là 1×10-5.

Bộ chuyển đổi lấy mẫu lại ID được đào tạo trong 2.000 bước, và bộ mã hóa ngữ cảnh trong 80.000 bước, cả hai đều sử dụng tối ưu hóa AdamW. Việc đào tạo diễn ra trong hai giai đoạn sử dụng 64 GPU NVIDIA V100 (mặc dù bài báo không chỉ định liệu chúng có 16GB hay 32GB VRAM).

Đối với việc đánh giá, Davis được sử dụng cho các mặt nạ ngẫu nhiên, và VPBench của các tác giả cho các mặt nạ phân đoạn.

Bộ dữ liệu VPBench bao gồm các đối tượng, động vật, con người, phong cảnh và các nhiệm vụ đa dạng, và bao gồm bốn hành động: thêm, xóa, thay đổi, và hoán đổi. Bộ sưu tập này bao gồm 45 video 6 giây, và chín video có độ dài trung bình 30 giây.

Tám chỉ số đã được sử dụng cho quá trình này. Đối với việc bảo tồn vùng bị mặt nạ, các tác giả sử dụng Tỷ lệ tín hiệu trên nhiễu đỉnh (PSNR); Các chỉ số tương tự về nhận thức đã học (LPIPS); Chỉ số tương tự về cấu trúc (SSIM); và Lỗi tuyệt đối trung bình (MAE).

Đối với việc căn chỉnh văn bản, các nhà nghiên cứu sử dụng Tương tự CLIP để đánh giá khoảng cách ngữ nghĩa giữa chú thích đoạn và nội dung thực tế được nhận thức, và cũng để đánh giá độ chính xác của các vùng bị mặt nạ.

Để đánh giá chất lượng chung của video đầu ra, Khoảng cách video Fréchet (FVD) đã được sử dụng.

Đối với một vòng so sánh định lượng về việc tạo lại video, các tác giả đã thiết lập hệ thống của họ chống lại các phương pháp trước đây ProPainter, COCOCO và Cog-Inp (CogVideoX). Bài kiểm tra bao gồm việc tạo lại khung hình đầu tiên của một đoạn bằng cách sử dụng các mô hình tạo lại hình ảnh, và sau đó sử dụng một lưng hình ảnh-sang-video (I2V) để truyền播 kết quả vào một hoạt động trộn latent, theo một phương pháp được đề xuất bởi một bài báo năm 2023 từ Israel.

Vì trang web dự án không hoàn toàn hoạt động tại thời điểm viết và vì video tổng quan trên YouTube của dự án có thể không bao gồm toàn bộ các ví dụ được nhồi vào trang web dự án, điều đó khá khó khăn để tìm các ví dụ video cụ thể cho kết quả được nêu trong bài báo. Vì vậy, chúng tôi sẽ hiển thị một số kết quả tĩnh được chọn từ bài báo, và kết thúc bài viết với một số ví dụ video bổ sung mà chúng tôi đã trích xuất từ trang web dự án.

So sánh định lượng của VideoPainter so với ProPainter, COCOCO và Cog-Inp trên VPBench (mặt nạ phân đoạn) và Davis (mặt nạ ngẫu nhiên). Các chỉ số bao gồm việc bảo tồn vùng bị mặt nạ, căn chỉnh văn bản và chất lượng video. Đỏ = tốt nhất, Xanh = tốt thứ hai.

Về những kết quả định lượng này, các tác giả nhận xét:

‘Trong VPBench dựa trên phân đoạn, ProPainter và COCOCO thể hiện hiệu suất kém nhất trên hầu hết các chỉ số, chủ yếu do khả năng không thể tạo lại các đối tượng bị mặt nạ hoàn toàn và khó khăn của kiến trúc một lưng trong việc cân bằng giữa việc bảo tồn nền và tạo tiền cảnh.’

‘Trong thử nghiệm mặt nạ ngẫu nhiên Davis, ProPainter cho thấy sự cải thiện bằng cách tận dụng thông tin nền một phần. Tuy nhiên, VideoPainter đạt được hiệu suất tối ưu trên cả phân đoạn (tiêu chuẩn và dài) và mặt nạ ngẫu nhiên thông qua kiến trúc phân nhánh kép của nó, hiệu quả decouples việc bảo tồn nền và tạo tiền cảnh.’

Các tác giả sau đó trình bày các ví dụ tĩnh về các thử nghiệm định lượng, trong đó chúng tôi giới thiệu một số lựa chọn dưới đây. Trong tất cả các trường hợp, chúng tôi đề cập người đọc đến trang web dự án và video YouTube để có độ phân giải tốt hơn.

So sánh với các phương pháp tạo lại trước đó.

Click để phát.Các ví dụ được chúng tôi ghép từ các video ‘kết quả’ trên trang web dự án.

Về vòng thử nghiệm định lượng này cho việc tạo lại video, các tác giả nhận xét:

‘VideoPainter liên tục cho thấy kết quả xuất sắc trong sự nhất quán video, chất lượng và căn chỉnh với chú thích văn bản. Đặc biệt, ProPainter không thể tạo ra các đối tượng bị mặt nạ hoàn toàn vì nó chỉ phụ thuộc vào việc truyền播 pixel nền thay vì tạo ra.’

‘Trong khi COCOCO thể hiện chức năng cơ bản, nó không thể duy trì ID nhất quán trong các vùng tạo lại (sự thay đổi đột ngột của tàu và địa hình) do kiến trúc một lưng cố gắng cân bằng giữa việc bảo tồn nền và tạo tiền cảnh.’

‘Cog-Inp đạt được kết quả tạo lại cơ bản; tuy nhiên, hoạt động trộn của nó không thể phát hiện ranh giới mặt nạ, dẫn đến các hiện象 đáng kể.’

‘Hơn nữa, VideoPainter có thể tạo ra các video nhất quán vượt quá một phút trong khi duy trì tính nhất quán ID thông qua việc lấy mẫu lại ID của chúng tôi.’

Các nhà nghiên cứu cũng đã kiểm tra khả năng tăng cường chú thích và đạt được kết quả tốt hơn bằng cách này, đặt hệ thống chống lại UniEdit, DiTCtrl và ReVideo.

Kết quả chỉnh sửa video so với các phương pháp trước đó.

Các tác giả nhận xét:

‘Đối với cả video tiêu chuẩn và dài trong VPBench, VideoPainter đạt được hiệu suất vượt trội, thậm chí vượt qua cả ReVideo từ đầu đến cuối. Sự thành công này có thể được quy cho kiến trúc phân nhánh kép của nó, đảm bảo khả năng bảo tồn nền và tạo tiền cảnh tuyệt vời, duy trì độ trung thực cao trong các vùng không được chỉnh sửa trong khi đảm bảo các vùng được chỉnh sửa phù hợp chặt chẽ với các hướng dẫn chỉnh sửa, được bổ sung bởi việc lấy mẫu lại ID vùng tạo lại giúp duy trì tính nhất quán ID trong video dài.’

Mặc dù bài báo có các ví dụ tĩnh về chỉ số này, chúng không mang tính启发, và chúng tôi đề cập người đọc đến các ví dụ đa dạng được phân bố trên các video được xuất bản cho dự án này.

Cuối cùng, một nghiên cứu của con người đã được thực hiện, trong đó 30 người dùng được yêu cầu đánh giá 50 lần tạo ra ngẫu nhiên từ các tập hợp VPBench và chỉnh sửa. Các ví dụ này đã nhấn mạnh việc bảo tồn nền, căn chỉnh với lời nhắc và chất lượng video chung.

Kết quả từ nghiên cứu của người dùng cho VideoPainter.

Các tác giả tuyên bố:

‘VideoPainter vượt trội so với các baseline hiện có, đạt được tỷ lệ ưa thích cao hơn trên tất cả các tiêu chí đánh giá trong cả hai nhiệm vụ.’

Họ thừa nhận, tuy nhiên, rằng chất lượng của các lần tạo ra của VideoPainter phụ thuộc vào mô hình cơ sở, có thể gặp khó khăn với chuyển động phức tạp và vật lý; và họ quan sát thấy rằng nó cũng hoạt động kém với mặt nạ chất lượng thấp hoặc chú thích không phù hợp.

Kết luận

VideoPainter dường như là một bổ sung đáng giá cho tài liệu. Typ của các giải pháp gần đây, tuy nhiên, nó có nhu cầu tính toán đáng kể. Ngoài ra, nhiều ví dụ được chọn để trình bày tại trang web dự án không đạt được những ví dụ tốt nhất; do đó, sẽ rất thú vị khi thấy khung này được đặt cạnh các mục nhập trong tương lai và một loạt các phương pháp trước đây.

* Nó đáng chú ý rằng ‘chỉnh sửa video’ trong ý nghĩa này không có nghĩa là ‘lắp ráp các đoạn khác nhau thành một chuỗi’, điều này là ý nghĩa truyền thống của thuật ngữ này; nhưng thay vào đó là thay đổi hoặc sửa đổi trực tiếp nội dung của các đoạn video hiện có bằng cách sử dụng các kỹ thuật học máy

Được xuất bản lần đầu vào thứ hai, ngày 10 tháng 3 năm 2025