Góc nhìn Anderson

Thêm Đối Thoại Vào Video Thực Với Trí Tuệ Nhân Tạo

Một khungamework trí tuệ nhân tạo mới có thể viết lại, xóa hoặc thêm lời nói của một người trong video mà không cần quay lại, trong một hệ thống từ đầu đến cuối.

Ba năm trước, internet sẽ bị sốc bởi bất kỳ một trong 20-30 khungamework chỉnh sửa video trí tuệ nhân tạo được xuất bản trên các cổng thông tin học thuật hàng tuần; như nó là, dòng nghiên cứu phổ biến này đã trở thành vô cùng phong phú đến mức gần như cấu thành một nhánh khác của ‘AI Slop’, và tôi bao phủ ít hơn nhiều những bản phát hành như vậy so với hai hoặc ba năm trước.

Tuy nhiên, một bản phát hành hiện tại trong dòng này đã thu hút sự chú ý của tôi: một hệ thống tích hợp có thể can thiệp vào các đoạn video thực và chèn thêm lời nói mới vào video hiện có (thay vì tạo một đoạn video tạo sinh hoàn toàn từ một khuôn mặt hoặc khung hình, điều này phổ biến hơn).

Trong các ví dụ dưới đây, mà tôi đã chỉnh sửa cùng nhau từ nhiều đoạn video mẫu có sẵn tại trang web dự án project website, chúng ta đầu tiên thấy đoạn video nguồn thực, và sau đó, dưới đây, lời nói được áp đặt bởi trí tuệ nhân tạo ở giữa đoạn video, bao gồm cả tổng hợp giọng nói và đồng bộ hóa môi:

Click để phát. Chỉnh sửa cục bộ với khâu – một trong số nhiều phương thức được cung cấp bởi FacEDiT. Vui lòng tham khảo trang web nguồn để có độ phân giải tốt hơn. Nguồn – https://facedit.github.io/

Cách tiếp cận này là một trong ba phương pháp được phát triển cho phương pháp mới, phương pháp này được đặt tên là ‘chỉnh sửa cục bộ với khâu’, và là phương pháp mà các tác giả quan tâm nhất (cũng như tôi). Về cơ bản, đoạn video được kéo dài bằng cách sử dụng một trong các khung hình giữa làm điểm bắt đầu cho giải thích trí tuệ nhân tạo mới, và khung hình thực tiếp theo làm mục tiêu mà đoạn video tạo sinh nên nhằm phù hợp.

Trong các đoạn video được thấy ở trên, những ‘hạt giống’ và ‘khung hình mục tiêu’ này được biểu diễn bởi video trên cùng bị tạm dừng trong khi video dưới cùng cung cấp phần tạo sinh.

Các tác giả mô tả phương pháp tổng hợp khuôn mặt và giọng nói này là phương pháp đầu tiên tích hợp đầy đủ từ đầu đến cuối cho các chỉnh sửa video trí tuệ nhân tạo loại này, quan sát thấy tiềm năng của một khungamework hoàn chỉnh như này cho sản xuất TV và phim:

‘Các nhà làm phim và nhà sản xuất truyền thông thường cần sửa đổi các phần cụ thể của video đã được quay – có thể một từ được nói sai hoặc kịch bản đã thay đổi sau khi quay. Ví dụ, trong cảnh nổi tiếng từ Titanic (1997) nơi Rose nói, “I’ll never let go, Jack,” đạo diễn có thể sau đó quyết định nó nên là “I’ll never forget you, Jack”.

‘Truyền thống, những thay đổi như vậy yêu cầu quay lại toàn bộ cảnh, điều này tốn kém và mất thời gian. Tổng hợp khuôn mặt nói chuyện cung cấp một giải pháp thay thế thực tế bằng cách tự động sửa đổi chuyển động khuôn mặt để phù hợp với lời nói được sửa đổi, loại bỏ nhu cầu về việc quay lại.’

Mặc dù việc can thiệp trí tuệ nhân tạo loại này có thể gặp phải đối lập văn hóa hoặc chống lại ngành công nghiệp, chúng cũng có thể cấu thành một loại chức năng mới trong các hệ thống và bộ công cụ VFX do con người dẫn dắt. Trong mọi trường hợp, hiện tại, những thách thức chỉ là kỹ thuật.

Ngoài việc kéo dài đoạn video thông qua thêm lời nói được tạo sinh bởi trí tuệ nhân tạo, hệ thống mới cũng có thể thay đổi lời nói hiện có:

Click để phát. Một ví dụ về việc thay đổi lời nói hiện có thay vì chèn thêm lời nói.

Trạng Thái Hiện Tại

Hiện tại không có hệ thống từ đầu đến cuối nào cung cấp khả năng tổng hợp này; mặc dù một số lượng ngày càng tăng các nền tảng trí tuệ nhân tạo tạo sinh như Veo series của Google, có thể tạo ra âm thanh, và nhiều khungamework khác có thể tạo ra giọng nói giả, hiện tại bạn cần tạo một đường ống khá phức tạp của các kiến trúc và thủ thuật khác nhau để can thiệp vào video thực như hệ thống mới – được đặt tên là FacEDiT – có thể thực hiện.

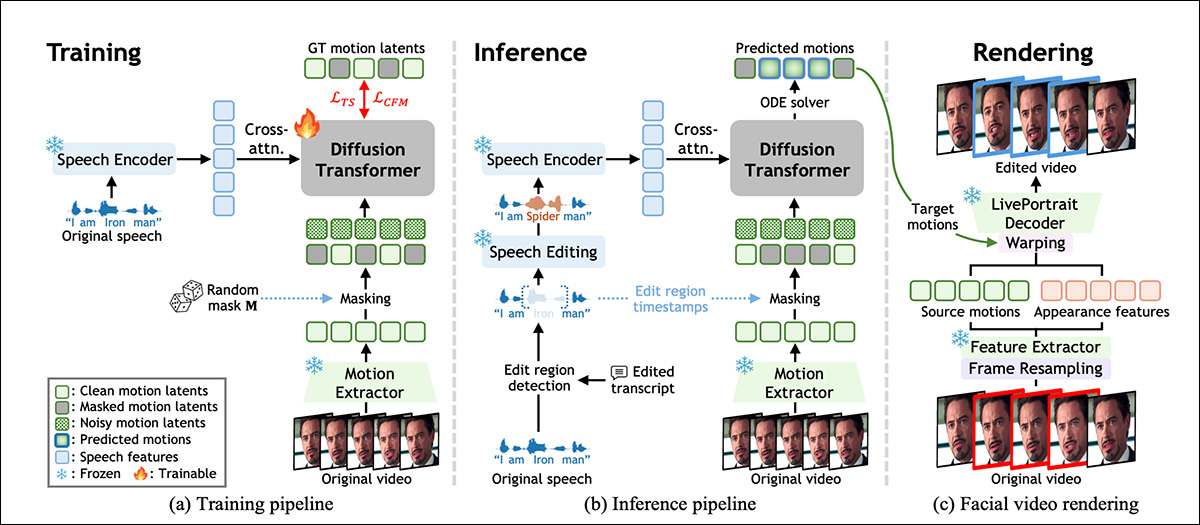

Hệ thống sử dụng Diffusion Transformers (DiT) kết hợp với Flow Matching để tạo ra chuyển động khuôn mặt có điều kiện dựa trên chuyển động và nội dung âm thanh xung quanh. Hệ thống tận dụng các gói phổ biến hiện có để xử lý tái tạo khuôn mặt, bao gồm LivePortrait (gần đây được Kling tiếp quản).

Ngoài phương pháp này, vì cách tiếp cận của họ là đầu tiên tích hợp những thách thức này vào một giải pháp đơn, các tác giả đã tạo ra một chuẩn mực mới gọi là FacEDiTBench, cùng với một số chỉ số đánh giá hoàn toàn mới phù hợp với nhiệm vụ cụ thể này.

Công việc mới new work có tiêu đề FacEDiT: Unified Talking Face Editing and Generation via Facial Motion Infilling, và đến từ bốn nhà nghiên cứu trên Pohang University of Science and Technology (POSTECH ), Korea Advanced Institute of Science & Technology (KAIST), và The University of Texas tại Austin.

Phương Pháp

FacEDiT được đào tạo để tái tạo chuyển động khuôn mặt bằng cách học cách điền vào các phần thiếu của hiệu suất gốc của diễn viên, dựa trên chuyển động xung quanh và âm thanh giọng nói. Như được hiển thị trong lược đồ dưới đây, quá trình này cho phép mô hình hoạt động như một bộ điền khoảng trống trong quá trình đào tạo, dự đoán chuyển động khuôn mặt phù hợp với giọng nói trong khi vẫn nhất quán với video gốc:

Tổng quan về hệ thống FacEDiT, hiển thị cách chuyển động khuôn mặt được học thông qua tự điền trong quá trình đào tạo, được hướng dẫn bởi lời nói chỉnh sửa tại thời điểm suy luận, và cuối cùng được hiển thị lại thành video bằng cách tái sử dụng ngoại hình từ video gốc trong khi chỉ thay thế chuyển động được nhắm mục tiêu. Nguồn

Tại thời điểm suy luận, kiến trúc相同 hỗ trợ hai đầu ra khác nhau tùy thuộc vào việc bao nhiêu video được che chắn: chỉnh sửa một phần, nơi chỉ một cụm từ được thay đổi và phần còn lại được giữ nguyên; hoặc tạo sinh câu đầy đủ, nơi chuyển động mới được tổng hợp hoàn toàn từ đầu.

Mô hình được đào tạo thông qua flow matching, điều này coi các chỉnh sửa video như một loại đường dẫn giữa hai phiên bản chuyển động khuôn mặt.

Thay vì học cách đoán xem một khuôn mặt chỉnh sửa nên trông như thế nào từ đầu, flow matching học cách di chuyển dần và mượt mà giữa một bản giữ chỗ ồn ào và chuyển động chính xác. Để thực hiện việc này, hệ thống biểu diễn chuyển động khuôn mặt như một tập hợp số紧 gọn được trích xuất từ mỗi khung hình sử dụng một phiên bản của hệ thống LivePortrait được đề cập trước đó (xem lược đồ trên).

Những vectơ chuyển động này được thiết kế để mô tả biểu cảm và tư thế đầu mà không đan xen danh tính, để thay đổi lời nói có thể được xác định vị trí mà không ảnh hưởng đến ngoại hình chung của người đó.

Đào Tạo FacEDiT

Để đào tạo FacEDiT, mỗi đoạn video được chia thành một loạt các ảnh chụp chuyển động khuôn mặt, và mỗi khung hình được ghép với phần âm thanh tương ứng. Các phần ngẫu nhiên của dữ liệu chuyển động sau đó được che giấu, và mô hình được yêu cầu đoán xem những chuyển động thiếu đó nên trông như thế nào, sử dụng cả lời nói và chuyển động không bị che giấu xung quanh làm ngữ cảnh.

Vì các khoảng trống bị che và vị trí của chúng thay đổi từ một ví dụ đào tạo này sang một ví dụ khác, mô hình dần dần học cách xử lý cả chỉnh sửa nội bộ nhỏ và khoảng trống dài hơn, cho việc tạo sinh toàn bộ chuỗi, tùy thuộc vào bao nhiêu thông tin nó được cung cấp.

Hệ thống Diffusion Transformer được đề cập trước đó học cách phục hồi chuyển động bị che bằng cách tinh chỉnh các đầu vào ồn ào theo thời gian. Thay vì cung cấp lời nói và chuyển động vào mô hình cùng một lúc, âm thanh được luồng vào mỗi khối xử lý thông qua cross-attention, giúp hệ thống phù hợp chuyển động môi chính xác hơn với lời nói.

Để duy trì tính thực tế trên các chỉnh sửa, sự chú ý bị thiên vị về các khung hình lân cận thay vì toàn bộ dòng thời gian, buộc mô hình phải tập trung vào tính liên tục cục bộ và ngăn chặn các hiện tượng nhấp nháy hoặc nhảy chuyển động ở các cạnh của các khu vực được chỉnh sửa. Các bản nhúng vị trí (nói cho mô hình biết mỗi khung hình xuất hiện ở đâu trong chuỗi) giúp mô hình duy trì dòng thời gian tự nhiên và ngữ cảnh.

Trong quá trình đào tạo, hệ thống học cách dự đoán chuyển động khuôn mặt thiếu bằng cách tái tạo các khoảng trống dựa trên lời nói và chuyển động không bị che giấu xung quanh. Tại thời điểm suy luận, thiết lập này được tái sử dụng, nhưng với các bản che giấu hiện được hướng dẫn bởi các chỉnh sửa trong lời nói.

Khi một từ hoặc cụm từ được chèn, xóa hoặc thay đổi, hệ thống xác định khu vực bị ảnh hưởng, che giấu nó và tái tạo chuyển động phù hợp với âm thanh mới. Tạo sinh toàn bộ chuỗi được coi là một trường hợp đặc biệt, nơi toàn bộ khu vực được che giấu và tổng hợp từ đầu.

Dữ Liệu và Kiểm Tra

Xương sống của hệ thống bao gồm 22 lớp cho Diffusion Transformer, mỗi lớp có 16 đầu chú ý và chiều kích của bộ phận cấp tiến là 1024 và 2024px. Các tính năng chuyển động và ngoại hình được trích xuất sử dụng các thành phần đóng băng của LivePortrait, và lời nói được mã hóa thông qua WavLM và được sửa đổi bằng cách sử dụng VoiceCraft.

Một lớp chiếu chuyên dụng ánh xạ các tính năng lời nói 786 chiều vào không gian ẩn của DiT, với chỉ mô-đun DiT và mô-đun chiếu được đào tạo từ đầu.

Đào tạo được thực hiện dưới AdamW với tốc độ học mục tiêu là 1e‑4, trong một triệu bước, trên hai GPU A6000 (mỗi GPU có 48GB VRAM), với tổng kích cỡ lô là tám.

FacEDiTBench

Bộ dữ liệu FacEDiTBench chứa 250 ví dụ, mỗi ví dụ có một đoạn video của lời nói gốc và lời nói chỉnh sửa, và các bản ghi cho cả hai. Các video đến từ ba nguồn, với 100 đoạn từ HDTF, 100 từ Hallo3, và 50 từ CelebV-Dub. Mỗi đoạn được kiểm tra thủ công để xác nhận rằng cả âm thanh và video đều đủ rõ ràng cho việc đánh giá.

GPT‑4o được sử dụng để sửa đổi mỗi bản ghi để tạo ra các chỉnh sửa ngữ pháp hợp lệ. Những bản ghi sửa đổi này, cùng với lời nói gốc, được chuyển đến VoiceCraft để tạo ra âm thanh mới; và tại mỗi giai đoạn, cả bản ghi và lời nói tạo sinh đều được xem xét thủ công về chất lượng.

Mỗi mẫu được dán nhãn với loại chỉnh sửa, thời gian thay đổi, và độ dài của khoảng trống được chỉnh sửa, và các chỉnh sửa được phân loại thành chèn, xóa, hoặc thay thế. Số lượng từ được thay đổi dao động từ các chỉnh sửa ngắn 1 đến 3 từ, chỉnh sửa trung bình 4 đến 6 từ, và chỉnh sửa dài hơn 7 đến 10 từ.

Ba chỉ số tùy chỉnh được định nghĩa để đánh giá chất lượng chỉnh sửa. độ liên tục ảnh, để đo lường mức độ mà ánh sáng và màu sắc của một đoạn chỉnh sửa hòa trộn với video xung quanh, bằng cách so sánh sự khác biệt ở mức pixel tại các ranh giới; độ liên tục chuyển động, để đánh giá sự nhất quán của chuyển động khuôn mặt, bằng cách đo lường sự thay đổi của dòng quang học trên các khung hình được chỉnh sửa và không được chỉnh sửa; và bảo tồn danh tính, để ước tính xem liệu ngoại hình của đối tượng có vẫn nhất quán sau khi chỉnh sửa, bằng cách so sánh các bản nhúng khuôn mặt từ các chuỗi gốc và tạo sinh sử dụng mô hình nhận dạng khuôn mặt ArcFace.

Kiểm Tra

Mô hình kiểm tra được đào tạo trên tài liệu từ ba bộ dữ liệu được đề cập trước đó, tổng cộng khoảng 200 giờ nội dung video, bao gồm cả blog và phim, cũng như video YouTube độ phân giải cao.

Để đánh giá việc chỉnh sửa khuôn mặt nói chuyện, FacEDiTBench được sử dụng, ngoài phần kiểm tra HDTF, đã trở thành một tiêu chuẩn基準 cho bộ nhiệm vụ này.

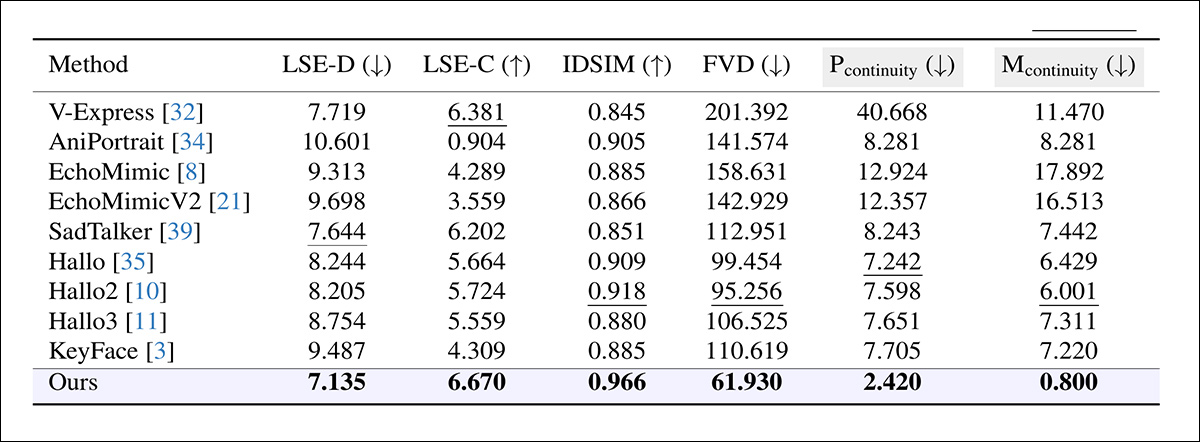

Vì không có hệ thống so sánh trực tiếp nào có khả năng bao gồm chức năng từ đầu đến cuối này, các tác giả đã chọn một loạt các khungamework có thể tái tạo một số chức năng mục tiêu, và có thể hoạt động như các đường cơ sở; cụ thể là, KeyFace; EchoMimic; EchoMimicV2; Hallo; Hallo2; Hallo3; V-Express; AniPortrait; và SadTalker.

Một số chỉ số đã được thiết lập cũng được sử dụng để đánh giá chất lượng tạo sinh và chỉnh sửa, với độ chính xác đồng bộ hóa môi được đánh giá thông qua SyncNet, báo cáo cả lỗi tuyệt đối giữa chuyển động môi và âm thanh (LSE-D) và một điểm số tin cậy (LSE-C); Fréchet Video Distance (FVD) lượng hóa mức độ thực tế của video tổng thể; và Learned Perceptual Similarity Metrics (LPIPS), đo lường sự tương đồng nhận thức giữa các khung hình tạo sinh và gốc.

Đối với việc chỉnh sửa, tất cả các chỉ số trừ LPIPS được áp dụng chỉ cho đoạn chỉnh sửa; đối với việc tạo sinh, toàn bộ video được đánh giá, với tính liên tục biên được loại trừ.

Mỗi mô hình được yêu cầu tạo ra một đoạn video khớp, sau đó được ghép vào đoạn video gốc (các nhà nghiên cứu lưu ý rằng phương pháp này thường giới thiệu các sự gián đoạn có thể nhìn thấy, nơi đoạn chỉnh sửa gặp phần video xung quanh). Một phương pháp khác cũng được kiểm tra, trong đó toàn bộ video được tạo sinh lại từ âm thanh chỉnh sửa – nhưng điều này vô tình ghi đè lên các vùng không được chỉnh sửa, và không bảo tồn hiệu suất gốc:

So sánh hiệu suất chỉnh sửa trên các hệ thống ban đầu được thiết kế cho việc tạo sinh khuôn mặt nói chuyện, với FacEDiT vượt trội so với tất cả các đường cơ sở trên mọi chỉ số, đạt được lỗi đồng bộ hóa môi thấp hơn (LSE-D), sự tin cậy đồng bộ hóa cao hơn (LSE-C), bảo tồn danh tính mạnh hơn (IDSIM), tính thực tế nhận thức cao hơn (FVD), và chuyển tiếp mượt mà hơn trên các biên chỉnh sửa (Pcontinuity, Mcontinuity). Các cột màu xám đánh dấu các tiêu chí chính để đánh giá chất lượng biên; các giá trị in đậm và gạch dưới chỉ ra kết quả tốt nhất và thứ hai, tương ứng

Về những kết quả này, các tác giả nhận xét:

‘[Mô hình của chúng tôi] vượt trội so với các phương pháp hiện có trên nhiệm vụ chỉnh sửa. Nó đạt được sự liên tục biên mạnh và bảo tồn danh tính cao, chứng tỏ khả năng của nó trong việc duy trì tính nhất quán thời gian và trực quan trong quá trình chỉnh sửa. Ngoài ra, độ chính xác đồng bộ hóa môi cao và FVD thấp phản ánh tính thực tế của video tạo sinh.’

Click để phát. Kết quả, được ráp lại bởi tác giả này từ các video được xuất bản tại trang web dự án. Vui lòng tham khảo trang web nguồn để có độ phân giải tốt hơn.

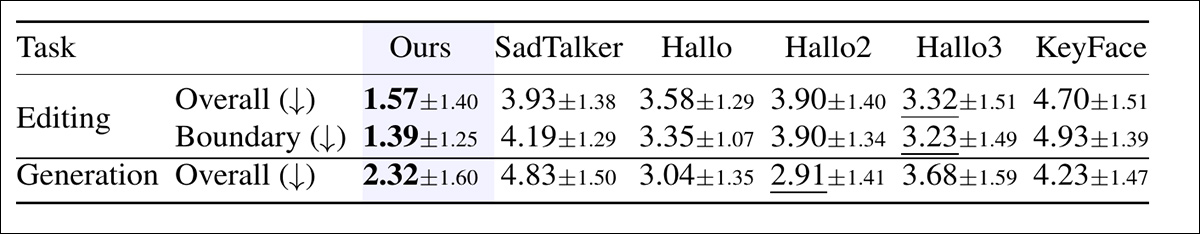

Hơn nữa, một nghiên cứu của con người đã được thực hiện để đánh giá chất lượng nhận thức trên cả chỉnh sửa và tạo sinh.

Đối với mỗi so sánh, các tham gia xem sáu video và xếp hạng chúng theo chất lượng tổng thể, xem xét độ chính xác đồng bộ hóa môi, tính tự nhiên và thực tế của chuyển động đầu. Trong các thử nghiệm chỉnh sửa, các tham gia cũng đánh giá sự mượt mà của chuyển tiếp giữa các đoạn chỉnh sửa và không chỉnh sửa:

Xếp hạng trung bình được giao bởi các nhà đánh giá con người, nơi thấp hơn có nghĩa là tốt hơn. Trong cả chỉnh sửa và tạo sinh, các tham gia đánh giá xem video trông tự nhiên và đồng bộ hóa như thế nào. Đối với chỉnh sửa, họ cũng đánh giá sự mượt mà của chuyển tiếp giữa các đoạn nói chỉnh sửa và không chỉnh sửa. Các số in đậm và gạch dưới chỉ ra hai điểm số hàng đầu.

Trong nghiên cứu, FacEDiT luôn được xếp hạng cao nhất bởi một lợi thế rõ ràng, cả về chất lượng chỉnh sửa và sự mượt mà của chuyển tiếp, cũng như đạt được điểm số mạnh trong việc tạo sinh, cho thấy rằng những lợi thế được đo lường của nó chuyển thành đầu ra được ưa chuộng về nhận thức.

Do thiếu không gian, chúng tôi đề nghị người đọc tham khảo bài báo nguồn để biết thêm chi tiết về các nghiên cứu phân tích và các thử nghiệm khác được thực hiện và báo cáo trong công việc mới.

Kết Luận

Thậm chí đối với việc suy luận, các hệ thống như thế này có thể yêu cầu tài nguyên tính toán đáng kể tại thời điểm suy luận, khiến nó khó khăn cho người dùng cuối – ở đây, rõ ràng là các cửa hàng VFX – để giữ công việc trong nhà. Do đó, các phương pháp có thể được điều chỉnh để phù hợp với tài nguyên thực tế sẽ luôn được các nhà cung cấp ưa chuộng, những người có nghĩa vụ pháp lý phải bảo vệ cảnh quay và tài sản trí tuệ của khách hàng.

Điều đó không có nghĩa là chỉ trích đề xuất mới, mà có thể hoạt động hoàn hảo dưới các trọng số được lượng tử hóa hoặc các tối ưu hóa khác, và là đề xuất đầu tiên thuộc loại này thu hút tôi trở lại lĩnh vực nghiên cứu này trong một thời gian khá dài.

Được xuất bản lần đầu vào thứ Tư, ngày 17 tháng 12 năm 2022. Đã được chỉnh sửa vào 20:10 EET, cùng ngày, để thêm khoảng trống trong đoạn văn đầu tiên.