Góc nhìn Anderson

AI Video Hoàn Chỉnh Ảnh Tự Sướng Của Mèo

Trình tạo video AI thường đưa ra kết quả gần giống nhưng không hoàn toàn chính xác, về việc cung cấp những gì mà lời nhắc văn bản mong muốn. Nhưng một bản sửa lỗi cấp cao mới làm cho mọi thứ khác biệt.

Hệ thống video tạo sinh thường gặp khó khăn trong việc tạo ra video thực sự sáng tạo hoặc điên rồ, và thường không đáp ứng được kỳ vọng của người dùng về lời nhắc văn bản.

Một phần nguyên nhân là sự kết hợp – việc các mô hình tầm nhìn/ngôn ngữ phải thỏa hiệp về thời gian đào tạo trên dữ liệu nguồn. Đào tạo quá ít, và các khái niệm sẽ linh hoạt nhưng chưa được hình thành đầy đủ – quá nhiều, và các khái niệm sẽ chính xác nhưng không còn linh hoạt đủ để kết hợp vào các tổ hợp mới.

Bạn có thể hình dung ra từ video được nhúng dưới đây. Ở bên trái là loại thỏa hiệp nửa chừng mà nhiều hệ thống AI cung cấp khi đáp ứng lời nhắc đòi hỏi (lời nhắc ở đầu video trong tất cả bốn ví dụ) yêu cầu sự kết hợp của các yếu tố mà quá幻 tưởng để có thể là một ví dụ đào tạo thực tế. Ở bên phải, là đầu ra AI gắn bó với lời nhắc tốt hơn:

Nhấn để phát (không có âm thanh). Ở bên phải, chúng ta thấy ‘factorized’ WAN 2.2 thực sự đáp ứng lời nhắc, so với cách giải thích mơ hồ của ‘vanilla’ Wan 2.2., ở bên trái. Vui lòng tham khảo các tệp video nguồn để có độ phân giải tốt hơn và nhiều ví dụ hơn, mặc dù các phiên bản được biên tập thấy ở đây không tồn tại tại trang web dự án và được biên tập cho bài viết này. Nguồn

Tốt, mặc dù chúng ta phải tha thứ cho bàn tay con người của con vịt拍 (!), rõ ràng là các ví dụ ở bên phải tuân thủ lời nhắc ban đầu tốt hơn nhiều so với những ví dụ ở bên trái.

Đáng chú ý, cả hai kiến trúc được giới thiệu đều cơ bản là giống nhau – kiến trúc phổ biến và rất có khả năng Wan 2.2, một bản phát hành của Trung Quốc đã đạt được tiến bộ đáng kể trong cộng đồng mã nguồn mở và nghiệp dư trong năm nay.

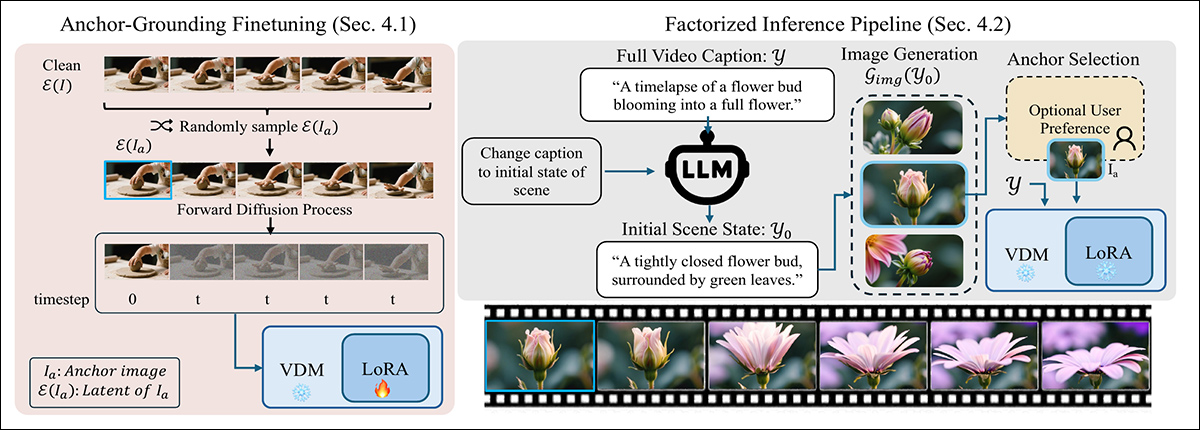

Sự khác biệt là đường ống tạo sinh thứ hai được phân tích, điều này trong trường hợp này có nghĩa là một mô hình ngôn ngữ lớn (LLM) đã được sử dụng để giải thích lại khung hình đầu tiên của video, để nó sẽ dễ dàng hơn cho hệ thống cung cấp những gì người dùng yêu cầu.

“Neo đậu” hình ảnh này liên quan đến việc tiêm một hình ảnh được tạo từ lời nhắc được tăng cường bởi LLM vào đường ống tạo sinh như một ‘khung hình bắt đầu’, và sử dụng mô hình giải thích LoRA để giúp tích hợp ‘khung hình xâm nhập’ vào quá trình tạo video:

Kết quả, về mặt trung thành với lời nhắc, khá đáng chú ý, đặc biệt là đối với một giải pháp dường như khá优雅:

Nhấn để phát (không có âm thanh). Các ví dụ tiếp theo về việc tạo video ‘phân tích’ thực sự gắn bó với kịch bản. Vui lòng tham khảo các tệp video nguồn để có độ phân giải tốt hơn và nhiều ví dụ hơn, mặc dù các phiên bản được biên tập thấy ở đây không tồn tại tại trang web dự án và được biên tập cho bài viết này.

Giải pháp này đến dưới dạng bài báo mới Factorized Video Generation: Decoupling Scene Construction and Temporal Synthesis in Text-to-Video Diffusion Models, và trang web dự án đi kèm video.

Trong khi nhiều hệ thống hiện tại cố gắng tăng độ chính xác của lời nhắc bằng cách sử dụng mô hình ngôn ngữ để viết lại văn bản mơ hồ hoặc không được chỉ định rõ, công việc mới cho rằng chiến lược này vẫn dẫn đến thất bại khi đại diện cảnh nội bộ của mô hình bị lỗi.

Ngay cả với lời nhắc chi tiết được viết lại, mô hình video từ văn bản thường xuyên tạo ra các yếu tố chính hoặc tạo ra các trạng thái ban đầu không tương thích mà phá vỡ logic của hoạt hình.只要 khung hình đầu tiên không phản ánh những gì lời nhắc mô tả, video kết quả không thể phục hồi, bất kể mô hình chuyển động tốt như thế nào.

Bài báo tuyên bố*:

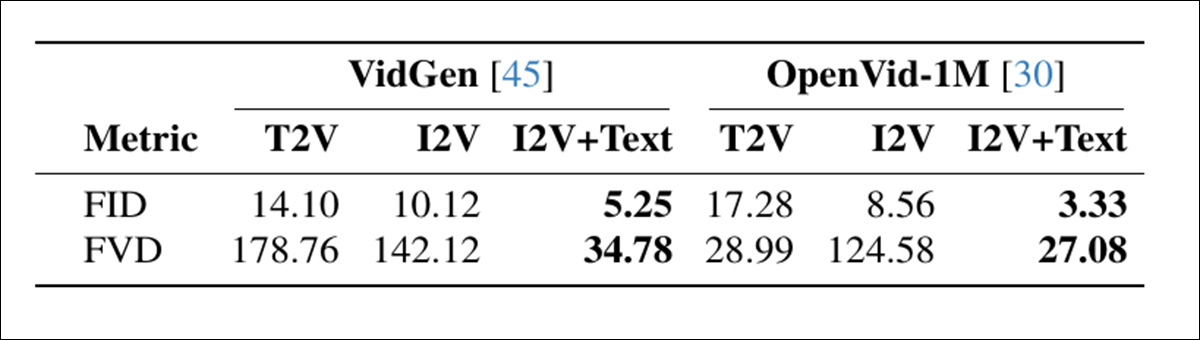

‘[Text-to-video] mô hình thường tạo ra khung hình bị dịch chuyển phân phối nhưng vẫn đạt được [đánh giá điểm] so sánh với I2V mô hình, chỉ ra rằng họ vẫn giữ được mô hình chuyển động tự nhiên ngay cả khi tính trung thực của cảnh tương đối kém.

‘[Image-to-Video] mô hình thể hiện hành vi bổ sung, điểm đánh giá mạnh từ cảnh ban đầu chính xác và sự nhất quán thời gian yếu hơn, trong khi I2V+text cân bằng cả hai khía cạnh.

‘Sự tương phản này cho thấy một sự không phù hợp cấu trúc trong các mô hình T2V hiện tại: sự gắn kết cảnh và tổng hợp thời gian được hưởng lợi từ các thiên vị cảm ứng khác nhau, nhưng các kiến trúc hiện có cố gắng học cả hai đồng thời trong một mô hình.’

So sánh chẩn đoán của các chế độ tạo sinh cho thấy rằng các mô hình không có neo cảnh rõ ràng đạt điểm cao về chuyển động, nhưng thường thỏa hiệp về bố cục cảnh:

So sánh các chế độ tạo video trên hai tập dữ liệu, cho thấy I2V+text đạt được chất lượng khung hình tốt nhất (FID) và sự nhất quán thời gian (FVD), nhấn mạnh lợi ích của việc tách biệt xây dựng cảnh và chuyển động. Nguồn

Những phát hiện này cho thấy một khiếm khuyết cấu trúc mà các mô hình hiện tại cố gắng học cả bố cục cảnh và hoạt hình trong một lần, ngay cả khi hai nhiệm vụ này yêu cầu các loại thiên vị cảm ứng khác nhau và được xử lý riêng biệt.

Có lẽ điều thú vị nhất là ‘mánh lới’ này có thể được áp dụng cho các cài đặt cục bộ của các mô hình như Wan 2.1 và 2.2, và các mô hình khuếch tán video tương tự như Hunyuan Video. Một cách tình cờ, so sánh chất lượng đầu ra của người dùng nghiệp dư với các cổng tạo sinh thương mại như Kling và Runway, hầu hết các nhà cung cấp API lớn dường như đang cải thiện các dịch vụ mã nguồn mở như WAN với LoRAs, và – dường như – với các thủ thuật giống như những gì được thấy trong bài báo mới. Do đó, cách tiếp cận này có thể đại diện cho một sự bắt kịp cho phe FOSS.

Các thử nghiệm được thực hiện cho phương pháp cho thấy rằng cách tiếp cận đơn giản và mô-đun này cung cấp một trạng thái mới về mặt nghệ thuật trên bảng đánh giá T2V-CompBench, cải thiện đáng kể tất cả các mô hình được thử nghiệm. Các tác giả lưu ý trong kết luận rằng trong khi hệ thống của họ cải thiện đáng kể tính trung thực, nó không giải quyết (hay không được thiết kế để giải quyết) sự trôi dạt danh tính, hiện là nỗi ám ảnh của nghiên cứu trí tuệ nhân tạo tạo sinh.

Bài báo mới đến từ bốn nhà nghiên cứu tại Ecole Polytechnique Fédérale de Lausanne (EPFL) ở Thụy Sĩ.

Phương pháp và Dữ liệu

Đề xuất trung tâm của kỹ thuật mới là các mô hình khuếch tán video từ văn bản (T2V) cần được ‘neo’ vào các khung hình bắt đầu thực sự phù hợp với lời nhắc văn bản mong muốn.

Để đảm bảo mô hình tôn trọng khung hình bắt đầu, phương pháp mới làm gián đoạn quá trình khuếch tán tiêu chuẩn bằng cách tiêm một latent sạch từ hình ảnh neo vào bước thời gian zero, thay thế một trong các đầu vào nhiễu thông thường. Đầu vào không quen thuộc này làm cho mô hình bối rối lúc đầu, nhưng với việc tinh chỉnh LoRA tối thiểu, nó học cách đối xử với khung hình được tiêm như một neo hình ảnh cố định chứ không phải là một phần của đường nhiễu:

Phương pháp hai giai đoạn để gắn kết tạo video từ văn bản với một neo hình ảnh: Trái, mô hình được tinh chỉnh sử dụng một LoRA nhẹ để đối xử với một latent sạch được tiêm như một ràng buộc cảnh cố định. Phải, lời nhắc được chia thành một chú thích khung hình đầu tiên, được sử dụng để tạo ra hình ảnh neo hướng dẫn video.

Tại thời điểm suy luận, phương pháp viết lại lời nhắc để mô tả chỉ khung hình đầu tiên, sử dụng một LLM để trích xuất một trạng thái cảnh ban đầu hợp lý tập trung vào bố cục và ngoại hình.

Lời nhắc được viết lại này được truyền đến một trình tạo hình ảnh để tạo ra một khung hình neo ứng viên (có thể được tinh chỉnh bởi người dùng). Khung hình được chọn được mã hóa thành một latent và tiêm vào quá trình khuếch tán bằng cách thay thế bước thời gian đầu tiên, cho phép mô hình tạo ra phần còn lại của video trong khi vẫn neo vào cảnh ban đầu – một quá trình hoạt động mà không cần thay đổi kiến trúc cơ bản.

Quá trình này được thử nghiệm bằng cách tạo LoRAs cho Wan2.2-14B, Wan2.1-1B, và CogVideo1.5-5B. Việc đào tạo LoRA được thực hiện tại hạng 256, trên 5000 đoạn clip được lấy mẫu ngẫu nhiên từ bộ sưu tập UltraVideo.

Đào tạo kéo dài 6000 bước, và yêu cầu 48 giờ GPU† cho Wan-1B và CogVideo-5B, và 96 giờ GPU cho Wan-14B. Các tác giả lưu ý rằng Wan-5B bản địa hỗ trợ điều kiện văn bản và hình ảnh (điều này trong trường hợp này được áp dụng cho các khung hình cũ hơn), và do đó không cần tinh chỉnh.

Thử nghiệm

Trong các thử nghiệm được thực hiện cho quá trình, mỗi lời nhắc văn bản ban đầu được tinh chỉnh sử dụng Qwen2.5-7B-Instruct, được sử dụng để tạo ra một chú thích hình ảnh ‘hạt giống’ chi tiết chứa mô tả của toàn bộ cảnh. Điều này sau đó được truyền đến QwenImage, được giao nhiệm vụ tạo ra ‘khung hình ma thuật’ để được xen vào quá trình khuếch tán:

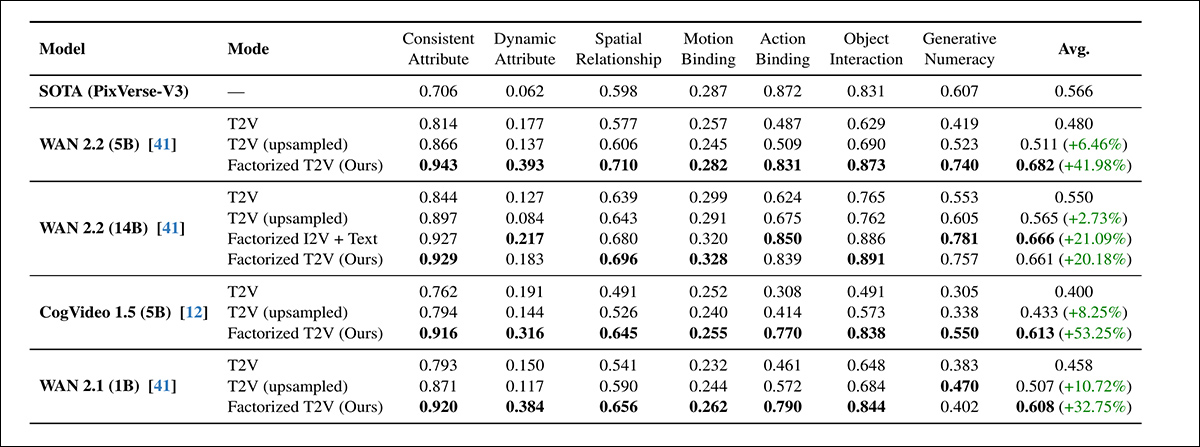

Bảng đánh giá được sử dụng để đánh giá hệ thống bao gồm bảng đánh giá T2V-CompBench đã đề cập, để thử nghiệm sự hiểu biết về thành phần bằng cách đánh giá mức độ mô hình bảo tồn các đối tượng, thuộc tính và hành động trong một cảnh hợp lý; và VBench 2.0, để đánh giá lý luận và sự nhất quán rộng hơn trên 18 chỉ số, được nhóm thành sáng tạo, lý luận thông thường, khả năng kiểm soát, tính trung thực của con người, và vật lý:

Trên tất cả các danh mục đánh giá của T2V-CompBench, phương pháp T2V phân tích đã vượt qua cả baseline T2V tiêu chuẩn và nâng cấp cho mọi mô hình được thử nghiệm, với lợi ích đạt tới 53,25%. Các biến thể đạt điểm cao thường khớp hoặc vượt quá điểm chuẩn PixVerse-V3 độc quyền.

Về vòng thử nghiệm ban đầu này, các tác giả tuyên bố*:

‘[Trên] tất cả các mô hình, thêm một hình ảnh neo nhất quán cải thiện hiệu suất thành phần. Tất cả các mô hình phân tích nhỏ hơn (CogVideo 5B, Wan 5B và Wan 1B) vượt qua mô hình T2V Wan 14B lớn hơn.

‘Phương pháp phân tích Wan 5B của chúng tôi cũng vượt qua baseline PixVerse-V3 thương mại, là mô hình được báo cáo tốt nhất trên bảng đánh giá. Điều này chứng tỏ rằng việc gắn kết hình ảnh thực sự tăng cường sự hiểu biết về cảnh và hành động, ngay cả trong các mô hình có dung lượng nhỏ hơn.

‘Trong mỗi họ mô hình, phiên bản phân tích vượt qua mô hình ban đầu. Đặc biệt, phiên bản LoRA neo nhẹ của chúng tôi trên WAN 14B đạt được hiệu suất so sánh với biến thể I2V 14B được đào tạo trước (0,661 so với 0,666), mặc dù không cần đào tạo lại toàn bộ.’

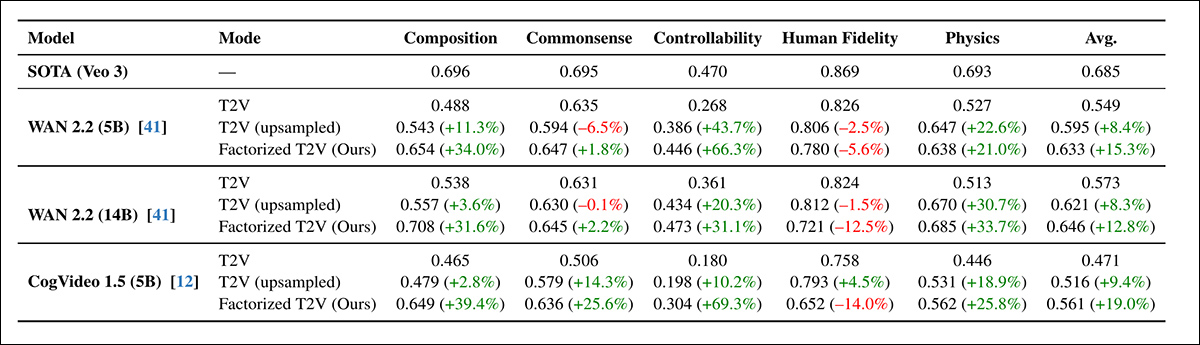

Tiếp theo là vòng VBench2.0:

Phương pháp T2V phân tích nhất quán cải thiện hiệu suất VBench 2.0 trên thành phần, lý luận thông thường, khả năng kiểm soát và vật lý, với một số lợi ích vượt quá 60% – mặc dù tính trung thực của con người vẫn còn dưới baseline Veo 3 độc quyền.

Trên tất cả các kiến trúc, phương pháp phân tích tăng điểm trên mọi danh mục VBench, ngoại trừ human fidelity, đã giảm nhẹ ngay cả với việc lấy mẫu lời nhắc.

WAN 5B vượt qua WAN 14B lớn hơn, củng cố kết quả T2V-CompBench trước đó rằng việc gắn kết hình ảnh đóng góp nhiều hơn cho quy mô.

Mặc dù lợi ích trên VBench nhất quán, chúng nhỏ hơn những gì được thấy trên T2V-CompBench, và các tác giả cho rằng điều này là do chế độ đánh giá nhị phân nghiêm ngặt hơn của VBench.

Đối với các thử nghiệm định tính, bài báo cung cấp hình ảnh tĩnh, nhưng chúng tôi đề cập người đọc đến các video tổng hợp được nhúng trong bài viết này, để có một ý tưởng rõ ràng hơn, với lưu ý rằng các video nguồn có nhiều hơn và đa dạng, cũng như có độ phân giải và chi tiết lớn hơn. Tìm thấy chúng tại đây. Về kết quả định tính, bài báo tuyên bố:

‘Các video neo nhất quán thể hiện thành phần cảnh chính xác hơn, gắn kết đối tượng-Thuộc tính mạnh hơn và tiến trình thời gian rõ ràng hơn.’

Phương pháp phân tích vẫn ổn định ngay cả khi số bước khuếch tán được cắt từ 50 xuống 15, cho thấy gần như không có tổn thất về hiệu suất trên T2V-CompBench. Ngược lại, cả baseline chỉ văn bản và nâng cấp đều suy giảm rõ rệt trong cùng điều kiện.

Mặc dù việc giảm bước có thể lý thuyết tăng tốc gấp ba, toàn bộ đường ống tạo sinh chỉ trở nên nhanh hơn 2,1 lần trong thực tế, do các chi phí cố định từ việc tạo hình ảnh neo. Tuy nhiên, kết quả cho thấy rằng việc neo không chỉ cải thiện chất lượng mẫu mà còn giúp ổn định quá trình khuếch tán, hỗ trợ tạo sinh nhanh hơn và hiệu quả hơn mà không mất đi độ chính xác.

Trang web dự án cung cấp các ví dụ về việc tạo sinh với mẫu nâng cấp so với phương pháp mới, trong đó chúng tôi cung cấp một số (độ phân giải thấp hơn) ví dụ được chỉnh sửa ở đây:

Nhấn để phát (không có âm thanh). Nguồn bắt đầu được lấy mẫu so với phương pháp phân tích của các tác giả.

Các tác giả kết luận:

‘Kết quả của chúng tôi cho thấy rằng việc gắn kết cải thiện, thay vì chỉ tăng khả năng, có thể quan trọng như nhau. Những tiến bộ gần đây trong khuếch tán T2V đã phụ thuộc nhiều vào việc tăng kích thước mô hình và dữ liệu đào tạo, nhưng ngay cả các mô hình lớn cũng thường gặp khó khăn trong việc suy diễn một cảnh ban đầu hợp lý từ văn bản alone.

‘Điều này trái ngược với khuếch tán hình ảnh, nơi việc tăng quy mô tương đối đơn giản; trong các mô hình video, mỗi cải tiến kiến trúc phải hoạt động trên một chiều thời gian bổ sung, khiến việc tăng quy mô trở nên tốn tài nguyên hơn nhiều.

‘Các phát hiện của chúng tôi cho thấy rằng việc gắn kết cải thiện có thể bổ sung cho quy mô bằng cách giải quyết một nút thắt khác: thiết lập cảnh đúng trước khi tổng hợp thời gian bắt đầu.

‘Bằng cách phân tích tạo video thành thành phần cảnh và mô hình thời gian, chúng tôi giảm thiểu một số chế độ thất bại phổ biến mà không cần các mô hình lớn hơn đáng kể. Chúng tôi xem đây là một nguyên tắc thiết kế bổ sung có thể hướng dẫn các kiến trúc tương lai hướng tới tổng hợp video đáng tin cậy và có cấu trúc hơn.’

Kết luận

Mặc dù các vấn đề về sự kết hợp rất thực, và có thể yêu cầu các giải pháp chuyên dụng (như cải thiện việc kiểm tra và đánh giá phân phối trước khi đào tạo), nó đã là một điều mở mắt khi xem việc phân tích ‘unglue’ một số sắp xếp lời nhắc khái niệm cứng đầu và ‘dính’ thành các bản kết xuất chính xác hơn nhiều – với chỉ một lớp điều kiện LoRA vừa phải, và sự can thiệp của một hình ảnh bắt đầu / hạt giống được cải thiện đáng kể.

Khoảng cách về tài nguyên giữa suy luận nghiệp dư cục bộ và các giải pháp thương mại có thể không lớn như tưởng, vì hầu hết các nhà cung cấp đều đang cố gắng hợp lý hóa chi phí tài nguyên GPU đáng kể của họ cho người tiêu dùng.

Một cách tình cờ, một số lượng lớn các nhà cung cấp video tạo sinh hiện tại dường như đang sử dụng các phiên bản được thương hiệu và ‘nâng cấp’ của các mô hình mã nguồn mở của Trung Quốc. ‘Hào môn’ chính mà bất kỳ hệ thống ‘trung gian’ nào dường như có là họ đã mất công đào tạo LoRAs, hoặc – với chi phí cao hơn và phần thưởng cao hơn – thực sự tiến hành tinh chỉnh đầy đủ trọng số mô hình††.

Những hiểu biết như vậy có thể giúp thu hẹp khoảng cách đó hơn nữa, trong bối cảnh một cảnh phát hành nơi người Trung Quốc dường như quyết tâm (không nhất thiết vì lý do vị tha hoặc lý tưởng) để dân chủ hóa AI tạo sinh, trong khi các lợi ích kinh doanh phương Tây có thể thích rằng việc tăng kích thước mô hình và quy định cuối cùng sẽ khiến bất kỳ mô hình thực sự tốt nào bị cloister sau các API, và nhiều lớp lọc nội dung.

* Đặt nặng của tác giả, không phải của tôi.

† Bài báo không chỉ định GPU nào được chọn, hoặc bao nhiêu được sử dụng.

†† Mặc dù con đường LoRA có khả năng hơn, cả về sự tiện lợi trong sử dụng và vì trọng số đầy đủ, chứ không phải trọng số lượng hóa, không luôn có sẵn.

Được xuất bản lần đầu vào Thứ Sáu, ngày 19 tháng 12 năm 2025