Yapay Zeka

UniTune: Google'ın Alternatif Nöral Görüntü Düzenleme Tekniği

Görünüşe göre Google Araştırması, metin tabanlı görüntü düzenlemeye birkaç cepheden saldırıyor ve muhtemelen neyin 'alacağını' görmek için bekliyor. Bu haftaki sürümünün izinde sıcak hayali kağıt, arama devi, metin komutları aracılığıyla görüntüler üzerinde başka türlü imkansız olan yapay zeka tabanlı düzenlemeleri gerçekleştirmek için ek bir gizli difüzyon tabanlı yöntem önerdi. UniTune.

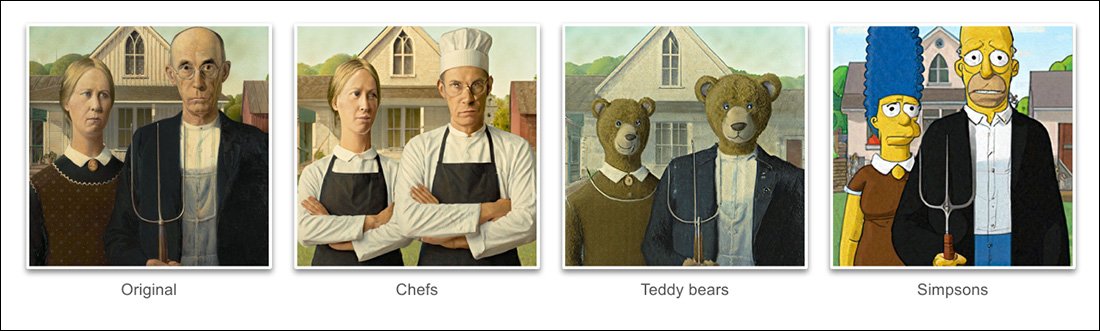

Projede verilen örneklere göre yeni kağıt, UniTune, olağanüstü derecede çözülme gerçek sabit görüntü içeriğinden anlamsal poz ve fikir:

UniTune'un semantik kompozisyon hakimiyeti olağanüstü. Resimlerin en üst sırasındaki iki kişinin yüzlerinin, kaynak görüntünün geri kalanındaki (sağda) olağanüstü dönüşümle nasıl bozulmadığına dikkat edin. Kaynak: https://arxiv.org/pdf/2210.09477.pdf

Kararlı Difüzyon hayranlarının şimdiye kadar öğrenmiş olacağı gibi, görüntünün geri kalanını olumsuz bir şekilde değiştirmeden bir resmin kısmi bölümlerine düzenlemeler uygulamak zor, bazen imkansız bir işlem olabilir. gibi popüler dağıtımlar olsa da OTOMATİK1111 yerel ve kısıtlı düzenlemeler için maskeler oluşturabilir, süreç dolambaçlıdır ve sıklıkla öngörülemez.

En azından bir bilgisayarlı görme uygulayıcısı için bariz cevap, araya bir görüntü katmanı eklemektir. anlamsal bölümleme Bu, kullanıcı müdahalesi olmadan bir görüntüdeki nesneleri tanıma ve izole etme yeteneğine sahiptir ve gerçekten de son zamanlarda bu düşünce doğrultusunda birkaç yeni girişim olmuştur.

Başka olasılık Dağınık ve karışık nöral görüntü düzenleme operasyonlarını kilitlemek, OpenAI'nin etkili Kontrast Dil-Görüntü Ön Eğitiminden (CLIPDALL-E 2 ve Stable Diffusion gibi gizli difüzyon modellerinin kalbinde yer alan ) modülü, metinden görüntüye modelin yorumlanmış bir işlemeyi kullanıcıya geri göndermeye hazır olduğu noktada bir filtre görevi görür. . Bu bağlamda, CLIP bir gözcü ve kalite kontrol modülü olarak hareket etmeli, hatalı biçimlendirilmiş veya başka bir şekilde uygun olmayan işlemeleri reddetmelidir. Bu kurulmak üzere (Discord bağlantısı) Stability.ai'nin DreamStudio API güdümlü portalında.

Bununla birlikte, CLIP böyle bir senaryoda tartışmasız hem suçlu hem de çözüm olduğundan (çünkü esas olarak görüntünün geliştirilme şeklini de bilgilendirmiştir) ve donanım gereksinimleri yerel olarak bir son kullanıcının kullanabileceğini aşabileceğinden, bu yaklaşım ideal olmayabilir.

Sıkıştırılmış Dil

Önerilen UniTune bunun yerine mevcut bir difüzyon modeline - bu durumda, Google'ın kendi Imagen'ine - ince ayar yapar, ancak araştırmacılar yöntemin diğer gizli difüzyon mimarileriyle uyumlu olduğunu belirtir - böylece ona çağrılabilecek benzersiz bir belirteç enjekte edilir. bir metin istemine dahil ederek.

Görünürde, bu kulağa Google gibi geliyor rüya kabini, şu anda Stable Diffusion hayranları ve geliştiricileri arasında bir saplantı olan ve yalnızca bir avuç kaynak resme dayalı olarak genellikle bir saatten daha kısa bir sürede mevcut bir kontrol noktasına yeni karakterler veya nesneler enjekte edebilen; ya da başka Metin Tersine Çevirme, bir kontrol noktası için 'sepet' dosyaları oluşturur, bunlar daha sonra orijinal olarak modele eğitilmiş gibi ele alınır ve metin sınıflandırıcısını değiştirerek modelin kendi geniş kaynaklarından yararlanarak küçük bir dosyaya neden olur ( DreamBooth'un minimum 2 GB budanmış kontrol noktaları).

Aslında araştırmacılar, UniTune'un bu iki yaklaşımı da reddettiğini iddia ediyor. Metin Tersine Çevirmenin çok fazla önemli ayrıntıyı atladığını, DreamBooth'un ise "Daha kötü performans gösterdi ve daha uzun sürdü" sonunda kararlaştırdıkları çözümden daha fazla.

Yine de UniTune, DreamBooth ile aynı kapsüllenmiş semantik 'metaprompt' yaklaşımını kullanır ve eğitimli değişiklikler, eğitmen tarafından seçilen benzersiz kelimelerle çağrılır ve şu anda zahmetli bir şekilde eğitilmiş bir genel sürüm modelinde var olan herhangi bir terimle çakışmaz.

"Düzenleme işlemini gerçekleştirmek için, ince ayarlı modelleri "[rare_tokens] edit_prompt" istemiyle örnekliyoruz (örneğin, "restoranda iki köpek beikkpic" veya "bir minyon beikkpic").'

Süreç

Nihai işlevsellikleri açısından neredeyse aynı iki makalenin Google'dan neden aynı hafta içinde gelmesi şaşırtıcı olsa da, iki girişim arasındaki çok sayıda benzerliğe rağmen, UniTune ve Imagic arasında en az bir açık fark vardır - ikincisi, görüntü düzenleme işlemlerine rehberlik etmek için 'sıkıştırılmamış' doğal dil istemlerini kullanırken, UniTune benzersiz DreamBooth tarzı belirteçlerle eğitim yapar.

Bu nedenle, Imagic ile düzenleme yapıyorsanız ve bu türden bir dönüşüm gerçekleştirmek istiyorsanız…

UniTune makalesinden - UniTune, kendisini Google'ın favori rakibi sinirsel düzenleme çerçevesi SDEdit'e karşı konumlandırıyor. UniTune'un sonuçları en sağda, tahmin edilen maske ise soldan ikinci resimde görülüyor.

.. Imagic'te girdiniz "arka planda sevimli tüylü bir canavar olarak oturan üçüncü kişi".

Eşdeğer UniTune komutu şöyle olacaktır: "[x] olarak arkadaki adam", Burada x tüylü canavar karakteriyle ilişkilendirilen ince eğitimli konsepte bağlı olan her ne kadar garip ve benzersiz kelime.

Birçok pozda komut verilebilecek derin sahte stilde bir soyutlama oluşturmak amacıyla DreamBooth veya Textual Inversion'a çok sayıda görüntü beslenirken, hem UniTune hem de Imagic bunun yerine sisteme tek bir görüntü - orijinal, bozulmamış görüntü - besler.

Bu, son birkaç yılın GAN tabanlı düzenleme araçlarının birçoğunun çalışma biçimine benzer - bir girdi görüntüsünü GAN'ın gizli alanındaki gizli kodlara dönüştürerek ve ardından bu kodları adresleyerek ve onları gizli alanın diğer bölümlerine göndererek. değişiklik alanı (örneğin, siyah saçlı genç bir kişinin resmini girmek ve bunu 'yaşlı' veya 'sarışın' ile ilişkili gizli kodlar aracılığıyla yansıtmak vb.).

Bununla birlikte, bir difüzyon modelinde ve bu yöntemle sonuçlar, kıyaslandığında oldukça şaşırtıcı derecede doğrudur ve çok daha az belirsizdir:

İnce Ayar Süreci

UniTune yöntemi, orijinal görüntüyü, modele eğitilmiş mevcut verilerin geniş havuzlarını kullanarak nasıl değiştirileceğine ilişkin bir dizi talimatla birlikte bir difüzyon modeli aracılığıyla gönderir. Aslında, bunu şu anda Stable Difusion's ile yapabilirsiniz. img2img işlevsellik – ancak görüntünün korumayı tercih ettiğiniz kısımlarını çarpıtmadan veya bir şekilde değiştirmeden.

UniTune işlemi sırasında, sistem ince ayard, yani UniTune, modeli, katmanlarının çoğu donmamış halde eğitime devam etmeye zorlar (aşağıya bakın). Çoğu durumda, ince ayar, genel genel Yaratılması veya geliştirilmesi istenen başka bir özelliğin enjekte edilmesi veya rafine edilmesi lehine, zor kazanılmış yüksek performanslı bir modelin kayıp değerleri.

Bununla birlikte, UniTune ile, üzerinde işlem yapılan model kopyası, birkaç gigabayt veya daha fazla ağırlığa sahip olsa da, tek kullanımlık bir teminat 'kabuğu' olarak değerlendirilecek ve sürecin sonunda tek bir amaca hizmet ederek atılacak gibi görünüyor. Bu tür gündelik veri tonajı, kendi modelleri budanmış olsa bile konu başına 2 GB'tan az olmayan DreamBooth hayranları için günlük bir depolama krizi haline geliyor.

Imagic'te olduğu gibi, UniTune'daki ana ayar, Imagen'deki üç katmanın alt ikisinde gerçekleşir (taban 64px, 64px>256px ve 256px>1024px). Imagic'ten farklı olarak, araştırmacılar bu son ve en büyük süper çözünürlüklü katman için de ayarlamayı optimize etmede bir miktar potansiyel değer görüyorlar (henüz denememiş olsalar da).

En düşük 64 piksellik katman için model, eğitim sırasında temel görüntüye doğru eğilimlidir; sisteme 128'lük bir toplu iş boyutunda 4 yineleme için birden çok yinelenen görüntü/metin çifti beslenir ve Adafaktör 0.0001 öğrenme hızında çalışan kayıp fonksiyonu olarak. rağmen T5 kodlayıcı tek başına bu ince ayar sırasında donar, Imagen'in ilk eğitimi sırasında da donar

Yukarıdaki işlem daha sonra Imagen'in orijinal eğitiminde kullanılan aynı gürültü artırma prosedürü kullanılarak 64>256px katmanı için tekrarlanır.

Örnekleme

Yapılan değişikliklerin ince ayarlı modelden çıkarılabileceği, Sınıflandırıcı Ücretsiz Kılavuz dahil olmak üzere birçok olası örnekleme yöntemi vardır (CFG), Kararlı Difüzyonun da dayanak noktası. CFG temel olarak, modelin 'hayal gücünü takip etme' ve işleme olanaklarını keşfetme konusunda ne ölçüde özgür olduğunu veya daha düşük ayarlarda, girdi kaynağı verilerine ne ölçüde uyması ve daha az kapsamlı veya dramatik değişiklikler yapması gerektiğini tanımlar. .

Metin Tersine Çevirme gibi (DreamBooth'ta biraz daha az), UniTune, orijinal görüntülere farklı grafik stilleri ve daha fazla fotogerçekçi düzenleme uygulamaya uygundur.

Araştırmacılar ayrıca deneyler yaptılar. SDDüzenleSistemin başlangıçtan itibaren yalnızca kısmen 'gürültü' olarak, bunun yerine temel özelliklerini koruyarak orijinal ayrıntıları korumaya teşvik edildiği 'geç başlangıç' tekniği. Araştırmacılar bunu yalnızca katmanların en altında (64 piksel) kullansalar da, bunun gelecekte faydalı bir ek örnekleme tekniği olabileceğine inanıyorlar.

Araştırmacılar ayrıca yararlandı istemden isteme modeli koşullandırmak için ek bir metin tabanlı teknik olarak:

"İleti istemi" ayarında, İstemi Yönlendirme olarak adlandırdığımız bir tekniğin, aslına uygunluğu ve ifadeyi ayarlamak için özellikle yararlı olduğunu bulduk.

İstem Yönlendirmesi, temelin koşulsuz model yerine farklı bir bilgi istemi olması dışında, Sınıflandırıcı Serbest Yönlendirmeye benzer. Bu, modeli iki bilgi istemi arasındaki deltaya doğru yönlendirir.'

Bununla birlikte, yazarların belirttiği gibi, hızlı yönlendirme yalnızca CFG'nin istenen sonucu elde edemediği durumlarda ara sıra gerekliydi.

UniTune'un geliştirilmesi sırasında karşılaşılan bir diğer yeni örnekleme yaklaşımı, interpolasyon, burada görüntünün alanları, hem orijinal hem de değiştirilmiş görüntünün kompozisyonda çok benzer olmasına ve daha 'naif' bir enterpolasyonun kullanılmasına izin verecek kadar belirgindir.

İnterpolasyon, dönüştürülecek alanların ayrık ve sınırları iyi belirlenmiş olduğu durumlarda, UniTune'un daha yüksek efor gerektiren işlemlerini gereksiz hale getirebilir.

Yazarlar, enterpolasyonun potansiyel olarak çok sayıda hedef kaynak görüntü için o kadar iyi çalışabileceğini ve bunun varsayılan bir ayar olarak kullanılabileceğini öne sürüyorlar ve ayrıca karmaşık tıkanıklıkların olmadığı durumlarda olağanüstü dönüşümleri etkileme gücüne sahip olduğunu gözlemliyorlar. daha yoğun yöntemlerle müzakere edilmesi gerekir.

UniTune, düzenleme maskeleri olsun ya da olmasın yerel düzenlemeleri gerçekleştirebilir, ancak alışılmadık bir yorumlama gücü ve kaynak giriş verilerinin güçlü özselleştirme kombinasyonu ile düzenlemelerin nereye yerleştirileceğine tek taraflı olarak karar verebilir:

İkinci sütundaki en üstteki görüntüde, 'arka plana kırmızı bir tren' eklemekle görevli UniTune, onu uygun ve otantik bir konuma yerleştirdi. Diğer örneklerde, görüntülerin piksel içeriğindeki ve temel stillerindeki olağanüstü değişikliklerin ortasında bile kaynak görüntünün anlamsal bütünlüğünün nasıl korunduğuna dikkat edin.

Gecikme

Her ne kadar yeni bir sistemin ilk yinelemesi yavaş olsa da ve topluluk katılımının veya kurumsal bağlılığın (genellikle her ikisi de değildir) sonunda kaynak ağırlıklı bir rutini hızlandırıp optimize etmesi mümkün olsa da, hem UniTune hem de Imagic bazı performanslar sergiliyor. Bu harika düzenlemeleri oluşturmak için oldukça büyük makine öğrenimi manevraları gerekiyor ve kaynağa bu kadar aç bir sürecin, API odaklı erişim yerine (gerçi ikincisi Google için daha çok tercih edilebilir) ev içi kullanıma ne ölçüde küçültülebileceği şüpheli. ).

Şu anda, bir T3 GPU'da girdiden sonuca gidiş-dönüş yaklaşık 4 dakikadır ve çıkarım için yaklaşık 30 saniye ekstradır (herhangi bir çıkarım rutinine göre). Yazarlar, bunun yüksek bir gecikme süresi olduğunu ve neredeyse 'etkileşimli' olarak nitelendirilmediğini kabul ediyor, ancak aynı zamanda, modelin başlangıçta ayarlandıktan sonra, kullanıcı işlemi bitirene kadar daha fazla düzenleme için kullanılabilir durumda kaldığını ve bu da düzenleme başına zamanı azaltıyor. .

İlk olarak 21 Ekim 2022'de yayınlandı.