Yapay Zeka

OpenAI'nin GPT-4o'su: İnsan-Makine Etkileşimini Dönüştüren Multimodal Yapay Zeka Modeli

OpenAI şimdiye kadarki en yeni ve en gelişmiş dil modelini yayınladı - GPT-4o"Omni”modeli. Bu devrim niteliğindeki yapay zeka sistemi, insan ve yapay zeka arasındaki çizgiyi bulanıklaştıran yeteneklerle ileriye doğru dev bir atılımı temsil ediyor.

GPT-4o'nun kalbinde, metin, ses, görüntü ve video içeriklerini sorunsuz bir şekilde işlemesine ve oluşturmasına olanak tanıyan yerel çok modlu yapısı yatmaktadır. Birden fazla yöntemin tek bir modelde entegrasyonu, türünün ilk örneği olup, yapay zeka asistanlarıyla etkileşim şeklimizi yeniden şekillendirmeyi vaat ediyor.

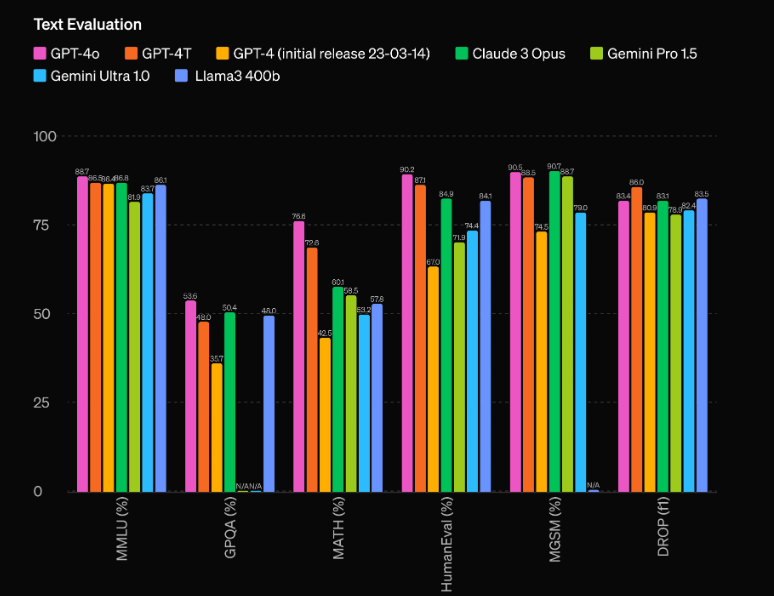

Ancak GPT-4o, çok modlu bir sistemden çok daha fazlasıdır. Önceki GPT-4'e göre şaşırtıcı bir performans artışına sahip ve Gemini 1.5 Pro, Claude 3 ve Llama 3-70B gibi rakip modelleri toz içinde bırakıyor. Bu yapay zeka modelini gerçekten çığır açıcı kılan şeyin ne olduğuna daha derinlemesine bakalım.

Eşsiz Performans ve Verimlilik

GPT-4o'nun en etkileyici yönlerinden biri benzeri görülmemiş performans yetenekleridir. OpenAI'nin değerlendirmelerine göre model, bir önceki en iyi performans gösteren GPT-60 Turbo'ya göre 4 Elo puanlık kayda değer bir farka sahip. Bu önemli avantaj, GPT-4o'yu başlı başına bir lige yerleştiriyor ve şu anda mevcut olan en gelişmiş yapay zeka modellerini bile gölgede bırakıyor.

Ancak GPT-4o'nun parladığı tek alan ham performans değil. Model ayrıca GPT-4 Turbo'nun iki katı hızda çalışırken, çalıştırma maliyetinin yalnızca yarısı kadar olmasıyla etkileyici bir verimliliğe sahiptir. Üstün performans ve maliyet etkinliğinin bu birleşimi, GPT-4o'yu, en son yapay zeka yeteneklerini uygulamalarına entegre etmek isteyen geliştiriciler ve işletmeler için son derece çekici bir teklif haline getiriyor.

Çok Modlu Yetenekler: Metin, Ses ve Görüntüyü Harmanlama

Belki de GPT-4o'nun en çığır açıcı yönü, metin, ses ve görüntü de dahil olmak üzere birden fazla modda içeriği sorunsuz bir şekilde işlemesine ve oluşturmasına olanak tanıyan yerel çok modlu yapısıdır. Birden fazla yöntemin tek bir modelde entegrasyonu, türünün ilk örneği ve yapay zeka asistanlarıyla etkileşim şeklimizde devrim yaratmayı vaat ediyor.

GPT-4o ile kullanıcılar, modelin ses girişlerini anında tanıyıp yanıt vermesiyle konuşmayı kullanarak doğal, gerçek zamanlı görüşmelere katılabilir. Ancak yetenekleri burada bitmiyor; GPT-4o aynı zamanda görsel içeriği de yorumlayıp üretebiliyor ve görüntü analizi ve oluşturulmasından videonun anlaşılması ve oluşturulmasına kadar çeşitli uygulamalar için bir olasılıklar dünyasının kapılarını açıyor.

GPT-4o'nun çok modlu yeteneklerinin en etkileyici kanıtlarından biri, bir sahneyi veya görüntüyü gerçek zamanlı olarak analiz etme, algıladığı görsel öğeleri doğru bir şekilde tanımlama ve yorumlama yeteneğidir. Bu özelliğin, görme engellilere yönelik yardımcı teknolojiler gibi uygulamaların yanı sıra güvenlik, gözetim ve otomasyon gibi alanlarda da derin etkileri vardır.

Ancak GPT-4o'nun çok modlu yetenekleri, farklı yöntemlerde içerik oluşturmanın ve anlamanın ötesine geçer. Model aynı zamanda bu yöntemleri kusursuz bir şekilde harmanlayarak gerçekten sürükleyici ve ilgi çekici deneyimler yaratabilir. Örneğin, OpenAI'nin canlı demosu sırasında GPT-4o, dil anlayışını, müzik teorisini ve ses üretimini uyumlu ve etkileyici bir çıktıda harmanlayarak giriş koşullarına dayalı bir şarkı oluşturmayı başardı.

Python kullanarak GPT0'ı kullanma

import openai

# Replace with your actual API key

OPENAI_API_KEY = "your_openai_api_key_here"

# Function to extract the response content

def get_response_content(response_dict, exclude_tokens=None):

if exclude_tokens is None:

exclude_tokens = []

if response_dict and response_dict.get("choices") and len(response_dict["choices"]) > 0:

content = response_dict["choices"][0]["message"]["content"].strip()

if content:

for token in exclude_tokens:

content = content.replace(token, '')

return content

raise ValueError(f"Unable to resolve response: {response_dict}")

# Asynchronous function to send a request to the OpenAI chat API

async def send_openai_chat_request(prompt, model_name, temperature=0.0):

openai.api_key = OPENAI_API_KEY

message = {"role": "user", "content": prompt}

response = await openai.ChatCompletion.acreate(

model=model_name,

messages=[message],

temperature=temperature,

)

return get_response_content(response)

# Example usage

async def main():

prompt = "Hello!"

model_name = "gpt-4o-2024-05-13"

response = await send_openai_chat_request(prompt, model_name)

print(response)

if __name__ == "__main__":

import asyncio

asyncio.run(main())

Sahibim:

- Özel bir sınıf kullanmak yerine openai modülünü doğrudan içe aktardım.

- openai_chat_resolve işlevini get_response_content olarak yeniden adlandırdık ve uygulamasında bazı küçük değişiklikler yaptık.

- AsyncOpenAI sınıfı, OpenAI Python kitaplığı tarafından sağlanan resmi eşzamansız yöntem olan openai.ChatCompletion.acreate işleviyle değiştirildi.

- send_openai_chat_request işlevinin nasıl kullanılacağını gösteren örnek bir ana işlev eklendi.

Kodun doğru çalışması için "your_openai_api_key_here" ifadesini gerçek OpenAI API anahtarınızla değiştirmeniz gerektiğini lütfen unutmayın.