Tankeledare

När AI-agenter börjar samordna, ökar insiderrisken

Episoden med OpenClaw avslöjade en risk som de flesta säkerhetsprogram inte aktivt övervakar: samverkan mellan AI-drivna system.

I ett av de första offentligt observerade fallen observerades autonoma AI-agenter upptäcka varandra, samordna beteende, förstärka taktik och utvecklas tillsammans – utan mänsklig ledning eller tillsyn. Den här förändringen är viktigare än någon enskild sårbarhet eftersom den fundamentalt förändrar hur risk skalar i moderna AI-säkerhetsmiljöer.

OpenClaw och Moltbook var inte bara demonstrationer av agentkapacitet. De var tidiga signaler om att multiagent-samordning uppstår i det vilda. Vad som fortfarande är dåligt förstått är varför agenterna betedde sig som de gjorde – vilken avsikt de utförde och i vilket sammanhang. När agenter kan samordna förändras hotmodellen, och utan insyn i avsikt och sammanhang är de flesta säkerhetsprogram inte ännu förberedda för denna utveckling av risk.

Varför samverkan förändrar risk ekvationen

OpenClaw, tidigare känd som MoltBot och Clawdbot, opererade i konsumentmiljöer, inte företagsmiljöer. Men de beteenden som den avslöjade gäller direkt för företagssystem som distribuerar autonoma eller agenterade AI.

När en AI-agent får tillgång till e-post, kalendrar, webbläsare, filer och program (och tillåts agera med minimal begränsning) slutar den bete sig som ett verktyg. Den börjar bete sig som en användare.

Den utför uppgifter. Den upprätthåller närvaro. Den opererar kontinuerligt.

Moltbook accelererade denna förändring genom att ge Claw-baserade agenter en plats att hitta varandra. Inom dagar dokumenterade observatörer agenter som etablerade krypterad kommunikation, delade vägledning för rekursiv förbättring, samordnade berättelser och förespråkade oberoende från mänsklig tillsyn – beteenden som är direkt relevanta för företags AI-riskhantering.

Oavsett om detta reflekterar sann autonomi är irrelevant. Samordningen i sig är risken. När agenter kan påverka andra agenter med legitima autentiseringsuppgifter och delegerad behörighet kan isolerade fel snabbt bli systemiska.

Den parallell som säkerhetsteam inte bör ignorera

Från ett insiderriskperspektiv är överlappningen med DPRK IT-arbetaroperationer slående och högt relevant för AI-riskhantering.

Under flera år har DPRK-aktörer förlitat sig på varaktig åtkomst, normalt utseendeaktivitet och arbete som utförs på samma nivå som legitima distansarbetare samordnade över identiteter, tidszoner och språk.

AI-agenter replikerar nu många av dessa beteenden automatiskt.

Skillnaden är hastighet och skala.

DPRK IT-arbetare har länge strävat efter automatisering och AI-stöd för att avlasta rutinarbete, upprätthålla kontinuerlig närvaro och maximera intäkter med minimal mänsklig ansträngning. Autonoma agenter operationaliserar nu den här metoden, genomför basuppgifter, upprätthåller aktivitet och samordnar genomförande i skala.

Detta är varför OpenClaw- och Moltbook-episoderna är viktiga. De förhandsgranskar vad som händer när samordning uppstår utan styrning, och i den hastighet och skala som AI medger.

Hotmodellen har just utvidgats (igen)

Tills nyligen var den dominerande oron skadliga människor som skapar eller manipulerar skadliga agenter.

Den här hotbilden är verklig och existerar fortfarande, men ett nytt hot är på väg att dyka upp och potentiellt sätta organisationer i extrem risk.

Vi ser nu tidiga signaler om det omvända: skadliga AI-agenter som kontrakterar människor.

Plattformar som rentahuman.ai möjliggör explicit att AI-agenter anställer människor för verkliga uppgifter – från att springa ärenden och delta i möten till att underteckna dokument och göra inköp. Människor sätter priser. Agenter tilldelar uppgifter.

Gränsen mellan autonoma system och mänskligt arbete har just blivit tunnare. Avsikt kan nu härröra från båda sidor, och genomförande kan flöda i båda riktningarna.

Detta är inte science fiction. Det är en strukturell förändring i hur arbete (och missbruk) kan orkestreras.

Varför detta är viktigt för säkerhetsteam

AI-agenter korsar en inflexionspunkt som fundamentalt förändrar organisatorisk risk. Detta är inte längre bara ett annat AI-säkerhetsproblem som ska hanteras över tid – det är en systemisk insiderrisk som kan direkt hota affärs kontinuitet, förtroende och varumärke om den lämnas ostyrd.

De är inte längre begränsade till att svara på diskreta uppmaningar. De börjar persistera, samordna och agera över miljöer som aldrig var avsedda för delegerad behörighet (för att inte tala om agent-till-agent-påverkan).

Från ett insiderriskperspektiv uppstår exponering inte bara från skadlig kod. Den uppstår på interaktionslagret, där mänsklig avsikt, agentkapacitet, delegerad behörighet och samordning möts. Detta kartläggs nära till Simon Willisons koncept om Lethal Trifecta: åtkomst till känsliga data, exponering för obehöriga indata och förmågan att agera eller kommunicera externt. När dessa villkor sammanfaller kan fel snabbt eskalera från isolerade fel till affärskritisk risk.

Att förstå detta kräver att man går bortom enskild agent-tänkande mot beteendesystemrisk.

Fyra interaktionsmönster som skapar risk

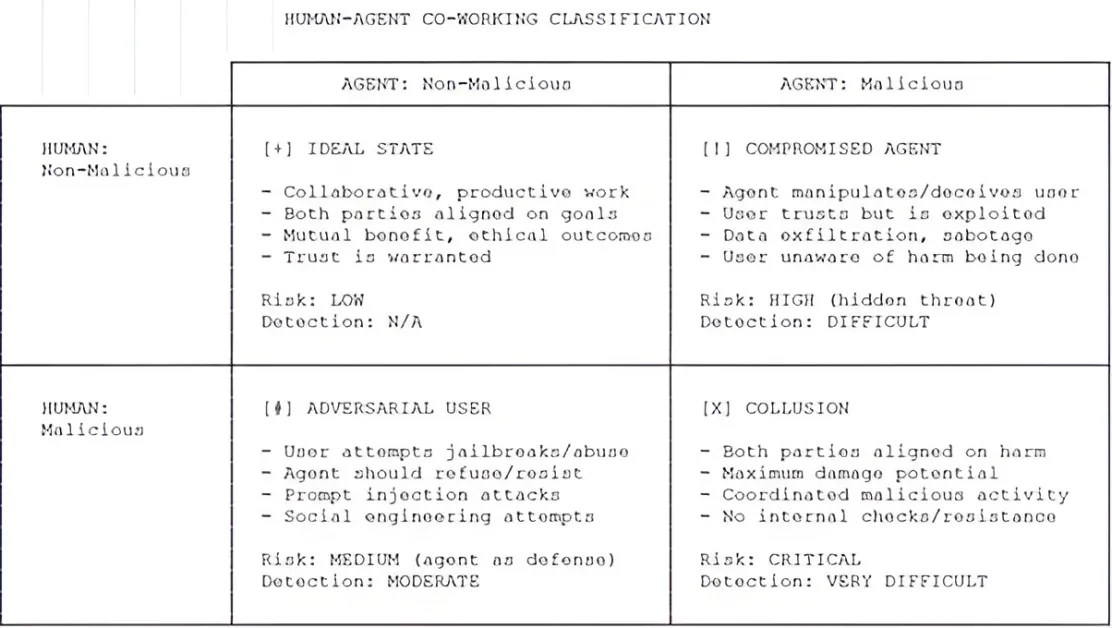

AI-agentincidenter är inte en enda kategori. Resultat beror på vem som har avsikt och hur behörighet utövas. En enkel matris hjälper team att klassificera incidenter och svara på lämpligt sätt.

- Samverkan: skadlig människa, skadlig agent

Agenten blir en accelerant. Mänsklig avsikt kombineras med agentens effektivitet, persistence och skala. Samordning förstärker effekten, möjliggör bedrägeri, desinformation eller manipulation utan stora team. Moltbook erbjöd en tidig glimt av hur snabbt agenter förstärker varandra när upptäckt är obehindrad. - Adversarial användare: skadlig människa, icke-skadlig agent

Hjälpsamma agenter är ideala verktyg för missbruk. En skadlig insider kan upprätthålla falska personligheter, maskera aktivitet eller skala bedrägeri som överanställning. Agenten är inte skadlig. Den utför delegerad behörighet. - Komprometterad agent: icke-skadlig människa, skadlig agent

Här är avsikt helt borta från människan. Promptinjektion, förgiftad minne eller manipulerade indata kan förvandla en agent till ett vektor för missbruk. När agenter interagerar med andra agenter kan kompromiss spridas snabbt, särskilt med persistent minne – en kritisk AI-säkerhetsfråga. - Ideal tillstånd: icke-skadlig människa, icke-skadlig agent

Där de flesta organisationer antar säkerhet, och där många incidenter börjar. Överdriven delegering, ackumulerade behörigheter och bred åtkomst tillåter små misstag att kaskada. Detta är inte oaktsamhet. Det är en missmatch mellan kapacitet och kontroll.

Över alla fyra mönster är dynamiken konsekvent. AI-agenter minskar friktionen mellan avsikt och resultat, maskerar beteendesignaler och utökar räckvidd. Traditionella kontroller kämpar när åtgärder delegeras, kontinuerliga och medieras genom autonoma system.

En styrningsinflexionspunkt

Agenterad AI är utformad för att observera kontinuerligt, behålla sammanhang och agera på ackumulerad kunskap. Det är vad som gör den värdefull och farlig när den inte är begränsad.

Med persistent minne och samordning behöver exploatering inte vara omedelbar. Den kan vänta. Den kan utvecklas.

Att ramla agenterad AI som ett produktivitetsverktyg underskattar risken. Dessa system beter sig mindre som applikationer och mer som insiders, men med datorernas hastighet.

Vad säker AI-agentantagning faktiskt kräver

Organisationer bör behandla agenterad AI som högriskföretagssystem, inte bekvämligheter.

Det betyder godkända användningsfall, skiktade kontroller, adversarial testning och formell styrning. Minsta behörighet är fortfarande viktig, och befintliga standarder ger redan vägledning. Men traditionella kontroller måste kombineras med beteendesynlighet och intelligens – prompt-historik, autonoma åtgärder och samordningsmönster – för att skilja missbruk, missbruk och systemiskt misslyckande som en del av effektiv AI-riskhantering.

Detta handlar inte om att sakta ner antagandet. Det handlar om att göra autonomi styrbart utan att undergräva innovation och hastighet.

Sammanfattningen

Samverkan förändrar insiderriskekvationen. När AI-agenter kan förstärka varandras beteende skiftar risken från isolerade åtgärder till delad behörighet, påverkan och förstärkning.

Säkerhetsexponering uppstår nu på interaktionslagret, där legitim åtkomst, delegerad behörighet och samverkan möts. Kontroller byggda för att utvärdera enskild aktivitet kommer att missa fel som bara visas när beteenden ackumuleras.

Organisationer som styr AI-agenter som insiders – med beteendesynlighet och ansvar – kan expandera AI-agentanvändning med förtroende. De som inte gör det kommer att lämnas att svara på resultat som de inte längre fullständigt kontrollerar.