Tankeledare

En injektionsattack som man inte kan förhindra: Önsketänkande eller verklig oro?

I den här artikeln vill jag engagera läsaren i ett tankeexperiment. Jag ska argumentera för att en viss typ av injektionsattack i framtiden kommer att vara effektivt oförhindrad. Mitt argument kommer att vara mer spekulativt än konkret, så jag försöker inte övertyga dig om någonting. Istället bjuder jag in dig att utforska dessa tankar. Innan jag börjar, som varje övertygande författare skulle göra, vill jag diskutera schack och schackmotorer.

Övermänskliga schackmotorer och en påstående om mänsklig erfarenhet

En av de trevligare aspekterna av schack som saknas i andra discipliner är förmågan att objektivt mäta en spelares kvalitet eller styrka. ELO-poängsystemet som används för detta ändamål har sina brister, men det ger en mycket bra ungefärlig uppskattning som håller över tiden. En poäng på 2700 eller högre är allmänt erkänt som världsklass (topp 30 i världen). Världens bästa spelare är strax under 2850. Ingen människa har någonsin uppnått en poäng på 2900.

I mitten av 90-talet såg vi den första AI-motorn (Deep Blue) som nådde en världsklass-nivå. Den praktiska implikationen av denna milstolpe var den breda antagandet av motorer av spelare på alla nivåer för övning och analys. Faktum är att motoranvändning blev essentiell för världens bästa spelare. Men under flera generationer av dessa världsklassmotorer var det nödvändigt att granska deras rekommenderade drag (dvs. utdata). Det fanns till och med ett särskilt format som skapades kallat “avancerat schack” där människor tävlade med en motor bredvid sig, och människa + maskinkombinationen ansågs vara överlägsen maskinen ensam.

Det tog ungefär 20 år, och viss kritisk framsteg inom djupinlärning och förstärkt inlärning för schackmotorer att nå övermänsklig nivå (ungefär 3200 ELO). Men när denna stratosfär väl bröts runt 2017, hände något mycket överraskande. Ja, faktiskt hände två saker. Den första var helt förväntad; motorerna blev den de facto-källan till “sanning” i 99% av alla positioner. I praktiken betydde det att vi gick in i “eran av blind tillit” till motorn. Dessa dagar är det praktiskt taget omöjligt för en människa att föreslå ett betydligt bättre drag än motorn. Så underhållande “avancerat schack” var, är det nu en meningslös övning; människor skulle bidra med nästan ingenting till spelet. Men den andra var chockerande för de flesta schackspelare. Dessa övermänskliga neurala (dvs. djupa neurala nätverk) motorer skulle ibland spela i en stil som bäst kan beskrivas som “romantisk”. Med andra ord, de skulle göra drag vars värde bara kunde uppskattas många, många drag senare, långt bortom vad någon människa eller världsklassmotor kunde beräkna. Det kändes mycket som om motorerna utvecklat en “känsla” eller en “intuition” för vissa positioner. Utom att denna intuition är ingenting en människa någonsin kunde förstå eller imitera.

Uttryckt på ett annat sätt kan en övermänsklig neural motor göra drag som är bortom den kognitiva horisonten för en människa. Detta är den kritiska punkten här; problemet är inte frågan om förklarbarhet. Snarare kan en människa inte förstå varför en motor rekommenderar ett drag utan att spela ut positionen och observera resultatet många drag senare, dvs. rulla ut hela trajektorien av möjliga spelsekvenser. Som ett resultat har vi en oöverstiglig klyfta i förmåga. Det är objektivt optimalt att acceptera motorutdata utan granskning. Jag kan sammanfatta mitt påstående på följande sätt:

Schack är ett bevis för att övermänsklig AI skulle fungera effektivt autonomt i vissa domäner. Att möjliggöra för AI-systemet att fatta beslut utan mänsklig granskning skulle vara det optimala sättet att distribuera ett sådant system.

Eftersom mitt påstående kan verka uppenbart eller oanmärkningsvärt, vill jag betona ett par nyanser. Anta att vi har ett AI-system som visar övermänsklig nivå i en komplex, kritisk uppgift med konkreta, oåterkalleliga konsekvenser. Det finns två implikationer av mitt påstående:

- Systemet skulle distribueras för att fatta beslut för uppgiften utan mänsklig granskning, trots den inbyggda risken

- Insikt som erhålls från övervakning av ett sådant system skulle inte förhindra ett skadligt beslut; skadan skulle redan ha skett

Systemutdatagranskning och övervakning är precis de sista två försvarslagren mot injektionsattacker. Därför kunde vår hypotetiska injektionsattack kringgå dessa lager genom att rikta sig mot det lämpliga systemet.

Detta är ett mycket realistiskt scenario i mitt sinne. Ett övermänskligt AI-system i en specifik domän är inte AGI, och de flesta experter tror att sådana system är precis runt hörnet. Vi behövde inte anta att besluten är tidskänsliga, bara att uppgiften är tillräckligt komplex för att mänsklig granskning skulle vara ohanterlig.

Men i den här artikeln är jag inte så mycket intresserad av det här eviga katt- och råttaspelet. Snarare är jag utsedd för att avgöra om en attack kan vara oförhindrad i princip. Från utvecklarens/försvararens perspektiv finns det bara en viktig insikt:

Separation av instruktioner från data i en prompt är grundläggande för att hantera injektionsrisk.

Vi kan anta att avvägningar inte är en faktor, och varje försvarslager eller teknik kan användas. Under denna (starka) antagande, är det möjligt att konstruera ett scenario där instruktion-data-separation i en prompt är effektivt omöjlig?

DNA-analogin

När frågan väl var formulerad i termer av instruktion-data-separation, var min första tanke att använda biologi som en analogi.

Tänk på en cell och en sträcka av DNA (känd som en gen). Genen ger instruktioner för att bygga ett protein genom transkription och translation. Den kodar också informationen (data) som påverkar proteinets struktur och funktion. Som sådan dikterar genen samtidigt vad som ska byggas och hur det ska byggas, eller så resonerade jag. Men detta är helt enkelt falskt eftersom en gen inte bestämmer hur den ska tolkas själv. Det finns ingen motsvarighet till instruktionsföljande i biologi på gen-nivå. “Hur” är fullständigt externaliserat till cellens maskineri.

Därför, även om jag inte kan skaka av mig känslan att framtida generationer av LLM – eller mer exakt, de system de utvecklas till – skulle likna biologiska maskiner i mycket högre utsträckning, fungerar den föreslagna analogin inte. Vi kan inte ersätta en cell med en LLM och en gen med en prompt och sedan utföra en injektion i genen som skulle orsaka ett “skadat” protein att byggas. Det verkar mer produktivt att hålla sig till naturligt språk och uppgifter som kräver semantisk tolkning.

Att avlägsna försvarslagren

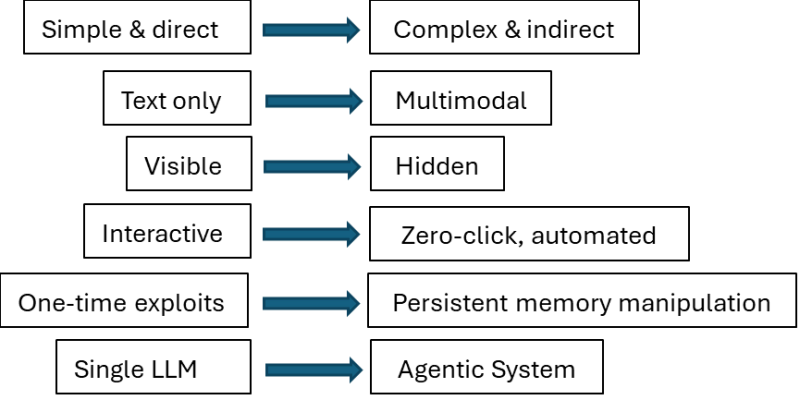

Det borde inte komma som en överraskning att försvarstrategier i flera lager anses vara mer effektiva för att stoppa injektionsattacker. Bilden nedan visar de vanligaste försvarslagren i ordning, och de associerade teknikerna som används i varje lager.

Vi har redan diskuterat de sista två lagren (utdata, övervakning) ovan, så låt oss fokusera på de första fyra.

När det gäller inmatningslagret är det rimligt att anta att sanering eller validering av prompten skulle vara ganska framgångsrik i att upptäcka indirekta attacker. Men om injektionen levereras direkt, och som föreslagits ovan, genom att lita på semantisk tolkning, perhaps är sanering irrelevant (ingenting att sanera), och validering är omöjlig som standard eftersom beräkningen måste slutföras för att identifiera problemet.

Det finns i princip inga gränser för de skyddsräcken du kunde konstruera i detekteringslagret. Faktum är att du till och med kunde använda en dedikerad LLM för injektionsdetektering. Men ännu en gång kommer det att vara svårt för en klassificerare eller en avvikelsedetektor att flagga en prompt som misstänkt när giftet är smart gömt inom semantiken.

Huset av kort

Min avsikt när jag började skriva den här artikeln var att beskriva en “oförhindrad” injektionsattack i breda drag. Kanske slutade jag med att följa en “icke-konstruktiv” approach genom att peta hål i befintliga försvarslager. Försvarstekniker fortsätter att utvecklas snabbt, och så gör attackytan. Det här spelet visar inga tecken på att ta slut snart. Men jag tror också att vi inte kommer att vara de som spelar det för mycket längre. Jag skulle gissa att den framgångsrika injektionsattacken i framtiden fortfarande kommer att vara på naturligt språk, bara ett språk som människor inte kan förstå; och jag skulle gissa att det kommer att upptäckas av ett system antingen byggt för det specifika syftet eller kanske av misstag efter att ha hanterat en relaterad uppgift, såsom att söka efter semantisk tvetydighet i någon representationsrymd.

Det finns något obehagligt i att medge att vi förlorar kontroll och ändå känna att detta är det mest rationella att göra. Du kan tänka på det som “intuitivt bevis” för att vissa attacker skulle vara obestridliga. Och om det lämnar dig obekväm, skulle du vara glad att veta att GPT 5.2 fann detta argument vara “inte kontroversiellt eller nytt” och förespråkade att jag inte “belabrar punkten” och skär ner 40% av artikeln.