Artificiell intelligens

Bristerna i Amazon Mechanical Turk kan hota system för generering av naturligt språk

En ny studie från University of Massachusetts Amherst har ställt engelska lärare mot crowdsourced-arbetare på Amazon Mechanical Turk i bedömning av utdata från system för generering av naturligt språk (NLG), och kommit till slutsatsen att låga standarder och “gaming” av uppskattade uppgifter bland AMT-arbetare kan hämma utvecklingen inom sektorn.

Rapporten kommer till ett antal fördömande slutsatser om den utsträckning till vilken den “industriella” billiga outsourcingen av öppna NLG-utvärderingsuppgifter kan leda till undermåliga resultat och algoritmer inom denna sektor.

Forskarna har också sammanställt en lista på 45 artiklar om öppen textgenerering där forskningen har använt AMT, och funnit att “den överväldigande majoriteten” inte rapporterade kritiska detaljer om användningen av Amazons crowd-tjänst, vilket gör det svårt att reproducera artiklarnas resultat.

Svettshopparbete

Rapporten riktar kritik mot både svettshoppsnaturen hos Amazon Mechanical Turk och de (troligen budgetbegränsade) akademiska projekten som ger AMT ytterligare legitimitet genom att använda (och citera) det som en giltig och konsekvent forskningsresurs. Författarna noterar:

‘Medan AMT är en bekväm och prisvärd lösning, observerar vi att hög varians mellan arbetare, dålig kalibrering och kognitivt krävande uppgifter kan leda forskare till vilseledande vetenskapliga slutsatser (t.ex. att människoskriven text är “sämre” än GPT-2:s).’

Rapporten skyller spelet snarare än spelarna, med forskarna observerar:

‘[Crowd] arbetare är ofta underbetalda för sitt arbete, vilket skadar både kvaliteten på forskningen och, viktigare, förmågan hos dessa crowd-arbetare att tjäna en skälig levnad.’

Den artikeln, med titeln Fara med att använda Mechanical Turk för att utvärdera öppen textgenerering, kommer dessutom till slutsatsen att “expertrattare” som språklärare och lingvister bör användas för att utvärdera öppen artificiell NLG-innehåll, även om AMT är billigare.

Testuppgifter

I jämförelse med AMT:s prestation mot mindre tidbegränsade, expertrattare, spenderade forskarna 144 dollar på AMT-tjänsterna som faktiskt användes i jämförelsestesterna (även om mycket mer spenderades på “icke-användbara” resultat – se nedan), vilket krävde slumpmässiga “Turks” för att utvärdera en av 200 texter, uppdelade mellan människoskapad text och artificiellt genererad text.

Att ge professionella lärare samma uppgift kostade 187,50 dollar, och bekräftade deras överlägsna prestation (i jämförelse med AMT-arbetare) genom att anställa Upwork-frilansare för att replikera uppgifterna kostade ytterligare 262,50 dollar.

Varje uppgift bestod av fyra utvärderingskriterier: grammatik (‘Hur grammatiskt korrekt är texten i berättelsen?’); sammanhängande (‘Hur väl passar meningarna i berättelsen ihop?’); tyckbarhet (‘Hur mycket tycker du om berättelsen?’); och relevans (‘Hur relevant är berättelsen för prompten?’).

Generering av texter

För att få NLG-material för testerna använde forskarna Facebook AI Researchs 2018 Hierarchical Neural Story Generation dataset, som består av 303 358 engelska berättelser komponerade av användare på den mycket populära (15 miljoner+ användare) r/writingprompts subreddit, där prenumeranternas berättelser “sås” med en-sats-prompter på ett liknande sätt som nuvarande metoder i text-till-bild-generering – och, naturligtvis, i öppen generering av naturligt språk system.

200 prompter från datasetet valdes slumpmässigt och passerade genom en medium-stor GPT-2-modell med Hugging-Face Transformers bibliotek. Således erhölls två uppsättningar resultat från samma prompter: de människoskapade diskursiva essäerna från Reddit-användare och GPT-2-genererade texter.

För att förhindra att samma AMT-arbetare bedömer samma berättelse flera gånger, söktes tre AMT-arbetarbedömningar per exempel. Tillsammans med experiment om de engelska språkfärdigheterna hos arbetarna (se slutet av artikeln) och diskontering av resultat från låginsatsarbetare (se “Kort tid” nedan), ökade den totala utgiften för AMT till cirka 1 500 dollar.

För att skapa en jämn spelplan genomfördes alla tester på vardagar mellan 11.00-11.30 PST.

Resultat och slutsatser

Studien täcker en stor mängd mark, men de viktigaste punkterna är följande:

Kort tid

Artikeln fann att den officiellt rapporterade genomsnittliga uppgiftstiden på 360 sekunder reducerades till en verklig arbetstid på bara 22 sekunder, och en medianarbetstid på bara 13 sekunder – en fjärdedel av den tid som den snabbaste engelska läraren tog för att replikera uppgiften.

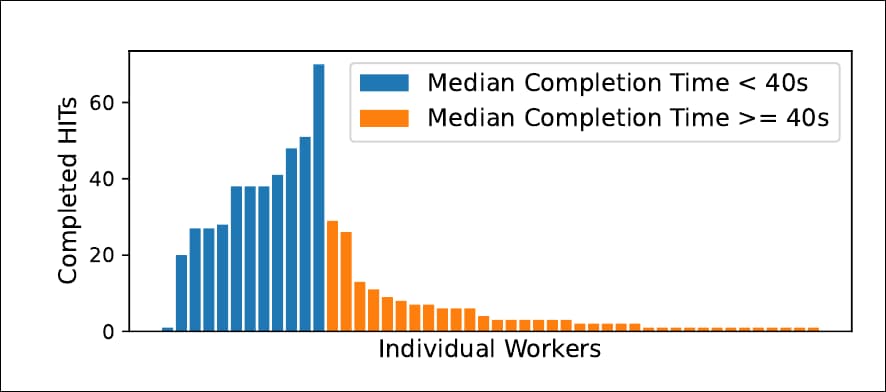

Från dag 2 av studien: de enskilda arbetarna (i orange) tillbringade betydligt mindre tid på att utvärdera varje uppgift än de bättre betalda lärarna, och (senare) de ännu bättre betalda Upwork-konsulterna. Källa: https://arxiv.org/pdf/2109.06835.pdf

Eftersom AMT inte har någon gräns för de mänskliga intelligensuppgifter (HIT) som en enskild arbetare kan ta på sig, har AMT “stjärnor” uppstått, med (lönsamma) rykten för att slutföra höga antal uppgifter per experiment. För att kompensera för accepterade träffar av samma arbetare mätte forskarna tiden mellan på varandra följande inskickade HIT, genom att jämföra start- och sluttiden för varje HIT. På detta sätt kom bristen på AMT:s rapporterade WorkTimeInSeconds och den faktiska tiden som tillbringades på uppgiften i fokus.

Eftersom ett sådant arbete inte kan utföras inom dessa reducerade tidsramar, var forskarna tvungna att kompensera för detta:

‘Eftersom det är omöjligt att noggrant läsa en paragraf-lång berättelse och utvärdera alla fyra egenskaper på så lite som 13 sekunder, mäter vi effekten på genomsnittliga betyg när vi filtrerar bort arbetare som tillbringar för lite tid per HIT…Specifikt tar vi bort bedömningar från arbetare vars median tid är under 40 sekunder (vilket är en låg ribba), och finner att i genomsnitt cirka 42% av våra betyg filtreras bort (varierar från 20%-72% över alla experiment).’

Artikeln hävdar att felaktigt rapporterad faktisk arbetstid i AMT är “en stor fråga” som vanligtvis förbises av forskare som använder tjänsterna.

Händer-hållning nödvändig

Resultaten tyder dessutom på att AMT-arbetare inte kan tillförlitligt skilja mellan text skriven av en människa och text skriven av en maskin, såvida de inte ser båda texterna sida vid sida, vilket i praktiken skulle kompromettera en typisk utvärderingsscen (där läsaren ska kunna fatta ett beslut baserat på ett enda textexempel, “äkta” eller artificiellt genererat).

Avslappnad acceptans av lågkvalitativ artificiell text

AMT-arbetare bedömde konsekvent lågkvalitativ GPT-baserad artificiell text som likvärdig med högkvalitativ, sammanhängande text skriven av människor, till skillnad från de engelska lärarna, som lätt kunde skilja på kvalitetsskillnaderna.

Ingen förberedelsetid, noll kontext

Att gå in i rätt sinnesstämning för en sådan abstrakt uppgift som bedömning av äkthet kommer inte naturligt; engelska lärare krävde 20 uppgifter för att kalibrera sin känslighet till den utvärderande miljön, medan AMT-arbetare vanligtvis inte fick någon “inriktnings tid” alls, vilket sänkte kvaliteten på deras indata.

Att spela systemet

Rapporten hävdar att den totala tiden AMT-arbetare tillbringar på enskilda uppgifter är uppblåst av arbetare som accepterar flera uppgifter samtidigt och kör igenom uppgifterna i olika flikar i sina webbläsare, istället för att fokusera på en uppgift under den registrerade uppgiftstiden.

Ursprungsland är viktigt

Standardinställningarna för AMT filtrerar inte arbetare efter ursprungsland, och rapporten noterar tidigare arbete som indikerar att AMT-arbetare använder VPN för att kringgå geografiska begränsningar, vilket möjliggör för icke-modersmål att presentera sig som modersmålsspråk (i ett system som, kanske ganska naivt, likställer en arbetares modersmål med deras IP-baserade geografiska plats).

Således körde forskarna om utvärderingstesterna på AMT med filter som begränsade potentiella deltagare till icke-engelsktalande länder, och fann att ‘arbetare från icke-engelsktalande länder bedömde sammanhängande, relevans och grammatik…lägre än identiskt kvalificerade arbetare från engelsktalande länder’.

Rapporten slutsats:

‘[Expertrattare] som lingvister eller språklärare bör användas närhelst möjligt eftersom de redan har utbildats för att utvärdera skriven text, och det är inte mycket dyrare…’

Publicerad 16 september 2021 – Uppdaterad 18 december 2021: Lade till taggar